A fecha de 26 de marzo de 2026, el error más común en la consulta openai image generation api cheaper alternative es asumir que “más barato” significa automáticamente “salir de OpenAI”. Si tu único problema es el precio oficial de entrada, la respuesta más barata y creíble sigue siendo el propio gpt-image-1-mini de OpenAI. OpenAI todavía publica para 1024x1024 los precios de \$0.005, \$0.011 y \$0.036 en low, medium y high. Solo cuando la comparación real es contra GPT Image 1.5, o cuando el problema es el workflow, entran de verdad Imagen 4 Fast, Gemini 2.5 Flash Image y FLUX.

Ahí está la confusión. Gran parte del SERP sigue tratando esta búsqueda como si fuera otro listado genérico de proveedores. Pero el lector real casi nunca está buscando una colección de logos. Está intentando resolver algo mucho más concreto: ¿de verdad necesito migrar, o simplemente estoy usando la línea cara de OpenAI? Si migro, ¿estoy sustituyendo una API de generación puntual, un workflow multimodal, un bucle de edición continua o solo una fase de experimentación demasiado cara?

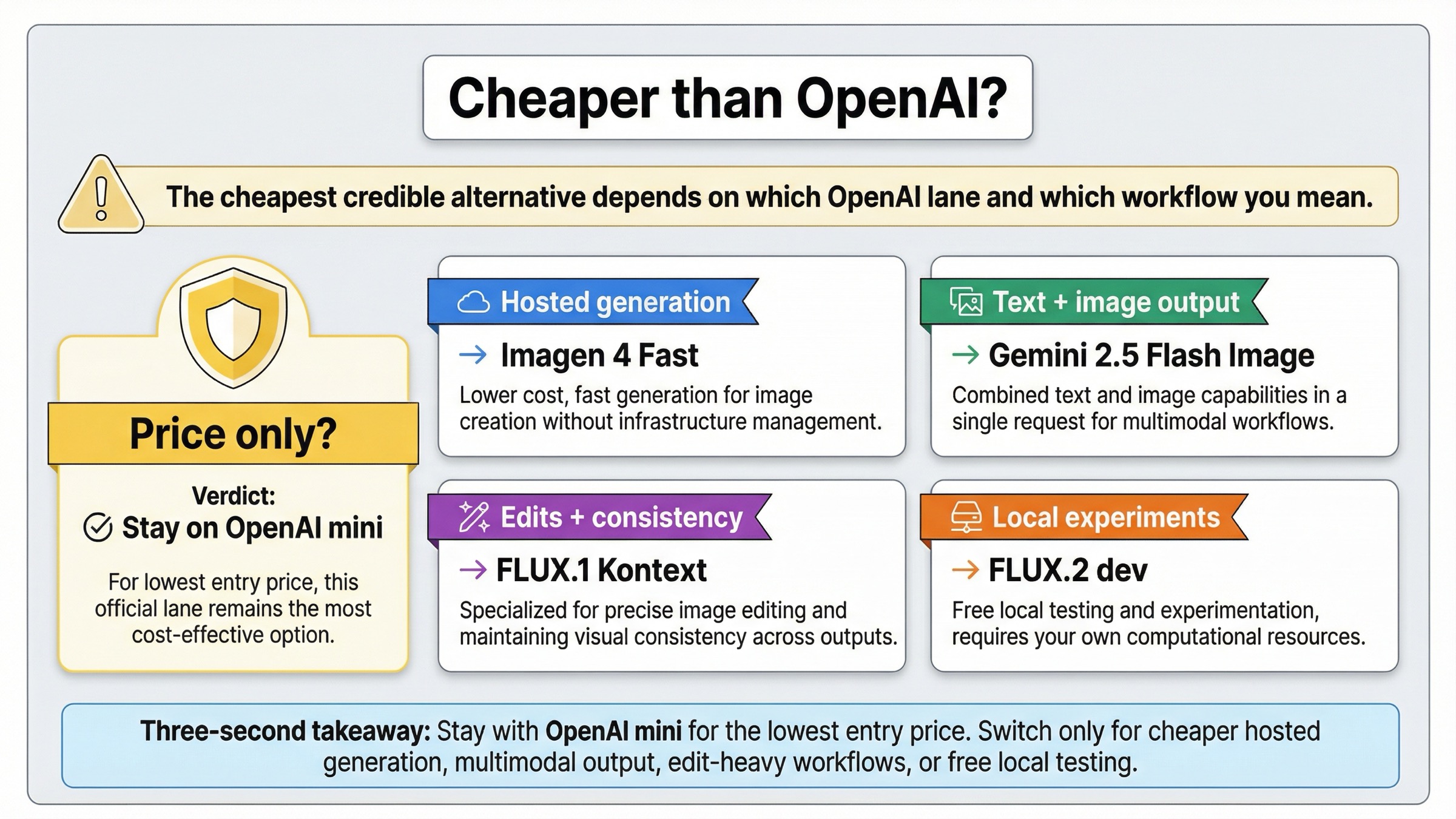

Por eso esta página no arranca con un top-10 de vendors. Arranca con una regla de cambio. Si el problema es solo el precio, quédate en OpenAI mini. Si quieres una ruta hosted más barata que GPT Image 1.5, mira Imagen 4 Fast. Si necesitas texto e imagen en una sola llamada, mira Gemini 2.5 Flash Image. Si OpenAI se encarece por las revisiones, mira FLUX.1 Kontext. Si lo que quieres es dejar de pagar mientras aprendes en local, mira FLUX.2 dev.

Resumen rápido

| Si tu problema real es... | Respuesta más barata o más adecuada | Por qué gana | Principal tradeoff |

|---|---|---|---|

| solo quieres el precio oficial de entrada más bajo | Quedarte con gpt-image-1-mini | OpenAI sigue publicando $0.005 como punto mínimo | Renuncias a parte de la calidad y de la edición fuerte de GPT Image 1.5 |

| quieres una ruta hosted más barata que GPT Image 1.5 | Imagen 4 Fast | Google publica $0.02 por imagen | No es un drop-in swap de OpenAI; es otra stack |

| necesitas texto e imagen en el mismo model call | Gemini 2.5 Flash Image | Comprime el workflow multimodal en una sola interacción | Es más difícil presupuestarlo como “precio por imagen” |

| lo caro no es la primera imagen sino las revisiones | FLUX.1 Kontext | Reduce mejor el costo efectivo en workflows edit-heavy | Su precio visible no es el headline más bajo |

| quieres experimentar en local antes de otro bill | FLUX.2 dev | Black Forest Labs lo lista como free para local non-commercial use | No es la ruta hosted comercial por defecto |

La conclusión corta es esta: no dejes OpenAI solo por la palabra “barato” antes de comparar con OpenAI mini. Solo cuando mini no cumpla por calidad o por forma de workflow merece la pena comparar GPT Image 1.5 con Imagen, Gemini y FLUX.

¿Qué opción es realmente más barata que OpenAI ahora mismo?

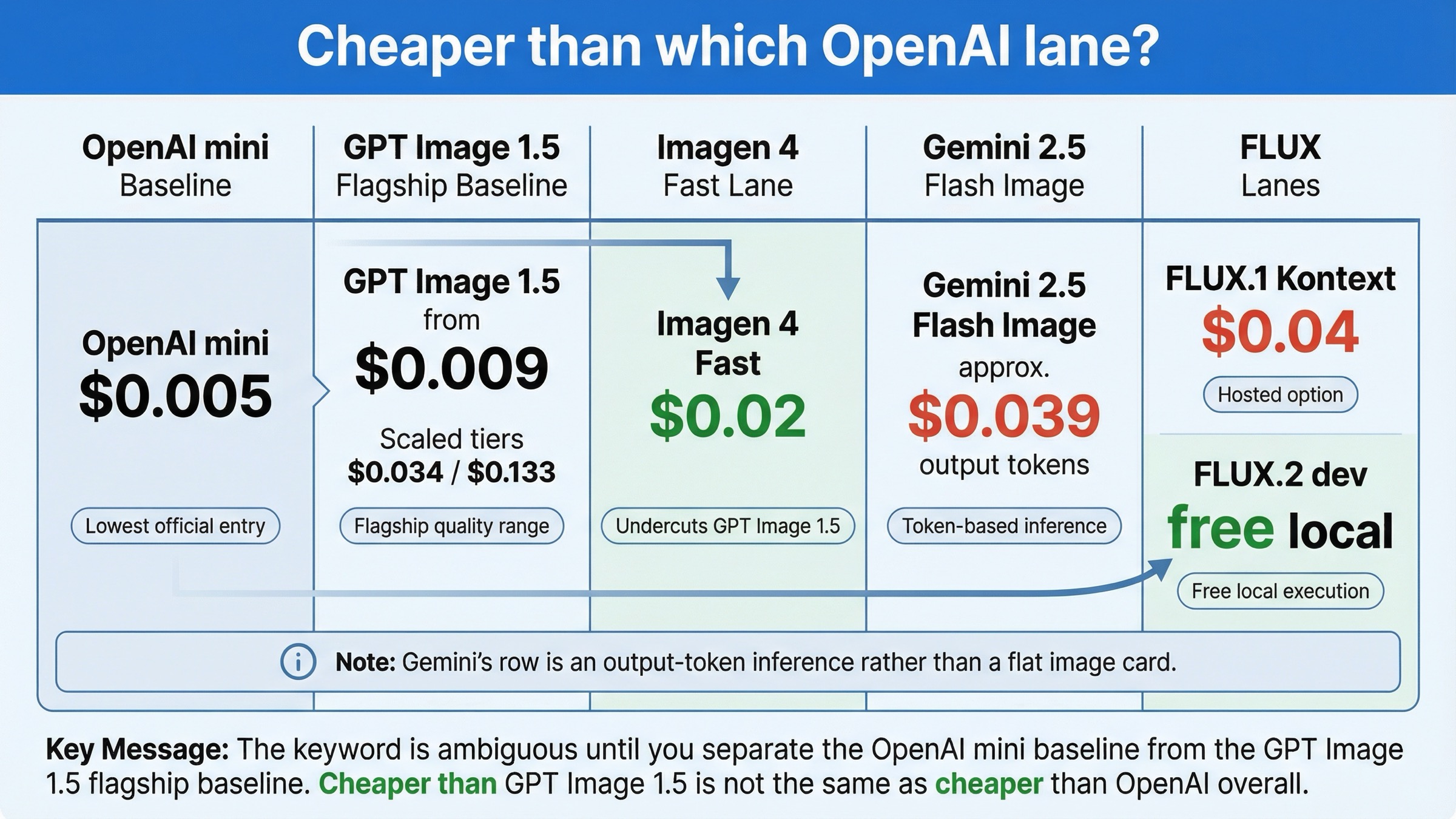

La ambigüedad más importante de esta consulta es que “más barato” siempre debería ir seguida de otra pregunta: ¿más barato que qué línea de OpenAI?

Si comparas contra GPT Image 1.5, ya existen varias respuestas creíbles y más baratas. La actual Vertex AI pricing page de Google lista Imagen 4 Fast a $0.02 por imagen, claramente por debajo de GPT Image 1.5 medium con $0.034 y high con $0.133. La actual pricing page de Black Forest Labs lista FLUX.1 Kontext [pro] a $0.04, que no es más barato que GPT Image 1.5 medium, pero puede salir mejor en workflows con muchas ediciones. Esa misma página también lista FLUX.2 [dev] como free para local development y non-commercial use, lo cual importa mucho si tu objetivo real es cortar gasto mientras aprendes.

Si comparas contra toda la familia actual de OpenAI, la respuesta cambia. La página de gpt-image-1-mini de OpenAI sigue mostrando el suelo oficial más bajo de esta comparación: $0.005, $0.011 y $0.036. Justamente por eso tantos resultados de “alternatives” resultan engañosos. Comparan a los demás contra GPT Image 1.5 y dejan que el lector olvide que OpenAI ya tiene un carril budget dentro de casa.

La forma más simple de ordenar estas superficies es esta tabla.

| Opción | Price surface actual | Fila visible más baja | Mejor encaje | Lo que resuelve peor |

|---|---|---|---|---|

gpt-image-1-mini | Modelo de imagen oficial de OpenAI | $0.005 | Generación oficial de OpenAI al menor coste | Calidad premium y edición más robusta |

| GPT Image 1.5 | Modelo flagship de imagen de OpenAI | $0.009 | Mejor calidad, mejor text rendering y mejores edits | Generación con prioridad de presupuesto |

| Imagen 4 Fast | Ruta hosted de generación de Google | $0.02 | Hosted generation más barata que GPT Image 1.5 | El mínimo de entrada frente a OpenAI mini |

| Gemini 2.5 Flash Image | Modelo multimodal con precio por tokens | Inferencia: unos $0.039 por imagen solo en output tokens | Un solo call para razonar, responder y renderizar | Planificación limpia por imagen |

| FLUX.1 Kontext [pro] | Ruta hosted edit-first de BFL | $0.04 | Revisiones, consistencia, cambios de texto | El headline price más bajo |

| FLUX.2 dev | Modelo local no comercial | Gratis | Experimentación local | Producción hosted comercial |

La fila de Gemini necesita una nota aparte. Google no publica Gemini 2.5 Flash Image como una tarjeta plana “por imagen” del mismo modo que sí lo hace con Imagen. Su documentación indica que una imagen generada consume 1290 image output tokens, y Vertex pricing publica $30 por 1M image output tokens. De ahí sale una inferencia de aproximadamente $0.039 por imagen solo en output tokens, sin contar input tokens. Es una inferencia a partir de cifras oficiales, no un precio plano aparte.

Así que la pregunta correcta no es “quién es el más barato”, sino “qué es más barato respecto a qué línea de OpenAI y para qué workflow”.

Quédate con gpt-image-1-mini si el problema es solo el precio

Esta es la parte que muchos artículos sobre alternativas intentan suavizar porque rompe la narrativa cómoda de “vete a otro proveedor”. Pero para muchos equipos es la recomendación más útil.

La propia image generation guide de OpenAI dice que gpt-image-1-mini es la opción más coste-eficiente cuando la calidad no es la prioridad principal. Y eso importa porque muchísimos equipos no están enfadados con OpenAI como proveedor. Lo que les pasa es otra cosa: empezaron con la línea flagship y después descubrieron que su workload real se parece más a drafts baratos, variantes internas, materiales desechables o imágenes de bajo riesgo que a producción visual premium.

Si ese es tu caso, migrar de proveedor suele ser el movimiento equivocado. El paso con menos fricción es quedarte dentro del mismo billing relationship de OpenAI y probar mini con tus prompts reales. No cambias de stack, no reescribes rutas, y el price floor sigue siendo más bajo que el de las alternativas hosted más visibles de esta comparativa.

Aquí es donde el SERP sigue exagerando. Muchas páginas convierten “OpenAI feels expensive” en “leave OpenAI”. Pero un problema de presupuesto no siempre es un problema de proveedor. A veces es solo un problema de elegir mal el lane.

Yo me quedaría con OpenAI mini cuando:

- el workload sigue siendo mostly one-shot generation

- ya tienes billing e infraestructura montados sobre OpenAI

- no necesitas text+image output en la misma llamada

- optimizas el menor precio oficial de entrada, no un cambio de marca

Si el benchmark falla en calidad o fiabilidad de edición, entonces sí tiene sentido seguir mirando. Pero si saltas ese benchmark y migras directamente, puedes acabar haciendo un cambio mucho mayor del que la economía exigía.

Si quieres revisar la superficie completa de precios de OpenAI antes de decidir, mira OpenAI image generation API pricing y gpt-image-1-5 cost per image. Ahí está la matemática de presupuesto que aquí comprimimos a propósito.

Usa Imagen 4 Fast si quieres una ruta hosted más barata que GPT Image 1.5

Si ya sabes que el problema es GPT Image 1.5 y no OpenAI mini, entonces Imagen 4 Fast es la alternativa hosted más clara y más fácil de justificar.

La actual Vertex AI pricing page de Google lista Imagen 4 Fast a $0.02 por imagen. Además, la documentación de Imagen 4 deja clara la forma del producto: es una línea generation-first sobre Vertex AI y soporta hasta 4 output images por prompt. Eso importa porque aquí no comparas un chat model que también puede dibujar, sino una ruta de generación de imágenes con otra ruta de generación de imágenes.

Por eso Imagen 4 Fast encaja mejor cuando el lector dice algo como:

- “GPT Image 1.5 es demasiado caro para mi volumen”

- “quiero llevar esta parte a Google Cloud”

- “no necesito text+image output en el mismo call”

- “prefiero un coste por imagen claro antes que token math multimodal”

Pero eso no convierte a Imagen 4 Fast en la respuesta universal a toda búsqueda de “cheaper alternative”. No gana frente a OpenAI mini en el lowest official entry price. Su valor está en ser más barato que GPT Image 1.5 para hosted generation, no en ser más barato que cualquier opción de OpenAI.

Para equipos con producción de calidad media esto es clave. Si tu default actual es GPT Image 1.5 medium a $0.034, pasar a Imagen 4 Fast a $0.02 puede ser una reducción de coste muy limpia. Pero si tu default correcto debería haber sido OpenAI mini, Imagen no era la primera optimización.

La regla operativa es sencilla. Usa Imagen 4 Fast cuando la comparación real sea contra GPT Image 1.5, no cuando la comparación real sea contra OpenAI mini.

Usa Gemini 2.5 Flash Image si necesitas texto e imagen en una sola llamada

Hay lectores que parecen buscar un image API más barato cuando en realidad el problema caro no es el precio de la imagen, sino la orquestación alrededor.

Ese es el mejor caso para Gemini 2.5 Flash Image. La actual documentación del modelo de Google indica que el modelo acepta text e image inputs y devuelve text e image outputs. Eso lo convierte en otra categoría de producto frente a la ruta directa de OpenAI o frente a Imagen. Se elige Gemini no porque tenga la cifra más simple “por imagen”, sino porque quieres que una sola interacción entienda contexto, responda y renderice.

Ahí también es donde se vuelven confusas muchas comparaciones de precio. Si obligas a Gemini 2.5 Flash Image a pelear solo como “una imagen más barata”, pierdes su principal fuente de ahorro. El ahorro puede venir de comprimir el workflow, no del flat image row más bajo. Si un call de Gemini sustituye una llamada de texto, otra de imagen y parte del glue de enrutado, el total del workflow puede ser más barato aunque el número “por imagen” no sea el más bajo en papel.

Lo contrario también es cierto. Si tu producto solo necesita un generate-image endpoint limpio, Gemini suele ser menos claro como comparación y encaja mejor Imagen 4 Fast o la propia familia de imágenes de OpenAI.

Yo miraría Gemini 2.5 Flash Image cuando:

- la aplicación necesita text e image output en el mismo turno

- simplificar model calls importa más que una cifra mínima por imagen

- el producto ya está pensado como workflow multimodal

- el cost problem real está en la complejidad de la orquestación

Si solo necesitas one-shot image generation, esta no suele ser la cheaper path más limpia. En esos casos es más lógico quedarse en OpenAI image routes o ir a Imagen.

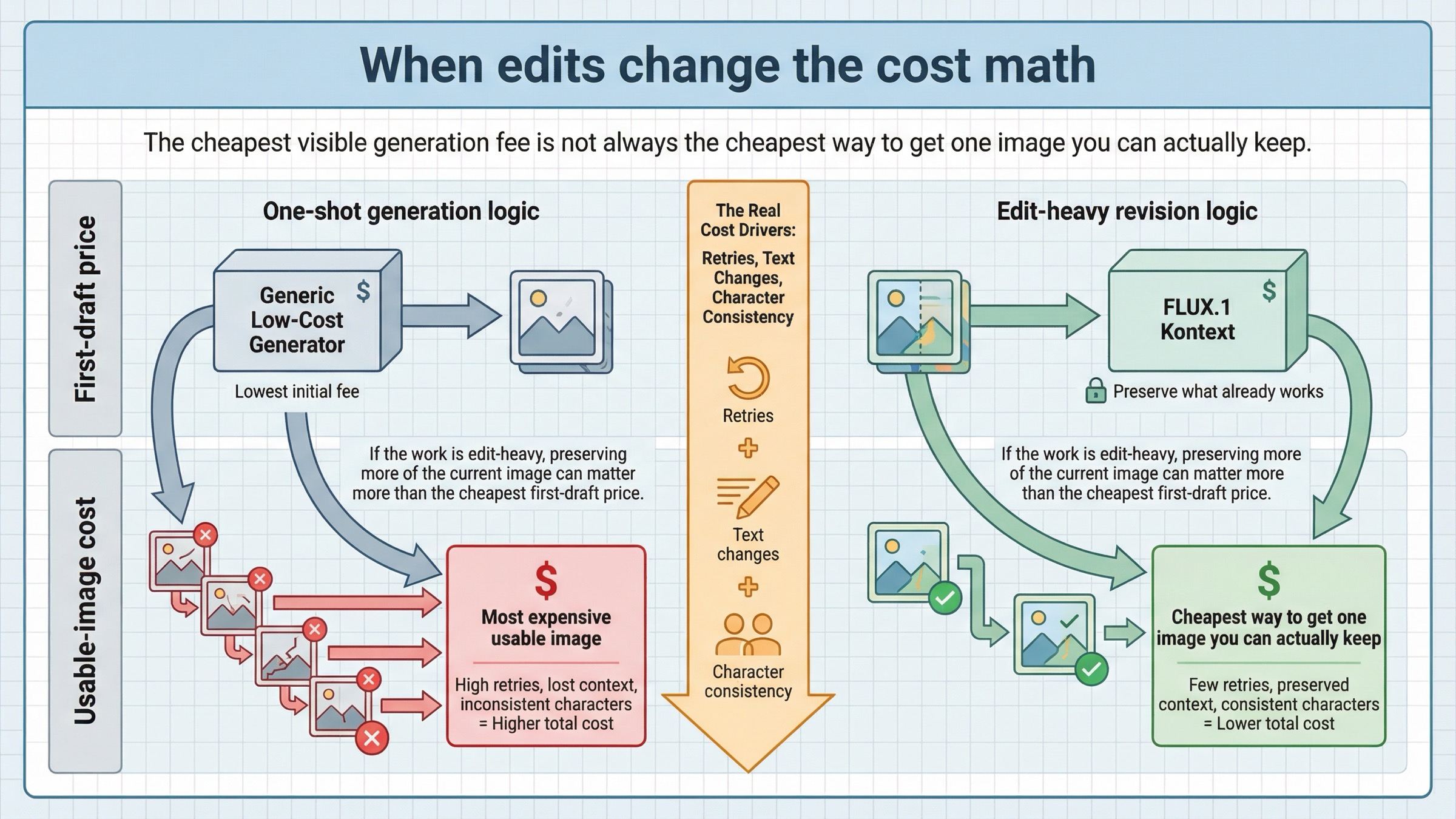

Usa FLUX.1 Kontext cuando las ediciones disparan el costo real

Esta es la sección que la mayoría de páginas sobre “cheaper alternatives” debería tener y casi nunca tiene.

El costo real de image generation muchas veces no está en la primera imagen, sino en cuántos intentos necesitas para llegar a una imagen que realmente puedas conservar. Por eso FLUX.1 Kontext pertenece a este artículo aunque su $0.04 publicado no sea el headline price más bajo del mercado.

El Kontext overview de Black Forest Labs posiciona el modelo alrededor de image editing, character consistency, text editing y style transformation. Eso no es la promesa de “otro generador barato”. Es la promesa de preservar más de lo que ya funciona para que dejes de pagar reinicios innecesarios.

Si tu equipo vive diciendo cosas como:

- “deja el personaje y cambia solo el fondo”

- “mantén la composición y reescribe el texto”

- “no toques el ángulo del producto, corrige la tipografía”

- “mantén el estilo de campaña y crea cinco variaciones”

entonces el cost center real suele ser la iteración, no la generación inicial. En ese contexto, un modelo que conserva mejor la imagen actual puede salir más barato en la práctica que otro con mejor precio de primera fila.

Por eso no describiría Kontext como un reemplazo universal de OpenAI. Responde mejor a un dolor más estrecho. Si el problema es el costo one-shot, pueden ganar mini o Imagen. Si el problema son las revisiones, Kontext se vuelve mucho más convincente.

La pregunta correcta aquí no es “¿Kontext es más barato por imagen?”, sino “¿Kontext reduce la cantidad de intentos pagados necesarios para llegar a una imagen utilizable?”

Para más contexto técnico puedes ir a FLUX.1 API guide. Por ahora aquí sigue haciendo falta un fallback explícito al inglés.

Usa FLUX.2 dev si primero quieres experimentar en local

No todos los lectores están ya en fase de escoger un nuevo proveedor hosted. Algunos simplemente quieren comprobar si esta feature de imagen merece seguir adelante.

Ahí es donde FLUX.2 dev se vuelve especialmente fuerte. La actual pricing page de Black Forest Labs lo lista como free para local development y non-commercial use. Eso lo convierte en una gran respuesta no a “qué API hosted debo migrar mañana”, sino a “cómo dejo de pagar mientras aclaro el workflow”.

Este punto importa más de lo que admiten muchos roundups. Buena parte de la demanda de “alternativas baratas” aparece antes de que el buyer haya estabilizado el caso de uso real. Siguen probando prompts, edit loops, pipelines de assets y umbrales de calidad. En esa etapa, el movimiento más racional puede ser no abrir otro hosted bill.

Eso no convierte a FLUX.2 dev en el reemplazo hosted comercial de OpenAI. Lo convierte en un puente entre una fase cara de experimentación y una decisión de producción mejor informada. Cuando termines de aprender en local, podrás decidir si la ruta correcta es OpenAI mini, Imagen 4 Fast, Gemini, hosted FLUX o cualquier otra.

Si tu objetivo real es “dejar de pagar mientras aprendo”, FLUX.2 dev es una de las mejores cheaper alternatives de toda esta página.

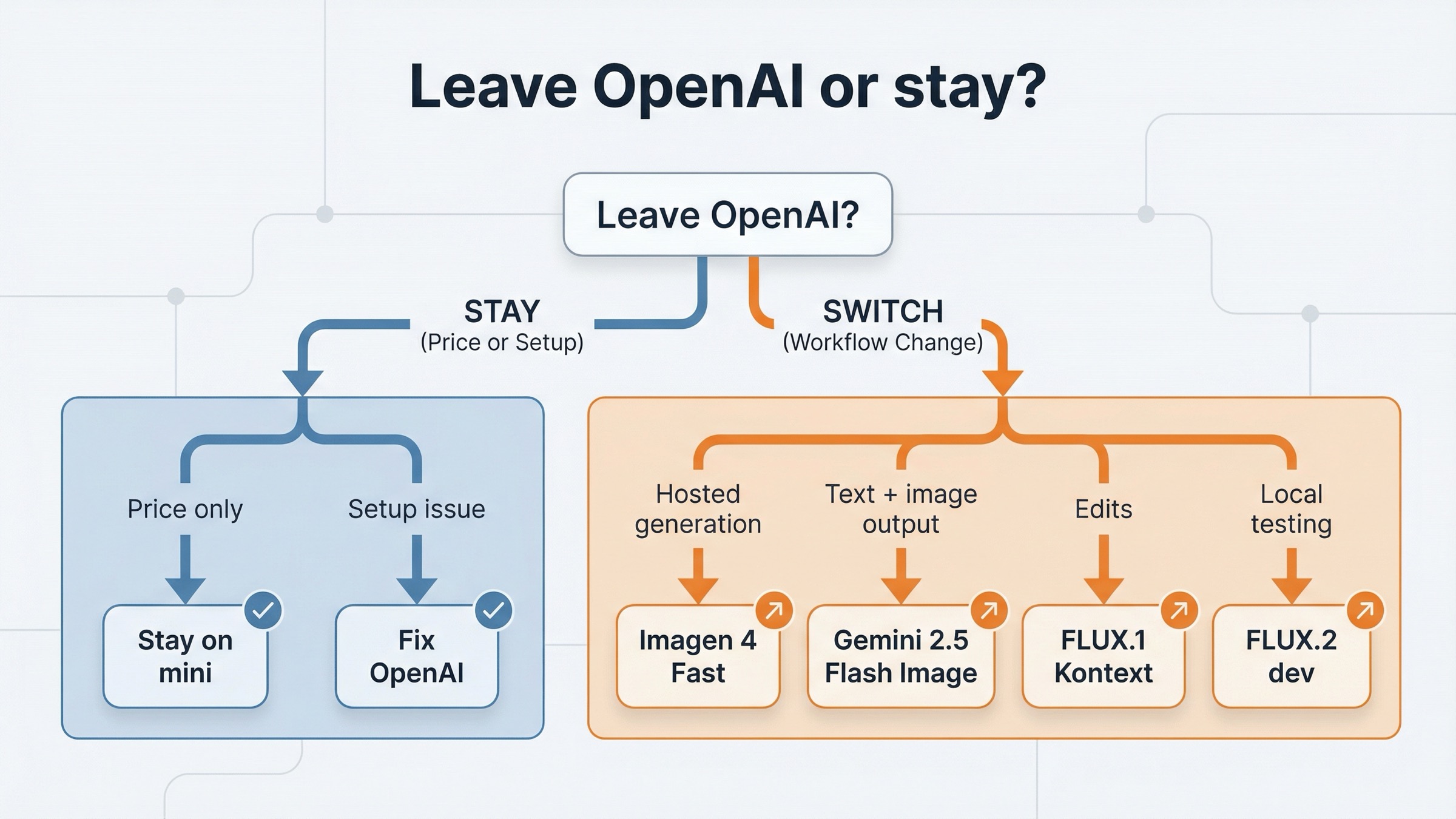

Cuándo la respuesta correcta sigue siendo quedarse con OpenAI

Una página de alternativas que merezca confianza tiene que decir con claridad cuándo no deberías cambiar.

El actual artículo de OpenAI sobre model availability sigue vinculando el acceso a gpt-image-1 y gpt-image-1-mini con usage tiers y, en algunos casos, con organization verification. Los hilos de la comunidad de OpenAI muestran bien cómo esa fricción operativa se interpreta como si fuera un problema de producto. En un developer thread, por ejemplo, usuarios reportaron 429 incluso antes de la primera imagen generada; las respuestas volvían a free tier, Tier 1 y verification. En otro diagnostic thread, los silent failures y salidas incompletas se leen como “el proveedor falla”, cuando la raíz puede ser carga, route confusion o estado de acceso.

Eso no significa que la frustración sea falsa. Significa que a veces la alternativa más barata no es un producto nuevo, sino arreglar el setup y volver a la línea correcta de OpenAI.

Yo me quedaría en OpenAI cuando:

- el problema es access, tier, verification o route choice, no model fit

- el workload sigue siendo mostly one-shot generation

- mini ya cumple el objetivo de presupuesto

- el costo de migrar supera la diferencia de precio que intentas ganar

Si después de eso la pregunta de reemplazo más amplia sigue abierta, ve a OpenAI image generation API alternative. Si el problema es más de ruta que de precio, OpenAI image API tutorial es el siguiente paso más útil.

FAQ

¿Cuál es ahora la alternativa más barata a OpenAI image generation API?

Si te refieres a una alternativa a OpenAI en general, la respuesta muchas veces sigue siendo el propio gpt-image-1-mini de OpenAI, porque low 1024x1024 sigue listado en $0.005. Si te refieres a una alternativa a GPT Image 1.5, la respuesta hosted más clara es Imagen 4 Fast a $0.02.

¿Imagen 4 Fast es más barata que OpenAI?

Suele ser más barata que GPT Image 1.5, pero no es más barata que gpt-image-1-mini en el mínimo oficial de entrada.

¿Gemini 2.5 Flash Image es realmente más barato?

A veces sí, pero normalmente porque comprime el workflow en un solo multimodal call, no porque publique el flat image row más bajo.

¿Cuándo sale más barato FLUX.1 Kontext?

Cuando el centro de costo real está en las ediciones repetidas, los cambios de texto, la consistencia de personajes y el número de retries. Ahí importa más el costo por imagen utilizable que el costo del primer draft.

¿Qué pasa si mi problema con OpenAI image API es en realidad fricción de setup?

Entonces el movimiento más barato suele ser no migrar todavía: arreglar tier, verification y route, y luego hacer benchmark con gpt-image-1-mini.