A fecha de 22 de marzo de 2026, el precio de OpenAI image generation API va de $0.005** a $0.20 por imagen de salida, segun modelo, calidad y tamano.** La pregunta util de presupuesto no es solo cuanto vale la imagen, sino que lane de imagen de OpenAI estas usando de verdad y si tambien aplican tokens de entrada de texto o imagen.

Ahi es donde fallan la mayoria de paginas de precio rapido. Una generacion simple puede comportarse casi como pay-per-image, pero los prompts largos, las ediciones y los workflows con referencias agregan otras piezas facturables. La pagina oficial de precios de OpenAI y la guia de generacion de imagenes lo separan mucho mejor que la mayoria de calculadoras externas.

Resumen rápido

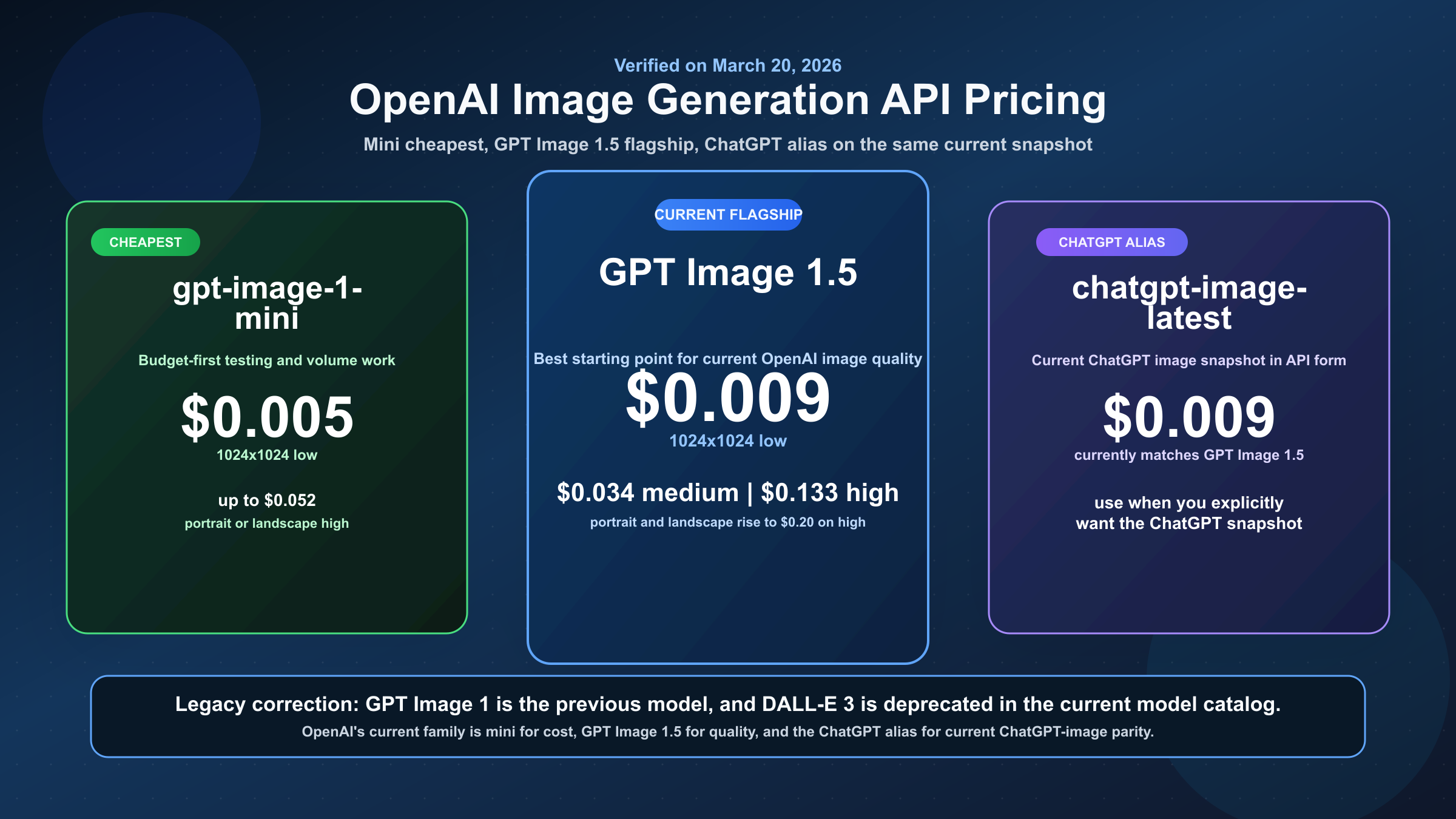

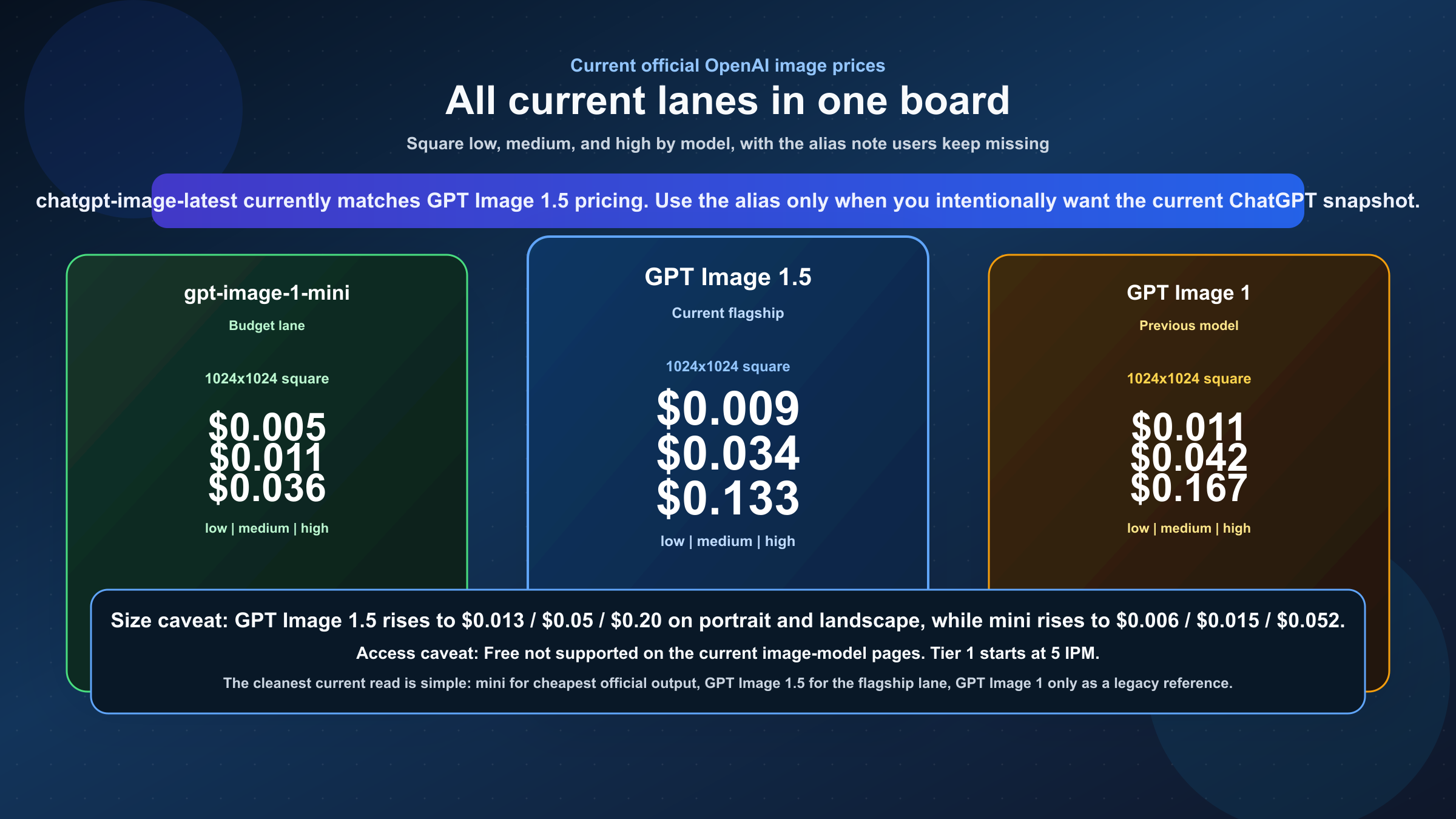

| Modelo | Papel actual | 1024x1024 low | 1024x1024 medium | 1024x1024 high | Mejor para |

|---|---|---|---|---|---|

| GPT Image 1.5 | Buque insignia actual | $0.009 | $0.034 | $0.133 | Producción, edición, trabajos donde la calidad importa más |

gpt-image-1-mini | Ruta actual más barata | $0.005 | $0.011 | $0.036 | Prototipos, borradores masivos, escenarios cost-first |

chatgpt-image-latest | Alias de ChatGPT | $0.009 | $0.034 | $0.133 | Cuando quieres igualar explícitamente la imagen actual de ChatGPT |

| GPT Image 1 | Modelo anterior | $0.011 | $0.042 | $0.167 | Referencia legacy para migración o compatibilidad |

De esa tabla salen tres ideas clave.

La primera: la referencia actual es GPT Image 1.5, no GPT Image 1.

La segunda: el suelo oficial más bajo hoy está en Mini.

La tercera: la cifra por imagen describe sobre todo el output image, no siempre la factura final.

Cómo se divide hoy el precio de OpenAI por modelo

La forma más útil de leer este tema es dejar de pensar en “un solo precio de OpenAI para generar imágenes”. Hoy OpenAI expone varias rutas y cada una responde a una pregunta de presupuesto distinta.

GPT Image 1.5 es la línea principal actual. En el anuncio del 16 de diciembre de 2025, OpenAI la presentó como la nueva ruta de imágenes en ChatGPT y en la API, y el catálogo actual ya la coloca por delante de GPT Image 1. Si vas a abrir un workflow nuevo, esta es la referencia natural.

gpt-image-1-mini es la entrada de coste. Si tu primera prioridad es probar barato, generar borradores en volumen o validar si realmente necesitas el flagship, Mini es donde deberías empezar. Muchas páginas lo dejan en segundo plano, pero para una decisión de compra real es fundamental.

chatgpt-image-latest es el alias de la instantánea de imagen usada por ChatGPT. Ahora mismo coincide en precio con GPT Image 1.5, pero no responde al mismo tipo de decisión. Si quieres un model ID estable para documentación y producción, gpt-image-1.5 es más limpio. Si quieres la paridad con la imagen actual de ChatGPT, entonces sí tiene sentido usar el alias.

GPT Image 1 ha pasado a ser una referencia anterior. Todavía aparece mucho en la SERP y por eso sigue generando confusión, pero no es la mejor base para un despliegue nuevo en 2026.

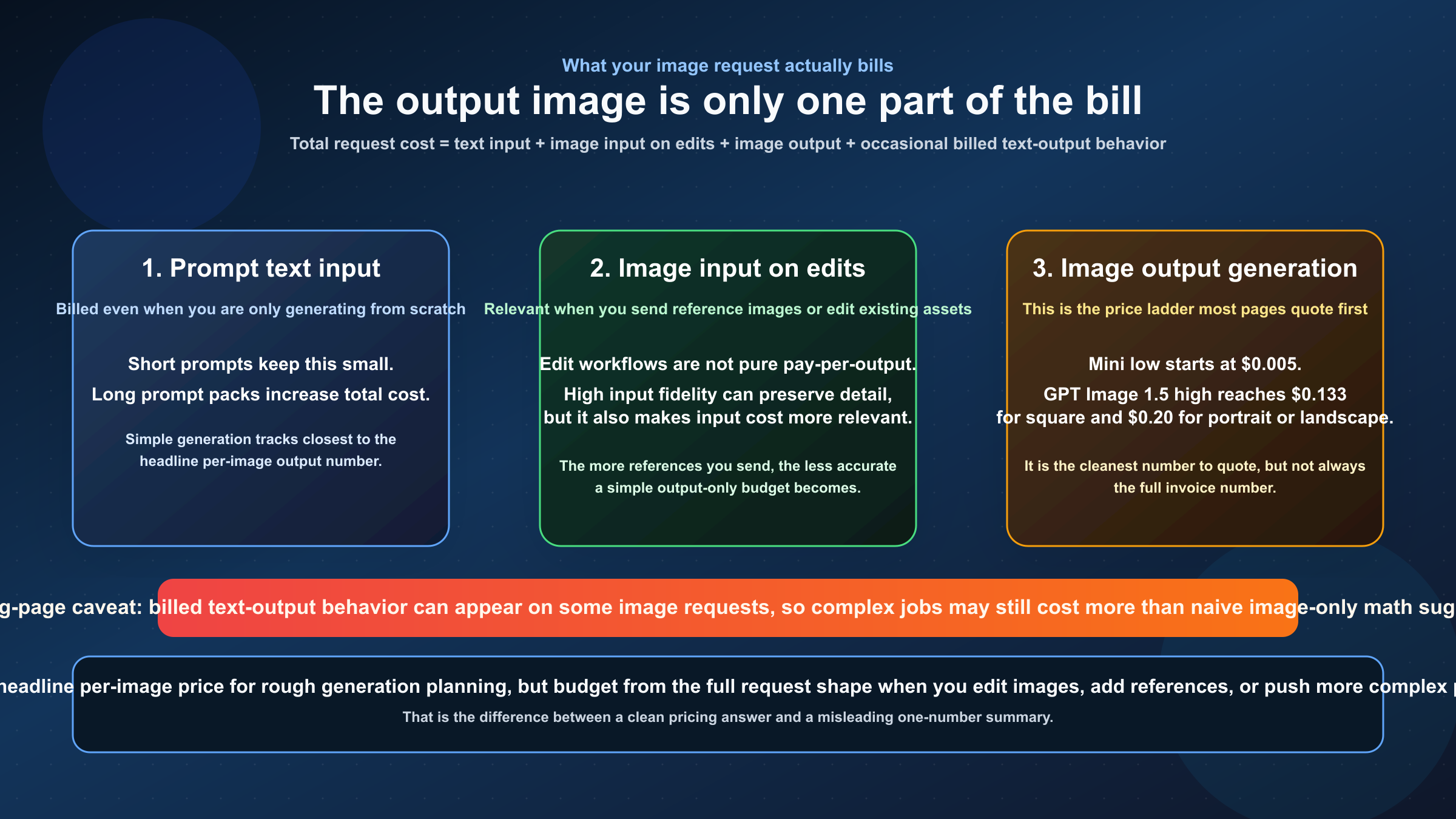

Por qué tu factura puede ser mayor que el “precio por imagen”

Aquí es donde más falla la mayoría de páginas.

Cuando ves $0.009 para GPT Image 1.5 low o $0.005 para Mini low, estás mirando sobre todo el coste de la imagen de salida. Sirve para una comparación rápida, pero no siempre equivale al coste total de la solicitud. La guía oficial de image generation deja claro que además pueden facturarse text input tokens e image input tokens.

La forma práctica de pensarlo es esta:

textcoste total de la solicitud = entrada de texto + entrada de imagen (si editas o envías referencias) + salida de imagen + algún billed text-output en ciertas solicitudes

Si solo haces text-to-image con un prompt corto, la cifra por imagen suele acercarse bastante a la realidad. Pero en cuanto entras en edición, reference images o prompts complejos, presupuestar solo con la tabla de output ya no basta. Por eso este tema no se resuelve con una sola fila de precios.

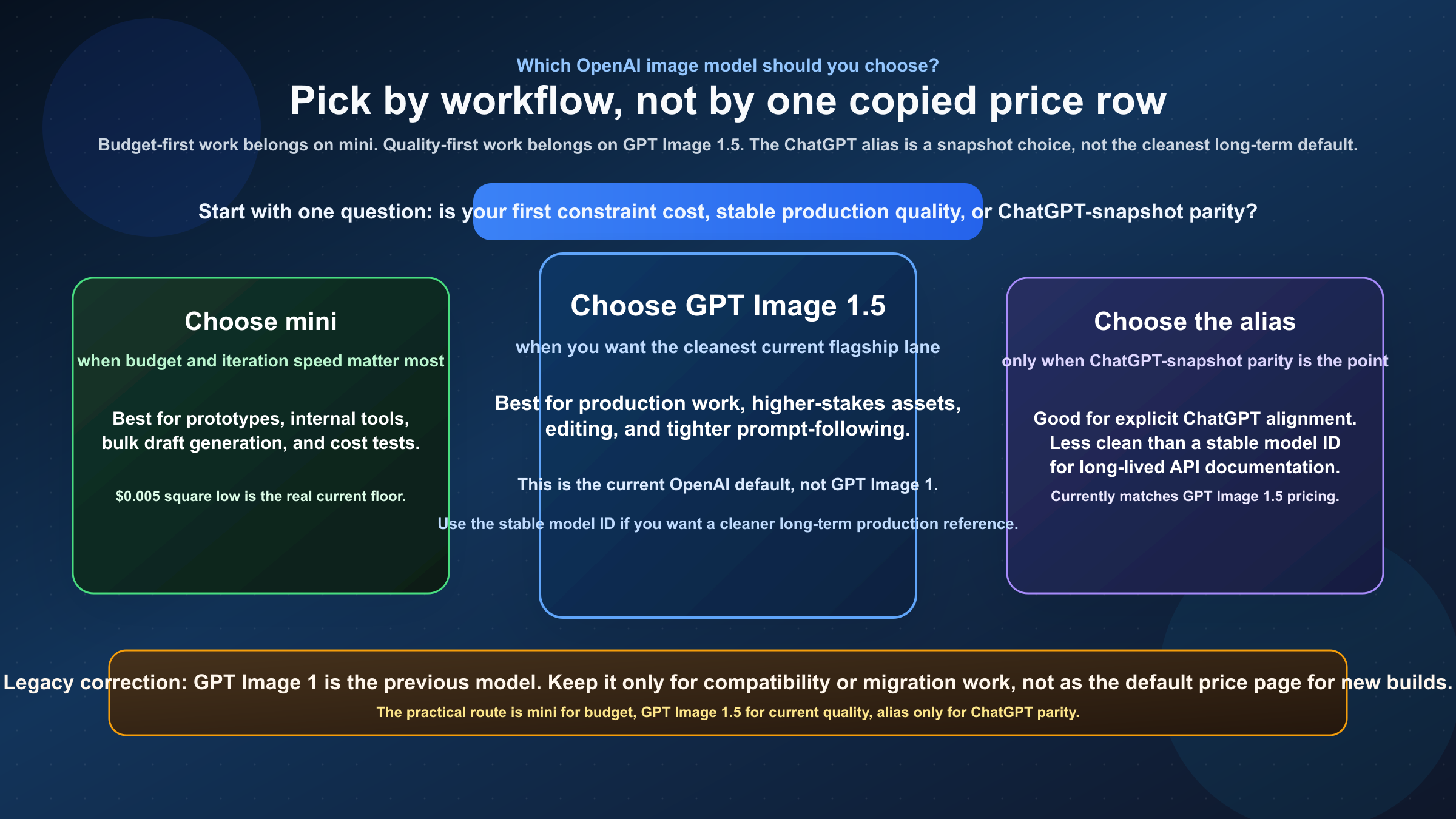

Qué ruta de OpenAI deberías elegir

La regla práctica puede resumirse así.

Si priorizas calidad, edición y estabilidad de producción, elige GPT Image 1.5.

Es la ruta más lógica para activos importantes, trabajo de edición y producción seria.

Si priorizas coste y velocidad de iteración, empieza por gpt-image-1-mini.

Es la mejor puerta de entrada para prototipos, herramientas internas, borradores masivos y validación de costes.

Si lo que quieres es igualar la instantánea actual de ChatGPT, usa chatgpt-image-latest.

Pero recuerda que un alias no es lo mismo que una referencia estable de largo plazo.

GPT Image 1 solo tiene sentido como referencia para migración o compatibilidad.

No es la mejor página base para un proyecto nuevo en 2026.

Si tu comparación real ya no es solo “qué hago dentro de OpenAI”, sino OpenAI frente a la línea actual de Google, entonces conviene pasar a Nano Banana 2 vs GPT Image 1.5.

Cómo pensar el presupuesto mensual

Si necesitas presupuesto de equipo y no solo una cifra por imagen, conviene mirar el problema por bloques de 1,000 y 10,000 imágenes.

| Escenario | Coste aproximado de output para 1,000 imágenes | Para 10,000 imágenes | Cuándo encaja |

|---|---|---|---|

| Mini low | unos $5 | unos $50 | pruebas baratas y borradores masivos |

| Mini medium | unos $11 | unos $110 | cuando buscas algo más sólido que low sin perder la lógica cost-first |

| GPT Image 1.5 medium | unos $34 | unos $340 | trabajo más cercano a producción |

| GPT Image 1.5 high | unos $133 | unos $1,330 | piezas críticas, materiales con texto y trabajos de edición fina |

Aunque estas cifras siguen centradas en output image, ya dejan claro lo importante: la diferencia entre Mini y el flagship cambia de verdad la factura cuando sube el volumen. Por eso, en equipos maduros, suele ganar una doble ruta: Mini para borradores baratos y GPT Image 1.5 para finales o casos más sensibles.

Batch también cuenta. Si tu flujo no es interactivo y puede ir a cola de fondo, la pricing page actual de OpenAI reduce aproximadamente a la mitad los precios token-level de Mini y GPT Image 1.5. En procesos nocturnos o de fondo, esa diferencia pesa mucho.

Cómo diseñar una ruta de coste más estable

El error más frecuente en equipos reales no es leer mal una cifra aislada, sino mandar todo el flujo al mismo modelo. Si usas GPT Image 1.5 high para borradores, exploración, variantes y piezas finales, la factura mensual crece mucho más rápido de lo que sugiere una tabla simple. En la mayoría de casos conviene separar el trabajo por etapas y no por una única preferencia de modelo.

Una estrategia muy práctica es esta: Mini low o medium para exploración y borradores en volumen, luego filtrado manual o programático, y solo después GPT Image 1.5 medium o high para los assets que realmente van a producción. La ventaja no es solo que una llamada salga más barata. La ventaja real es que reduces la proporción de llamadas caras dentro del volumen total del mes.

Esto pesa todavía más en workflows de edición. Cuando añades reference images, iteraciones y prompts largos, empiezan a entrar más componentes facturables además del output image. Por eso suele ser mejor descubrir dirección barata primero y pagar la ruta premium solo cuando el material ya justificó ese coste.

También ayuda pensar el presupuesto por cohortes de uso. No todas las imágenes del mes son iguales: unas son exploración, otras son variantes intermedias y otras son piezas finales para publicar. Si mezclas todo en una sola media, pierdes visibilidad. Si separas “borrador”, “selección” y “final”, enseguida ves dónde tiene sentido Mini y dónde sí compensa pagar GPT Image 1.5.

Esa separación es especialmente útil para equipos de marketing, contenidos y e-commerce. Suelen generar mucho volumen al principio y muy pocas piezas terminan llegando a producción. Ahí la pregunta correcta no es “qué modelo da la mejor imagen absoluta”, sino “qué combinación de modelos reduce el coste por asset aprobado”. En muchos casos, esa combinación gana claramente frente a una estrategia de flagship para todo.

Tres errores comunes al presupuestar

El primero es tratar el precio del output image como si fuera el precio completo del workflow. Para un text-to-image sencillo puede servir como aproximación, pero deja de ser fiable en cuanto aparecen edición, imágenes de entrada o varias repeticiones hasta llegar al resultado correcto.

El segundo es mirar solo la fila más barata y no calcular el coste de llegar a un resultado utilizable. Mini low puede ser el mejor punto de entrada, pero si un tipo de pieza necesita muchos reintentos o más posprocesado humano, la métrica relevante ya no es “cuánto cuesta una llamada”, sino “cuánto cuesta producir una imagen que sí puedo publicar”.

El tercero es mezclar precios de Batch con presupuestos de tiempo real. Si una tarea puede ejecutarse en segundo plano, Batch cambia de verdad la estructura del coste. Pero si el usuario está esperando delante de una interfaz, ese descuento no es el baseline correcto. Son dos contextos distintos y deberían modelarse por separado.

Hay un cuarto desajuste muy común, aunque no siempre se verbaliza: presupuestar con la resolución y calidad final desde el minuto uno. Si tu fase de descubrimiento puede funcionar con square low o medium, no tiene sentido asumir desde el principio portrait high o landscape high para todo el lote. El presupuesto se vuelve mucho más preciso cuando separas el coste de explorar del coste de entregar.

Otro error práctico es no distinguir entre un alias “cómodo” y un ID estable de producción. chatgpt-image-latest puede ser correcto si buscas parecerte al comportamiento actual de ChatGPT, pero para documentación interna, control de cambios y forecasting suele ser más limpio presupuestar alrededor de un modelo estable como gpt-image-1.5. Esa claridad también evita discusiones posteriores sobre por qué cambió el rendimiento o la factura.

La forma madura de cerrar este tema no es elegir un solo número mágico, sino definir una regla operativa. Por ejemplo: Mini para ideación y variaciones, GPT Image 1.5 medium para entregables normales, GPT Image 1.5 high solo para assets críticos o con texto. Cuando el equipo trabaja con una regla así, el presupuesto deja de depender de intuiciones y pasa a ser una política reproducible.

Además, esta forma de presupuestar facilita hablar con producto y finanzas. En lugar de discutir si “la imagen cuesta nueve milésimas o treinta y cuatro”, puedes explicar qué parte del volumen vive en exploración barata, qué parte pasa a revisión y qué porcentaje llega al escalón premium. Esa traducción operativa suele ser mucho más útil que una tabla aislada.

También simplifica el seguimiento posterior. Cuando la política ya distingue borrador, selección y entrega, resulta mucho más fácil detectar si el problema de coste está en demasiados reintentos, en prompts demasiado largos o en un exceso de piezas llevadas antes de tiempo al nivel high.

El coste útil es el coste por asset aprobado

En la práctica, el error más caro no suele ser leer mal una fila de la tabla, sino confundir el precio de una llamada con el precio de un resultado que realmente sirve. Para un equipo que publica, vende o entrega imágenes a clientes, la métrica útil no es solo cuánto cuesta generar, sino cuánto cuesta producir un asset aprobado. Si Mini low obliga a repetir más veces en cierto tipo de trabajo, la ventaja del precio inicial puede reducirse mucho. Si GPT Image 1.5 cuesta más por llamada pero reduce reintentos y correcciones, el coste útil puede ser mejor de lo que parece en la tabla superficial.

Por eso conviene seguir dos métricas además del gasto bruto del mes: acceptance rate y re-run rate. El acceptance rate dice qué porcentaje de imágenes pasa a la siguiente fase sin otra generación. El re-run rate muestra cuántas veces vuelve a lanzarse la misma tarea. En exploración y borradores, Mini suele seguir ganando. En assets con texto, edición fina o uso comercial delicado, GPT Image 1.5 puede compensar mejor precisamente porque baja la fricción de repetir.

También ayuda separar la operación en dos carriles. Un carril barato para exploración, variantes y cribado rápido. Un carril premium para imágenes finales, materiales que van a publicarse y trabajos donde la consistencia visual importa más que ahorrar unas décimas por llamada. Cuando haces esa separación, el presupuesto deja de ser una discusión abstracta sobre “qué modelo es más barato” y pasa a convertirse en una política operativa mucho más defendible.

Esa política es además más fácil de explicar a producto, marketing o finanzas. En vez de defender una cifra media poco intuitiva, puedes mostrar qué parte del volumen vive en ideación barata, qué parte avanza a revisión y qué porcentaje pequeño termina en la ruta más cara. Para equipos reales, esa visibilidad vale más que cualquier tabla aislada.

Por qué las páginas antiguas no coinciden entre sí

No es que OpenAI tenga una cuadrícula de precios caótica. Es que la línea de referencia cambió.

El 16 de diciembre de 2025, OpenAI lanzó GPT Image 1.5 y explicó que image input e image output eran 20% más baratos que en GPT Image 1. Eso significa que cualquier contenido que siga centrado en GPT Image 1 como si fuera la ruta principal arrastra una base antigua.

La SERP mezcla model cards oficiales, calculators y páginas del alias de ChatGPT. Cada una aporta una parte correcta, pero ninguna resuelve sola la lectura familiar completa. Por eso el usuario siente que varias páginas “parecen ciertas” y, al mismo tiempo, no responden del todo a la pregunta.

Access, descuento Batch y últimas advertencias

Primero, no es una historia de free tier. Las image model pages actuales indican Free not supported y Tier 1 desde 5 IPM.

Segundo, Batch importa de verdad. En la pricing page actual, GPT Image 1.5 y Mini bajan aproximadamente a la mitad a nivel token en Batch. Eso es útil para generación de fondo, pero no suele encajar en experiencias interactivas donde el usuario espera respuesta inmediata.

Tercero, no mezcles el precio de suscripción de ChatGPT con la facturación de la API. Para presupuestos de producción son superficies distintas.

FAQ

¿GPT Image 1.5 es hoy la línea principal de imágenes de OpenAI?

Sí. A fecha de 22 de marzo de 2026, el catálogo actual la coloca como la referencia principal.

¿Cuál es hoy el precio oficial mínimo?

El suelo actual está en gpt-image-1-mini low 1024x1024 por $0.005.

¿chatgpt-image-latest cuesta distinto que GPT Image 1.5?

Hoy no. Pero como alias, sigue siendo una decisión distinta a elegir un model ID estable.

¿Por qué mi factura puede ser mayor que la tabla por imagen?

Porque además del output image pueden entrar text input, image input y algunos casos de billed text-output.

¿Existe free tier para la línea actual de imágenes de OpenAI?

Según las image model pages actuales, no: aparece Free not supported.