A fecha del 24 de marzo de 2026, si solo te importa el precio oficial de entrada más bajo, no deberías salir de OpenAI. La ruta oficial más barata sigue siendo gpt-image-1-mini, con $0.005 para una imagen low de 1024x1024. El cambio solo tiene sentido cuando lo que necesitas ya no es “algo más barato”, sino una superficie de trabajo diferente.

Ahí es donde la SERP suele fallar. Demasiadas páginas responden a este tema con un ranking amplio de image APIs, como si listar muchos nombres resolviera la decisión. Pero la mayoría de lectores que buscan una alternativa a OpenAI no quieren “todo el mercado”. Quieren resolver un cuello de botella concreto: mover la generación a Google Cloud, obtener texto e imagen en una sola llamada, trabajar mejor con revisiones y consistencia, o probar el flujo localmente antes de asumir otra factura hosted.

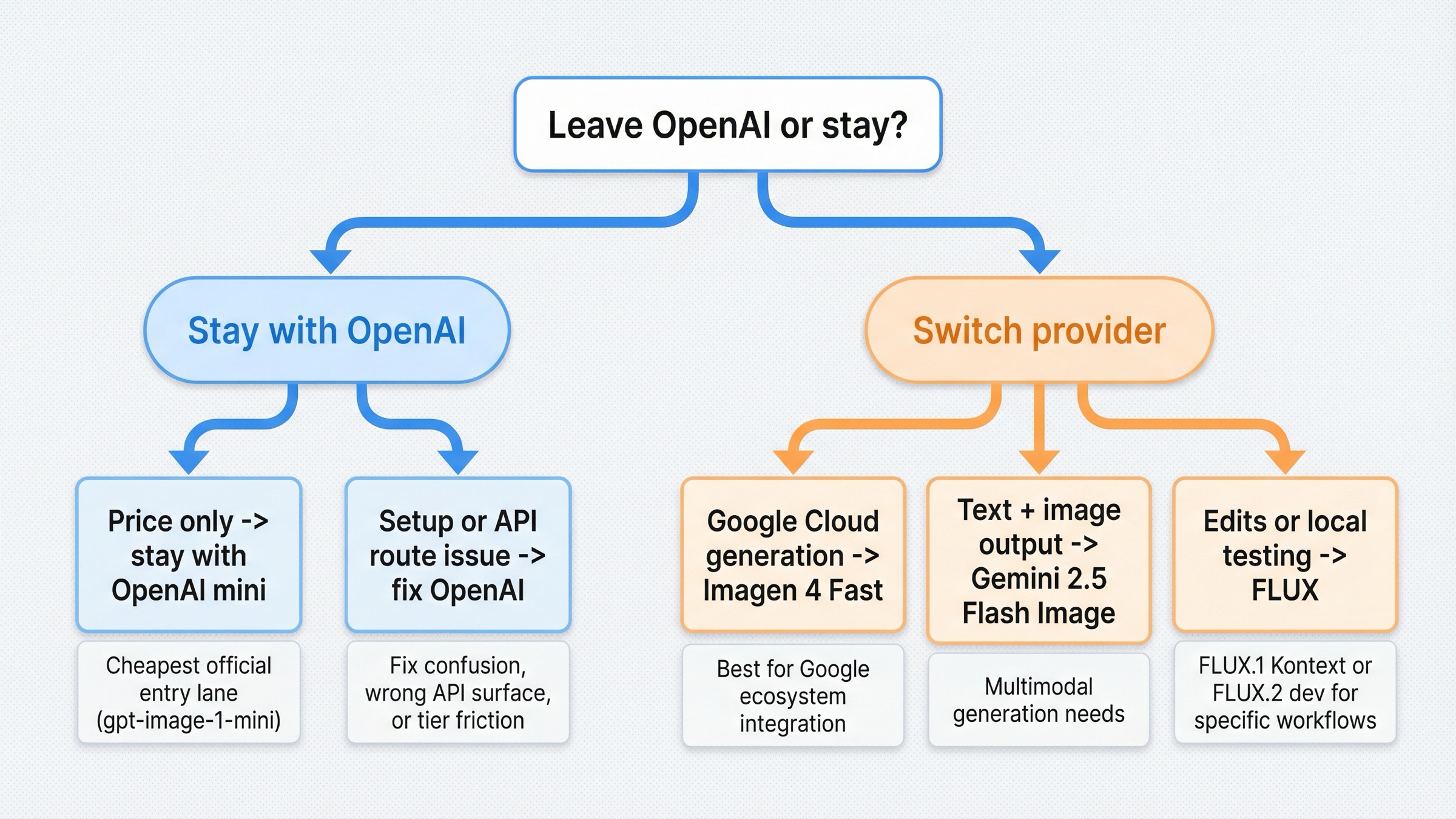

Y conviene decir una cosa desde el principio: no toda búsqueda de “alternativa a OpenAI” implica que haya que cambiar de proveedor. En su propio image generation guide, OpenAI ya separa el camino directo de generación/edición del flujo conversacional editable. A veces el problema no es el proveedor, sino la ruta API elegida o el estado de tier y verificación.

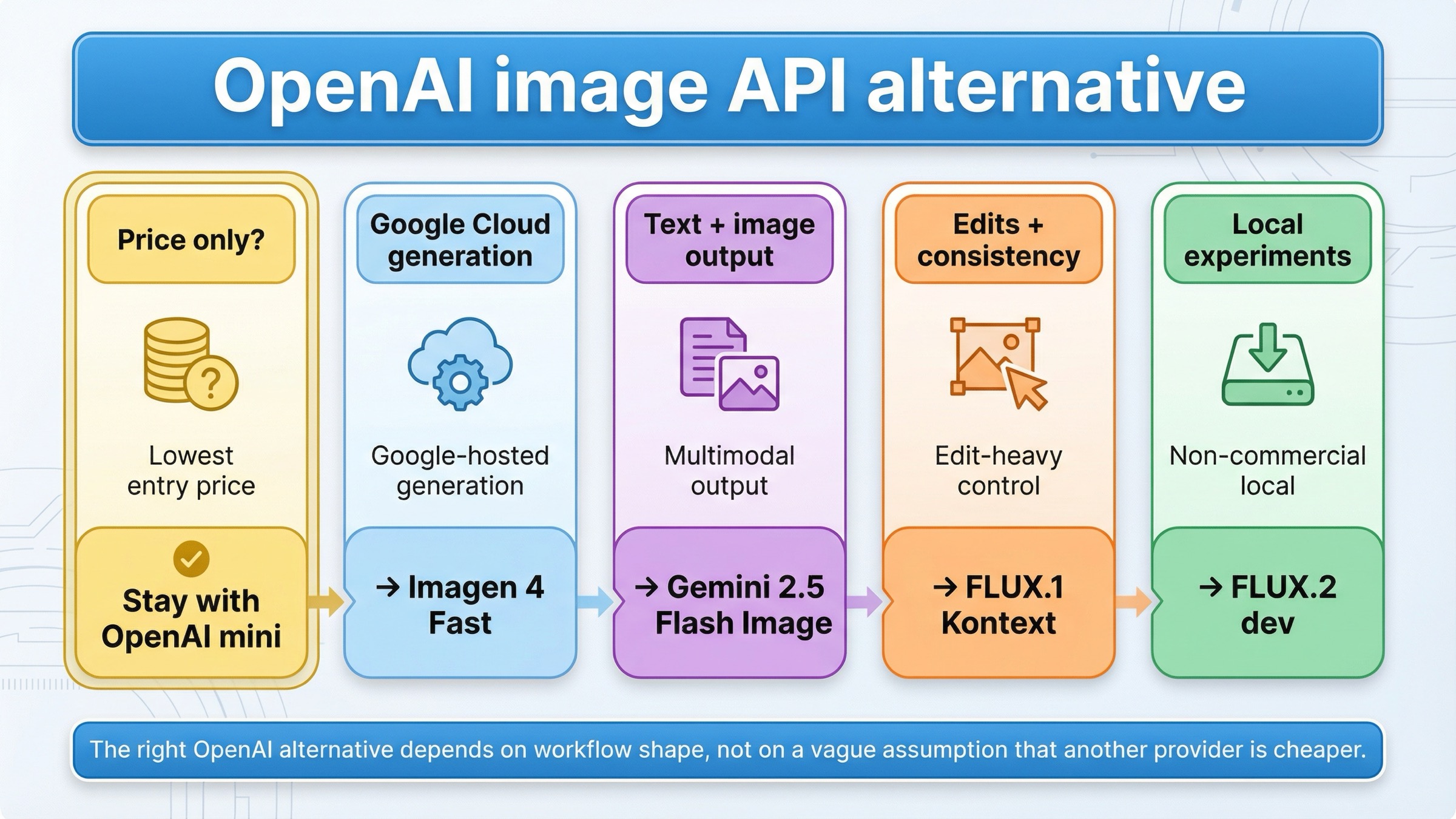

Resumen rápido

Si solo necesitas la regla de routing, usa esta tabla.

| Si OpenAI dejó de encajar porque... | Qué elegir | Por qué encaja mejor | Tradeoff principal |

|---|---|---|---|

| solo te importa el precio oficial de entrada más bajo | Quedarte con gpt-image-1-mini | Sigue siendo la ruta oficial más barata | Sigues dentro de la lógica de tiers de OpenAI |

| quieres una línea de generación alojada en Google Cloud | Imagen 4 Fast | Google ofrece una ruta de generación dedicada y clara en Vertex AI | No es un reemplazo drop-in de OpenAI |

| tu app necesita devolver texto e imagen en la misma interacción | Gemini 2.5 Flash Image | Soporta text/image input y text/image output | El pricing por tokens es menos intuitivo |

| tu problema son las ediciones repetidas, la consistencia y el texto dentro de la imagen | FLUX.1 Kontext | Está orientado a editing, consistency y text editing | No es la opción hosted más barata |

| quieres validar el flujo localmente antes de pagar otro proveedor | FLUX.2 dev | Permite experimentación local no comercial | No es la ruta final para producción hosted |

Por qué los desarrolladores siguen buscando una alternativa a OpenAI image API

La mayoría no llega aquí porque OpenAI “sea malo”, sino porque su necesidad actual ya no encaja del todo con la forma en que OpenAI organiza su stack de imágenes.

La primera razón es cómo se siente el coste dentro del workflow. En la página actual de GPT Image 1.5, OpenAI muestra con bastante claridad que low 1024x1024 cuesta $0.009, medium $0.034 y high $0.133. Pero en la página de gpt-image-1-mini, el mismo tamaño low empieza en $0.005. Eso obliga a una conclusión incómoda pero útil: si lo único que buscas es el precio oficial de entrada más bajo, OpenAI sigue ganando.

La segunda razón es la forma del producto. Para algunas apps, OpenAI sigue siendo la mejor ruta directa de generación. Pero para otras, el requisito real ya no es una endpoint de imagen aislada, sino un modelo que entienda contexto, responda con texto y además devuelva una imagen en la misma interacción. Ahí la comparación deja de ser “qué imagen API es más barata” y pasa a ser “qué forma de workflow encaja mejor con lo que estoy construyendo”.

La tercera razón es la edición iterativa. Si tu equipo vive corrigiendo textos, detalles, personajes o variaciones sobre una misma composición, el criterio importante deja de ser la belleza del primer output y pasa a ser la capacidad de editar sin destruir lo que ya estaba bien.

La cuarta razón es la fricción de acceso. En el artículo de model availability by tier and verification, OpenAI explica que gpt-image-1 y gpt-image-1-mini viven en tiers 1-5 y que parte del acceso depende de organization verification. En la práctica, muchos usuarios buscan “alternativa” cuando en realidad buscan una explicación de por qué el acceso aún no se comporta como esperaban.

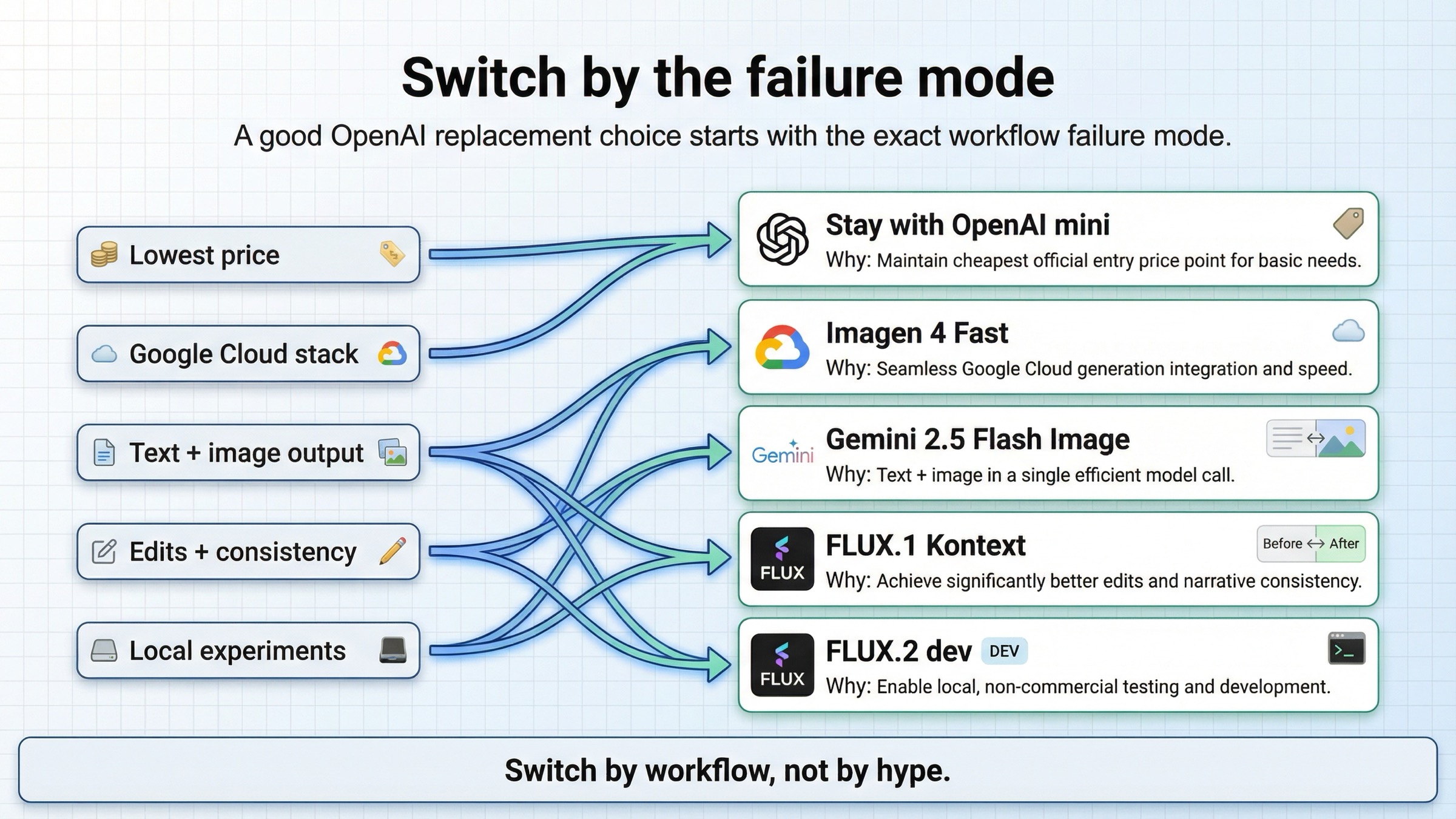

Cómo dividir las alternativas de OpenAI image API

Si separas el problema correctamente, aparecen cuatro rutas reales y una ruta de permanencia.

gpt-image-1-mini no debe desaparecer de este artículo. Es el punto de partida. Si tu prioridad número uno es el precio oficial más bajo para empezar, la respuesta correcta sigue siendo quedarte en OpenAI.

Imagen 4 Fast responde a otra necesidad: “quiero llevar esta parte del producto a Google Cloud y tener una línea de generación más claramente integrada con ese stack”. En la página de precios de Vertex AI, Google publica $0.02 por imagen para Imagen 4 Fast. No es el entry price más bajo, pero sí una ruta Google-hosted muy clara.

Gemini 2.5 Flash Image resuelve otro tipo de problema. La documentación del modelo deja claro que puede trabajar con text + image input y devolver text + image output. Eso lo convierte en una ruta más cercana a un producto multimodal que a una simple image endpoint.

FLUX.1 Kontext está claramente mejor posicionado para la edición y la consistencia. En la introducción de Kontext, Black Forest Labs habla de editing, character consistency, text editing y style transformation. Si tu problema real es una cadena de revisiones, eso pesa más que un benchmark de generación pura.

FLUX.2 dev llena un hueco que muchas comparativas ignoran: la necesidad de probar el flujo localmente, sin convertir el siguiente paso en otra factura hosted.

Imagen 4 Fast encaja mejor si quieres una ruta de generación alojada en Google Cloud

Si la razón para moverte no es “quiero algo supuestamente más barato”, sino “quiero que esta capacidad viva en Google Cloud”, yo empezaría por Imagen 4 Fast.

Google lo vende como una línea dedicada de generación en Vertex AI, separada de la parte más multimodal de Gemini. Esa separación importa. Para muchas empresas, el motivo del cambio no es el precio mínimo, sino la necesidad de alinear proveedor, billing y stack técnico alrededor de Google Cloud.

La documentación de Imagen 4 además indica que soporta hasta 4 output images por prompt. Eso refuerza la idea de que estamos ante una línea de generación hosted clara, no ante un flujo híbrido de conversación y herramientas.

El tradeoff también debe quedar claro: Imagen 4 Fast no gana a OpenAI mini en precio oficial mínimo de entrada. Gana cuando la organización necesita que la generación viva en el stack de Google Cloud y que la superficie sea simple de explicar.

Si todavía estás afinando la matemática dentro de OpenAI, el siguiente paso útil es OpenAI image generation API pricing y gpt-image-1-5 pricing API.

Gemini 2.5 Flash Image encaja mejor si necesitas texto e imagen en un solo flujo

Para algunas apps, el problema de OpenAI no está en la calidad de imagen, sino en que la generación queda demasiado separada del resto del flujo multimodal.

Ahí es donde Gemini 2.5 Flash Image se vuelve más interesante que una simple comparación de precios. Google dice explícitamente que el modelo acepta text + image input y devuelve text + image output. También documenta que generar una imagen consume 1290 tokens. Esa cifra importa porque te recuerda que no se trata solo de “otra API de imágenes”, sino de una ruta pensada para interacción multimodal.

Si tu producto tiene que entender la instrucción, responder con texto y producir una imagen dentro del mismo ciclo, Gemini 2.5 Flash Image puede encajar mejor que una image endpoint aislada. Si, en cambio, lo que buscas es una línea pura de generación que sea fácil de presupuestar, Imagen 4 Fast o incluso el propio Images API de OpenAI siguen siendo más simples.

En otras palabras: Gemini gana por forma de workflow, no por “pixeles baratos”.

FLUX.1 Kontext encaja mejor para ediciones intensivas, consistencia y cambios de texto

Si tu mayor dolor es que la primera imagen nunca es la definitiva, FLUX.1 Kontext suele ser un mejor movimiento que perseguir otra API puramente generativa.

Muchas comparativas fallan aquí porque meten todos los proveedores en la misma caja mental. Pero en la práctica, muchos equipos trabajan sobre revisiones: cambiar copy dentro de un póster, mantener el mismo personaje, tocar una parte del layout, ajustar la escena sin rehacerlo todo. En ese contexto, el criterio importante es quién edita mejor sin perder lo ya resuelto.

Black Forest Labs orienta Kontext exactamente a ese tipo de trabajo. No solo habla de generación; habla de editing, consistency, text editing y style transformation.

En la página de precios, Kontext [pro] aparece a $0.04 por imagen y Kontext [max] a $0.08. No es una opción “barata”. Pero la pregunta aquí no es “¿cuesta menos que OpenAI?”, sino “¿me ahorra más trabajo manual porque mi flujo real es de revisión continua?”. En equipos con mucha iteración, esa respuesta puede ser sí.

Para el contexto técnico más profundo, el mejor siguiente paso sigue siendo FLUX.1 API guide, con fallback explícito al inglés.

FLUX.2 dev encaja mejor para experimentos locales no comerciales

También existe un caso muy real donde lo correcto no es elegir otro proveedor hosted mañana mismo, sino probar el workflow localmente antes de comprometer otro presupuesto.

Ahí entra FLUX.2 dev. En la pricing page oficial de BFL aparece como ruta válida para local development, non-commercial use. Eso lo convierte en una alternativa muy distinta: no es un reemplazo hosted listo para producción, sino una forma de validar el flujo antes de tomar una decisión mayor.

Eso es especialmente útil cuando el caso de uso aún no está del todo claro. Si todavía estás probando prompts, revisiones, edición local o constraints offline, puede tener más sentido aclarar el workflow primero que saltar a otra factura mensual o por uso.

El tradeoff es evidente: no es el destino final de un pipeline comercial hosted. Pero como puente hacia una mejor decisión, es una ruta muy valiosa.

Cuándo seguir con OpenAI sigue siendo la mejor decisión

Una buena página de alternativas tiene que decirte cuándo no conviene moverse.

Primer caso: si lo único que necesitas es el precio oficial de entrada más bajo. Ahí la respuesta sigue siendo gpt-image-1-mini.

Segundo caso: si el problema real está en setup, tier, verificación u otra elección de superficie API. Si la fricción viene de account state o de haber elegido mal la ruta, cambiar de proveedor puede resolver el problema equivocado.

Los hilos de comunidad sobre image generation diagnostics y rate-limit issues con gpt-image-1 sirven para recordar justo eso: parte del deseo de “irse” nace de fricción operativa, no de un verdadero mismatch de producto.

Si eso se parece a tu caso, la mejor siguiente lectura es OpenAI image API tutorial, no otro directorio de vendors.

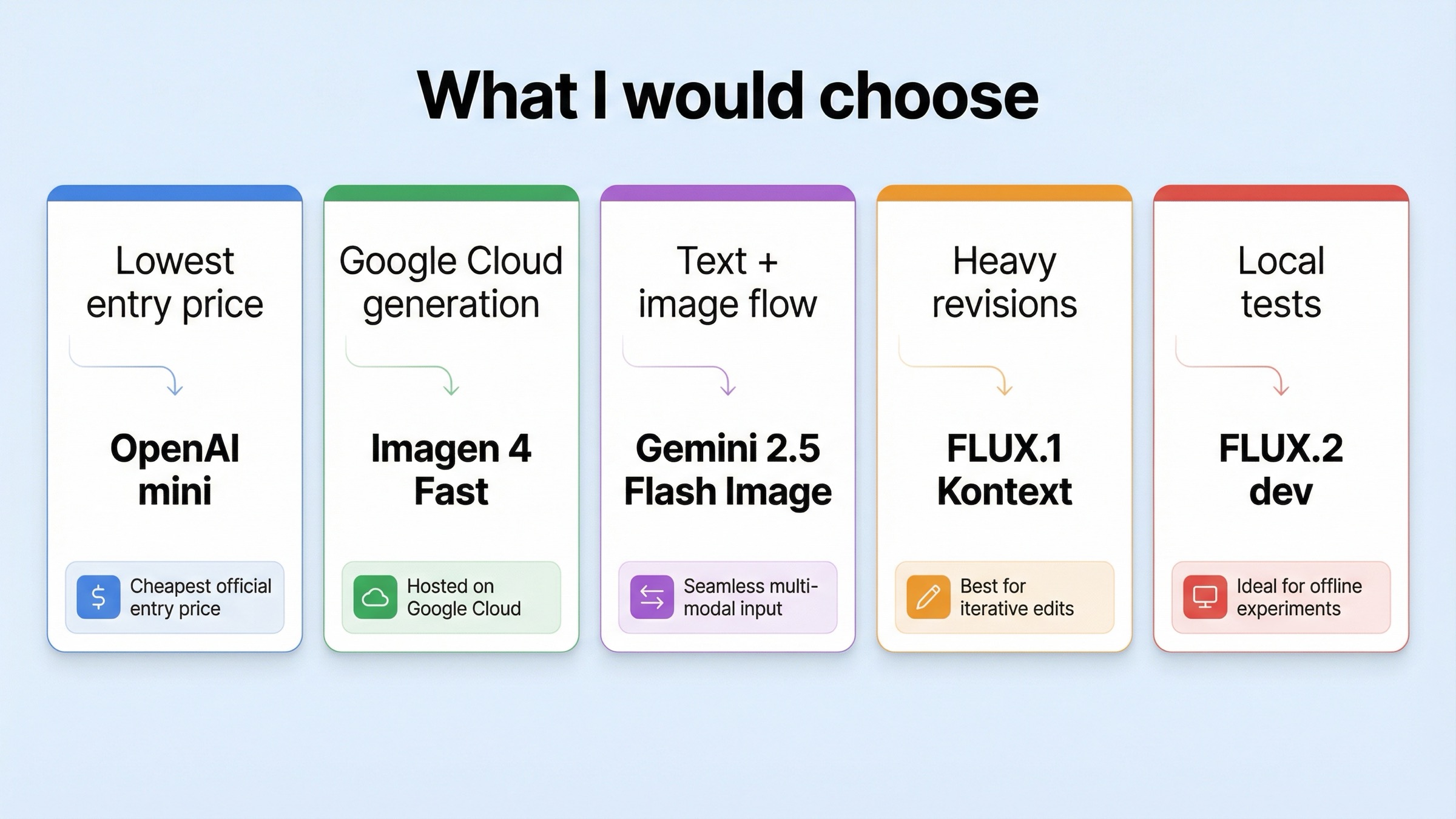

Qué elegiría yo en cinco situaciones comunes

Si tuviera que decidir hoy, usaría estas reglas.

1. Solo me importa el precio oficial de entrada más bajo. Me quedo con gpt-image-1-mini.

2. Estoy construyendo en Google Cloud y quiero una ruta dedicada de generación hosted. Elijo Imagen 4 Fast.

3. Mi app necesita responder con texto e imagen dentro del mismo flujo. Elijo Gemini 2.5 Flash Image.

4. Mi equipo vive en revisiones continuas y no en generación desde cero. Elijo FLUX.1 Kontext.

5. Todavía quiero validar el workflow localmente antes de pagar otro proveedor. Elijo FLUX.2 dev.

Conclusión

La mejor alternativa a OpenAI image generation API no es una marca universal. Es la ruta que corrige la razón exacta por la que OpenAI dejó de ser el default adecuado.

Si el problema es solo el precio oficial de entrada, quédate en OpenAI y usa gpt-image-1-mini. Si quieres una línea de generación en Google Cloud, elige Imagen 4 Fast. Si necesitas texto e imagen en la misma interacción, elige Gemini 2.5 Flash Image. Si tu dolor real son las ediciones y la consistencia, mira FLUX.1 Kontext. Si necesitas experimentación local no comercial, vete a FLUX.2 dev. Y si el bloqueo real es setup o elección de API surface en OpenAI, lo más inteligente puede ser no cambiar todavía.