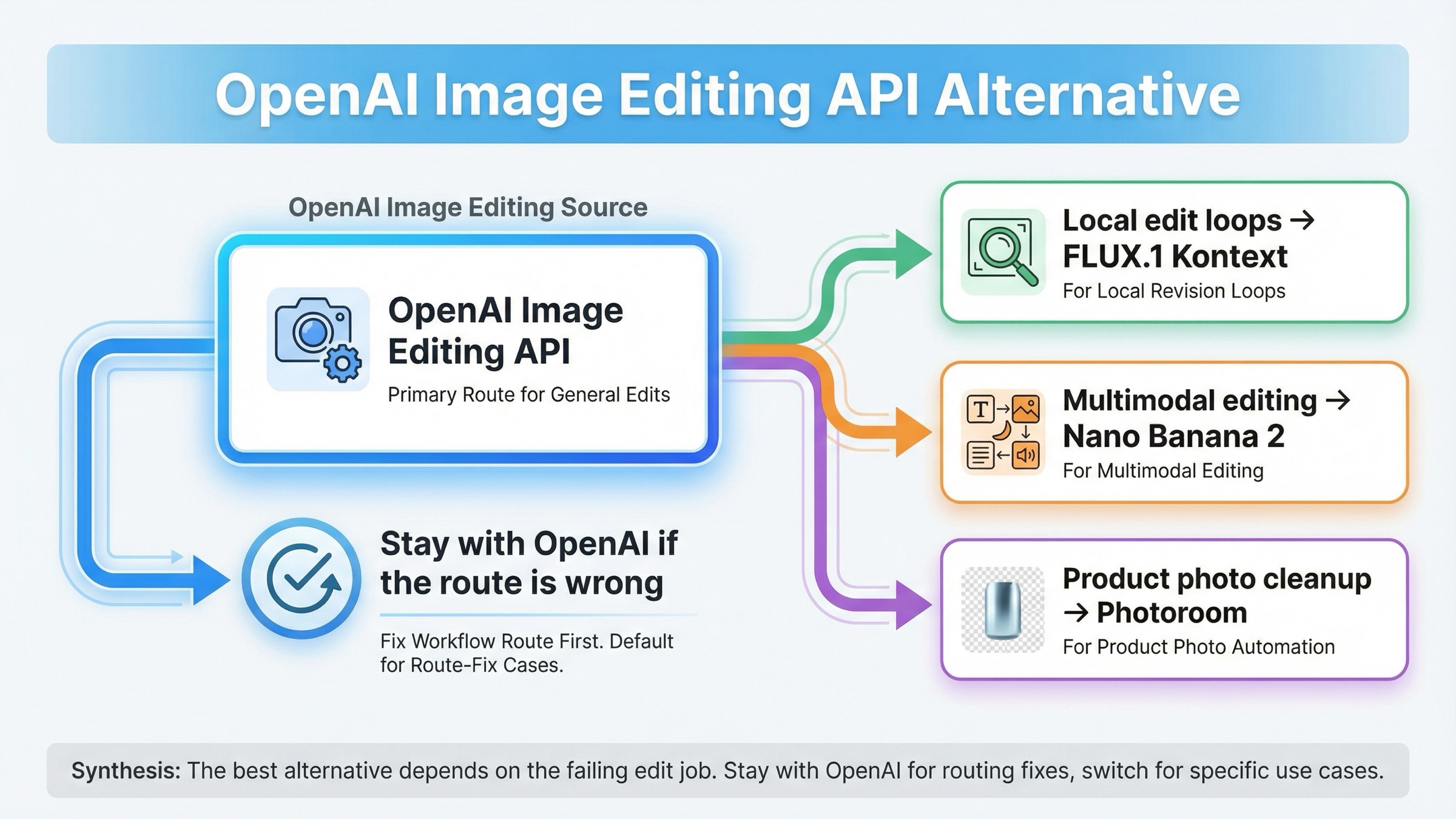

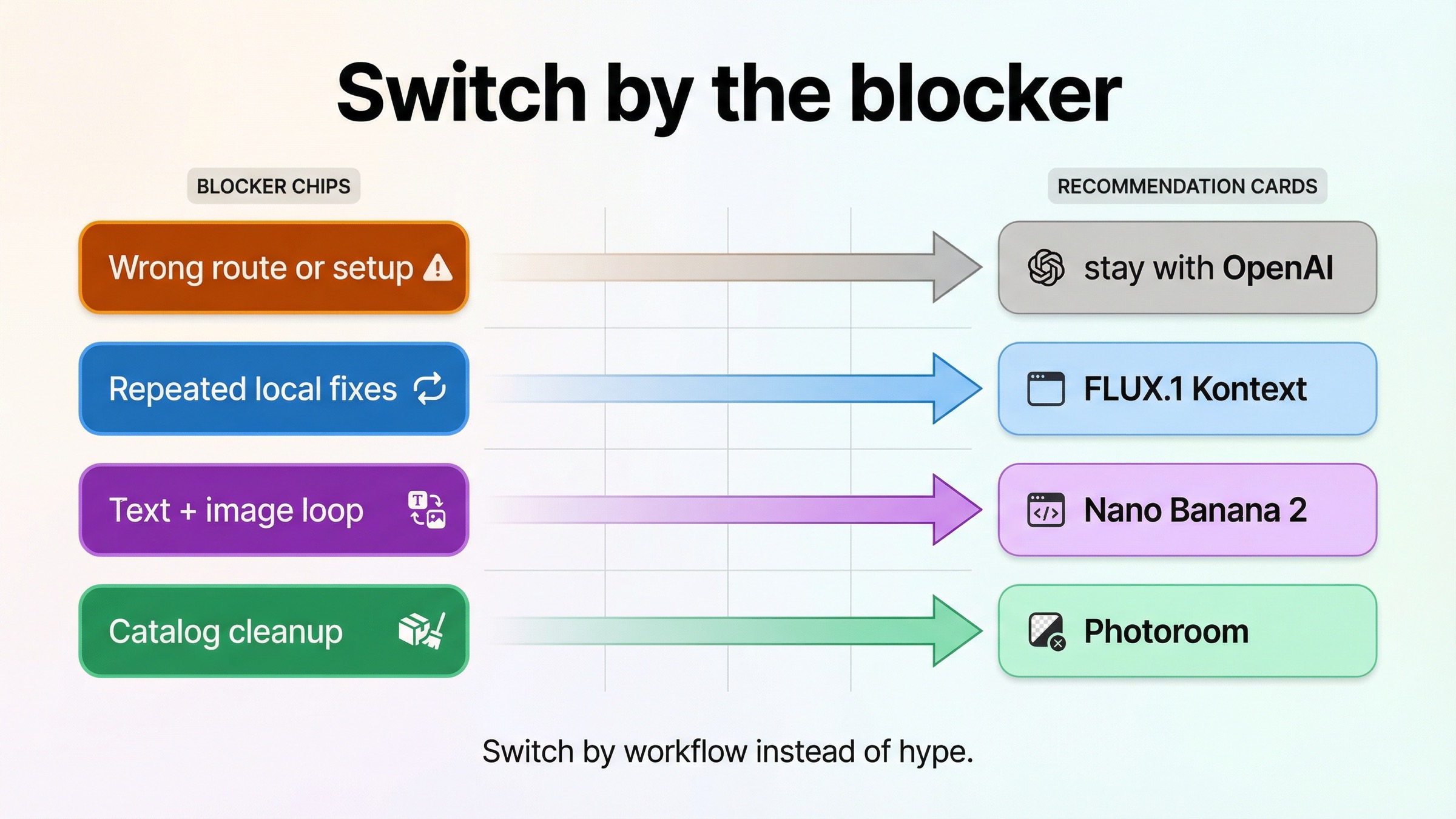

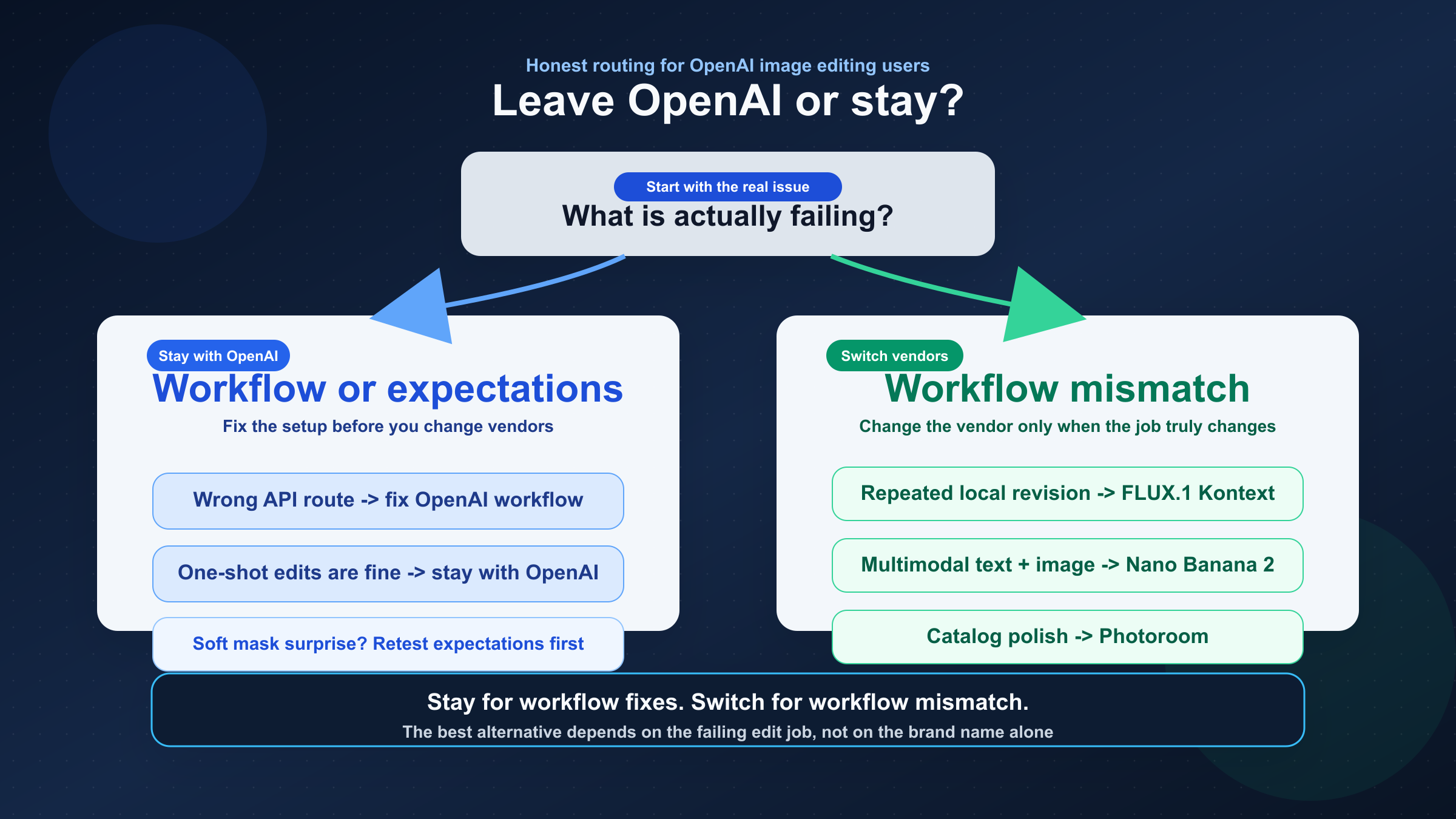

A fecha del 27 de marzo de 2026, la mejor alternativa a OpenAI image editing API depende de qué tipo de edit workflow se te está rompiendo. Si tu dolor real es una cadena de ediciones locales, varias rondas de revisión, drift después del segundo cambio o pérdida de consistency, el primer candidato debería ser FLUX.1 Kontext. Si lo que necesitas es un flujo text+image más fuerte, localization, text-in-image y un multimodal editing loop más natural, entonces Nano Banana 2 tiene más sentido. Si tu trabajo real gira alrededor de product photos, background cleanup, shadows, catalog consistency y ad variants, la comparación correcta empieza en Photoroom. Pero si solo te decepcionó una mask edit de OpenAI, no conviertas el provider switch en la respuesta automática.

Ahí es donde la SERP sigue fallando. Muchas páginas responden este tema como si fuera un ranking amplio de “alternativas a OpenAI”, cuando el reader real está preguntando algo mucho más estrecho: qué usar en lugar de OpenAI image edits para este trabajo de edición concreto.

También conviene poner un caveat importante al principio. En su image generation guide, OpenAI sigue diciendo que Image API es la mejor opción cuando solo necesitas una generación o una edición aislada, mientras que Responses API encaja mejor en experiencias editables y conversacionales más largas. Eso significa que parte del “quiero una alternativa” es en realidad un route-choice mistake. Además, OpenAI todavía mantiene DALL·E 2 como lane más barata para inpainting con mask, pero en la misma guía deja claro que el soporte para DALL·E 2 y DALL·E 3 termina el 12 de mayo de 2026. Aunque tu complaint con masks sea totalmente real, no es una respuesta a largo plazo.

Resumen rápido

- Si tus one-shot edits siguen funcionando razonablemente y el problema real se parece más a route choice, setup o soft-mask expectations, primero quédate en OpenAI.

- Si la necesidad real es “mantén casi toda la imagen y cambia solo esta parte”, con revisiones locales repetidas, FLUX.1 Kontext es el primer test lógico.

- Si tu workflow necesita text+image reasoning, localization, text-in-image y follow-up edits, Nano Banana 2 merece prioridad.

- Si el trabajo real es product listings, backgrounds, shadows, catalog cleanup y ad variants, el primer benchmark correcto es Photoroom.

- DALL·E 2 es solo un bridge temporal para masks: OpenAI ya publicó la fecha de fin de soporte, 12 de mayo de 2026.

La regla más rápida para usuarios de OpenAI image editing

Si solo necesitas la respuesta de routing, empieza por esta tabla.

| Si OpenAI edits falla porque... | Qué elegir | Por qué encaja mejor | Tradeoff principal |

|---|---|---|---|

| el problema real está en la surface API, el setup o la route choice | Quedarte en OpenAI | Puede que el problema no sea el vendor, sino el workflow | Sigues dentro de los límites actuales de OpenAI |

| tras varias ediciones locales la imagen deriva demasiado y cuesta conservar la escena original | FLUX.1 Kontext | Está orientado a image editing, consistency y text editing | Añades otro vendor y no es una lane barata |

| necesitas text+image loop, localization y multimodal editing | Nano Banana 2 | Google lo posiciona como una route de advanced editing más rápida | La familia de modelos de Google es más compleja de explicar |

| tu trabajo real son product photos, backgrounds y catalog automation | Photoroom | Es un API especializada en commercial photo editing | No es el mejor benchmark si buscas creatividad abierta |

Eso es lo que esta página tiene que resolver. Muchas alternativas responden al mercado. Esta responde a la regla de reemplazo.

Cuándo todavía no deberías reemplazar OpenAI

No todo reader debería cambiar. Muchas veces salir de OpenAI antes de aislar el problema solo mueve la misma confusión a otro proveedor.

La primera comprobación es la route API. OpenAI sigue separando Image API como camino por defecto para generación o edición aislada, y Responses API como parte de un flujo multimodal más largo. Si empezaste en la surface equivocada, cambiar de proveedor puede dar sensación de progreso sin resolver el origen de la fricción.

La segunda comprobación es la expectativa sobre masks. Las docs de GPT Image enseñan images.edit(), masks e input_fidelity, pero la evidencia de comunidad sigue siendo útil: todavía hay casos donde mask edit se siente más como un semantic rewrite que como un parche local estricto. Eso no significa que OpenAI image editing sea inútil. Significa que no conviene medirlo con la expectativa de un Photoshop-style fill determinista.

Ahí es donde entra el caveat de DALL·E 2. Si OpenAI mismo lo mantiene como lane de inpainting con mask, está reconociendo que esa necesidad existe. Pero, al mismo tiempo, ya puso fecha de fin al soporte: 12 de mayo de 2026. La lectura correcta no es “perfecto, entonces ignoro el mercado”. La lectura correcta es “tengo un puente de corto plazo, pero necesito una respuesta más estable si las masks son lo central”.

Si después de esto ves que tu problema se parece más a route choice dentro de OpenAI que a un verdadero vendor mismatch, la siguiente lectura lógica es OpenAI image editing API y OpenAI image generation API endpoint. Si ya confirmaste que necesitas un cambio más amplio de image workflow, entonces OpenAI image generation API alternative es la página más adecuada.

FLUX.1 Kontext encaja mejor para ediciones locales repetidas y consistency

Si tu complaint principal suena a “mantén casi toda la imagen, pero cambia exactamente esto”, FLUX.1 Kontext es la alternativa más fuerte para probar primero.

La recomendación no nace de marketing vacío. Nace de cómo Black Forest Labs describe el producto en su Kontext overview: image editing, character consistency, text editing y style transformation. Eso encaja mejor con un workflow de revisión continua que con una route pensada sobre todo para un buen first pass.

Aquí es donde muchas frustraciones con OpenAI dejan de ser un prompt problem y se convierten en un workflow-fit problem. La primera versión puede salir aceptable, pero en la segunda ronda cambia el logo, se mueve la composición o se rompe la identidad del personaje. Cuando ese patrón se repite, ya no basta con ajustar prompts: la route probablemente no está optimizada para ese tipo de edición.

Kontext resulta especialmente razonable en trabajos como:

- mantener el subject y cambiar solo la ropa

- conservar la composición y sustituir el texto de un cartel

- mantener el packaging y reemplazar solo un elemento de branding

- mover el mismo character entre escenas sin perder identidad

Eso ya no es simple generation. Es controlled revision. Y ahí Kontext encaja mejor.

También hay un cost signal práctico. En la pricing page, Black Forest Labs publica FLUX.1 Kontext Pro a \$0.04 por imagen y Kontext Max a \$0.08. No es una lane barata, pero el cálculo correcto no es solo el precio por imagen. Si cada ronda fallida te cuesta tiempo humano de cleanup, una API aparentemente más barata puede terminar siendo un workflow más caro.

La regla útil aquí es simple: si el trabajo real es local revision con consistency, prueba FLUX.1 Kontext; no cambies solo porque “quieres otra image API”.

Nano Banana 2 encaja mejor para multimodal editing y localization

Si la frustración con OpenAI no se limita al control local, sino que apunta a un workflow demasiado estrecho para text+image, localization y revisiones multimodales, el image stack de Google se vuelve más interesante.

En la mayoría de esos casos, el primer test debería ser Nano Banana 2. Google lo presenta como Gemini 3.1 Flash Image, y en las docs de Gemini image generation la edición de imágenes aparece como una route de primer nivel. Además, el launch post de Nano Banana 2 habla de high-fidelity generation y faster advanced editing.

Eso importa cuando el trabajo necesita:

- editar una imagen y mantener texto legible en otro idioma

- combinar instrucciones de texto, imágenes de referencia y follow-up edits en un mismo loop

- producir marketing assets con mejor comportamiento en text-in-image

- apoyarse en más contexto semántico durante el edit process

Google también separa con más claridad sus lanes: una apunta a speed/high-volume use y otra a professional asset production. Por eso la pregunta correcta no es “qué modelo de Google es mejor en abstracto”, sino si necesitas una lane de multimodal editing o un especialista de edición local más estrecho como Kontext.

En la mayoría de switch cases, es más sensato empezar por Nano Banana 2 que saltar directamente a la lane más cara. Si luego el test muestra que tu caso exige más producción pesada, ya tendrás margen para subir dentro de la familia.

Si quieres más contexto del lado de Google, la continuación natural es Gemini image-to-image editing o Gemini vs OpenAI image generation. Esta página solo responde a la pregunta de reemplazo para editing.

Photoroom encaja mejor para product photos, backgrounds y catalog automation

Muchas búsquedas de OpenAI image editing API alternative no son realmente preguntas de foundation-model switch. Son preguntas de commercial photo-editing workflow.

Ahí es donde la respuesta correcta suele ser Photoroom.

Su API documentation y la Image Editing API page son muy claras: subject separation, background replacement, relighting, realistic shadows, catalog photos, listings y ads. Es otra categoría de trabajo.

Si tu KPI se parece más a esto:

- cleaner product cutouts

- fondos uniformes o de marca

- listings más rápidos

- variantes de anuncios a escala

- consistencia visual de catálogo

entonces no conviene comparar primero “qué foundation model es más inteligente”, sino qué API automatiza mejor este workflow comercial concreto.

Aquí es donde muchas páginas de alternativas pierden credibilidad. Siguen comparando modelos generales cuando el reader real necesita un pipeline de e-commerce. Un modelo más general puede ser más potente en abstracto y aun así perder en productividad frente a un API especializada.

Por eso la regla aquí es deliberadamente directa: si tu trabajo es listings, catalog cleanup y visual merchandising, benchmarkea primero Photoroom y luego mira general models.

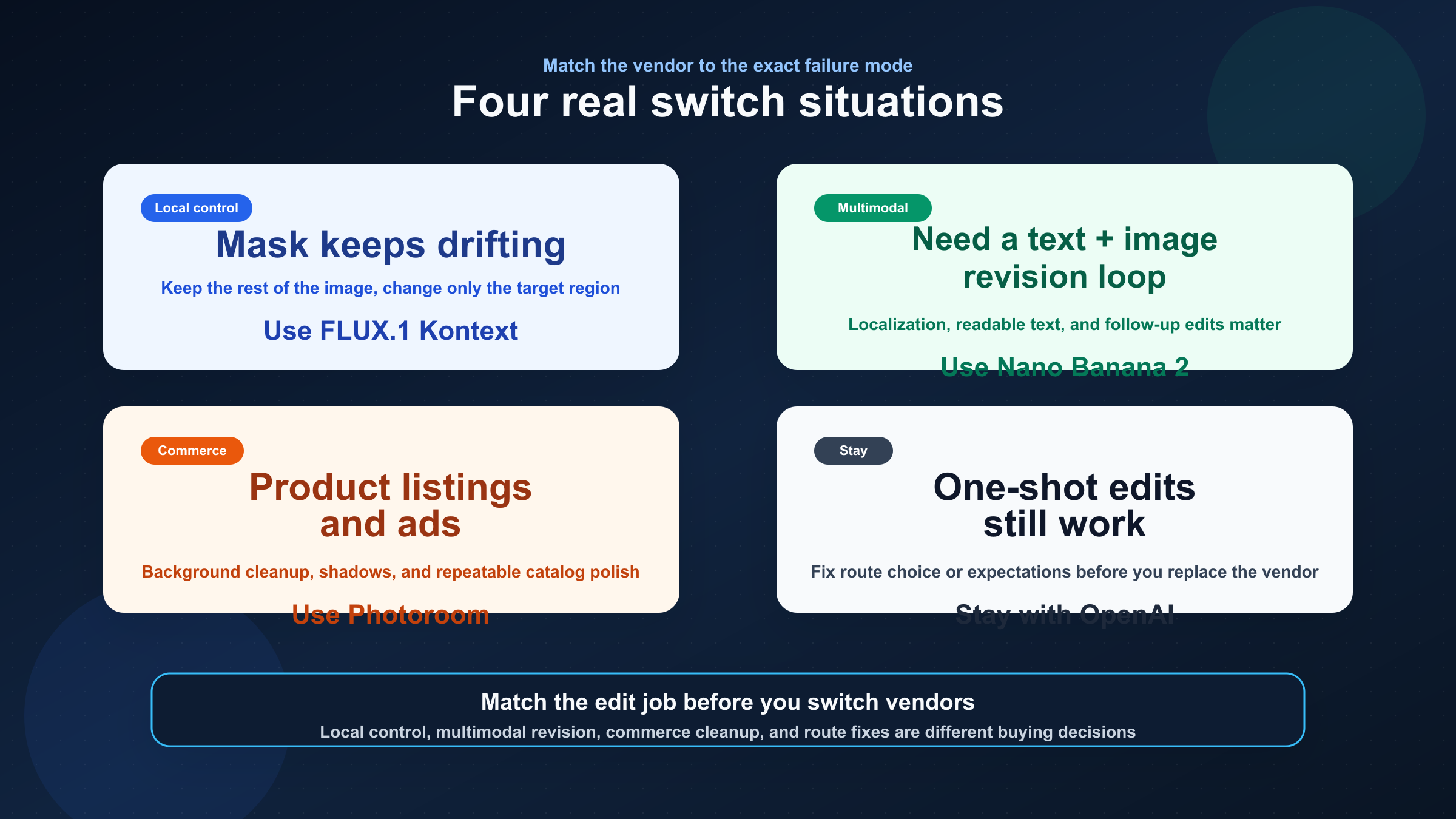

Qué elegiría yo en cuatro situaciones reales

Si yo tuviera que tomar la decisión hoy, la simplificaría así.

1. Las mask edits cambian demasiado y necesito correcciones locales repetidas.

Empezaría con FLUX.1 Kontext. Aquí el problema ya es de controlled local revision.

2. Necesito un sistema que entienda texto e imagen juntos y siga editando con rapidez.

Empezaría con Nano Banana 2. El dolor ya no es solo la máscara; es todo el multimodal editing loop.

3. Trabajo con product photos, catálogos o anuncios y me importa más el commercial polish que la creatividad abierta.

Empezaría con Photoroom. Este es un specialist workflow y merece una specialist API.

4. Mis one-shot edits en OpenAI siguen funcionando, pero el workflow se siente torpe.

Me quedaría primero en OpenAI. Revisaría de nuevo si el route correcto es Images API o Responses API y si el problema real es soft-mask expectation. Si lo único que te importa es hard-mask inpainting, trataría DALL·E 2 solo como un bridge de corto plazo.

Esas cuatro situaciones son la buying logic real detrás de esta query. Muchas páginas responden al mercado. Esta responde al failure mode.

FAQ

¿Cuál es la mejor alternativa para ediciones intensivas con masks?

Si lo que de verdad necesitas es control local repetible, el primer test debería ser FLUX.1 Kontext. OpenAI sigue manteniendo DALL·E 2 como bridge para masks, pero la fecha oficial de fin de soporte es 12 de mayo de 2026.

¿Debería salir de OpenAI solo porque las masks se sienten demasiado globales?

No necesariamente. Primero confirma que estás en la surface correcta y que tu caso no sigue siendo una edición aislada con expectativas equivocadas. El cambio de proveedor tiene sentido cuando el workflow pide revisiones locales repetidas, multimodal editing o cleanup comercial especializado.

Para e-commerce, ¿qué debería probar antes: Nano Banana 2 o Photoroom?

Si tu workflow mezcla reasoning, texto, localization y revisiones creativas más amplias, prueba antes Nano Banana 2. Si el centro del trabajo es product cleanup, backgrounds, shadows y consistencia de catálogo, prueba antes Photoroom.

¿FLUX.1 Kontext es necesariamente más barato que OpenAI?

No. El criterio correcto no es solo el unit price, sino el workflow cost. BFL publica Kontext Pro a \$0.04 y Kontext Max a \$0.08, pero la comparación importante es si reduce rondas fallidas y cleanup manual.

Conclusión

La mejor alternativa a OpenAI image editing API no es un único model name, sino la route que mejor encaja con el edit job que hoy te está fallando.

Si el problema es local revision y consistency, mira FLUX.1 Kontext. Si el problema es multimodal editing, text rendering y localization, mira Nano Banana 2. Si el problema es product photos, backgrounds y catalog automation, mira Photoroom. Y si el problema real es route choice o soft-mask expectations, quédate antes en OpenAI, corrige el workflow y decide después si de verdad hace falta un provider switch.