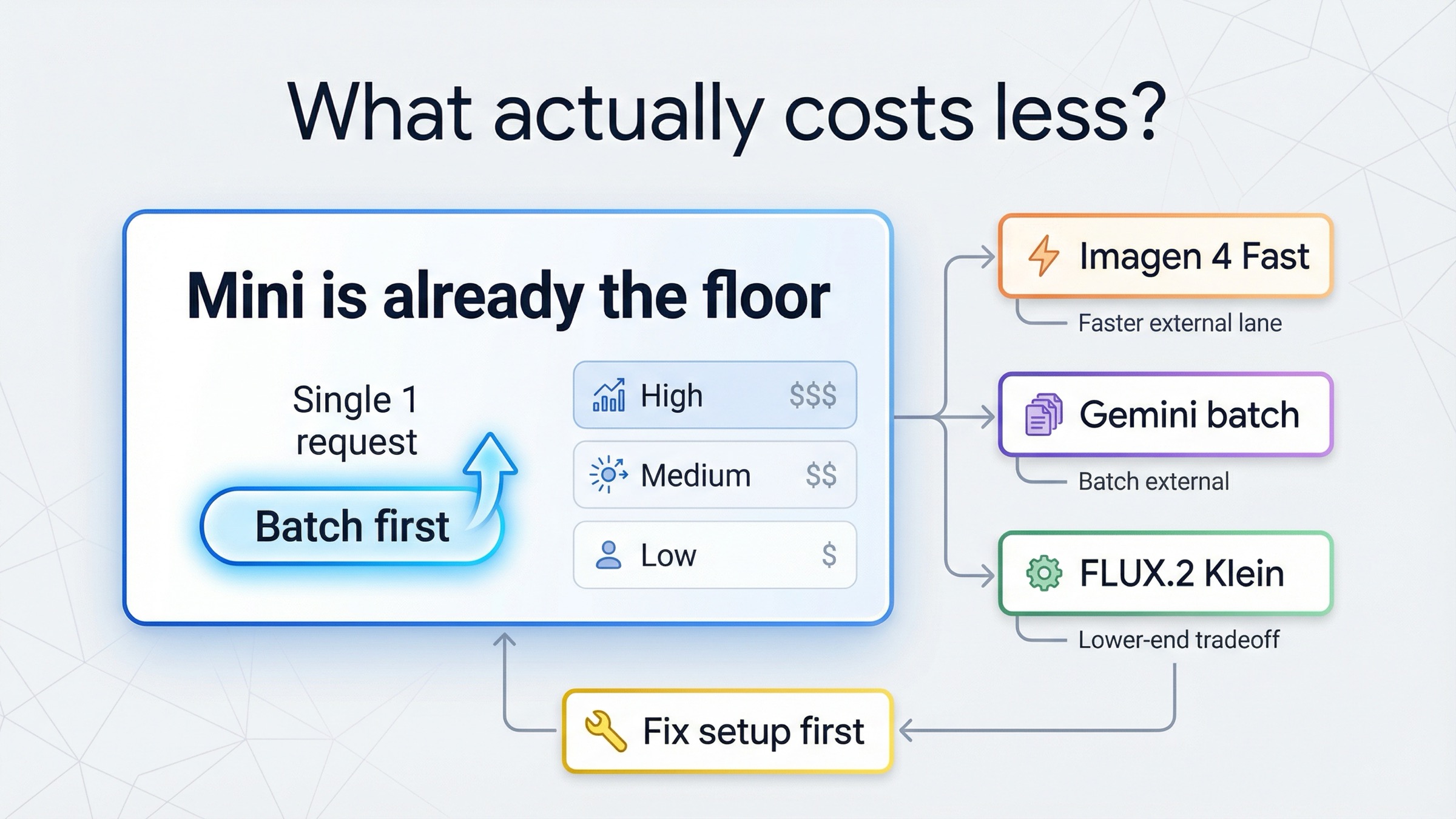

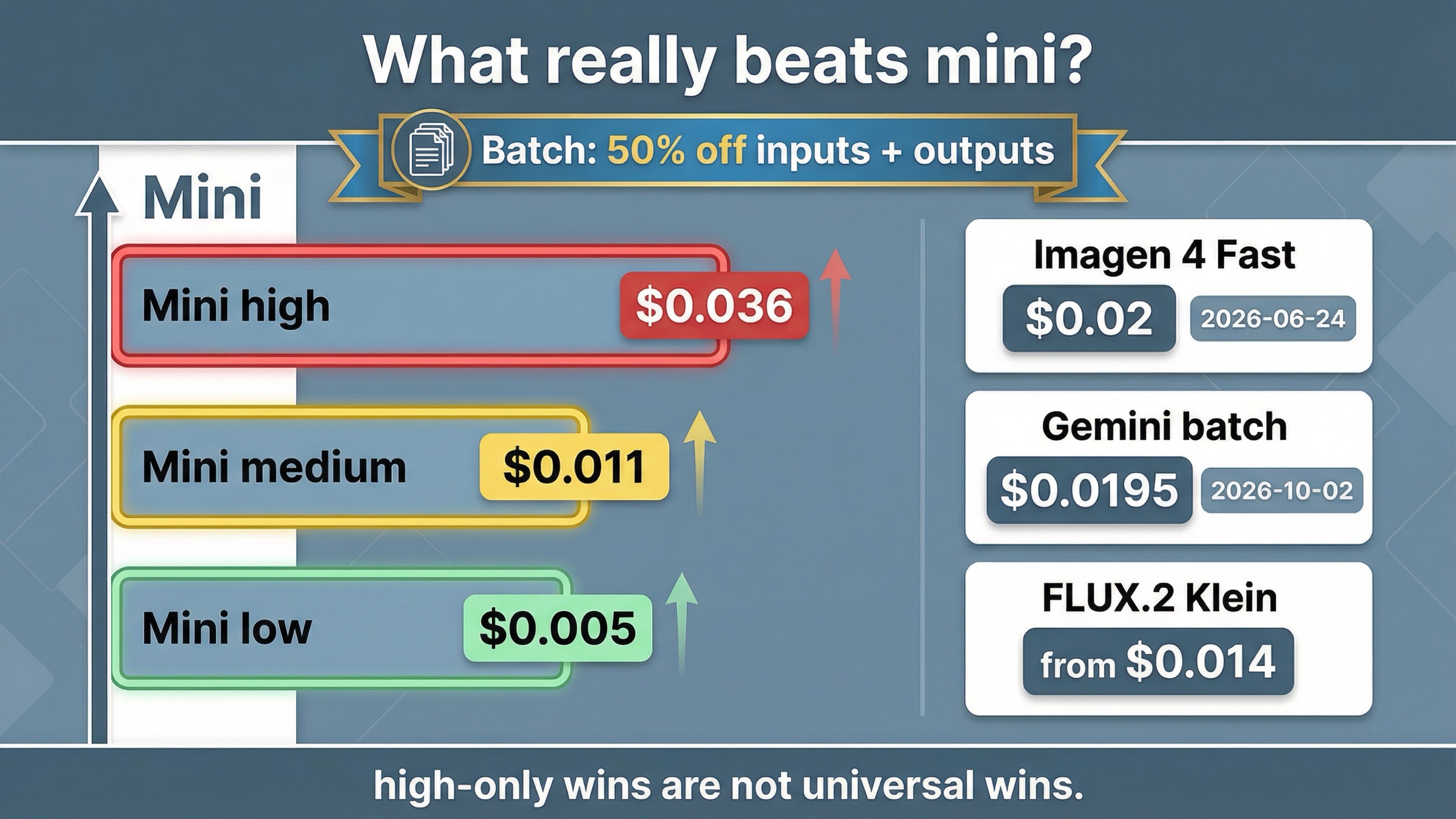

По состоянию на 29 марта 2026 года нет чистой mainstream hosted API, которая бьет gpt-image-1-mini по его текущим low и medium price rows. Текущая страница модели gpt-image-1-mini у OpenAI по-прежнему показывает \$0.005, \$0.011 и \$0.036 для square 1024x1024 в режимах low, medium и high. Уже один этот факт меняет стартовый ответ: если проблема только в цене, первый cheaper move обычно не смена модели, а сохранение mini и тест Batch.

Именно в этом месте live SERP чаще всего начинает путать читателя. Широкие pricing pages сообщают, что Imagen 4 Fast стоит 0.02, что gemini-2.5-flash-image batch стоит 0.0195, а FLUX.2 Klein начинается примерно с 0.014 или 0.015. Но они редко договаривают, дешевле ли эти строки mini в целом, дешевле ли они только mini high, или они выглядят дешевле лишь потому, что меняют сам job, target quality или shelf life маршрута.

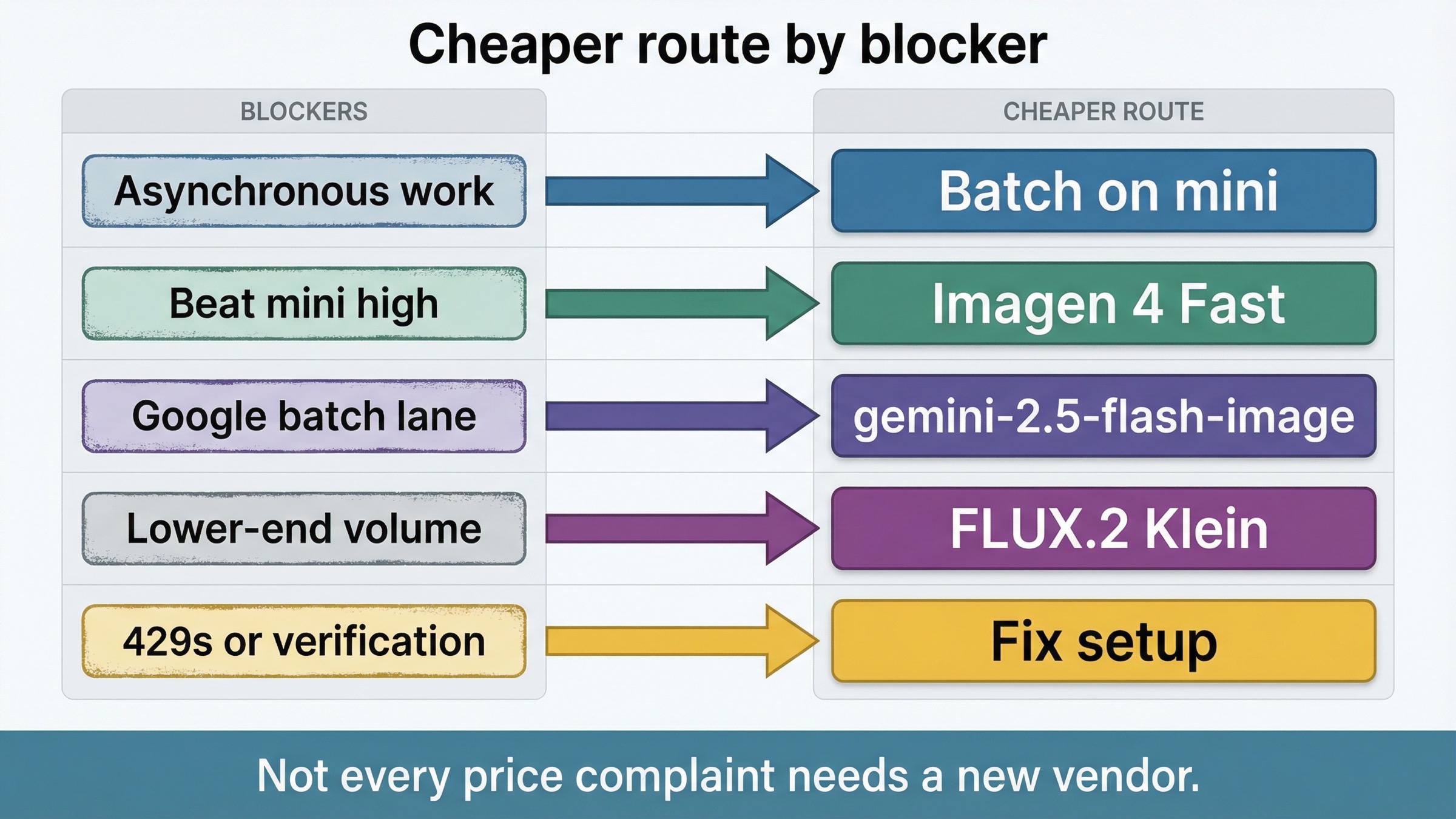

Есть и вторая ловушка в этом keyword. Часть запросов gpt-image-1-mini cheaper alternative вообще не про выбор модели. Это вопросы про live versus Batch routing, про verification, tier state или access pain, из-за которых workflow кажется слишком дорогим. Если ваша реальная проблема в качестве, typography или editing, следующий правильный материал скорее GPT Image 1 Mini alternative. Эта страница остается на price-first decision.

Краткое содержание

Если нужен только routing answer, сначала смотрите на эту таблицу.

| Если ваш реальный goal это... | Самый дешевый правдоподобный ход | Текущий price anchor | Почему это работает | Главный caveat |

|---|---|---|---|---|

| сохранить самый дешевый официальный image lane внутри OpenAI | Остаться на gpt-image-1-mini | \$0.005 / \$0.011 / \$0.036 | mini уже является текущей cost-efficient branch внутри OpenAI | Вы сохраняете ceiling качества mini |

| снизить стоимость без смены модели для асинхронной работы | Остаться на mini и протестировать Batch | OpenAI пишет, что Batch экономит 50% на inputs и outputs | Первый cheaper move может быть изменением workflow, а не vendor | OpenAI не публикует отдельную mini batch per-image card, и Batch асинхронный |

| обойти mini high, но не mini low или medium, через простой Google-hosted lane | Imagen 4 Fast | \$0.02 за изображение | Он действительно дешевле mini high и прост для объяснения | Он все еще дороже mini low и medium, и Google указывает shutdown date 24 июня 2026 года |

| обойти mini high с самым низким текущим image row у Google | gemini-2.5-flash-image batch | \$0.0195 за изображение | Это самый низкий текущий опубликованный Google image row | Он все еще дороже mini low и medium, и Google указывает shutdown date 2 октября 2026 года |

| купить lower-end external high-volume lane | FLUX.2 Klein | от \$0.014 до \$0.015 | Он может обойти mini high в части lower-end workloads | Цена завязана на megapixel, и это не like-for-like замена GPT Image |

| убрать access, verification или route pain, которые только ощущаются как дороговизна | Остаться в OpenAI и починить setup | смена модели не нужна | Vendor switch не решает tier или verification state | Сначала все равно надо отладить маршрут |

Практическое правило короткое: дешевле mini high не значит дешевле mini в целом. Если смешать эти вещи, можно уйти с текущего floor без настоящей причины.

Почему mini уже является текущим floor

Самая важная часть этой статьи не очередная comparison row, а понимание того, чем mini вообще должен быть.

Текущий models catalog у OpenAI по-прежнему описывает семейство достаточно чисто: GPT Image 1.5 это state-of-the-art image generation model, GPT Image 1 это previous generation model, а gpt-image-1-mini это cost-efficient branch. Это означает, что mini не случайный бюджетный хвост и не старый остаток каталога. Это текущий официальный ответ OpenAI для команд, которым нужен более низкий image cost внутри той же platform stack.

Та же страница mini прямо показывает price split. Для square 1024x1024 mini сейчас стоит \$0.005 low, \$0.011 medium и \$0.036 high. Именно из-за этих трех строк keyword про cheaper alternative и оказывается неудобным. Многие broad pricing pages сравнивают одно число конкурента с одним числом OpenAI так, как будто у mini есть одна универсальная цена. Это не так. Имеет значение именно тот row, который вы реально покупаете.

Отсюда следует и следующий вывод. Некоторые supposedly cheaper alternatives на деле вообще не являются альтернативами mini как такового. Imagen 4 Fast по 0.02 и gemini-2.5-flash-image batch по 0.0195 дешевле mini high, но не дешевле mini low и не дешевле mini medium. Если ваша работа уже живет на low или medium, Google здесь не приносит настоящий price win. Он приносит новую platform stack и новый lifecycle.

По той же причине Batch должен находиться почти в начале статьи. На текущей API pricing page OpenAI пишет, что Batch API экономит 50% на inputs и outputs для асинхронной работы в течение 24 часов. Страница mini также показывает Batch как поддерживаемое endpoint family. OpenAI не публикует отдельную mini-specific batch per-image card, поэтому правильнее читать это как workflow optimization, а не как новую фиксированную наклейку с ценой. Но routing consequence все равно важен: если workload можно ставить в очередь, первый cheaper experiment часто выглядит как mini plus Batch, а не как новый vendor.

Это же место помогает не скатиться к legacy answer. В текущем image generation guide OpenAI пишет, что DALL-E 2 и DALL-E 3 перестают принимать requests 12 мая 2026 года. Даже если где-то еще остались старые cheap-looking rows, это уже не сильный default answer для новой price-first статьи.

Если вам нужен чистый mini ladder без рыночного routing, дальше логично читать GPT Image 1 Mini pricing. Если вопрос шире mini и вы на самом деле имеете в виду более дешевую альтернативу всему OpenAI image stack, тогда полезнее OpenAI image generation API cheaper alternative.

Картина становится намного яснее, если отделить universal wins от narrow wins:

| Route | Текущая опубликованная price surface | Что он реально бьет | Главный caveat |

|---|---|---|---|

| Mini live | \$0.005 / \$0.011 / \$0.036 | baseline floor внутри OpenAI | Тот же ceiling качества mini |

| Mini + Batch | 50% off на inputs и outputs | потенциально самый дешевый вариант того же workflow при асинхронной обработке | Отдельная mini batch image card не опубликована |

| Imagen 4 Fast | \$0.02 за изображение | mini high | shutdown date 24 июня 2026 года |

gemini-2.5-flash-image batch | \$0.0195 за изображение | mini high | shutdown date 2 октября 2026 года |

| FLUX.2 Klein 4B / 9B | от \$0.014 / \$0.015 | часть lower-end mini-high сравнений | Megapixel pricing и другой quality target |

Эта таблица и есть статья. Все остальное только объясняет, в каком случае каждая строка честна.

Когда дешевые строки Google действительно важны

Google здесь важен, но только если не размывать задачу, которую он решает.

Самый понятный Google-hosted generation lane это Imagen 4 Fast по \$0.02 за изображение на текущей Gemini Developer API pricing page. Это осмысленный ответ тогда, когда ваша реальная comparison point это mini high, а не mini low или medium, и когда нужен простой hosted generation product, а не queue или workflow tweak внутри OpenAI.

Но caveat настолько важен, что должен стоять в том же абзаце, что и цена. На текущей deprecations page Google указывает для imagen-4.0-fast-generate-001 shutdown date 24 июня 2026 года. Это не делает Imagen 4 Fast бесполезным сегодня. Это делает его short-horizon cheaper lane, а не вечным default answer, про который можно забыть после миграции.

gemini-2.5-flash-image batch еще более чувствителен к контексту. Текущая pricing page Google показывает \$0.0195 за изображение на batch pricing и \$0.039 за изображение на standard pricing. Отсюда и появляется красивый дешевый row, который может пройти ниже mini high. Но текущая deprecations page также указывает 2 октября 2026 года как shutdown date для gemini-2.5-flash-image. Иными словами, дешевый row реален, но его clock тоже реален.

Поэтому честный ответ про Google намного уже, чем кажется в pricing grid:

- используйте Imagen 4 Fast, если нужен простой Google-hosted generation lane, который сейчас дешевле mini high

- используйте

gemini-2.5-flash-imagebatch только если вам подходит более короткий lifecycle и именно batch path - не называйте ни один из этих rows универсально дешевле mini

Последняя строка и есть главный trust test. Если ваш текущий workload уже помещается в mini low или medium, Google не приносит более чистую победу по цене. Он приносит другую платформу, другой lifecycle и cheaper row только против одной конкретной строки mini.

Когда BFL дешевле только потому, что меняется сам job

Black Forest Labs должен быть в этой статье, но по другой причине.

Текущая pricing page BFL дает один действительно lower starting lane: FLUX.2 [klein] 4B от 0.014 и FLUX.2 [klein] 9B от 0.015 при megapixel-based pricing. Это означает, что Klein может опускаться ниже mini high и иногда оказываться у той границы, где читатель всерьез начинает выбирать между staying on OpenAI и уходом во внешний stack.

Но смысл BFL не в том, что перед нами чистый дешевый клон mini. Смысл в том, что Klein это lower-end high-volume lane с другой product posture. Сама документация BFL описывает его как маршрут для real-time, high-volume и balanced quality-speed use cases. Это реальный route, но это уже не та же продуктовая promise, что и у GPT Image family.

Именно это отличие live SERP чаще всего и стирает. Cheap не всегда означает ту же самую работу за меньшее число. Иногда cheap означает:

- более низкие ожидания по quality

- другую economics output size

- другой operating assumption

- volume-first lane вместо попытки сохранить поведение OpenAI-style generation

Поэтому рекомендация про BFL должна оставаться узкой. Используйте FLUX.2 Klein тогда, когда вы осознанно выбираете дешевый внешний volume lane, а не one-to-one замену mini.

Та же pricing page BFL заодно показывает, что не должно попадать на эту страницу. FLUX.1 Kontext [pro] стоит 0.04 за изображение. Это не дешевле mini high. Он по-прежнему может быть правильным выбором для edit-heavy workflow, но это уже другой вопрос, и он относится скорее к GPT Image 1 Mini alternative, а не к cheaper-alternative page.

Этот контраст полезен, потому что не дает статье расплыться. У BFL есть cheap-looking lanes, но единственный price-first route здесь это Klein. Если вам нужна edit-heavy control, вопрос уже сместился от cheaper к better-fit.

Когда реальная проблема в setup, а не в цене

Одна из причин, по которой cheaper-alternative query выглядит сильнее, чем она есть на самом деле, состоит в том, что access pain очень легко ощущается как price pain.

На текущей help page по organization verification OpenAI пишет, что verification unlocks image-generation capabilities, не требует spending thresholds, может занимать до 30 минут на обновление статуса и часто решает lingering access issues после создания нового API key. Это не pricing advice, но это крайне важный routing advice. Если ваша проблема в verification или route state, vendor switch лечит не ту болезнь.

Текущий community thread OpenAI про rate-limit errors в gpt-image-1 показывает то же самое со стороны пользователя. Люди сталкивались с 429 или free-tier-like failures еще до того, как реальная генерация изображений вообще начиналась, даже после credits или verification. Дальше разговор уходил в payment state, tier, support и key regeneration troubleshooting. Это уже не разговор про дешевую модель. Это разговор про setup, который просто ощущается дорогим, потому что ничего полезного пока не shipping.

Эта секция важна, потому что live SERP плохо разделяет три состояния:

- модель слишком дорогая для задачи

- workflow дорогой, потому что вы не batching

- account или verification state блокирует доступ

Только первое состояние действительно требует более дешевой модели. Второе может требовать более дешевого workflow. Третье требует troubleshooting.

Если ваша реальная жалоба звучит как "мы слишком много платим за keepable images", тогда продолжайте читать эту страницу. Если она звучит как "мы все еще не можем чисто запустить route", тогда полезнее OpenAI image API tutorial, а не миграция на другого vendor.

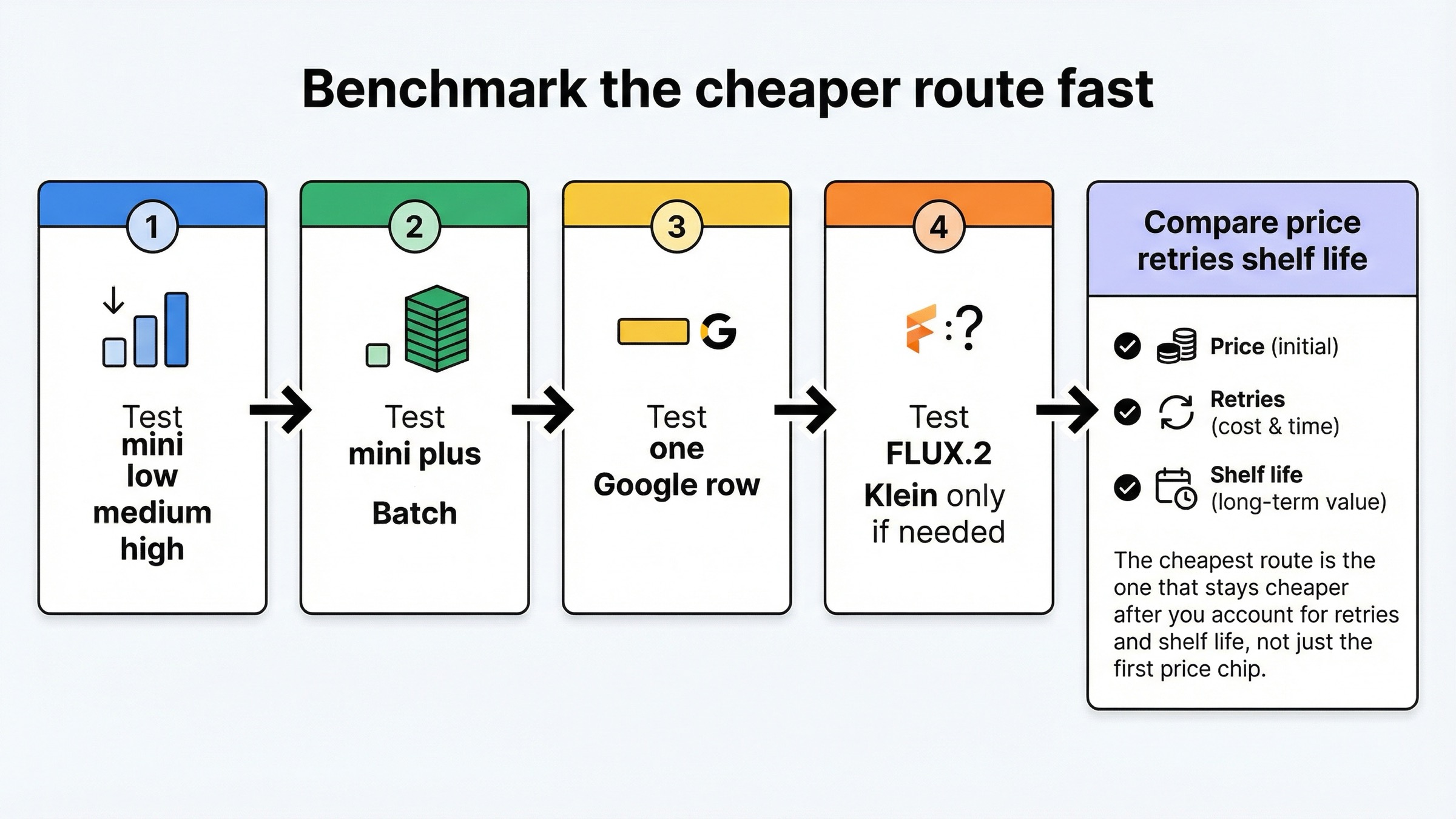

Как я бы проверял cheaper route за один вечер

Не выбирайте маршрут по одной строке. Выбирайте его по одному контролируемому вечеру тестов.

- Прогоните один и тот же prompt set через mini low, medium и high. На этот keyword нельзя честно ответить, если вы даже не проверили, с каким mini row реально сравниваете рынок.

- Если workload может подождать, прогоните mini через Batch. Это первый дешевый workflow route, потому что он сохраняет ту же model family и режет inputs и outputs на уровне платформы.

- Протестируйте Imagen 4 Fast только если вы честно сравниваете против mini high и действительно хотите простой Google-hosted generation lane.

- Протестируйте

gemini-2.5-flash-imagebatch только если short-horizon маршрут вас не ломает и shutdown date 2 октября 2026 года не убивает план. - Протестируйте FLUX.2 Klein только если вы и правда готовы покупать lower-end external volume lane, а не like-for-like replacement mini.

Потом сравнивайте три вещи, а не одну:

- цену за usable image

- retry count до результата, который вы бы оставили

- насколько безопасно строиться вокруг этого route после учета shutdown dates и workflow shape

Вот эту последнюю строку pricing guides обычно и пропускают. Самый дешевый row это еще не весь ответ. Дешевый route это тот, который остается дешевым после учета queue shape, quality expectation и shelf life.

FAQ

Есть ли сейчас что-то, что действительно дешевле gpt-image-1-mini в целом?

Нет, если говорить о clean current mainstream hosted swap. Те строки, которые сегодня действительно проходят ниже mini, либо бьют только mini high, либо зависят от Batch, либо меняют сам job настолько сильно, что вы уже не покупаете тот же тип route.

Какой самый дешевый способ продолжать использовать mini?

Сначала проверьте, хватает ли вам mini low или mini medium, а затем протестируйте Batch, если workload можно выполнять асинхронно. Обычно это и есть первый честный cheaper move, потому что он оставляет ту же model family и не заставляет мигрировать до того, как станет понятно, что cheaper requirement вообще реален.

Стоит ли переходить на Google только потому, что sticker price выглядит ниже?

Только если вы честно сравниваете против mini high и вас устраивает lifecycle caveat. Imagen 4 Fast и gemini-2.5-flash-image batch могут выглядеть дешевле в этом более узком сравнении, но ни один из них не дешевле mini low или medium, а оба маршрута имеют 2026 shutdown dates в текущей документации Google.

Вывод

Лучшая более дешевая альтернатива gpt-image-1-mini обычно не является другой mainstream hosted image model.

Если цена это вся проблема, оставляйте mini и сначала тестируйте Batch. Если вам нужно обойти только mini high, тогда Imagen 4 Fast и gemini-2.5-flash-image batch являются реальными текущими rows, но оба несут shutdown caveat 2026 года и ни один не дешевле mini low или medium. Если нужен lower-end external volume lane, FLUX.2 Klein выглядит самой чистой опцией BFL, но это уже смена job, а не универсальная замена mini. А если боль сидит в verification или access state, сначала чините setup, а уже потом называйте это pricing problem.

Именно этот честный ответ live SERP все еще прячет. Mini уже является floor. Реальная работа состоит в том, чтобы понять, нужно ли вам оптимизировать его, перерасти его или перестать принимать setup issue за проблему model pricing.