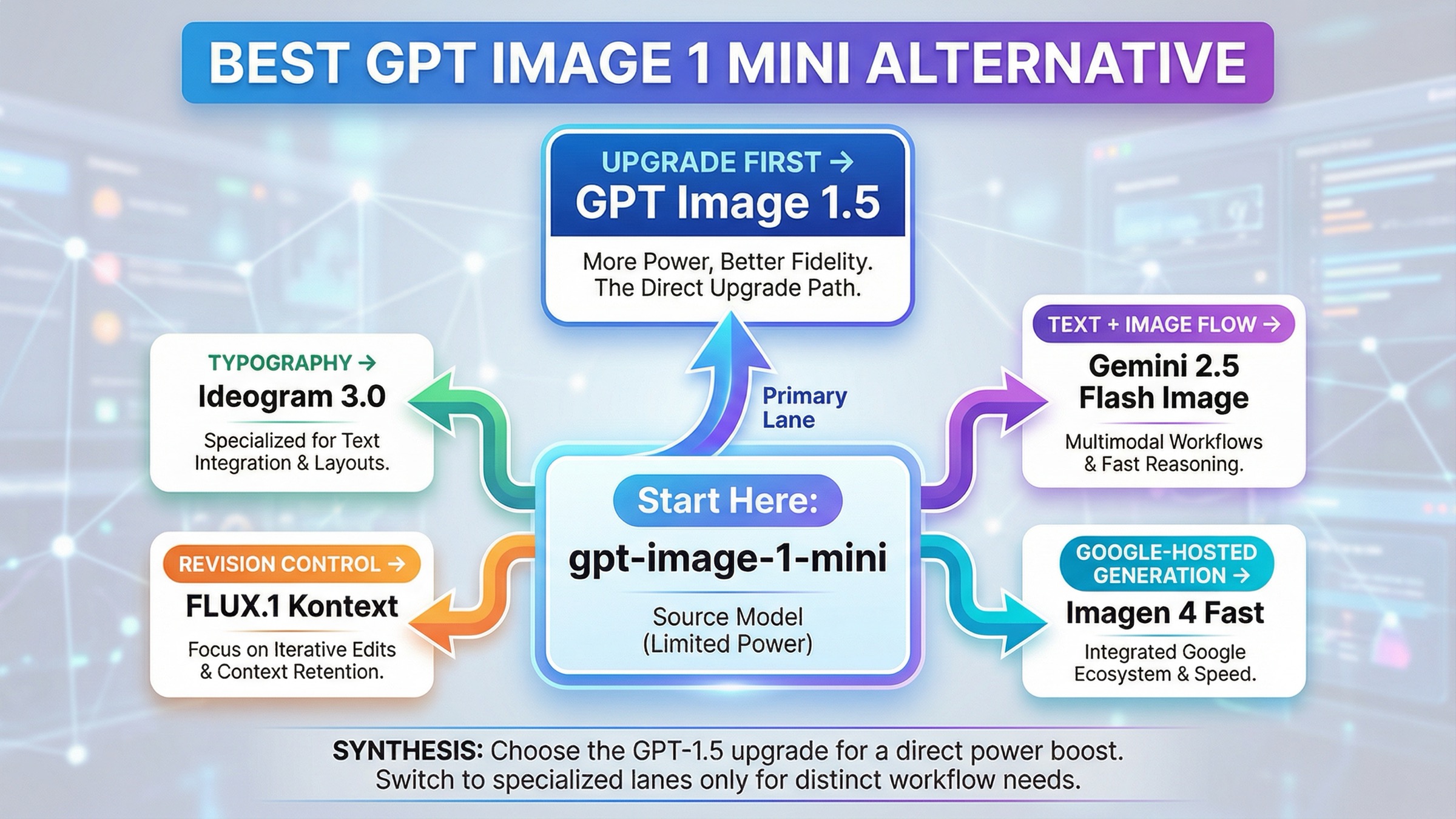

По состоянию на 27 марта 2026 года лучшая альтернатива gpt-image-1-mini зависит от того, в чем именно mini перестал вас устраивать. Если проблема только в общей слабости качества, в следовании сложным инструкциям или в уверенности на более дорогих выходах, первым делом стоит проверить GPT Image 1.5, а не другого вендора. Переключаться имеет смысл только тогда, когда сбой связан с задачей, которую split OpenAI между budget и flagship не закрывает: Ideogram 3.0 для типографики и layout-heavy дизайна, FLUX.1 Kontext для правок и консистентности, Gemini 2.5 Flash Image для мультимодального text-plus-image потока, а Imagen 4 Fast для более прямой Google-hosted генерации.

Именно этот более узкий выбор все еще плохо виден в текущей SERP по точному запросу. На первой странице много карточек моделей, прокси-сервисов, витрин и широких списков в духе “лучшие AI image models”. Они говорят, что mini существует и что он дешевле. Но обычно не объясняют, когда правильный следующий ход это апгрейд внутри OpenAI, а когда действительно нужен другой стек.

Есть и еще одна практическая оговорка, которую лучше вынести в начало. Некоторые поиски по gpt-image-1-mini alternative на самом деле не являются задачей выбора альтернативы. Текущая официальная image generation guide от OpenAI по-прежнему говорит, что Image API лучше подходит для one-shot generation и editing, а Responses API лучше подходит для conversational editable image experiences. Если ваш workflow кажется неудобным из-за того, что выбрана не та поверхность API, смена вендора не исправит настоящую проблему.

Самое быстрое правило переключения для пользователей gpt-image-1-mini

Если вам нужен только короткий вывод, начинайте отсюда.

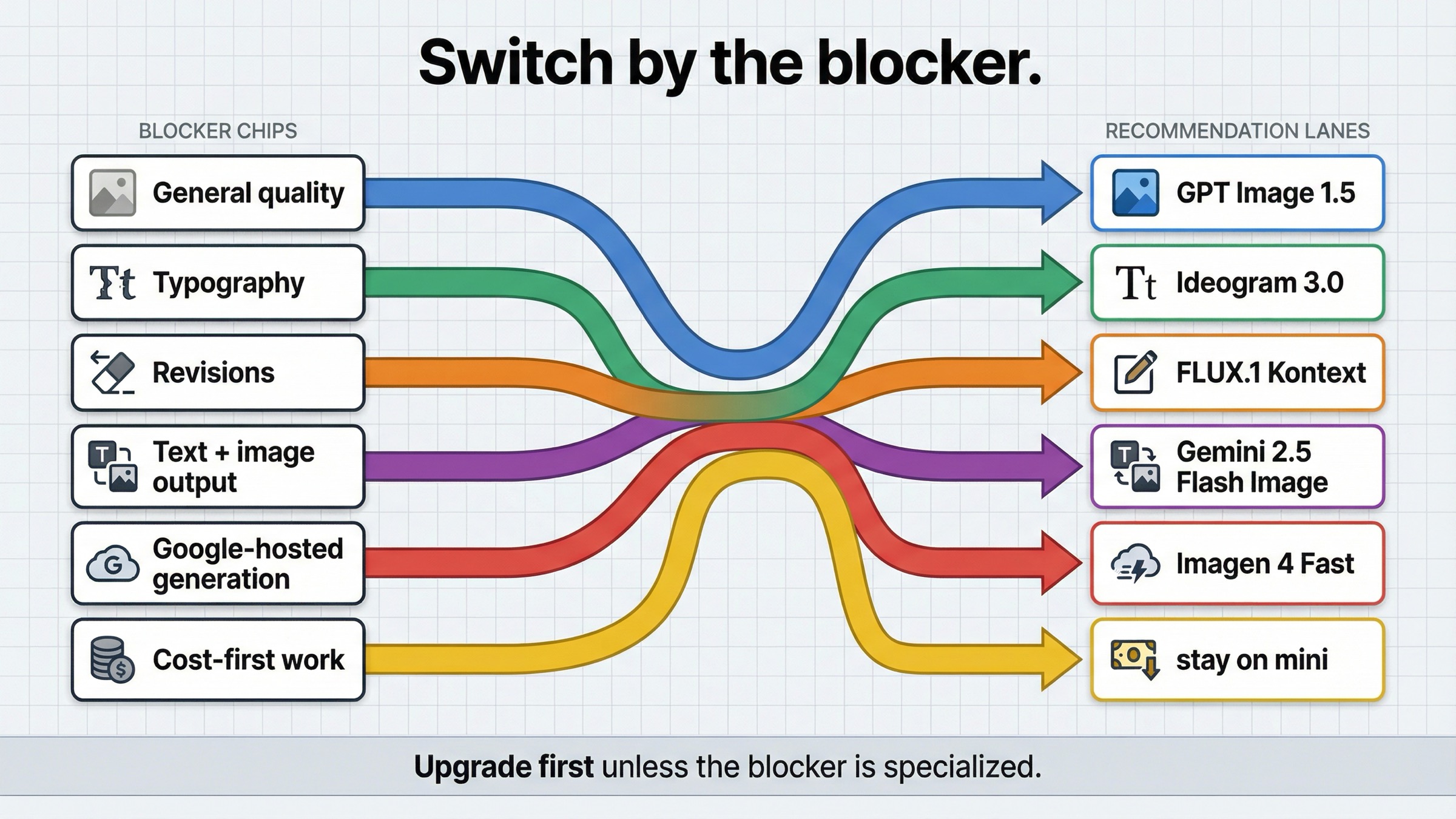

| Если mini не подходит потому что... | Вместо него стоит взять | Почему это лучше для этой задачи | Главный компромисс |

|---|---|---|---|

| нужна выше общая визуальная сила, лучшее следование prompt и больше уверенности на важных выходах | GPT Image 1.5 | Это текущая flagship-линия OpenAI для image generation, значит она закрывает самый очевидный кейс “mini слишком бюджетный для этой работы” без смены поставщика и стека | Цена за изображение заметно выше |

| для вас важнее постеры, ads, thumbnails и другой дизайн с видимым текстом | Ideogram 3.0 | Ideogram 3.0 прямо позиционируется вокруг text rendering, design quality и layout generation | Это не лучший ответ, если реальная боль не в типографике, а в edit control или мультимодальной оркестрации |

| команда много раз правит одну и ту же картинку, меняет текст и борется с консистентностью | FLUX.1 Kontext | Kontext построен вокруг editing, character consistency, text editing и style transformation | Его опубликованная hosted-цена не выглядит самой дешевой строкой |

| продукту нужен text output и image output в одном взаимодействии | Gemini 2.5 Flash Image | Google предлагает text and image inputs, text and image outputs и multi-turn image editing | Ценообразование токеновое, а не простая карточка “цена за картинку” |

| нужен более простой Google-hosted image lane | Imagen 4 Fast | Google продает его как отдельную text-to-image линию с понятной ценой за изображение | Он менее убедителен, чем Gemini, если workflow действительно требует text-plus-image reasoning |

| стоимость по-прежнему главный фактор, а выходы низкорисковые | Оставайтесь на gpt-image-1-mini | OpenAI по-прежнему держит mini как свой самый дешевый официальный image lane | Вы сохраняете бюджетный потолок качества |

| реальная проблема в tiers, rate limits или неправильно выбранной API surface | Оставайтесь в OpenAI и чините маршрут | Иногда сломан доступ или workflow, а не сама модель | Нужно решать настройку, а не “переезжать” |

Эта таблица важна, потому что она сжимает реальное решение. Ключевой запрос звучит как обзор рынка, но под ним скрывается более узкий выбор: вы заменяете дешевую general image lane или конкретную слабость mini, которую он по определению не должен закрывать?

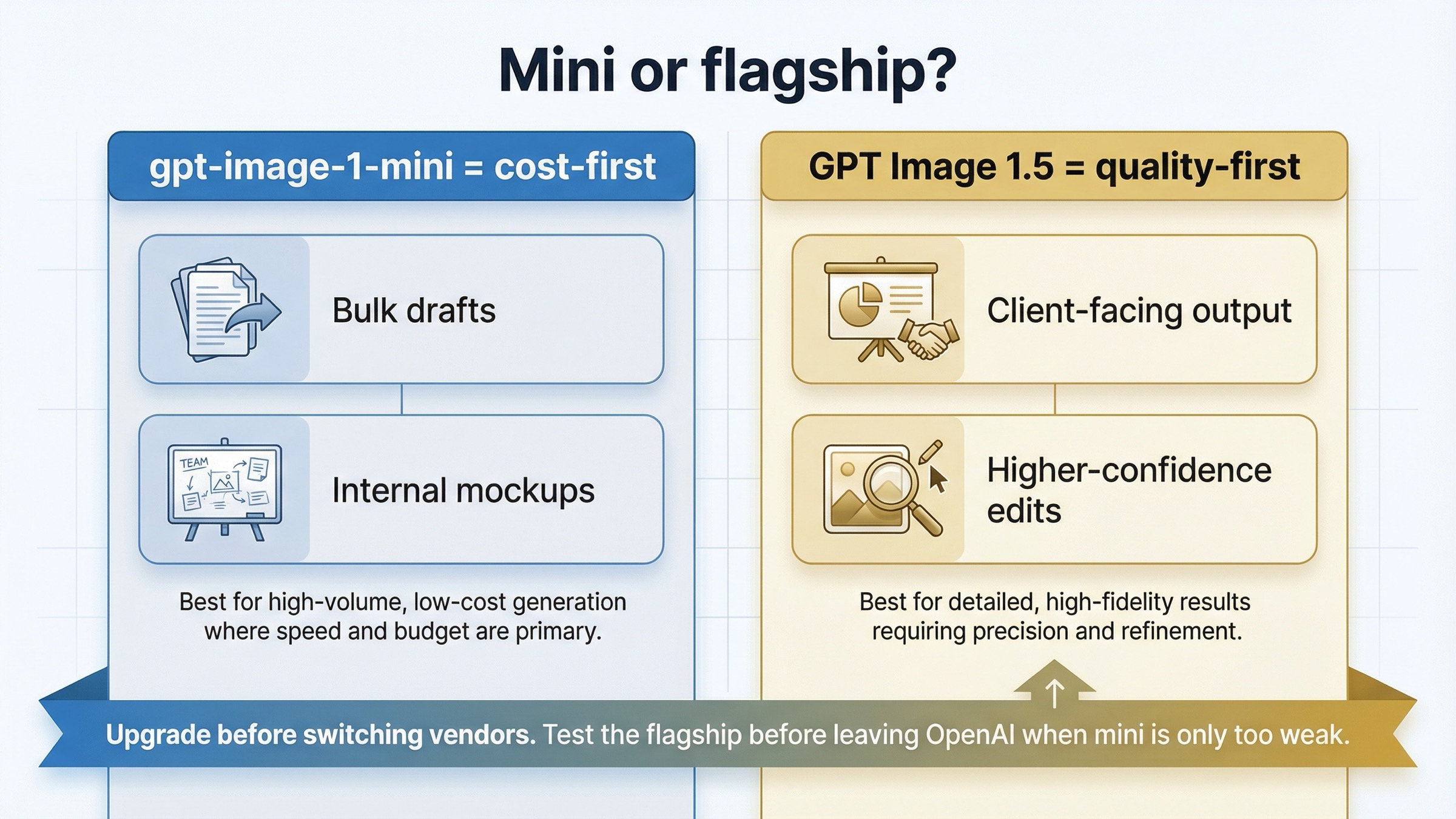

Переходите на GPT Image 1.5, если mini подводит только по общей силе

Самая частая ошибка в этом семействе запросов это пропустить очевидный same-vendor upgrade.

Текущий каталог моделей OpenAI описывает линейку достаточно ясно. GPT Image 1.5 это state-of-the-art image generation model. GPT Image 1 это предыдущая image generation model. gpt-image-1-mini это cost-efficient branch. Из этого следует простой вывод: mini не должен выигрывать у flagship во всем. Он нужен для более дешевого объема, когда премия за flagship не оправдана.

Если ваша реальная жалоба звучит так:

- mini хуже держит сложные creative prompts

- для черновиков его хватает, но для client-facing output уже нет

- экономия на цене за изображение превращается в слишком много повторных запусков

- на простых задачах mini приемлем, а на требовательных быстро “сыпется”

то первым сравнением должен быть GPT Image 1.5, а не другой поставщик.

Именно разница в цене объясняет, почему этот апгрейд вообще существует. Страницы моделей OpenAI сейчас указывают квадратную генерацию 1024x1024 по $0.005, $0.011 и $0.036 для mini на low, medium и high. GPT Image 1.5 для той же квадратной лесенки указывает $0.009, $0.034 и $0.133. Это заметный скачок, особенно на medium и high. Но смысл flagship lane как раз в том, что некоторые workflow готовы один раз платить больше, если это избавляет от нескольких дешевых, но бесполезных перезапусков.

Поэтому этот запрос на самом деле спрашивает не “какая модель лучше mini вообще?”. Он спрашивает: “не взял ли я budget lane для работы, которая изначально была flagship work?”.

Вот где многие страницы про альтернативы теряют доверие. Они делают вид, что любая проблема должна заканчиваться сменой вендора. Хорошая статья про замену mini так делать не может, потому что иногда самый честный ответ звучит так: останьтесь внутри OpenAI и перестаньте ожидать, что бюджетная ветка будет вести себя как flagship.

Сама guide по image generation от OpenAI объясняет, зачем нужен этот апгрейд. В ней GPT Image связывается с более сильным instruction following, text rendering, detailed editing и real-world knowledge. Именно этот набор жалоб и скрывается за фразой “mini слишком слабый”. Если это ваш случай, уходить к другому поставщику до теста GPT Image 1.5 часто означает пропустить самый чистый control.

Если ваш следующий вопрос уже не про выбор вендора, а про внутреннюю математику OpenAI, посмотрите цены GPT Image 1 Mini и цены API GPT Image 1.5. Там глубже разобрана cost ladder. Здесь важна именно rule of switch.

Ideogram 3.0 это лучшая альтернатива для типографики и layout-heavy дизайна

Mini может быть дешевым и при этом оставаться неправильным инструментом, когда сама задача это по сути graphic design с видимым текстом внутри результата.

Именно поэтому Ideogram 3.0 стоит тестировать первым в таком сценарии.

Официальная страница Ideogram 3.0 не продает модель как универсальный image catch-all. Она обещает более конкретную вещь: улучшения в text rendering quality, creative designs и text and layout generation для graphic design, advertising, marketing и других профессиональных use cases. Это совсем другой promise по сравнению с budget image lane, который выигрывает прежде всего ценой.

Практически это важно потому, что многие сравнительные статьи превращают “качество” в одну общую категорию. Но есть scene quality, photo quality, prompt adherence, edit reliability, а есть типографика и layout quality, которые становятся всем продуктом, когда вы генерируете постеры, ad creatives, social promos, концепты landing pages, обложки или thumbnails с реальным текстом.

Если ваша жалоба звучит так:

- “сцена нормальная, но словам нельзя доверять”

- “layout все еще требует слишком много ручной чистки”

- “нужен текст, который выглядит спроектированным, а не просто читаемым”

- “для меня важнее композиция плюс типографика, а не просто картинка”

то Ideogram становится лучшим внешним тестом, потому что он явно пытается выиграть именно эту задачу.

Есть и операционная причина держать этот маршрут отдельно от Gemini. Текущая страница API pricing у Ideogram показывает основные generation и editing endpoints как flat-fee output-image calls, а не как token-priced multimodal model. Поэтому Ideogram естественнее сравнивать там, где workflow по-прежнему сводится к “сгенерируй оформленный asset”, а не к “веди текстово-визуальный диалог, который закончится картинкой”.

Здесь рекомендация должна оставаться узкой. Используйте Ideogram 3.0, когда дизайн-система сама является продуктом. Не превращайте его в универсальный ответ на любую боль с mini. Если проблема в edit control или consistency, то Kontext логичнее. Если проблема просто в том, что mini слишком слаб на важных выходах, GPT Image 1.5 остается первым ходом.

FLUX.1 Kontext это лучшая альтернатива для итеративных правок и консистентности

Некоторые команды недовольны mini не потому, что первая генерация совсем unusable. Они недовольны тем, что вторая, третья и четвертая правка становятся слишком разрушительными, ненадежными или дорогими по времени.

Это именно тот lane, в котором FLUX.1 Kontext оказывается сильнее, чем обычно признают общие roundup-страницы.

Официальный обзор Kontext от Black Forest Labs строит позиционирование вокруг image editing, character consistency, text editing и style transformation. Документация также говорит, что Kontext умеет изменять отдельные части изображения, сохраняя все остальное, поддерживать identity персонажа через итерации и заменять текст в табличках, постерах и лейблах без разрушения окружающего оформления.

Это не просто еще одна вариация на тему text-to-image. Это workflow pitch.

Именно здесь всплывает скрытый cost question, который многие roundups сглаживают. Реальная стоимость image generation часто сидит не в первой картинке. Она сидит в количестве раз, когда вы вынуждены перегенерировать, чинить или вручную дочищать результат до publishable state. Поэтому Kontext может оказаться дешевле на практике, даже если официальный pricing у BFL сейчас указывает FLUX.1 Kontext [pro] по $0.04 за изображение, что выше, чем mini в некоторых рядах.

Если ваш workflow выглядит так:

- сохранить композицию, но поменять headline

- сохранить персонажа, но поменять сцену

- сохранить campaign style, но сделать пять новых вариантов

- сохранить картинку, но поправить текст или мелкие визуальные ошибки

то правильный вопрос это не “у какой модели ниже опубликованная цена?”. Правильный вопрос это “какая модель доведет меня до shipping output с меньшим числом оплаченных повторов?”.

Именно в этом чистая причина уйти с mini на Kontext. Переключайтесь тогда, когда cost center находится в давлении правок, а не только в first-pass generation.

Gemini 2.5 Flash Image и Imagen 4 Fast: как разделить роли

Google важен в этой альтернативной карте сразу по двум причинам, и слабые страницы обычно смешивают их в одну.

Выбирайте Gemini 2.5 Flash Image, когда продукту нужен text-and-image behavior в одном interaction loop.

Выбирайте Imagen 4 Fast, когда нужен понятный hosted image-generation lane внутри Google Cloud.

Это не одна и та же работа.

Текущая документация Gemini 2.5 Flash Image говорит, что модель принимает text and image inputs, возвращает text and image outputs, поддерживает multi-turn image editing и потребляет 1290 tokens на каждое сгенерированное изображение. Страница цен Vertex AI отдельно указывает image output по $30 за 1M tokens для Gemini 2.5 Flash Image. Если перевести это в цену выхода для одной картинки 1024x1024, получится примерно $0.039 только за output tokens, без учета input. Это вывод из официальных чисел, а не готовый per-image прайс.

Эта структура цены хорошо показывает, что именно заменяет Gemini. Это не самая простая “карточка взамен mini”. Это более сильный маршрут тогда, когда одна модельная call должна интерпретировать текст, работать с изображениями, удерживать контекст диалога и затем возвращать изображение.

Поэтому Google не становится автоматическим ответом для пользователей mini, которым просто нужна более сильная картинка. Если workflow все еще довольно прямой image generation flow, то переход на Google добавляет vendor и billing complexity, которую GPT Image 1.5, возможно, уже решает. Gemini становится действительно убедительным, когда меняется форма workflow, а не только когда mini кажется слишком слабым.

С Imagen 4 Fast логика другая. Та же страница цен Google указывает Imagen 4 Fast по $0.02 за изображение, а документация Imagen 4 описывает его как часть dedicated image generation line. Поэтому Imagen оказывается более чистым ответом в сценарии “мне нужен Google-hosted generator с понятной per-image economics”.

Практическое правило выглядит так:

- Gemini 2.5 Flash Image для мультимодальных product flows

- Imagen 4 Fast для более простой hosted image generation внутри Google

Когда mini все еще должен оставаться в workflow

Надежная страница про альтернативы обязана иметь раздел о том, когда не нужно переключаться.

Mini стоит оставлять в workflow, когда:

- задача это high-volume ideation, internal mockups, disposable variants или low-stakes creative

- стоимость за изображение по-прежнему главный decision variable

- вам не нужна более сильная типографика, более точные правки или мультимодальный interaction model

- реальная friction не в качестве модели, а в доступе, tiers или confusion around API surface

Последний пункт важнее, чем признают многие страницы. Текущая статья поддержки OpenAI про API model availability by usage tier and verification status говорит, что GPT-image-1 и GPT-image-1-mini доступны API users на tiers 1–5, хотя часть доступа зависит от organization verification. В сообществе OpenAI хорошо видно, почему люди иногда считают setup friction доказательством того, что пора к другому вендору. В одном текущем обсуждении пользователи жаловались на rate-limit errors еще до генерации первой картинки, а ответы опять возвращали разговор к tier state, funding и verification, а не к качеству prompt.

Это не значит, что раздражение не настоящее. Это значит, что иногда правильное действие это не миграция, а проверка account state, правильного API key и подходящей surface.

Честное правило такое: оставайтесь на mini, когда mini все еще решает именно ту работу, для которой он был задуман.

Если ваш вопрос на самом деле шире и сводится к маршруту между OpenAI и другими поставщиками, дальше полезно читать альтернативу OpenAI image generation API. Если проблема не в модели, а в выборе маршрута внутри OpenAI, полезнее будет tutorial по OpenAI Image API.

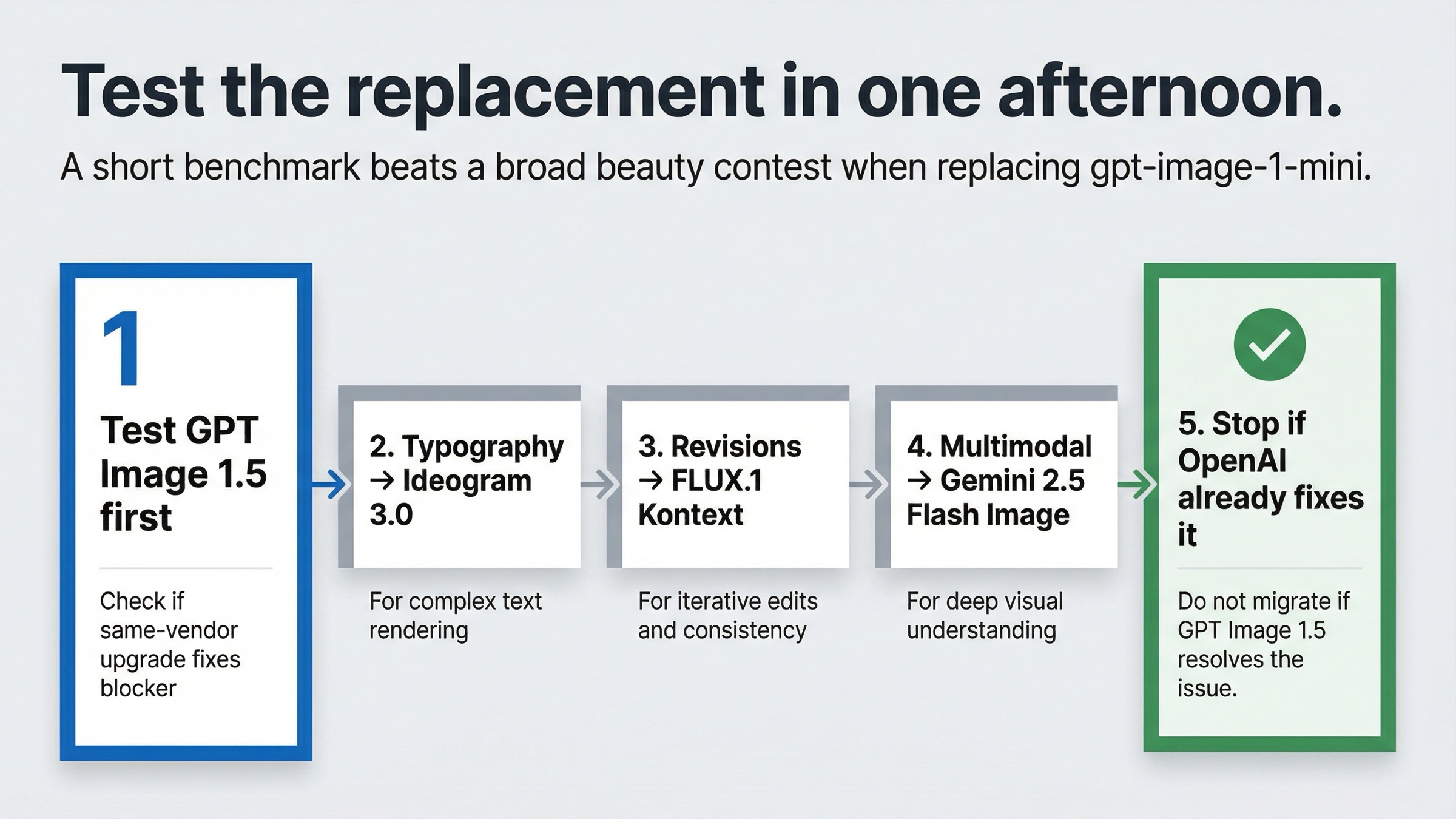

Как я бы протестировал замену за один день

Если команда действительно собирается заменять mini, не начинайте с конкурса красоты. Начинайте с точного сбоя.

1. Сначала прогоните очевидный same-vendor control.

Если mini слаб только по общей output quality, прогоните те же prompts на GPT Image 1.5 еще до любого другого поставщика.

2. Сделайте один typography test.

Возьмите prompt для постера, ad, thumbnail или упаковки и сравните mini с Ideogram 3.0. Смотрите на text cleanup, spacing, layout confidence и объем ручной доработки после генерации.

3. Сделайте один revision-loop test.

Возьмите базовую картинку, проведите через нее три change requests и сравните mini с FLUX.1 Kontext по сохранению сцены, дрейфу, замене текста и усилию оператора.

4. Сделайте один multimodal workflow test.

Если продукту нужен разговор плюс image output, сравните текущий OpenAI flow с одной сессией Gemini 2.5 Flash Image, которая объясняет, исправляет и рендерит в одном цикле.

5. Проверьте, нужен ли новый вендор вообще.

Если benchmark с GPT Image 1.5 уже убирает боль, остановитесь. Самая дешевая миграция это та, которую не пришлось делать.

Итог

Лучшая альтернатива gpt-image-1-mini это не одна конкретная модель. Это форма модели, которая исправляет ровно ту причину, по которой mini перестал быть правильным default.

Если mini слаб только по общей силе, сначала переходите на GPT Image 1.5. Если проблема в типографике и layout, берите Ideogram 3.0. Если боль в правках, консистентности и text replacement, берите FLUX.1 Kontext. Если продукту нужен один interaction loop, который умеет мыслить текстом и возвращать изображения, берите Gemini 2.5 Flash Image. Если нужен более простой Google-hosted generation lane, берите Imagen 4 Fast. И если стоимость все еще единственный настоящий фактор, оставайтесь на mini, пока workflow не даст конкретный повод для движения.