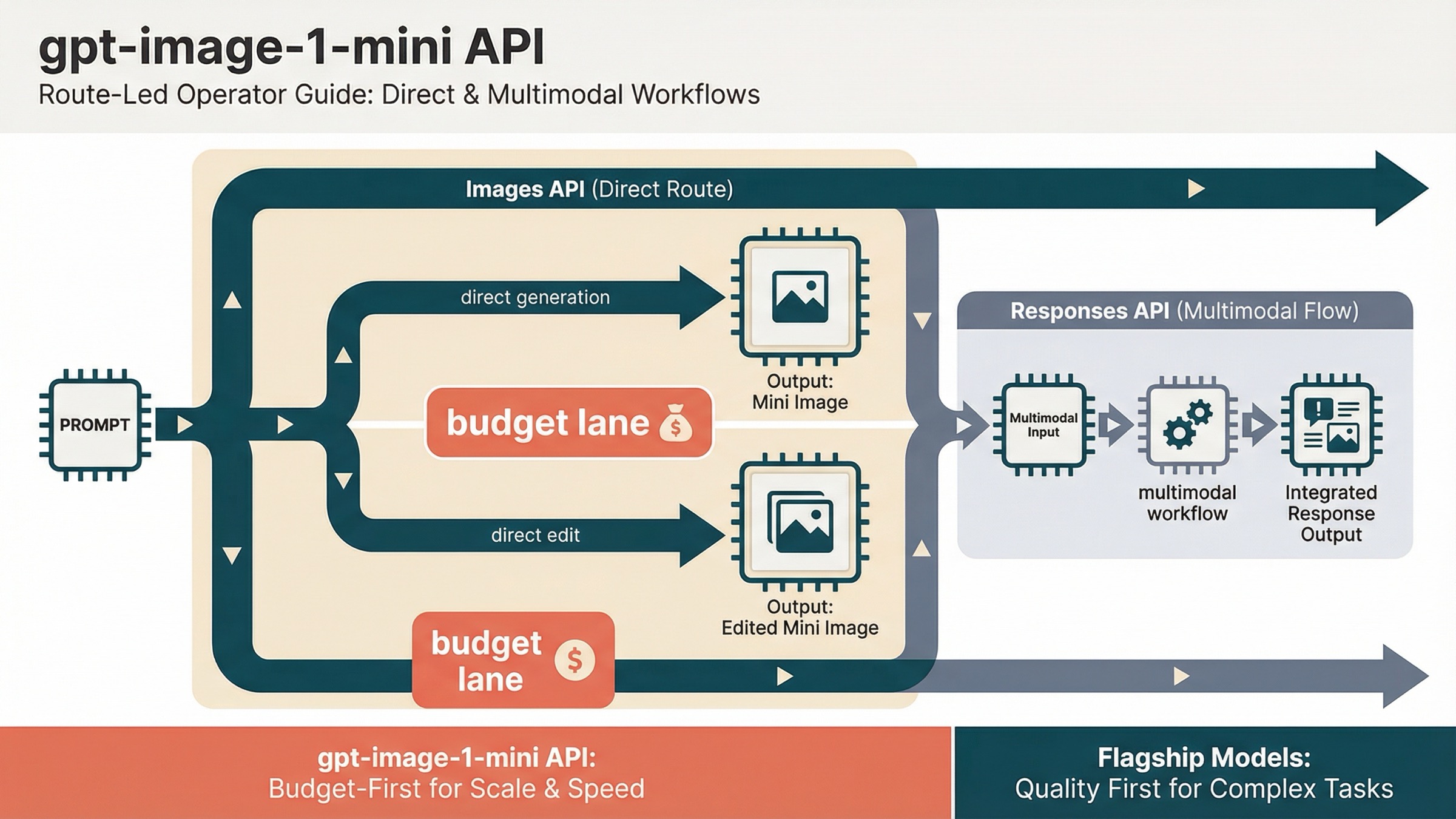

По состоянию на 27 марта 2026 года самый безопасный current default для gpt-image-1-mini простой: если вам нужна прямая generation или direct edit, начинайте с OpenAI Images API; если image generation — только один tool внутри большего multimodal workflow, переходите к Responses API. Именно этот route split current SERP все еще заставляет читателя собирать из нескольких страниц.

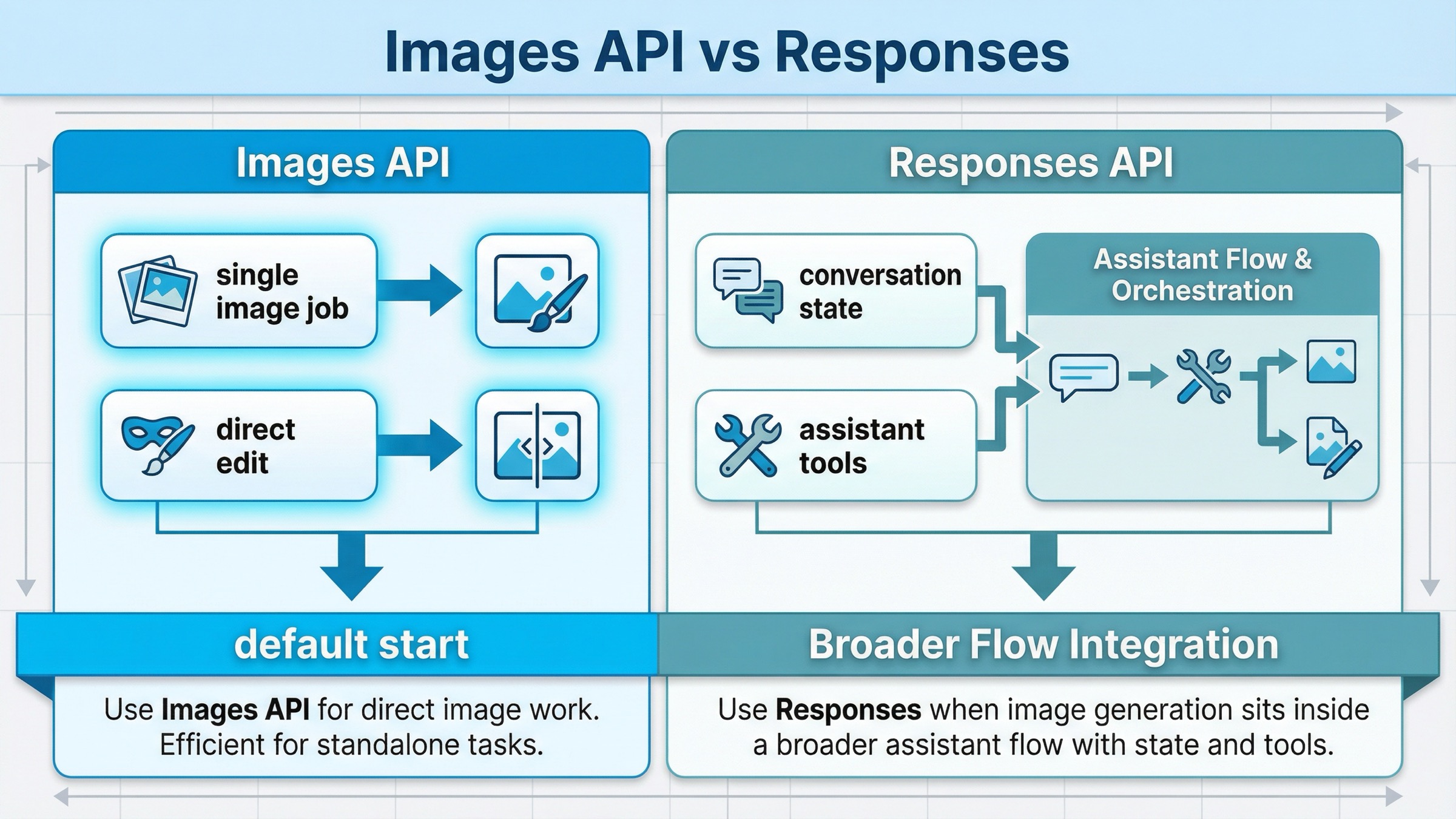

Этот keyword выглядит запутаннее, чем должен, не потому что OpenAI не дает ответ, а потому что ответ разбросан по нескольким официальным страницам. gpt-image-1-mini model page держит current pricing, endpoints и rate limits. Image-generation guide дает главное route rule: если вам нужно сгенерировать или отредактировать одну картинку по одному prompt, лучше Image API; если image generation живет внутри conversational editable flow, подходит Responses. Images and vision guide уже показывает tool path внутри Responses. Если читать только одну страницу, легко стартовать не с той abstraction.

Поэтому exact-match wrapper pages часто останавливаются на фразе "это дешевый image model OpenAI" и не говорят самое важное: с какой API surface реально начинать. Эта статья уже, чем общий OpenAI Image API tutorial: здесь речь только о том, что делать, если вы уже сузили задачу до gpt-image-1-mini.

Кратко

- direct generation и direct edit начинайте с Images API;

- Responses API нужен тогда, когда генерация картинки — часть larger assistant workflow;

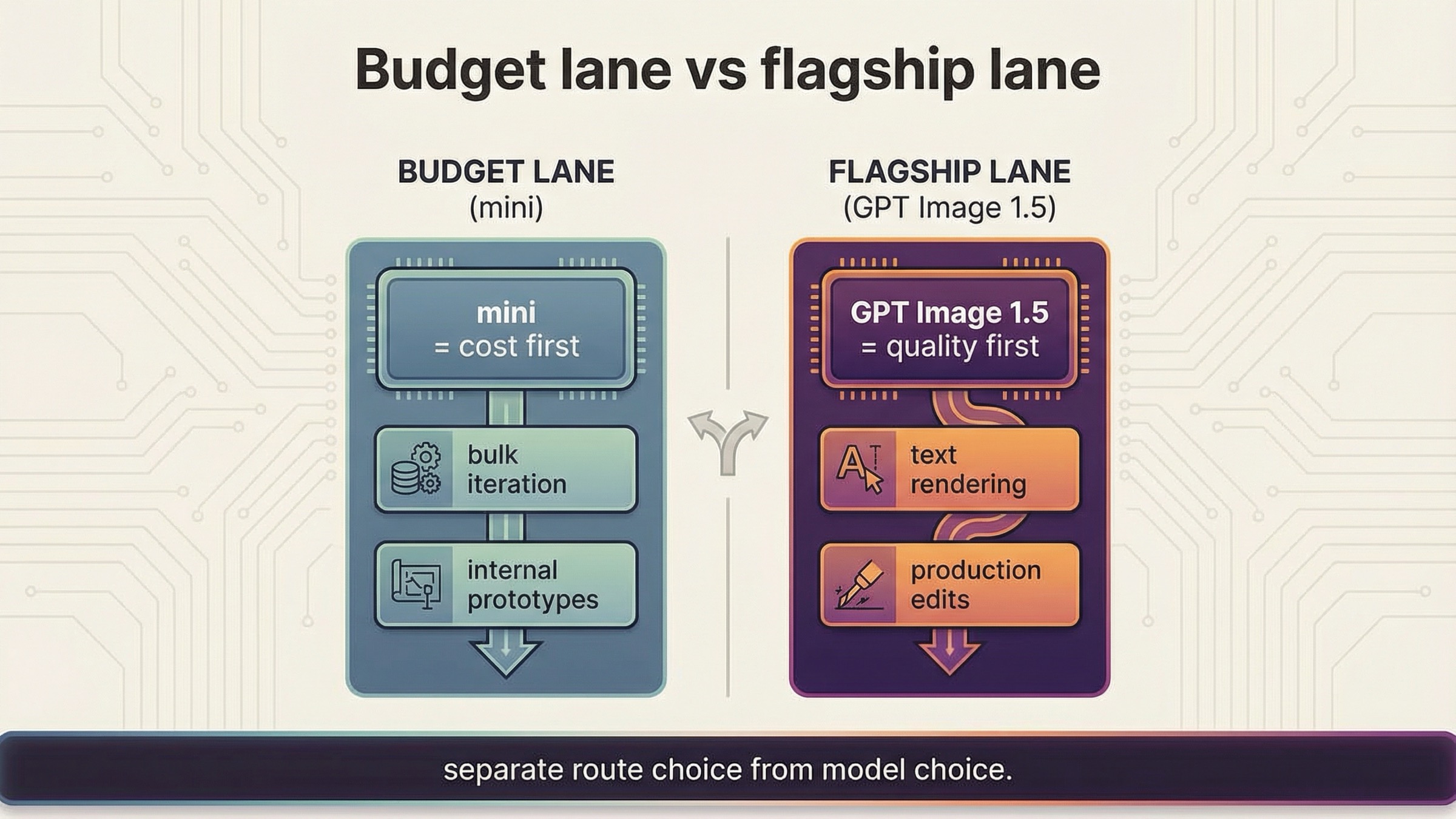

gpt-image-1-mini— это budget lane, а не universal flagship lane;- прежде чем переписывать код, проверьте tier access и organization verification.

Если нужен one-line takeaway, он такой: для первого запроса к gpt-image-1-mini выгоднее начинать с прямого Images API, а не с более широкого Responses flow. Это сокращает число moving parts и быстрее показывает, проблема у вас в доступе, в модели или в собственной обработке результата.

Самый безопасный direct path

Для этого keyword самое полезное первое действие — не попытаться покрыть все параметры сразу, а получить один короткий working request с минимальным failure surface. Current OpenAI guide прямо пишет, что Image API — лучший выбор, если нужно сгенерировать или отредактировать single image from one prompt. Это важно, потому что многие разработчики сначала видят Responses example и делают неверный вывод, что "более новый" route автоматически лучше и здесь.

Самый короткий generation path выглядит так:

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const result = await client.images.generate({ model: "gpt-image-1-mini", prompt: "Create a clean editorial illustration of a robot photographer in a bright studio", size: "1024x1024", quality: "medium", output_format: "jpeg", output_compression: 80, }); const imageBase64 = result.data[0].b64_json; fs.writeFileSync( "gpt-image-1-mini-demo.jpg", Buffer.from(imageBase64, "base64") );

Тот же смысл в Python:

pythonfrom openai import OpenAI import base64 client = OpenAI() result = client.images.generate( model="gpt-image-1-mini", prompt="Create a clean editorial illustration of a robot photographer in a bright studio", size="1024x1024", quality="medium", output_format="jpeg", output_compression=80, ) image_base64 = result.data[0].b64_json with open("gpt-image-1-mini-demo.jpg", "wb") as f: f.write(base64.b64decode(image_base64))

Первый request полезно держать boring deliberately. Вы проверяете не artistic maximum, а model ID, active project, access state и output handling. Чем раньше вы превратите first test в bigger workflow, тем сложнее будет понять, сломался route, account state или сам код.

Именно поэтому первая интеграция должна быть намеренно скучной. На старте вам не нужно доказывать, что вы умеете использовать все параметры модели. Вам нужно быстро проверить четыре базовые вещи: правильный ли project выбран, действительно ли доступен нужный model ID, открыт ли access и корректно ли вы сохраняете результат. Все остальные возможности стоит подключать только после того, как shortest direct path уже отработал.

Images API vs Responses для gpt-image-1-mini

Вот единственная route table, которая здесь действительно нужна:

| Ситуация | Лучший default | Почему |

|---|---|---|

| Нужен один prompt и одна output image | Images API | Самый короткий path и самый понятный debug |

| Нужен direct edit одной или нескольких input images | Images API | Та же прямая route без лишней orchestration |

| Генерация картинки — часть multimodal assistant | Responses API | Здесь abstraction определяет outer workflow |

| Нужны conversation state, tools и image output в одном request | Responses API | Image generation — только часть bigger flow |

| Нужно быстро проверить exact model | Images API | Меньше moving parts |

Практическое правило простое: если image generation и есть feature, начинайте с Images API. Если image generation — только step внутри assistant workflow, переходите к Responses.

Это же помогает снять самый частый спор внутри команды. Если кто-то предлагает сразу унифицировать все новые integrations через Responses только потому, что этот surface выглядит свежее, полезно задать один вопрос: нам правда нужны conversation state, другие tools или mixed outputs в одном request? Если нет, то более широкий abstraction только утяжеляет первую реализацию и увеличивает failure surface.

Как выглядит Responses route, когда он действительно нужен

Лучший способ не запутаться в Responses — увидеть его в правильном контексте. Current OpenAI docs показывают image generation inside Responses именно как tool внутри larger request, а не как default replacement для images.generate().

Это меняет mental model:

- top-level request — multimodal / assistant request;

- image generation — один tool внутри него;

- route меняется не потому, что model называется

gpt-image-1-mini, а потому что surrounding workflow стал шире.

Минимальный пример такой:

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const response = await client.responses.create({ model: "gpt-4.1-mini", input: "Generate a transparent sticker-style icon of a paper airplane", tools: [{ type: "image_generation", quality: "medium" }], }); const imageBase64 = response.output .filter((item) => item.type === "image_generation_call") .map((item) => item.result)[0]; fs.writeFileSync("paper-airplane.png", Buffer.from(imageBase64, "base64"));

Если ваш реальный job — "отправить prompt, получить image, сохранить bytes", этот route только увеличит failure surface. Он хорош не сам по себе, а тогда, когда вам правда нужен larger assistant flow.

Вот почему current SERP часто создает ложный выбор между двумя "одинаково правильными" вариантами. Для большинства читателей exact query вопрос звучит не как предпочтение интерфейса, а как инженерное решение: стоит ли усложнять первую поставку без продуктовой причины. В этом смысле Images API обычно выигрывает именно потому, что делает меньше.

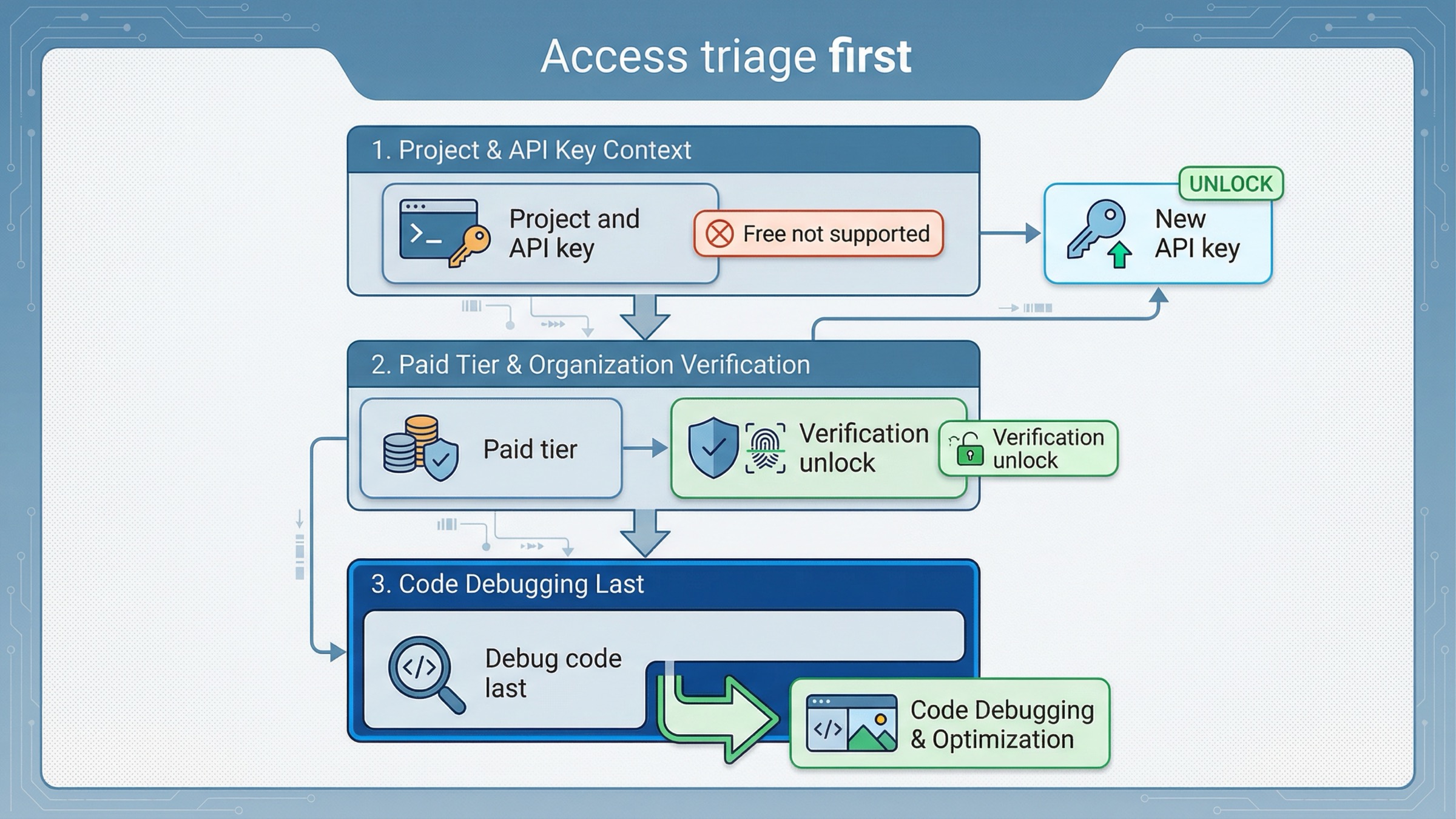

Сначала access, потом debugging

Еще одна точка, где exact-match pages тратят время читателя, — samples идут раньше, чем честный разговор про account readiness.

Current API model availability article говорит, что GPT-image-1 и GPT-image-1-mini доступны пользователям API на tiers 1 through 5, причем часть access зависит от organization verification. Current gpt-image-1-mini model page одновременно показывает Free not supported и Tier 1 starting at 100,000 TPM и 5 IPM.

Поэтому безопасный troubleshooting order такой:

- проверьте, что API key привязан к правильному project и organization;

- убедитесь, что account реально находится на paid tier;

- если доступ все равно выглядит заблокированным, проверьте branch с organization verification;

- только потом подозревайте prompt, SDK sample или output parsing.

Current help page по organization verification дополнительно говорит, что verification может unlock image-generation capabilities, статус может обновляться до 30 минут, а новый API key часто снимает lingering not-verified errors. Это account-state problem, а не model-selection problem.

Если у вас blocker именно в verification или permissions, следующая полезная статья — OpenAI image generation API verification, а не еще один похожий sample.

Эту мысль стоит повторить еще раз: если вы не проверили account state, почти любая попытка "дебажить код" будет преждевременной. Многие разработчики в такой ситуации меняют SDK, prompt format или целиком переписывают route через Responses, хотя реальная причина в том, что organization или tier еще не готовы к image capability.

Когда mini — правильный default, а когда нет

Здесь важно говорить честно. gpt-image-1-mini — budget lane, а не universal lane. Current image-generation guide рекомендует GPT Image 1.5 для best experience и предлагает mini, когда cost важнее, чем image quality. Current mini model page показывает, что по состоянию на 27 марта 2026 года 1024x1024 low / medium / high стоят $0.005 / $0.011 / $0.036.

Это особенно выгодно в таких workloads:

- bulk iteration;

- internal prototypes;

- low-stakes drafts;

- cost-sensitive feature work.

Но из этой таблицы нельзя делать вывод "значит теперь везде default = mini". Правильный вывод другой: если cost — первая constraint, mini — current first benchmark.

Если же workflow зависит от stronger text rendering, более стабильного quality, сложных edits или высокой цены каждой неудачи, тогда вопрос уже не только в route. Тогда уместнее смотреть OpenAI image generation API pricing или GPT Image 1.5 API pricing, потому что real question — какой model дает cheaper successful workflow, а не только cheaper image.

Это особенно важно для production-команд, которые оценивают не только цену одного изображения, но и цену успешного результата. Если более дешевый model чаще требует retries, ручной доработки или не держит quality bar для бренда, nominal sticker price уже не отражает реальную стоимость workflow. Именно поэтому mini нужно читать как cost-first option, а не как универсальный конец выбора.

Direct edit остается на том же route

Wrapper pages часто делают вид, будто для edit нужен другой conceptual path. На деле current mini model page уже перечисляет и v1/images/generations, и v1/images/edits. То есть если generation route уже идет через Images API, edit обычно остается на той же прямой surface.

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const result = await client.images.edit({ model: "gpt-image-1-mini", image: fs.createReadStream("room.png"), prompt: "Turn this room into a bright Nordic living room with pale oak shelves and soft morning light.", size: "1024x1024" }); const imageBase64 = result.data[0].b64_json; fs.writeFileSync("room-nordic.png", Buffer.from(imageBase64, "base64"));

Route rule остается тем же: direct edit — сначала Images API; Responses — только если edit живет внутри bigger assistant flow.

Troubleshooting: что thin wrapper pages не решают

Первый recurring mistake — слишком ранний переход к Responses. Если feature — просто сгенерировать или отредактировать картинку, larger abstraction дает больше способов дебажить не тот слой.

Второй mistake — читать mini как ответ для всех workloads. Official docs так его не позиционируют: mini — cost-efficient lane, GPT Image 1.5 — best-experience lane.

Третий mistake — переписывать code до проверки access state. Tier access и organization verification могут заблокировать image capability даже при валидном sample.

Четвертый mistake — думать, что exact-match article должен быть просто model card. На практике читателю нужен answer на два вопроса: "с чего начать?" и "когда этот default уже не лучший?"

Есть и три повторяющихся failure branches, которые thin wrapper pages обычно не закрывают. Если первый request падает access-style ошибкой, почти всегда полезнее проверить tier, project и verification, чем искать "более новый" sample. Если request проходит, но output quality не дотягивает, проблема чаще в том, что mini не подходит этому workload, а не в том, что выбран неправильный endpoint. И если команда тянется к Responses только потому, что он выглядит modern, стоит вернуться к product question: нужен ли larger multimodal workflow прямо в этом конкретном request.

Есть и еще одна полезная инженерная привычка: разделять вопрос маршрута и вопрос модели в календаре внедрения. Сначала вы подтверждаете, что direct route работает и что account готов к image capability. Только после этого есть смысл проводить benchmark mini против GPT Image 1.5 и принимать более дорогие продуктовые решения. Когда эти шаги смешиваются, команды часто тратят время не на тот класс проблем.

Если перевести это в практический rollout, порядок будет таким. Сначала вы добиваетесь одной предсказуемой direct generation на Images API и одной предсказуемой direct edit операции, чтобы убедиться, что integration работает в принципе. Потом вы проверяете access policy, verification и наблюдаете, нет ли нестабильности на уровне organization или project. И только после этого сравниваете mini с GPT Image 1.5 по качеству, скорости итерации и цене успешного результата, а не только по nominal pricing.

FAQ

Можно ли делать direct edits через gpt-image-1-mini?

Да. Current model page перечисляет и v1/images/generations, и v1/images/edits, так что edit может оставаться на Images API.

Есть ли у gpt-image-1-mini free tier?

Нет на current official page по состоянию на 27 марта 2026 года. Там явно указано Free not supported.

Когда лучше сразу смотреть GPT Image 1.5?

Когда quality, text rendering, complex edits или высокая цена неудачного результата важнее, чем lowest per-image price.

Финальная рекомендация

Если вы интегрируете gpt-image-1-mini сегодня, сначала используйте Images API. Для first generation request — тоже, для first edit request — тоже, и держите request достаточно простым, чтобы быстро проверить access и output handling. К Responses переходите только тогда, когда image generation — один step inside larger multimodal workflow.

После этого задайте второй вопрос отдельно: подходит ли mini именно вашему workload? Если cost — главный constraint, это сильный first benchmark. Если важнее quality, stronger text rendering и heavy edits, не позволяйте самой дешевой sticker price сделать решение за вас. Главная мысль этого keyword — route choice и model choice нужно разделять.

Именно это разделение делает exact query полезным на практике. Вы не обязаны одновременно выбрать и route, и "финальный лучший model" в первый день. Сначала нужен безопасный запуск. Потом уже честный benchmark по качеству и общей стоимости workflow.

Для engineering-команды это означает еще одну полезную вещь: обсуждение архитектуры становится короче. Вместо абстрактного спора "Images API или Responses API, mini или 1.5" вы задаете два конкретных вопроса по очереди. Какой surface дает самый короткий path к первому рабочему результату? И какой model дает лучший баланс качества и общей стоимости после того, как доступ и route уже подтверждены?