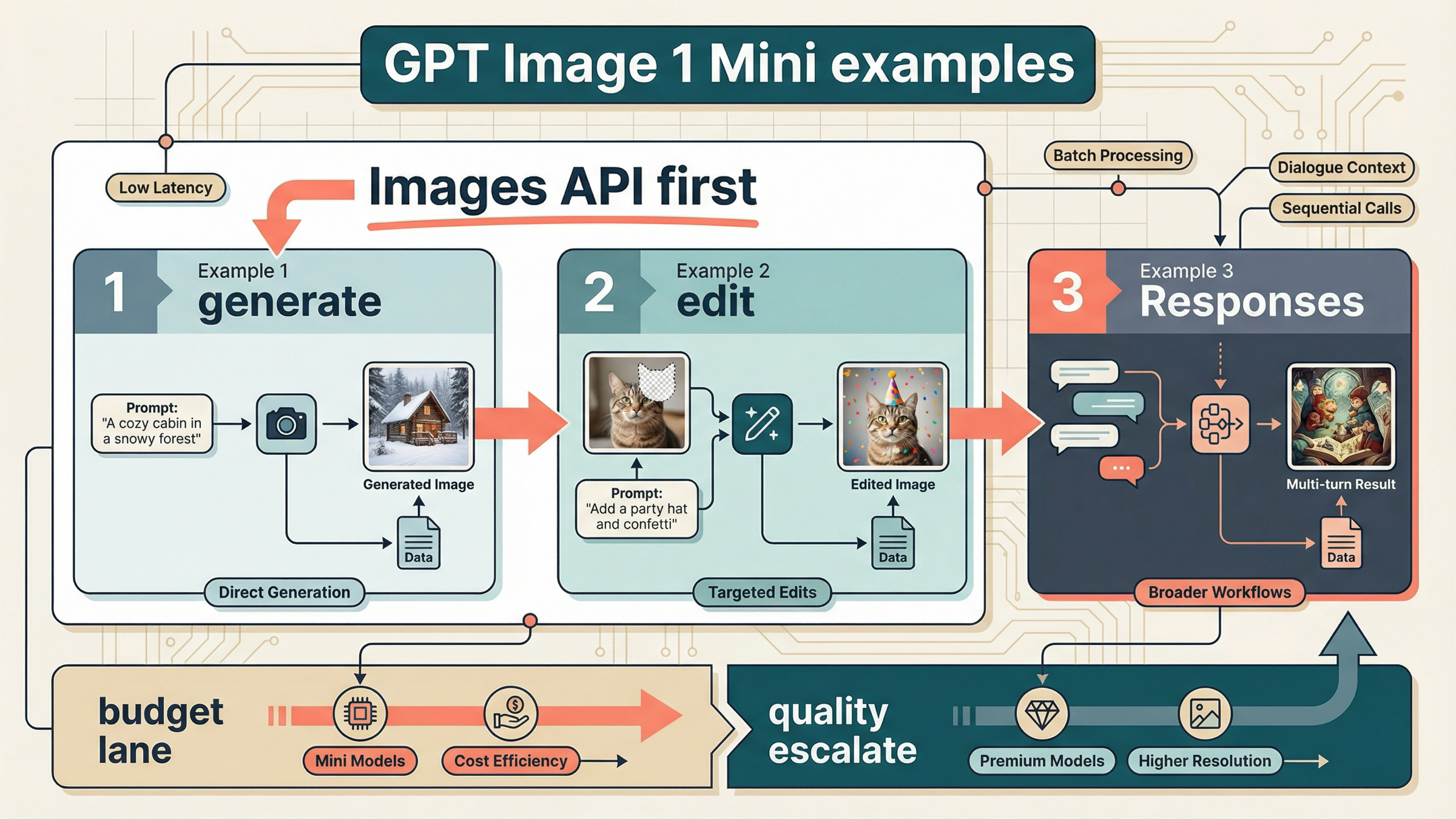

2026년 3월 29일 기준으로 gpt-image-1-mini examples 를 찾는다면, 가장 안전한 기본 순서는 명확합니다. one-shot generation 은 Images API, direct edit 도 Images API, Responses 는 정말로 multi-turn image workflow 가 필요할 때만. 현재 검색 결과가 가장 흐리게 만드는 부분이 바로 이 “어느 예제를 먼저 복사할지”인데, 현재 OpenAI 문서는 이 순서를 꽤 분명하게 보여줍니다.

현재 image generation guide 는 한 번의 prompt 로 한 번의 생성이나 편집만 필요하면 Image API 가 더 적합하다고 설명합니다. 반대로 Responses API 는 conversation 이나 multi-step flow 안에 image generation 을 넣을 때의 route 입니다. 여기에 gpt-image-1-mini model page 의 포지셔닝까지 합치면, mini 는 GPT Image 1 의 cost-efficient branch 이지 모든 이미지 작업의 universal default 는 아닙니다.

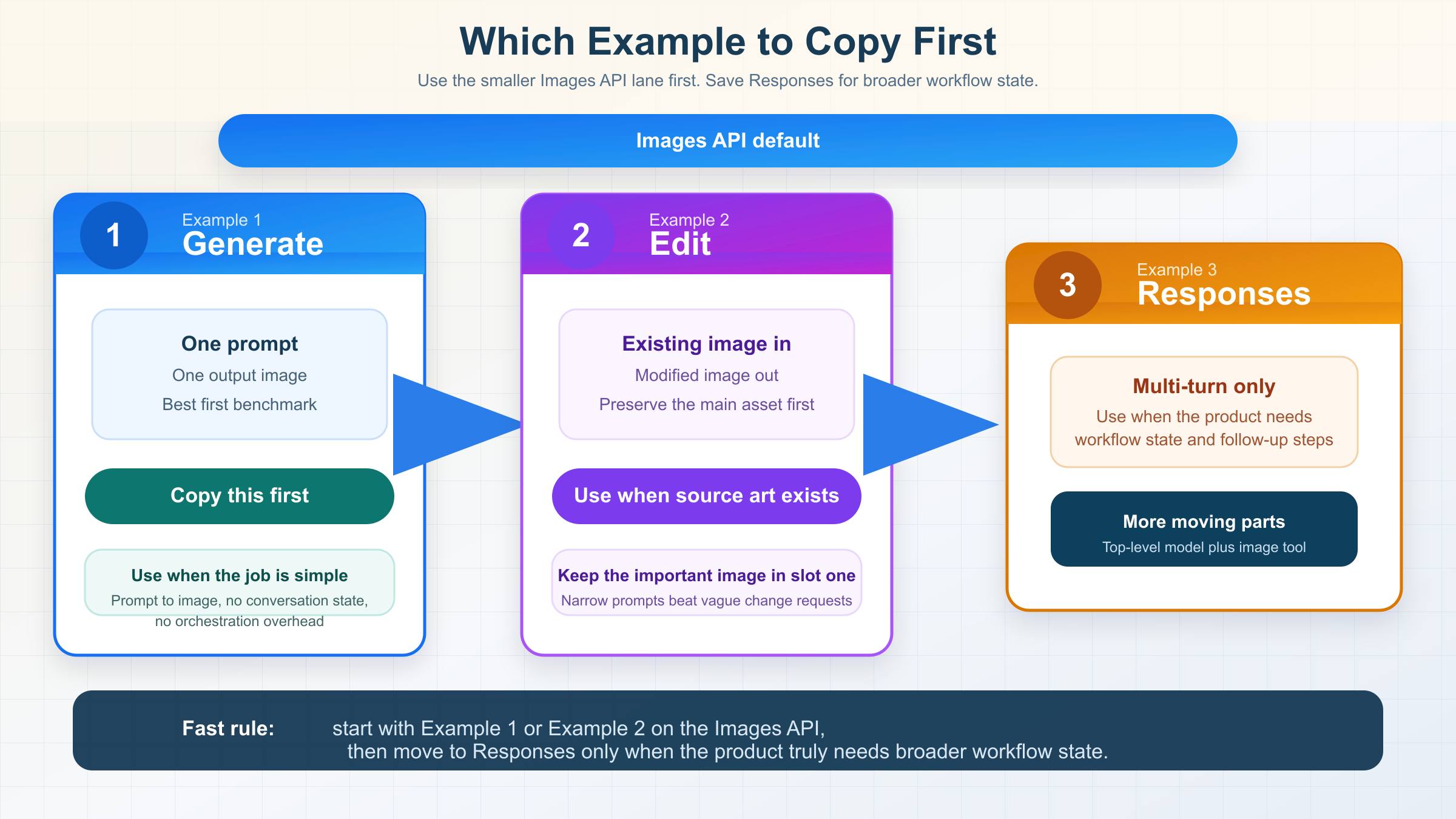

그래서 이 키워드에서 필요한 것은 “예제가 많아 보이는 페이지”가 아니라, 지금 무엇을 먼저 실행해야 하는지 를 정해 주는 페이지입니다. prompt-to-image 만 원하면 Example 1. 이미 있는 이미지를 바꾸고 싶으면 Example 2. 이미지가 더 큰 conversation workflow 안에서 상태를 이어가야 한다면 그때 Example 3 으로 가면 됩니다.

핵심 요약

- one-shot generation 과 direct edit 는 먼저 Images API 로 시작하는 편이 가장 안전합니다.

- Responses 는 multi-turn workflow 나 conversation state 가 정말 필요할 때만 쓰면 됩니다.

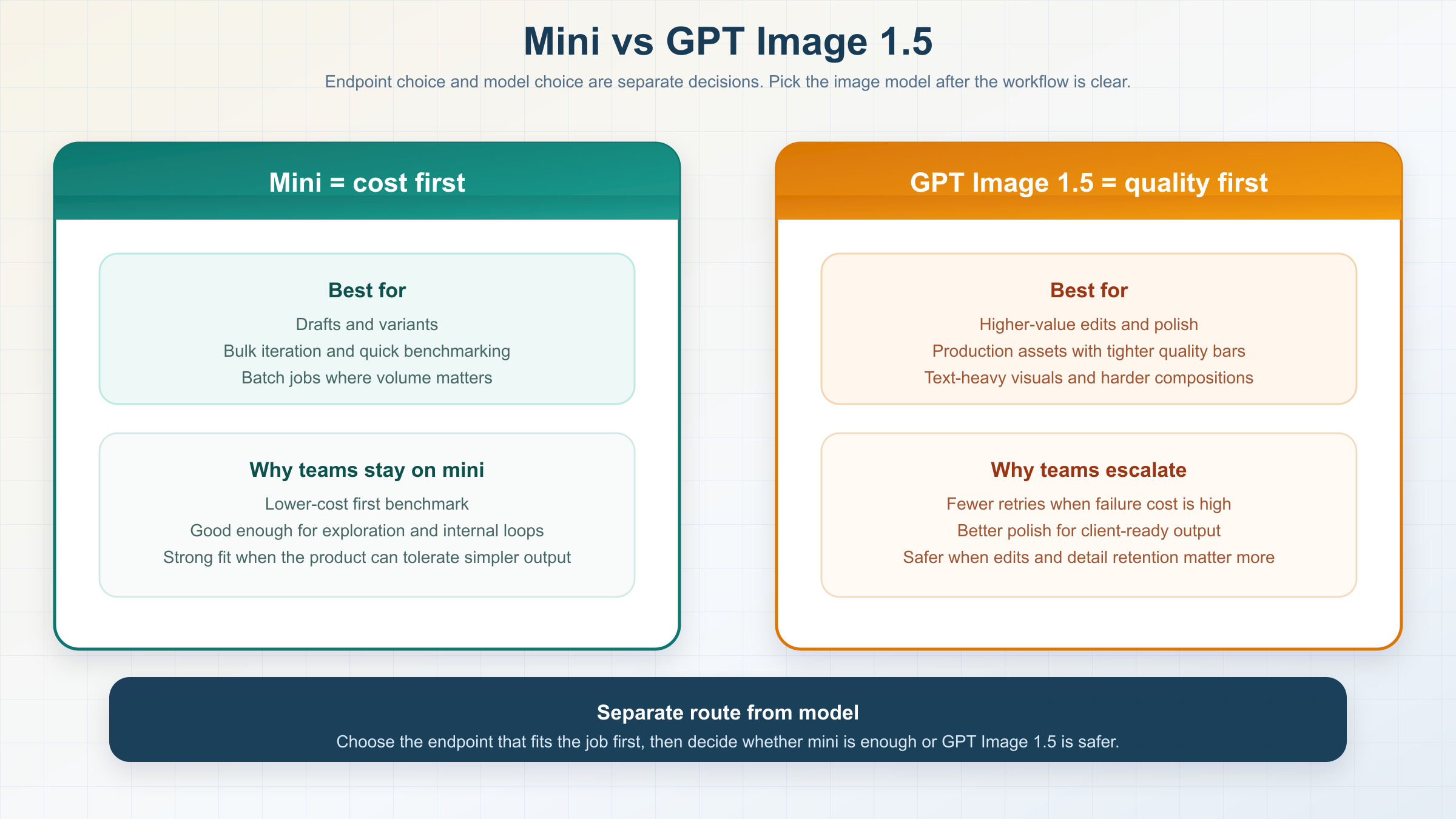

- cost first 면 mini, quality first 면 GPT Image 1.5 예제를 먼저 복사하는 판단이 기본입니다.

먼저 복사할 gpt-image-1-mini 예제 3가지

이 exact query 의 page one 은 model directory, example gallery, gateway playground 가 뒤섞여 있습니다. 다 쓸모가 없는 것은 아니지만 공통된 약점이 있습니다. 첫 번째 성공 경로를 좁혀 주지 못한다는 것 입니다. 아래 표가 가장 짧고 가장 실용적인 답입니다.

| 지금 필요한 것 | 먼저 복사할 example | API surface | 여기서 시작하는 이유 |

|---|---|---|---|

| 한 번의 prompt 로 한 장을 생성 | Example 1 | Images API | 가장 작은 official route 이고 first success 를 만들기 쉽기 때문 |

| 기존 이미지를 직접 수정 | Example 2 | Images API | current docs 도 direct image route 를 권하고, mini 의 fidelity rule 이 여기서 중요하기 때문 |

| 여러 턴에 걸쳐 이미지를 다듬는 workflow | Example 3 | Responses API | conversation state 와 larger orchestration 이 실제로 필요할 때만 이 추상화가 값어치를 하기 때문 |

현재 tool guide 는 image prompt 에 draw 나 edit 같은 direct verb 를 쓰는 편이 낫다고도 안내합니다. 작은 차이 같지만, 이런 설명이 없는 page 는 대개 “코드를 붙여 넣는 예시” 이상으로는 잘 도와주지 못합니다.

더 넓은 OpenAI image API example 이 필요하다면 OpenAI image generation API example 이 다음 읽을 거리입니다. 이 글은 일부러 mini 의 start-here decision 에만 좁게 맞췄습니다.

Example 1: Images API 로 한 번에 생성하기

mini 예제 중 가장 먼저 돌려 볼 것은 대개 가장 단순한 generate path 입니다. prompt 하나, 이미지 하나, base64 decode 하나. conversation state 도 없고 tool route 도 없습니다. 그래서 mini 가 지금 workload 에 맞는지 가장 빠르게 확인하기 좋습니다.

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const result = await client.images.generate({ model: "gpt-image-1-mini", prompt: "Draw a clean editorial illustration of a robot street photographer in bright morning light.", size: "1024x1024", quality: "medium", output_format: "jpeg", output_compression: 80, }); const imageBase64 = result.data[0].b64_json; fs.writeFileSync( "gpt-image-1-mini-generate.jpg", Buffer.from(imageBase64, "base64") );

Python 도 같은 모양입니다.

pythonfrom openai import OpenAI import base64 client = OpenAI() result = client.images.generate( model="gpt-image-1-mini", prompt="Draw a clean editorial illustration of a robot street photographer in bright morning light.", size="1024x1024", quality="medium", output_format="jpeg", output_compression=80, ) image_base64 = result.data[0].b64_json with open("gpt-image-1-mini-generate.jpg", "wb") as f: f.write(base64.b64decode(image_base64))

raw cURL 은 아래와 같습니다.

bashcurl https://api.openai.com/v1/images/generations \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "gpt-image-1-mini", "prompt": "Draw a clean editorial illustration of a robot street photographer in bright morning light.", "size": "1024x1024", "quality": "medium", "output_format": "jpeg", "output_compression": 80 }' \ | jq -r '.data[0].b64_json' \ | base64 --decode > gpt-image-1-mini-generate.jpg

이 example 이 first default 인 이유는 단순합니다. 현재 OpenAI 의 route rule 과 맞고, mini 가 정말 이 작업에 충분한지 가장 빨리 판단하게 해 주기 때문입니다. current guide 는 GPT Image 1.5 for the best experience 를 권하지만, cost-first benchmark 가 목적이라면 mini 를 가장 직접적인 route 에서 먼저 테스트하는 것이 맞습니다.

처음 요청은 일부러 boring 하게 두는 편이 좋습니다. square image, quality: "medium", 그리고 draw 같은 direct verb 로 시작하는 prompt. 저장과 decode 가 확인된 뒤에야 aspect ratio, transparency, streaming 같은 변수를 추가하는 편이 디버깅도 쉽습니다.

| Parameter | 안전한 시작값 | 바꿔야 하는 순간 |

|---|---|---|

size | 1024x1024 | 실제 제품 요구가 다른 aspect ratio 일 때 |

quality | medium | low 가 부족하거나 high 가 비용을 회수한다고 판단됐을 때 |

output_format | jpeg | downstream 이 다른 파일 형식을 요구할 때 |

output_compression | 80 | 파일 크기나 artifact 가 실제 문제일 때 |

current mini model page 의 1024x1024 가격은 low $0.005, medium $0.011, high $0.036 입니다. 이 차이면 high 를 처음부터 기본값으로 둘 이유는 거의 없습니다. draft, cheap benchmark, low-stakes variant 라면 medium 부터 시작하는 편이 더 합리적입니다.

Example 2: input_fidelity 로 직접 편집하기

이미 source image 가 있다면 여기서도 Images API 에 남는 편이 맞습니다. current docs 는 one-shot edit 를 Responses 의 기본 use case 로 밀지 않습니다. 핵심은 mini edit 를 어디서 하느냐보다, 무엇이 결과를 실제로 바꾸는가 입니다.

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const result = await client.images.edit({ model: "gpt-image-1-mini", image: [ fs.createReadStream("product-photo.jpg"), fs.createReadStream("brand-logo.png"), ], prompt: "Edit the first image by placing the logo from the second image onto the coffee cup label. Preserve the cup shape, lighting, camera angle, and table texture.", input_fidelity: "high", size: "1024x1024", quality: "medium", }); const imageBase64 = result.data[0].b64_json; fs.writeFileSync( "product-photo-edited.png", Buffer.from(imageBase64, "base64") );

현재 input fidelity 문서 는, gpt-image-1 과 gpt-image-1-mini 에서 input_fidelity: "high" 를 쓰면 첫 번째 input image 가 더 강하게 preserve 된다 고 설명합니다. 얼굴, 제품, logo 같이 가장 중요하게 유지해야 할 asset 이 있다면 slot one 에 두는 편이 맞습니다.

이게 바로 많은 wrapper page 가 놓치는 부분입니다. “edit 도 된다” 정도로는 충분하지 않고, 무엇이 output 차이를 만드는지 를 알려줘야 실제로 도움이 됩니다. mini edit 에서는 보통 다음 세 가지가 핵심입니다.

- 가장 중요한 asset 을 first image 로 둔다.

input_fidelity: "high"는 detail preservation 이 실제로 중요한 경우에만 쓴다.- prompt 에서 “무엇을 바꿀지” 와 “무엇을 유지할지” 를 함께 적는다.

mask 를 쓰더라도 이건 여전히 prompt-driven generative edit 입니다. Photoshop 식 deterministic patching 이 아니라는 점을 기억해야 합니다. image 와 mask 는 같은 size 와 format 이어야 하고 alpha channel 도 필요하지만, 그 자체가 완전한 픽셀 보존을 약속하지는 않습니다.

또 하나 흔한 함정은 SDK 를 벗어난 뒤 raw HTTP 에서 multipart form-data 를 잘못 보내는 것입니다. SDK 가 숨겨 주던 upload mechanics 를 직접 맞춰야 하므로, “SDK 에서는 되는데 HTTP 로는 안 된다” 는 문제는 꽤 자주 파일 업로드 shape 에서 나옵니다.

edit 자체를 더 깊게 보고 싶다면 GPT Image 1 Mini edit 이 더 맞는 다음 글입니다. 이 글은 example choice 에만 집중합니다.

Example 3: Responses 는 multi-turn workflow 가 필요할 때만

이 example 을 세 번째로 미루는 이유는, 더 “최신”이라서가 아니라 정말로 더 큰 workflow 가 필요할 때만 값어치가 있기 때문입니다.

Responses API 에서는 top-level model 에 gpt-image-1-mini 를 넣지 않습니다. current docs 가 설명하듯, hosted image_generation tool 아래에서는 GPT Image family 가 쓰이지만, model field 자체는 gpt-4.1 이나 gpt-5 같은 mainline text model 이어야 합니다.

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const response = await client.responses.create({ model: "gpt-5", input: "Generate an image of a gray tabby cat reading a newspaper at a cafe table.", tools: [{ type: "image_generation" }], }); const firstImage = response.output .filter((item) => item.type === "image_generation_call") .map((item) => item.result)[0]; fs.writeFileSync("cat-cafe.png", Buffer.from(firstImage, "base64")); const followUp = await client.responses.create({ model: "gpt-5", previous_response_id: response.id, input: "Now make it look like a realistic magazine photo.", tools: [{ type: "image_generation" }], }); const secondImage = followUp.output .filter((item) => item.type === "image_generation_call") .map((item) => item.result)[0]; fs.writeFileSync("cat-cafe-realistic.png", Buffer.from(secondImage, "base64"));

Responses 로 가야 하는 순간은 이미지 생성이 single-shot task 가 아니라 conversation state 나 larger orchestration 의 일부가 되는 순간입니다. current docs 는 Responses 의 장점으로 multi-turn editing 과 more flexible image inputs 를 듭니다. 반대로 simple generation 이나 direct edit 만 필요한 상황이라면, 이 추상화는 보통 디버깅 면만 넓힙니다.

그래서 SERP 가 Responses 를 더 modern 하게 보여 줘도 그대로 믿을 필요가 없습니다. OpenAI 의 답은 더 단순합니다. 더 현대적인 route 가 아니라, job 에 맞는 route 가 맞는 route 입니다.

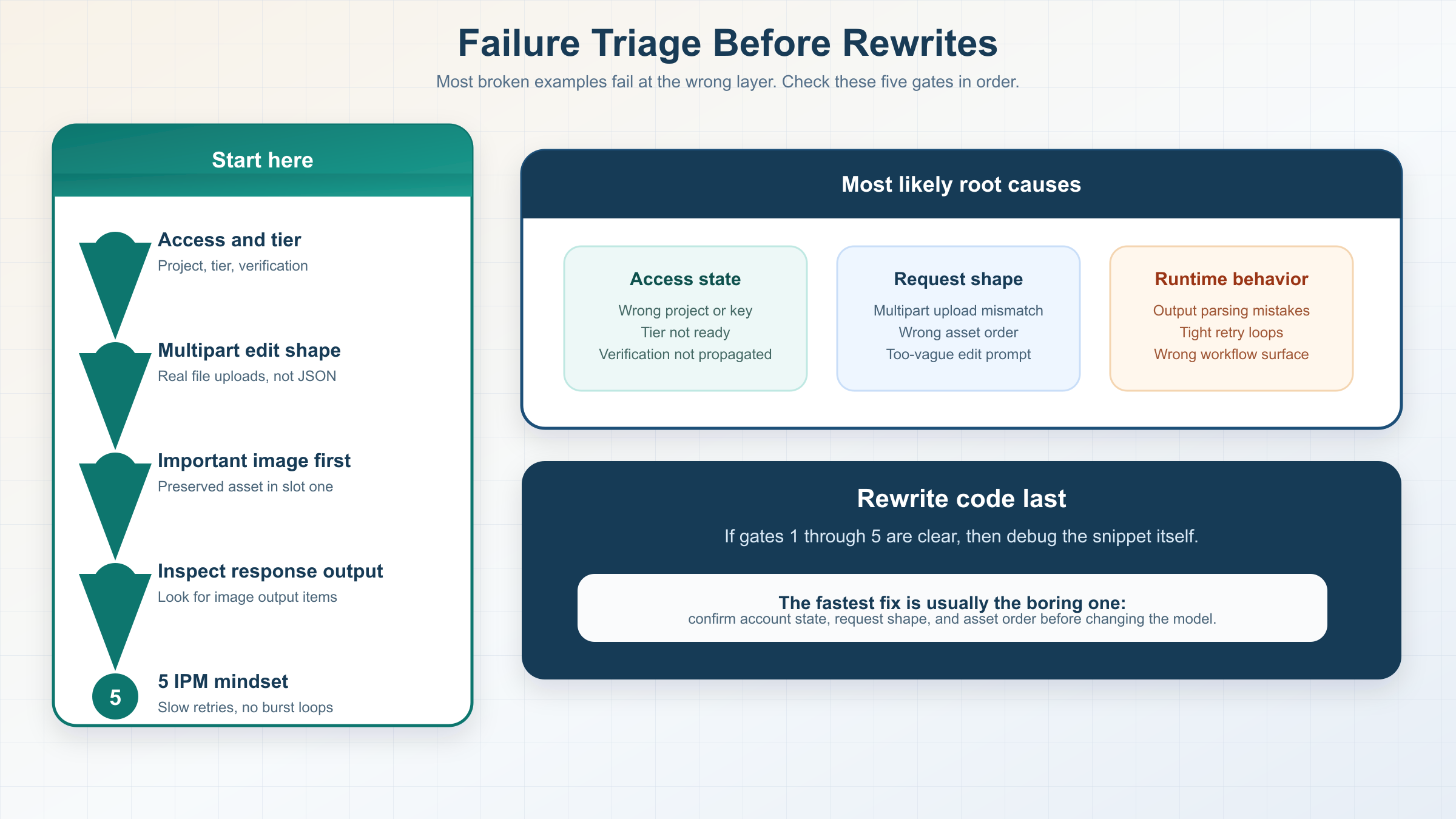

예제를 탓하기 전에 끝내야 할 setup checks

mini 는 cheap image lane 이지만 free lane 은 아닙니다. 2026년 3월 29일 기준 current mini model page 는 1024x1024 출력 가격을 $0.005 / $0.011 / $0.036 으로 보여 주고, 동시에 Free not supported, Tier 1 시작값을 100,000 TPM 과 5 IPM 으로 적고 있습니다.

실제로는 좋은 example 도 account state 때문에 실패할 수 있습니다. current model availability article 는 gpt-image-1 과 gpt-image-1-mini 가 API users 의 tiers 1 through 5 에서 이용 가능하다고 하면서도, 일부 access 는 organization verification 영향을 받을 수 있다고 설명합니다. 이어서 organization verification article 는 verification 반영이 up to 30 minutes 걸릴 수 있고, new API key 가 lingering error 를 없애는 데 도움 될 수 있다고 말합니다.

이럴 때의 debug order 는 간단합니다.

- API key 가 올바른 project 와 organization 에 속하는지 확인한다.

- current tier 가 mini image access 를 포함하는지 확인한다.

- access error 가 계속되면 organization verification 을 확인한다.

- verification 직후라면 30분 propagation window 를 기다린다.

- code 를 다시 쓰기 전에 새 API key 를 발급한다.

만약 blocker 가 example quality 가 아니라 access state 라면 OpenAI image generation API verification 을 먼저 보는 편이 빠릅니다.

흔한 gpt-image-1-mini example 실패를 먼저 어떻게 점검할까

copied example 이 실패할 때 root cause 는 생각보다 평범합니다. 잘못된 surface, 잘못된 request shape, 늦은 account-state 확인. 대부분 여기서 설명됩니다.

| 증상 | 가장 가능성이 큰 원인 | 가장 먼저 볼 것 |

|---|---|---|

| generation example 이 access / availability error 를 낸다 | project, tier, verification 이 준비되지 않았다 | org, tier, verification state 와 key 생성 시점 |

| edit example 은 돌지만 reference asset 을 무시한다 | 중요한 image 가 first 가 아니거나 prompt 가 너무 vague 하다 | preserve 할 image 를 first 로 두고 prompt 를 좁힌다 |

| SDK 를 벗어난 뒤 edit request 가 깨진다 | multipart file upload shape 가 틀렸다 | multipart form-data 와 real file parts 로 다시 확인한다 |

| Responses example 이 text 만 돌려주고 usable image 가 없다 | response parsing 이 틀렸거나 workflow 가 아직 너무 크다 | response.output 의 image_generation_call 을 확인한다 |

| rate limit 에 예상보다 빨리 걸린다 | image endpoint 를 text endpoint 와 같은 감각으로 재시도한다 | current IPM 을 확인하고 burst retry 를 멈춘다 |

특히 마지막 줄은 중요합니다. Tier 1 의 5 IPM 은 text-model testing 습관과는 전혀 다른 템포입니다. 같은 example 을 prompt 만 바꾸며 짧은 시간에 반복하면 random failure 처럼 보여도 실제 원인은 quota 일 수 있습니다.

Images API example 은 안정적인데 Responses 만 흔들린다면 대개 architecture complexity 를 너무 빨리 추가한 것입니다. generation example 은 되는데 edit 가 안 된다면 mini 자체보다 asset order, prompt scope, multipart shape 를 먼저 의심하는 편이 맞습니다.

mini 로 충분한 경우와 GPT Image 1.5 예제를 먼저 복사하는 편이 더 안전한 경우

많은 exact examples page 가 가장 애매하게 넘기는 부분이 여기입니다. 코드가 돌아가는 것 과 그 모델이 맞는 default 인 것 은 다릅니다.

OpenAI 의 current image guide 는 gpt-image-1.5 를 latest and most advanced GPT Image model 로 두고, best experience 를 원하면 GPT Image 1.5 를 쓰라고 권합니다. 같은 guide 는 gpt-image-1-mini 를 more cost-effective option 으로 소개하지만, image quality 가 priority 가 아닐 때의 이야기입니다.

따라서 더 정직한 rule 은 이렇습니다.

- cost 가 첫 번째 제약이면 mini examples 부터 복사한다.

- output quality, higher-value edits, retry cost 가 더 중요하면 GPT Image 1.5 예제를 먼저 복사한다.

mini 는 internal concepts, low-stakes variants, cheap prompt benchmark, volume-first batch generation 에 잘 맞습니다. 반대로 GPT Image 1.5 는 production output, edit failure 가 비싼 작업, retry 를 줄이는 것이 더 중요한 workflow 에 더 안전한 시작점입니다.

여기에 current API pricing page 의 Batch API 50% 할인 까지 고려하면, 모델 선택은 더더욱 workflow decision 이 됩니다. 가장 싼 model 이 가장 싼 workflow 가 되는 것은 아닙니다.

가격만 더 깊게 보고 싶으면 GPT Image 1 Mini pricing, qualitative judgment 이 더 필요하면 GPT Image 1 Mini review 가 다음으로 맞습니다.

wrapper example page 가 계속 퍼뜨리는 오해

첫 번째 오해는 wrong abstraction 을 먼저 복사하는 것 입니다. one prompt, one image 라면 Responses 부터 시작할 이유가 없습니다. current docs 는 여전히 Images API 로 돌아오라고 말합니다.

두 번째 오해는 Responses 의 model field 에 wrong model 을 넣는 것 입니다. hosted image_generation tool 을 쓸 때 top-level model 은 gpt-5 나 gpt-4.1 같은 mainline model 이어야 합니다.

세 번째 오해는 mini edit 의 first-image rule 을 잊는 것 입니다. 가장 중요한 얼굴, 상품, logo 는 first input 에 둬야 합니다.

네 번째 오해는 가장 싼 lane 을 best default 로 착각하는 것 입니다. OpenAI 가 mini 에 준 역할은 budget lane 이지 quality-first lane 이 아닙니다.

다섯 번째 오해는 account state 보다 code 를 먼저 의심하는 것 입니다. tier, verification, propagation window 가 맞지 않으면 example 이 멀쩡해도 failure 처럼 보입니다.

여섯 번째 오해는 gateway product 의 vocabulary 를 official API 에 그대로 가져오는 것 입니다. third-party abstraction 은 그 product 안에서는 유용하지만, OpenAI-native field 와 1:1 로 대응한다고 가정하면 위험합니다.

결론

gpt-image-1-mini examples 를 찾고 있다면 지금 가장 먼저 복사할 가치가 높은 것은 세 가지입니다. one-shot generation 은 Images API, direct edit 도 Images API, 그리고 multi-turn image workflow 가 실제 요구사항일 때만 Responses 입니다.

끝까지 남겨야 할 rule 은 하나입니다. mini 는 cheaper lane 이지 universal lane 이 아니다. examples 가 잘 동작하고 품질도 충분하면 mini 에 머물면 되고, retry 와 cleanup 비용이 늘기 시작하면 같은 route 를 GPT Image 1.5 로 다시 복사하는 편이 더 싼 판단이 됩니다.