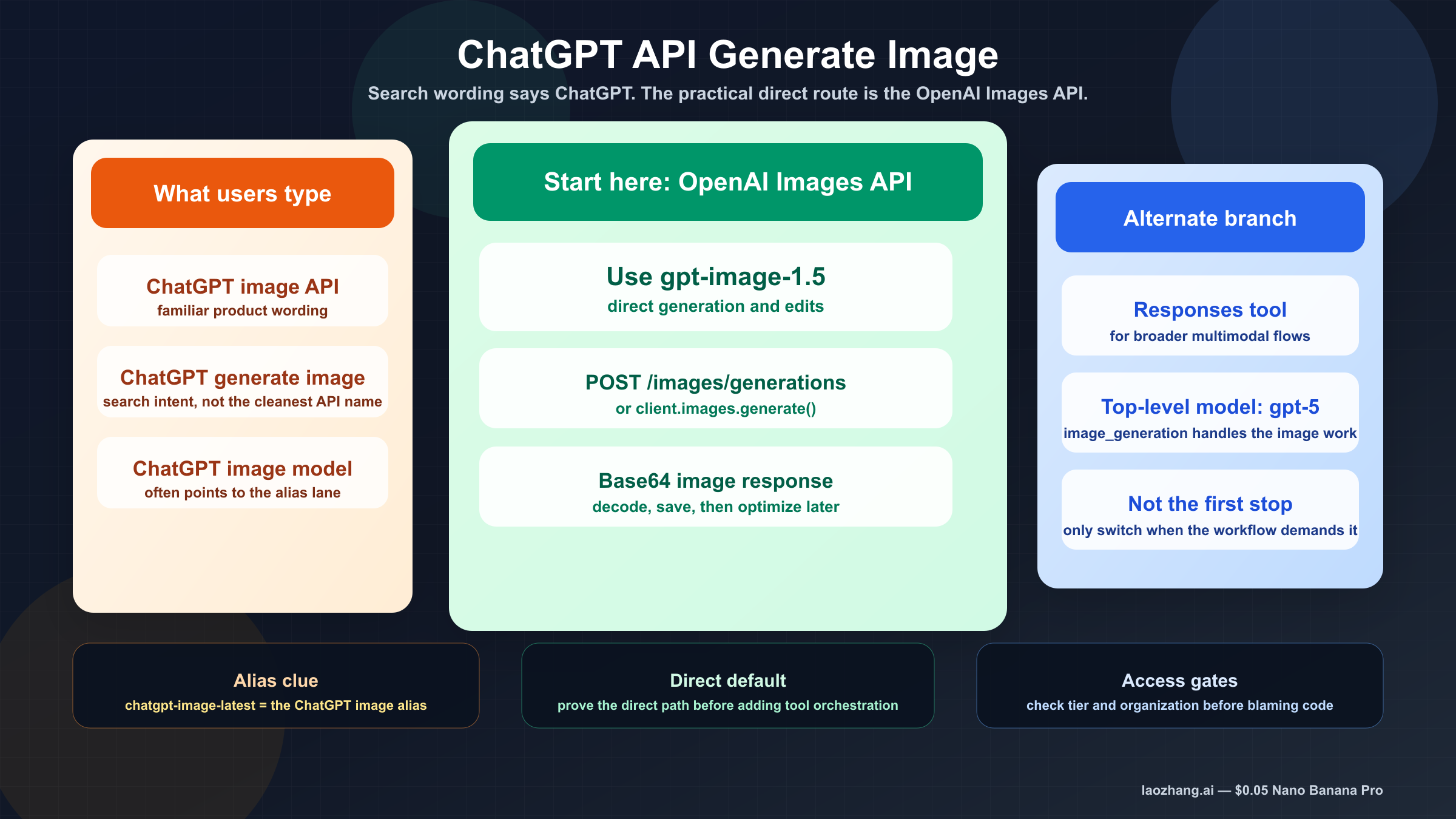

chatgpt api generate image 를 검색한 사람에게 2026년 3월 23일 기준으로 가장 실무적인 답을 한 줄로 말하면 이렇습니다. 먼저 써야 할 것은 OpenAI Images API와 gpt-image-1.5이지, 별도의 ChatGPT 전용 이미지 endpoint가 아닙니다. 단발성 이미지 생성이라면 client.images.generate() 또는 POST /v1/images/generations 에서 시작하는 편이 가장 안전합니다.

이 키워드가 필요 이상으로 복잡해 보이는 이유는 OpenAI가 답을 여러 surface에 나누어 두었기 때문입니다. image generation guide는 Images API의 직접 경로를 중심으로 설명하고 gpt-image-1.5를 현재 가장 안전한 default로 제시합니다. image_generation tool guide는 Responses 쪽 분기를 보여 줍니다. chatgpt-image-latest 모델 페이지는 그 이름이 ChatGPT에서 쓰는 이미지 snapshot을 가리키는 alias임을 설명합니다. 이 중 하나만 읽으면 전체 그림이 어긋나기 쉽습니다.

가장 안전한 순서는 단순합니다. 먼저 Images API의 직접 요청 하나를 성공시키고, 돌아온 base64 이미지를 저장하고, 내 계정이 정말 그 이미지 lane에 접근할 수 있는지 확인한 다음에야 alias, edit, Responses 분기를 더합니다. 이 순서만 지켜도 검색 결과가 아직 독자에게 떠넘기고 있는 우회 비용을 상당 부분 줄일 수 있습니다.

핵심 요약

- 먼저 배워야 할 별도의 "ChatGPT 이미지 API"가 따로 있는 것은 아닙니다.

- 단발성 이미지 생성이라면 OpenAI Images API와 **

gpt-image-1.5**부터 시작하는 것이 안전합니다. - Responses

image_generation은 이미지 생성이 더 큰 멀티모달 workflow의 한 부분일 때만 씁니다. chatgpt-image-latest는 ChatGPT에서 쓰는 snapshot을 가리키는 alias로 이해해야지, 별도 플랫폼의 증거로 보면 안 됩니다.- 예제가 실패하면 먼저 usage tier, organization verification, API key가 어느 organization을 보고 있는지를 확인해야 합니다.

찾고 있는 것이 ChatGPT 이미지 API인지 OpenAI Images API인지

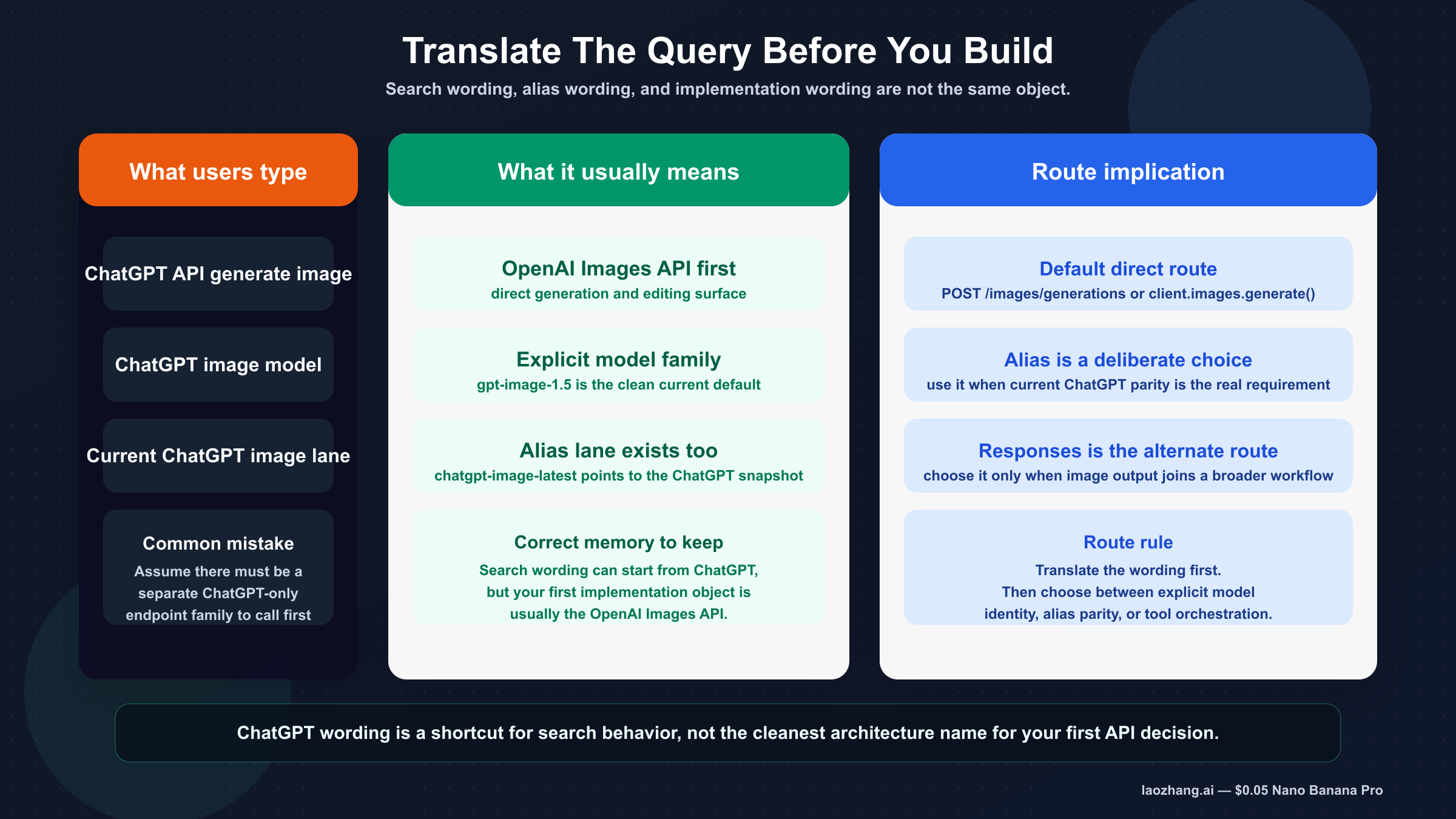

실무에서는 ChatGPT라는 표현으로 검색해도, 실제로 찾는 것은 대부분 OpenAI Images API입니다. 아직도 많은 페이지가 이 한 문장을 처음에 분명하게 말하지 않습니다.

chatgpt-image-latest 공식 페이지는 그 alias가 현재 ChatGPT에서 사용되는 image snapshot을 가리킨다고 분명히 적고 있습니다. 그래서 이런 검색어가 생깁니다. 독자는 ChatGPT라는 제품을 알고 있으니 같은 이름으로 API를 찾습니다. 하지만 실제 구현 surface는 여전히 OpenAI API의 surface입니다. v1/images/generations, v1/images/edits, 그리고 이미지 생성이 더 큰 흐름의 일부가 되었을 때의 Responses API가 본체입니다.

이 차이는 단순한 이름 문제만이 아닙니다. 무엇을 첫 abstraction으로 잡을지, 무엇을 먼저 디버그할지, 팀 문서에 무엇을 남길지를 바꿉니다. "ChatGPT image API가 필요하다"라고 생각하면 아직도 gpt-4o, proxy 경로, 우회 접근을 가르치는 약한 글로 쉽게 흘러갑니다. "ChatGPT라는 검색어가 실제로 어떤 OpenAI surface를 뜻하는가"를 먼저 생각하면 문서가 훨씬 정리됩니다.

이 키워드가 아직도 이길 수 있는 이유도 같습니다. 공식 페이지에는 사실이 있지만, 독자가 실제로 겪는 문제 순서대로 정리돼 있지 않습니다. 어떤 페이지는 model facts를 주고, 어떤 페이지는 tool syntax를 보여 주고, 어떤 페이지는 endpoint를 확인해 주고, Help Center는 verification을 다룹니다. 독자가 진짜 알고 싶은 것은 "image generation이 무엇인가"가 아니라 "무엇을 먼저 호출해야 처음부터 틀린 abstraction을 고르지 않을 수 있는가"입니다.

그 질문에 대한 실무 규칙은 짧으면 충분합니다.

- 먼저 Images API.

- default model은

gpt-image-1.5. chatgpt-image-latest는 alias 선택이지 첫 설계 선택이 아니다.

더 넓은 surface map을 먼저 정리하고 싶다면 한국어 OpenAI Image API tutorial을 보는 편이 자연스럽습니다. 이 페이지는 의도적으로 더 좁습니다. ChatGPT라는 검색어를 올바른 첫 구현 판단으로 번역하는 것이 목적이기 때문입니다.

지금 가장 빨리 통하는 API 이미지 생성 경로

단순한 "prompt를 주고 이미지 하나를 받는다"는 작업이라면 지금도 가장 짧은 길은 직접적인 Images API입니다. Images 공식 reference는 POST /images/generations 를 그대로 보여 주고, image generation guide는 gpt-image-1.5 를 가장 좋은 현재 default로 권합니다.

첫 요청은 의도적으로 단순해야 합니다.

- prompt 하나

- 정사각형 이미지 한 장

- 불필요한 orchestration 없음

- base64 decode

- 파일 저장

이렇게 해야 HTTP 호출뿐 아니라 실제 통합 경로 전체를 확인할 수 있습니다.

JavaScript:

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const result = await client.images.generate({ model: "gpt-image-1.5", prompt: "Create a clean editorial illustration of a robot camera operator in a bright studio", size: "1024x1024", quality: "medium", }); const imageBase64 = result.data[0].b64_json; const imageBuffer = Buffer.from(imageBase64, "base64"); fs.writeFileSync("chatgpt-api-generate-image.png", imageBuffer);

Python:

pythonfrom openai import OpenAI import base64 client = OpenAI() result = client.images.generate( model="gpt-image-1.5", prompt="Create a clean editorial illustration of a robot camera operator in a bright studio", size="1024x1024", quality="medium", ) image_base64 = result.data[0].b64_json image_bytes = base64.b64decode(image_base64) with open("chatgpt-api-generate-image.png", "wb") as f: f.write(image_bytes)

cURL:

bashcurl https://api.openai.com/v1/images/generations \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "gpt-image-1.5", "prompt": "Create a clean editorial illustration of a robot camera operator in a bright studio", "size": "1024x1024", "quality": "medium" }' \ | jq -r '.data[0].b64_json' \ | base64 --decode > chatgpt-api-generate-image.png

이 경로가 좋은 이유는 세 가지입니다. 첫째, 현재 공식 권장 model을 그대로 쓴다는 점입니다. 둘째, 경로가 충분히 직통이라 실패 원인을 나누기 쉽습니다. 셋째, 많은 약한 글이 건너뛰는 output contract를 처음부터 보여 준다는 점입니다. Image API는 base64 이미지 데이터를 기본으로 반환하고, PNG가 기본 format이며, JPEG/WebP와 output_compression은 그 다음 단계의 조정 옵션입니다.

좀 더 넓은 example 모음이 필요하다면 한국어 OpenAI image generation API example 이 자연스러운 다음 읽을거리입니다. 이 keyword에서는 처음 route를 맞추는 것이 더 중요합니다.

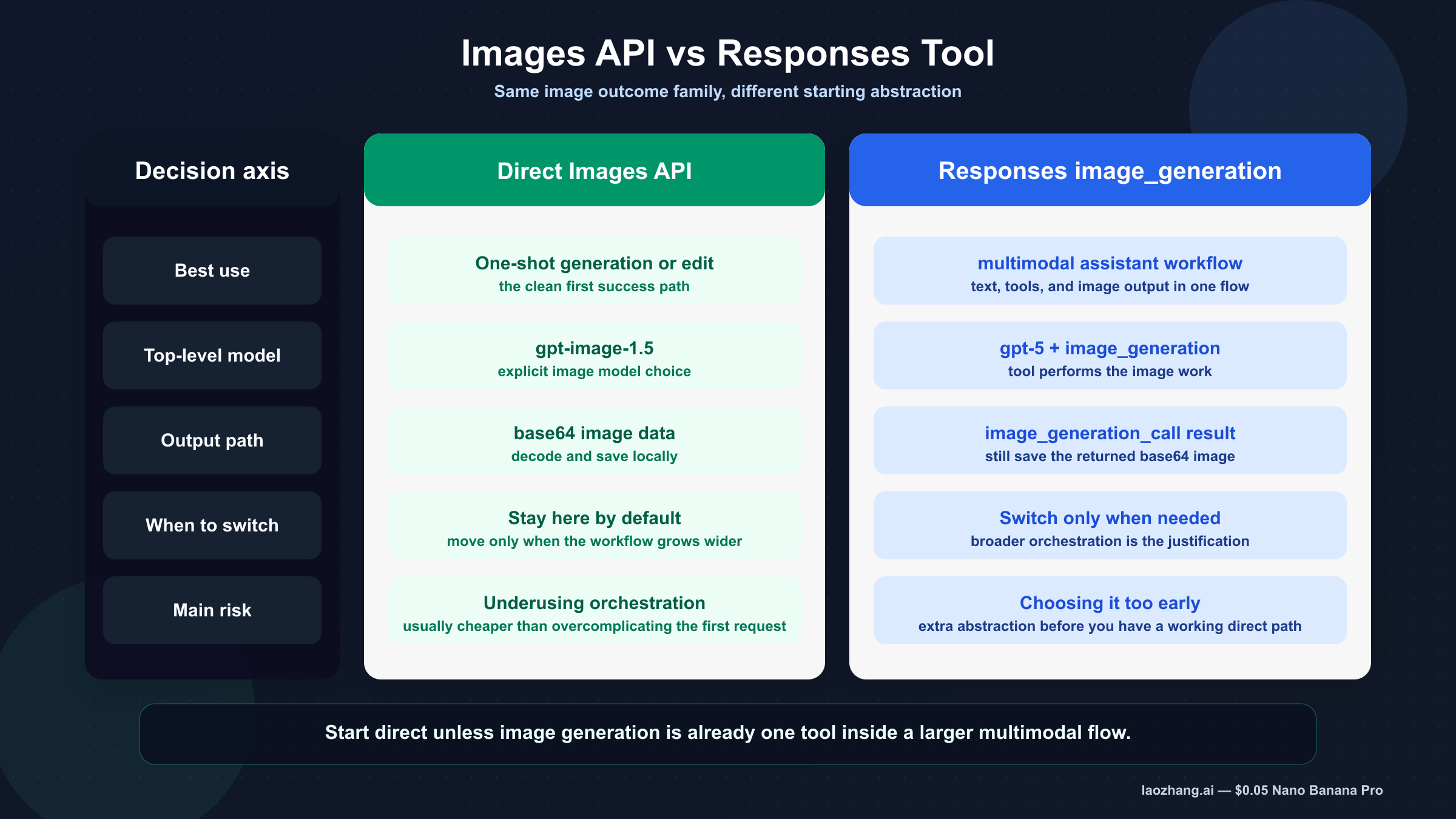

Images API와 Responses image_generation을 어떻게 나눠 써야 하는가

Images API가 맞는 경우는 이미지 생성 자체가 feature의 중심일 때입니다. Responses tool이 맞는 경우는 이미지가 더 넓은 reasoning 또는 multimodal workflow 안에서 하나의 출력일 때입니다.

| 상황 | 먼저 고를 것 | 이유 |

|---|---|---|

| prompt 하나로 이미지 하나를 받고 싶다 | Images API | 층이 적고 첫 성공까지 가장 짧다 |

| backend endpoint로 생성이나 edit를 하고 싶다 | Images API | request contract가 단순하고 디버깅이 쉽다 |

| 한 장 또는 여러 장의 이미지를 직접 edit하고 싶다 | Images API | edit의 본선이 여기 모여 있다 |

| assistant가 때때로 이미지도 반환한다 | Responses image_generation | 이미지가 더 큰 흐름의 tool로 자연스럽다 |

| 텍스트, tools, 이미지를 한 interaction에 넣고 싶다 | Responses image_generation | orchestration을 한 surface에 둘 수 있다 |

tool guide가 중요한 이유는 현재 responses.create() 예제가 model: "gpt-5" 를 쓰고 tools: [{ type: "image_generation" }] 를 붙이기 때문입니다. 이미지 자체는 tool 쪽에서 GPT Image family가 처리합니다. 그래서 gpt-image-1.5를 Responses의 top-level model field에 넣으려는 시도는 보통 문서를 잘못 읽은 결과입니다.

정말 tool 경로가 필요하다면 최소 형태는 아래와 같습니다.

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const response = await client.responses.create({ model: "gpt-5", input: "Generate a transparent sticker-style icon of a paper airplane", tools: [{ type: "image_generation", background: "transparent" }], }); const imageBase64 = response.output .filter((item) => item.type === "image_generation_call") .map((item) => item.result)[0]; fs.writeFileSync("paper-airplane.png", Buffer.from(imageBase64, "base64"));

이 예제가 여기서 중요한 이유는 branch의 차이를 구체적으로 보여 주기 때문입니다. 직접 경로는 image model을 명시합니다. Responses 경로는 mainline model을 위에 두고 이미지 생성을 tool에 맡깁니다. 두 형태를 나란히 보면 어디서 abstraction이 달라지는지가 훨씬 잘 보입니다.

팀 안에 남겨 둘 실무 규칙은 단순합니다. 이미지 생성이 정말 더 큰 multimodal workflow의 일부가 될 때만 Responses로 가고, 그렇지 않으면 처음에는 직접 경로로 시작하라.

지금 정말 중요한 모델 이름

모델 이름이 중요한 이유는 SERP가 아직도 오래된 릴리스 이름과 시기상 뒤처진 설명을 끌고 들어오기 때문입니다.

| 모델 또는 라벨 | 지금 의미 | 쓰는 곳 |

|---|---|---|

gpt-image-1.5 | GPT Image family의 현재 주력 | 직접 생성과 edit의 대부분 |

gpt-image-1.5-2025-12-16 | 모델 페이지에 보이는 dated snapshot | 재현성 높은 eval과 rollout |

chatgpt-image-latest | ChatGPT에서 쓰는 image snapshot을 가리키는 alias | 현재 ChatGPT parity가 목표일 때만 |

gpt-image-1 | 이전 GPT Image lane | migration 또는 compatibility |

| DALL-E 2 / DALL-E 3 | deprecated | 이 query의 fresh default에는 부적절 |

image generation guide는 gpt-image-1.5 를 GPT Image family의 최신이자 가장 좋은 default로 설명하고, DALL-E 2 와 DALL-E 3 는 deprecated이며 05/12/2026 에 support가 끝난다고 적고 있습니다. 따라서 gpt-4o나 DALL-E 중심의 글을 fresh default로 삼을 이유는 없습니다.

gpt-image-1.5 모델 페이지에는 실무적으로 유용한 사실이 두 가지 더 있습니다.

- Free not supported

- Tier 1은 100,000 TPM과 5 IPM부터

그리고 gpt-image-1.5-2025-12-16 snapshot도 보입니다. reproducibility나 staged rollout이 중요하다면 alias보다 훨씬 다루기 쉽습니다. alias와 explicit model ID의 차이를 더 보고 싶다면 한국어 chatgpt-image-latest vs gpt-image-1.5 가 자연스러운 다음 읽을거리입니다.

이 query에서 pricing이 주연은 아니지만, current ladder는 알고 있을 가치가 있습니다. chatgpt-image-latest 페이지에는 1024x1024 low가 $0.009, medium이 $0.034, high가 $0.133 으로 나옵니다. 여기서 중요한 결론은 하나입니다. 아직도 이 층을 "GPT-4o image generation" 정도로 설명하는 오래된 글을 기본으로 삼지 말아야 한다는 점입니다. 다음 질문이 budget이라면 OpenAI image generation API pricing 으로 가는 편이 맞습니다.

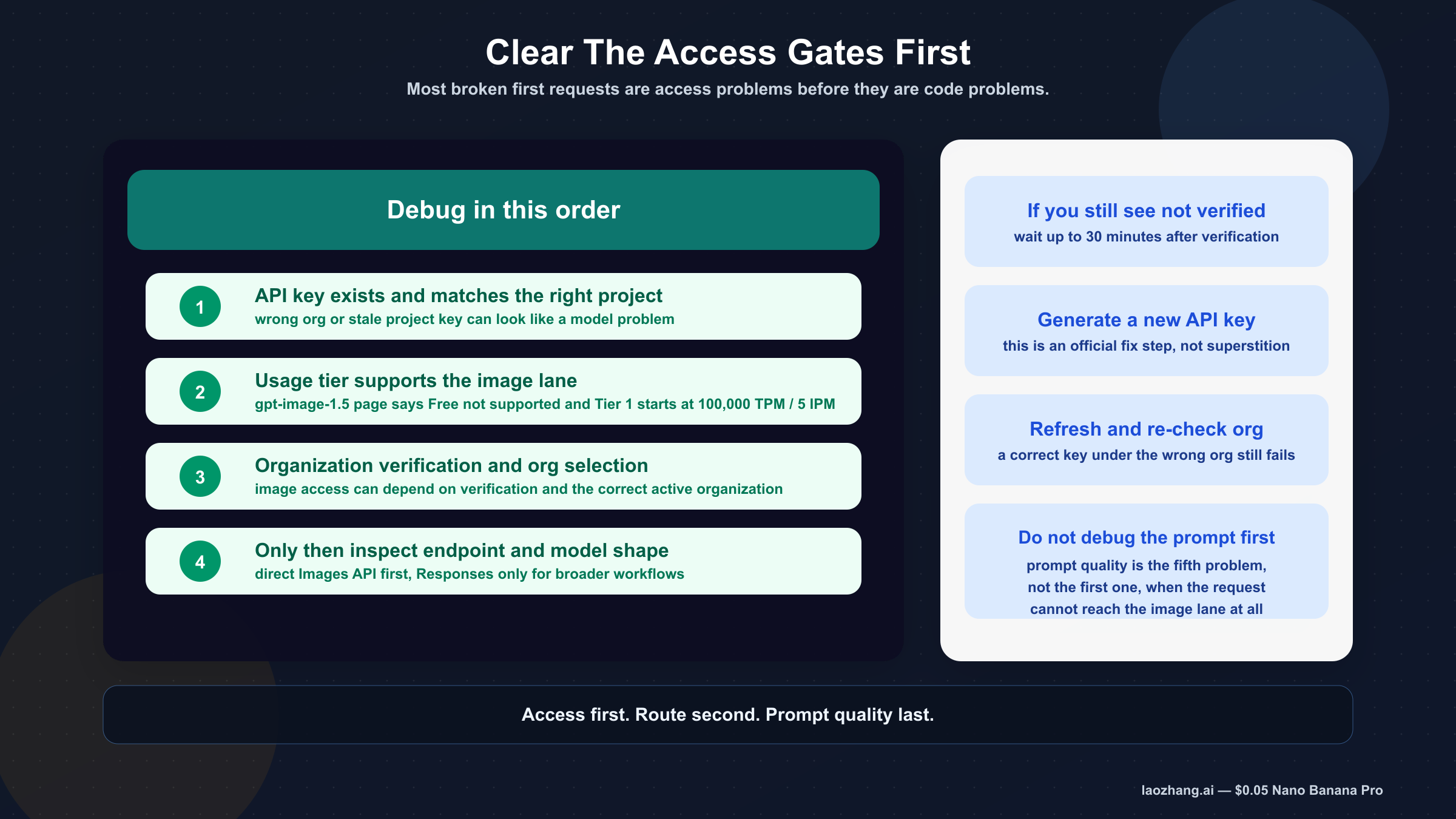

문제 해결: 예제를 의심하기 전에 접근 게이트부터 확인하기

첫 시도의 실패는 snippet 자체보다 account state, active organization, 또는 오래된 mental model 때문인 경우가 많습니다.

첫 번째 확인은 usage tier입니다. API Model Availability by Usage Tier and Verification Status는 GPT-image-1 과 GPT-image-1-mini 가 tiers 1 through 5 의 API 사용자에게 열려 있고 일부 access는 organization verification 에 영향을 받는다고 말합니다. gpt-image-1.5 페이지는 별도로 Free not supported 라고 말합니다. 즉, 이것을 ChatGPT 무료 기능의 연장선으로 생각하는 순간 이미 API access를 보는 틀이 어긋나기 쉽습니다.

두 번째 확인은 organization verification입니다. API Organization Verification는 verification이 image generation capabilities를 열어 줄 수 있다고 설명합니다. 동시에 "not verified"가 남아 있을 때의 구체적인 단계도 제시합니다.

- 30분 정도 기다리기

- 새 API key 만들기

- refresh 또는 재로그인

- 올바른 organization 을 보고 있는지 확인

이 순서를 글 안에 직접 적어 두는 이유는, 많은 개발자가 반대로 움직이기 때문입니다. SDK를 다시 깔고, prompt를 바꾸고, 예제를 통째로 다시 쓰기 전에, 그 account가 정말 image lane에 접근할 수 있는지를 먼저 확인해야 합니다.

세 번째 확인은 route choice입니다. 단발 이미지가 필요한데 Responses 예제를 가져오면 불필요한 tool orchestration을 디버그하게 됩니다. 오래된 글에서 gpt-4o나 hosted image URL 전제를 가져오면 더 오래 헤맵니다.

깨끗한 진단 순서는 아래와 같습니다.

- access와 organization

- current model name

- endpoint와 request shape

- output decode

- prompt quality

주된 막힘이 여전히 access라면 한국어 OpenAI image generation API verification 으로 가는 편이 빠릅니다. 그 글은 verification branch를 더 깊게 다룹니다.

피해야 할 약한 튜토리얼 패턴

첫 번째 약한 패턴은 proxy-first tutorial 입니다. 문제 전체를 "이 proxy를 써서 ChatGPT image API를 열어라"라고 설명하는 페이지는 그 자체로 현재 official route에서 독자를 멀리 보냅니다. 보기에는 그럴듯해도 오래된 default model, 틀린 model name, 혹은 그 서비스 안에서만 의미가 있는 route를 가르치는 경우가 많습니다.

두 번째는 gpt-4o를 current default처럼 다루는 글 입니다. 이름이 아직 충분히 최신처럼 들리기 때문에 ranking되기 쉽지만, 지금의 OpenAI docs는 gpt-image-1.5를 권합니다. 2026년의 fresh article이 이 query를 gpt-4o 중심으로 답하는 것은 더 이상 올바른 출발점이 아닙니다.

세 번째는 Responses에 대한 mental model을 설명하지 않는 글 입니다. Responses가 이미지를 다룰 수 있다는 말 자체는 맞지만, top-level model은 mainline model이고 image work는 image_generation tool 쪽에서 일어난다는 점을 설명하지 않으면 독자는 field-level 오해를 하게 됩니다.

네 번째는 ChatGPT 요금제 동작과 API access를 같은 gate로 취급하는 것 입니다. ChatGPT라는 제품 경험이 query의 출발점이 되는 것은 자연스럽지만, usage tier, organization verification, explicit model availability는 별개의 operational question입니다.

좋은 습관은 tutorial을 열 때마다 아래 네 가지를 확인하는 것입니다.

- GPT Image family의 current naming을 쓰는가

- Images API와 Responses tool을 분리해서 설명하는가

- request뿐 아니라 output 저장까지 설명하는가

- SDK를 탓하기 전에 tier와 verification을 언급하는가

대부분이 아니오라면, 그 페이지는 rank는 하더라도 implementation guide로서는 약할 가능성이 큽니다.

최종 권장 경로

API로 이미지를 하나 생성하고 싶은 것이 목적이라면, 현재 가장 안전한 답은 OpenAI Images API와 gpt-image-1.5를 쓰는 것 입니다. 많은 사람이 chatgpt api generate image 라는 검색어로 실제로 찾고 있는 것도 이것입니다. 아직 OpenAI surface 이름을 정확히 몰라도, 실무의 첫入口는 거기입니다.

chatgpt-image-latest는 현재 ChatGPT alias를 따라가는 것이 목표일 때만 쓰고, Responses image_generation은 이미지가 더 큰 multimodal workflow의 일부가 되었을 때만 씁니다. 둘 다 첫 추측이 아니라 의식적인 선택이어야 합니다.

가장 시간을 덜 낭비하는 순서는 이렇습니다.

- Images API 직통 예제를 하나 돌린다

- account에 access가 있는지 확인한다

- base64 이미지를 제대로 저장한다

- 그 다음에 alias, edit, Responses를 추가한다

화려한 "complete guide"처럼 보이지는 않지만, 바로 그 순서가 지금의 SERP에 아직 가장 부족한 부분입니다.