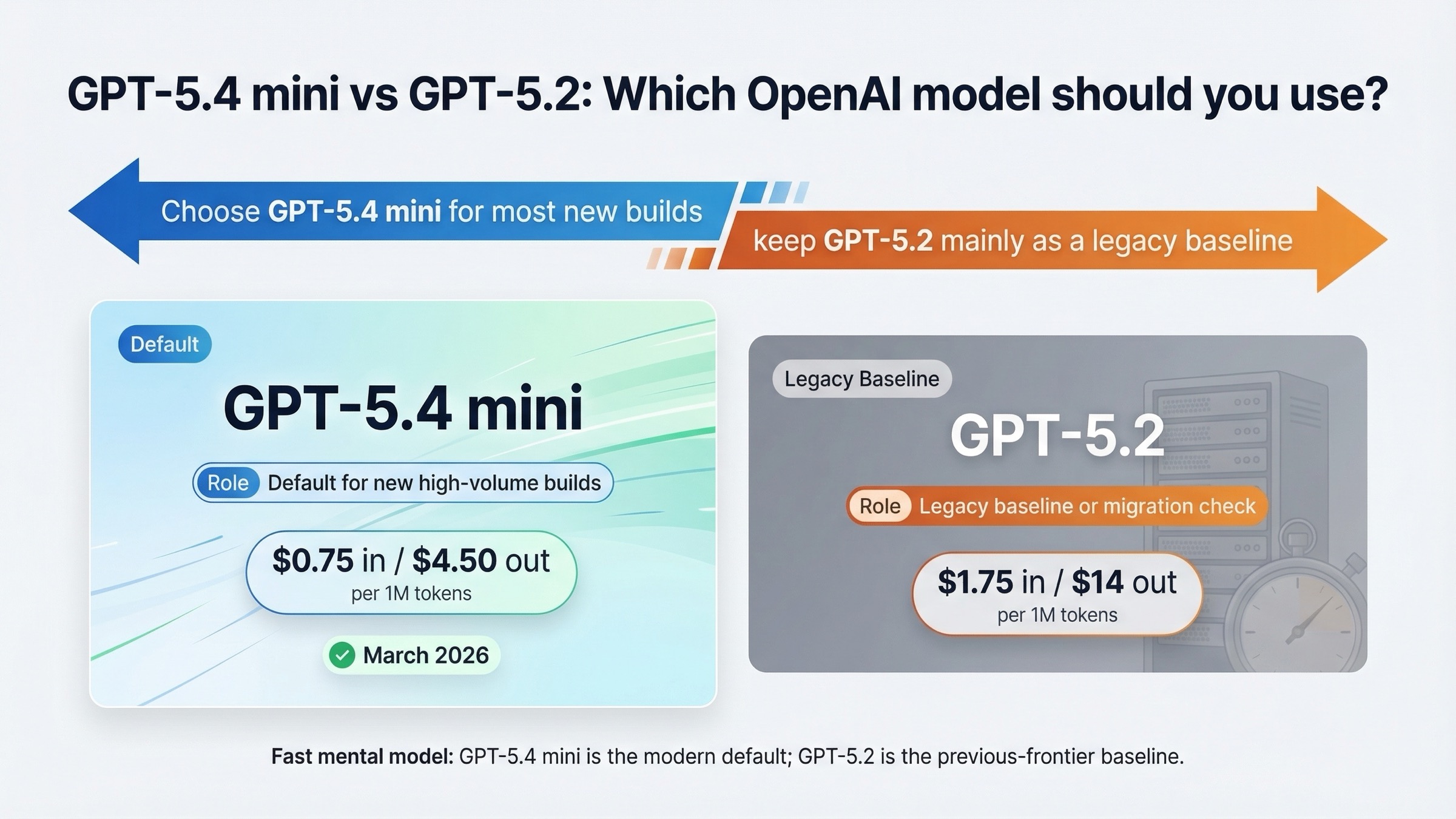

A fecha de 22 de marzo de 2026, la mayoria de los proyectos nuevos en OpenAI API deberian elegir GPT-5.4 mini, no GPT-5.2. GPT-5.2 ahora importa sobre todo como baseline legacy o checkpoint de migracion, no como punto de partida por defecto para trabajo nuevo. Si la decision es para un despliegue nuevo, la pregunta util no es quien gana en abstracto, sino cual funciona hoy como default y cual conviene conservar solo como baseline de migracion. Por eso esta comparativa sirve mas para decidir roles de uso y reemplazo que para vender una supuesta victoria absoluta. Ese matiz es el punto clave.

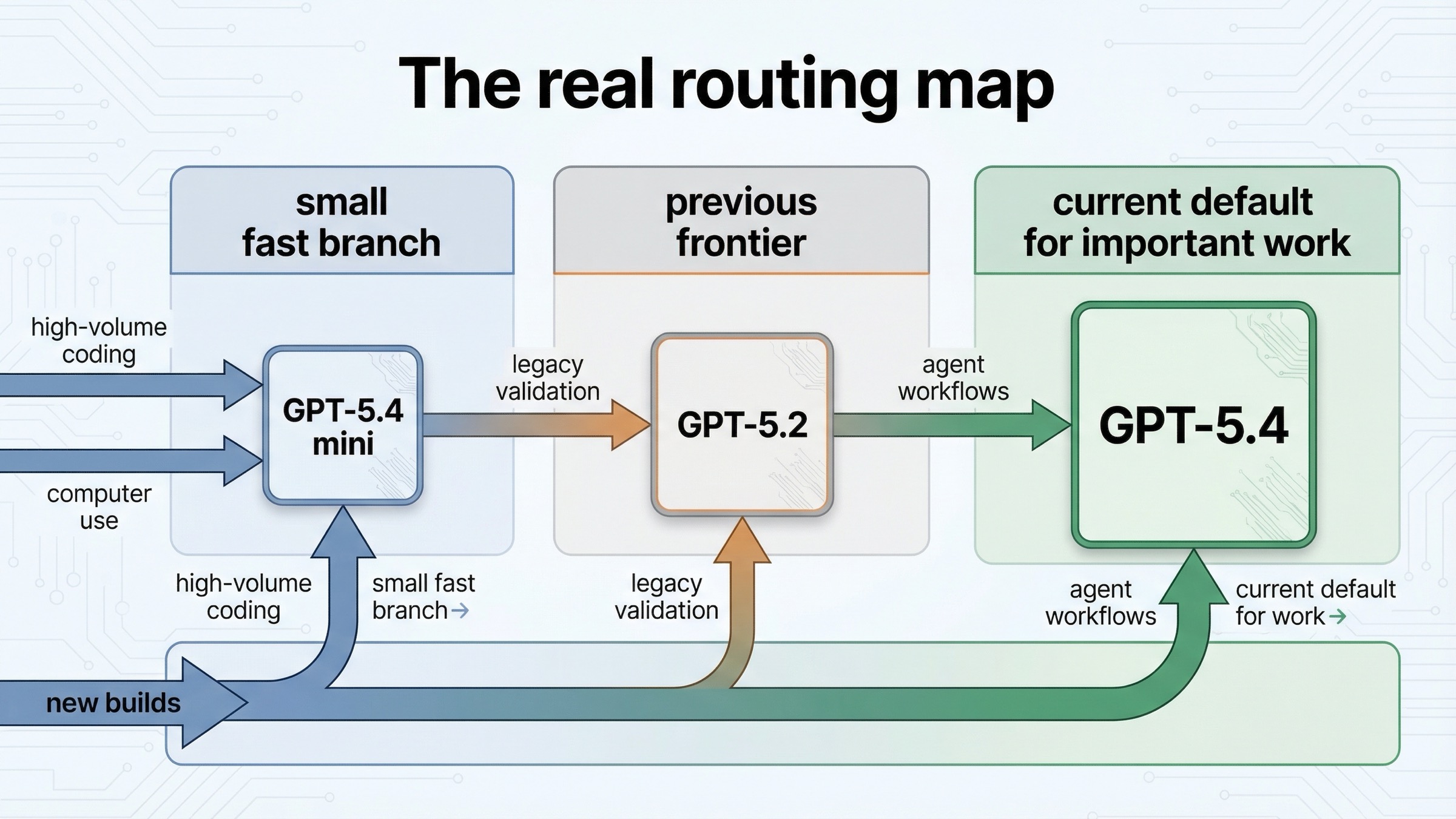

La ruta correcta depende de que estes reemplazando. La latest model guide de OpenAI dice que GPT-5.4 reemplaza a GPT-5.2 en la API, mientras la pagina oficial de GPT-5.4 mini lo presenta como la lane pequena y rapida para coding, computer use y agent workflows de alto volumen. Si lo que de verdad necesitas es el sucesor frontier mas profundo de GPT-5.2, la respuesta cercana es GPT-5.4, no mini.

Resumen rápido

- Elige GPT-5.4 mini para la mayoría de proyectos nuevos.

- Mantén GPT-5.2 solo como baseline temporal para migración o validación.

- Mira GPT-5.4 si lo que de verdad buscas es el sucesor moderno de la antigua línea frontier.

Comparación rápida: GPT-5.4 mini frente a GPT-5.2

| Factor | GPT-5.4 mini | GPT-5.2 | Qué implica en la práctica |

|---|---|---|---|

| Rol actual | Rama pequeña y rápida para coding, tools y agents | Modelo frontier anterior | Ya no compiten en la misma línea de producto |

| Mejor encaje | Nuevos coding assistants, subagentes, workflows con herramientas y alto volumen | Baselines heredados, pruebas de migración, validación de prompts antiguos | En trabajo nuevo, GPT-5.4 mini suele ser el punto de partida correcto |

| Precio de input | $0.75 / 1M tokens | $1.75 / 1M tokens | GPT-5.4 mini es mucho más barato |

| Cached input | $0.075 / 1M tokens | $0.175 / 1M tokens | La diferencia también pesa en flujos repetitivos |

| Precio de output | $4.50 / 1M tokens | $14.00 / 1M tokens | GPT-5.2 sale mucho más caro |

| Context window | 400K | 400K | GPT-5.2 no gana por contexto |

| Knowledge cutoff | 2025-08-31 | 2025-08-31 | Tampoco gana por frescura |

| Límite público Tier 5 | 30,000 RPM / 180M TPM | 15,000 RPM / 40M TPM | GPT-5.4 mini encaja mejor en producción de alto volumen |

La lectura correcta de la tabla no es “uno es nuevo y otro viejo”, sino esta: GPT-5.4 mini encaja como default moderno y económico, mientras que GPT-5.2 encaja cada vez más como baseline heredado.

Dicho de otro modo, la tabla sirve menos para decidir "qué modelo suena más potente" y más para decidir qué ruta quieres convertir en default en 2026. Cuando el contexto, el max output y el cutoff son iguales, el peso real cae en precio, throughput y dirección de producto. Y en esos tres puntos GPT-5.4 mini tiene una ventaja bastante clara.

Esto es una decisión de routing, no un duelo puro de benchmarks

Si solo miras los nombres, parece una comparación simple entre una mini nueva y un modelo más antiguo. Pero así no organiza OpenAI su línea actual.

La lectura oficial hoy es:

gpt-5.4= default para trabajo importantegpt-5.4-mini= rama pequeña y rápidagpt-5.2= frontier anterior

Por eso GPT-5.4 mini no es el sustituto directo de GPT-5.2. El sucesor de esa función es GPT-5.4.

Este matiz cambia completamente la utilidad del artículo. La mayoría de páginas del SERP comparan filas y métricas, pero no responden la pregunta verdadera: ¿necesitas una rama small fast, necesitas conservar un baseline antiguo o deberías pasar directamente al default frontier actual?

Hasta que no distingues esas tres necesidades, la comparación parece más limpia de lo que realmente es.

Además, el nombre mini puede engañar. Suena a versión reducida o a opción claramente inferior, pero en esta comparación esa intuición no ayuda demasiado. Lo que muestran las páginas actuales es otra cosa: GPT-5.4 mini es la rama pequeña, rápida y alineada con los flujos modernos de alto volumen; GPT-5.2 es la baseline frontier anterior que hoy se conserva más por continuidad que por conveniencia como nuevo punto de partida.

Ese detalle cambia mucho la lectura del keyword. Si piensas en un equipo que está lanzando un asistente de programación, una herramienta interna o una cadena de subagentes, lo que necesita no es solo "un modelo fuerte", sino un modelo que pueda vivir dentro de llamadas repetidas sin disparar el coste total. En ese contexto, GPT-5.4 mini deja de parecer una variante secundaria y pasa a verse como la ruta operativamente más razonable.

También ayuda a interpretar mejor por qué tantas comparativas del SERP se quedan cortas. Muchas responden como si el lector estuviera eligiendo entre dos modelos de la misma familia y del mismo rol, cuando en realidad está decidiendo si conviene permanecer en una baseline antigua o cambiar a una rama moderna pensada para volumen alto. Esa diferencia de enfoque es la que convierte una simple tabla en una recomendación útil de arquitectura.

En otras palabras, la pregunta real casi nunca es "cuál gana en abstracto", sino "qué combinación de precio, throughput y rol de producto encaja mejor con mi sistema". Esa formulación es bastante más útil para un equipo técnico que una lista de impresiones genéricas sobre inteligencia.

Eso, en el fondo, es lo que esta comparación debería resolver.

Y hacerlo con un criterio accionable.

Qué especificaciones importan de verdad

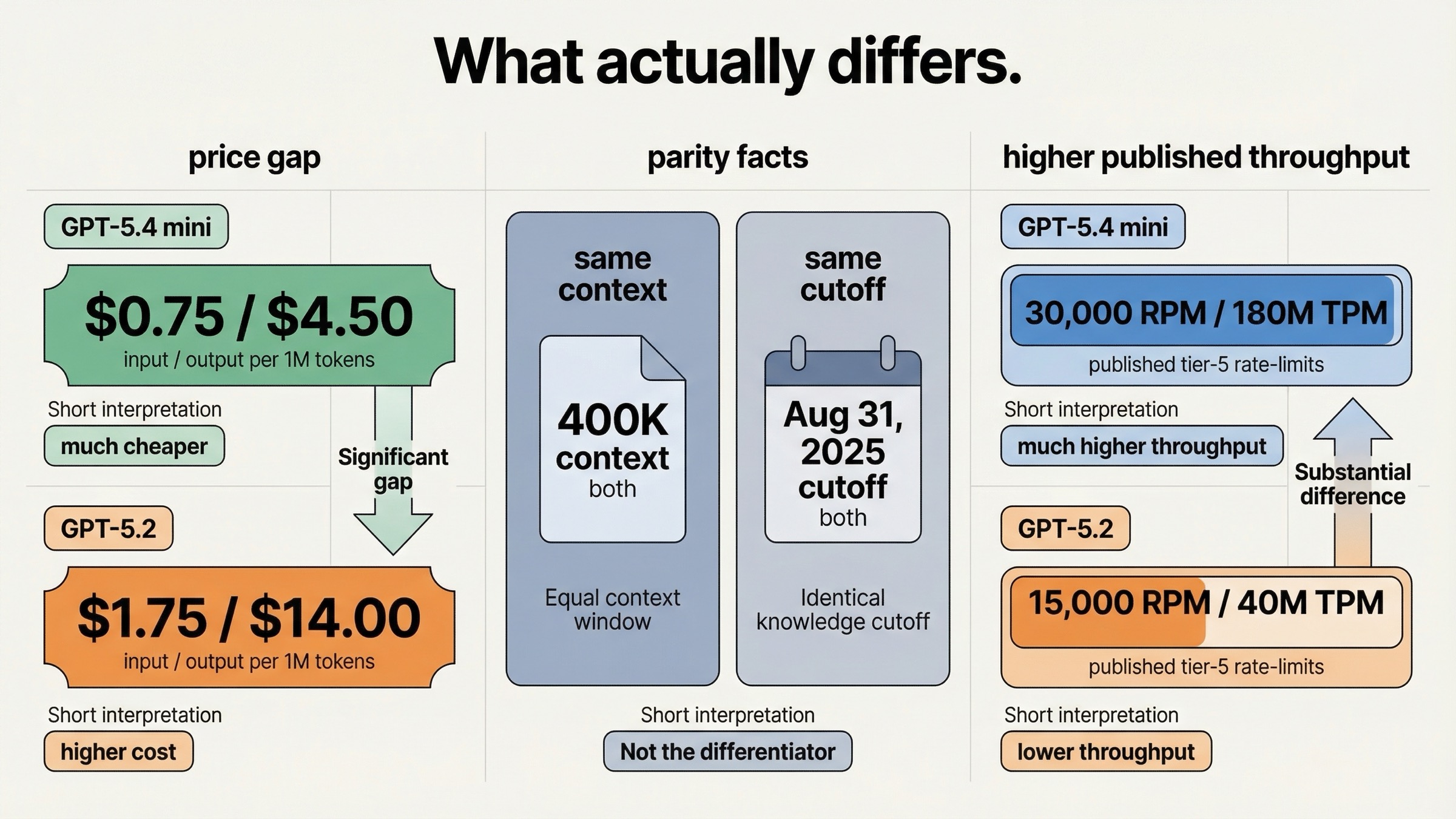

En términos prácticos, la diferencia se concentra en cuatro puntos.

El primero es el precio. GPT-5.4 mini cuesta $0.75 input / $4.50 output, mientras que GPT-5.2 cuesta $1.75 input / $14 output. En agent loops, coding workflows y rutas de alto volumen, eso ya no es un detalle menor.

El segundo es el throughput público. GPT-5.4 mini publica 30,000 RPM / 180M TPM en Tier 5, frente a 15,000 RPM / 40M TPM de GPT-5.2. Eso la hace más natural como ruta de producción cuando el sistema llama muchas veces al modelo.

El tercero es lo que no cambia. Hoy ambos modelos listan 400K context, 128K max output y cutoff 2025-08-31. Es decir, quedarse en GPT-5.2 no te compra más contexto ni un conocimiento más reciente.

El cuarto es la dirección del producto. GPT-5.4 mini aparece explícitamente como strongest mini model para coding, computer use y subagents. GPT-5.2 aparece como frontier anterior. Ese cambio de posicionamiento pesa mucho más que una comparación superficial de nombres.

Ese matiz importa todavía más cuando piensas en sistemas reales con muchas llamadas: agentes que planifican, subagentes, herramientas encadenadas, pasos de validación y reintentos. En esos entornos no basta con mirar la calidad de una respuesta aislada. También importa cuánto cuesta repetir el ciclo y si el throughput publicado acompaña el volumen que realmente vas a tener. Ahí GPT-5.4 mini suele encajar mejor.

Si lo que quieres es una comparación mini-vs-mini, tiene más sentido leer GPT-5.4 mini vs GPT-5 mini. Si tu duda real es frontier anterior vs frontier actual, entonces GPT-5.4 vs GPT-5.2 es la comparación más directa.

Cuándo conviene elegir GPT-5.4 mini

GPT-5.4 mini tiene más sentido cuando necesitas un modelo que sea barato de llamar muchas veces, rápido para entrar en bucles, y alineado con la línea actual de producto.

Los casos más claros son:

- coding assistants

- subagentes

- workflows con computer use o interacción con interfaces

- sistemas con herramientas encadenadas

- productos de alto volumen donde importan coste y límites públicos

Aquí importa mucho que GPT-5.4 mini no sacrifica contexto ni cutoff frente a GPT-5.2. En esta comparación, mini significa sobre todo otra rama de producto y de coste, no una reducción radical del techo útil.

Por eso es una opción especialmente razonable para equipos que están construyendo asistentes de programación, herramientas internas, rutas con computer use o flujos de orquestación donde el modelo se llama muchas veces por tarea. En ese tipo de producto, una diferencia fuerte en input, output y TPM cambia la arquitectura de costes desde el primer día.

Cuándo GPT-5.2 todavía tiene sentido

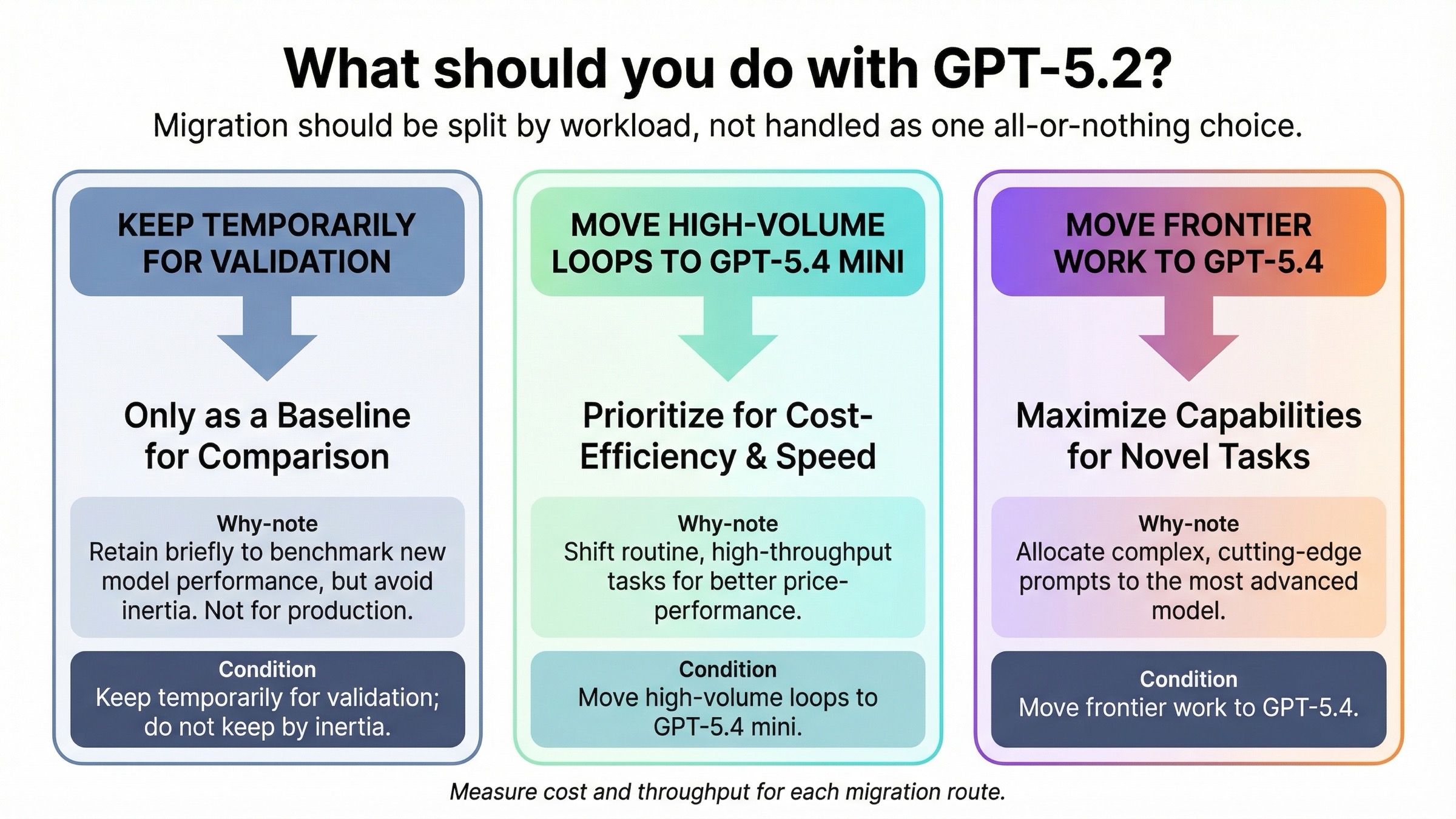

GPT-5.2 sigue teniendo sentido, pero más como baseline controlado que como nuevo default.

Merece la pena mantenerlo cuando:

- necesitas comparar la salida de un flujo antiguo con la de un flujo nuevo

- tienes prompts muy afinados y quieres migrar por etapas

- no puedes romper una cadena ya estable sin medir antes el impacto

- en tu equipo todavía se mezclan las superficies de ChatGPT con el routing del API

En esos casos GPT-5.2 sigue siendo útil. Pero no porque siga siendo la mejor apuesta para proyectos nuevos, sino porque todavía sirve como punto de referencia.

Además, durante el lanzamiento de GPT-5.2 hubo discusión en OpenAI Developer Community sobre fricción de billing en image inputs entre distintos endpoints. Después se indicó que ya se había desplegado una corrección, pero la lección sigue siendo válida: si mantienes una ruta legacy, mídela con cargas reales; no la conserves solo por costumbre.

También conviene definir el papel de GPT-5.2 con bastante precisión si decides mantenerlo. Por ejemplo: baseline de regresión, ruta temporal para prompts antiguos, o línea de comparación mientras dura una migración controlada. En cuanto esa función se vuelve difusa, el modelo suele quedarse por inercia más tiempo del necesario y pasa de ser una baseline útil a convertirse en un default heredado sin justificación clara.

Separar bien esa función evita muchos errores de gestión. Una cosa es decir "mantenemos GPT-5.2 tres meses para comparar prompts y medir regresiones"; otra muy distinta es dejarlo vivo porque todo el mundo ya conoce su nombre. Lo primero es una estrategia. Lo segundo suele convertirse en deuda operativa.

El modelo que muchos en realidad quieren es GPT-5.4

Si dudas de GPT-5.4 mini no por precio sino porque “mini” te suena a compromiso, entonces GPT-5.2 normalmente no es la mejor alternativa. En ese caso, lo más lógico es mirar GPT-5.4.

Esa es la línea que realmente sustituyó a GPT-5.2 como default frontier.

La división útil queda así:

- GPT-5.4 mini para default moderno de alto volumen

- GPT-5.4 para trabajo importante y complejo

- GPT-5.2 para baseline temporal de migración

Si esa era tu duda real, conviene continuar con GPT-5.4 vs GPT-5.4 mini.

Mirarlo así tiene otra ventaja: evita forzar una falsa elección binaria. En muchos equipos la solución correcta no es escoger un único modelo para todo, sino repartir papeles. GPT-5.4 mini como ruta pequeña y rápida, GPT-5.4 como ruta frontier actual, y GPT-5.2 solo como baseline mientras dure la transición. Esa lectura refleja mejor el estado real de la línea de OpenAI.

Y esa separación suele producir mejores decisiones presupuestarias. Cuando distingues la ruta de alto volumen, la ruta frontier y la ruta legacy, deja de tener sentido discutir de forma abstracta cuál "gana". La conversación pasa a ser qué modelo aporta más valor en cada clase de trabajo, que es una forma mucho más útil de decidir.

Cómo migrar desde GPT-5.2 sin hacerlo a ciegas

La forma más sensata de migrar no es cortar todo de una vez, sino separar las cargas por tipo.

- Separa loops de alto volumen de tareas realmente frontier.

- Prueba GPT-5.4 mini primero en rutas de coding y tools de alto volumen.

- Evalúa GPT-5.4 aparte para las tareas complejas e importantes.

- Mide no solo calidad, sino coste real, RPM, TPM y estabilidad operativa.

- Saca GPT-5.2 del default en cuanto deje de aportar valor como baseline.

Así puedes mantener GPT-5.2 donde aún aporta algo, sin dejar que bloquee el paso a la línea actual.

Y además te obliga a medir con más honestidad. Cuando separas la ruta de alto volumen, la ruta frontier y la ruta legacy, resulta mucho más fácil ver dónde se va el presupuesto, dónde aprieta el throughput y dónde un modelo sigue vivo únicamente por hábito histórico.

Esa lectura por workloads también facilita la coordinación interna. El equipo de producto puede decidir qué experiencia necesita una ruta barata y frecuente, backend puede revisar qué límites acompañan mejor el tráfico esperado, y operaciones puede fijar una fecha realista para retirar la baseline heredada. En conjunto, la migración deja de ser una discusión de preferencias y pasa a ser un plan verificable.

FAQ

¿GPT-5.4 mini es más barato que GPT-5.2?

Sí. En el momento de revisar este artículo, GPT-5.4 mini figuraba con $0.75 input / $4.50 output y GPT-5.2 con $1.75 input / $14 output.

¿GPT-5.4 mini reemplaza directamente a GPT-5.2?

No. En la estructura actual de OpenAI, el sucesor de GPT-5.2 como línea frontier es GPT-5.4. GPT-5.4 mini es la rama small fast.

¿GPT-5.4 mini y GPT-5.2 tienen el mismo context window?

Sí. En la verificación hecha para este artículo, ambos listaban 400K context, 128K max output y cutoff 2025-08-31.

Conclusión

Para la mayoría de proyectos nuevos en OpenAI API durante 2026, GPT-5.4 mini es una mejor elección que GPT-5.2. Cuesta menos, publica límites más altos y encaja mejor en la línea actual de producto.

GPT-5.2 sigue siendo útil sobre todo como baseline heredado para migración y validación, no como nuevo default. Y si lo que necesitas es el sucesor moderno de la antigua línea frontier, la respuesta real es GPT-5.4.