A fecha del 20 de marzo de 2026, GPT-5.4 mini es la elección por defecto para la mayoría de equipos que arrancan nuevos flujos de OpenAI API con baja latencia. El alcance de esta comparativa es operativo: precio, benchmarks, superficie de herramientas y fricción real de migración, no solo una tabla de especificaciones. El valor de esta página es dejarte una regla de decisión clara: cuándo pagar el extra de GPT-5.4 mini y cuándo mantener GPT-5 mini por coste.

Que GPT-5.4 mini sea la mejor base no significa que GPT-5 mini haya dejado de servir. Si tu carga es estable, muy centrada en texto y con fuerte presión de presupuesto, GPT-5 mini sigue siendo una opción racional. La pregunta correcta no es "cuál puntúa más", sino si tu flujo de trabajo aprovecha de verdad el salto en herramientas, frescura y rendimiento en programación y computer use.

Resumen rápido

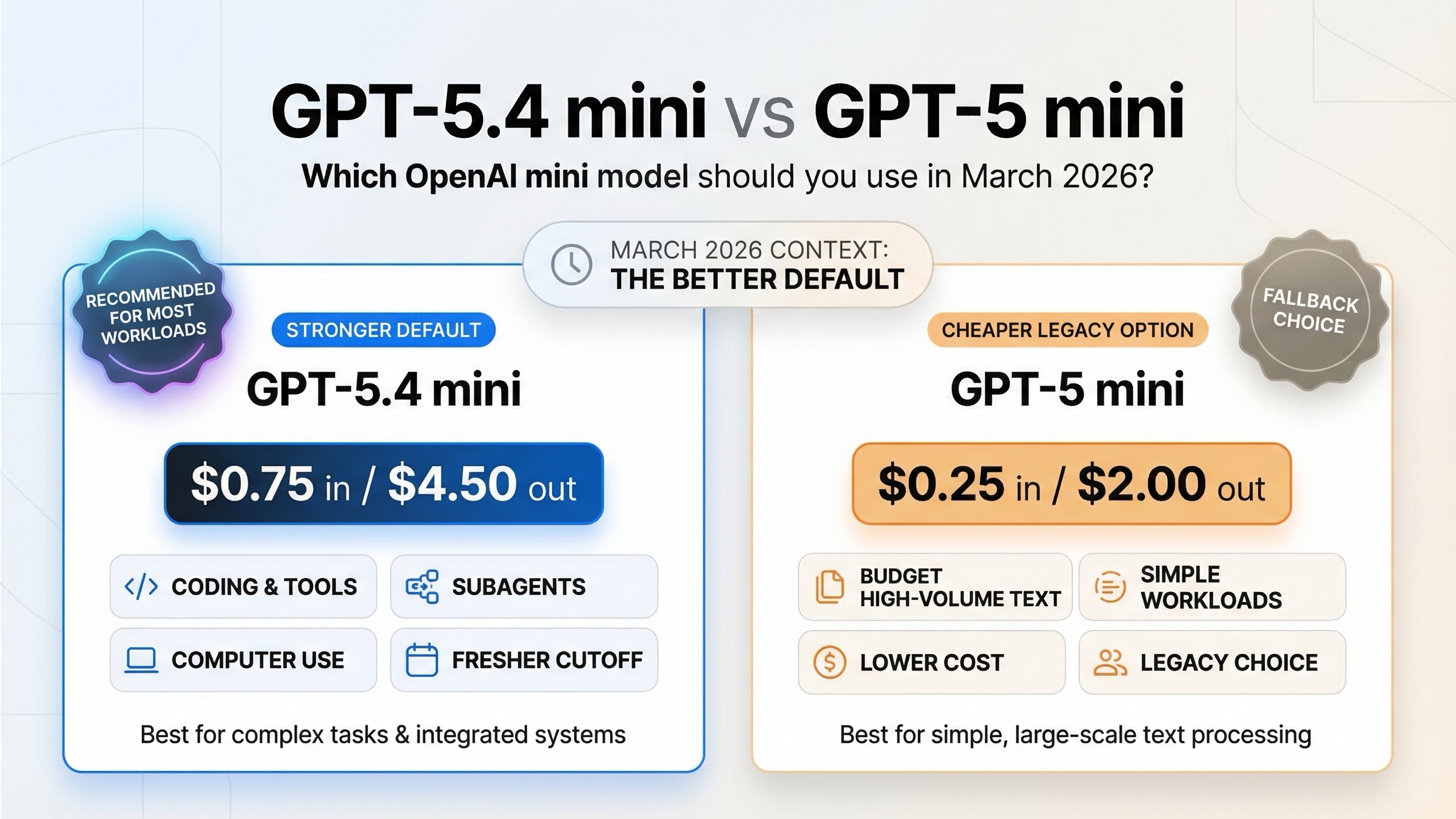

Si solo quieres la respuesta corta: usa GPT-5.4 mini para casi todos los nuevos proyectos y deja GPT-5 mini para cargas estables, baratas y con poca dependencia de herramientas.

| Modelo | Mejor para | Motivo principal para elegirlo | Motivo principal para no elegirlo |

|---|---|---|---|

| GPT-5.4 mini | Nuevos asistentes de programación, agentes con herramientas, subagentes estilo Codex y flujos con capturas | Mejores benchmarks, cutoff más reciente, más herramientas y recomendación actual de OpenAI | Es más caro: $0.75 entrada / $4.50 salida por 1M de tokens |

| GPT-5 mini | Pipelines existentes de alto volumen de texto y escenarios muy sensibles al presupuesto | Precio más bajo: $0.25 entrada / $2.00 salida por 1M de tokens | Modelo más antiguo, menos herramientas y peor rendimiento en la comparativa oficial de marzo de 2026 |

Regla práctica para decidir en minutos:

- Si lanzas un producto nuevo sobre OpenAI API en 2026, empieza por GPT-5.4 mini.

- Si dependes de computer use, hosted shell, apply patch, skills o bucles de tool search, GPT-5.4 mini es más seguro.

- Si tu carga es clasificación o generación de texto simple a gran escala, la diferencia de coste puede pesar más que la diferencia de capacidad.

- Si estás mezclando etiquetas de ChatGPT con elección de modelo API, separa superficies antes de decidir.

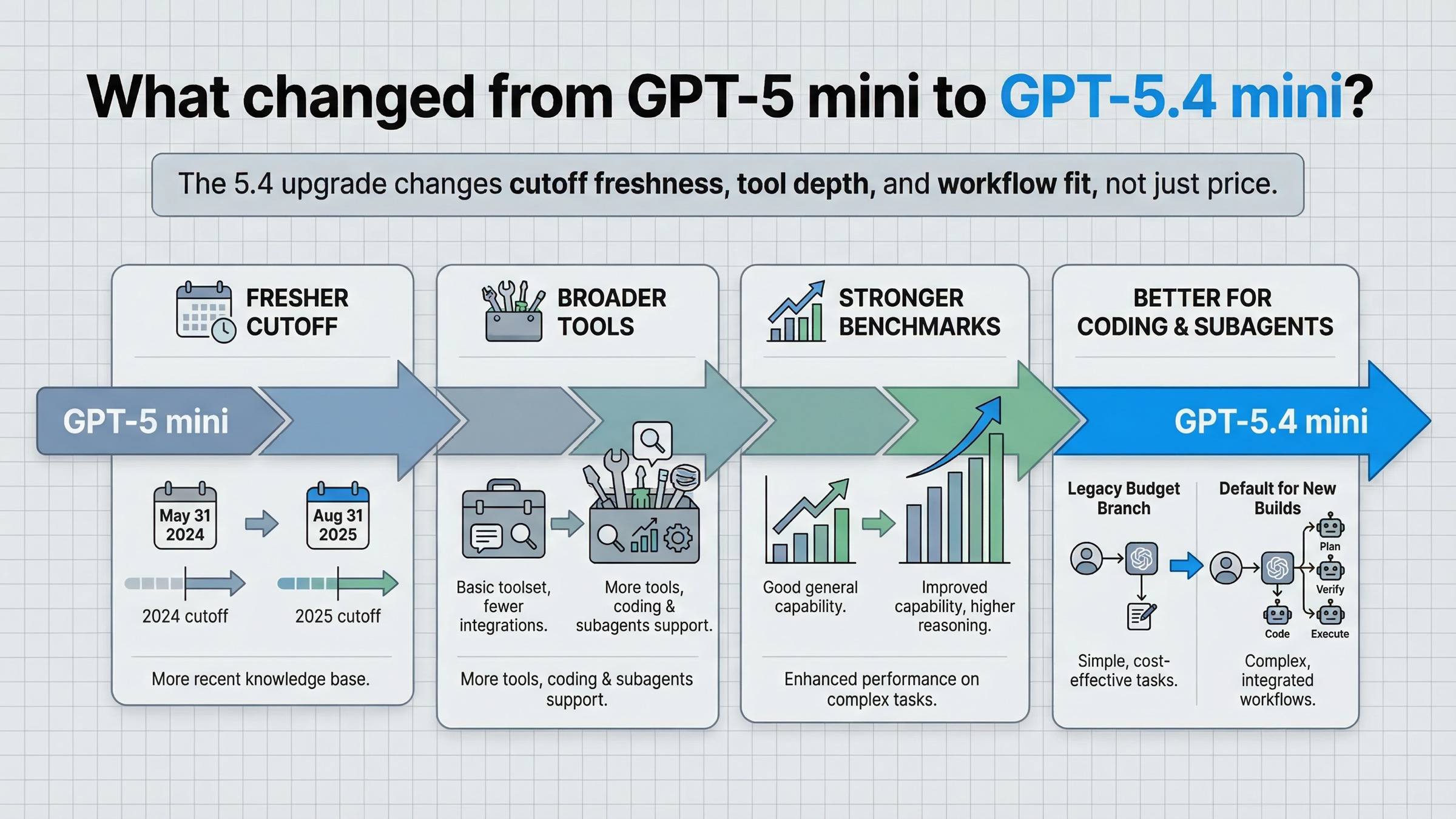

Qué cambió realmente de GPT-5 mini a GPT-5.4 mini

El error más común con esta keyword es tratar GPT-5.4 mini como un "parche menor" de GPT-5 mini. No es eso. OpenAI lo presenta como la nueva línea mini para programación, computer use y subagentes, no como una simple versión cosmética.

En el lanzamiento oficial del 17 de marzo de 2026 de GPT-5.4 mini y nano, OpenAI deja tres mensajes relevantes para una compra técnica.

Primero, GPT-5.4 mini se posiciona explícitamente como el mini más fuerte para coding, computer use y subagentes. Ese encuadre ya cambia la recomendación por defecto.

Segundo, OpenAI afirma que GPT-5.4 mini mejora sobre GPT-5 mini en coding, razonamiento, comprensión multimodal y uso de herramientas, y además funciona a más de 2x de velocidad. Ese es el núcleo de la prima de precio.

Tercero, la diferencia no está en el tamaño de contexto (ambos mantienen 400K de ventana y 128K de salida máxima), sino en lo que el modelo puede hacer dentro de ese contexto.

Resumen operativo del cambio:

| Area | GPT-5 mini | GPT-5.4 mini | Por qué importa |

|---|---|---|---|

| Posicionamiento | Mini economico de razonamiento GPT-5 | Mini más fuerte para coding, computer use y subagentes | Para nuevos builds, 5.4 mini pasa a ser la linea mini activa |

| Knowledge cutoff | 31 mayo 2024 | 31 agosto 2025 | GPT-5.4 mini llega bastante más fresco |

| Superficie de herramientas | Web search, file search, code interpreter, MCP | Web search, file search, image generation, code interpreter, hosted shell, apply patch, skills, computer use, MCP, tool search | El salto se nota mucho más en workflows agénticos que en chat simple |

| Recomendacion oficial | Sigue disponible como legacy | Recomendación actual para nuevos workloads mini | OpenAI ya orienta cargas nuevas hacia GPT-5.4 mini |

La implicación práctica es directa: GPT-5 mini ya no es la recomendación por defecto. Es una opción de excepción para casos concretos de coste y simplicidad.

Precio, contexto y soporte de herramientas, lado a lado

Para muchos equipos, la comparacion empieza en el precio. Ese enfoque es correcto, pero se queda corto si no lo cruzas con superficie de herramientas y tipo de workload.

En la pagina oficial de GPT-5.4 mini, el precio actual es $0.75 por 1M tokens de entrada y $4.50 por 1M tokens de salida. En la pagina oficial de GPT-5 mini, el precio actual es $0.25 por 1M de entrada y $2.00 por 1M de salida.

Si: GPT-5.4 mini cuesta aproximadamente 3x en entrada y 2.25x en salida. La diferencia es real. Pero el precio por si solo no decide bien.

| Especificacion | GPT-5.4 mini | GPT-5 mini |

|---|---|---|

| Precio entrada | $0.75 / 1M tokens | $0.25 / 1M tokens |

| Entrada cacheada | $0.08 / 1M tokens | $0.025 / 1M tokens |

| Precio salida | $4.50 / 1M tokens | $2.00 / 1M tokens |

| Context window | 400K | 400K |

| Max output | 128K | 128K |

| Knowledge cutoff | 31 ago 2025 | 31 may 2024 |

| Snapshot visible | gpt-5.4-mini-2026-03-17 | gpt-5-mini-2025-08-07 |

Con solo precio y contexto, GPT-5 mini parece mejor negocio. Pero la comparativa real cambia cuando miras herramientas:

| Capacidad | GPT-5.4 mini | GPT-5 mini |

|---|---|---|

| Web search | Si | Si |

| File search | Si | Si |

| Herramienta de image generation | Si | No |

| Code interpreter | Si | Si |

| Hosted shell | Si | No |

| Apply patch | Si | No |

| Skills | Si | No |

| Computer use | Si | No |

| MCP | Si | Si |

| Tool search | Si | No |

| Distillation | Si | No |

Aqui esta la linea divisoria de verdad. Si tu producto es completado de texto con herramientas basicas, GPT-5 mini puede seguir cumpliendo. Si construyes un asistente de codigo moderno o un flujo con subagentes y herramientas profundas, GPT-5.4 mini pertenece a otra clase de uso.

Tambien importa la frescura del cutoff. Pasar de mayo de 2024 a agosto de 2025 reduce friccion cuando el usuario pregunta por librerias, APIs o cambios de producto recientes.

Diferencias de benchmark que si cambian la decision

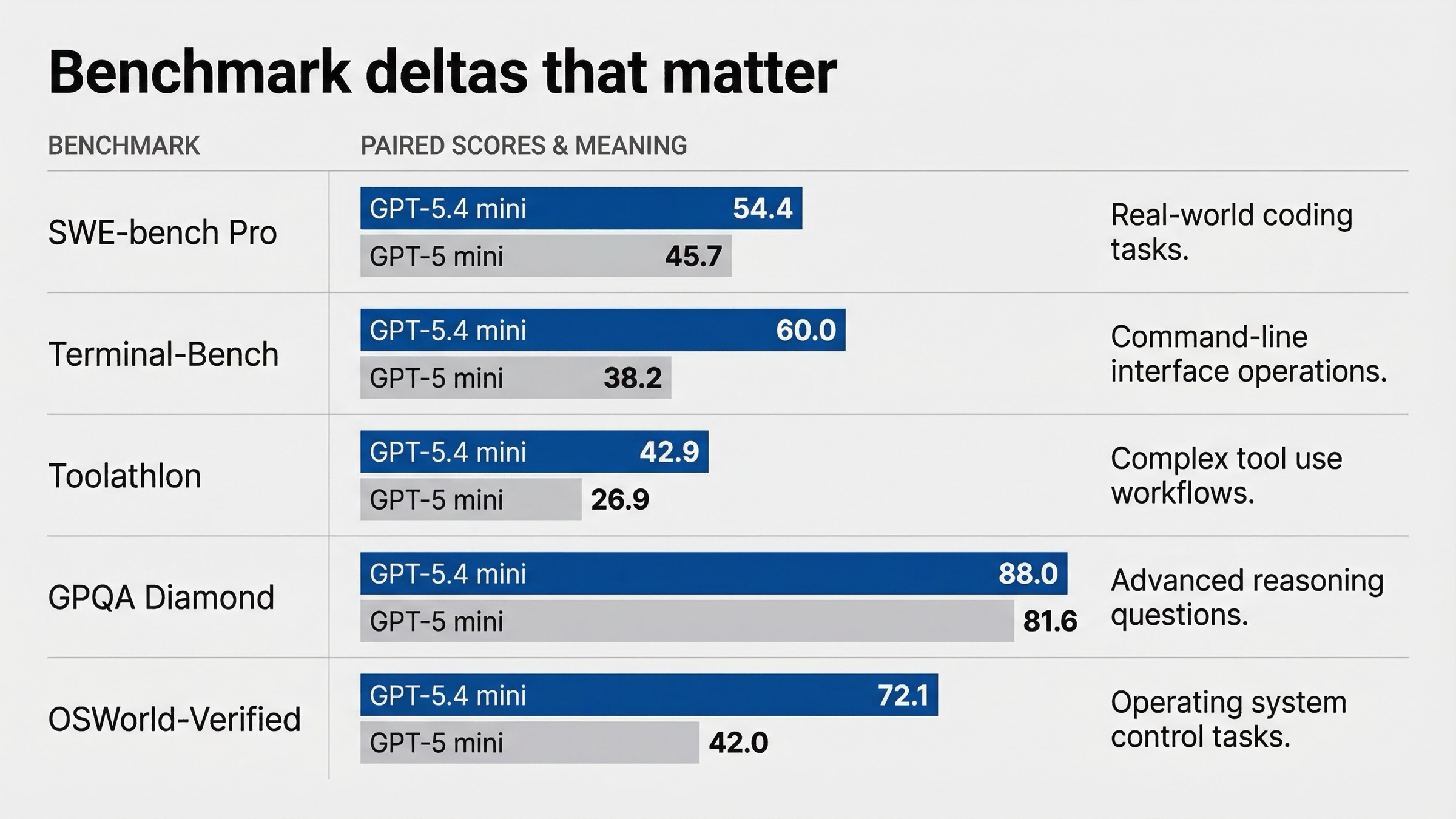

Los benchmarks solo sirven si te ayudan a decidir compra. El valor del post oficial de marzo de 2026 es que compara GPT-5.4 mini contra GPT-5 mini justo en los ejes que importan para desarrollo.

| Benchmark del post de OpenAI (17 mar 2026) | GPT-5.4 mini | GPT-5 mini | Lectura de compra |

|---|---|---|---|

| SWE-bench Pro (Public) | 54.4% | 45.7% | Mejor resolviendo incidencias reales de software |

| Terminal-Bench 2.0 | 60.0% | 38.2% | Mejor ejecucion en tareas de terminal/herramientas |

| Toolathlon | 42.9% | 26.9% | Mayor fiabilidad en uso de herramientas |

| GPQA Diamond | 88.0% | 81.6% | Mejor razonamiento de nivel alto |

| OSWorld-Verified | 72.1% | 42.0% | Mucho mejor para computer-use workflows |

| OpenAI MRCR v2 128K-256K | 33.6% | 19.4% | Mejor cuando el prompt crece de verdad |

Tres conclusiones utiles:

La primera: no son diferencias marginales. En Terminal-Bench, Toolathlon y OSWorld la brecha es suficientemente grande para cambiar comportamiento en producto.

La segunda: no es solo un upgrade de coding. Tambien mejora en razonamiento y trabajo de contexto largo.

La tercera: pagar por benchmarks solo tiene sentido si esos benchmarks se parecen a tu workload. Un sistema de clasificacion corta y barata no siempre necesita esa mejora.

Matiz tecnico importante: OpenAI indica que en esa comparativa el maximo reasoning_effort para GPT-5 mini era high, mientras que GPT-5.4 mini se evaluo con xhigh. Es una comparativa de producto actual disponible, no un test de laboratorio totalmente simetrico.

Regla rapida:

- Si tu trabajo depende de tools, coding o interpretacion de interfaz, la mejora de benchmark pesa mucho.

- Si tu trabajo es texto barato a gran escala, puede no justificar el coste extra.

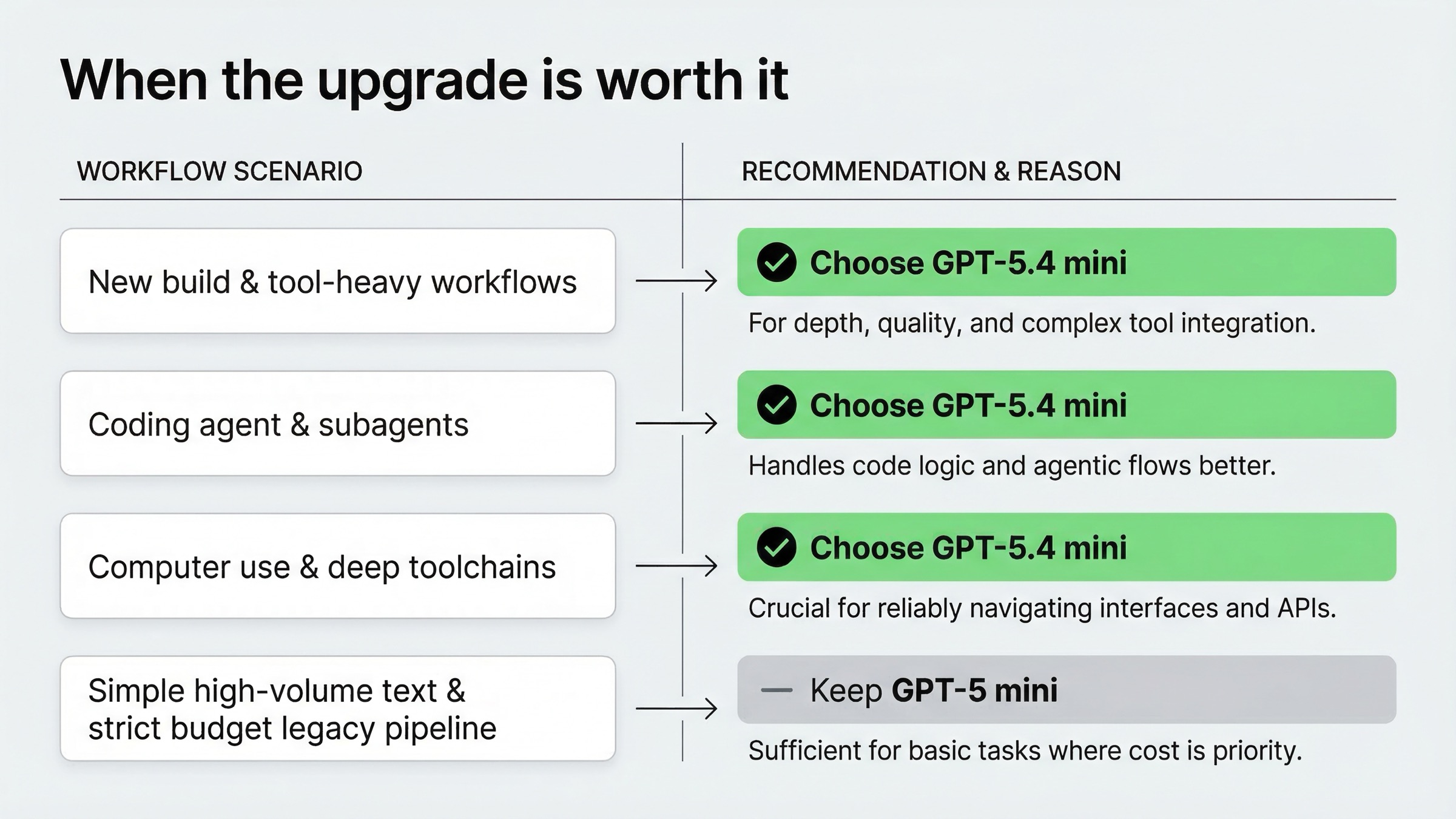

Cuando GPT-5.4 mini si compensa el coste extra

GPT-5.4 mini compensa cuando evita perder tiempo de ingenieria en workarounds de fiabilidad, herramientas o capacidad.

El caso mas claro es coding serio. Si el modelo debe navegar repositorios, recuperarse de fallos de tools, inspeccionar archivos grandes, encadenar llamadas y operar en un harness de codigo, GPT-5.4 mini es un default mas defendible.

El segundo caso es trabajo agéntico con tool depth real. Hosted shell, apply patch, skills, computer use y tool search no son extras cosméticos: cambian qué arquitectura puedes mantener sin partir el flujo entre varios modelos.

El tercer caso es densidad multimodal. En la narrativa oficial de marzo de 2026, computer use e interpretacion de capturas son casos de primera clase para GPT-5.4 mini.

El cuarto caso es migración desde rutas "económicas" antiguas (por ejemplo patrones tipo o4-mini). En la guía latest model, OpenAI menciona gpt-5.4-mini como reemplazo fuerte para o4-mini o gpt-4.1-mini.

Suele compensar pagar mas si tu flujo se parece a alguno de estos:

- Asistente de coding que exige tool calling fiable y operaciones tipo patch.

- Agente de interfaz que lee capturas y ejecuta acciones de computer use.

- Subagente dentro de un orquestador mayor.

- Producto donde un cutoff mas reciente reduce errores de soporte por documentacion desactualizada.

- Equipo que hoy gasta tiempo afinando prompts para tapar limitaciones de GPT-5 mini.

Cuando GPT-5 mini todavia tiene sentido

GPT-5 mini sigue siendo util cuando el workload no aprovecha el extra de GPT-5.4 mini.

El caso mas fuerte es trafico legacy sensible a coste. Si ya operas GPT-5 mini con prompts estables, poca dependencia de tools y tasas de fallo controladas, migrar todo puede subir factura mas rapido de lo que sube valor.

El segundo caso es texto simple de gran volumen. Para salidas cortas y estructuradas o tareas de routing estrechas, GPT-5 mini puede seguir siendo un punto economico valido.

El tercer caso es arquitectura con rutas pesada/ligera separadas. Si ya envias lo complejo a otro modelo, GPT-5 mini puede permanecer como carril barato.

GPT-5 mini tiene sentido si se cumplen la mayoria de estas condiciones:

- Predominio de texto simple sobre flujos con herramientas.

- No necesitas hosted shell, apply patch, skills, computer use ni tool search.

- El objetivo principal es bajar coste por token.

- Estas optimizando un sistema existente, no redisenando uno nuevo desde cero.

Eso si: no asumas que sera la mejor opcion barata para siempre. La recomendacion oficial para nuevas cargas ya se mueve hacia la linea 5.4.

Notas de migracion para workloads existentes en GPT-5 mini

Si ya estas en GPT-5 mini, no migres a ciegas. Prueba primero donde realmente pierdes dinero o confianza.

Checklist minimo:

| Pregunta de migracion | Por que importa |

|---|---|

| Tu flujo mejora con mayor fiabilidad en tools? | El salto fuerte de GPT-5.4 mini esta en coding y tool use |

| Necesitas conocimiento mas reciente sin depender tanto de search? | La brecha de cutoff es amplia |

| Tu arquitectura requiere capacidades que GPT-5 mini no trae? | Hosted shell, apply patch, skills, computer use y tool search inclinan la balanza |

| Tu caso es de baja latencia pero muy superficial? | Ahi el coste puede seguir favoreciendo GPT-5 mini o GPT-5.4 nano |

Tambien hay una capa de comportamiento de prompts. La guia Using GPT-5.4 indica diferencias de comportamiento frente a modelos anteriores de la familia GPT-5. Ademas, en la OpenAI Developer Community varios equipos reportaron friccion en GPT-5 y GPT-5 mini para tareas deterministas de baja latencia cuando querian razonamiento totalmente desactivado.

Recomendacion de migracion:

- Prueba GPT-5.4 mini primero en los flujos donde GPT-5 mini ya falla: coding, chaining de tools, extraccion estructurada y razonamiento con capturas.

- Conserva GPT-5 mini solo si la mejora medida es pequena y el aumento de gasto es alto.

- Si la carga es muy simple y muy sensible a precio, compara tambien rutas de casos tipo o4-mini (en ingles) y GPT-5.4 nano para el carril barato.

Si empiezas desde cero con API, primero monta la base con esta guia para obtener OpenAI API key (en ingles) y despues valida GPT-5.4 mini como primera opcion.

ChatGPT vs API: no mezcles estas superficies

Esta keyword se contamina rapido porque "mini" aparece en varios productos y se asume equivalencia uno-a-uno. No la hay.

Segun el lanzamiento del 17 de marzo de 2026 de GPT-5.4 mini y nano, GPT-5.4 mini esta disponible en API, Codex y ChatGPT. Pero la ayuda oficial que volvi a comprobar el 20 de marzo de 2026 ya describe otra realidad: GPT-5.3 es ahora la linea por defecto de ChatGPT para usuarios con sesion iniciada, los planes de pago pueden elegir manualmente GPT-5.4 Thinking y, tras algunos limites de uso, los chats pasan a una mini version mas generica. Por eso no conviene leer las etiquetas visibles de ChatGPT como si fueran equivalentes directos de esta comparativa API.

Por eso esta comparativa debe leerse como decision de API/Codex, no como eleccion de etiquetas visibles del selector de ChatGPT.

FAQ

GPT-5 mini esta deprecado?

No. A 20 de marzo de 2026, GPT-5 mini mantiene pagina de modelo y precio activo en API. Pero ya funciona como opcion mini anterior, no como recomendacion principal para nuevos workloads.

GPT-5.4 mini reemplaza completamente a GPT-5 mini?

Como recomendacion por defecto para builds nuevos, practicamente si. A nivel operativo, no al 100%, porque GPT-5 mini sigue siendo util para escenarios estrechos y muy sensibles a coste.

Cual conviene para agentes de coding o subagentes estilo Codex?

GPT-5.4 mini. Es justo el encuadre oficial de OpenAI y la comparativa de marzo de 2026 respalda esa eleccion.

Cual conviene para texto barato de alto volumen?

Si el flujo es realmente simple y tool-light, GPT-5 mini sigue siendo defendible. Antes de cerrar decision, compara tambien con GPT-5.4 nano.

Que modelo va mejor para tareas deterministas y de baja latencia?

Depende de prompts y formato de salida. Hubo reportes de friccion en workflows antiguos de GPT-5 mini para casos donde se buscaba comportamiento totalmente no-razonado. En ese tipo de tarea, mide en entorno real y no asumas por inercia.

Recomendacion final

Si necesitas una frase para decidir en equipo, usa esta: GPT-5.4 mini es la opcion por defecto correcta en 2026, salvo que tengas una razon clara de coste para mantener GPT-5 mini.

Se sostiene sobre cuatro hechos verificados el 20 de marzo de 2026:

- OpenAI recomienda GPT-5.4 mini para la mayoria de nuevos workloads mini de baja latencia y alto volumen.

- GPT-5.4 mini trae una superficie de herramientas bastante mas amplia para coding y flujos agenticos.

- La comparativa oficial del 17 de marzo de 2026 marca mejoras claras frente a GPT-5 mini en coding, tools, computer use y razonamiento.

- GPT-5 mini es mas barato, pero ya no es la ruta por defecto para sistemas nuevos.

La decision real no es "si GPT-5.4 mini es mejor". Lo es. La decision real es si tu workload es lo bastante simple como para priorizar coste y aceptar la perdida de capacidad. En muchos equipos API de 2026, esa respuesta sera que no.