Respuesta corta: para la mayoría de equipos, GPT-5.4 ya es la mejor opción por defecto. OpenAI lanzó GPT-5.4 el 5 de marzo de 2026 y en su guía actual para elegir modelo la coloca como el punto de partida recomendado para tareas complejas de razonamiento y programación. Si la pregunta real es qué modelo debería ocupar la ruta principal en API o Codex, la respuesta oficial ya se movió de GPT-5.2 a GPT-5.4.

Eso no significa que GPT-5.2 haya quedado inútil. GPT-5.2 se lanzó el 11 de diciembre de 2025, sigue siendo más barata en input y cached input, y todavía aparece en parte de la documentación de límites de ChatGPT Enterprise. Por eso sigue teniendo sentido en algunos casos concretos.

La clave no es repetir el marketing del lanzamiento. La clave es responder esto: ¿qué modelo conviene poner como predeterminado hoy, y cuál conviene dejar solo como excepción?

Resumen rápido

Si solo quieres una recomendación: usa GPT-5.4 como ruta principal y conserva GPT-5.2 solo en escenarios más estrechos.

| Categoría | GPT-5.4 | GPT-5.2 | Lectura práctica |

|---|---|---|---|

| Fecha de lanzamiento | 5 de marzo de 2026 | 11 de diciembre de 2025 | GPT-5.4 es la nueva frontier por defecto |

| Rol actual | Modelo insignia para reasoning y coding | Frontier anterior | GPT-5.4 ya tomó el puesto central |

| Precio de input | $2.50 / 1M | $1.75 / 1M | GPT-5.2 sigue siendo más barata en input |

| Cached input | $0.25 / 1M | $0.175 / 1M | En flujos repetitivos GPT-5.2 cuesta menos |

| Precio de output | $15 / 1M | $14 / 1M | La diferencia es pequeña |

| Ventana de contexto | 1,050,000 | 400,000 | GPT-5.4 gana con claridad en contexto largo |

| Límites API publicados | Los mismos tiers visibles | Los mismos tiers visibles | No es una comparación de RPM/TPM |

| Mejor uso | Nuevo default para API, Codex y flujos con herramientas | Carril más barato o legacy | GPT-5.4 primero, GPT-5.2 solo cuando haga falta |

La idea central es esta: GPT-5.4 debería reemplazar a GPT-5.2 como default, pero GPT-5.2 no necesariamente debe desaparecer del stack.

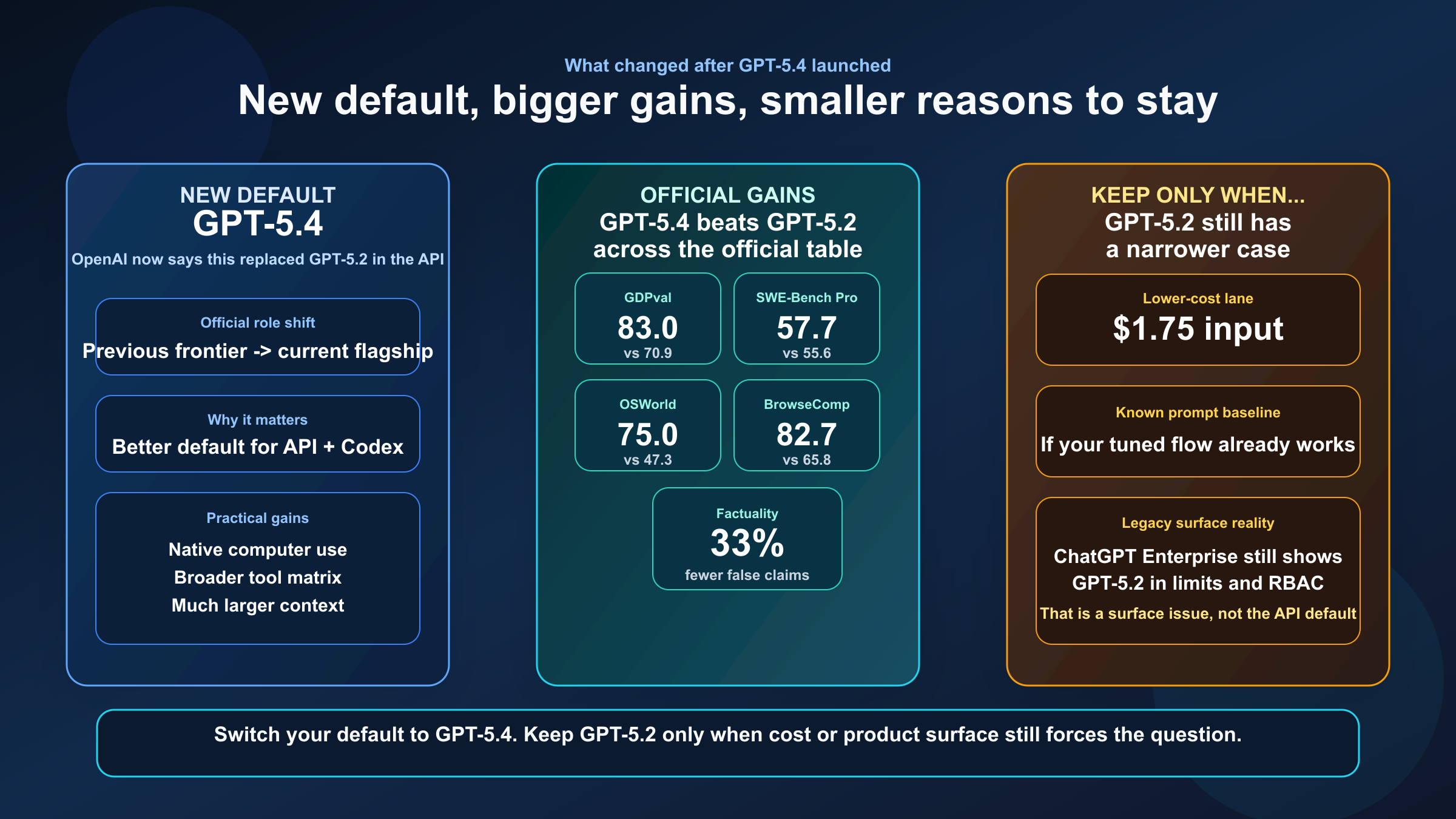

Qué cambió realmente de GPT-5.2 a GPT-5.4

El cambio más importante no está en un benchmark aislado. Está en la posición del producto.

Cuando salió GPT-5.2, OpenAI la presentó como su modelo frontier para trabajo profesional, contexto largo, vision y agentic coding. Para muchas integraciones era lógico convertirla en la ruta general por defecto.

Con GPT-5.4 eso cambió. OpenAI ahora la describe como el modelo frontier actual para trabajo profesional y, además, en la documentación vigente afirma que reemplazó a GPT-5.2 en la API. Esa frase importa porque resuelve la pregunta práctica que la mayoría de páginas del SERP todavía responde mal: hoy, ¿cuál debería ser el nuevo punto de partida?

GPT-5.4 también amplía el significado de “modelo generalista”. En la página de lanzamiento OpenAI destaca native computer use y soporte para hasta 1M de tokens de contexto. Es decir, no solo mejora la calidad general frente a GPT-5.2: también amplía el tipo de trabajo que puede absorber como ruta principal.

Por eso esta comparación no debería leerse como una simple lista de especificaciones. La forma correcta de verla es:

- frontier anterior vs frontier actual

- ruta madura y más barata vs ruta principal con más alcance

- carril táctico para costo vs carril por defecto para trabajo complejo

Qué benchmarks y diferencias importan de verdad

OpenAI compara GPT-5.4 contra GPT-5.2 directamente en varios benchmarks:

| Métrica | GPT-5.4 | GPT-5.2 | Qué implica |

|---|---|---|---|

| GDPval | 83.0% | 70.9% | Mejor desempeño en trabajo profesional real |

| SWE-Bench Pro | 57.7% | 55.6% | Mejor resultado en ingeniería de software difícil |

| OSWorld-Verified | 75.0% | 47.3% | Salto fuerte en computer use y tareas GUI |

| Toolathlon | 54.6% | 46.3% | Mejor en flujos multi-herramienta |

| BrowseComp | 82.7% | 65.8% | Mejor en búsqueda y síntesis de fuentes |

No importa solo que GPT-5.4 gane. Importa dónde gana.

GDPval y BrowseComp indican que GPT-5.4 es mejor cuando el trabajo mezcla código, lectura, síntesis, toma de decisiones y generación de entregables. OSWorld y Toolathlon muestran que la ventaja también aparece cuando el flujo depende de herramientas, interfaces y pasos encadenados, no solo de “escribir código”.

OpenAI además afirma que GPT-5.4 reduce en 33% la probabilidad de falsedad por afirmación y en 18% la probabilidad de que una respuesta completa contenga errores frente a GPT-5.2. Para equipos que usan el modelo como socio técnico y no solo como autocompletado, esa mejora importa.

La conclusión aquí es directa:

- GPT-5.4 es mejor como modelo general de trabajo

- la diferencia se nota sobre todo en flujos agentic y tool-heavy

- GPT-5.2 sigue siendo útil, pero ya no define el default frontier

Si quieres otra referencia dentro de la familia de OpenAI para programación, puedes seguir con nuestra guía GPT-5.4 vs GPT-5.3-Codex.

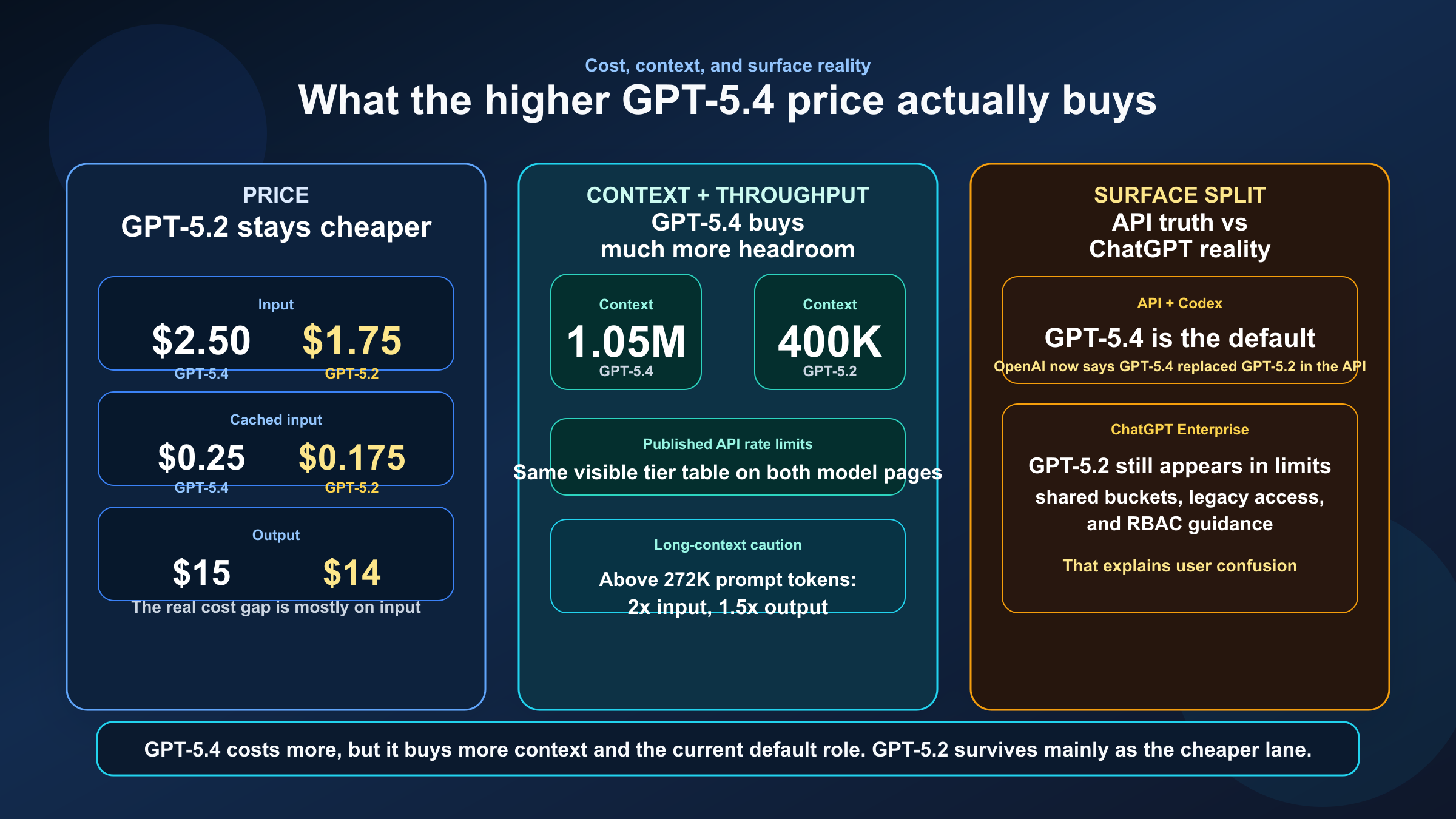

Precio, contexto y límites públicos de la API

Aquí es donde GPT-5.2 conserva su argumento más serio.

| Parámetro | GPT-5.4 | GPT-5.2 | Cómo leerlo |

|---|---|---|---|

| Input | $2.50 / 1M | $1.75 / 1M | GPT-5.2 es mejor para cargas muy sensibles al costo |

| Cached input | $0.25 / 1M | $0.175 / 1M | GPT-5.2 sigue ganando en contexto repetido |

| Output | $15 / 1M | $14 / 1M | La diferencia aquí no manda |

| Contexto | 1,050,000 | 400,000 | GPT-5.4 ofrece mucho más margen |

| Max output | 128,000 | 128,000 | Sin diferencia práctica grande |

| Caveat de contexto largo | >272K input = 2x input y 1.5x output en toda la sesión | No hay multiplicador público equivalente | El gran contexto de GPT-5.4 tiene un precio real |

En costes, la diferencia principal está en el input. Si tu sistema manda muchísimos prompts largos, o reusa bloques grandes de contexto una y otra vez, GPT-5.2 todavía puede ser la ruta económica más razonable.

Pero el salto de contexto es enorme: 1.05M frente a 400K. Para análisis de repositorios grandes, documentos extensos y sesiones largas con agentes, esa diferencia cambia de verdad lo que cabe en una sola ejecución.

El problema es que muchas comparativas se quedan solo con la cifra grande. La página actual del modelo GPT-5.4 también advierte que, por encima de 272K input tokens, toda la sesión se cobra con multiplicador. Así que la ventaja existe, pero no es gratuita.

Otra aclaración importante: en las páginas públicas del modelo, los tiers visibles de rate limits de GPT-5.4 y GPT-5.2 son equivalentes. Por eso esta no es una comparación de throughput bruto. Es una comparación de default quality, herramientas, contexto y costo.

API y Codex vs la realidad de ChatGPT y Enterprise

Aquí aparece gran parte de la confusión del SERP.

Si hablas de API y Codex, la situación es muy clara:

- GPT-5.4 ya es la opción principal recomendada

- OpenAI la presenta como reemplazo de GPT-5.2 en la API

- para flujos nuevos y complejos, lo razonable es arrancar con GPT-5.4

Si hablas de ChatGPT y Enterprise, el panorama es más desordenado. GPT-5.2 todavía aparece en buckets compartidos, acceso legacy y reglas RBAC de la documentación de ayuda. Eso hace que algunos usuarios piensen que GPT-5.2 sigue siendo un default equivalente, cuando en realidad están viendo una verdad de superficie, no la recomendación principal para la API.

Por eso el mejor marco es separar ambos planos:

- decisión técnica de routing para API y Codex

- realidad operativa del model picker y de la administración en Enterprise

Ambos pueden coexistir sin contradecirse.

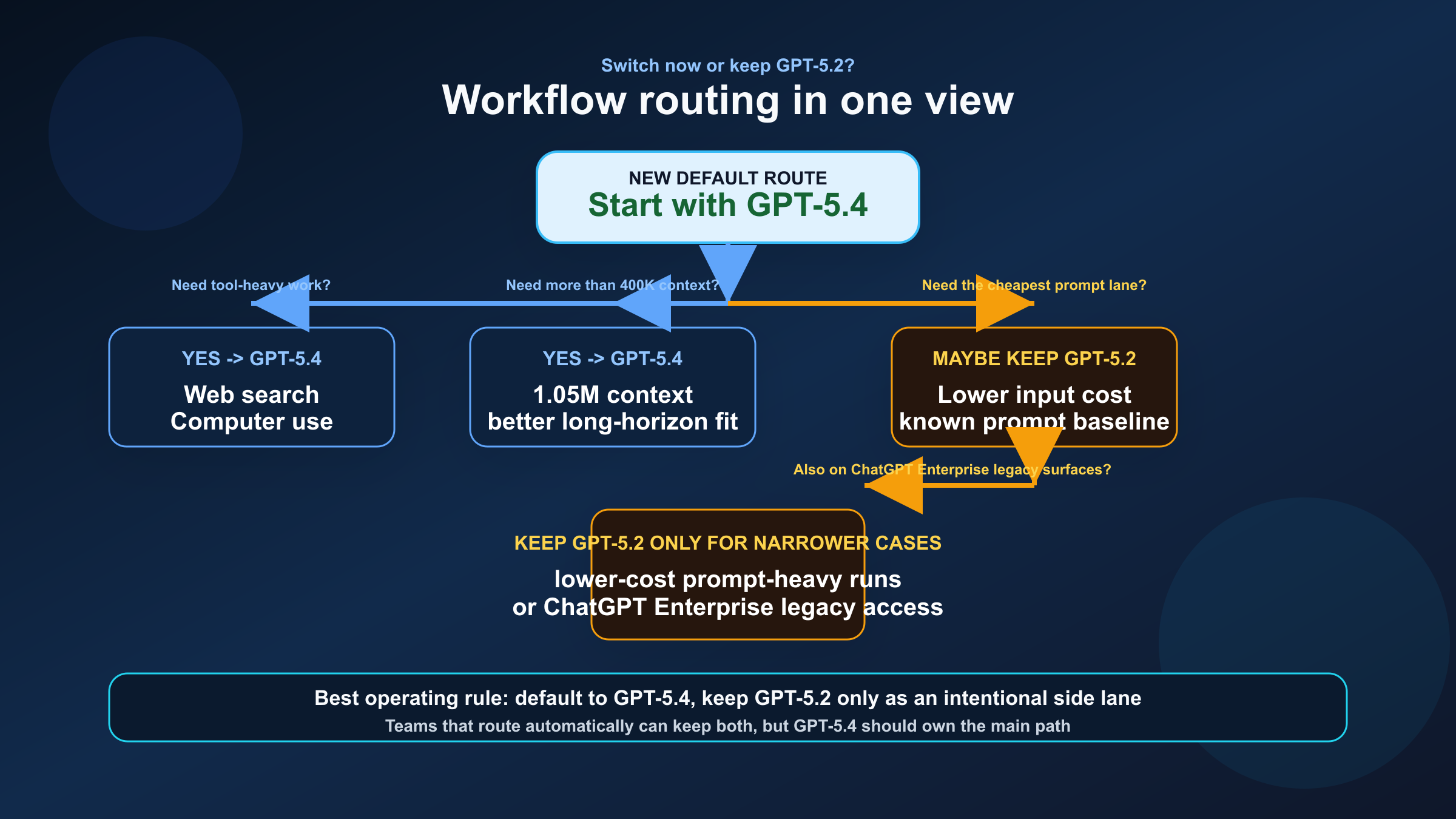

Cuándo GPT-5.4 es claramente mejor

GPT-5.4 es claramente mejor cuando el trabajo va más allá de prompts baratos y repetitivos.

Tiene más sentido usar GPT-5.4 como default cuando necesitas:

- análisis de repositorios grandes

- workflows con varias herramientas

- browser use, screenshots y computer use

- tareas mixtas de código, análisis y documentación

- una sola ruta fuerte en vez de demasiadas rutas especiales

Para muchos equipos, el costo oculto no está en los tokens sino en mantener demasiados defaults, excepciones y reglas de clasificación. GPT-5.4 ayuda precisamente porque puede absorber más tipos de trabajo con una sola ruta principal.

Eso se nota todavía más cuando una misma sesión tiene que leer documentación larga, recorrer un repositorio, llamar herramientas, verificar datos y luego convertir todo eso en una recomendación o en un parche. En ese tipo de cadena mixta, GPT-5.4 no solo "rinde mejor": también reduce la probabilidad de que el flujo se rompa entre pasos, que es justo lo que más encarece los workflows reales.

También simplifica la gobernanza interna. Si varias personas del equipo necesitan una regla clara para elegir modelo, es más fácil documentar "GPT-5.4 por defecto" y dejar GPT-5.2 como excepción consciente, que mantener un árbol de decisiones lleno de rutas históricas, costes parciales y reglas especiales.

Cuándo GPT-5.2 todavía tiene sentido

GPT-5.2 ya no tiene sentido como main default, pero sí como carril táctico.

Todavía conviene conservarla cuando:

- el input cost es más importante que la máxima capacidad

- ya tienes prompts y flujos muy afinados para GPT-5.2

- las tareas caben de sobra en 400K de contexto

- la realidad que mandas es Enterprise legacy, no una integración nueva de API

- quieres una fallback lane más barata al lado de GPT-5.4

La palabra clave aquí es intención. GPT-5.2 ya no se conserva por costumbre, sino porque sigue resolviendo una necesidad concreta.

En la práctica, eso suele funcionar bien como un carril de costo. Puedes reservar GPT-5.2 para tareas previsibles, con mucho input repetido y poca necesidad de herramientas o contexto extremo, mientras que GPT-5.4 se queda con el trabajo que de verdad se beneficia de una ruta más amplia y más capaz. Esa separación suele ser más útil que intentar decidir modelo caso por caso de manera improvisada.

Checklist de migración de GPT-5.2 a GPT-5.4

Si tu equipo todavía usa GPT-5.2 como default, lo más sensato es migrar por etapas.

- Pon GPT-5.4 como ruta principal para API y Codex nuevos.

- Conserva GPT-5.2 para escenarios prompt-heavy más baratos y legacy cases.

- Reprueba tres tipos de tareas reales: long-context, multi-tool y cost-sensitive.

- Añade monitoring de costos para sesiones de GPT-5.4 por encima de 272K input.

- Si tus usuarios trabajan sobre ChatGPT Enterprise, documenta por separado el default de API y la realidad del model picker.

Así aprovechas la nueva ruta principal sin romper la vía económica que todavía puede seguir teniendo sentido.

Además, conviene medir la migración con una lógica de workflow completo y no solo con precio por millón de tokens. Si al pasar a GPT-5.4 reduces reintentos, fragmentación del contexto y correcciones manuales en tareas largas, el costo operativo total puede salir mejor de lo que sugiere una tabla simple de precios.

Una secuencia de migración bastante sana consiste en mover primero a GPT-5.4 los flujos donde el error cuesta más tiempo: investigación técnica, debugging largo, análisis de repositorio, tareas con herramientas y sesiones con contexto muy amplio. Después puedes dejar GPT-5.2 para cargas previsibles, repetitivas y baratas, donde la prioridad real sea el costo de input y no la amplitud de capacidades.

Ese enfoque también ayuda a nivel organizativo. En lugar de discutir modelo por modelo cada vez que aparece una tarea nueva, el equipo puede documentar una regla simple: GPT-5.4 como ruta principal para trabajo complejo, GPT-5.2 como excepción controlada para optimización de costos o compatibilidad con superficies legacy. Cuando la política queda clara, la migración deja de depender de memoria informal y se vuelve mucho más estable.

Dicho de otra manera, esta comparación solo parece cerrada si se mira como una tabla de specs. En el uso real, la pregunta importante es qué modelo quieres como línea base para trabajo nuevo. Ahí GPT-5.4 tiene ventaja clara porque cubre más tipos de tareas con menos fricción operativa, mientras que GPT-5.2 encaja mejor como carril secundario con objetivos bien definidos.

Si incluso la documentación interna del equipo queda más simple después del cambio, eso ya es una señal fuerte de que la ruta principal correcta ha pasado a ser GPT-5.4.

Ese criterio práctico suele valer más que cualquier comparativa superficial de lanzamiento.

FAQ

¿GPT-5.4 reemplaza completamente a GPT-5.2?

Para la mayoría de flujos nuevos en API y Codex, sí. OpenAI ya la posiciona como la sustituta natural. Pero eso no significa que GPT-5.2 desaparezca de todas las superficies ni que deje de servir como carril más barato.

¿La subida de precio de GPT-5.4 vale la pena?

Normalmente sí, si de verdad vas a aprovechar más contexto, mejor tool posture y mejor rendimiento agentic. Si tus tareas son sobre todo prompts repetitivos y baratos, GPT-5.2 todavía puede ser la opción más rentable.

¿Hay diferencias reales de rate limits entre ambas?

No de forma importante en las páginas públicas actuales. Los tiers visibles son equivalentes, así que la elección no gira alrededor de RPM o TPM.

¿Por qué todavía aparece GPT-5.2 en ChatGPT Enterprise?

Porque Enterprise documenta buckets compartidos, acceso legacy y reglas RBAC, no solo la recomendación técnica para la API. Eso explica por qué algunos usuarios siguen viéndola.

¿Cuándo conviene dejar GPT-5.2?

Cuando necesitas reducir input cost, cuando tu flujo actual ya está muy afinado para GPT-5.2, o cuando debes convivir con superficies legacy de Enterprise. En la mayoría de los demás casos, la ruta principal ya debería ser GPT-5.4.