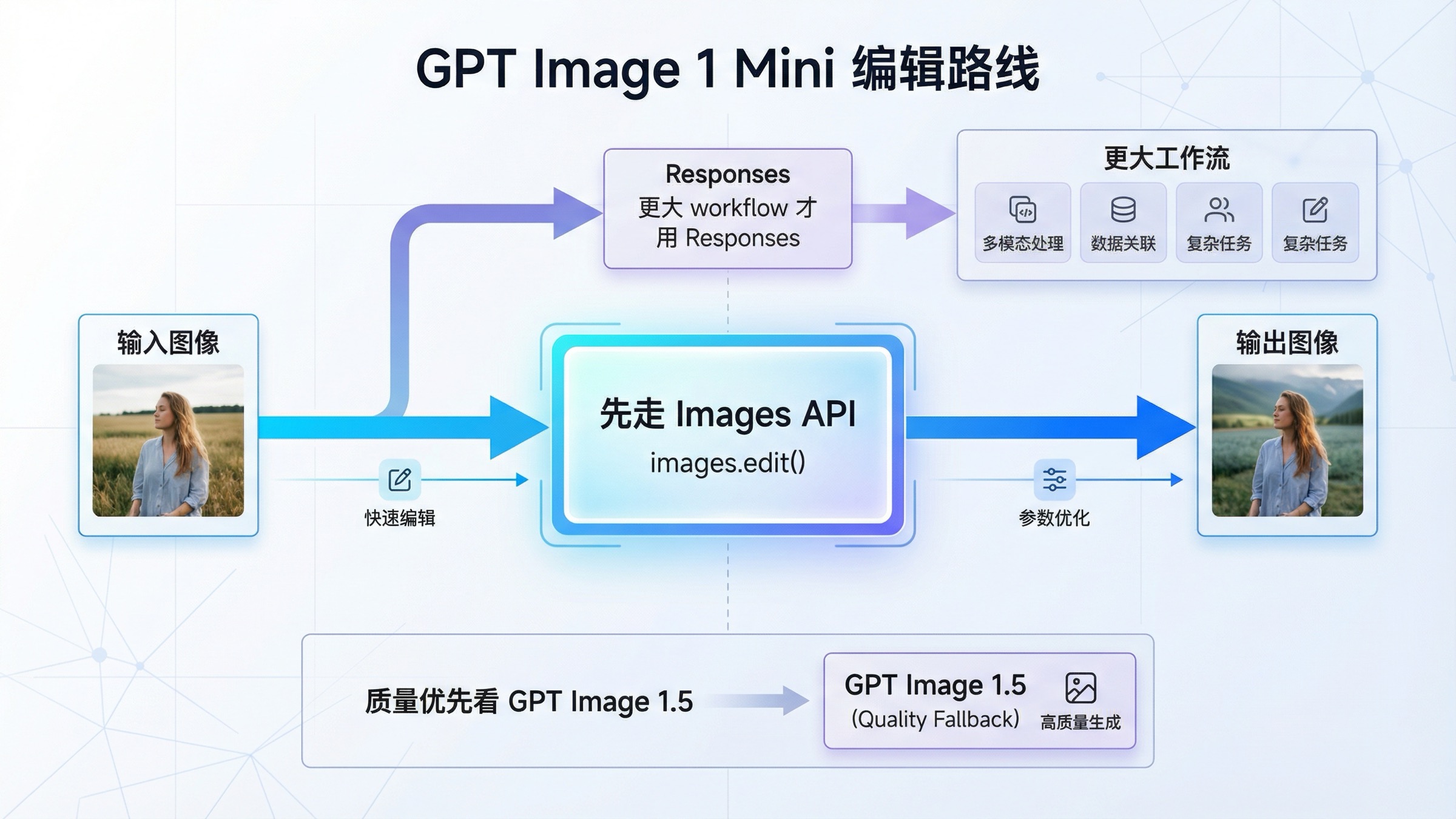

如果你在 2026 年 3 月 29 日要用 gpt-image-1-mini 做图片编辑,最稳的默认路线不是 Responses,而是直接走 OpenAI Images API:SDK 里用 client.images.edit(),原始 HTTP 则用 POST /v1/images/edits。 只有当“编辑图片”只是更大 assistant、conversation 或多工具工作流里的一个步骤时,Responses 才是更合理的外层抽象。

这个答案之所以值得单独写一篇,是因为当前结果页和官方文档把线索分散在不同页面上。gpt-image-1-mini 模型页 明确列出了 v1/images/edits。当前的 image generation guide 又明确说,当你只需要根据一个 prompt 做一次生成或编辑时,Image API 是更好的选择。与此同时,当前的 image generation tool guide 在 Responses 侧明确说明 action 的模型主要是 gpt-image-1.5 和 chatgpt-image-latest,而不是把 mini 当成默认编辑入口。把这几页合在一起看,结论就比多数页面更清楚:mini 的直接编辑先走 /v1/images/edits。

这条路线还有一个现实好处:它能让你少踩一类很常见的错误。很多开发者先看到 Responses 示例,就以为“新一点、通用一点”的抽象天然更适合 gpt-image-1-mini。对这个精确关键词来说,通常正好相反。直接 edit 路线更容易对齐文档、更容易排查问题,也更容易把 mini 的限制和适用边界看清楚。

要点速览

- 如果你的任务就是“把这张图改一下”,先用

client.images.edit()或POST /v1/images/edits。 - 如果图片编辑只是更大 assistant / multimodal workflow 里的一个步骤,再考虑 Responses。

- 如果你要更强的多图保真、更高的 edit 上限,或者更稳的质量优先默认值,直接看 GPT Image 1.5。

- 真正开始改代码之前,先检查 付费 tier、组织验证、项目和 API key 归属。

| 场景 | 更好的默认值 | 为什么 |

|---|---|---|

| 编辑一张或几张图片并直接保存结果 | images.edit() | 这是 mini 当前最明确、最直接的编辑路线 |

| 一次请求里要带 mask 或参考图 | images.edit() | 文件上传、mask 和输出处理都更直观 |

| 图片编辑只是长对话、多工具或 assistant 的一环 | Responses | 真正需要的是会话和工具编排,不只是编辑本身 |

| 你要尽量保住多张输入图、品牌元素或高价值素材 | GPT Image 1.5 + images.edit() | 官方把 1.5 放在更高质量、更强保真的路线 |

直接编辑 mini,先走 /v1/images/edits

对这个关键词来说,最有用的第一条规则其实并不复杂。当前官方文档没有让你去猜:mini 模型页明确写了 v1/images/edits,image guide 也说明如果你只需要一条 prompt 做一次生成或编辑,Image API 就是更好的默认起点。这正好匹配大多数 “gpt-image-1-mini edit” 搜索背后的实际任务。

所以你的第一条成功路径应该故意“无聊”一点:

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const result = await client.images.edit({ model: "gpt-image-1-mini", image: [fs.createReadStream("room.png")], prompt: "Replace the blank wall art with a framed abstract poster. Preserve the room layout, lighting, furniture, and camera angle. Do not change anything else.", input_fidelity: "high", size: "1024x1024", quality: "medium", output_format: "jpeg", output_compression: 80, }); const imageBase64 = result.data[0].b64_json; fs.writeFileSync("room-edited.jpg", Buffer.from(imageBase64, "base64"));

如果你在做原始 HTTP 调试,也要记住这里走的是 multipart form-data,不是 JSON:

bashcurl https://api.openai.com/v1/images/edits \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -F "model=gpt-image-1-mini" \ -F "image[]=@room.png" \ -F 'prompt=Replace the blank wall art with a framed abstract poster. Preserve the room layout, lighting, furniture, and camera angle. Do not change anything else.' \ -F "input_fidelity=high" \ -F "size=1024x1024" \ -F "quality=medium"

为什么这条 direct route 应该排在第一位?原因有三层。

第一,它把模型选择和 API surface 对齐了。你用的是 mini 当前明确支持的编辑 endpoint,而不是先把请求塞进更大的 orchestration layer,再猜到底是哪一层出了问题。

第二,它能把调试范围缩小。请求失败时,你通常只需要优先看四类问题:账号权限、文件格式、prompt 写法、输出解析,而不是还要同时怀疑 top-level Responses model、tool 配置或 conversation state。

第三,它能让这篇文章和更宽的 OpenAI 图片编辑 API 指南 保持清晰分工。那篇文章讲的是整个 OpenAI image edit family;这篇文章只回答一个更窄也更实用的问题:当你已经知道自己就是要 mini edit 时,应该先怎么做。

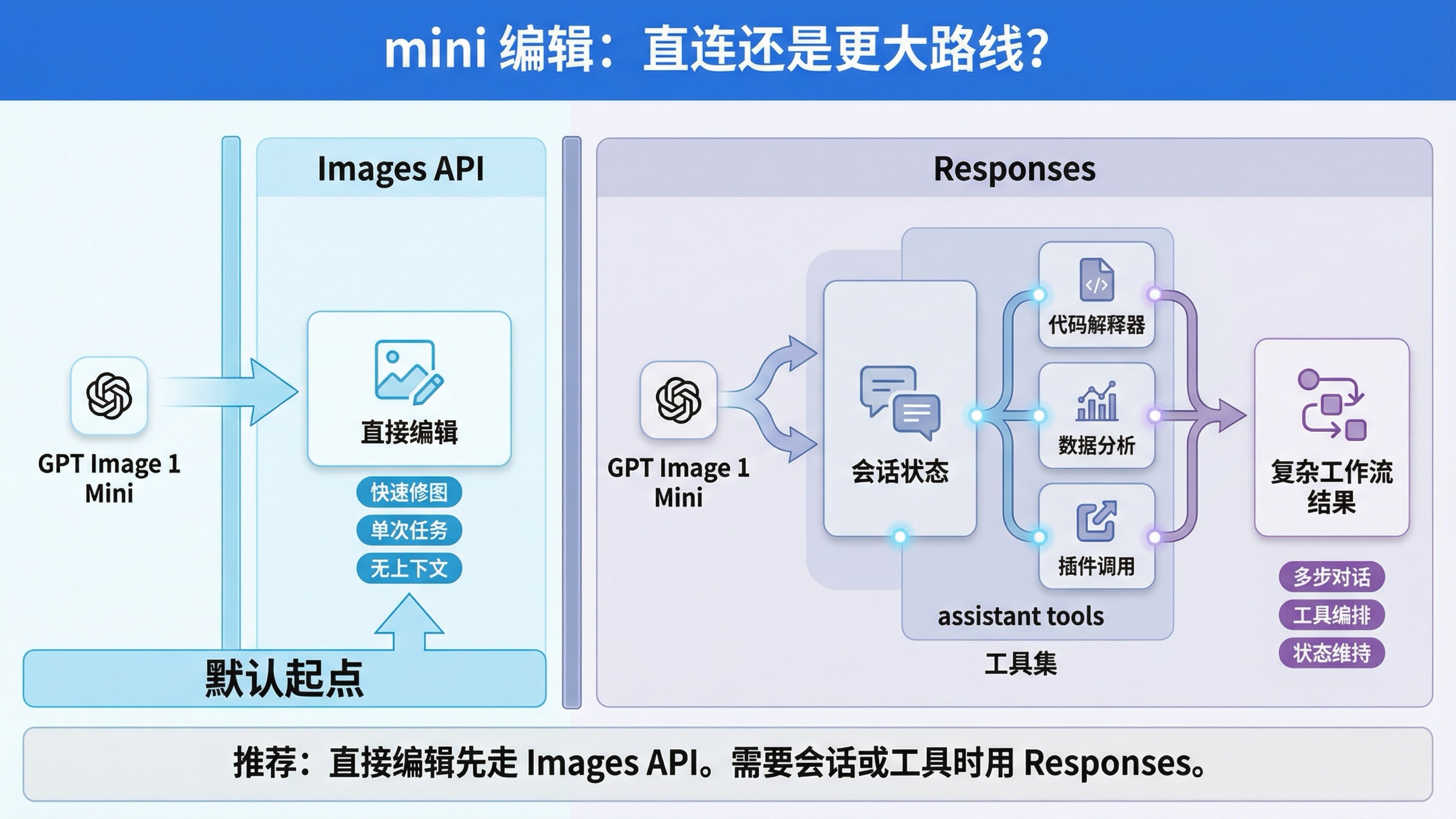

Responses 什么时候有用,为什么 mini 让这条分界更重要

Responses 当然不是不能用。问题只是:当你的完整需求就是“用 gpt-image-1-mini 改一张图”时,它通常不该是第一选择。

当前 image generation tool guide 已经把关键分界写得很清楚:在 Responses 里,top-level model 必须是文本模型,例如 gpt-4.1 或 gpt-5。GPT Image 系列不是 Responses 顶层 model 的直接替代项,图片生成只是其中的 hosted tool。换句话说,你一旦走到 Responses,选的就不再只是“mini 编辑接口”,而是一个更大的工作流抽象。

这条分界放到 mini 上会更重要,因为官方工具文档目前把 Responses 侧 action 的明确 edit 说明重点放在 gpt-image-1.5 和 chatgpt-image-latest 上,并没有把 mini 当成最清晰的 Responses edit 合约来写。我这里不是在推断“mini 永远不能在 Responses 里工作”,而是在做一个更保守也更有用的判断:如果你要的是可预测、被官方明示、最容易 debug 的 mini 编辑路径,直接 Images API 依然是更稳的合同面。

Responses 什么时候才更合理?通常是这些情况:

- 你要做多轮图像编辑,需要保存前一次 response 或 image generation call 的上下文

- 你在做一个会混合推理、工具调用和图片编辑的 assistant

- 你希望图片编辑发生在更长的对话链路里,而不是单独一个 edit 请求

- 你需要同一个 request 里由模型决定是否调用图片工具,而不是每次都手工指定 edit 流程

所以最值得记住的其实是这两句:

- “图片编辑本身就是功能”:先用

images.edit() - “图片编辑只是更大功能里的一个工具”:再看 Responses

如果你真正的问题比 edit 更大,想把整个 mini 路线图看全,后续更适合读的是 gpt-image-1-mini API 指南。这篇文章故意收窄,只聚焦 mini edit 的第一判断。

mini 上的 mask、参考图与 input_fidelity

这是整篇文章里最值得仔细读的一段,因为它正好补上了当前结果页最容易漏掉的 mini-specific 行为。

当前 image generation guide 的 edit 部分 写得很明确:图片和 mask 必须 格式一致、尺寸一致,总大小需要控制在 50 MB 内,而且 mask 要带 alpha channel。更重要的是官方的行为描述:对于 GPT Image,mask editing 依然是 prompt-based 的。也就是说,mask 会引导编辑区域,但它并不等于 Photoshop 那种像素级的硬边界约束。

这会直接改变你写 mini edit 请求的方式。你应该把 mask 当成“强引导”,而不是“完全只改这里、绝不碰别处”的机械裁切。

另一个更容易被忽略的 mini 规则来自当前 input_fidelity 文档。OpenAI 现在明确说了:当你在 gpt-image-1 或 gpt-image-1-mini 上使用高 input fidelity 时,第一张输入图会得到更强的纹理和细节保留。如果你的编辑任务里有脸、logo、产品主体、包装或其他关键视觉锚点,就应该把它放在 第一张输入图的位置。而 GPT Image 1.5 更强的地方在于:它可以更好地保留前 5 张 输入图。

这不是一个无关紧要的 SDK 参数提示,而是会改变 edit 设计方式的规则。

mini 更适合这些任务:

- 一张主图加一张小参考图

- 一张脸或一个 logo 明显应该占据第一输入位

- 一个场景里只做一类主要改动

- 低到中等风险的商品 mockup、空间改造或创意变体

而当任务长成这样时,就该更谨慎:

- 多张参考图都同样重要

- 多个品牌元素都必须尽量完整保留

- 文字排版和布局细节容错很低

- 商业价值较高,失败一次就会带来明显返工成本

最直接的实现模式仍然很简单:

jsconst result = await client.images.edit({ model: "gpt-image-1-mini", image: [ fs.createReadStream("base-scene.jpg"), fs.createReadStream("logo.png"), ], prompt: "Place the logo from image 2 onto the tote bag in image 1. Preserve the model, pose, bag shape, camera framing, and lighting.", input_fidelity: "high", });

真正决定结果的重点并不在代码语法,而在 输入顺序。在 mini 上,第一张图就是最强的保真位。

在改代码之前,先检查价格、限额与验证

很多精确匹配页面最浪费读者时间的地方,不是代码样例写错,而是没有先告诉你:这类失败经常不是代码问题。

按 2026 年 3 月 29 日当前的 gpt-image-1-mini 模型页,1024x1024 的价格仍然是 low $0.005、medium $0.011、high $0.036。同一页还写明 Free not supported,而且 mini 在 Tier 1 的起点是 100,000 TPM 与 5 IPM。

当前的 model availability 文章 说明 GPT-image-1 和 GPT-image-1-mini 对 API Tier 1 到 Tier 5 用户开放,但部分能力仍可能受 organization verification 影响。OpenAI 当前的 organization verification 帮助文档 也明确提到:验证状态同步有时要等 30 分钟,而且在组织验证完成后,重新生成 API key 往往能解决 lingering “not verified” 类报错。

所以最正确的排查顺序应该是:

- 确认 API key 归属的是正确的项目和组织

- 确认账号已经进入支持 mini 图像能力的付费 tier

- 如果仍然像是权限问题,确认 organization verification 是否才是真正阻塞点

- 给状态同步留满 30 分钟

- 如果组织已经验证,重新生成一个新的 API key

- 只有这些都确认后,才去继续重写代码

这条顺序非常重要,因为 direct mini edit 请求完全可能在语法正确的情况下失败。如果真正的问题是账号状态没有 ready,那么你把 prompt 写得更漂亮、或者把 integration 整体改写成 Responses,都不会解决根因。

如果你真正卡的是权限,而不是 edit 逻辑,本页之后更适合读的是 OpenAI 图片生成 API 验证排查。如果你卡的是预算测算,则继续看 GPT Image 1 Mini 定价 更有效。

精确关键词页面最容易漏掉的排错顺序

第一类常见错误是 一开始就站错 API 面。如果你的任务只是做一次直接编辑,就不要因为 Responses 的示例更“新”就默认把它当成更优路线。当前官方文档已经给了你先走更小抽象层的理由。

第二类常见错误是 在 Responses 里套用了错误的模型心智。GPT Image 系列并不是 Responses 顶层 model 的直接替代值;如果你走 Responses,顶层通常仍然是 gpt-4.1、gpt-5 之类的文本模型,图片能力发生在 hosted tool 里。

第三类常见错误是 把 mask 当成像素级硬边界。官方文档已经明确说 GPT Image 的 mask 编辑是 prompt 驱动的,它不承诺完全沿着 mask 边界零偏差执行。如果你的工作流要求极小局部改动、几乎零连带变化,最好尽早验证这个假设。

第四类常见错误是 把最重要的资产放错输入顺序。在 mini 上,如果脸、logo、包装或 hero product 没放在第一张输入图,你其实已经让掉了最强的保真位。

第五类常见错误是 先 debug prompt,再 debug access。如果 mini 图像权限没开通,或者 org 验证没生效,再多 prompt 微调也不会让请求突然成功。

第六类常见错误是 拿一个低成本 edit 请求去承担太复杂的任务。当前官方 limitations 说明里也提到,复杂 prompt 可能需要 最多 2 分钟,而模型在精确排版、复杂一致性和结构化构图控制上依然会遇到边界。如果你的任务同时要求品牌锁定、文字精度、多参考图一致性和商业可交付,那就应该及时怀疑“是不是模型选错了”,而不是只怀疑 prompt 不够长。

更稳的实际习惯通常是:

- 先做一次最小 direct edit

- 把最重要的输入图放在第一位

- 只有在确实需要保真时再加

input_fidelity="high" - 如果第一轮结果接近,但不够稳,把一个复杂改动拆成两轮更小的 edit

这类顺序优化,通常比继续把 prompt 写长一倍更有价值。

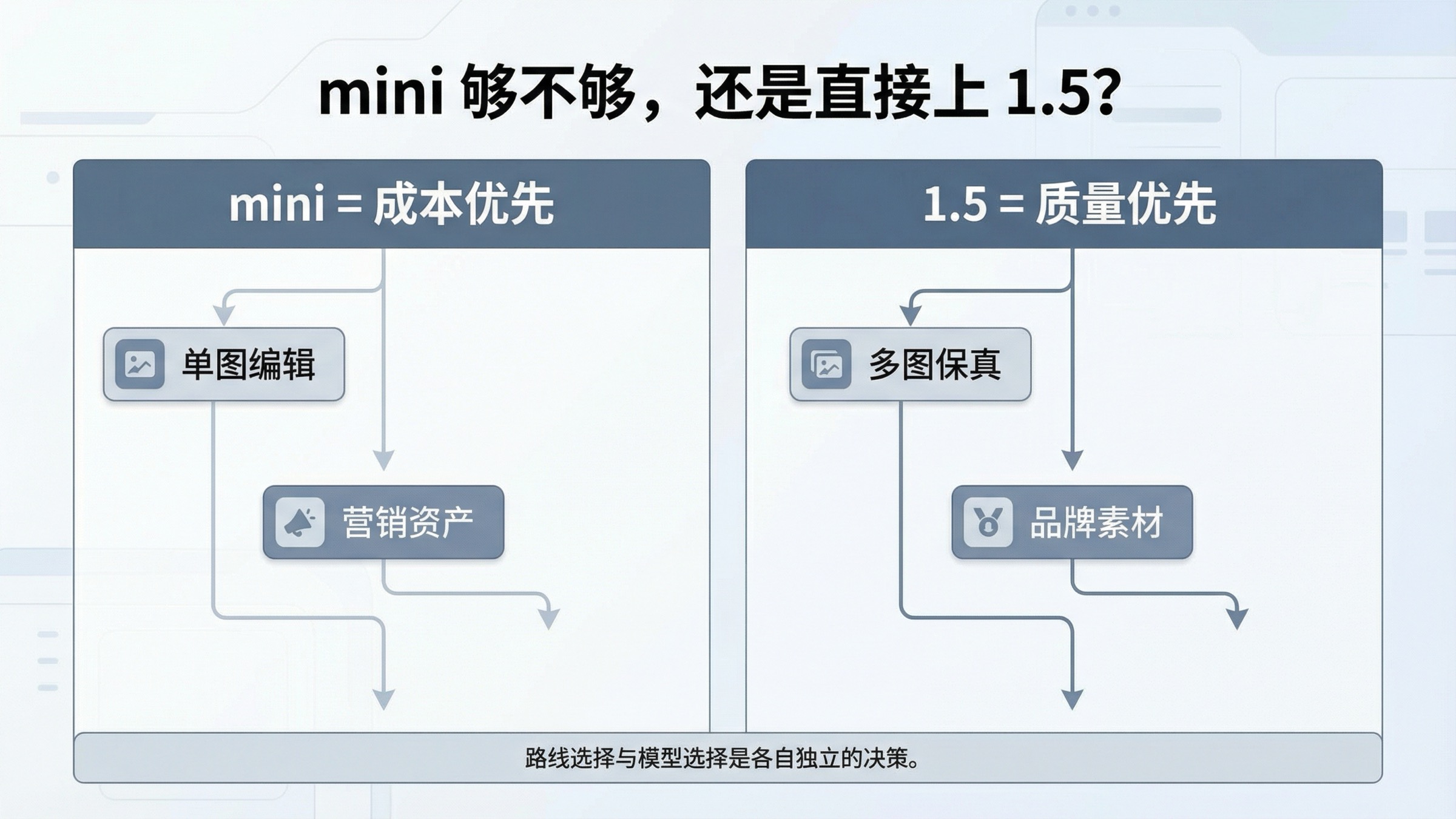

什么情况下 mini edit 已经够用,什么时候该直接上 GPT Image 1.5

这个关键词背后真正藏着的,其实不是 “mini 还是 Responses”,而是 “mini 够不够,还是我该直接上 1.5”。

当前 model comparison 部分 的官方结论很清楚:gpt-image-1.5 是最佳整体质量体验的默认路线,而 gpt-image-1-mini 是在图像质量不是首要约束时更有成本优势的选择。把这句话翻译成 edit 工作流语言,就是:

mini 通常已经够用的情况:

- 内部创意变体

- 低风险电商图或房间改造图

- 一张主图为主的产品编辑

- 先跑便宜 benchmark,再决定要不要升旗舰质量

- 成本比极致保真更重要的编辑链路

GPT Image 1.5 更稳的情况:

- 一次请求里有多张都很关键的参考图

- 对品牌元素、脸部、产品细节有更强保真要求

- 版式、文字、构图细节容错更低

- 高价值营销素材,一次失败就会带来明显返工

- 你要的是当前 OpenAI 图片编辑里的质量优先默认值

所以真正诚实的推荐不是 “mini vs Responses”,而是:direct mini edit 先走 Images API;如果工作负载本身证明 mini 不够,再直接切到 GPT Image 1.5。

如果你还想看 mini 的整体性价比判断,下一篇更适合读的是 GPT Image 1 Mini 评测。如果你要看更宽的 OpenAI image family 总路线,则去 OpenAI Image API 教程。如果你已经知道自己接下来要比较 1.5 的成本,再继续读 GPT Image 1.5 API 定价详解。

FAQ

gpt-image-1-mini 现在能直接编辑图片吗?

可以。当前官方 gpt-image-1-mini 模型页明确列出了 v1/images/edits,所以 direct Images API 本身就是 mini edit 的有效路线。

如果我只需要一次编辑,为什么不一开始就上 Responses?

因为当前 image guide 已经写明:当你只需要一个 prompt 做一次图片生成或编辑时,Image API 是更合适的默认值。Responses 的价值在于更大的会话和工具工作流,而不是替代所有 direct edit 请求。

用了 mask,就能强制模型只改 mask 区域吗?

不能。当前文档明确把 GPT Image 的 mask editing 定义为 prompt-based。mask 会引导编辑,但并不是像素级硬边界控制。

什么时候应该从 mini 直接切到 GPT Image 1.5?

当你的编辑任务更依赖多图保真、品牌元素稳定、版式与文字精度,或者失败一次就会带来较高返工成本时,1.5 往往是更稳的默认值。

最后的建议

如果你今天的精确任务就是“用 gpt-image-1-mini 编辑图片”,先走 images.edit() 或 POST /v1/images/edits。 这是当前文档里最清晰、最好 debug、也最不容易把 mini-specific 行为弄混的路线。

只有当图片编辑只是更大 assistant / multimodal workflow 里的一个步骤时,才把 Responses 当成真正合理的外层抽象。至于模型层面的第二个问题,则单独判断:如果 mini 已经不够,就不要继续在路由层打转,直接 benchmark GPT Image 1.5。