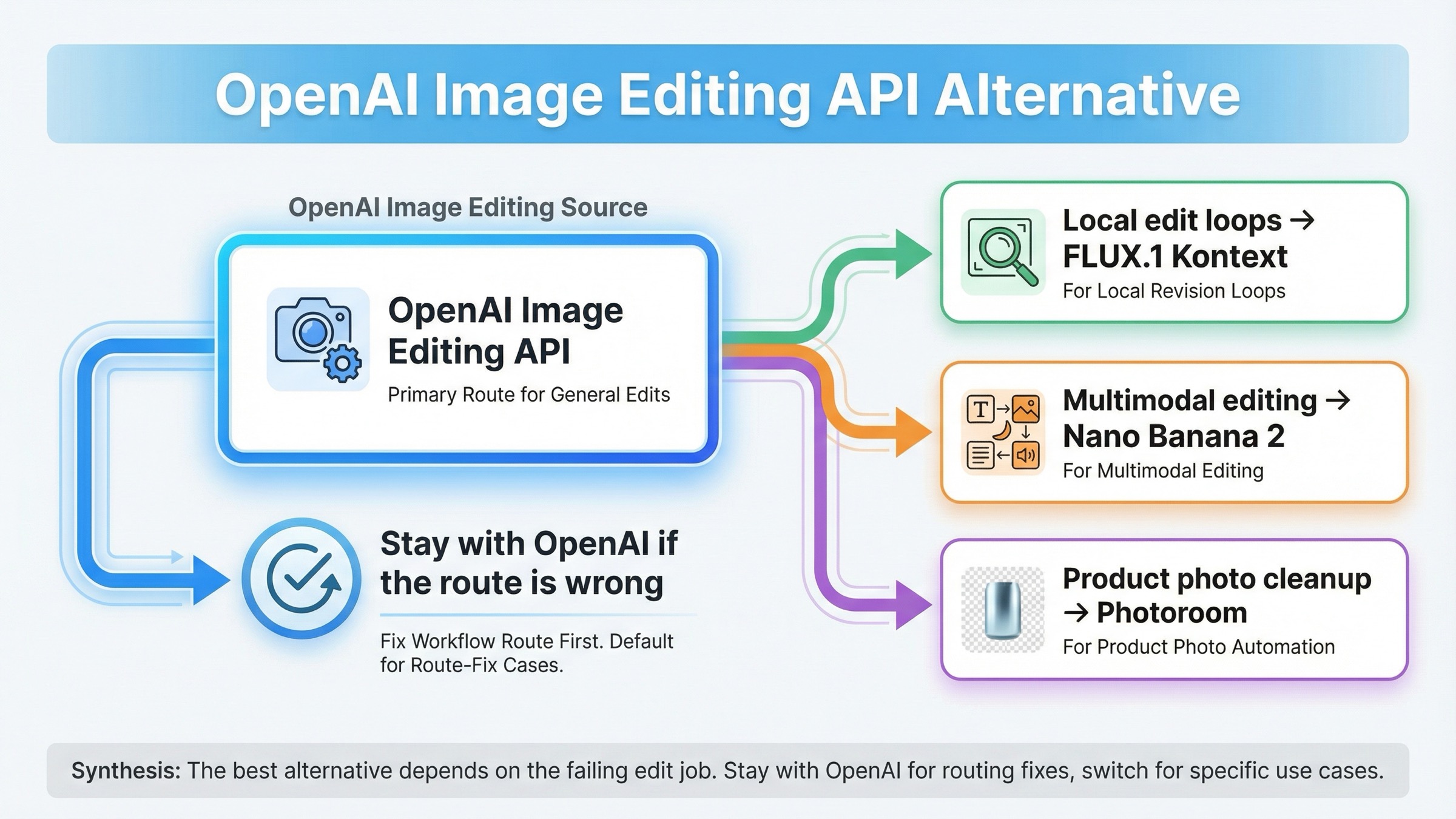

По состоянию на 27 марта 2026 года лучшая альтернатива OpenAI image editing API зависит от того, какой именно edit workflow у вас ломается. Если главная боль — локальные правки, повторяемые revision loops, drift после второй или третьей правки и потеря consistency, первым делом стоит смотреть на FLUX.1 Kontext. Если вам нужен более сильный text+image workflow, localization, text-in-image и быстрый multimodal edit loop, логичнее тестировать Nano Banana 2. Если реальная задача — product photos, background cleanup, shadows, catalog consistency и ad variants, то правильнее смотреть на Photoroom. Но если вас разочаровал только один OpenAI mask workflow, не спешите автоматически считать, что пора менять провайдера.

Именно в этом месте текущий SERP чаще всего уводит в сторону. Много страниц отвечают на такой запрос как на широкое “какие вообще есть OpenAI alternatives”, хотя реальный reader ищет более узкое решение: чем заменить OpenAI image edits именно в моей edit-heavy задаче.

Важно сразу проговорить еще одну вещь. В актуальном image generation guide OpenAI по-прежнему пишет, что Image API — это лучший default choice для одной генерации или одной edit operation из одного prompt, а Responses API нужен для conversational editable experiences. Значит, часть “alternative intent” на практике оказывается route-choice mistake. Есть и отдельная mask caveat: OpenAI все еще указывает DALL·E 2 как более дешевую inpainting-with-mask lane, но в той же документации сказано, что поддержка DALL·E 2 и DALL·E 3 закончится 12 мая 2026 года. То есть даже если mask complaint полностью реальна, это все равно не долгосрочный ответ.

Краткое содержание

- Если one-shot edits в целом вас устраивают, а проблема больше похожа на route choice, setup или слишком завышенные ожидания от soft masks, сначала оставайтесь в OpenAI.

- Если вам нужен контролируемый local edit loop и принцип “оставь почти всю картинку, измени только это место”, первым кандидатом становится FLUX.1 Kontext.

- Если workflow требует text+image reasoning, localization, readable text inside the image и последовательных multimodal revisions, смотрите на Nano Banana 2.

- Если вы живете в мире product listings, background replacement, shadows, catalog cleanup и repeatable merchandising edits, первым бенчмарком должен быть Photoroom.

- DALL·E 2 стоит рассматривать только как краткосрочную mask bridge lane: OpenAI уже опубликовал дату окончания поддержки — 12 мая 2026 года.

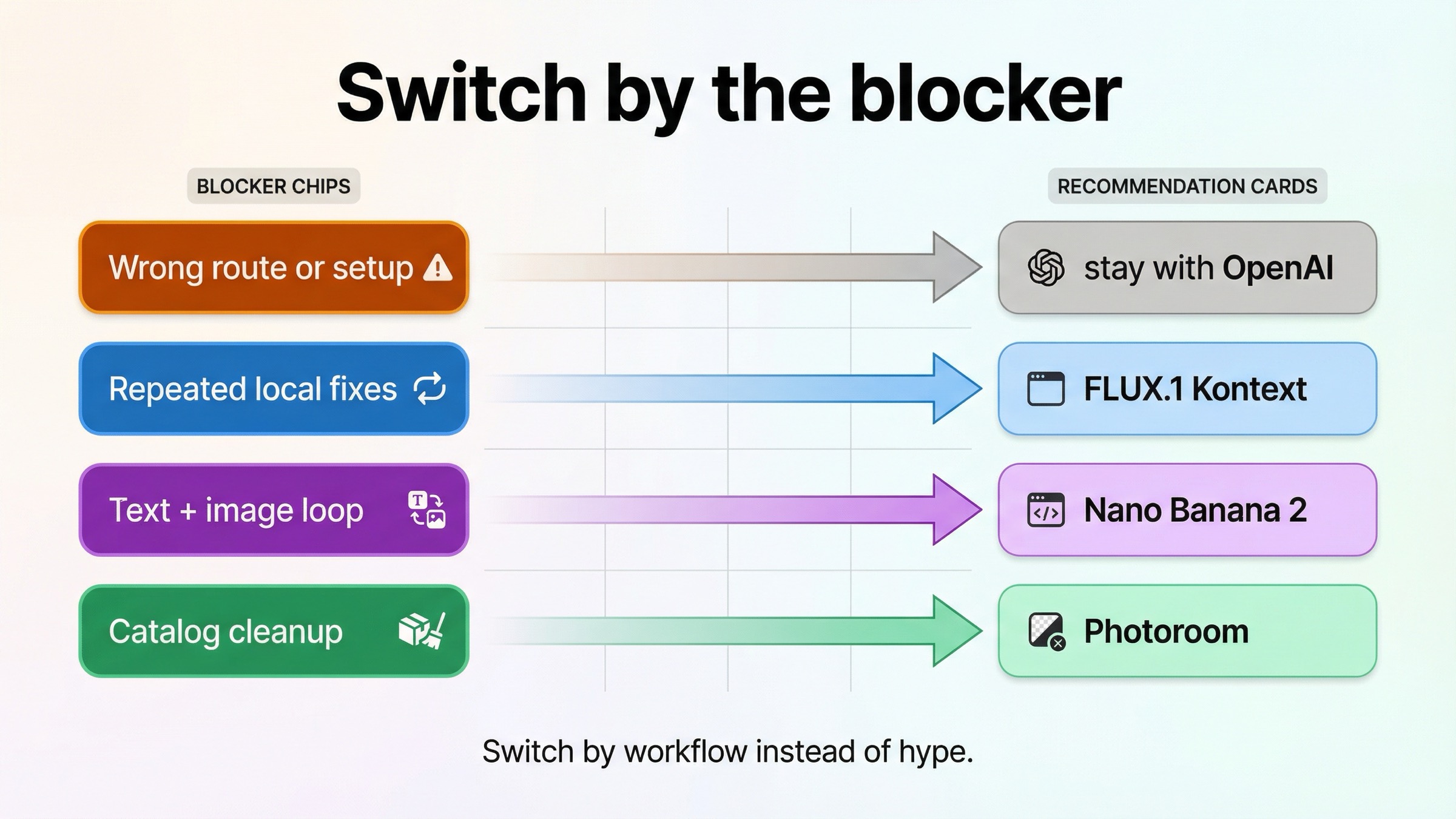

Самое быстрое правило выбора для пользователей OpenAI image editing

Если вам нужен только routing answer, начните с этой таблицы.

| Если OpenAI edits ломаются потому что... | Что выбрать | Почему это подходит | Главный tradeoff |

|---|---|---|---|

| проблема в route choice, setup или выборе не того API surface | Остаться в OpenAI | Корень проблемы может быть не в vendor, а в workflow surface | Вы все равно остаетесь внутри текущих ограничений OpenAI |

| после нескольких локальных правок картинка дрейфует и трудно сохранить исходную сцену | FLUX.1 Kontext | BFL позиционирует Kontext именно вокруг image editing, consistency и text editing | Это отдельный vendor и не низкобюджетная hosted lane |

| вам нужен text+image loop, localization, multimodal reasoning и более быстрые advanced edits | Nano Banana 2 | Google продвигает его как fast advanced editing lane внутри своего image stack | Семейство Google image models сложнее для объяснения и budgeting |

| ваша реальная задача — product photos, backgrounds, shadows, catalog cleanup и ad variants | Photoroom | Это специализированный commercial photo-editing API, а не широкая foundation-model витрина | Для open-ended creative generation это не лучший benchmark |

В этом и есть настоящая работа статьи. Она превращает расплывчатый alternatives query в четыре конкретных решения. Большинство ranking pages проигрывают именно здесь: они описывают рынок, но не дают replacement rule.

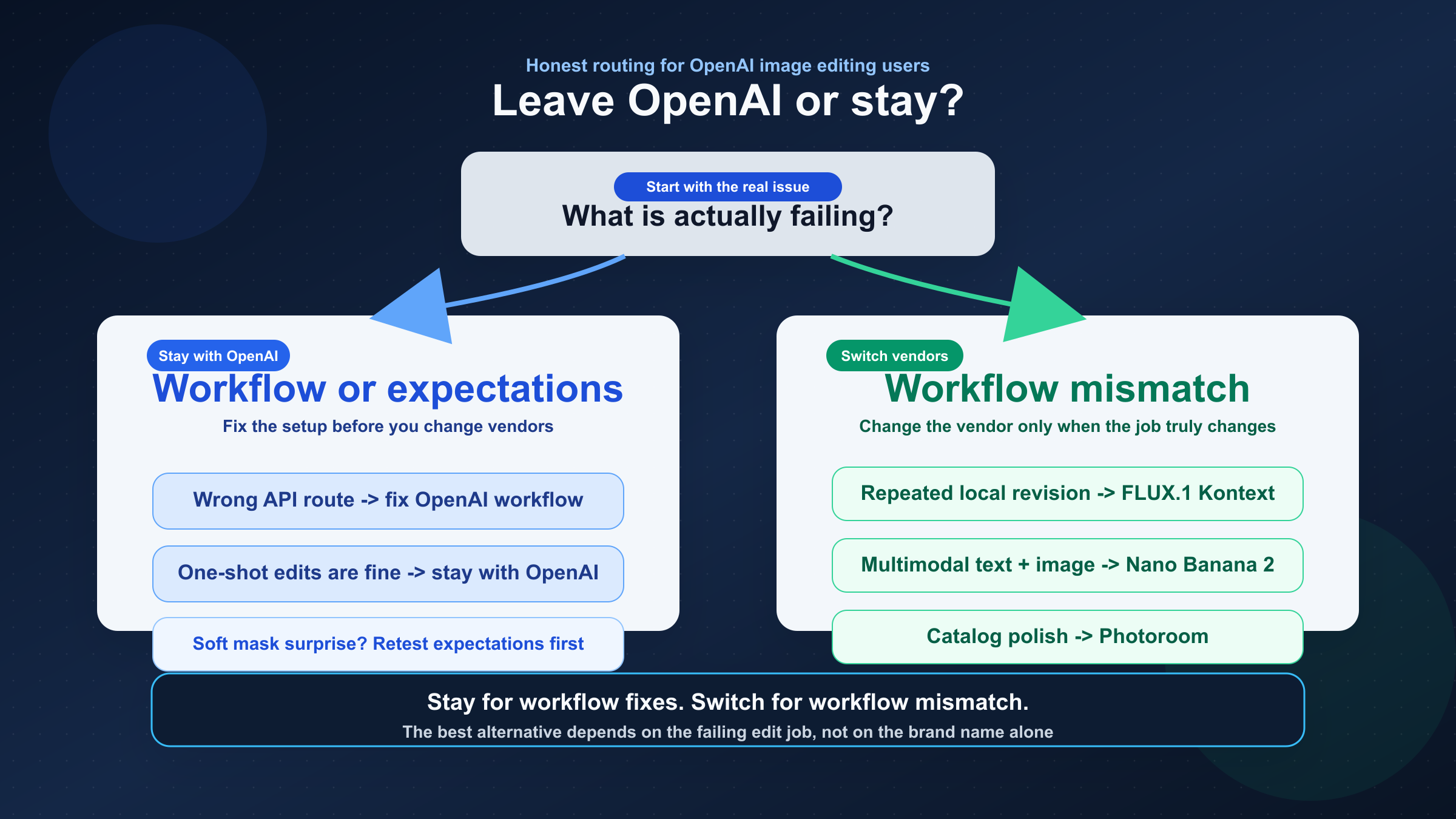

Когда OpenAI пока не стоит заменять

Некоторым reader действительно стоит уходить. Но многим не стоит покидать OpenAI, пока они не доказали, что проблема на самом деле не в текущем workflow.

Первая проверка — API surface choice. OpenAI все еще пишет, что Image API — лучший путь для одной генерации или одного edit action из одного prompt. Responses API разумнее, когда image output — только часть более длинного multimodal flow. Если вы начали не с той поверхности, смена провайдера создает ощущение прогресса, но часто оставляет ту же самую путаницу.

Вторая проверка — ожидания от masks. В нынешних GPT Image docs есть и images.edit(), и masks, и input_fidelity. Но community feedback по-прежнему достаточно согласован, чтобы его учитывать: masked edits нередко ощущаются не как строгая локальная patch replace operation, а как более глобальный semantic rewrite. Это не значит, что OpenAI image editing бесполезен. Это значит, что mask здесь все еще не равен deterministic Photoshop-style fill.

Именно поэтому важен caveat про DALL·E 2. OpenAI сам указывает его как lower-cost inpainting model для работы с mask. То есть потребность в hard-mask-style patching реальна и признана. Но в той же официальной документации OpenAI уже назвал дату конца поддержки — 12 мая 2026 года. Следовательно, правильный вывод не “значит, можно игнорировать рынок”, а “есть короткий мост, но долгосрочно нужна другая линия, если именно mask behavior для вас критичен”.

Если после этого блока вы понимаете, что проблема все-таки ближе к OpenAI route choice, чем к реальному vendor mismatch, следующие полезные материалы — OpenAI image editing API и OpenAI image generation API endpoint. Если же вы уже подтвердили, что вам нужна более широкая замена image workflow, тогда релевантнее OpenAI image generation API alternative.

FLUX.1 Kontext лучше всего подходит для локальных правок и consistency

Если ваш главный complaint звучит как “сохрани почти всю картинку, но измени вот это место”, то FLUX.1 Kontext — самый сильный альтернативный маршрут для первого теста.

Эта рекомендация не строится на hype wording. Она опирается на то, как Black Forest Labs описывает продукт официально. В Kontext overview продукт прямо позиционируется вокруг image editing, character consistency, text editing и style transformation, включая сценарии, где надо менять конкретные части изображения, сохраняя остальное. Это гораздо точнее совпадает с revision-heavy workflow, чем системы, которые в первую очередь оптимизированы под красивый first pass.

Именно здесь многие frustrations с OpenAI перестают быть prompt problem и становятся workflow-fit problem. Первая версия может выглядеть нормально, но затем:

- logo теряет fidelity после второй правки

- лицо персонажа уходит слишком далеко от исходника

- layout меняется сильнее, чем вы просили

- брендовый элемент исчезает, когда вы хотели поправить только текст

Как только этот pattern повторяется, вопрос уже не в том, “умеете ли вы писать prompt”, а в том, “подходит ли эта route для controlled revision workflow”.

Kontext особенно легко оправдать в сценариях вроде:

- сохранить subject identity, но поменять outfit

- сохранить composition, но переписать текст на вывеске

- оставить packaging shape, но заменить branding element

- переносить одного и того же character между разными сценами

Это уже не simple one-shot generation tasks. Это continuous edit tasks, и здесь Kontext ближе к реальной работе.

Есть и практический cost signal. В официальном pricing BFL сейчас пишет FLUX.1 Kontext Pro — \$0.04 за изображение, а Kontext Max — \$0.08. Это не low-cost lane, но и не абстрактный premium “за бренд”. Если команда регулярно сжигает часы оператора на cleanup после каждого edit round, nominally cheaper image API легко превращается в более дорогой workflow.

Поэтому правило здесь простое: когда работа на самом деле про local revisions и сохранение consistency, тестируйте FLUX.1 Kontext; не переключайтесь туда просто потому, что вам нужен “еще один image API”.

Nano Banana 2 лучше всего подходит для multimodal editing и localization

Если проблема не только в local patch control, а в том, что OpenAI route кажется слишком узкой для richer multimodal editing, то Google-side image stack становится заметно интереснее.

Для большинства таких переходов правильный первый тест — Nano Banana 2. Google сам пишет, что это Gemini 3.1 Flash Image, и в документации по image generation image editing показан как first-class route. Дополнительно в launch post про Nano Banana 2 акцент сделан на high-fidelity generation и faster advanced editing. Это важное отличие от OpenAI, если ваш продукт хочет объединить editing и более широкий multimodal understanding в одной системе.

Такой route особенно уместен, когда нужно:

- обновлять картинку и одновременно сохранять readable text в другом языке

- крутить один loop из text instructions, reference images и follow-up edits

- делать marketing assets с более уверенным text-in-image behavior

- опираться на более широкий semantic context в самом edit process

Это и есть та часть рынка, где Google image stack сейчас выглядит сильнее. И Google довольно четко разделяет свою линейку: одна линия оптимизирована под speed and high-volume use, другая Pro line — под professional asset production. Значит, правильный вопрос не “какой Google image model лучший вообще”, а “мне нужен fast multimodal editing lane или все-таки narrow local-edit specialist вроде Kontext?”

Для большинства switch cases разумнее начать именно с Nano Banana 2, а не сразу с самой дорогой Pro lane. Если тесты покажут, что use case требует более heavy production output, тогда уже можно подниматься выше внутри семейства.

Если после этого вам нужен более широкий Google-side context, дальше логично читать Gemini image-to-image editing и Gemini vs OpenAI image generation. Эта статья по задаче уже: она решает именно вопрос editing replacement для OpenAI.

Photoroom лучше всего подходит для product photos, backgrounds и catalog automation

Большая часть запросов вида OpenAI image editing API alternative на деле не про foundation-model switch. Она про commercial photo-editing workflow.

Именно здесь правильным ответом часто становится Photoroom.

У Photoroom unusually clear positioning. В API documentation и на Image Editing API page они прямо говорят о subject separation, background replacement, relighting, realistic shadows, new backgrounds, listings, ads и consistent catalog output. Это совсем другой benchmark по сравнению с OpenAI или FLUX Kontext.

Если бизнес metric у вас ближе к таким задачам:

- cleaner product cutouts

- uniform white or brand backgrounds

- faster marketplace listings

- scalable ad variants from one product asset

- repeatable catalog polish

тогда сравнивать нужно не “какой foundation model умнее”, а “какой API лучше автоматизирует именно этот narrow commercial editing job”.

Именно здесь многие alternative pages теряют credibility. Они продолжают сравнивать base models, хотя reader на самом деле нужен e-commerce image pipeline. Это звучит умно, но часто просто тратит время. Специализированный editing API легко может оказаться полезнее более сильной general model, если ваши требования уже и повторяемее.

Поэтому и правило получается жестким, но честным: если ваша работа — это listings, catalog cleanup и merchandising edits, сначала benchmark Photoroom, а уже потом сравнивайте другие foundation models.

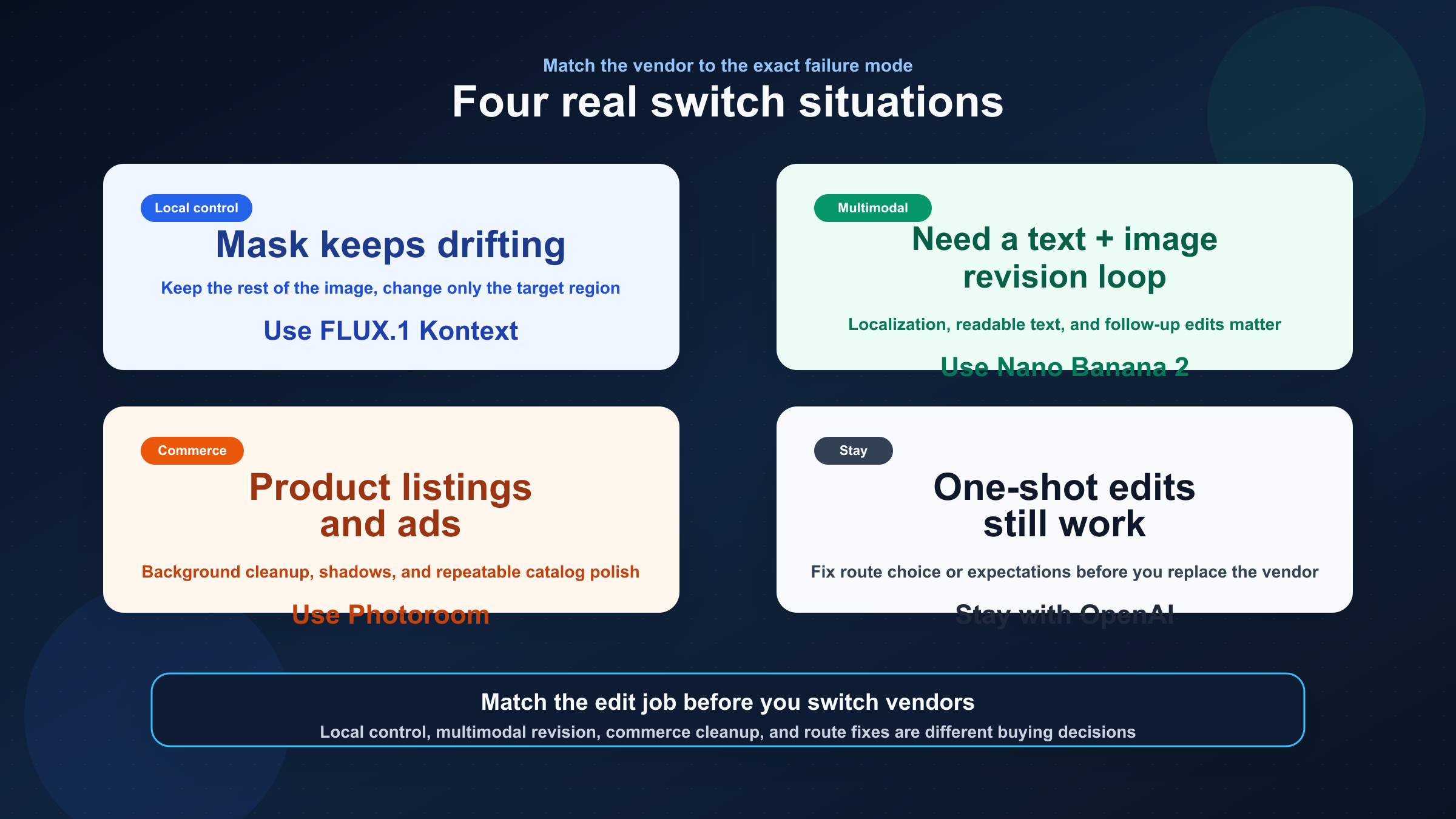

Что бы я выбрал в четырех реальных ситуациях

Если бы мне нужно было принять решение сегодня, я бы опирался на такие правила.

1. Mask edits постоянно меняют слишком много, а мне нужны повторяемые локальные исправления.

Я бы начал с FLUX.1 Kontext. Это лучший первый ход, когда работа по сути стала controlled local revision.

2. Мне нужна система, которая понимает текст и изображение вместе, а потом быстро продолжает правки.

Я бы начал с Nano Banana 2. Это правильнее, когда pain point уходит за пределы masks и превращается в multimodal editing loop.

3. Я работаю с product photos, catalogs или ads и мне важнее commercial polish, чем open-ended creativity.

Я бы начал с Photoroom. Это specialist workflow, а specialist workflows заслуживают specialist APIs.

4. Мои one-shot OpenAI edits в целом работают, но workflow все еще кажется неудобным.

Я бы сначала остался в OpenAI. Нужно еще раз проверить Images API vs Responses API и понять, не в soft-mask expectations ли корень проблемы. Если вам нужен именно hard-mask inpainting, смотрите на DALL·E 2 только как на короткий bridge.

Именно эти четыре ситуации и есть реальная buying logic внутри запроса. И именно поэтому такая статья может быть полезнее текущего SERP average: большинство ranking pages отвечают на рынок, а не на failure mode.

FAQ

Какая альтернатива лучше всего подходит для mask-heavy editing?

Если реальная задача — повторяемый local control, первым тестом должен быть FLUX.1 Kontext. OpenAI все еще указывает DALL·E 2 как mask bridge lane, но это short-term path: официальная дата конца поддержки — 12 мая 2026 года.

Стоит ли уходить из OpenAI только потому, что masks ощущаются слишком “глобальными”?

Не сразу. Сначала подтвердите, что вы вообще используете правильный OpenAI surface и что ваш use case не остается one-shot edit task с неверными ожиданиями. Переключение оправдано тогда, когда workflow системно требует local revision, multimodal editing или specialist commercial cleanup.

Что лучше для e-commerce workflow: Nano Banana 2 или Photoroom?

Выбирайте Nano Banana 2, если workflow смешивает reasoning, text, localization и broader creative edits. Выбирайте Photoroom, если главное — product cleanup, backgrounds, shadows, listings и repeatable catalog output.

FLUX.1 Kontext обязательно дешевле OpenAI?

Нет. Price alone здесь плохой критерий. Сейчас BFL пишет Kontext Pro — \$0.04, Kontext Max — \$0.08 за изображение. Сравнивать нужно не только unit price, но и то, уменьшает ли route число неудачных edit rounds и ручной cleanup.

Вывод

Лучшая альтернатива OpenAI image editing API — это не один универсальный model name, а та route, которая соответствует вашему сломанному edit job.

Если проблема в локальных повторяемых правках и consistency, смотрите на FLUX.1 Kontext. Если проблема в multimodal editing, text rendering и localization, смотрите на Nano Banana 2. Если проблема в product photos, backgrounds и catalog automation, смотрите на Photoroom. Если проблема на самом деле в route choice или soft-mask expectations, сначала оставайтесь в OpenAI и исправьте workflow, а уже потом решайте, нужен ли вам реальный vendor switch.