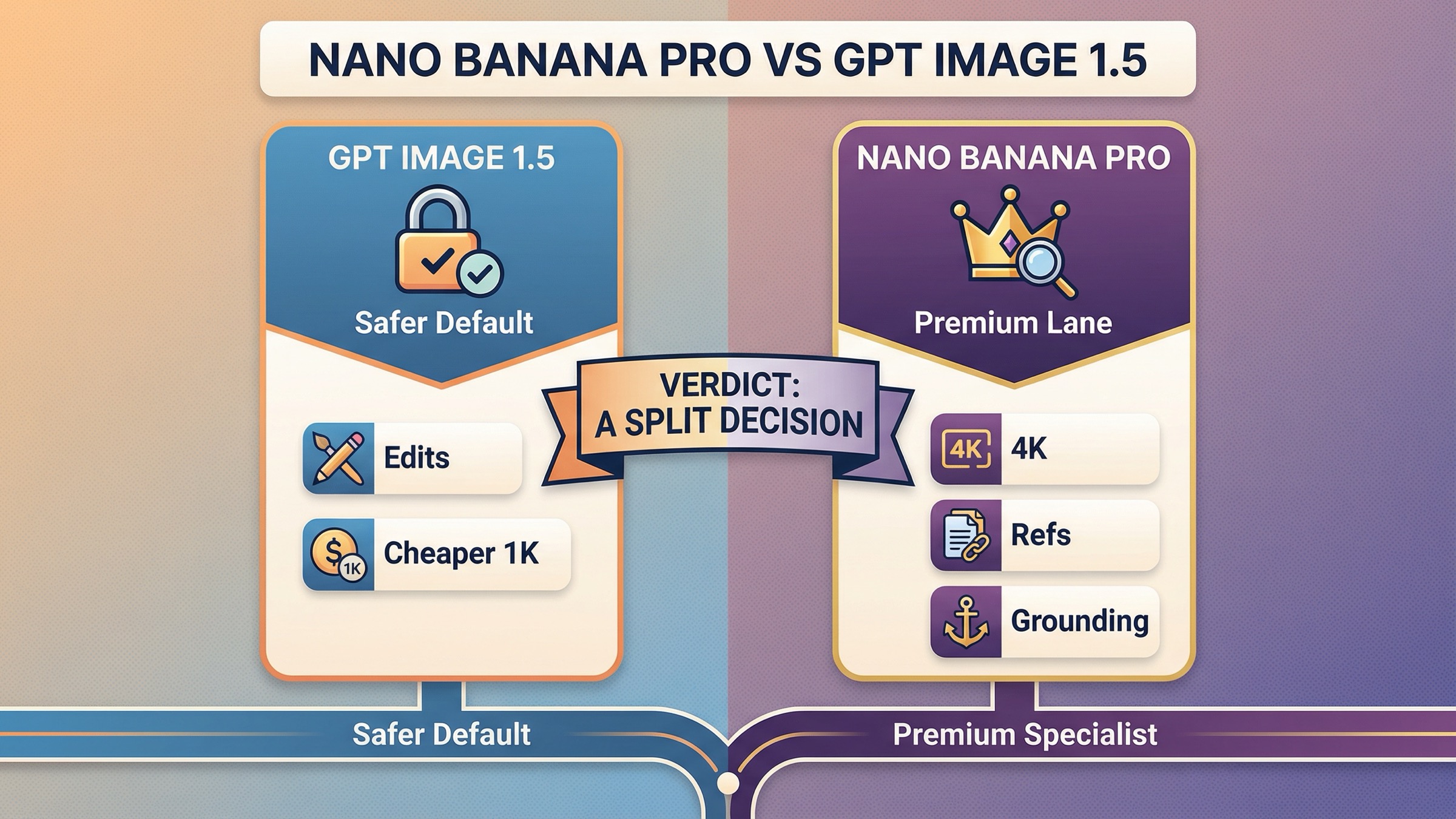

Если ваш workflow в основном про правки, прозрачный фон и более дешевое производство в 1K, начинайте с GPT Image 1.5. Если же работа реально упирается в 2K/4K, Google Search grounding или heavy reference-image generation, тогда уже имеет смысл брать Nano Banana Pro.

Это и есть практический ответ, который большинство страниц в выдаче до сих пор прячет за бессмысленным поиском "общего победителя". В реальном продакшне важен не вопрос "кто рисует красивее вообще", а вопрос какой путь создаст меньше повторных прогонов, меньше путаницы и меньше операционного трения именно под ваш тип задач. У OpenAI сегодня сильнее продуктовая ясность: страница GPT Image 1.5 собирает в одном месте цену за изображение, tier rate limits и сам image workflow. У Google, наоборот, сильнее premium-часть истории: image generation guide прямо выводит 2K/4K, grounding и более тяжелые reference-driven сценарии.

Но самый важный caveat нужно вынести наверх. То, что рынок называет Nano Banana Pro, в актуальных Google docs соответствует gemini-3-pro-image-preview. То есть модель всё еще Preview. Текущая страница rate limits отдельно говорит, что активные лимиты нужно смотреть в AI Studio и что preview-модели могут иметь более жесткие ограничения. Это не делает Nano Banana Pro плохим выбором. Это просто означает, что вы сравниваете не два одинаково стабильных продукта, а stable-looking default против более сильной, но более volatile premium-линии.

Краткое содержание

| Ваш приоритет | Что брать | Почему | Главный caveat |

|---|---|---|---|

| Самый дешевый официальный 1K | GPT Image 1.5 | На текущей странице OpenAI указаны $0.009, $0.034 и $0.133 для square 1024x1024. | Это все еще не public 4K ladder. |

| Прозрачный фон и cutout assets | GPT Image 1.5 | OpenAI прямо документирует transparent backgrounds в текущем image guide. | Для production quality обычно нужен не самый дешевый tier. |

| Высокоточные правки существующих asset'ов | GPT Image 1.5 | OpenAI документирует multi-turn editing и более высокую fidelity для первых 5 input images. | Layout-sensitive edits все равно могут дрейфовать. |

| 2K или 4K output | Nano Banana Pro | Google текущим guide прямо позиционирует Gemini 3 image models для 1K / 2K / 4K. | Это preview-модель, а значит меньше operational certainty. |

| Heavy reference-image generation | Nano Banana Pro | Google пишет про до 14 reference images. | Product surface заметно сложнее, чем у OpenAI. |

| Search-grounded generation | Nano Banana Pro | В текущем image workflow есть Google Search grounding. | Это важно только для части use cases. |

| Прозрачные public rate limits | GPT Image 1.5 | OpenAI публикует image-per-minute tiers от 5 IPM до 250 IPM. | Лимиты зависят от tier, а не универсальны. |

| Один безопасный default для mixed team | GPT Image 1.5 | Правки, прозрачный фон и более чистая операционная история встречаются чаще, чем 4K. | Командам с high-resolution и grounding still стоит добавлять Nano Banana Pro как вторую линию. |

Самая честная короткая формула выглядит так: GPT Image 1.5 — более безопасный default, Nano Banana Pro — более сильный specialist. Если нужно, чтобы одна модель уверенно закрывала правки, packaging, cutouts, social assets и обычный production art, разумнее стартовать с OpenAI. Если же задача изначально требует более высокого разрешения, grounding или больших reference sets, тогда Google premium lane начинает оправдывать свою цену.

Почему эта сравнительная тема до сих пор сбивает с толку

Главная проблема не в том, что обе модели слишком сложные. Проблема в том, что рынок и поисковая выдача до сих пор смешивают названия, таймлайн и product surfaces.

С GPT Image 1.5 всё относительно чисто. OpenAI использует это имя в model page, в image generation guide и в релизном посте от 16 декабря 2025 года. То, что вы видите в pricing, rate limits и edit-oriented workflow, складывается в одну понятную линию.

С Nano Banana Pro всё заметно грязнее. В актуальных docs Google эта линия называется Gemini 3 Pro Image Preview, а страница моделей прямо маркирует её как Preview. Большая часть ranking pages эту связку не объясняет. Они просто называют модель Nano Banana Pro и ведут себя так, будто перед нами такой же стабильный официальный product name, как GPT Image 1.5. Именно здесь пользователи и начинают путаться: какую модель они реально вызывают, насколько она стабильна и почему implementation experience может не совпасть с тем, что им обещала comparison article.

Таймлайн тоже важен. Google в changelog показывает релиз Gemini 3 Pro Image Preview на 20 ноября 2025 года. OpenAI вывел новый ChatGPT Images опыт и API-модель GPT Image 1.5 16 декабря 2025 года. Потом Google еще добавил Nano Banana 2 как более новую Flash image line 26 февраля 2026 года. В итоге многие старые статьи сегодня смешивают сразу три разные истории:

- GPT Image 1.5 как текущую OpenAI flagship line

- Nano Banana Pro как Google premium image lane

- Nano Banana 2 как более новую Flash line

Эта статья специально уже. Она отвечает только на Nano Banana Pro vs GPT Image 1.5. Не на весь Google image stack и не на вопрос, что удобнее в consumer apps. Только такой узкий фрейм позволяет снова сделать сравнение полезным.

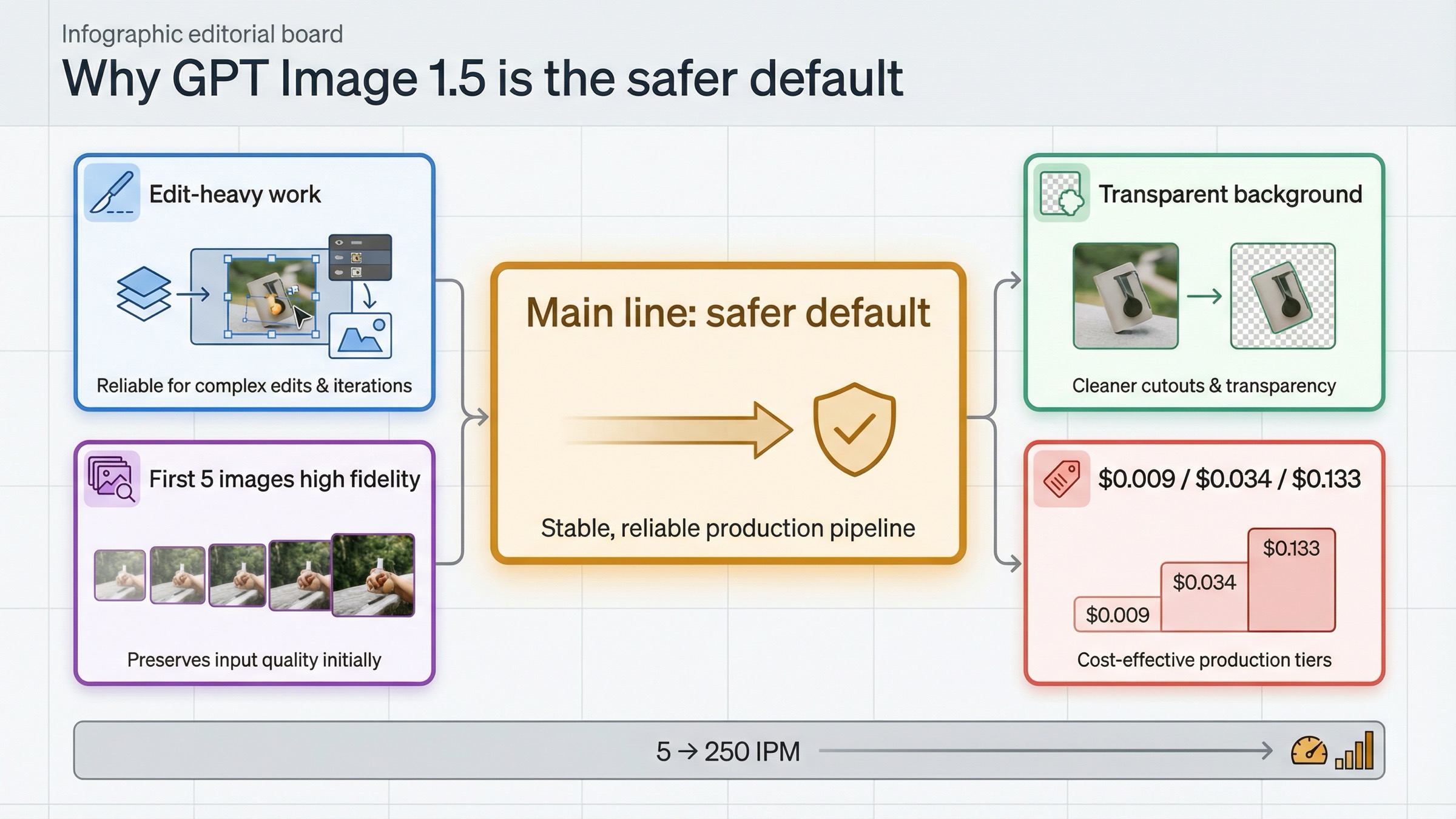

Почему GPT Image 1.5 остается более безопасным выбором по умолчанию для правок, прозрачного фона и более дешевого 1K

Главный аргумент в пользу GPT Image 1.5 — не абстрактное "качество картинки". Его сила в workflow control.

Текущий image generation guide у OpenAI документирует именно те вещи, которые командам постоянно нужны в продакшне: transparent backgrounds, multi-turn editing и input_fidelity, позволяющий лучше удерживать детали входных изображений. Там же сказано, что первые 5 input images могут сохраняться с более высокой fidelity при input_fidelity=high. Для edit-heavy pipeline это очень значимо. Потому что реальная задача часто звучит не как "сделай красивое изображение", а как "измени этот existing asset, не сломав logo, label, лицо, упаковку или композицию".

Это и есть причина, по которой OpenAI сейчас легче становится командным default. Вам не нужно переводить одно имя в другое, собирать pricing из одной страницы, rate limits из другой, edit route из третьей и надеяться, что всё это относится к одному и тому же surface. Страница GPT Image 1.5 уже даёт snapshot, public pricing и tier limits в одном месте. Для product owner'ов и engineering-команд это не мелочь, а реальная экономия времени на стандартизации.

Цена усиливает этот default-case. По повторной проверке на 27 марта 2026 года, square-output pricing у OpenAI выглядит так: $0.009 за low, $0.034 за medium и $0.133 за high на 1024x1024. И это важно не потому, что дешевле всегда лучше, а потому что огромная доля реальной работы всё еще ближе к 1K, чем к 4K. Social creatives, product cutouts, packaging concepts, UI-ish visuals, ad iterations и обычные marketing assets чаще выигрывают от дешевого и понятного official 1K pricing, чем от потенциальной возможности уйти в более крупный размер.

Конечно, это не означает, что у GPT Image 1.5 нет ограничений. Тот же guide предупреждает о сложностях с precise text placement, consistency across generations и layout-sensitive compositions. А launch post отдельно упоминает, что multilingual performance всё еще не идеальна. Поэтому правильный вывод звучит не как "OpenAI всегда выигрывает текст". Правильнее так: GPT Image 1.5 выигрывает тогда, когда важнее сохранить и править конкретные assets, чем строить более крупную, более конфигурируемую generation system.

Если вам нужна более узкая статья не про выбор модели, а про сами edit flows, ближайшее продолжение в этом репозитории — OpenAI image editing API. Там глубже разобран preservation-heavy editing. Здесь мы держим фокус на routing decision между двумя моделями.

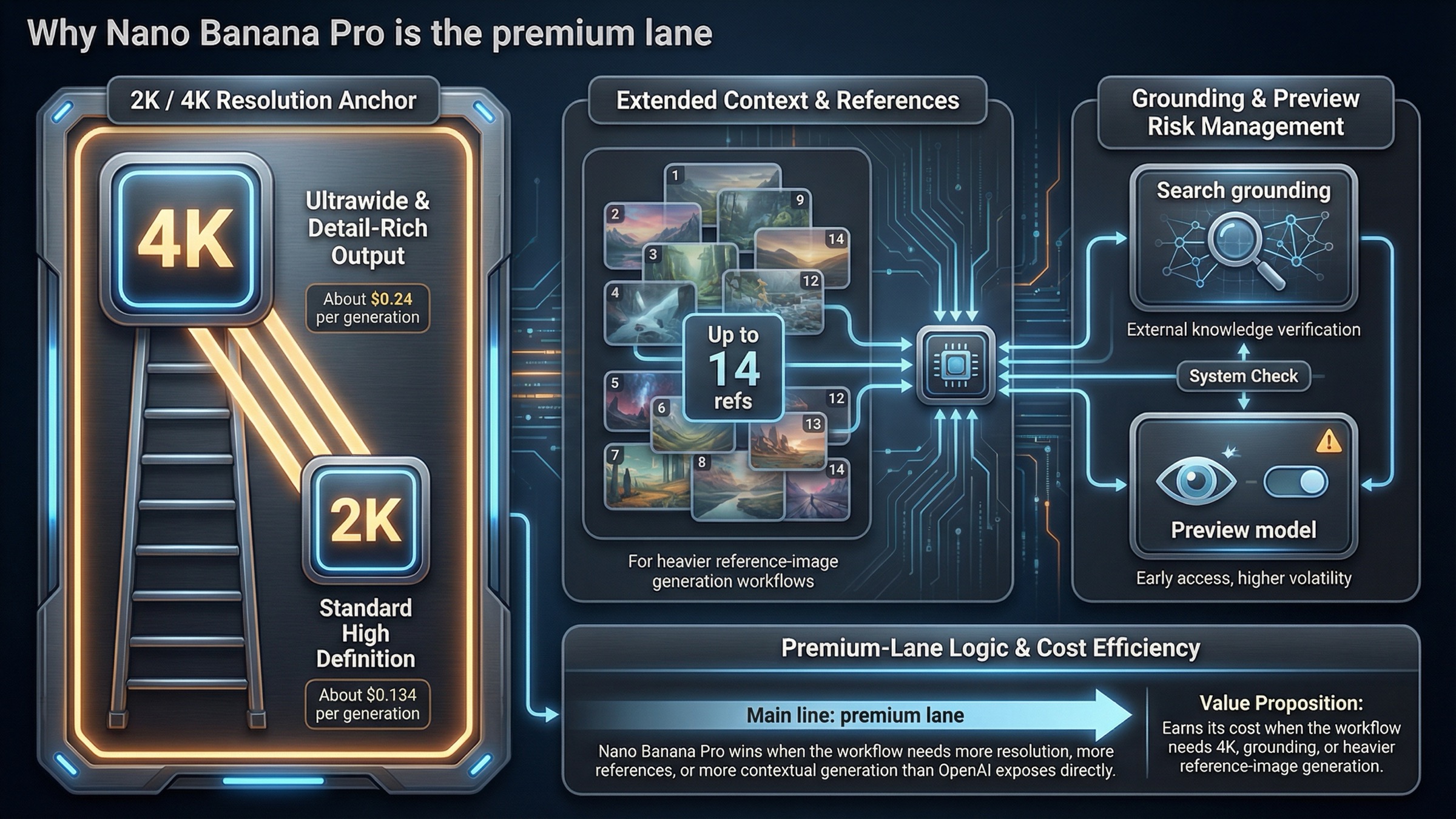

Почему Nano Banana Pro сильнее там, где нужны 2K/4K, grounding и более тяжелая reference-driven генерация

Nano Banana Pro оправдывает свою premium-позицию не тем, что "рисует лучше вообще", а тем, что открывает workflow shape, который OpenAI сегодня не зеркалит настолько прямо.

Текущий Gemini image generation guide у Google прямо выводит Gemini 3 image models на 1K, 2K и 4K. Одно это уже меняет покупательское решение. Если задача — не обычный 1024 draft, а large-format ad, poster, signage concept, инфографика или любой asset, где запас под crop и итоговый размер входят в deliverable, Nano Banana Pro уже не выглядит роскошью. Он начинает выглядеть как инструмент под задачу.

Второе преимущество — масштаб reference images. Google говорит о support до 14 reference images, плюс отдельно описывает лимиты для object и character consistency. У OpenAI тоже есть multi-image editing и сильный input_fidelity, но это всё же другой posture. Если workflow больше похож на brand-guided scene building, controlled concept generation и работу с большими reference packs, Nano Banana Pro предлагает более generation-first набор возможностей.

Третья разница — grounding. Google добавляет Google Search grounding прямо в image workflow. Это не универсально нужная функция. Но если система должна генерировать information-heavy visuals, search-informed explainers или изображения, где актуальность фактов реально влияет на результат, grounding перестает быть красивым бонусом и становится категорией workflow.

То, как Google позиционирует модель на models page, тоже показательно. Там речь идёт о professional design engine, reasoning core, studio-quality 4K, complex layouts и precise text rendering. Это важно не как маркетинговая фраза, а как сигнал: Google продаёт не просто "картинки получше", а модель для более сложных image jobs.

Но caveat нельзя ослаблять. Nano Banana Pro всё ещё preview. Публичная страница rate limits отправляет вас смотреть активные лимиты в AI Studio и отдельно напоминает, что preview models могут быть более restrictive. Значит, оптимальный reading такой: Nano Banana Pro — сильный ответ для workflow, которые действительно требуют 4K, grounding и heavy reference-image generation, а не безусловный replacement для safest default.

Если нужен более узкий разбор именно high-resolution части, здесь логичное продолжение — Gemini image generation 4K output. Эта статья остаётся только на уровне cross-vendor decision.

Ценовая и throughput-логика, которая реально меняет выбор

Самая частая и самая нечестная ошибка в этом SERP — поставить рядом одну цифру OpenAI и одну цифру Google так, будто они обозначают одну и ту же нагрузку.

У OpenAI pricing считать легко, потому что страница GPT Image 1.5 публикует цены напрямую. У Google история менее чистая: релевантный pricing block Gemini 3 Pro Image Preview в этом окружении не открылся полноценно, поэтому цену Google здесь приходится честно маркировать как fallback-verified fact, а не выдавать за line-by-line чтение официальной страницы. Тем не менее, текущая public pricing surface указывает примерно $0.134 за 1K / 2K и $0.24 за 4K, при более низком batch pricing по состоянию на 27 марта 2026 года.

Именно поэтому правильная таблица выглядит так:

| Ветка решения | GPT Image 1.5 | Nano Banana Pro | Более естественный default |

|---|---|---|---|

| Самый дешевый официальный square output | $0.009 low или $0.034 medium при 1024x1024 | Premium line, около $0.134 даже до 4K | GPT Image 1.5 |

| Более качественный 1K, где важны правки | $0.133 high при 1024x1024 | Около $0.134 за 1K / 2K | Нужно смотреть на workflow, а не на headline price |

| Настоящий 2K или 4K production | Public 2K/4K ladder на странице GPT Image 1.5 нет | Около $0.134 на 2K и $0.24 на 4K | Nano Banana Pro |

| Прозрачность rate-limit story | OpenAI публикует 5 IPM до 250 IPM | Google отправляет в AI Studio и отдельно предупреждает про preview limits | GPT Image 1.5 |

Вот почему один "победитель" здесь не работает. Если ваши output'ы — в основном standard-resolution assets, а редактирование и прозрачность операционной истории для вас важнее, OpenAI действительно выглядит чище. Если же job definition меняется и вы начинаете считать 2K/4K, grounding и большие reference budgets частью нормальной задачи, pricing у Google уже начинает выглядеть не как "дороже", а как цена за другой класс инструмента.

Именно здесь многие comparison pages и теряют доверие. Они приводят одну цену для Google, одну для OpenAI и не объясняют, official ли это pricing, relay pricing или app-subscription economics. Для high-intent reader это слишком заметная дыра.

Если хочется глубже уйти именно в cost math, ближайшие companion pages в этом репозитории — GPT Image 1.5 cost per image и Gemini image API vs OpenAI image API. Здесь достаточно удержать только те цифры, которые реально меняют выбор модели.

Preview risk, naming confusion и workflow friction важнее, чем признаёт большинство comparison pages

Это та часть темы, которую многие ranking pages подают как необязательное дополнение. На практике она не необязательная.

У OpenAI operational story заметно чище. Страница GPT Image 1.5 в одном месте показывает snapshot, pricing, limits и endpoints. Это не значит, что никаких ограничений нет. В guide OpenAI всё равно пишет, что для GPT Image models может требоваться organization verification. Но публичная документация по-прежнему даёт более ясный ответ на вопрос "что именно я покупаю и как это бюджетировать".

У Google capability story у Nano Banana Pro сильный, но operational story менее аккуратный. Модель остаётся preview. Публичная страница rate limits отправляет вас смотреть active limits в AI Studio. И friction здесь не абстрактный. Пользователи уже жаловались, например, что 2K output игнорируется в некоторых image-to-image сценариях — такие сообщения есть на Google AI Developers Forum. Это не приговор модели. Это просто напоминание: premium capability story нужно читать вместе с preview reality.

Naming layer только усиливает путаницу. Пользователь, который вводит "Nano Banana Pro vs GPT Image 1.5", часто смешивает в голове сразу три разных слоя:

- официальные Gemini model IDs

- рыночное shorthand-имя Nano Banana Pro

- названия от third-party wrappers и relay platforms

Именно поэтому одна из лучших возможностей для этой страницы — просто не замыливать имена. Иногда этого уже достаточно, чтобы выглядеть сильнее среднего результата на page one.

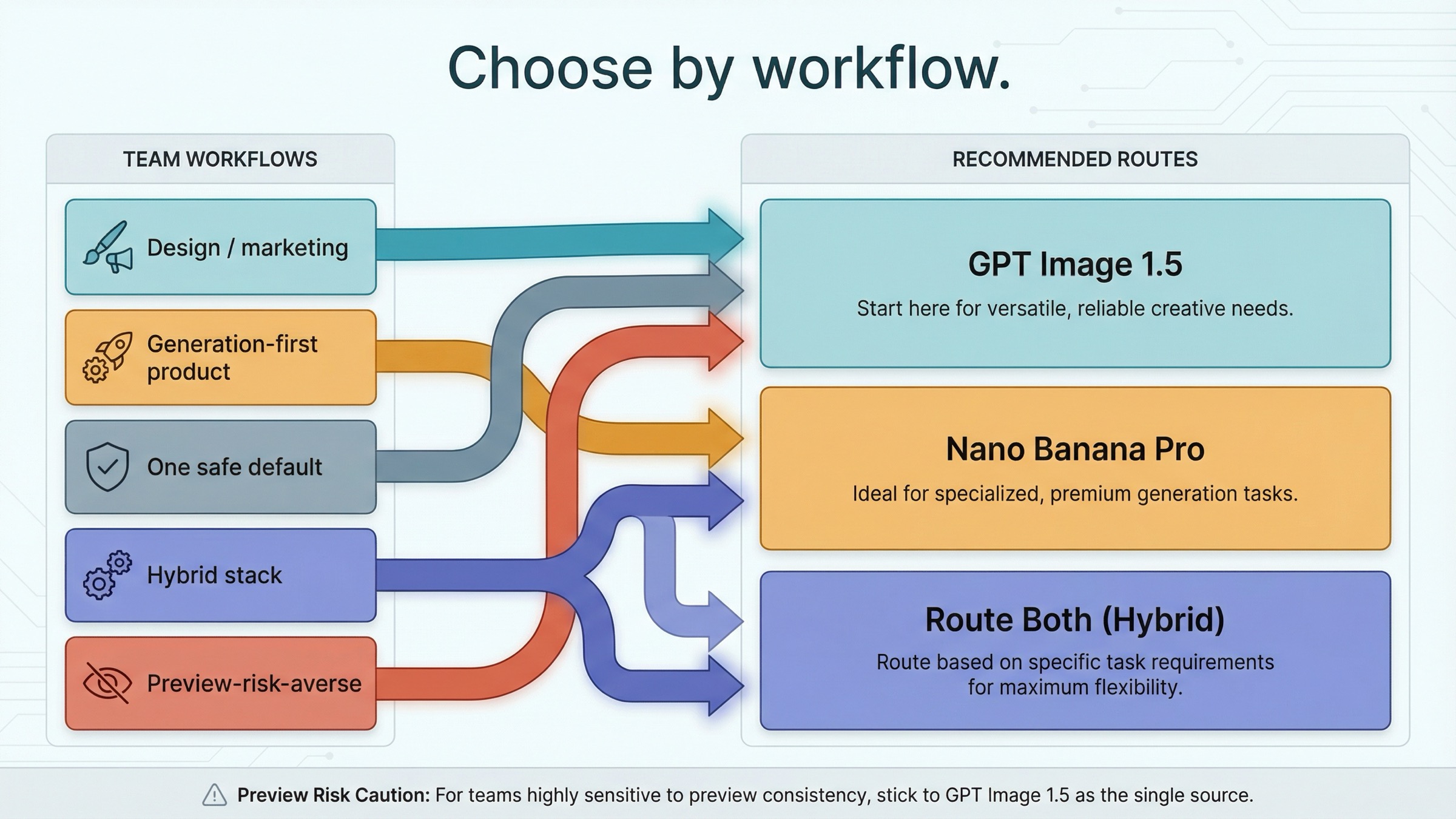

Какой вариант я бы выбрал для каждого реального workflow

Если бы мне пришлось принимать решение сегодня, я бы не пытался насильно стандартизировать один ответ для всех команд.

Для design или marketing-команды, которая постоянно правит existing assets, я бы начал с GPT Image 1.5. Transparent background, high-fidelity edits и более прозрачная official pricing / limits story обычно важнее, чем 4K само по себе.

Для product-команды, строящей generation-first visual system, я бы сначала тестировал Nano Banana Pro, если 2K/4K, grounding и большие reference sets — это не редкий edge case, а ядро продукта.

Для небольшой команды, которой нужен один безопасный default, я бы всё еще выбрал GPT Image 1.5. Он проще объясняется внутри компании, легче считается и требует меньше product-translation между названием, ценой и documentation surface.

Для гибридного стека я бы вообще не искал одного победителя. Edit-heavy, transparent-background и asset-preservation jobs я бы маршрутизировал в GPT Image 1.5. Premium generation, larger-format outputs и reference-heavy workflows — в Nano Banana Pro.

Для команды, которая не любит preview risk, я бы относился к Nano Banana Pro заметно осторожнее. Если выгода от 2K/4K, grounding и heavier references неочевидна, не стоит делать его single default source.

Такой routing сильнее, чем beauty-contest verdict, потому что именно так решения и принимаются в реальном production environment.

FAQ

Nano Banana Pro — это официальный Google model name или просто рыночный nickname?

В текущих Google docs ему соответствует Gemini 3 Pro Image Preview. Nickname широко используется в search и community, но для implementation всё равно важны официальный model ID и preview status.

Поддерживает ли GPT Image 1.5 настоящий 4K output?

Не на текущей public странице GPT Image 1.5. OpenAI публикует size ladder до 1536x1024 или 1024x1536, тогда как актуальный Gemini image guide у Google прямо говорит про 1K / 2K / 4K на стороне Gemini 3 image models.

Что лучше для текста внутри изображений?

Самый безопасный ответ здесь уже, чем любят писать comparison pages. Если задача edit-heavy и связана с сохранением existing asset'ов, GPT Image 1.5 — более безопасный default. Но если вместе с этим критичны большой размер, heavy reference budget или generation-first features Google, тогда уже появляется смысл выбирать Nano Banana Pro.

Публикует ли Google rate limits для Nano Banana Pro так же прозрачно, как OpenAI?

Нет. OpenAI публикует tiered image-per-minute limits прямо на model page GPT Image 1.5. Google пишет, что active limits нужно смотреть в AI Studio, и отдельно предупреждает, что preview models могут иметь более restrictive limits.

Итог

Если нужен самый короткий совет, то он такой: берите GPT Image 1.5 как default и добавляйте Nano Banana Pro только тогда, когда workflow действительно требует high-resolution generation, grounding или более тяжелой reference-control линии.

Если вам нужна более сильная premium-generation route и вы готовы жить с caveats preview-модели, выбирайте Nano Banana Pro.

Если нужен более безопасный operational default для правок, прозрачного фона и более дешевого standard-size output, выбирайте GPT Image 1.5.

Это и есть реальный ответ, который страница один до сих пор любит переусложнять.