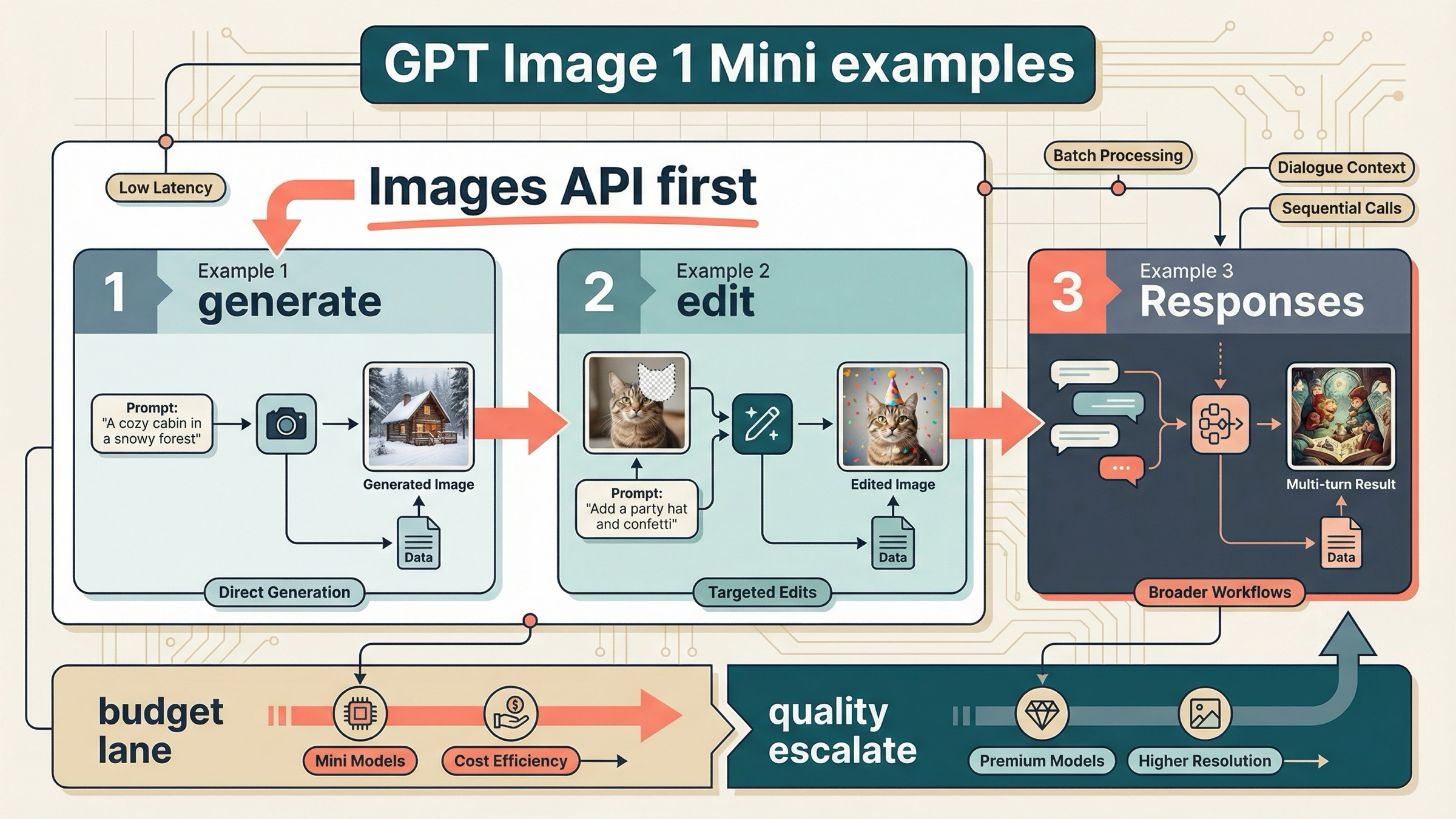

Если вам нужны gpt-image-1-mini examples, которые все еще работают на 29 марта 2026 года, начинайте с Images API для one-shot generation и direct edits, а к Responses переходите только тогда, когда действительно нужен multi-turn image workflow. Это самый короткий current answer, которого exact-query SERP по-прежнему не формулирует достаточно прямо.

Такой порядок следует из current OpenAI docs. Image generation guide по-прежнему говорит, что Image API лучше подходит для single-image generation или edit по одному prompt, а Responses нужен для conversational или multi-step image flows. На current gpt-image-1-mini model page mini прямо позиционируется как cost-efficient GPT Image lane, а не как лучший вариант для любого image job.

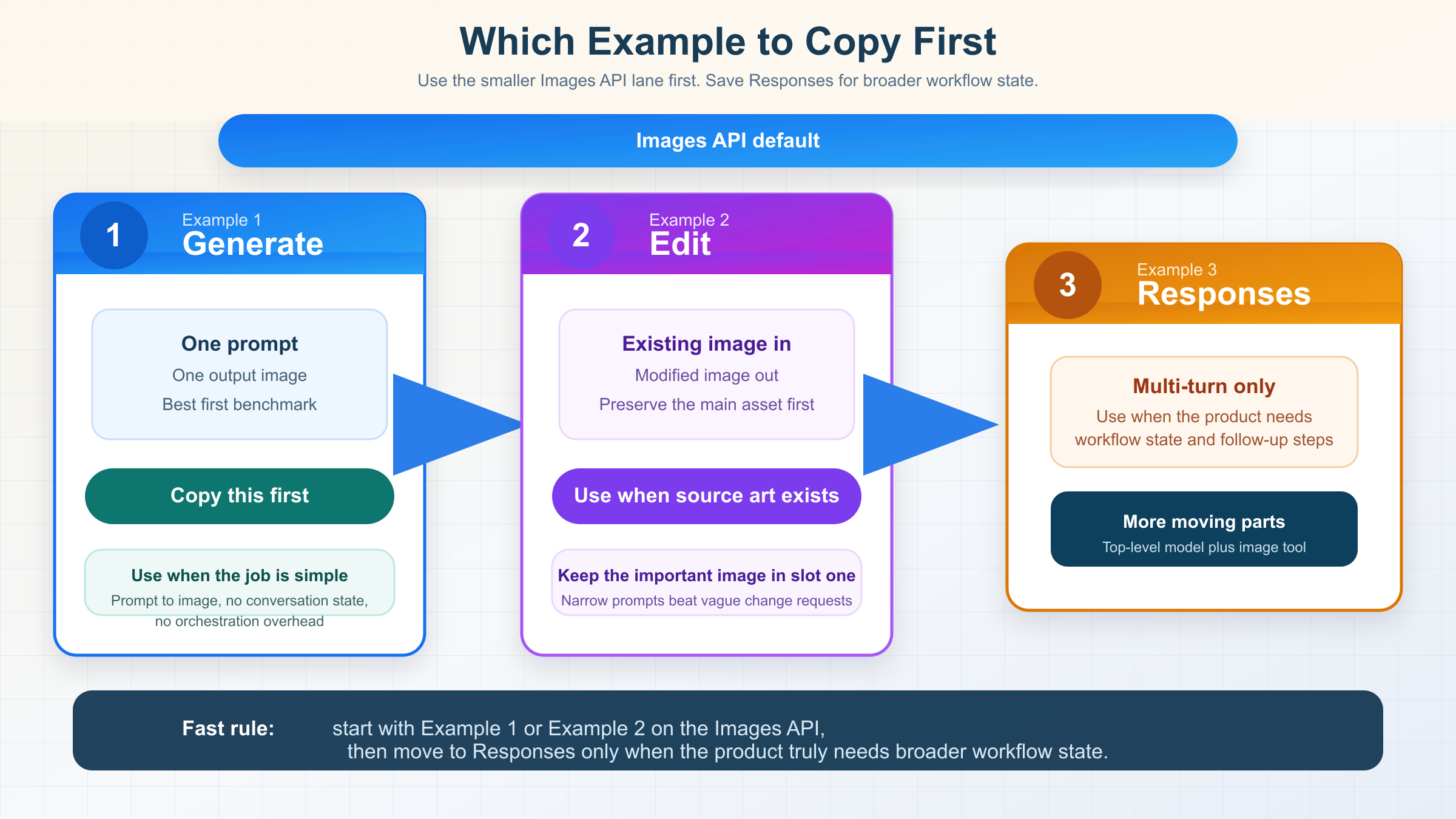

Именно поэтому три примера ниже имеют смысл копировать первыми. Если вам нужен prompt-to-image output, копируйте Example 1. Если у вас уже есть source image и нужен direct edit, берите Example 2. Если продукту реально нужны follow-up turns и image state across responses, только тогда переходите к Example 3.

3 gpt-image-1-mini examples, которые стоит копировать первыми

Query с exact model name сегодня забит model directories, playground pages и wrapper examples. Они помогают увидеть, что модель вообще существует, но почти не помогают решить, с какого route начинать прямо сейчас. Эта таблица дает самый короткий честный answer.

| Если вам нужно... | Копируйте этот example | API surface | Почему начинать отсюда |

|---|---|---|---|

| Один prompt и одна output image | Example 1 | Images API | Самый маленький official route и лучший first success target |

| Прямой edit существующего изображения | Example 2 | Images API | OpenAI все еще рекомендует direct image route для one-shot edits |

| Итеративная работа с изображением across turns | Example 3 | Responses API | Только здесь larger abstraction действительно оправдан |

Есть еще один useful shortcut перед code blocks. Current tool guide по image generation напоминает: prompts работают лучше, когда вы используете прямые verbs вроде draw или edit. Это маленькая деталь, но она помогает быстро отличать page-one examples, которые реально ведут к working request, от страниц, которые просто имитируют helpfulness.

Если вам нужен более широкий OpenAI image example, но уже вокруг flagship lane, после этой страницы откройте OpenAI image generation API example. Этот материал deliberately narrow: только про gpt-image-1-mini и про то, какой example стоит копировать первым.

Example 1: one-shot image generation через Images API

Этот example безопаснее всего брать первым, потому что у него минимальный failure surface. Один prompt, один output image, один straightforward decode step. Нет conversation state, нет tool routing, нет лишней ambiguity по поводу того, что именно у вас сломалось.

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const result = await client.images.generate({ model: "gpt-image-1-mini", prompt: "Draw a clean editorial illustration of a robot street photographer in bright morning light.", size: "1024x1024", quality: "medium", output_format: "jpeg", output_compression: 80, }); const imageBase64 = result.data[0].b64_json; fs.writeFileSync( "gpt-image-1-mini-generate.jpg", Buffer.from(imageBase64, "base64") );

Python version выглядит столь же прямо:

pythonfrom openai import OpenAI import base64 client = OpenAI() result = client.images.generate( model="gpt-image-1-mini", prompt="Draw a clean editorial illustration of a robot street photographer in bright morning light.", size="1024x1024", quality="medium", output_format="jpeg", output_compression=80, ) image_base64 = result.data[0].b64_json with open("gpt-image-1-mini-generate.jpg", "wb") as f: f.write(base64.b64decode(image_base64))

И raw cURL shape:

bashcurl https://api.openai.com/v1/images/generations \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "gpt-image-1-mini", "prompt": "Draw a clean editorial illustration of a robot street photographer in bright morning light.", "size": "1024x1024", "quality": "medium", "output_format": "jpeg", "output_compression": 80 }' \ | jq -r '.data[0].b64_json' \ | base64 --decode > gpt-image-1-mini-generate.jpg

Почему это лучший first default? Во-первых, он совпадает с current OpenAI route rule. Во-вторых, это лучший способ быстро понять, подходит ли mini вообще вашему workload. OpenAI в current guide по image generation по-прежнему рекомендует GPT Image 1.5 for the best experience, но если ваш реальный приоритет — cost-efficient image generation, то mini имеет смысл тестировать именно на самом direct route.

Первый request полезно сделать boring on purpose: square image, quality: "medium", prompt с явным verb вроде draw, сохранение файла на диск и проверка, что bytes корректно decoded. Только после этого имеет смысл добавлять more art direction, other output formats или сложные downstream requirements.

Есть и practical reason не прыгать сразу в quality: "high". На official mini model page current 1024x1024 price ladder выглядит так: $0.005 low, $0.011 medium, $0.036 high. Разница слишком заметная, чтобы брать high только "на всякий случай". Для drafts, internal concepts и cheap prompt benchmarking medium чаще оказывается правильной starting point.

| Параметр | Безопасный first value | Меняйте его, когда |

|---|---|---|

size | 1024x1024 | Нужен другой aspect ratio или downstream crop |

quality | medium | Уже видно, что low недостаточно, а high реально окупается |

output_format | jpeg | Ваш pipeline требует другой file type |

output_compression | 80 | Важнее file size или наоборот важна максимальная detail retention |

Example 2: direct image edits с input_fidelity

Если у вас уже есть source image и вы хотите ее изменить, оставайтесь на Images API. Current docs все еще трактуют direct edits как часть той же smaller route. Сам факт, что job уже не pure text-to-image, не значит, что нужно автоматически прыгать в Responses.

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const result = await client.images.edit({ model: "gpt-image-1-mini", image: [ fs.createReadStream("product-photo.jpg"), fs.createReadStream("brand-logo.png"), ], prompt: "Edit the first image by placing the logo from the second image onto the coffee cup label. Preserve the cup shape, lighting, camera angle, and table texture.", input_fidelity: "high", size: "1024x1024", quality: "medium", }); const imageBase64 = result.data[0].b64_json; fs.writeFileSync( "product-photo-edited.png", Buffer.from(imageBase64, "base64") );

Здесь начинается mini-specific detail, которую wrapper pages почти всегда пропускают. Current input fidelity documentation говорит: если вы используете gpt-image-1 или gpt-image-1-mini с input_fidelity: "high", то первое input image получает сильнейшее preservation по texture и detail. Если один face, product shot или logo особенно важен, ставьте его именно в slot one.

Эта деталь и есть difference between "edit exists" и "edit works the way you expected". Для mini edits полезно держать в голове три rules:

- самое важное source asset кладите первым;

input_fidelity: "high"используйте только тогда, когда detail preservation действительно worth the extra image-input cost;- prompt должен не только говорить, что изменить, но и фиксировать, что нельзя ломать.

Если позже вы добавляете mask, помните: GPT Image edits все еще generative, а не Photoshop-style deterministic surgery. Image guide говорит, что image и mask должны совпадать по size и format, а mask должен иметь alpha channel. Это useful control, но не pixel-perfect patch system.

Есть и еще одна practical trap. SDK quietly hide multipart form-data mechanics. Если вы уводите тот же edit request на raw HTTP, image files надо отправлять как actual file parts, а не JSON-объекты с binary content. Именно в этот момент многие "короткие" wrapper examples перестают быть production-helpful.

Если весь ваш task на самом деле крутится именно вокруг direct edits, а не around examples as a whole, логичный next read — GPT Image 1 Mini edit. Эта статья остается на уровне example choice, а не exhaustively edit-specific tutorial.

Example 3: multi-turn image workflow в Responses

Этот example нужен только тогда, когда product действительно требует conversation state, follow-up refinement или larger assistant workflow. Для one-request job это не лучший first copy target.

Причина subtle, но важная. В Responses API top-level model должен быть text-capable mainline model вроде gpt-5 или gpt-4.1. Hosted image_generation tool использует GPT Image models underneath, но gpt-image-1-mini не ставится в top-level model field. Именно это thin wrappers очень часто размывают.

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const response = await client.responses.create({ model: "gpt-5", input: "Generate an image of a gray tabby cat reading a newspaper at a cafe table.", tools: [{ type: "image_generation" }], }); const firstImage = response.output .filter((item) => item.type === "image_generation_call") .map((item) => item.result)[0]; fs.writeFileSync("cat-cafe.png", Buffer.from(firstImage, "base64")); const followUp = await client.responses.create({ model: "gpt-5", previous_response_id: response.id, input: "Now make it look like a realistic magazine photo.", tools: [{ type: "image_generation" }], }); const secondImage = followUp.output .filter((item) => item.type === "image_generation_call") .map((item) => item.result)[0]; fs.writeFileSync("cat-cafe-realistic.png", Buffer.from(secondImage, "base64"));

Это правильный route, если image generation уже не является single-shot feature. Он подходит тогда, когда продукту нужна memory across turns или image generation — только one tool внутри bigger orchestration.

И это неправильный route, если ваш use case по-прежнему simple. Current OpenAI docs здесь точнее, чем SERP average: "современнее" не значит "правильнее". Правильнее тот surface, который соответствует job. Для simple generation и direct edits smaller Images API route по-прежнему чище.

Есть еще одна причина не ставить Responses в начало: он добавляет сразу два decision layers. Нужно выбрать top-level reasoning model, а затем понять, где именно внутри workflow should happen image generation. Для assistant products это legit architecture. Для first mini benchmark это почти всегда хуже как debug surface.

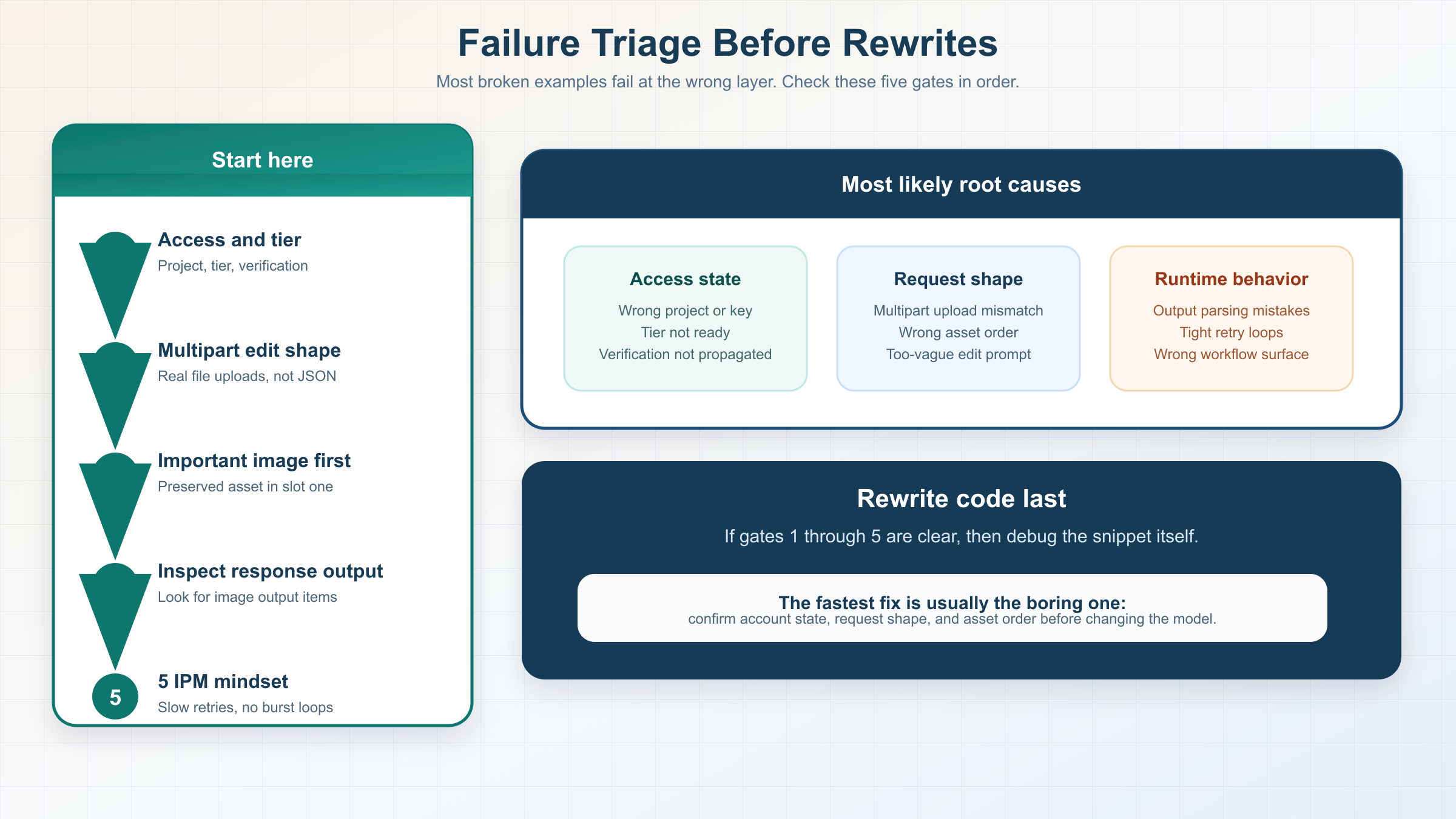

Setup checks, которые надо сделать до того, как вы обвините examples

Mini — это cheap image lane, но это не free lane. По состоянию на 29 марта 2026 года official mini model page показывает для 1024x1024 такие output prices: $0.005 low, $0.011 medium, $0.036 high. Та же page также говорит, что Free is not supported, а Tier 1 начинается с 100,000 TPM и 5 IPM.

Это важно, потому что even a good example может упасть не из-за request shape, а из-за того, что account state не готов к model. Current model availability article говорит, что gpt-image-1 и gpt-image-1-mini доступны API users на tiers 1 through 5, но часть access зависит от organization verification. А current organization verification article добавляет operational detail: propagation может занимать до 30 минут, а new API key часто решает lingering not verified errors.

Самый useful debug order здесь такой:

- убедитесь, что API key относится к правильному project и organization;

- проверьте, что tier действительно поддерживает mini image access;

- если access выглядит blocked, проверьте organization verification;

- если verification завершилась только что, дождитесь полного 30-minute propagation window;

- сгенерируйте new API key прежде, чем переписывать working example.

Если ваш blocker — это скорее access state, чем example quality, следующий материал — OpenAI image generation API verification.

Troubleshooting common gpt-image-1-mini example failures

Когда copied example не работает, root cause обычно скучнее, чем обещает SERP. Чаще всего проблема в wrong surface, wrong request shape или в том, что account state проверили слишком поздно.

| Симптом | Самая вероятная причина | Что проверить первым |

|---|---|---|

| Generation example возвращает access / availability error | project, tier или verification state не готовы | Проверьте org, tier, verification и момент выпуска API key |

| Edit example отрабатывает, но игнорирует reference asset | важное image не было первым, либо prompt слишком vague | Поставьте preserved image первым и сузьте prompt |

| Edit request ломается после ухода с SDK | raw request не отправляет multipart files корректно | Пересоберите call как multipart form-data с real file parts |

| Responses example возвращает text, но не usable image | response parsing не та, либо сам workflow слишком complex для first test | Проверьте response.output и image_generation_call items |

| Rate limits приходят неожиданно быстро | image quotas у mini маленькие по сравнению с text-model habits | Учитывайте official IPM figure и уберите burst retries |

Последняя строка worth underlining. При 5 IPM на Tier 1 можно получить ощущение "случайной" ошибки просто потому, что вы несколько раз подряд гоняете один и тот же image example, меняя prompt или asset order. Здесь легко перепутать quota behavior и broken code.

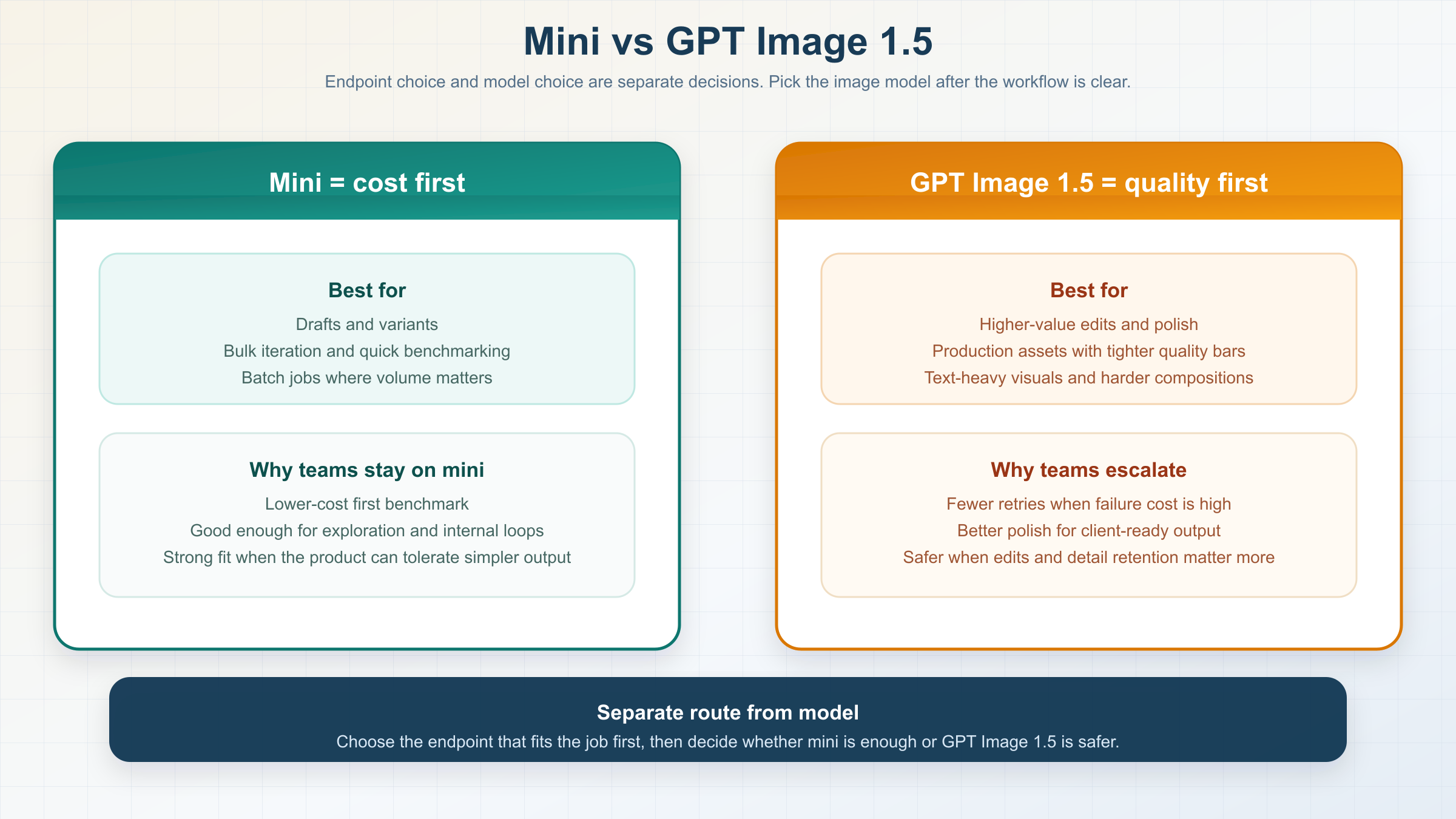

Когда mini достаточно, а когда safer копировать уже GPT Image 1.5

Именно этот вопрос exact examples pages почти никогда не отвечают честно. Current image guide говорит, что gpt-image-1.5 — latest and most advanced GPT Image model, и рекомендует GPT Image 1.5 for the best experience. Та же guide говорит, что gpt-image-1-mini можно брать как more cost-effective option, когда image quality не главный priority.

Значит, honest rule выглядит не как "mini теперь default". Honest rule такой:

- копируйте mini examples first, когда главный constraint — cost;

- копируйте GPT Image 1.5 examples first, когда важнее overall quality, heavier edits и lower retry cost.

Mini хорошо fit для internal concepts, low-stakes variants, cheap prompt benchmarking и workflows, где volume важнее perfection. GPT Image 1.5 safer тогда, когда вы уже работаете с production assets, дорогими edit failures или workflows, где каждая retry реально стоит времени и денег.

Есть еще один scale nuance. Current API pricing page говорит, что Batch API saves 50% on inputs and outputs. Это не стирает ценовое преимущество mini, но делает model choice более workflow-dependent для asynchronous jobs. Поэтому "самый дешевый example" не всегда становится cheapest system after retries and batch strategy.

Если вам нужен full cost breakdown, откройте GPT Image 1 Mini pricing. Если нужен broader qualitative judgment по самому mini, читайте GPT Image 1 Mini review.

Ошибки, которые wrapper example pages все еще навязывают

Первая ошибка — копировать не тот abstraction. Если нужен один prompt и одна output image, не начинайте с Responses только потому, что он выглядит новее. Current OpenAI docs по-прежнему отправляют вас обратно к Images API.

Вторая ошибка — ставить wrong model в Responses model field. Если вы используете hosted image_generation tool, top-level model должен быть чем-то вроде gpt-5 или gpt-4.1, а не gpt-image-1-mini.

Третья ошибка — забывать first-image rule при mini edits. Если для вас критичнее всего один face, product или logo, именно это изображение должно быть первым.

Четвертая ошибка — считать, что cheapest lane автоматически и есть лучший default. Official OpenAI docs такого не говорят. Они говорят, что mini — cost-effective lane, а GPT Image 1.5 — still the best-experience lane.

Пятая ошибка — debugging code раньше account state. Если у project не тот tier, org не verified или propagation еще не закончилась, example будет падать даже при корректном request shape.

Шестая ошибка — копировать vocabulary gateway pages обратно в official API. Third-party playgrounds часто прячут несколько route decisions внутри одного собственного abstraction. Когда те же labels механически копируют в OpenAI-native code, получается путаница между platform UI и actual API behavior.

Bottom line

Если вы искали gpt-image-1-mini examples, три паттерна выше — именно те, которые стоит копировать первыми. Images API для one-shot generation. Images API же для direct edits с input_fidelity. Responses только тогда, когда продукту действительно нужен multi-turn image workflow.

И держите в голове одно главное rule: mini — это cheaper lane, а не universal lane. Если examples работают и quality уже достаточно, оставляйте mini. Если retries начинают дорожать, а output надо дотягивать до stronger polish, безопаснее копировать тот же route уже с GPT Image 1.5.