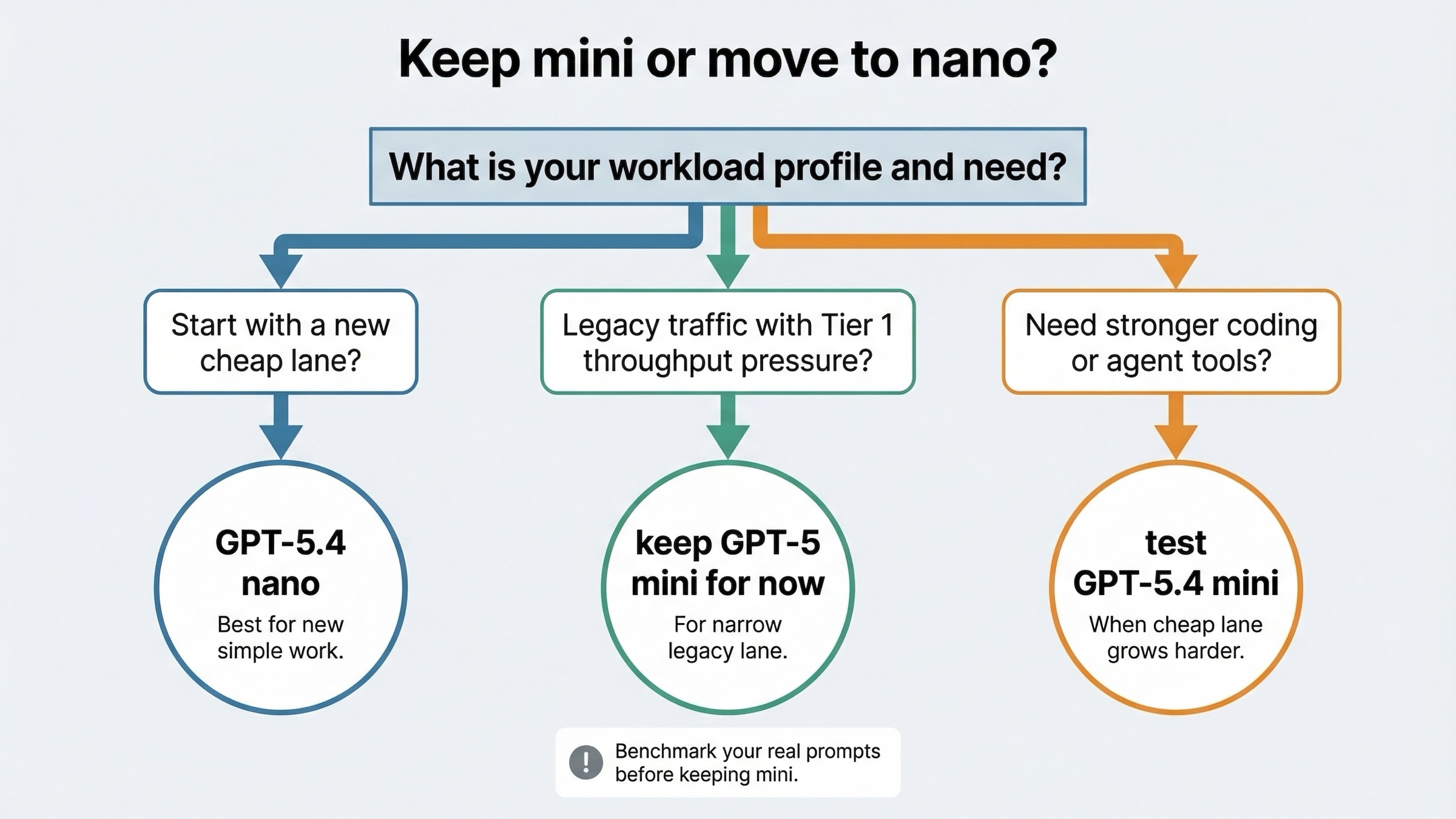

Для новых высокообъемных сценариев в OpenAI API обычно выгоднее GPT-5.4 nano. GPT-5 mini стоит оставлять только тогда, когда у вас уже есть стабильный production-контур на этом модели, критичен ее профиль throughput на нижних платных уровнях или риск миграции сейчас дороже потенциального выигрыша.

Практическое правило здесь простое. Если вы запускаете новую дешевую ветку для classification, extraction, ranking или tool-enabled helper agents, начинайте с GPT-5.4 nano: она дешевле, заметно свежее и лучше вписывается в нынешние low-cost workflows. GPT-5 mini по-прежнему уместна как legacy-вариант для стабильного text-heavy трафика, но уже не выглядит cheap default для новой архитектуры 2026 года. Ее главное оставшееся преимущество сегодня связано скорее с операционной инерцией и предсказуемостью, чем с более сильной базовой позицией продукта.

Краткое содержание

| Модель | Лучший сценарий | Почему выбрать | Почему не выбрать |

|---|---|---|---|

| GPT-5.4 nano | Новые дешевые цепочки для классификации, извлечения, ранжирования и простых subagents | Ниже цена, новее knowledge cutoff, шире tool surface и лучше ряд официальных coding/tool benchmark-строк | Ниже Tier 1 TPM и слабее mini в нескольких более узких eval-сценариях |

| GPT-5 mini | Legacy-трафик, где уже все стабильно и важен throughput | Выше Tier 1 TPM и уже известное продовое поведение | Модель старее, дороже nano и уже не выглядит дефолтным cheap-branch для новых сборок |

Самое полезное правило такое: для нового дешевого API-маршрута сначала тестируйте GPT-5.4 nano; GPT-5 mini оставляйте только при измеримой причине.

Почему это сравнение обманчиво по названиям

Многим кажется, что GPT-5 mini должна быть «классом выше», чем GPT-5.4 nano, просто потому что слово mini звучит крупнее, чем nano. В текущей линейке OpenAI это уже не работает.

В latest-model guide OpenAI прямо пишет: если вам нужен меньший и более быстрый вариант, начинайте с gpt-5.4-mini или gpt-5.4-nano. А на странице GPT-5 mini уже есть еще более сильный сигнал: для большинства новых low-latency, high-volume workloads рекомендуется начинать с GPT-5.4 mini.

То есть GPT-5 mini все еще существует, но это уже не главный «современный дешевый дефолт». Скорее, это живая legacy-ветка, которую иногда есть смысл сохранить. GPT-5.4 nano, напротив, OpenAI позиционирует как дешевую GPT-5.4-класс ветку для classification, extraction, ranking и более простых coding subagents. Именно это и нужно большинству бюджетных worker-цепочек.

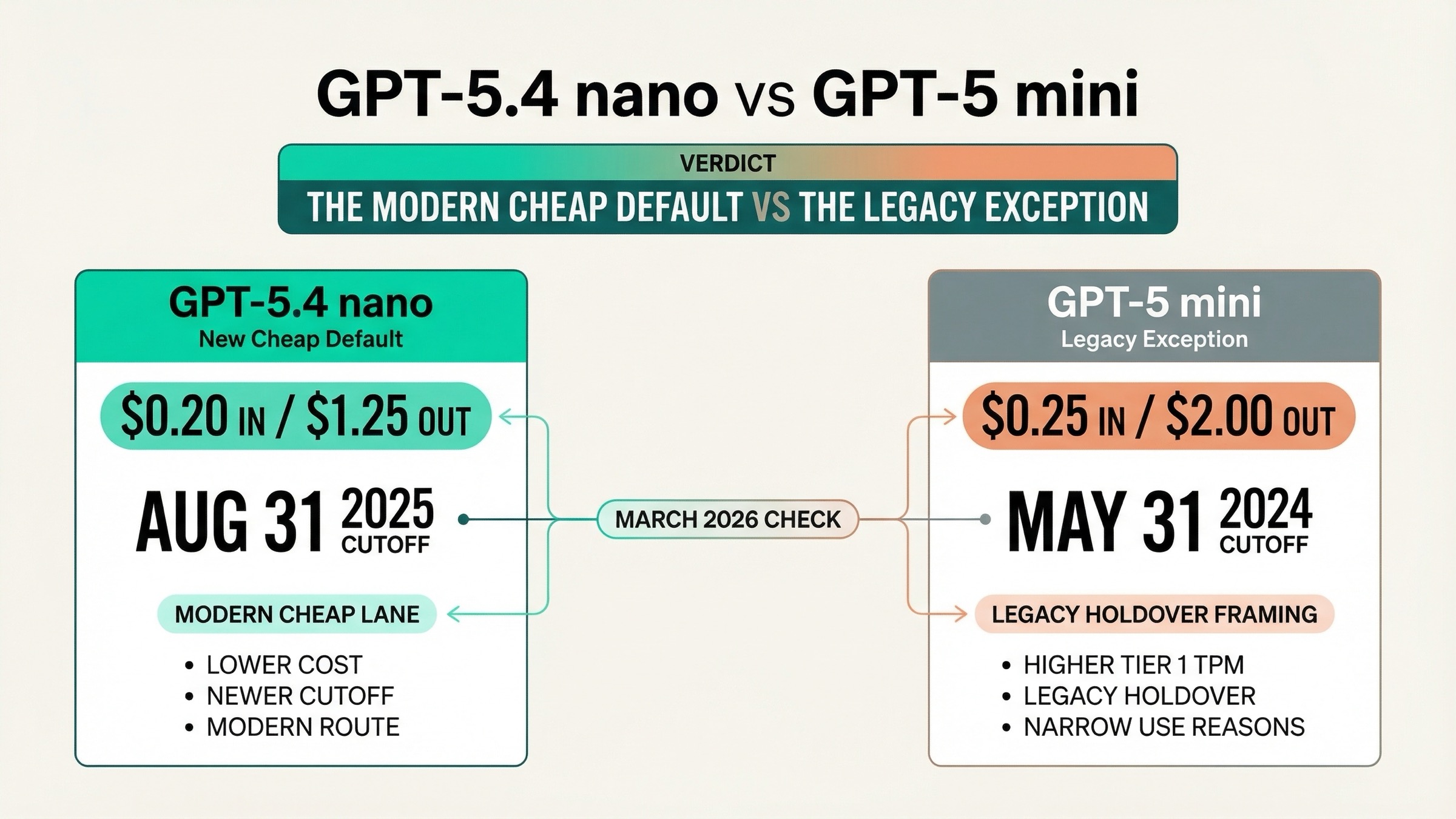

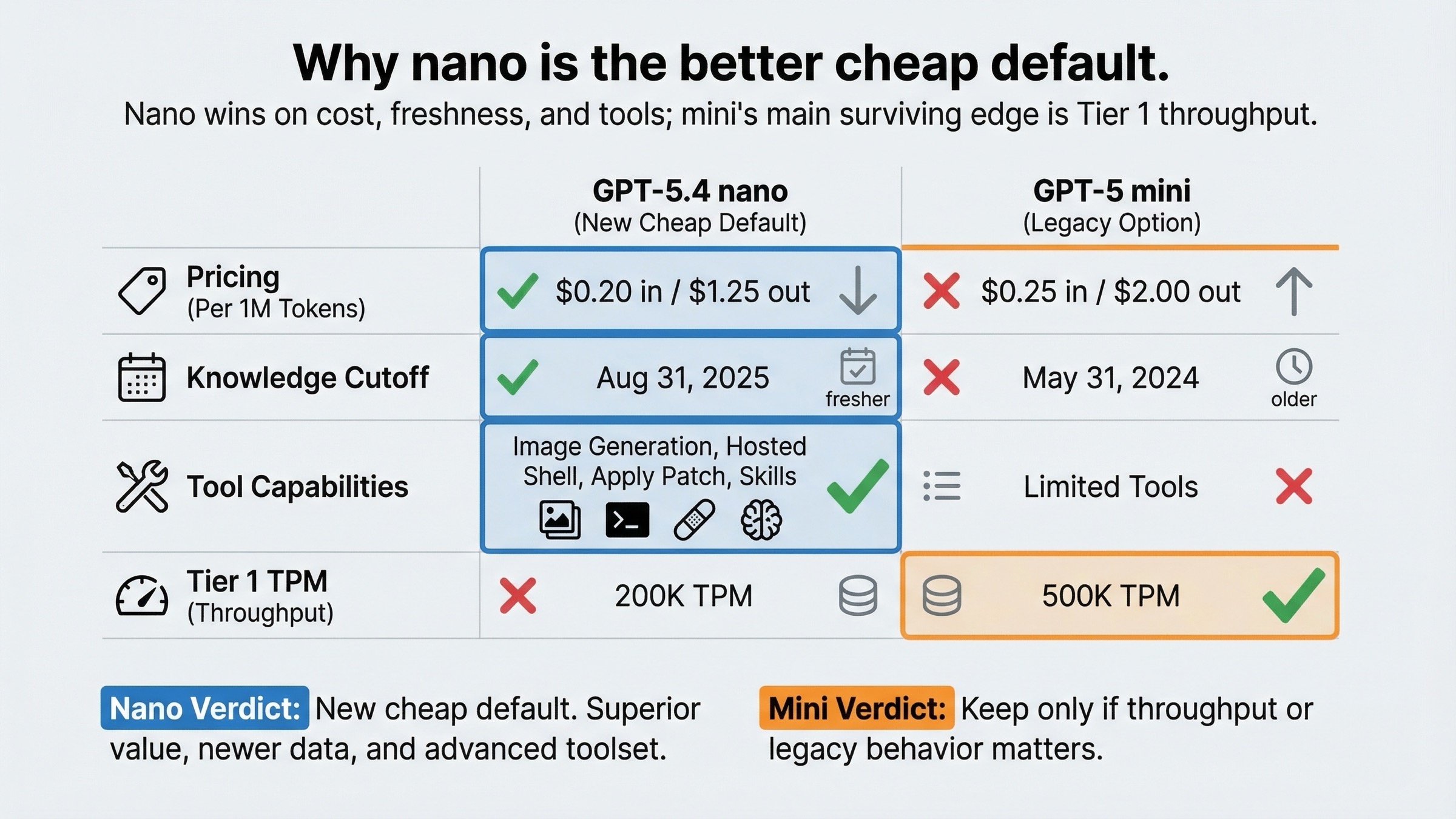

Цена, свежесть, инструменты и throughput рядом

На 21 марта 2026 года GPT-5.4 nano стоит $0.20 за 1M input tokens, $0.02 cached input и $1.25 за 1M output tokens. GPT-5 mini стоит $0.25, $0.025 и $2.00 соответственно. То есть в этой паре GPT-5 mini не просто старее. Она еще и дороже по input, cached input и output.

Второе важное отличие, которое часто недооценивают, это свежесть знаний. GPT-5.4 nano имеет cutoff 31 августа 2025 года, а GPT-5 mini — 31 мая 2024 года. Для новых библиотек, API-изменений и документации 2025 года это уже ощутимая разница.

Третье отличие — инструменты. GPT-5.4 nano сейчас поддерживает image generation, hosted shell, apply patch, skills и MCP, а GPT-5 mini ограничивается web search, file search, code interpreter и MCP. Если ваш дешевый worker делает только plain-text работу, это может не решить выбор. Но если дешевой ветке все же нужен полезный tool layer, преимущество nano становится практическим, а не теоретическим.

Самый сильный аргумент в пользу GPT-5 mini сегодня — throughput на нижних платных тирах. На compare-models page Tier 1 TPM у GPT-5 mini — 500,000, у GPT-5.4 nano — 200,000. Именно это чаще всего и объясняет, почему кто-то все еще держит mini.

| Характеристика | GPT-5.4 nano | GPT-5 mini |

|---|---|---|

| Input price | $0.20 / 1M tokens | $0.25 / 1M tokens |

| Cached input | $0.02 / 1M tokens | $0.025 / 1M tokens |

| Output price | $1.25 / 1M tokens | $2.00 / 1M tokens |

| Context window | 400,000 | 400,000 |

| Max output | 128,000 | 128,000 |

| Knowledge cutoff | 2025-08-31 | 2024-05-31 |

| Snapshot | gpt-5.4-nano-2026-03-17 | gpt-5-mini-2025-08-07 |

| Image generation | Yes | No |

| Hosted shell | Yes | No |

| Apply patch | Yes | No |

| Skills | Yes | No |

| Tier 1 TPM | 200,000 | 500,000 |

Уже из этой таблицы видно, почему простое «mini против nano» без интерпретации не помогает. По стоимости, freshness и tool surface новая cheap-default-логика уже явно склоняется к nano.

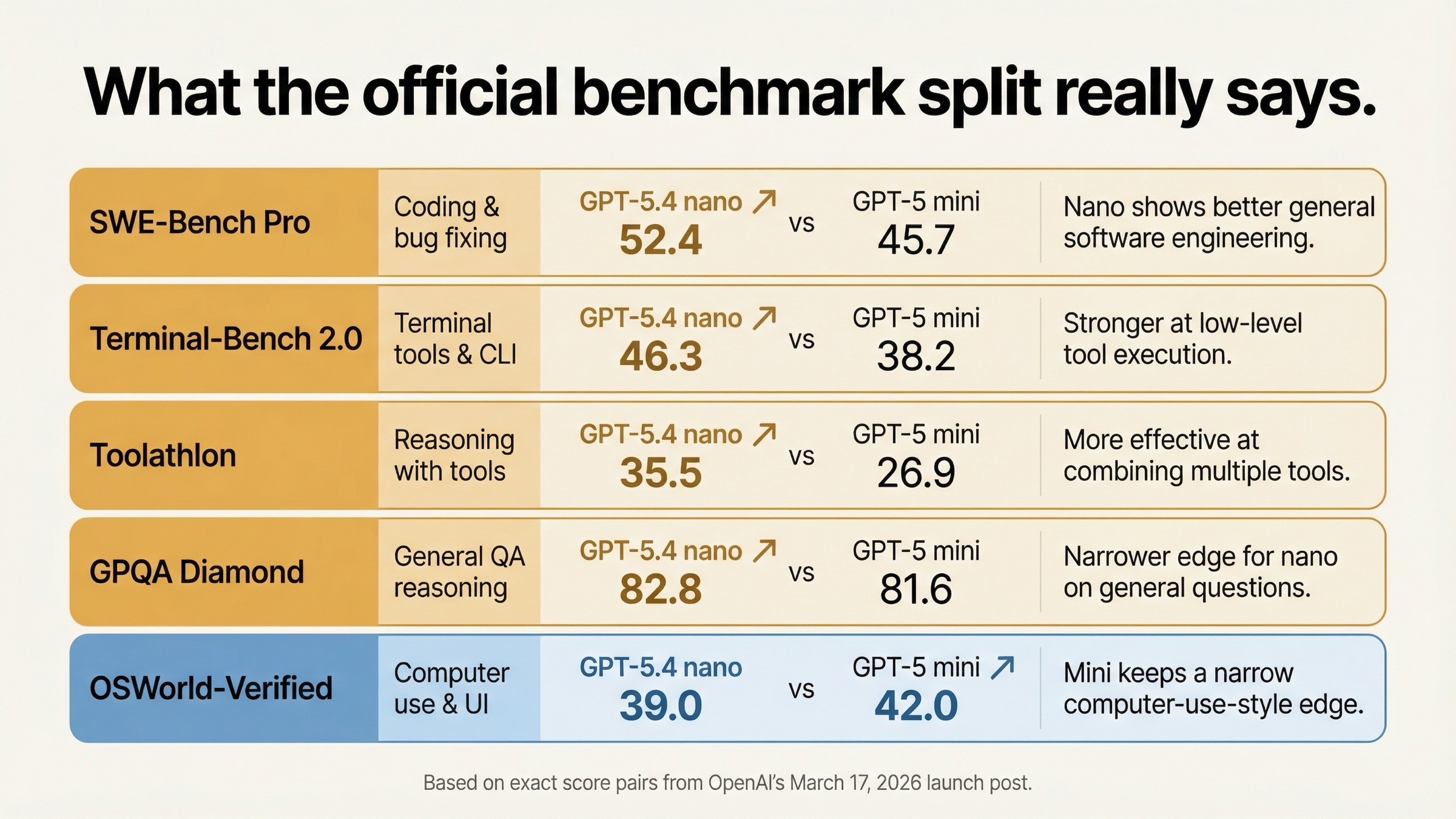

Что реально говорят официальные бенчмарки от 17 марта 2026 года

Здесь находится самая важная часть аргумента. Если бы GPT-5.4 nano была просто дешевле, но ощутимо слабее, выбор был бы менее очевидным. Но официальный launch table показывает более интересную картину.

| Бенчмарк из official launch post | GPT-5.4 nano | GPT-5 mini | Практический смысл |

|---|---|---|---|

| SWE-Bench Pro | 52.4% | 45.7% | Nano лучше на реальных software issue-resolution задачах |

| Terminal-Bench 2.0 | 46.3% | 38.2% | Nano сильнее в terminal-style tool execution |

| Toolathlon | 35.5% | 26.9% | Nano надежнее на multi-tool workflows |

| GPQA Diamond | 82.8% | 81.6% | Даже в high-end QA reasoning nano слегка впереди |

| MRCR v2 128K-256K | 33.1% | 19.4% | На реально больших prompt-контекстах nano заметно сильнее |

| OSWorld-Verified | 39.0% | 42.0% | Здесь mini сохраняет небольшой edge |

Главное наблюдение такое: GPT-5.4 nano выигрывает не только за счет цены. Она выигрывает и по многим строкам, которые особенно важны для современных дешевых worker-пайплайнов: coding, tool use, terminal-style execution и retrieval-heavy work. GPT-5 mini не исчезает с карты полностью, потому что у нее остаются отдельные карманы преимущества, но общая картина уже не в ее пользу.

Важно и то, как читать эту таблицу. OpenAI отмечает, что в сравнении GPT-5 mini идет с максимальным доступным reasoning_effort = high, а GPT-5.4-линейка — с xhigh. Это значит, что таблица отражает продуктовые состояния «как они доступны сейчас», а не лабораторный симметричный тест. Для buyer decision это как раз полезно.

Когда GPT-5.4 nano — лучший выбор

Если вы сейчас строите дешевую ветку заново, GPT-5.4 nano чаще всего и должна быть первой точкой теста.

Самый очевидный случай — classification, extraction, ranking и helper-agents. Именно под эти задачи OpenAI и рекомендует nano. Второй случай — легкая coding-support работа: triage, мелкие преобразования, tool-heavy helper tasks. Третий — новые архитектуры, где вы хотите modern cheap lane, а не legacy-ветку из привычки.

GPT-5.4 nano особенно хороша, если:

- вы строите новый дешевый маршрут, а не защищаете старый;

- вам нужна минимальная цена из этой пары;

- важны более свежие знания 2025 года;

- cheap lane все же использует инструменты, а не только plain text;

- вы готовы жить с меньшим Tier 1 TPM ради лучшей стоимости и более современного product branch.

Когда GPT-5 mini все еще имеет смысл

У GPT-5 mini остается право на жизнь, но только как на исключение с понятной причиной.

Первая причина — стабильный legacy deployment. Если модель уже работает, промпты отстроены, а стоимость миграции реальна, заменять ее вслепую не нужно. Вторая — Tier 1 throughput pressure. Если именно это ограничение больнее всего, mini может временно оставаться практичнее. Третья — ваши реальные задачи ближе к тем eval-карманам, где mini все еще показывает лучшую картину.

Оставлять GPT-5 mini разумнее, когда:

- вы уже используете ее в проде и не хотите мигрировать без измерений;

- Tier 1 throughput реально влияет на экономику или latency;

- workload в основном текстовый и не опирается на новые инструменты;

- реальные A/B-тесты не показали, что GPT-5.4 nano заметно лучше именно на ваших prompts.

Ключевой момент: это узкий список условий. Он не означает, что GPT-5 mini осталась универсальной дешевой рекомендацией.

API-выбор нельзя смешивать с ChatGPT-поверхностью

Этот запрос часто уводит людей в неправильную сторону: они ищут модельное имя, попадают на статьи про ChatGPT visibility и потом переносят app-surface-логику на API routing.

Но это разные вопросы. На текущей странице Help Center про GPT-5.3 и GPT-5.4 в ChatGPT видимые линии описаны как GPT-5.3 Instant, GPT-5.4 Thinking и GPT-5.4 Pro. Это не то же самое, что выбор между GPT-5.4 nano и GPT-5 mini для API.

Если вы строите API stack, ориентируйтесь на model pages, latest-model guide и release post. Если хотите понять премиум-ветку рядом с cheap lane, дальше стоит читать GPT-5.4 vs GPT-5 mini. Если вам еще нужен сам API setup, здесь пока нет локализованной версии, поэтому оставляю явный fallback на английскую OpenAI API key guide.

Практическое правило миграции такое:

- Для любого нового cheap workload сначала тестируйте GPT-5.4 nano.

- GPT-5 mini оставляйте только если ваши реальные prompts доказывают преимущество по throughput или стабильности.

- Если cheap lane начинает тянуть более сложный coding/agent workload, смещайте сравнение к GPT-5.4 mini, а не глубже в legacy mini.

Что измерить перед тем как оставить mini

Самая частая ошибка в таких сравнениях состоит в том, что команда оставляет GPT-5 mini по инерции, а не по метрикам. Если у вас уже есть рабочий маршрут на mini, не нужно мигрировать вслепую. Но и защищать старое решение одной фразой вроде «оно у нас давно работает» тоже недостаточно. Решение должно опираться на измерения.

Минимальный набор для честного A/B здесь простой: стоимость на один полезный ответ, доля успешных tool calls, стабильность на длинных prompts, средняя задержка на вашем обычном трафике и процент ручных эскалаций. Если после этого GPT-5 mini действительно выигрывает по throughput-sensitive трафику и при этом не проигрывает по качеству настолько, что экономия исчезает, оставлять ее можно. Но если разница держится только на привычке команды, это уже плохой аргумент.

Полезно и разделить трафик по типам задач, а не мерить все одной средней. В одном и том же проде cheap lane может обслуживать короткие классификаторы, длинные extraction jobs, routing helpers и простые coding workers. Именно на таких смешанных пачках GPT-5.4 nano часто выглядит сильнее, потому что выигрывает не только в цене, но и в tool-heavy и long-context поведении.

На практике хороший вопрос звучит так: «Где именно mini приносит измеримое преимущество, которое покрывает ее более высокую цену и более старый cutoff?» Если команда не может назвать конкретный сегмент запросов, то mini почти наверняка осталась в системе как legacy-привычка, а не как лучший текущий выбор.

Как мигрировать на nano без сюрпризов

Если вы решили тестировать GPT-5.4 nano, не переводите на нее весь дешевый трафик одним переключателем. Лучше вынести три маршрута: существующий mini, кандидат nano и контрольный premium fallback. Тогда вы увидите не только среднее качество ответа, но и то, как меняется частота отказов, ретраев и вынужденных эскалаций на более дорогую ветку.

Еще один практический шаг — сохранить прежние prompts и менять только модель, а не модель и orchestration одновременно. Иначе вы не поймете, что именно улучшилось или ухудшилось. После этого уже можно отдельно пробовать более короткие system prompts, другой reasoning budget и более активное использование tool surface, потому что у nano здесь больше продуктовых возможностей.

Для production rollout логика обычно такая: сначала 5-10% нового дешевого трафика, затем отдельный замер стоимости на завершенную задачу, затем контроль ошибок на длинных контекстах и только после этого расширение доли. Если результаты ровные, GPT-5.4 nano постепенно становится cheap default, а GPT-5 mini остается в системе только как страховка для конкретных throughput-карманов.

Именно такой порядок лучше всего отражает текущую официальную картину. GPT-5.4 nano стоит рассматривать как новый базовый кандидат. GPT-5 mini стоит сохранять не потому, что она «вроде бы классом выше», а только потому, что ваши реальные метрики показали для нее узкую, но настоящую operational нишу.

Если нужен совсем короткий operational тест, используйте простой фильтр: mini должна либо заметно снижать очередь под вашим Tier 1 лимитом, либо давать более предсказуемое поведение на уже критичных prompts. Если этого нет, новый дешевый маршрут разумнее стандартизировать на nano и уже вокруг нее строить дальнейшую оптимизацию.

FAQ

GPT-5 mini уже deprecated?

Нет. На 21 марта 2026 года у нее по-прежнему есть активная model page, pricing и rate limits. Вопрос не в том, жива ли модель, а в том, осталась ли она правильным cheap default для нового маршрута.

GPT-5.4 nano полностью заменяет GPT-5 mini?

Тоже нет. Для legacy-трафика, throughput-sensitive workloads и уже отстроенных систем mini может оставаться рабочим вариантом. Но для новых cheap lanes GPT-5.4 nano чаще всего выглядит правильнее.

Какой самый сильный аргумент оставить GPT-5 mini?

Самый сильный аргумент — не название, а operations: выше Tier 1 TPM плюс уже проверенное продовое поведение.

Когда нужно сравнивать уже с GPT-5.4 mini?

Когда вашей дешевой ветке становится тесно в рамках simple helper work и она начинает выполнять более сложные coding или agent-задачи. В таком случае логичнее переходить к GPT-5.4 mini vs GPT-5 mini.

Короткий честный вывод: GPT-5.4 nano обычно стала правильной дешевой веткой для новых OpenAI API-нагрузок, а GPT-5 mini — это теперь скорее осознанное legacy-исключение.