По состоянию на 20 марта 2026 года для большинства новых сценариев OpenAI API с низкой задержкой разумнее всего брать GPT-5.4 mini как модель по умолчанию. Да, она дороже GPT-5 mini, но в официальном анонсе от 17 марта 2026 года OpenAI прямо пишет, что GPT-5.4 mini превосходит GPT-5 mini в программировании, рассуждении, мультимодальном понимании и работе с инструментами, при этом работает более чем в два раза быстрее. На текущей странице GPT-5 mini также указано, что для большинства новых задач с низкой задержкой и высоким объёмом лучше начинать именно с GPT-5.4 mini.

Это не означает, что GPT-5 mini больше не нужен. Если у вас уже работает большой поток относительно простых текстовых запросов и главная цель состоит в жёстком контроле затрат, GPT-5 mini всё ещё может быть рациональным вариантом. Но решать нужно не по названию, а по рабочей отдаче: окупают ли более широкий набор инструментов, более свежий knowledge cutoff и лучшая производительность в программировании и computer use ту доплату, которую требует GPT-5.4 mini.

Краткое содержание

Короткий ответ: в новых проектах обычно выбирайте GPT-5.4 mini; GPT-5 mini оставляйте для стабильных, слабо инструментированных и максимально чувствительных к стоимости нагрузок.

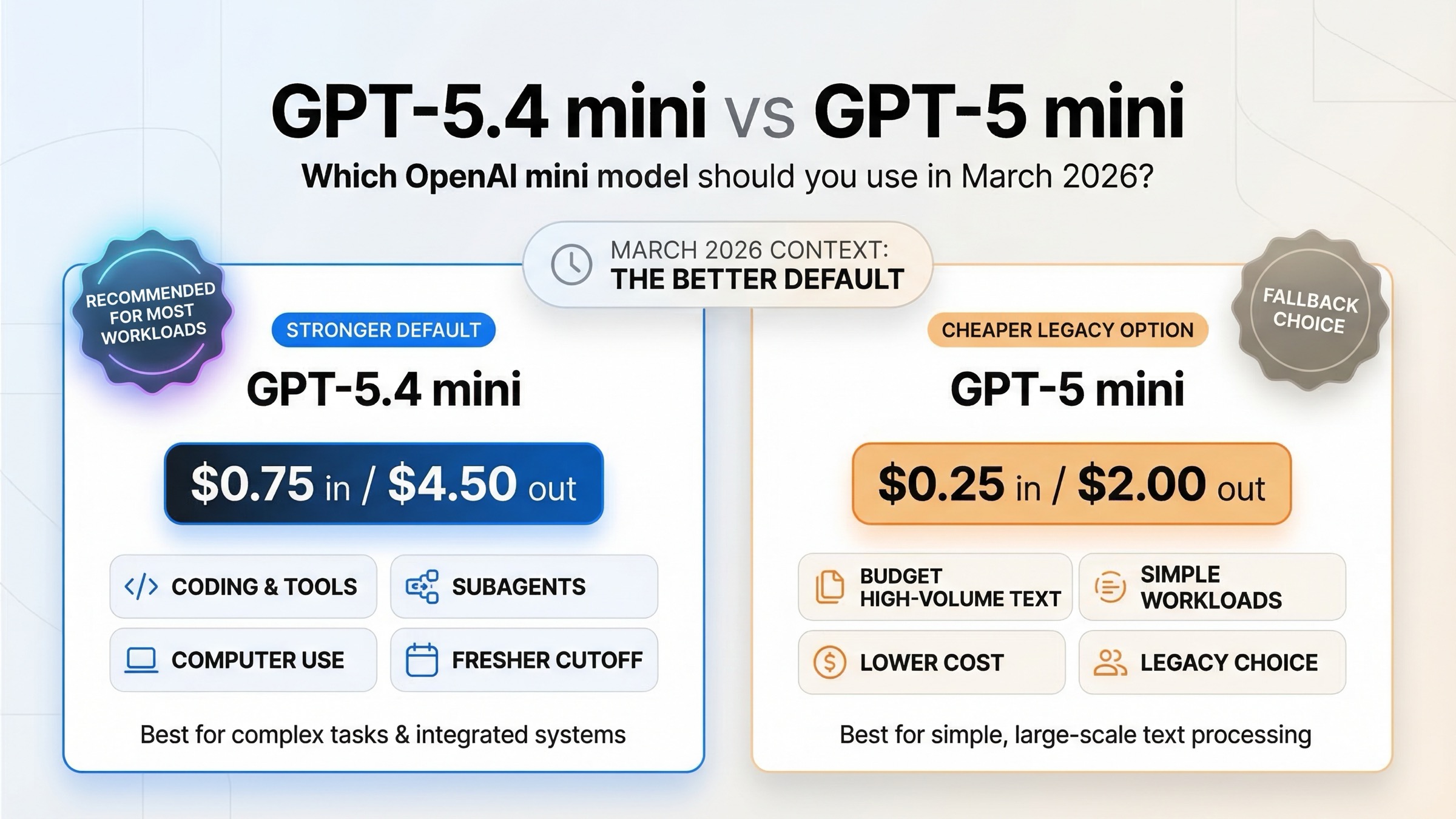

| Модель | Лучший сценарий | Главная причина выбрать | Главная причина не выбирать |

|---|---|---|---|

| GPT-5.4 mini | Новые coding-ассистенты, agent tools, subagents в стиле Codex, сценарии со скриншотами | Сильнее бенчмарки, свежее cutoff, шире инструменты и это текущая рекомендация OpenAI | Дороже: $0.75 input / $4.50 output за 1M токенов |

| GPT-5 mini | Существующие high-volume текстовые pipeline и бюджетно-чувствительные legacy-сценарии | Ниже цена: $0.25 input / $2.00 output за 1M токенов | Более старая модель, уже tool stack и слабее результаты в официальном сравнении марта 2026 |

Самое практичное правило выбора:

- Если вы запускаете новый продукт на OpenAI API в 2026 году, по умолчанию берите GPT-5.4 mini.

- Если workflow зависит от computer use, hosted shell, apply patch, skills или agent loops с tool search, GPT-5.4 mini безопаснее.

- Если нагрузка в основном про простую текстовую классификацию, routing или дешёвую массовую генерацию, разрыв в цене может быть важнее разрыва в возможностях.

- Если вы смотрите только на названия моделей в ChatGPT, сначала отделите это от выбора API-модели: ChatGPT availability и API recommendation - разные поверхности продукта.

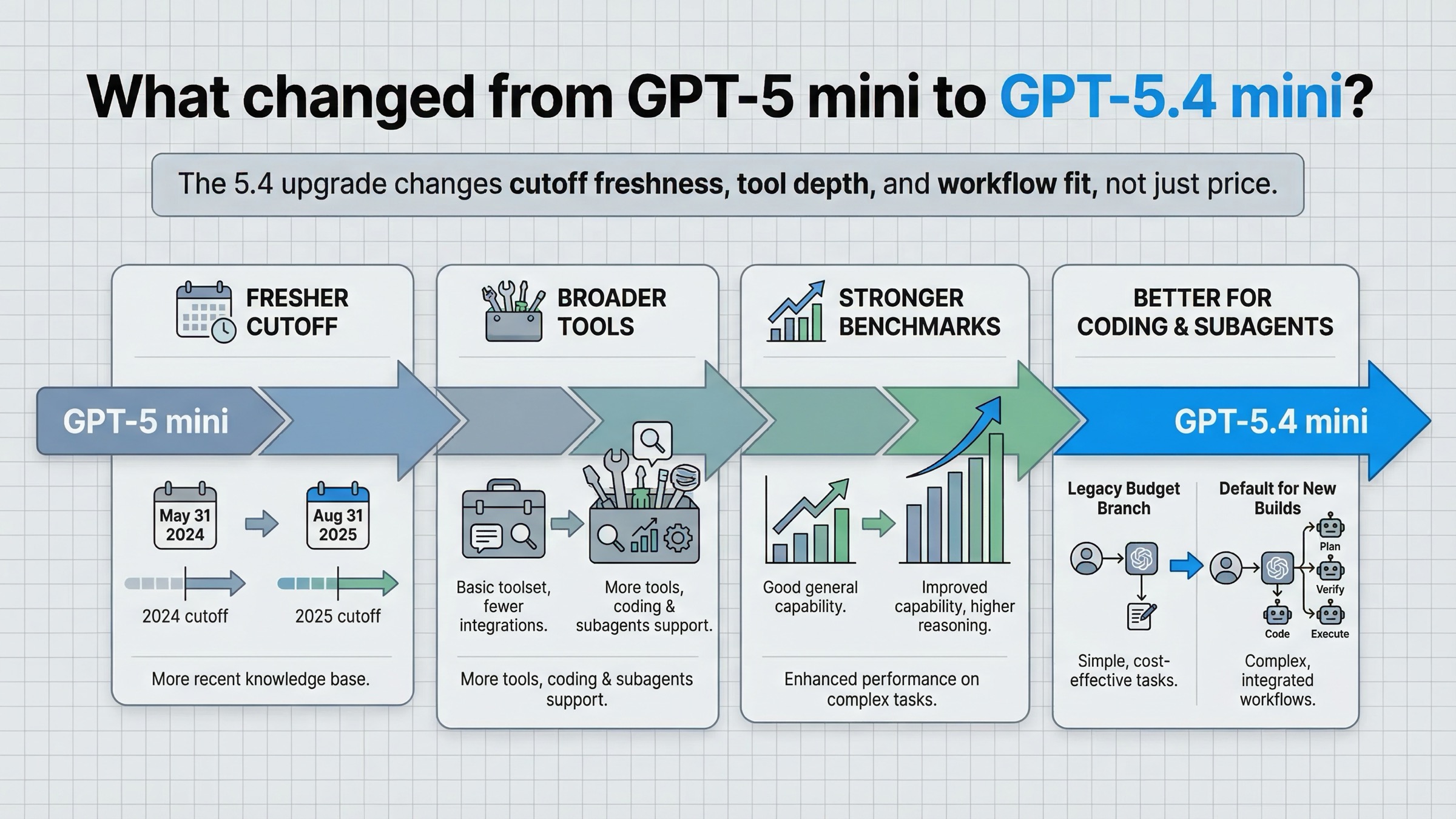

Что на самом деле изменилось при переходе с GPT-5 mini на GPT-5.4 mini

Самая частая ошибка в этой теме - считать GPT-5.4 mini косметическим патчем. Это не так. OpenAI позиционирует релиз как апгрейд маленькой модели для coding, computer use и subagents, а не как «тот же GPT-5 mini с новым индексом».

В официальном анонсе GPT-5.4 mini and nano от 17 марта 2026 года особенно важны три тезиса.

Во-первых, GPT-5.4 mini прямо заявлен как strongest mini model для coding, computer use и subagents. Это принципиально сильнее, чем просто «более дешёвый GPT-5», и показывает смену продуктовой роли модели.

Во-вторых, OpenAI утверждает, что GPT-5.4 mini превосходит GPT-5 mini в coding, reasoning, multimodal understanding и tool use, при этом работает более чем в 2 раза быстрее. Это и есть центр решения о покупке: вы платите не только за свежесть, а за модель, которая должна надёжнее работать в реальных tool-driven workflow.

В-третьих, по model cards разрыв в прикладном использовании больше, чем многие ожидают. По «голым» окнам контекста различий почти нет: у обеих моделей 400K context window и 128K max output. Разница в том, что модель умеет делать внутри этого контекста.

Коротко в операционных терминах:

| Область | GPT-5 mini | GPT-5.4 mini | Почему это важно |

|---|---|---|---|

| Позиционирование | Дешёвая small reasoning-модель в линейке GPT-5 | Strongest mini model для coding, computer use и subagents | Для новых сборок GPT-5.4 mini уже активная «базовая» ветка |

| Knowledge cutoff | 31 мая 2024 | 31 августа 2025 | GPT-5.4 mini заметно свежее |

| Tool stack | Web search, file search, code interpreter, MCP | Web search, file search, image generation, code interpreter, hosted shell, apply patch, skills, computer use, MCP, tool search | Апгрейд особенно велик для agent workflow, а не только для чата |

| Официальная рекомендация | Legacy-ветка, но доступна | Текущая рекомендация по small-model умолчанию | OpenAI направляет новые low-latency задачи именно сюда |

Именно поэтому вывод здесь может быть прямым. Если даже страница legacy-модели рекомендует для новых high-volume и low-latency сценариев начинать с более новой mini-ветки, бремя доказательства смещается: GPT-5 mini больше не default-выбор, а сценарий-исключение.

Цены, контекст и поддержка инструментов: сравнение бок о бок

Большинство команд начинает с цены, а затем смотрит на capability - и это правильный подход. Но чистая разница в стоимости вводит в заблуждение, если не сопоставлять её с разницей в инструментах и рабочем профиле.

Согласно текущей странице GPT-5.4 mini, цена GPT-5.4 mini составляет $0.75 за 1M input tokens и $4.50 за 1M output tokens. По текущей странице GPT-5 mini, GPT-5 mini стоит $0.25 за 1M input tokens и $2.00 за 1M output tokens.

То есть да: GPT-5.4 mini примерно в 3 раза дороже по input и в 2.25 раза дороже по output. Это существенный разрыв, а не статистический шум. Но это только начало сравнения.

| Характеристика | GPT-5.4 mini | GPT-5 mini |

|---|---|---|

| Input price | $0.75 / 1M tokens | $0.25 / 1M tokens |

| Cached input | $0.08 / 1M tokens | $0.025 / 1M tokens |

| Output price | $4.50 / 1M tokens | $2.00 / 1M tokens |

| Context window | 400K | 400K |

| Max output | 128K | 128K |

| Knowledge cutoff | Aug 31, 2025 | May 31, 2024 |

| Snapshot на model page | gpt-5.4-mini-2026-03-17 | gpt-5-mini-2025-08-07 |

Если смотреть только на context length, модели похожи. Поэтому многие «быстрые» сравнения останавливаются слишком рано. В таком срезе GPT-5 mini выглядит как выгодная сделка. Но как только добавляете сравнение для tool-heavy среды, картина меняется:

| Возможность | GPT-5.4 mini | GPT-5 mini |

|---|---|---|

| Web search | Да | Да |

| File search | Да | Да |

| Image generation tool | Да | Нет |

| Code interpreter | Да | Да |

| Hosted shell | Да | Нет |

| Apply patch | Да | Нет |

| Skills | Да | Нет |

| Computer use | Да | Нет |

| MCP | Да | Да |

| Tool search | Да | Нет |

| Distillation | Да | Нет |

Это и есть главный водораздел. Если ваша система - в основном «умный автокомплит» с парой простых инструментов, GPT-5 mini всё ещё может быть достаточен. Но если продукт похож на современного coding-agent, UI-agent или subagent pipeline, GPT-5.4 mini уже в другой продуктовой ветке.

Отдельно часто недооценивают фактор свежести. Разница между cutoff на 31 мая 2024 и 31 августа 2025 - реальная, когда пользователи спрашивают о новых библиотеках, API-изменениях и drift в документации 2025 года. Даже с web search более свежая базовая модель обычно уменьшает объём «ремонта» через prompt и снижает вероятность промахов.

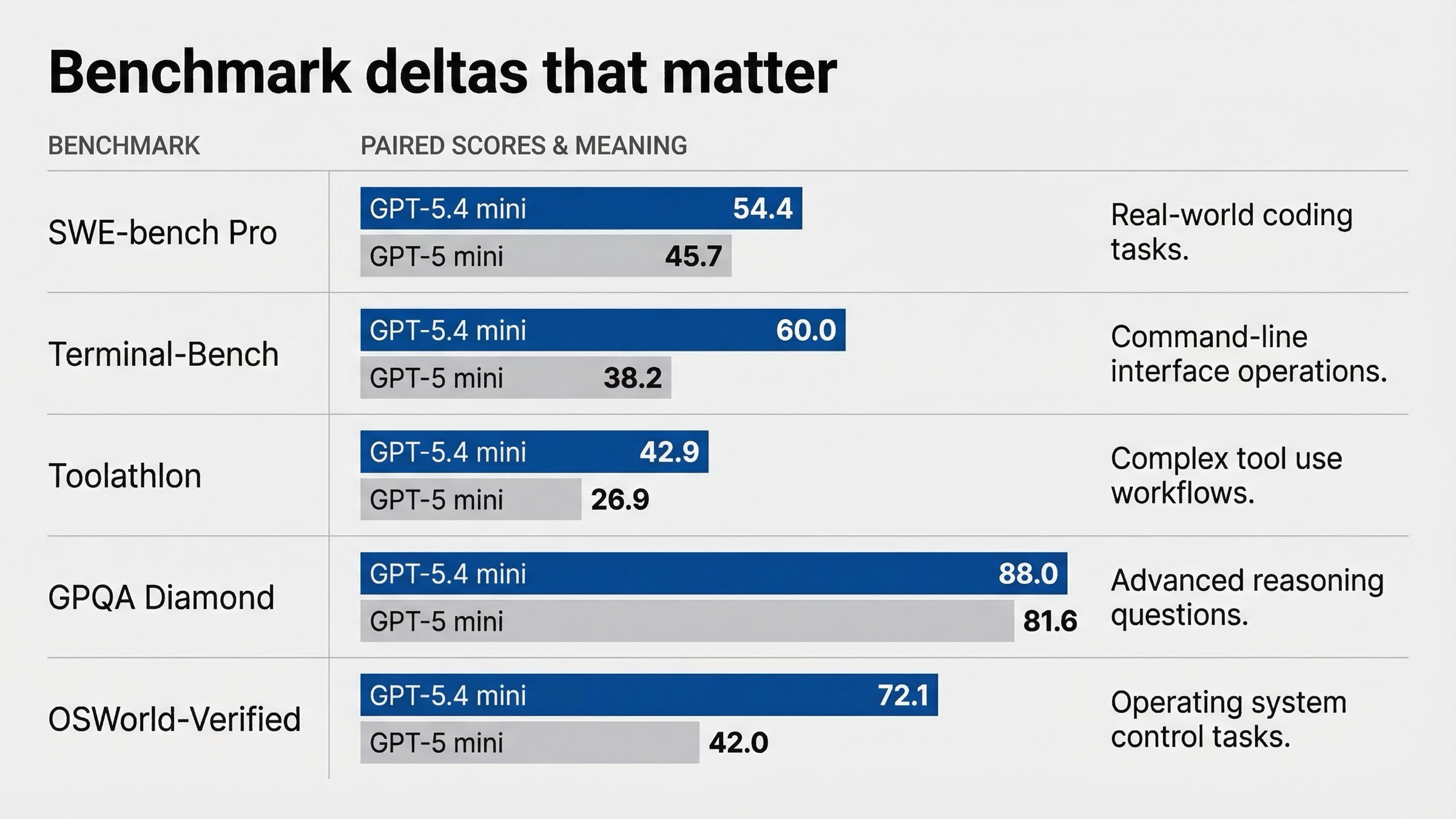

Какие бенчмарки действительно влияют на выбор

Таблицы бенчмарков полезны только тогда, когда отвечают на вопрос «что покупать». Ценность официального поста от марта 2026 в том, что он сравнивает GPT-5.4 mini с GPT-5 mini именно по тем направлениям, которые важны разработчикам: coding, tool use, intelligence, computer use и long context.

| Бенчмарк из поста OpenAI от 17 марта 2026 | GPT-5.4 mini | GPT-5 mini | Что это значит practically |

|---|---|---|---|

| SWE-bench Pro (Public) | 54.4% | 45.7% | Лучше в реальном решении software issues |

| Terminal-Bench 2.0 | 60.0% | 38.2% | Сильнее в terminal-style execution |

| Toolathlon | 42.9% | 26.9% | Надёжнее tool use |

| GPQA Diamond | 88.0% | 81.6% | Сильнее в сложном reasoning |

| OSWorld-Verified | 72.1% | 42.0% | Сильнее в computer-use workflow |

| OpenAI MRCR v2 128K-256K | 33.6% | 19.4% | Лучше при реально длинных prompt |

Три вывода важнее «сырых» значений.

Первое: GPT-5.4 mini выигрывает не на уровне статистического шума. Дельты в coding и tools достаточно большие, чтобы заметно менять поведение продукта, особенно в Terminal-Bench, Toolathlon и OSWorld-Verified. Для coding assistant, UI operator и orchestration-сценариев в стиле Codex это уже не косметика.

Второе: модель выигрывает не только в coding. В официальном сравнении GPT-5.4 mini лучше и по сильному reasoning, и по long-context retrieval. Это означает более широкий operational margin, а не только более аккуратные патчи кода.

Третье: бенчмарк-выигрыш имеет ценность только если совпадает с вашей реальной нагрузкой. Команде, которая обрабатывает миллионы коротких classification-запросов, не всегда нужен более высокий Terminal-Bench. Команде, которая делает agentic code review, test repair и screenshot interpretation, он обычно нужен.

Есть важный нюанс из самой таблицы. OpenAI отмечает, что максимальный reasoning_effort, доступный для GPT-5 mini в этом сравнении запуска, - high, а GPT-5.4 mini оценивался на xhigh. Значит, это не идеально симметричный «one-to-one lab bake-off». Таблица остаётся полезной как сравнение текущих продуктовых режимов, но её стоит читать именно как product comparison, а не как «чистый» архитектурный эксперимент.

Именно здесь у текущих страниц page-one слабое место: цифры есть, а вывод для бюджета - неочевиден. Практическое правило простое:

- Если workflow завязан на tools, coding и UI interpretation, дельты бенчмарков важны.

- Если нагрузка в основном про дешёвый массовый текстовый вывод, эти дельты могут не окупить более высокую цену.

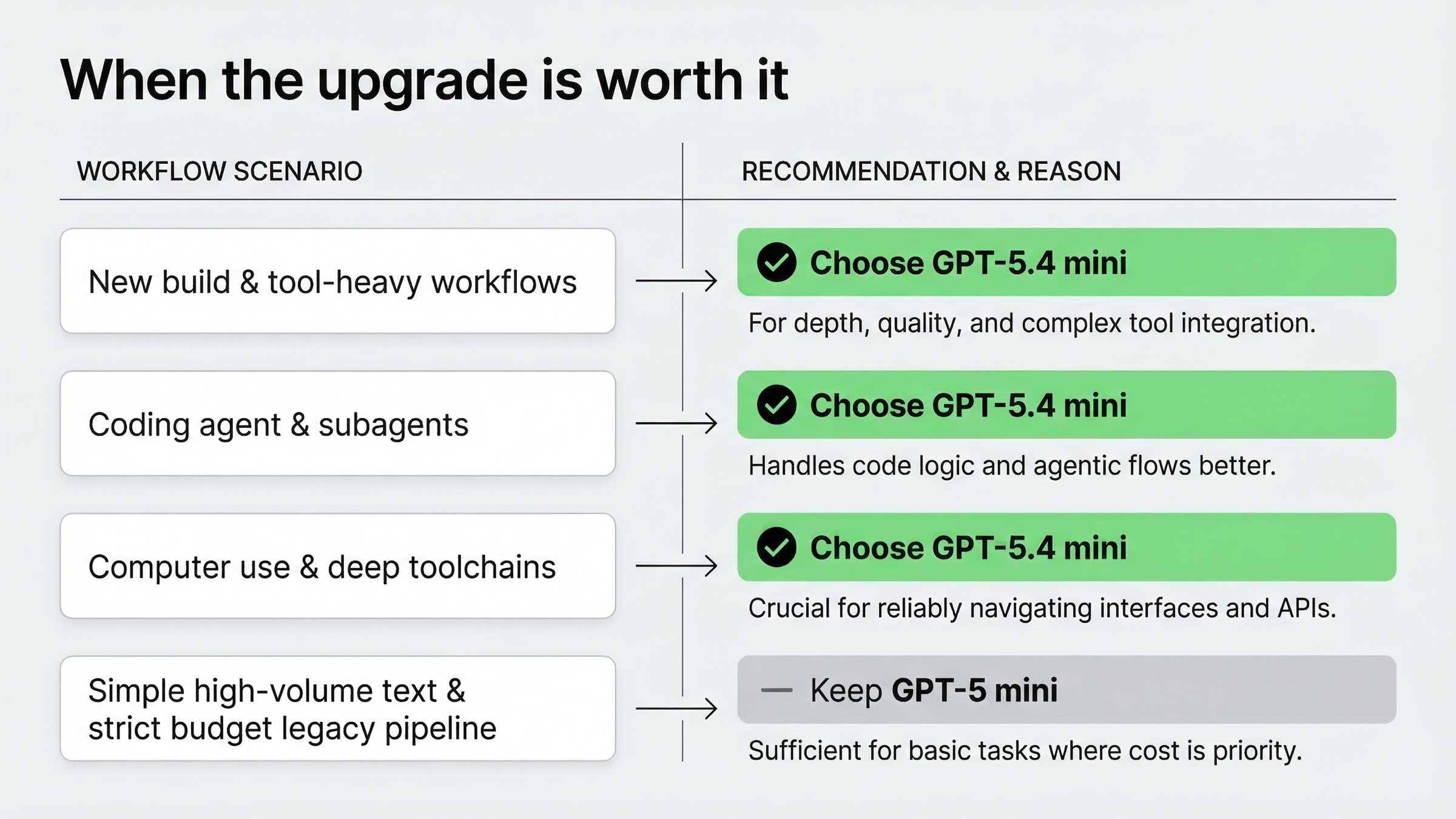

Когда переплата за GPT-5.4 mini действительно оправдана

GPT-5.4 mini оправдывает цену тогда, когда иначе ваш продукт теряет время, надёжность или инженерный ресурс на обход ограничений GPT-5 mini.

Самый очевидный кейс - coding. OpenAI позиционирует GPT-5.4 mini вокруг coding assistants и subagents, и бенчмарки это подтверждают. Если модель должна ходить по кодовой базе, восстанавливаться после tool failures, разбирать большие файлы, вызывать несколько инструментов и работать в coding harness, GPT-5.4 mini - более защищённый default.

Второй явный кейс - agent workflow с реальной глубиной инструментов. Hosted shell, apply patch, skills, computer use и tool search - это не «декоративные» фичи. Они меняют то, какую архитектуру продукта вы вообще можете построить без дополнительных special-case маршрутов на другие модели.

Третий кейс - высокая доля multimodal операций. В посте марта 2026 отдельно подчёркнуты computer use и screenshot interpretation. Если пользователи загружают dashboard-скриншоты, баг-экраны или плотные UI-состояния, OpenAI фактически направляет эти задачи в сторону GPT-5.4 mini.

Четвёртый кейс - миграция с «дешёвых reasoning»-веток типа o4-mini. В latest GPT-5.4 guide OpenAI прямо пишет, что gpt-5.4-mini - хороший replacement для o4-mini и gpt-4.1-mini. Это сильный сигнал, куда развивается small-model линейка.

Обычно переплата оправдана, если у вас один или несколько таких профилей:

- coding assistant с высоким требованием к надёжному tool calling и patch-операциям;

- UI-agent, который читает скриншоты и делает computer-use actions;

- subagent-воркер внутри более крупной orchestration-системы;

- продукт, где более свежая база знаний по экосистеме 2025 снижает поддержку и число ошибок;

- команда, которая иначе будет тратить часы на prompt-тюнинг под legacy-ограничения GPT-5 mini.

Когда GPT-5 mini всё ещё имеет смысл

GPT-5 mini остаётся разумным выбором, когда нагрузка настолько проста, что дополнительные возможности GPT-5.4 mini остаются недоиспользованными.

Самый сильный сценарий - cost-sensitive legacy traffic. Если GPT-5 mini уже работает в проде, ваши prompt стабильны, инструментальная глубина невысокая, а fail-rate приемлем, перевод всего трафика на GPT-5.4 mini может увеличить расходы быстрее, чем пользовательскую ценность.

Второй сценарий - простые high-volume текстовые задачи. Если workload состоит в основном из коротких структурированных ответов, лёгкой генерации и узкого routing, GPT-5 mini может оставаться более дешёвой операционной точкой. В такой ситуации часто полезнее сравнивать не только GPT-5.4 mini и GPT-5 mini, но и GPT-5 mini против GPT-5.4 nano.

Третий сценарий - уже разделённая архитектура маршрутизации. Например, тяжёлые ветки отправляются в более сильную модель, а лёгкие остаются на дешёвой. В таком дизайне GPT-5 mini может продолжать жить как «дешёвая ветка», если бенчмарк-чувствительные и tool-чувствительные задачи уже вынесены отдельно.

GPT-5 mini стоит оставить, если совпадает большинство пунктов:

- ваши запросы в основном plain text, а не tool-heavy;

- вам не нужны hosted shell, apply patch, skills, computer use и tool search;

- вы больше оптимизируете token spend, чем качество coding/agent поведения;

- вы донастраиваете существующую систему, а не проектируете новую с нуля.

При этом важно не зафиксироваться на предположении, что GPT-5 mini «всегда будет самым дешёвым хорошим вариантом». Текущая документация OpenAI уже направляет новые workloads в сторону 5.4-линейки, а это обычно индикатор долгосрочного продуктового фокуса.

Миграция действующих нагрузок с GPT-5 mini

Если вы уже используете GPT-5 mini, не мигрируйте «вслепую». Тестируйте те workflow, где вы реально теряете деньги или доверие пользователей.

Стартовый чеклист:

| Вопрос миграции | Почему это важно |

|---|---|

| Выигрывает ли ваш workload от более надёжного tool use? | Самые сильные преимущества GPT-5.4 mini - именно в coding и tools, а не только в качестве текста |

| Нужна ли более свежая база знаний без избыточной зависимости от web search? | Разрыв по cutoff большой |

| Используете ли вы agent-возможности, которых нет в GPT-5 mini? | Hosted shell, apply patch, skills, computer use и tool search указывают в сторону GPT-5.4 mini |

| Нагрузка действительно latency-sensitive, но при этом простая? | Если да, давление по стоимости может оставлять смысл в GPT-5 mini или GPT-5.4 nano |

Есть и отдельный практический угол - поведение prompt-параметров. В latest GPT-5.4 guide отмечено, что старые модели GPT-5 family ведут себя иначе, чем GPT-5.4, при некоторых настройках. Дополнительно в OpenAI Developer Community разработчики описывали реальное трение со старыми GPT-5 и GPT-5 mini в deterministic low-latency задачах, особенно когда требовалось полностью отключить reasoning. Это важно, потому что в проде команды сравнивают модели не в «стерильном» бенчмарк-стенде, а в ограничениях реальной системы.

Практическая стратегия миграции:

- Сначала тестируйте GPT-5.4 mini на слабых местах текущего GPT-5 mini: coding, цепочки tools, structured action extraction и screenshot-heavy reasoning.

- Оставляйте GPT-5 mini только там, где измеренный прирост мал, а рост стоимости велик.

- Для очень простых и price-sensitive задач дополнительно сравните, не покрывает ли дешёвую ветку лучше сценарий уровня o4-mini (англ.) или GPT-5.4 nano.

Если вы только начинаете работу с API, сначала пройдите базовую настройку по инструкции получения OpenAI API key (англ.), а затем тестируйте GPT-5.4 mini как исходный baseline. Это соответствует и текущей документации, и практическому направлению развития линейки.

ChatGPT и API: не смешивайте эти поверхности

В этом запросе часто возникает путаница, потому что слово «mini» встречается в нескольких местах продукта, и создаётся впечатление, что названия полностью взаимозаменяемы.

Это не так.

В анонсе OpenAI от 17 марта 2026 года GPT-5.4 mini and nano сказано, что GPT-5.4 mini доступен в API, Codex и ChatGPT. Но актуальная статья Help Center, перепроверенная 20 марта 2026 года, уже описывает другую картину: базовой линией ChatGPT для авторизованных пользователей стал GPT-5.3, платные тарифы могут вручную выбирать GPT-5.4 Thinking, а после части лимитов чат переключается на более общую mini-версию модели. Поэтому сравнение API в этой статье нельзя читать как прямое соответствие названиям в ChatGPT model picker.

Если вы принимаете решение для API, приоритет - model pages и API guides. Если вы решаете вопрос по планам ChatGPT, важнее Help Center и правила availability. Эта статья в первую очередь про API и usage в стиле Codex; блок про ChatGPT нужен только для снятия путаницы в названиях.

FAQ: Часто задаваемые вопросы

GPT-5 mini уже deprecated?

Нет. На 20 марта 2026 у GPT-5 mini есть актуальная model page и действующая цена в API. Но это уже более старая small-model ветка, а не та, которую OpenAI рекомендует по умолчанию для новых low-latency/high-volume задач.

GPT-5.4 mini полностью заменяет GPT-5 mini?

Функционально - это более сильный default для большинства новых сборок. Операционно - нет: GPT-5 mini продолжает существовать и может быть лучше в узких cost-sensitive сценариях. Корректная модель мышления: GPT-5.4 mini как активная рекомендованная ветка, GPT-5 mini как более дешёвая legacy-ветка.

Что выбрать для coding agents и subagents в стиле Codex?

GPT-5.4 mini. Именно так его позиционирует OpenAI, и официальные бенчмарки марта 2026 поддерживают это решение.

Что выбрать для дешёвых high-volume текстовых задач?

Если нагрузка достаточно простая и tool-light, GPT-5 mini всё ещё может быть рациональным. Но перед фиксацией решения проверьте и GPT-5.4 nano: GPT-5 mini больше не выглядит «очевидной» будущей дешёвой базой.

Какая модель лучше для deterministic low-latency задач?

Это зависит от ваших prompt, формата ответа и ограничений в проде. По обсуждениям в OpenAI Developer Community старые workflow на GPT-5 mini иногда создавали трение, когда требовалось полностью не-рассуждающее поведение. Если задача реально простая и deterministic, проверяйте на собственных тестах, а не по инерции legacy-выбора.

Итоговая рекомендация

Если нужен один тезис для команды, используйте его: в 2026 году GPT-5.4 mini - это правильный default, если у вас нет конкретной cost-driven причины оставаться на GPT-5 mini.

Этот вывод опирается на четыре факта, перепроверенные 20 марта 2026:

- OpenAI рекомендует GPT-5.4 mini для большинства новых low-latency/high-volume workloads.

- GPT-5.4 mini имеет существенно более широкий tool stack для агентных и coding-сценариев.

- В официальном сравнении от 17 марта 2026 GPT-5.4 mini показывает заметный прирост над GPT-5 mini в coding, tool use, computer use и reasoning.

- GPT-5 mini дешевле, но это уже не default-маршрут для новых систем.

То есть реальный вопрос не в том, «лучше ли GPT-5.4 mini». Лучше. Реальный вопрос - достаточно ли прост ваш workload, чтобы осознанно отказаться от этого прироста и остаться на более дешёвой старой ветке. Для многих API-команд в 2026 ответ будет «нет».