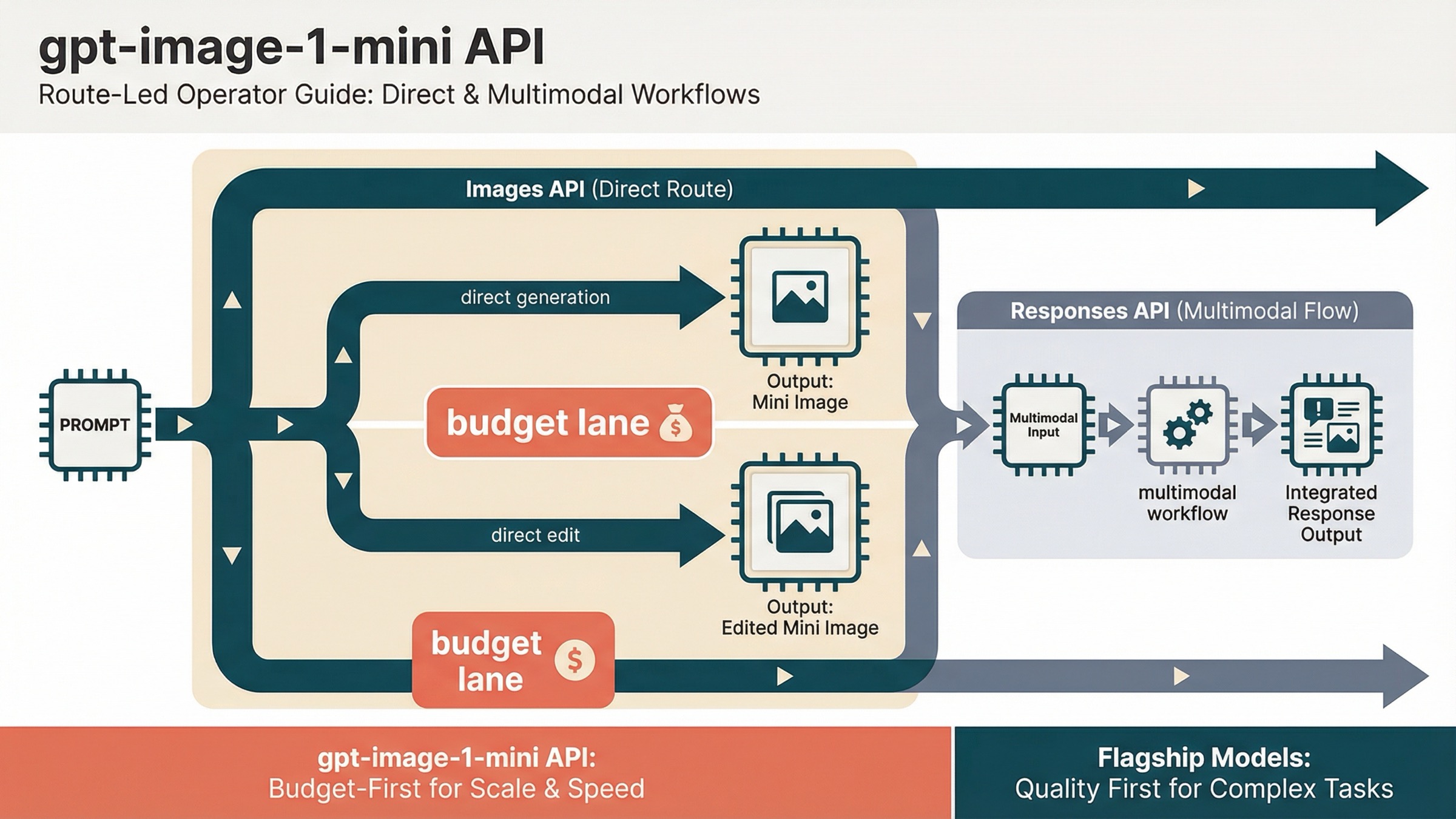

2026년 3월 27일 기준 gpt-image-1-mini API의 가장 안전한 기본값은 분명합니다. direct generation 이나 direct edit 라면 먼저 OpenAI Images API를 쓰고, image generation이 더 큰 multimodal workflow 안의 한 tool일 때만 Responses API로 넘어갑니다. 지금 exact-query page one 이 가장 약하게 설명하는 지점도 바로 이 route split입니다.

이 키워드가 필요 이상으로 헷갈리는 이유는 OpenAI가 답을 숨겨서가 아니라 답을 여러 페이지에 나눠 놓았기 때문입니다. gpt-image-1-mini model page는 current pricing, endpoints, rate limits를 보여 줍니다. image-generation guide는 direct generation / edit 에서는 Image API가 더 낫고, broader conversational image experience라면 Responses가 맞다고 설명합니다. images and vision guide는 Responses 쪽 tool usage를 보여 줍니다. 한 페이지만 읽으면 route 전체가 보이지 않습니다.

그래서 exact keyword를 잡은 thin wrapper page 들은 종종 "mini는 OpenAI의 더 싼 image model"까지는 말해도, 그래서 첫 request를 어디에 보내야 하는지 는 명확하게 못 말합니다. 이 글은 더 넓은 OpenAI image API tutorial을 다시 쓰는 글이 아니라, 이미 gpt-image-1-mini까지 좁혀진 reader가 첫 implementation을 어디서 시작해야 하는지만 정확히 정리하는 글입니다.

핵심 요약

- direct generation, direct edit 는 Images API부터 시작한다.

- image generation이 assistant workflow 안의 한 단계라면 Responses API를 쓴다.

gpt-image-1-mini는 budget lane이지 universal default가 아니다.- SDK sample을 의심하기 전에 tier access 와 organization verification 을 먼저 확인한다.

가장 짧은 direct path부터 통과시키자

이 키워드에서 제일 중요한 첫 성공은 "모든 옵션을 한 번에 쓰는 request"가 아니라 "가장 적게 실패할 direct request"입니다. current OpenAI guide는 이미지 한 장을 prompt로 생성하거나 직접 편집할 때는 Image API가 더 적합하다고 말합니다. 많은 개발자가 Responses 예제를 먼저 보고 "더 최신 abstraction이니까 이것부터"라고 생각하는데, gpt-image-1-mini exact query에서는 대개 그 반대가 더 안전합니다.

가장 단순한 generation path는 이렇게 시작하면 됩니다.

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const result = await client.images.generate({ model: "gpt-image-1-mini", prompt: "Create a clean editorial illustration of a robot photographer in a bright studio", size: "1024x1024", quality: "medium", output_format: "jpeg", output_compression: 80, }); const imageBase64 = result.data[0].b64_json; fs.writeFileSync( "gpt-image-1-mini-demo.jpg", Buffer.from(imageBase64, "base64") );

Python도 똑같이 짧습니다.

pythonfrom openai import OpenAI import base64 client = OpenAI() result = client.images.generate( model="gpt-image-1-mini", prompt="Create a clean editorial illustration of a robot photographer in a bright studio", size="1024x1024", quality="medium", output_format="jpeg", output_compression=80, ) image_base64 = result.data[0].b64_json with open("gpt-image-1-mini-demo.jpg", "wb") as f: f.write(base64.b64decode(image_base64))

첫 request를 일부러 boring하게 유지하는 이유는 간단합니다. 여기서 확인해야 할 것은 current model ID, current project / org, account access, output handling입니다. 첫 시도부터 larger workflow처럼 만들수록 실제 blocker가 route인지 access인지 code인지 구분하기 어려워집니다.

조금 더 직설적으로 말하면, 첫 성공은 일부러 평범해야 합니다. 첫 요청에서 증명해야 하는 것은 모든 옵션을 다 안다는 사실이 아니라, 올바른 project, 올바른 model, 올바른 access, 올바른 저장 처리가 한 번에 맞물리는지입니다. OpenAI docs에는 size, quality, transparency, edit 입력 같은 옵션도 많지만, 그런 확장은 가장 짧은 direct generation이 먼저 통과한 뒤에 붙이는 편이 훨씬 안전합니다.

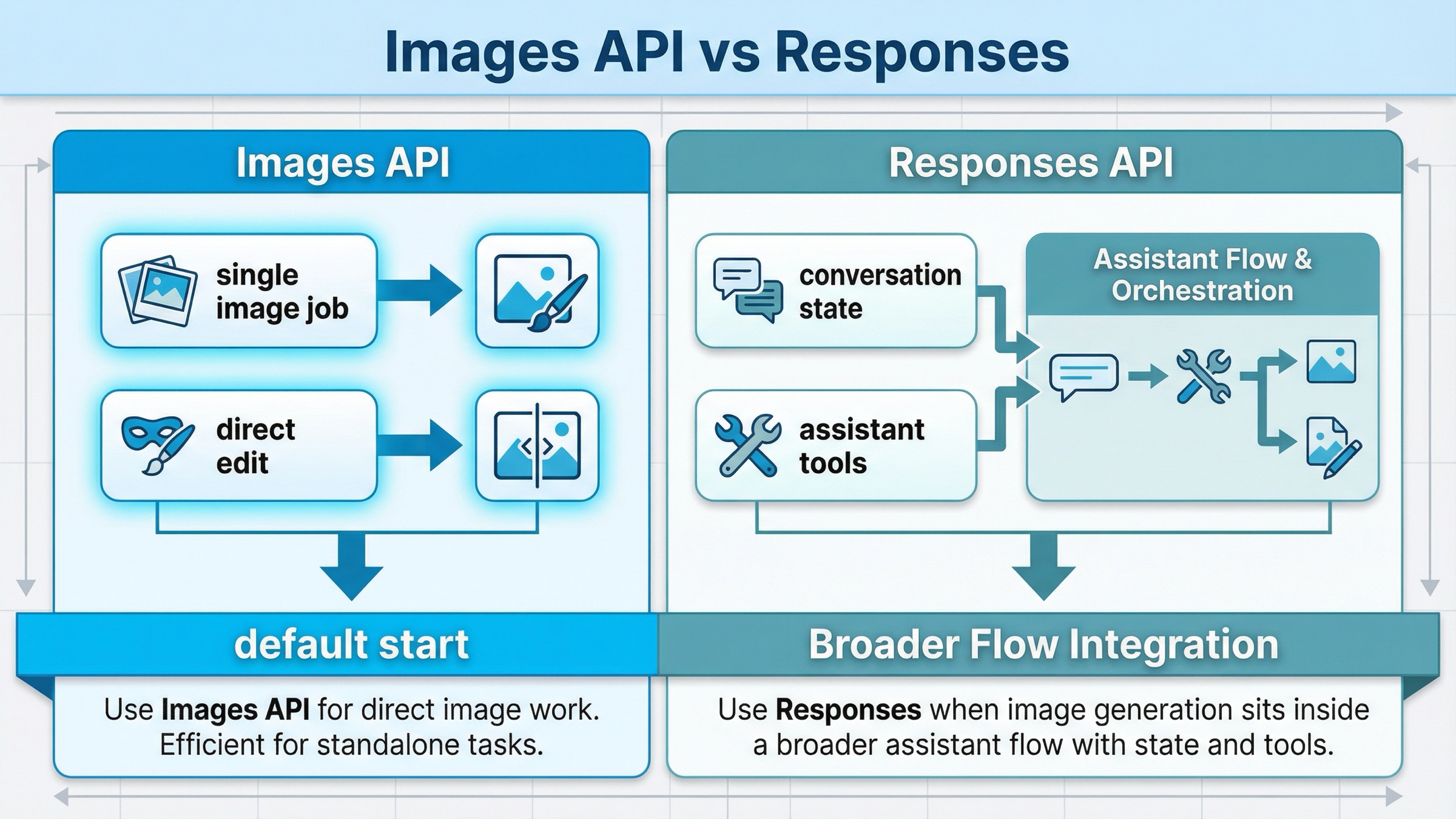

Images API vs Responses for gpt-image-1-mini

이 키워드에서 필요한 route table은 사실 하나면 충분합니다.

| 상황 | 더 나은 기본값 | 이유 |

|---|---|---|

| prompt 하나로 이미지 한 장을 바로 만들고 싶다 | Images API | 가장 짧은 path, 가장 쉬운 debugging |

| 입력 이미지를 직접 edit 하고 싶다 | Images API | 같은 direct route 안에서 해결된다 |

| 이미지 생성이 multimodal assistant 안의 한 step이다 | Responses API | image generation이 larger flow 안의 tool이기 때문 |

| conversation state, tools, reasoning steps와 이미지를 한 request에 묶고 싶다 | Responses API | 여기서는 outer workflow가 abstraction을 결정한다 |

| exact model을 가장 빨리 검증하고 싶다 | Images API | moving parts가 적다 |

정리하면 이렇습니다. 이미지 생성 자체가 기능이면 Images API로 시작하고, 이미지 생성이 더 큰 workflow 안의 일부일 때만 Responses로 간다.

이것이 current official docs를 가장 안전하게 읽는 방법입니다. image-generation guide는 route rule을 주고, images-and-vision guide는 Responses 안에서 image tool이 어디에 들어가는지 보여 줍니다. 즉 Responses가 더 "modern"해 보여도, direct image job까지 무조건 అక్కడ서 시작해야 한다는 뜻은 아닙니다.

팀 안에서 "요즘 예제가 다 Responses니까 새 프로젝트도 전부 저걸로 가자"는 말이 나와도 같은 기준으로 보면 됩니다. 그 request에 정말 conversation state, 여러 tools, mixed output이 필요한지 먼저 물어야 합니다. 필요 없다면 더 큰 abstraction을 먼저 고르는 것은 기술적 일관성보다 초기 복잡도만 키우는 선택일 가능성이 큽니다.

Responses가 맞는 경우는 어떤 모양인가

Responses 혼란을 줄이는 가장 좋은 방법은, 그 route를 실제로 맞는 문맥 안에서 보는 것입니다. current OpenAI docs에서 Responses image generation은 어디까지나 더 큰 request 안의 tool이지, images.generate()를 무조건 대체하는 default가 아닙니다.

그래서 mental model이 달라집니다.

- top-level request는 multimodal / assistant request다

- image generation은 그 안의 한 tool이다

gpt-image-1-mini라는 model name 때문에 route가 바뀌는 것이 아니라, outer workflow가 바꾸는 것이다

최소 예제는 대략 이런 모양입니다.

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const response = await client.responses.create({ model: "gpt-4.1-mini", input: "Generate a transparent sticker-style icon of a paper airplane", tools: [{ type: "image_generation", quality: "medium" }], }); const imageBase64 = response.output .filter((item) => item.type === "image_generation_call") .map((item) => item.result)[0]; fs.writeFileSync("paper-airplane.png", Buffer.from(imageBase64, "base64"));

이 route가 맞는 경우는 assistant flow, conversation state, tool orchestration이 실제 요구사항일 때입니다. 반대로 그냥 "prompt 주고 이미지 한 장 받아 파일로 저장"이 목표라면 direct Images API가 훨씬 작은 failure surface를 제공합니다.

바로 이 점 때문에 exact-match 결과를 읽을 때 잘못된 인상을 받기 쉽습니다. 겉으로는 두 개의 API surface 중 취향에 따라 고르는 것처럼 보이지만, 실제로는 첫 구현을 불필요하게 무겁게 만들지 말아야 한다는 문제에 더 가깝습니다. gpt-image-1-mini라는 모델 이름 자체가 더 넓은 route를 강요하는 것은 아닙니다.

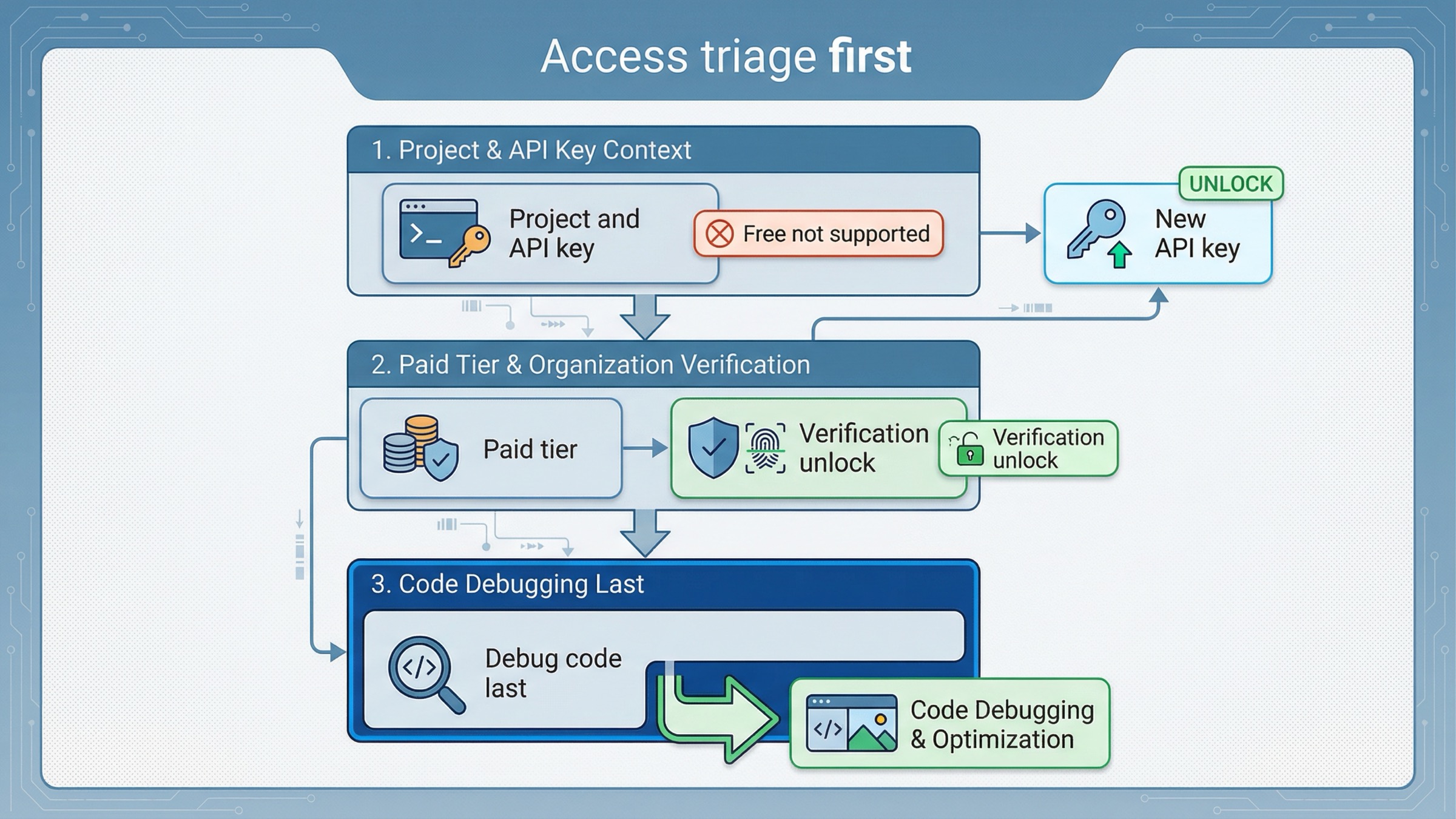

access를 먼저 확인하고, code는 나중에 본다

exact-query 페이지가 가장 자주 시간을 낭비시키는 지점이 여기입니다. 샘플 코드부터 보여 준 뒤, 한참 지나서야 "사실 account가 아직 ready가 아닐 수도 있다"고 말합니다.

OpenAI의 current API model availability article는 GPT-image-1과 GPT-image-1-mini가 tiers 1 through 5에서 사용 가능하지만 일부 access는 organization verification에 달려 있다고 설명합니다. current gpt-image-1-mini model page는 Free not supported, Tier 1 100,000 TPM / 5 IPM도 명시합니다.

그래서 가장 안전한 troubleshooting order는 이렇습니다.

- API key가 맞는 project / organization에 연결되어 있는지 확인한다.

- account가 실제로 paid tier에 올라와 있는지 확인한다.

- 막혀 있으면 organization verification이 blocker인지 확인한다.

- 여기까지 맞는데도 안 되면 그때 prompt, SDK code, output parsing을 의심한다.

OpenAI의 current organization verification help page는 verification이 image generation capability를 unlock할 수 있고, 상태 반영에 최대 30분이 걸릴 수 있으며, lingering not-verified error는 새 API key를 만들면 풀리는 경우가 있다고 적습니다. 이것은 code bug branch가 아니라 account-state branch입니다.

permission과 verification이 진짜 blocker라면 다음 읽을거리는 OpenAI image generation API verification입니다.

이 부분은 한 번 더 강조할 필요가 있습니다. access를 확인하기 전에 prompt를 바꾸고, SDK 버전을 바꾸고, 심지어 Responses로 route 자체를 갈아타도 근본 원인이 account state라면 아무 도움도 되지 않습니다. gpt-image-1-mini 초기 통합에서는 code보다 account readiness를 먼저 의심하는 편이 대개 더 빠릅니다.

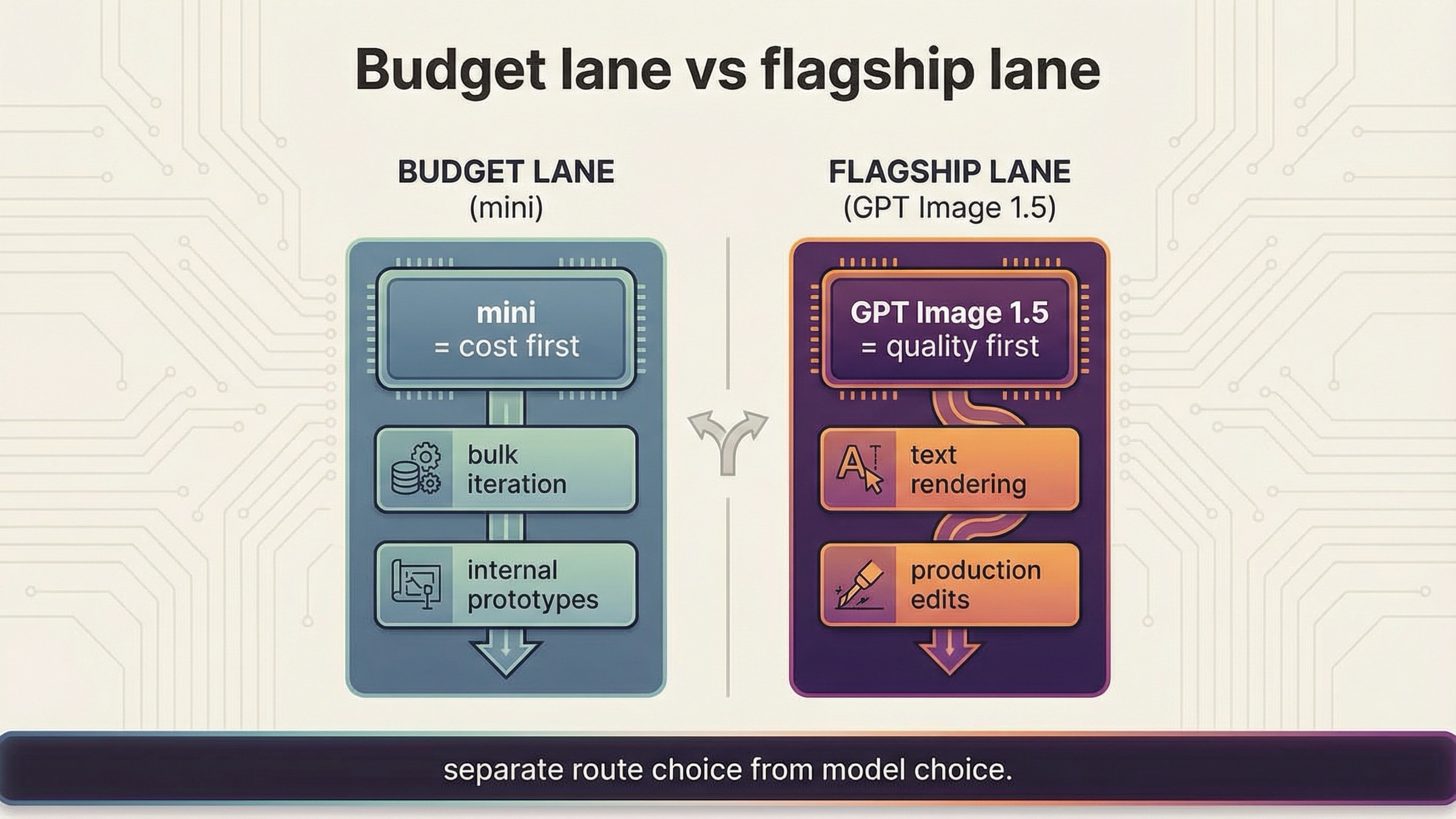

언제 gpt-image-1-mini가 맞고, 언제 GPT Image 1.5를 다시 봐야 하나

여기서는 솔직해야 합니다. gpt-image-1-mini는 budget lane이지 universal lane이 아닙니다. current image-generation guide는 best experience를 위해 GPT Image 1.5를 추천하고, image quality가 priority가 아닐 때 더 cost-effective한 option으로 mini를 보라고 합니다. current mini model page는 1024x1024 low / medium / high를 $0.005 / $0.011 / $0.036으로 보여 줍니다.

이 가격 구조가 특히 강한 경우는 다음과 같습니다.

- bulk iteration

- internal prototypes

- low-stakes draft generation

- cost ceiling이 품질보다 더 중요한 feature

하지만 여기서 내리면 안 되는 결론은 "그러면 앞으로 다 mini"입니다. 맞는 해석은 cost가 첫 번째 제약일 때 mini가 first benchmark라는 것입니다.

반대로 text rendering, cleaner premium output, edit-heavy production, retry 비용이 더 중요한 workload라면, 진짜 비교는 mini vs Responses가 아니라 mini vs GPT Image 1.5가 됩니다. 그때는 OpenAI image generation API pricing이나 GPT Image 1.5 API pricing이 더 적절한 다음 글입니다. 질문이 route를 넘어 total workflow cost로 이동했기 때문입니다.

여기서 자주 생기는 오해는 "한 장 가격이 더 싸면 전체 workflow도 더 싸다"는 식의 단순화입니다. 실제 제품 비용에는 retry, 품질 부족으로 인한 재작업, 후처리 시간도 들어갑니다. mini의 가격 이점은 분명하지만, 그 이점이 모든 생산 환경에서 그대로 총비용 우위로 이어지는 것은 아닙니다.

direct edit도 결국 같은 route다

여기서 wrapper page들이 자주 과장하는 부분이 하나 있습니다. edit를 한다고 해서 갑자기 두 번째 API 세계로 넘어가야 하는 것은 아닙니다. current mini model page는 v1/images/generations 와 v1/images/edits 를 둘 다 보여 줍니다. 즉 generation이 이미 Images API 위에 있다면, edit도 보통 같은 direct route 안에 남아 있습니다.

예를 들면:

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const result = await client.images.edit({ model: "gpt-image-1-mini", image: fs.createReadStream("room.png"), prompt: "Turn this room into a bright Nordic living room with pale oak shelves and soft morning light.", size: "1024x1024" }); const imageBase64 = result.data[0].b64_json; fs.writeFileSync("room-nordic.png", Buffer.from(imageBase64, "base64"));

route rule는 그대로입니다. direct edit면 Images API에 남고, edit가 larger assistant workflow의 한 단계일 때만 Responses를 검토하면 됩니다.

Troubleshooting: thin wrapper page가 해결해 주지 않는 문제

좋은 exact-match 글이 해야 할 일은 "모델이 있다"를 말하는 것이 아니라, 첫 성공 후에도 계속 남는 실수를 줄여 주는 것입니다.

첫 번째 실수는 Responses로 너무 빨리 가는 것 입니다. direct image feature인데 더 큰 abstraction부터 잡으면 route와 code를 동시에 헷갈리기 쉽습니다.

두 번째 실수는 mini를 모든 workload의 정답처럼 읽는 것 입니다. official docs는 mini를 cost-efficient branch로, GPT Image 1.5를 best-experience branch로 둡니다. 그 차이를 지우면 결국 wrong benchmark에서 출발하게 됩니다.

세 번째 실수는 access state를 확인하기 전에 code를 갈아엎는 것 입니다. tier access와 organization verification은 image capability를 직접 막을 수 있습니다. account가 ready가 아니면 두 번째 sample도 소용없습니다.

네 번째 실수는 exact keyword page가 그냥 model card면 충분하다고 생각하는 것 입니다. 실제 reader는 "어디서 시작하지?"와 "언제 이 default를 버려야 하지?"를 같이 알고 싶어합니다.

추가로 자주 반복되는 실패 branch도 세 가지는 바로 떠올릴 수 있습니다. 첫 request가 access류 오류로 끝나면 오래된 sample보다 tier, project, verification을 먼저 보는 편이 맞습니다. request는 성공하지만 결과 품질이 약하면 endpoint보다 mini의 적합성을 다시 봐야 합니다. Responses를 쓰고 싶은 이유가 "문서에서 더 자주 보여서"뿐이라면, 그 request에 정말 larger multimodal workflow가 필요한지 다시 물어봐야 합니다.

FAQ

gpt-image-1-mini로 direct edit도 할 수 있나요?

할 수 있습니다. current model page는 v1/images/generations와 v1/images/edits를 모두 지원 endpoint로 보여 줍니다.

gpt-image-1-mini에 free tier가 있나요?

2026년 3월 27일 기준 current model page는 Free not supported라고 적고 있습니다. 실제 출발점은 paid Tier 1입니다.

언제 GPT Image 1.5를 바로 봐야 하나요?

output quality, stronger text rendering, complex edit reliability, retry-sensitive production work가 중요하면 GPT Image 1.5를 같이 benchmark 해야 합니다.

마지막 권장안

지금 gpt-image-1-mini를 붙인다면 먼저 Images API를 쓰세요. 첫 generation request도, 첫 edit request도 그 route에서 시작하고, request는 충분히 단순하게 유지해서 access와 output handling을 쉽게 확인하세요. Responses는 image generation이 larger multimodal workflow 안의 한 tool일 때만 쓰면 됩니다.

그 다음에 별도로 물어야 할 질문은 이것입니다. mini가 정말 이 workload에 맞는 model인가? cost가 첫 번째 제약이면 mini는 좋은 first benchmark입니다. 하지만 quality, text rendering, heavy edit가 더 중요하면 가장 싼 sticker price가 최종 답이 아닙니다. 이 키워드에서 제일 중요한 것은 결국 route choice와 model choice를 분리해서 보는 것 입니다.