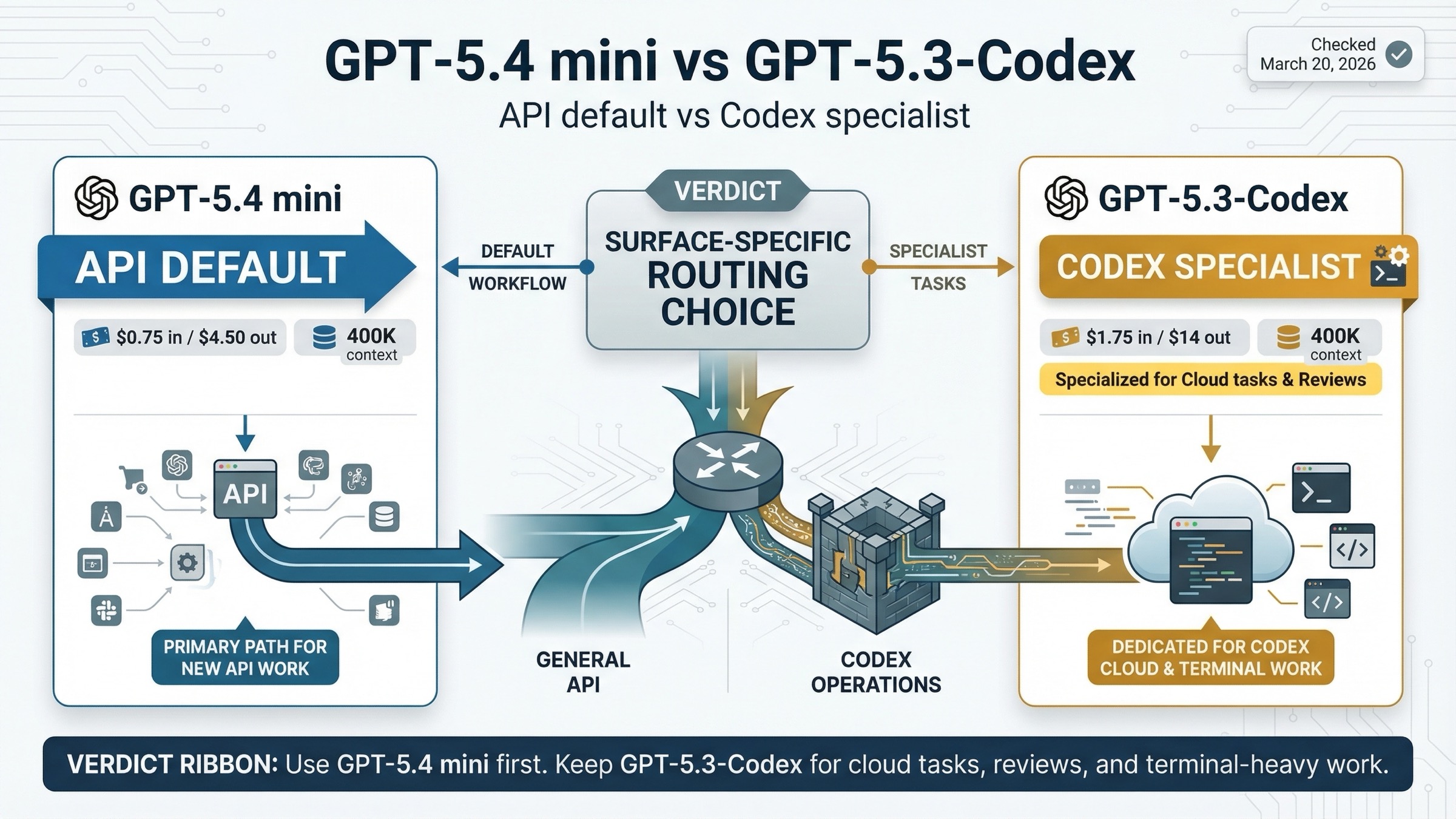

새로운 API 와 subagent 작업에는 GPT-5.4 mini 를 쓰세요. code review, terminal 작업, 더 깊은 coding behavior 가 소형 모델 가격 효율보다 더 중요하다면 Codex 안에서는 GPT-5.3-Codex 를 유지하는 편이 맞습니다.

이 비교는 surface 를 분리해야 선명해집니다. API 에서는 GPT-5.4 mini 가 많은 고볼륨 coding workflow 에서 더 저렴하고 더 새로운 기본값입니다. 반면 Codex 스타일 환경에서는 GPT-5.3-Codex 가 여전히 더 강한 specialist coding posture 를 갖고 있습니다.

핵심 요약

가장 짧은 답은 이렇습니다. 새 API 코딩과 서브에이전트는 GPT-5.4 mini, Codex의 cloud tasks·reviews·터미널 중심 작업은 GPT-5.3-Codex 입니다.

| 모델 | 추천 시나리오 | 선택 이유 | 망설일 이유 |

|---|---|---|---|

| GPT-5.4 mini | 새 API 코딩 워커, 저비용 subagent, 스크린샷 해석 워커, Codex 로컬 루틴 | API가 저렴하고 도구 폭이 넓으며 현재 추천 mini 라인 | specialist coding 벤치마크는 GPT-5.3-Codex가 더 강하고 Codex cloud tasks / reviews를 아직 지원하지 않음 |

| GPT-5.3-Codex | terminal-heavy 코딩, Codex cloud tasks, Codex code reviews, 더 깊은 코딩 루프 | SWE-Bench Pro와 Terminal-Bench 프로필이 강하고 Codex 제품 슬롯이 더 넓음 | API 비용이 훨씬 높고 더 이상 기본 소형 추천은 아님 |

바로 적용 가능한 규칙은 다음과 같습니다.

- 새 API 코딩 워크플로를 만들면 먼저 GPT-5.4 mini를 테스트합니다.

- Codex에서 cloud tasks 또는 GitHub code reviews가 필요하면 GPT-5.3-Codex를 유지합니다.

- terminal-heavy 엔지니어링 루프라면 GPT-5.3-Codex 쪽이 아직 더 강합니다.

- ChatGPT 모델 이름만 보고 API / Codex 선택을 대신하지 않습니다.

GPT-5.4 mini와 GPT-5.3-Codex의 진짜 차이

이 비교에서 가장 흔한 오해는 GPT-5.4 mini를 “더 싸고 더 작은 GPT-5.3-Codex” 정도로 보는 것입니다. 실제로는 그렇지 않습니다.

현재 공식 모델 페이지 기준으로 두 모델은 다음 상위 스펙이 꽤 비슷합니다.

- 400K context window

- 128K max output

- 2025-08-31 knowledge cutoff

- text / image input 지원

그래서 스펙 카드만 대충 보면 비슷해 보입니다. 하지만 실제 선택을 가르는 것은 이런 정적 숫자가 아니라 제품 역할입니다.

OpenAI의 Using GPT-5.4 guide는 gpt-5.4-mini를 high-volume coding, computer use, agent workflows의 추천 모델로 둡니다. 즉 지금의 mini 기본값에 가깝습니다.

반대로 GPT-5.3-Codex model page는 이 모델을 the most capable agentic coding model to date로 설명하고, Codex 또는 유사 환경에 최적화된 specialist로 다룹니다.

실무 관점에서 보면 다음처럼 기억하는 것이 가장 쉽습니다.

| 질문 | 더 맞는 모델 |

|---|---|

| 현재 API 기본 small model이 필요한가 | GPT-5.4 mini |

| 더 깊은 specialist coding lane이 필요한가 | GPT-5.3-Codex |

| Codex cloud tasks / reviews가 필요한가 | GPT-5.3-Codex |

| 저렴한 로컬 루틴 작업이나 subagent가 필요한가 | GPT-5.4 mini |

즉 이 비교는 한 모델이 다른 모델을 완전히 지우는 이야기가 아니라, API 기본 라인과 Codex specialist 라인을 어떻게 나눌지의 문제입니다.

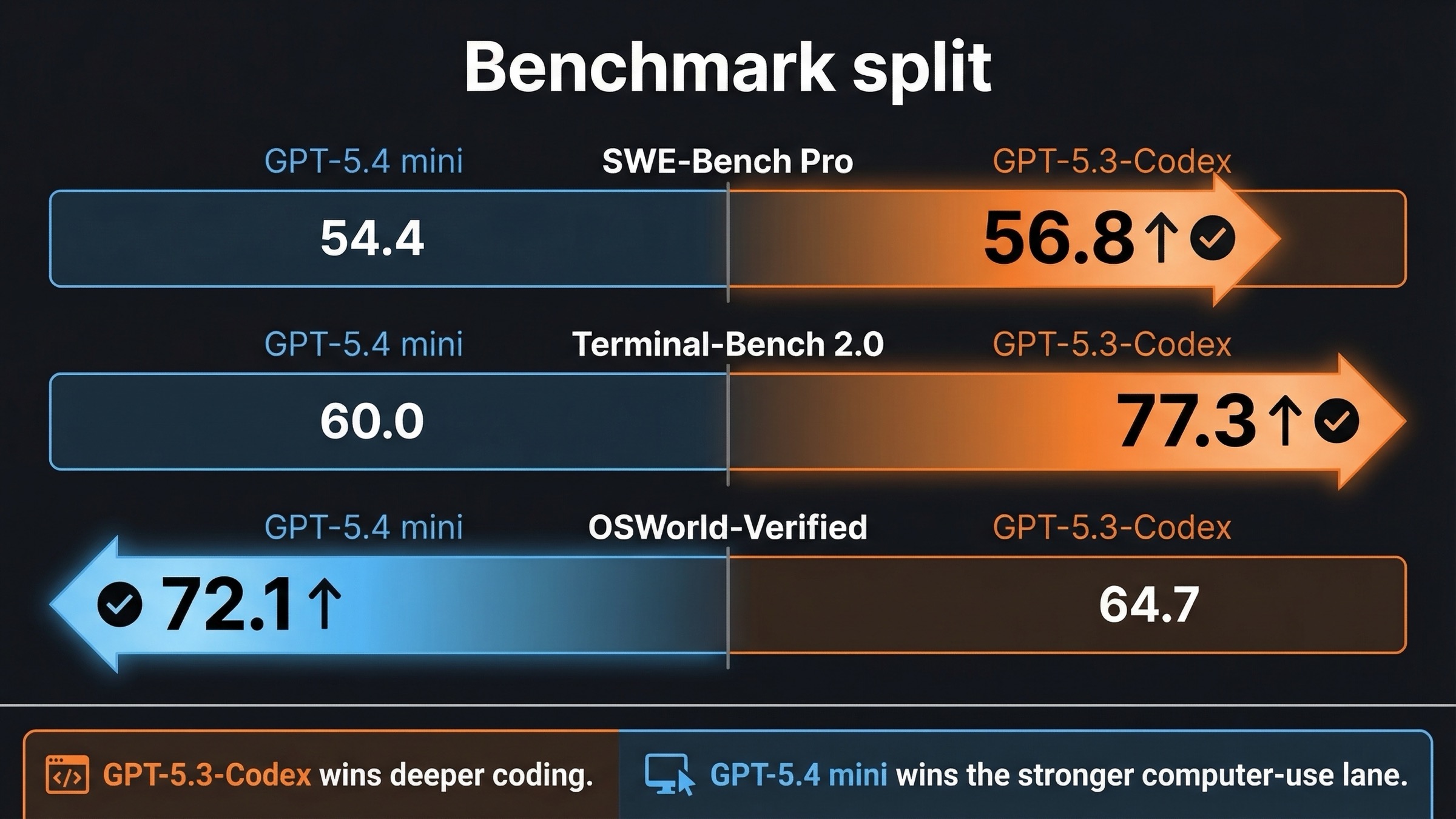

실제 의사결정에 영향을 주는 벤치마크 차이

OpenAI가 두 모델을 한 표에서 직접 맞붙이지는 않았지만, 각 출시 글만으로도 실무적인 구분은 충분히 보입니다.

2026년 3월 17일 공식 GPT-5.4 mini and nano 글에서 GPT-5.4 mini는 다음과 같습니다.

- 54.4% SWE-Bench Pro

- 60.0% Terminal-Bench 2.0

- 72.1% OSWorld-Verified

2026년 2월 5일 공식 GPT-5.3-Codex 글에서 GPT-5.3-Codex는 다음과 같습니다.

- 56.8% SWE-Bench Pro

- 77.3% Terminal-Bench 2.0

- 64.7% OSWorld-Verified

나란히 두면 패턴은 꽤 분명합니다.

| 벤치마크 | GPT-5.4 mini | GPT-5.3-Codex | 어떻게 읽어야 하나 |

|---|---|---|---|

| SWE-Bench Pro | 54.4% | 56.8% | GPT-5.3-Codex가 specialist coding 프로필은 더 강함 |

| Terminal-Bench 2.0 | 60.0% | 77.3% | terminal-heavy 엔지니어링에서는 GPT-5.3-Codex가 크게 우세 |

| OSWorld-Verified | 72.1% | 64.7% | screenshot-grounded, computer-use 계열은 GPT-5.4 mini가 우세 |

핵심은 “몇 줄을 이겼냐”가 아니라 어떤 종류의 작업을 이기느냐 입니다.

실제 일이 shell 명령, repo-local debugging, CLI 자동화, 빌드와 테스트 루프에 가깝다면 GPT-5.3-Codex의 우위는 상징적인 수준이 아닙니다. 특히 Terminal-Bench 격차는 터미널 중심 사용자에게는 무시하기 어렵습니다.

반대로 작업이 스크린샷 해석, 넓은 tool use, 상위 planner 아래의 저비용 worker, computer-use에 가까운 하이브리드 코딩 작업이라면 GPT-5.4 mini가 더 자연스럽습니다. OSWorld 우위는 OpenAI가 GPT-5.4 계열을 어디에 맞추고 있는지 보여주는 신호입니다.

따라서 벤치마크 레이어의 결론은 다음 두 줄로 정리됩니다.

- GPT-5.3-Codex는 더 깊은 coding specialist lane을 가져간다

- GPT-5.4 mini는 더 저렴하고 현대적인 mini lane과 computer-use 적합성을 가져간다

small model 비교를 넘어서 더 큰 모델까지 볼지 고민 중이라면, 관련 글인 GPT-5.4 vs GPT-5.3-Codex도 함께 참고할 만합니다.

API 가격, 도구 지원, 레이트 리밋

API 관점에서는 가격 차이가 추천 결론을 매우 실무적으로 만듭니다.

2026년 3월 20일 기준으로 확인한 공식 페이지에서는:

| 항목 | GPT-5.4 mini | GPT-5.3-Codex |

|---|---|---|

| Input price | $0.75 / 1M tokens | $1.75 / 1M tokens |

| Cached input | $0.075 / 1M tokens | $0.175 / 1M tokens |

| Output price | $4.50 / 1M tokens | $14.00 / 1M tokens |

| Context window | 400K | 400K |

| Max output | 128K | 128K |

| Knowledge cutoff | 2025-08-31 | 2025-08-31 |

즉 GPT-5.3-Codex는 API에서 예산형 옵션이 아닙니다. 오히려 GPT-5.4 mini가 훨씬 저렴합니다.

- 입력은 절반 이하

- 캐시 입력도 절반 이하

- 출력은 3분의 1보다 낮음

순수하게 API 라우팅만 본다면 GPT-5.3-Codex를 first test로 둘 이유가 크게 약해집니다.

도구 폭도 GPT-5.4 mini가 더 넓습니다. 현재 GPT-5.4 mini page는 다음을 명시합니다.

- web search

- file search

- image generation

- code interpreter

- hosted shell

- apply patch

- skills

- computer use

- MCP

- tool search

반면 GPT-5.3-Codex page는 structured outputs, function calling, specialist coding 환경 적합성 쪽에 더 무게가 실려 있습니다.

rate limits도 GPT-5.4 mini 쪽이 불리하지 않습니다.

| Tier | GPT-5.4 mini TPM | GPT-5.3-Codex TPM |

|---|---|---|

| Tier 1 | 500,000 | 500,000 |

| Tier 2 | 2,000,000 | 1,000,000 |

| Tier 3 | 4,000,000 | 2,000,000 |

| Tier 4 | 10,000,000 | 4,000,000 |

| Tier 5 | 180,000,000 | 40,000,000 |

그래서 API 쪽만 보면 결론은 꽤 단순합니다. specialist coding 이점이 가격 차이와 도구 폭 차이를 이길 만큼 분명한 경우를 제외하면, 기본값은 GPT-5.4 mini가 맞습니다.

mini 계열 내부 비교가 더 필요하다면 GPT-5.4 mini vs GPT-5 mini도 같이 보면 정리가 빠릅니다.

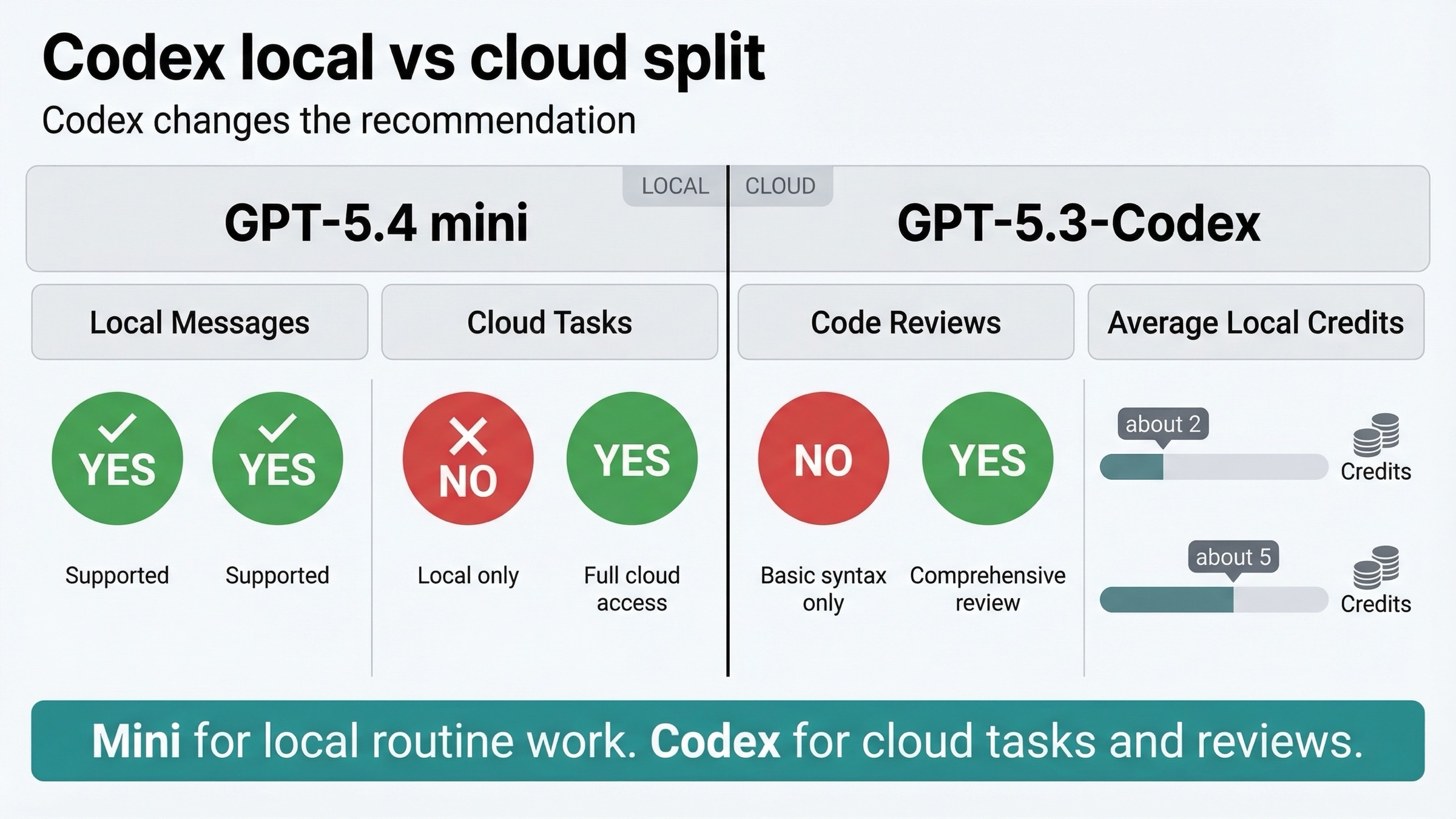

Codex에서는 왜 결론이 달라지나

이 비교에서 정말 중요한 층은 여기입니다.

Codex 안에서는 GPT-5.4 mini가 GPT-5.3-Codex의 완전한 대체재가 아닙니다.

현재 Codex pricing page에 따르면:

- GPT-5.4 mini는 최대 3.3배 더 높은 local-message limits

- GPT-5.4 mini의 평균 로컬 작업은 약 2 credits

- GPT-5.3-Codex의 평균 로컬 작업은 약 5 credits

그래서 GPT-5.4 mini는 다음에 매우 잘 맞습니다.

- Codex의 routine local work

- 저렴한 잔작업 수정

- file read / file edit 중심의 짧은 작업

- local quota를 오래 가져가야 하는 보조 작업

하지만 같은 페이지에는 결정적인 caveat가 있습니다.

| Codex capability | GPT-5.4 mini | GPT-5.3-Codex |

|---|---|---|

| Local messages | Yes | Yes |

| Cloud tasks | No | Yes |

| Code reviews | No | Yes |

즉 Codex에서는 추천 결론이 둘로 갈라집니다.

- 로컬 루틴 작업은 GPT-5.4 mini

- cloud tasks와 reviews는 GPT-5.3-Codex

이 split을 놓치고 “GPT-5.4 mini가 싸니 전부 대체하면 된다”고 생각하면 실제 운영에서 바로 막히게 됩니다.

2026년 3월 Reddit 같은 곳에서 보인 혼란은 plan이나 surface별 가용성 변화에 대한 반응이 많았습니다. 하지만 그런 노이즈가 바꾸지 못하는 더 안정적인 사실이 있습니다. 현재 GPT-5.4 mini와 GPT-5.3-Codex는 Codex 안에서 다른 일을 하고 있다는 점입니다.

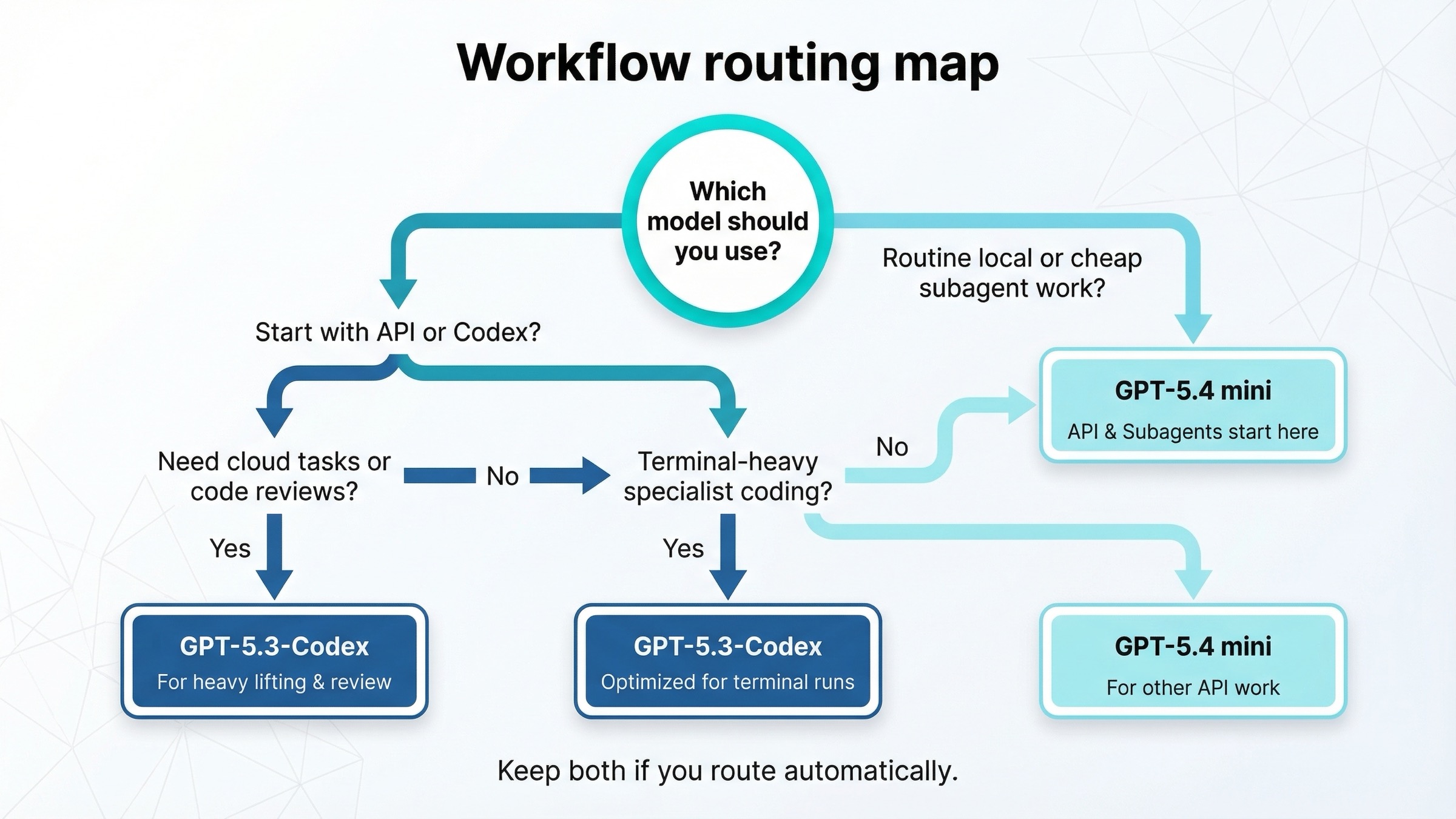

어떤 워크플로에 어떤 모델을 써야 하나

운영 규칙으로 압축하면 다음 표가 가장 실용적입니다.

| Workflow | GPT-5.4 mini | GPT-5.3-Codex | 이유 |

|---|---|---|---|

| 새 API coding worker | Yes | Rarely | 저렴하고 도구 지원이 넓으며 현재 default에 가까움 |

| 상위 planner 아래 cheap subagent | Yes | Rarely | OpenAI가 mini의 역할로 설명하는 구간 |

| screenshot-heavy / computer-use-like worker | Yes | Sometimes | OSWorld와 tool posture가 더 강함 |

| terminal-heavy engineering | Sometimes | Yes | Terminal-Bench 격차가 큼 |

| Codex local routine work | Yes | Sometimes | local quota와 credit 효율이 좋음 |

| Codex cloud tasks | No | Yes | 현재 제품 슬롯이 GPT-5.3-Codex |

| Codex GitHub code reviews | No | Yes | 현재 제품 슬롯이 GPT-5.3-Codex |

| 깊은 specialist coding loop | Sometimes | Yes | 아직 specialist choice에 더 가까움 |

평범한 API 팀이라면 답은 비교적 단순합니다. 기본은 GPT-5.4 mini로 두고, terminal-heavy 또는 specialist coding만 GPT-5.3-Codex로 라우팅하는 편이 좋습니다.

Codex 헤비 유저라면 실제로는 둘 다 유지하는 것이 가장 자연스럽습니다.

- GPT-5.4 mini를 cheap local work에 사용

- GPT-5.3-Codex를 cloud tasks, reviews, 더 어려운 coding lane에 사용

새 모델이니 전부 5.4 mini, specialist니 전부 Codex라는 식의 이분법보다 이쪽이 훨씬 건강합니다.

그래도 GPT-5.3-Codex를 남겨야 하는 경우

많은 비교 글은 “GPT-5.4 mini가 더 새롭다. 그러니 그걸 쓰면 된다”로 끝납니다. 짧게 끝나지만 실무에는 부족합니다.

GPT-5.3-Codex를 지금도 남겨야 할 이유는 크게 네 가지입니다.

첫째, terminal-heavy work 입니다. shell operations, repo-local debugging, CLI 중심 개발이라면 GPT-5.3-Codex의 benchmark profile이 여전히 가장 설득력 있습니다.

둘째, Codex cloud workflows 입니다. cloud tasks가 필요하면 GPT-5.3-Codex를 남겨야 합니다.

셋째, Codex code reviews 입니다. GitHub review flow가 중요한 팀에서는 이 한 가지 이유만으로도 유지 가치가 있습니다.

넷째, fallback routing 입니다. 하나의 영구 우승자를 찾기보다,

- mini first를 cheap current work에 두고

- Codex second를 specialist coding과 Codex cloud surface에 두는

2단 구조가 실제 라우팅 설계로 더 강합니다.

Codex 계열을 다른 specialist coding 모델과 비교한 감각까지 보고 싶다면 영어판 GPT-5.3 Codex vs Claude Opus 4.6도 참고할 수 있습니다.

FAQ

GPT-5.4 mini가 코딩 전반에서 GPT-5.3-Codex보다 낫나요?

완전히 그렇지는 않습니다. 공식 수치상 GPT-5.3-Codex가 SWE-Bench Pro와 Terminal-Bench 2.0에서 더 강합니다. 반면 GPT-5.4 mini는 API 비용이 훨씬 낮고, 현재 추천 small model이며, computer-use 인접 작업에 더 잘 맞습니다.

코딩 벤치마크는 GPT-5.3-Codex가 더 강한데 왜 기본 추천은 GPT-5.4 mini인가요?

기본 추천은 한 줄의 벤치마크로 정해지지 않습니다. 가격, tool support, rate limits, product direction, 그리고 많은 코딩 시스템이 실제로는 tool-and-agent system이라는 운영 현실까지 함께 보아야 합니다.

Codex 안에서 GPT-5.4 mini가 GPT-5.3-Codex를 대체하나요?

완전하게는 아닙니다. 적어도 2026년 3월 20일 기준 Codex pricing page에서는 GPT-5.4 mini에 cloud tasks와 code reviews가 없습니다. 그 자리는 아직 GPT-5.3-Codex의 역할입니다.

새 팀은 무엇부터 테스트해야 하나요?

API 팀이라면 GPT-5.4 mini부터 테스트하는 편이 자연스럽습니다. Codex-heavy 팀이라면 GPT-5.4 mini를 로컬 루틴 작업, GPT-5.3-Codex를 cloud-task / review workflow에 두는 2레인 구조로 시작하는 것이 빠릅니다.

최종 추천

팀에 한 줄만 가져가야 한다면 이렇게 정리하면 충분합니다. 새 API 코딩과 subagent work는 GPT-5.4 mini를 기본값으로 두고, Codex의 cloud tasks, reviews, terminal-heavy engineering은 GPT-5.3-Codex를 남겨둔다.

이 결론이 단순한 “새 모델 대 구모델”보다 강한 이유는 2026년 3월의 실제 제품 상태에 그대로 맞기 때문입니다.

- GPT-5.4 mini는 API에서 더 저렴하고 기본값으로 두기 쉽다

- GPT-5.3-Codex는 specialist coding profile을 여전히 유지한다

- Codex 제품 동작이 두 모델을 today interchangeable하게 만들지 않는다

성숙한 선택은 한 모델로 다른 모델을 지워버리는 것이 아니라, 두 모델을 각자 맞는 레인에 다시 배치하는 것입니다.