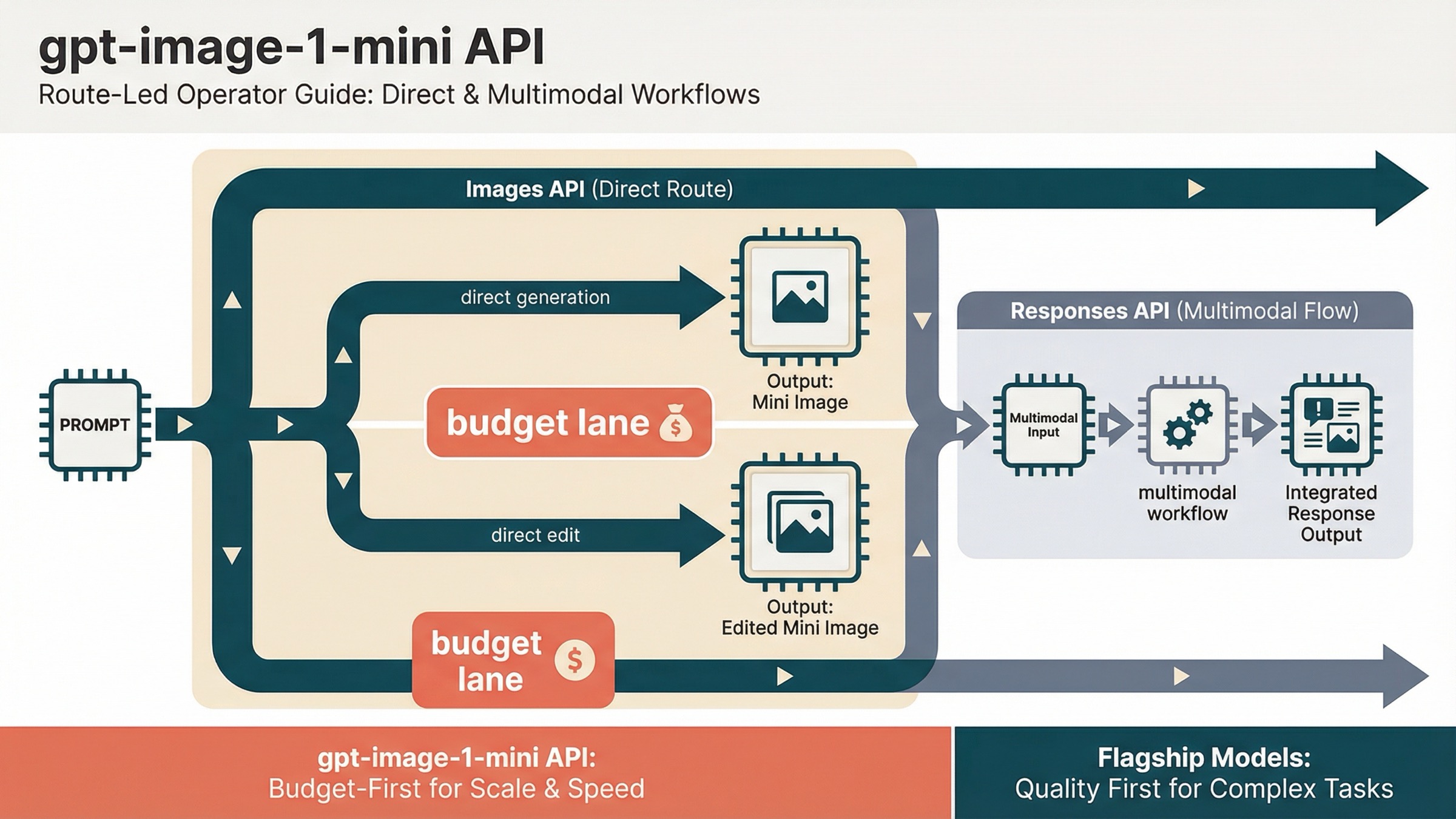

2026年3月27日時点で、gpt-image-1-mini API のいちばん安全な default は明快です。direct generation と direct edit なら先に OpenAI Images API を使い、image generation が larger multimodal workflow の 1 tool になったときだけ Responses API に進みます。 current page one がまだ弱いのは、この route split を 1 ページで完結させていないからです。

この keyword が必要以上に難しく見えるのは、OpenAI が答えを隠しているからではなく、答えを複数ページに分けているからです。gpt-image-1-mini model page は current pricing、endpoints、rate limits を持っています。Image-generation guide は「single image generation / edit なら Image API がよい」と route rule を明示します。Images and vision guide は Responses 側の tool path を見せます。1ページだけ読むと、最初の実装順序を間違えやすいのです。

だから exact-match page の多くは「mini は OpenAI の安い image model」というところで止まり、最初の request をどこへ投げるべきか をうまく言い切れていません。このページはより広い OpenAI Image API tutorial の再説明ではなく、gpt-image-1-mini まで絞れた reader の最初の route choice だけを解くページです。

要点まとめ

- direct generation と direct edit は Images API から始める。

- image generation が assistant workflow の 1 step なら Responses API を使う。

gpt-image-1-miniは budget lane であり、universal flagship ではない。- SDK sample を疑う前に tier access と organization verification を確認する。

いちばん短い direct path から始める

この keyword で最初に必要なのは、parameter を全部覚えることではなく、shortest working request を通すことです。current OpenAI guide は、1つの prompt から 1枚を直接 generate / edit するなら Image API が最適だと説明しています。Responses example のほうが先に目に入ることがありますが、gpt-image-1-mini の exact query では direct route を先に通したほうが失敗点を絞りやすいです。

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const result = await client.images.generate({ model: "gpt-image-1-mini", prompt: "Create a clean editorial illustration of a robot photographer in a bright studio", size: "1024x1024", quality: "medium", output_format: "jpeg", output_compression: 80, }); const imageBase64 = result.data[0].b64_json; fs.writeFileSync( "gpt-image-1-mini-demo.jpg", Buffer.from(imageBase64, "base64") );

Python でも考え方は同じです。

pythonfrom openai import OpenAI import base64 client = OpenAI() result = client.images.generate( model="gpt-image-1-mini", prompt="Create a clean editorial illustration of a robot photographer in a bright studio", size="1024x1024", quality="medium", output_format="jpeg", output_compression=80, ) image_base64 = result.data[0].b64_json with open("gpt-image-1-mini-demo.jpg", "wb") as f: f.write(base64.b64decode(image_base64))

最初の request を deliberately simple に保つ理由は、model ID、active project、access state、output handling を切り分けたいからです。最初から larger workflow にすると、本当に壊れている layer が route なのか、account state なのか、code なのかが見えにくくなります。

言い換えると、最初の成功はわざと地味であるべきです。最初の1本で証明したいのは「全部のオプションを使いこなせる」ことではなく、正しい project、正しい model、正しい access、正しい保存処理がそろっていることです。OpenAI の docs には size や quality、透過、edit まわりの選択肢もありますが、それらは最短の direct generation が通ってから広げるほうが安全です。

Images API vs Responses for gpt-image-1-mini

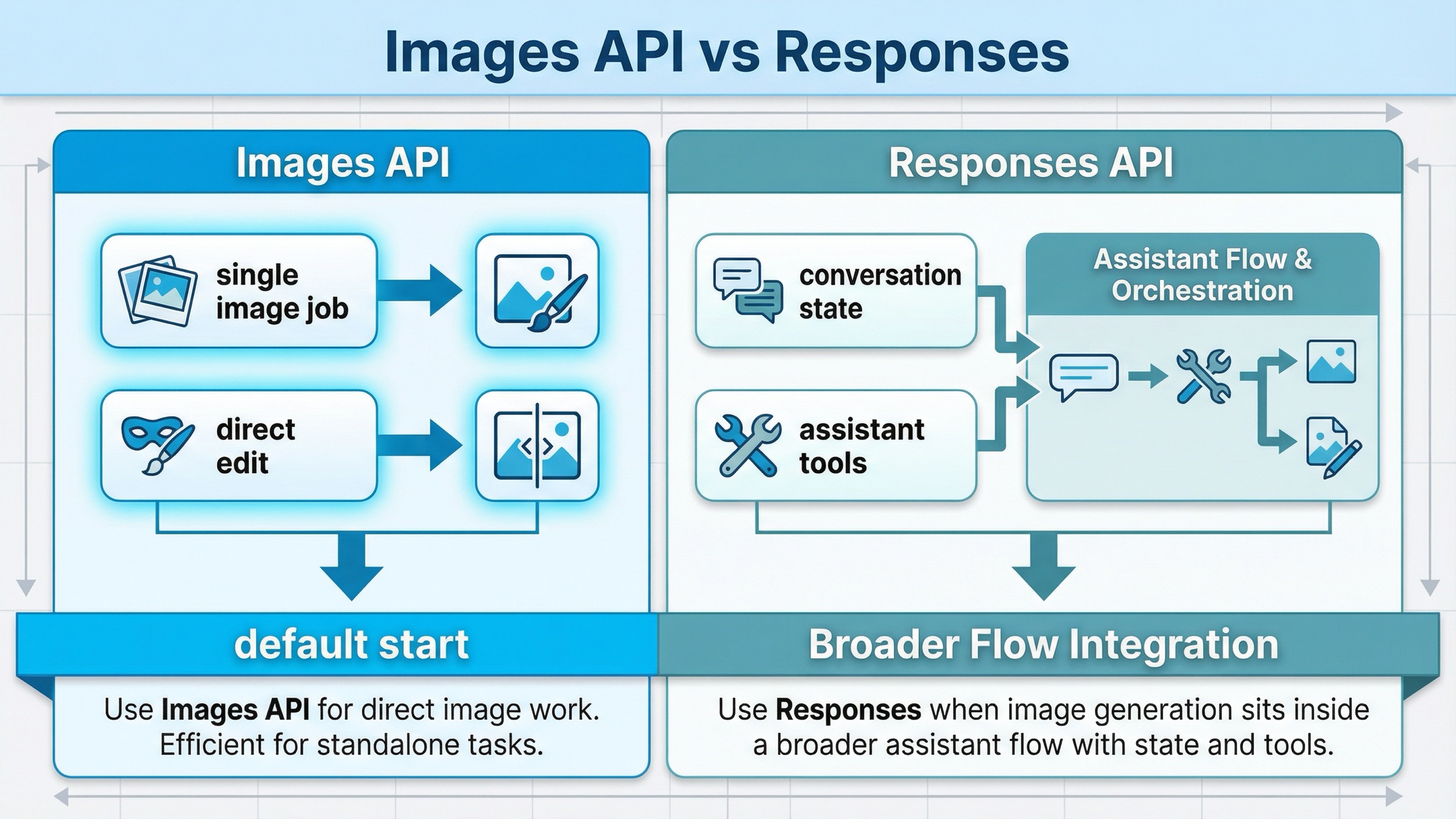

この keyword で必要な route table はこれで足ります。

| 状況 | より安全な default | 理由 |

|---|---|---|

| 1つの prompt で 1枚の image が欲しい | Images API | 最短 path で debug しやすい |

| input image を direct に edit したい | Images API | 同じ direct route で完結する |

| image generation が multimodal assistant の 1 step | Responses API | abstraction を決めるのは outer workflow |

| conversation state, tools, reasoning と image output を 1 request に載せたい | Responses API | image generation は larger flow の一部になる |

| exact model を最速で試したい | Images API | moving parts が少ない |

つまり、画像生成そのものが feature なら Images API、画像生成が larger workflow の一部なら Responses API と考えるのが最も安全です。

チーム内で「Responses のほうが新しそうだから全部そちらに寄せたい」という声が出たときも、判断基準は同じです。その request に本当に conversation state、複数 tools、mixed output が必要なのかを先に聞くべきです。必要ないなら、より大きい abstraction を先に選ぶ理由はあまりありません。

Responses が本当に必要なときの形

Responses に早く飛びつかないためには、それが fit する文脈を見るのがいちばんです。current OpenAI docs で Responses の image generation は、あくまで larger request の中の tool として出てきます。images.generate() の default replacement として出てくるわけではありません。

mental model はこう変わります。

- top-level request は multimodal / assistant request

- image generation はその中の 1 tool

gpt-image-1-miniだから route が変わるのではなく、surrounding workflow が route を変える

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const response = await client.responses.create({ model: "gpt-4.1-mini", input: "Generate a transparent sticker-style icon of a paper airplane", tools: [{ type: "image_generation", quality: "medium" }], }); const imageBase64 = response.output .filter((item) => item.type === "image_generation_call") .map((item) => item.result)[0]; fs.writeFileSync("paper-airplane.png", Buffer.from(imageBase64, "base64"));

single image job なら、この route は単に failure surface を増やしやすいだけです。assistant flow が本当に必要になって初めて価値が出ます。

この点を曖昧にしたまま exact-match page を読むと、2つの equally valid な route から好みで選ぶように見えてしまいます。実際にはそうではなく、ほとんどの読者は「最初の実装を必要以上に複雑にするかどうか」を選んでいるだけです。その意味で、Images API は単に古い route ではなく、direct image job に対するより小さくて検証しやすい route です。

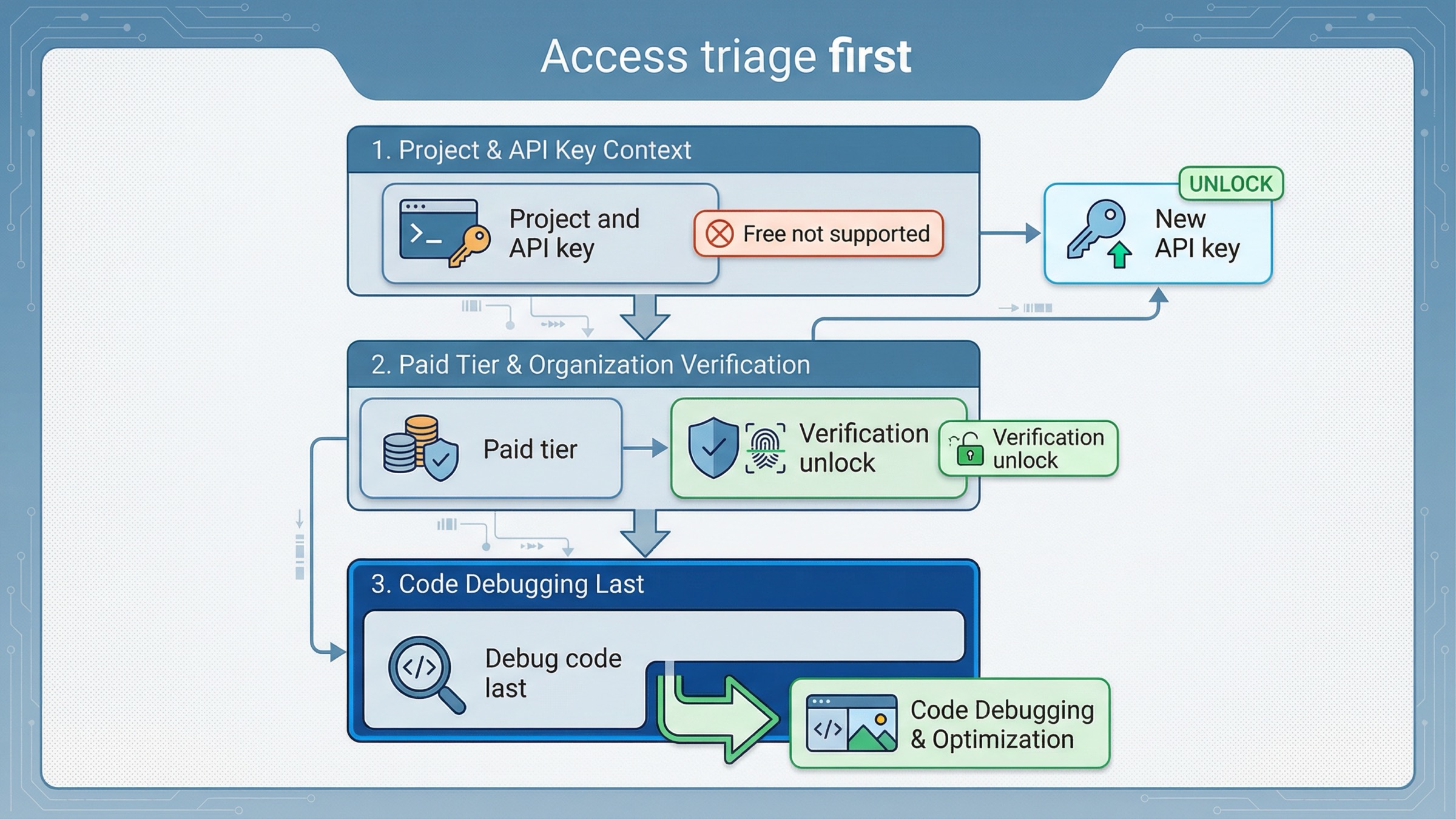

access を先に見て、code は最後に疑う

exact-match page が時間を無駄にしやすいもう1つの場所はここです。sample code を先に出して、ずっと後で account が ready でない可能性を言うのは順番が逆です。

Current API model availability article は、GPT-image-1 と GPT-image-1-mini が tiers 1 through 5 に開いていて、一部 access は organization verification に依存する と説明します。Current gpt-image-1-mini model page は Free not supported、Tier 1 100,000 TPM / 5 IPM も出しています。

だから troubleshooting order はこうです。

- API key が正しい project / organization に属しているかを見る

- account が paid tier に乗っているか確認する

- block されるなら organization verification branch を確認する

- そこまで通ってから prompt、SDK code、output parsing を疑う

Current organization verification help page は、verification が image-generation capability を unlock できること、反映に最大 30 分かかること、新しい API key が lingering error を解消することを説明しています。これは account-state branch であって、model-selection branch ではありません。

ここはもう一段強く意識しておいたほうがいい部分です。access を確認する前に prompt を変えたり、SDK を入れ替えたり、Responses に route rewrite したりしても、根本原因が account 側なら何も解決しません。gpt-image-1-mini の初回導入では、code より先に account state を疑うほうが速い場面がかなり多いです。

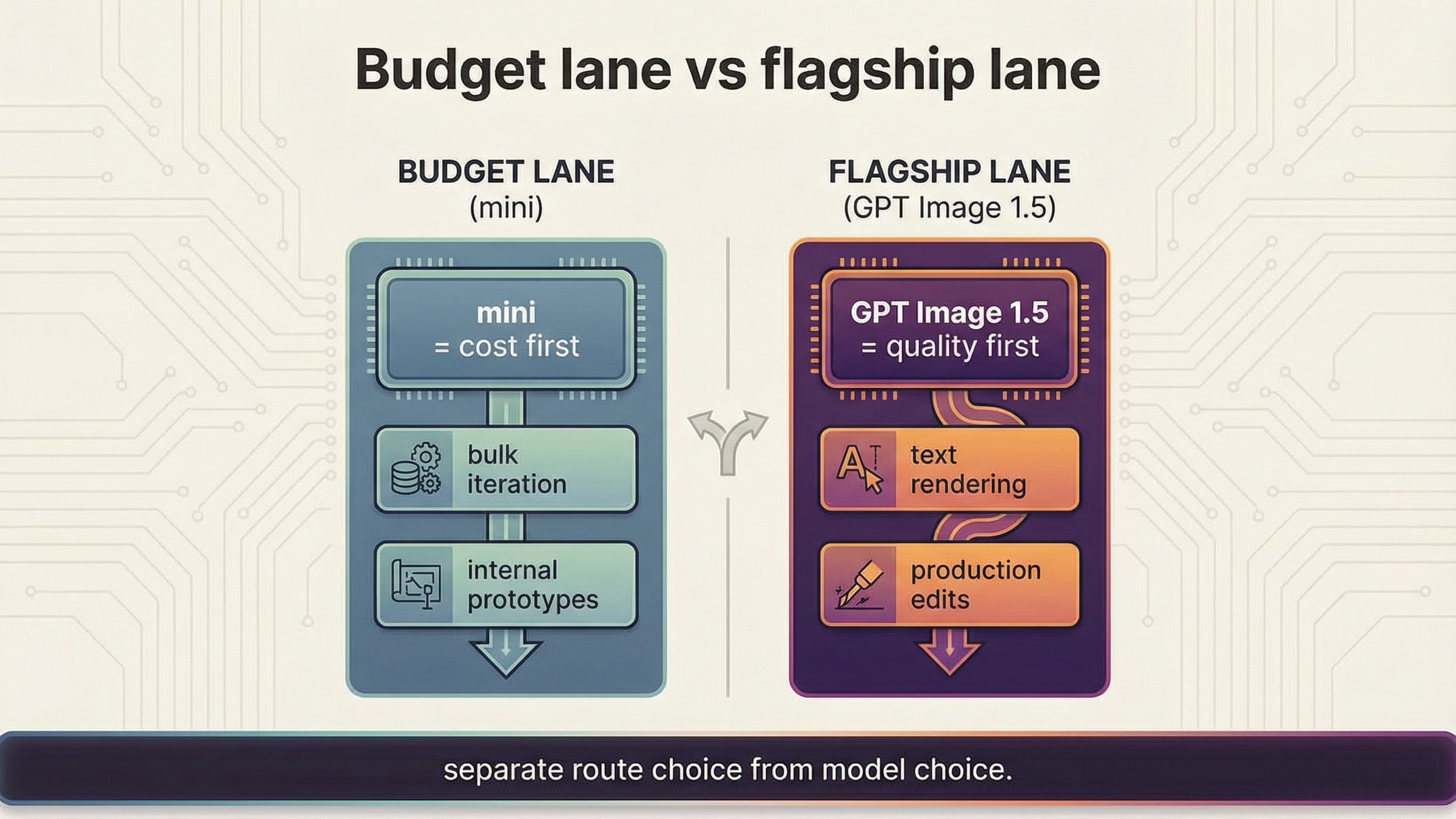

いつ mini が正解で、いつ GPT Image 1.5 を見るべきか

ここは正直に読む必要があります。gpt-image-1-mini は budget lane であって universal lane ではありません。 Current image-generation guide は best experience には GPT Image 1.5 を勧め、image quality が最優先でないときの more cost-effective option として mini を挙げています。Current mini model page は 1024x1024 low / medium / high を $0.005 / $0.011 / $0.036 と示しています。

これが強いのは、bulk iteration、internal prototype、low-stakes draft、cost-sensitive feature のようなケースです。

でもそこから「なら全部 mini が default」という結論にはなりません。正しい読み方は、cost が first constraint なら mini が first benchmark ということです。

text rendering、cleaner premium output、complex edit reliability、retry cost が重要な workload なら、比較対象は mini vs Responses ではなく mini vs GPT Image 1.5 になります。そのときは OpenAI画像生成API料金 や GPT Image 1.5 API pricing のほうが次の一手として適切です。

この違いを落としてしまうと、"1枚あたりが安いから workflow 全体でも安い" という誤読につながります。実運用では、retry 回数、後処理、品質不足による差し戻しもコストです。mini の価格優位は本物ですが、それがそのまま全 workload の total cost 優位だとは限りません。

もう1つ重要なのは、mini の価格優位を route choice の正しさと混同しないことです。Images API を選ぶか Responses を選ぶかは、あくまで feature の形と surrounding workflow で決まります。一方で mini を使うか GPT Image 1.5 を使うかは、quality と cost の優先順位で決まります。この2つを別々に考えられると、設計の迷いがかなり減ります。

direct edit でも route は同じ

Wrapper pages は edit になると別の API 世界が必要なように見せることがありますが、current mini model page は v1/images/generations と v1/images/edits を両方 listed しています。つまり generation が Images API 上にあるなら、edit も通常は同じ direct route に残ります。

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const result = await client.images.edit({ model: "gpt-image-1-mini", image: fs.createReadStream("room.png"), prompt: "Turn this room into a bright Nordic living room with pale oak shelves and soft morning light.", size: "1024x1024" }); const imageBase64 = result.data[0].b64_json; fs.writeFileSync("room-nordic.png", Buffer.from(imageBase64, "base64"));

Troubleshooting: thin wrapper page では解決しないこと

よくある mistake は4つあります。

1つ目は Responses に早く行きすぎること。direct image feature に larger abstraction を持ち込むと、間違った layer を debug しやすくなります。

2つ目は mini をすべての workload の答えとして読むこと。official docs はそう読ませていません。

3つ目は access state を見ずに code を書き換えること。tier access と verification は valid sample を止められます。

4つ目は exact-match article は model card で十分だと思うこと。実際の reader は「どこから始めるか」と「いつ default を切り替えるか」を知りたいのです。

さらに、よくある failure branch を3つだけ明示しておくと判断しやすくなります。最初の request が access 系のエラーで落ちるなら、obsolete sample を疑うより tier、project、verification を見直すほうが先です。request 自体は通るのに quality が足りないなら、endpoint ではなく mini の適性を疑うべきです。Responses を選びたくなる理由が「docs でよく見るから」だけなら、その request に larger multimodal workflow が本当に必要かをもう一度確認してください。

そして、導入順序も意識しておくと無駄が減ります。最初にやるべきなのは direct route の成功確認であって、最終的な model benchmark を一度に終わらせることではありません。account readiness と route の妥当性が確認できてから mini と GPT Image 1.5 の比較に進むほうが、問題の切り分けも予算判断もずっと明確になります。

実務に落とすなら、順番はかなり明快です。最初に Images API で direct generation を1本通し、次に direct edit も同じ surface で確認して、account と route が安定していることを見ます。その後で初めて、mini と GPT Image 1.5 を quality、retry 率、総コストの観点で比べるほうが、実装判断としても予算判断としても筋が通ります。

FAQ

gpt-image-1-mini で direct edit できますか。

できます。Current model page は v1/images/generations と v1/images/edits の両方を listed しています。

gpt-image-1-mini に free tier はありますか。

2026年3月27日時点の current model page では Free not supported です。

いつ GPT Image 1.5 を見るべきですか。

quality、text rendering、complex edits、retry-sensitive production work の比重が高いときです。

最後の recommendation

今 gpt-image-1-mini を接続するなら、まず Images API を使ってください。 最初の generation request も最初の edit request もその route で始め、request を十分に小さく保って access と output handling を切り分けます。Responses は image generation が larger multimodal workflow の 1 step になったときだけで十分です。

そして second question を separate に考えてください。mini は本当にこの workload に合っているか。 cost-first なら強い first benchmark です。quality、text rendering、heavy edit が重要なら、最安の sticker price が自動的に正解になるわけではありません。この keyword でいちばん大事なのは、route choice と model choice を分けて考えることです。

この順番を守るだけで、exact query の混乱はかなり減ります。最初に route を小さく正しく選び、その後で model の quality と total cost を比較する。gpt-image-1-mini api という検索語で本当に必要なのは、その二段階の意思決定を混ぜないことです。

開発チームにとっても、この分け方には意味があります。route を決める議論と model を決める議論が一緒になると、account access の問題なのか、API surface の問題なのか、品質評価の問題なのかが曖昧になります。まず direct route を成功させ、そのあとに model を benchmark するほうが、議論も実装もずっと安定します。