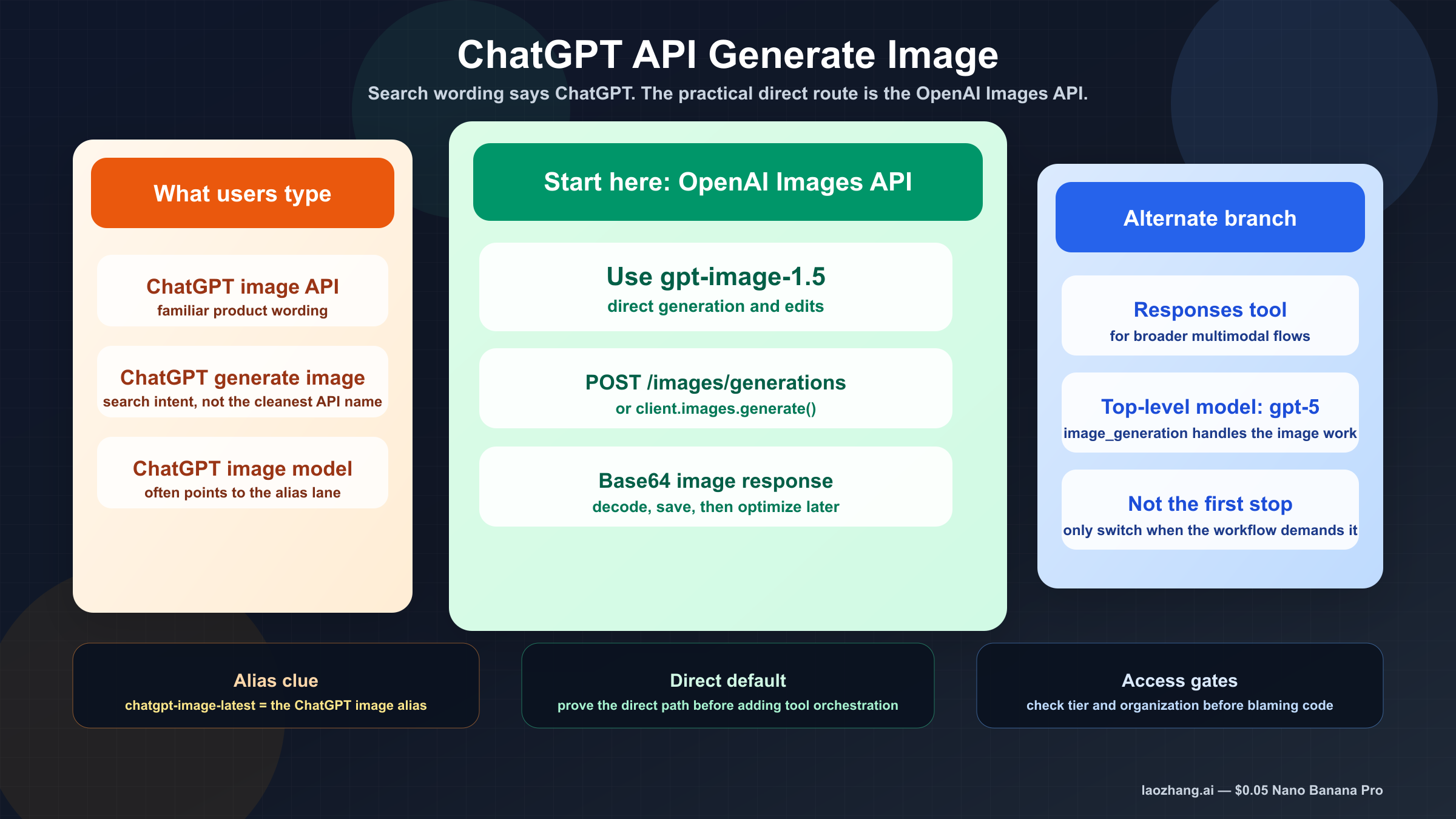

chatgpt api generate image と検索した人に、2026年3月23日時点でいちばん実務的な答えを一行で言うならこうです。最初に使うべきなのは OpenAI Images API と gpt-image-1.5 であり、ChatGPT専用の別endpointを探すことではありません。 単発の画像生成なら client.images.generate() か POST /v1/images/generations から始めるのがいちばん安全です。

このキーワードが必要以上にややこしく見える理由は、OpenAI が答えを複数の面に分けているからです。image generation guide は Images API の直接ルートを中心に説明し、gpt-image-1.5 を現在の最有力 default としています。image_generation tool guide は Responses 側の分岐を説明します。chatgpt-image-latest のモデルページ は、その名前が ChatGPT で使われている画像 snapshot を指す alias であることを示します。どれか一枚だけ読むと、全体像がずれやすい構造です。

いちばん安全な順番は単純です。まず Images API の直通リクエストを一つ通し、返ってきた base64 画像を保存し、自分のアカウントに本当にアクセス権があることを確認する。そのあとで alias、edit、Responses 分岐を必要に応じて足します。この順番にするだけで、検索結果がまだ読者に押し付けている無駄な回り道の多くを避けられます。

要点まとめ

- 最初に学ぶべき別物の「ChatGPT画像API」があるわけではありません。

- 単発の画像生成なら OpenAI Images API と

gpt-image-1.5から始めるのが安全です。 - Responses

image_generationは、画像生成がより大きいマルチモーダル workflow の一部になったときだけ使います。 chatgpt-image-latestは ChatGPT で使われている画像 snapshot を指す alias と考えるべきで、別プラットフォームの証拠ではありません。- 例が動かないときは、まず usage tier、organization verification、API key がどの organization を見ているか を確認します。

探しているのはChatGPTの画像APIか、それともOpenAI Images APIか

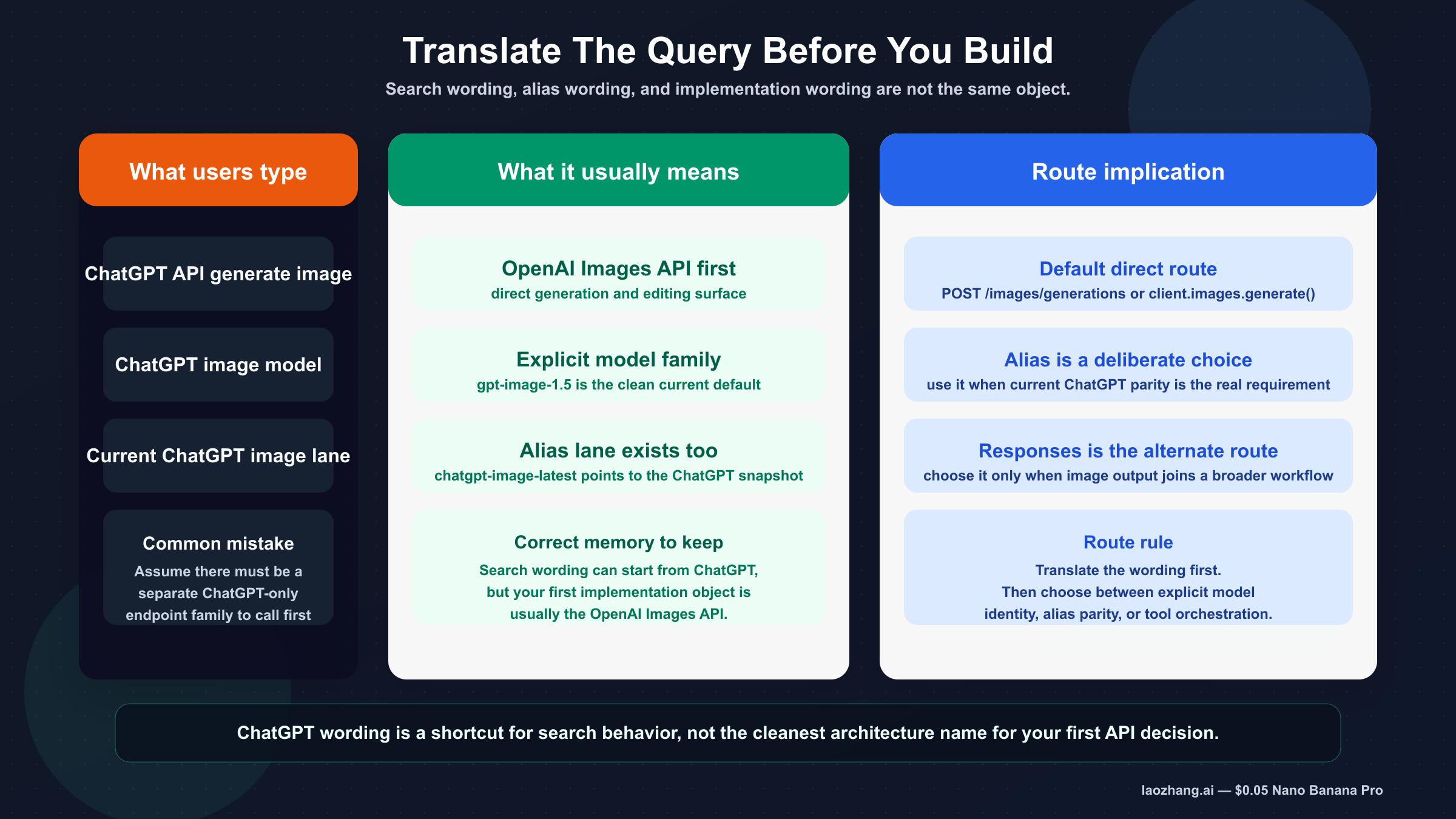

実務上は、ChatGPT という言い方で検索していても、探しているものの多くは OpenAI Images API です。ここを最初に言い切らないページがまだ多すぎます。

chatgpt-image-latest の公式ページ には、その alias が 現在 ChatGPT で使われている画像 snapshot を指す と明記されています。だからこそこの検索語が生まれます。読者は ChatGPT というプロダクトを知っているので、その延長で API を探します。けれど、実際に使う surface は依然として OpenAI API の surface です。v1/images/generations、v1/images/edits、そして画像生成がより大きな流れの一部になったときの Responses API が本体です。

この違いは呼び方の問題だけではありません。何を最初の abstraction にするか、どうデバッグするか、どうチームに説明するかを変えます。「ChatGPT image API が欲しい」と考えると、まだ gpt-4o や proxy ベースのやり方を教えている薄い記事に流れやすくなります。「ChatGPT という検索語が実際にはどの OpenAI surface を指しているか」を先に考えると、ドキュメントの読み方がかなり整理されます。

このキーワードがまだ狙えるのもそのためです。公式ページには事実がありますが、読者が本当に困っている順番では並んでいません。あるページは model facts、別のページは tool syntax、さらに別のページは endpoint、Help Center は verification を教えます。読者が知りたいのは「image generationとは何か」ではなく、「最初に何を呼べば、最初から間違った abstraction を選ばずに済むか」です。

この問いに対する実務ルールは短くて十分です。

- まず Images API。

- default model は

gpt-image-1.5。 chatgpt-image-latestは alias の判断であって、最初の設計判断ではない。

もっと広い surface map を先に整理したいなら、日本語の OpenAI Image API tutorial を読む方が自然です。このページはあえて狭くしています。ChatGPT という検索語を、正しい最初の実装判断に翻訳することが仕事だからです。

今いちばん速く通るAPI画像生成ルート

単純な「prompt を渡して画像を得る」仕事なら、いまも最短ルートは直通の Images API です。Images の公式 reference は POST /images/generations をそのまま示し、image generation guide は gpt-image-1.5 を最良の default として勧めています。

最初のリクエストは、意図的に退屈であるべきです。

- prompt は一つ

- 正方形画像を一枚

- 余計な orchestration はなし

- base64 を decode

- ファイルに保存

これで HTTP 呼び出しだけでなく、実際の統合経路全体を確認できます。

JavaScript:

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const result = await client.images.generate({ model: "gpt-image-1.5", prompt: "Create a clean editorial illustration of a robot camera operator in a bright studio", size: "1024x1024", quality: "medium", }); const imageBase64 = result.data[0].b64_json; const imageBuffer = Buffer.from(imageBase64, "base64"); fs.writeFileSync("chatgpt-api-generate-image.png", imageBuffer);

Python:

pythonfrom openai import OpenAI import base64 client = OpenAI() result = client.images.generate( model="gpt-image-1.5", prompt="Create a clean editorial illustration of a robot camera operator in a bright studio", size="1024x1024", quality="medium", ) image_base64 = result.data[0].b64_json image_bytes = base64.b64decode(image_base64) with open("chatgpt-api-generate-image.png", "wb") as f: f.write(image_bytes)

cURL:

bashcurl https://api.openai.com/v1/images/generations \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "gpt-image-1.5", "prompt": "Create a clean editorial illustration of a robot camera operator in a bright studio", "size": "1024x1024", "quality": "medium" }' \ | jq -r '.data[0].b64_json' \ | base64 --decode > chatgpt-api-generate-image.png

このルートがよいのは三つの理由があります。第一に、現在の公式推奨 model をそのまま使っていること。第二に、ルートが十分に直通なので、失敗の切り分けがしやすいこと。第三に、多くの弱い記事が飛ばしている output contract を最初から示していることです。Image API は base64 画像を default で返し、PNG が default format で、JPEG/WebP と output_compression はあとから追加する調整項目です。

もっと広い example 集が必要なら、日本語の OpenAI image generation API example が次の読み先です。この keyword では、最初のルート選択を正しくすることの方が、早い段階では重要です。

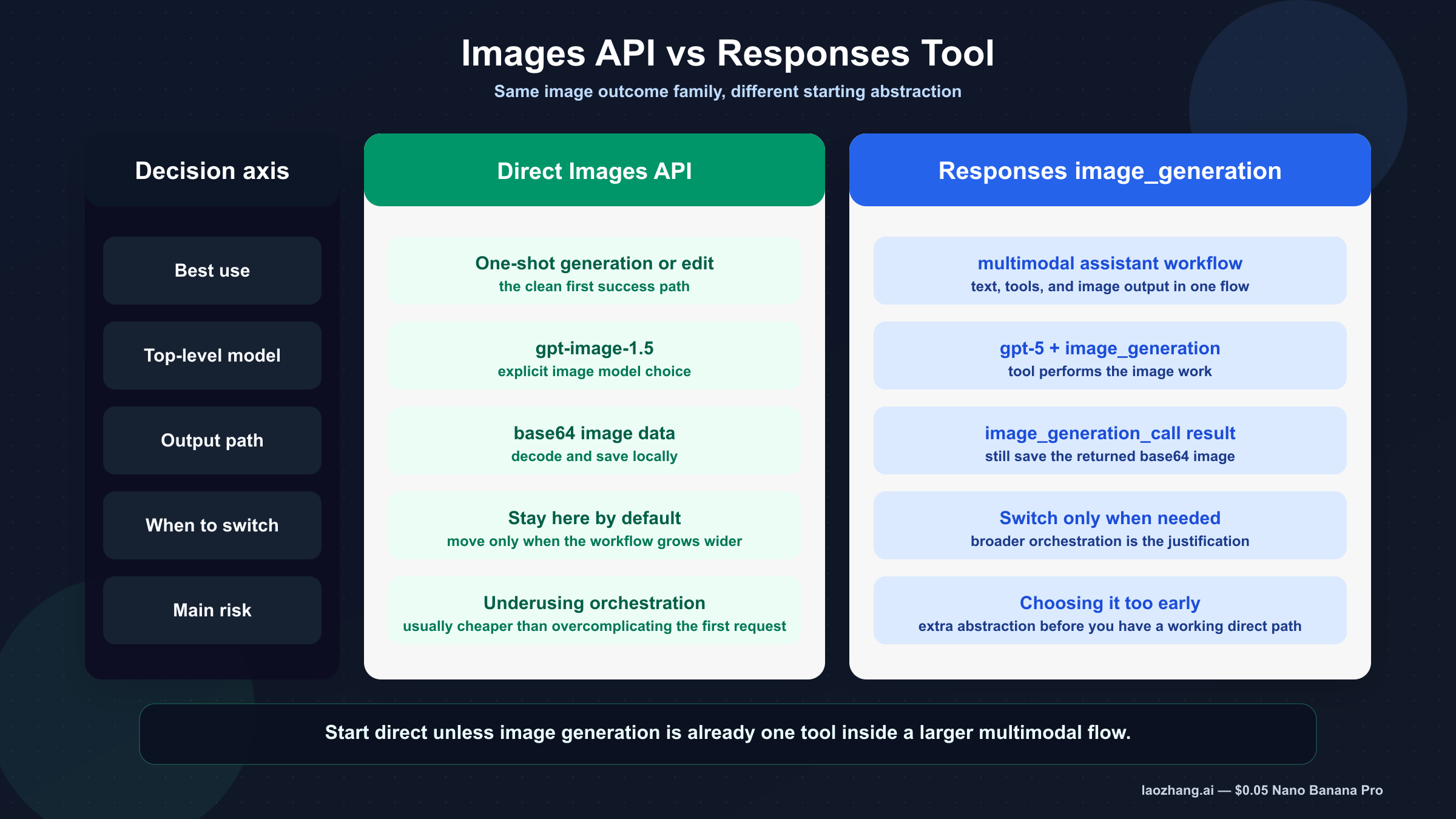

Images API と Responses image_generation をどう使い分けるか

Images API が向いているのは、画像生成そのものが feature の中心であるときです。Responses の tool が向いているのは、画像が reasoning や multimodal workflow の一部として現れるときです。

| 状況 | まず選ぶべきもの | 理由 |

|---|---|---|

| prompt を一つ投げて画像を得たい | Images API | 層が少なく、最初の成功まで最短 |

| backend endpoint で生成や edit をしたい | Images API | request contract が単純で、切り分けもしやすい |

| 一枚または複数枚の画像を直接 edit したい | Images API | edit の本筋はここに集約されている |

| assistant が時々画像も返す | Responses image_generation | 画像を tool として wider flow に乗せやすい |

| 文字、tools、画像を一つの interaction にまとめたい | Responses image_generation | orchestration を一つの surface に置ける |

tool guide が重要なのは、現在の responses.create() 例が model: "gpt-5" を使い、tools: [{ type: "image_generation" }] を付ける形になっているからです。画像そのものは GPT Image family が tool の側で処理します。だから gpt-image-1.5 を Responses の top-level model field に入れるのは、ドキュメントの読み方としてはだいたい間違いです。

本当に tool ルートが必要なら、最小形は次のようになります。

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const response = await client.responses.create({ model: "gpt-5", input: "Generate a transparent sticker-style icon of a paper airplane", tools: [{ type: "image_generation", background: "transparent" }], }); const imageBase64 = response.output .filter((item) => item.type === "image_generation_call") .map((item) => item.result)[0]; fs.writeFileSync("paper-airplane.png", Buffer.from(imageBase64, "base64"));

この snippet の価値は、branch の違いを具体的に見せる点です。直通ルートは image model を明示します。Responses ルートは mainline model を上に置き、画像生成を tool に委ねます。二つを横に見ると、どこで abstraction が変わるのかがずっと分かりやすくなります。

チームに残るべき実務ルールは単純です。最初は直通で始め、画像が本当に wider multimodal workflow の一部になったときだけ Responses に切り替える。

今本当に重要なモデル名

モデル名が重要なのは、SERP がまだ古いリリース名や時代遅れの説明を混ぜているからです。

| モデルまたはラベル | 今の意味 | 使いどころ |

|---|---|---|

gpt-image-1.5 | GPT Image family の現行本命 | 直接生成と edit のほとんど |

gpt-image-1.5-2025-12-16 | モデルページに見える dated snapshot | 再現性重視の eval や controlled rollout |

chatgpt-image-latest | ChatGPT で使われている image snapshot を指す alias | 現在の ChatGPT parity を取りたいときだけ |

gpt-image-1 | 旧世代 GPT Image lane | migration や compatibility 用 |

| DALL-E 2 / DALL-E 3 | deprecated | この query の fresh default には向かない |

image generation guide は gpt-image-1.5 を GPT Image family の最新かつ最良の default とし、DALL-E 2 と DALL-E 3 は deprecated で 05/12/2026 に support を終えると書いています。つまり、gpt-4o や DALL-E を中心にした tutorial を fresh default として扱う理由はもうありません。

gpt-image-1.5 のモデルページ には、実務で役立つ事実が二つあります。

- Free not supported

- Tier 1 は 100,000 TPM と 5 IPM から

さらに gpt-image-1.5-2025-12-16 という snapshot も見えます。reproducibility や staged rollout が大事なら、この情報は alias よりずっと扱いやすいです。alias と explicit model ID の違いをもっと掘るなら、日本語の chatgpt-image-latest vs gpt-image-1.5 が自然な次の読み先です。

この query では pricing が主役ではありませんが、見えている current ladder は知っておく価値があります。chatgpt-image-latest のページには 1024x1024 low が $0.009、medium が $0.034、high が $0.133 とあります。ここでも重要なのは、古い GPT-4o image 前提の記事を default にしないことです。次の疑問が budget なら、OpenAI image generation API pricing に進む方が自然です。

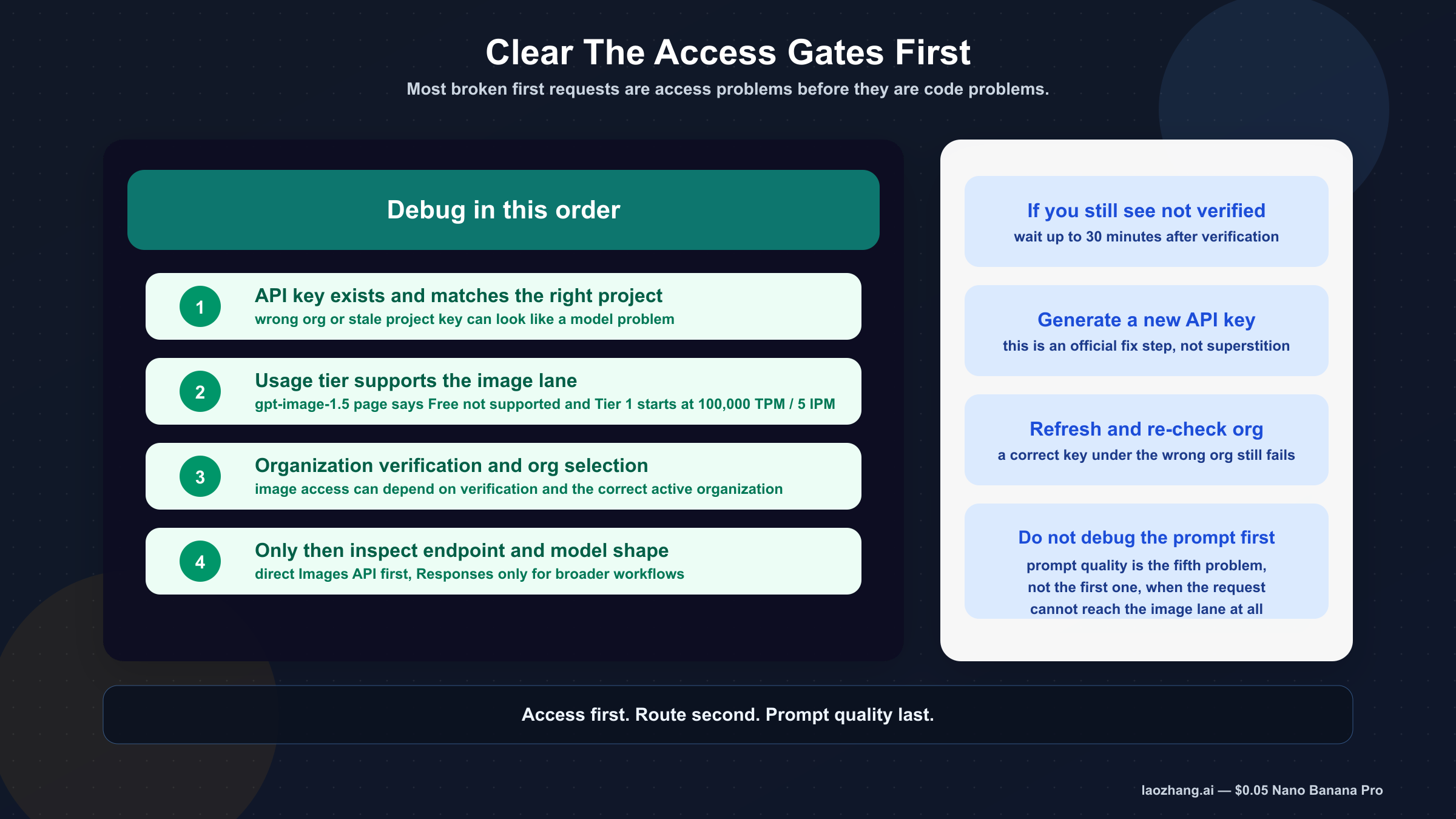

トラブルシューティング: サンプルを疑う前にアクセス条件を確認する

最初の失敗の多くは snippet そのものではなく、account state、active organization、あるいは古い mental model が原因です。

最初に確認すべきは usage tier です。API Model Availability by Usage Tier and Verification Status には、GPT-image-1 と GPT-image-1-mini が tiers 1 through 5 の API ユーザー向けであり、一部は organization verification の影響を受けると書かれています。gpt-image-1.5 のモデルページは別途 Free not supported と書いています。つまり、これを ChatGPT の無料機能の延長だと思っている時点で、API access の見方がずれている可能性が高いということです。

二つ目は organization verification です。API Organization Verification は、verification が image generation capabilities を unlock できると説明しています。さらに "not verified" が残る場合の具体的な手順も出しています。

- 30分 まで待つ

- 新しい API key を作る

- refresh または再ログインする

- 正しい organization を見ているか確認する

これを先に書く価値があるのは、多くの開発者が逆の順番で動くからです。SDK を入れ直し、prompt を変え、サンプルを書き換える前に、そもそもその account が image lane に到達できるかを確かめるべきです。

三つ目は route choice です。単発画像が欲しいだけなのに Responses の例を持ってきたら、不要な tool orchestration をデバッグすることになります。古い記事から gpt-4o や hosted image URL 前提の形を拾ってきたら、さらに時間を失います。

きれいな診断順は次の通りです。

- access と organization

- current model name

- endpoint と request shape

- output の decode

- prompt quality

主な詰まりがまだ access 側にあるなら、日本語の OpenAI image generation API verification に進む方が早いです。そこは verification branch をもっと深く扱っています。

避けるべき弱いチュートリアル

一つ目の弱いパターンは proxy-first tutorial です。問題全体を「この proxy を使って ChatGPT image API を開け」と説明するページは、それだけで current official route から読者を遠ざけています。見た目が立派でも、古い default model、間違った model name、あるいはそのサービスの中でしか意味を持たない route を教えていることが少なくありません。

二つ目は gpt-4o を current default に置く記事 です。まだ ranking しやすいのは名前が十分新しそうに見えるからですが、今の OpenAI docs は gpt-image-1.5 を勧めています。2026年の fresh article がこの query の default answer を gpt-4o 中心で書くのは、もう正しいスタートではありません。

三つ目は Responses の mental model を説明しない記事 です。Responses が画像を扱えること自体は正しくても、top-level model は mainline model であり、image work は image_generation tool 側で行われることを説明しないページは、読者を field-level の誤読に導きます。

四つ目は ChatGPT のプラン挙動と API access を同じ gate とみなすこと です。ChatGPT というプロダクト体験が query の出発点になるのは自然ですが、usage tier、organization verification、explicit model availability は別の operational question です。

良い習慣は、tutorial を開いたら次の四つを確認することです。

- GPT Image family の current naming を使っているか

- Images API と Responses tool を分けているか

- request だけでなく output 保存まで説明しているか

- SDK を責める前に tier と verification を触れているか

大半が no なら、そのページは rank していても implementation guide としては弱い可能性が高いです。

最後のおすすめ

単に API で画像を生成したいだけなら、現時点で最も安全な答えは OpenAI Images API と gpt-image-1.5 を使うこと です。多くの人が chatgpt api generate image で本当に探しているのはこれです。まだ OpenAI surface の名前を知らなくても、実務上の入口はそこになります。

chatgpt-image-latest は current ChatGPT alias を追うこと自体が目的のときだけ使う。Responses image_generation は画像がより大きな multimodal workflow の一部になったときだけ使う。この二つは conscious choice であるべきで、最初の推測であるべきではありません。

いちばん時間を無駄にしにくい順番はこうです。

- Images API の直通例を一つ動かす

- account に access があることを確認する

- base64 画像を正しく保存する

- そのあとで alias、edit、Responses を足す

派手な "complete guide" ではありませんが、この順番こそが今の SERP にまだ足りないものです。