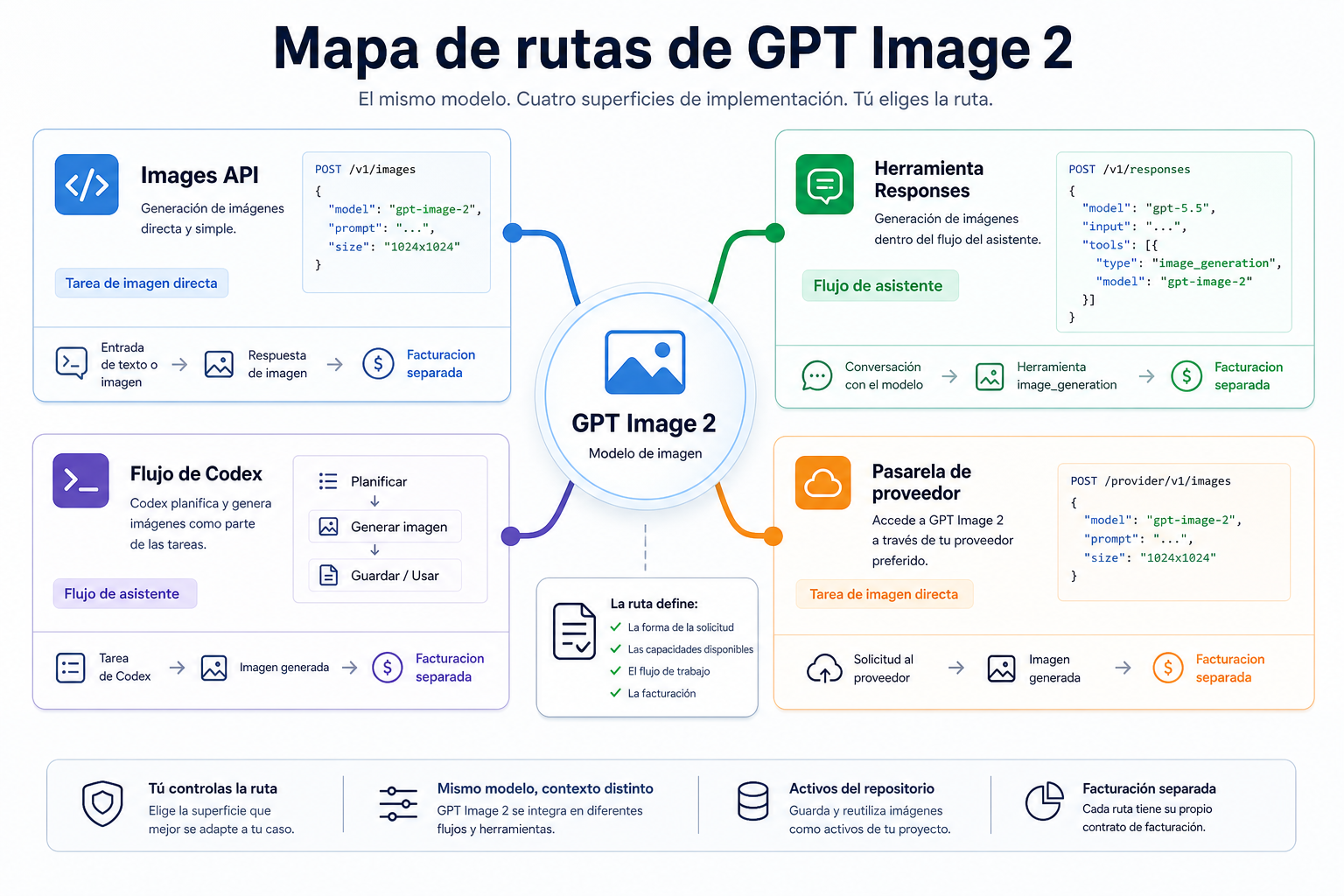

Si vas a usar GPT Image 2, la primera decisión no es qué snippet copiar, sino qué ruta debe hacerse responsable del trabajo. Para generación directa o edición de imágenes, empieza con Images API. Si la imagen aparece dentro de un assistant o agent flow, usa Responses con el tool image_generation. Si lo que necesitas es producir covers, diagramas o assets visuales dentro de un repositorio, Codex puede ser el workflow adecuado. Si buscas acceso unificado, pago alternativo, respaldo o routing entre proveedores, un gateway externo es otro contrato.

La confusión aparece porque el mismo nombre de modelo se ve en varios lugares. Pero no todos esos lugares comparten endpoint, request shape ni factura. Los errores más comunes son poner gpt-image-2 como model superior en Responses, explicar el uso de Codex como si fuera billing de OpenAI API key, o copiar una tarifa de gateway en una tabla de precios oficiales de OpenAI. La secuencia correcta es más aburrida y más segura: elige route, escribe el payload que corresponde a esa route y deja claro qué billing boundary aplica.

Decide la ruta antes de escribir código

Si tu backend solo necesita generar una imagen, Images API es la superficie más simple. Te permite comprobar API key, project, acceso al modelo, tamaño, calidad, almacenamiento de salida y errores sin añadir una capa agentic. Si el usuario conversa con un assistant, el modelo decide cuándo necesita una imagen y después continúa con texto, archivos o tools, Responses es más natural. Codex es otro caso: funciona muy bien como workflow local de repositorio, pero no es sinónimo de public API endpoint.

| Trabajo real | Ruta inicial | Dónde va el model ID | De quién es la factura o límite | Error que conviene evitar |

|---|---|---|---|---|

| Generar una imagen desde backend | Images API | model: "gpt-image-2" en el image request | OpenAI API project | llamar a esto Codex endpoint |

| Editar imágenes de entrada | Images API edits | model del edit request | OpenAI API project | mandar edits a Responses sin necesidad |

| Generar imágenes dentro de un assistant | Responses + image_generation | top-level model textual; image model en tool | billing de Responses/API | poner gpt-image-2 como top-level model |

| Crear assets para docs o repo | Codex workflow | lo gestiona la capacidad de imagen de Codex | plan o credits de Codex/ChatGPT | tratarlo como uso de API key |

| Unificar acceso o pago | gateway externo | mapping del proveedor | contrato del gateway | convertir precio del gateway en precio oficial |

La tabla no existe para decorar la página. Existe para decidir quién posee el trabajo. Images API posee generación y edición directas. Responses posee la orquestación con tools. Codex posee la producción de archivos dentro del repositorio. El gateway posee su propia ruta de acceso y facturación. Cuando ese ownership está claro, el código y la explicación de costes dejan de pelearse.

Generación y edición directas: empieza con Images API

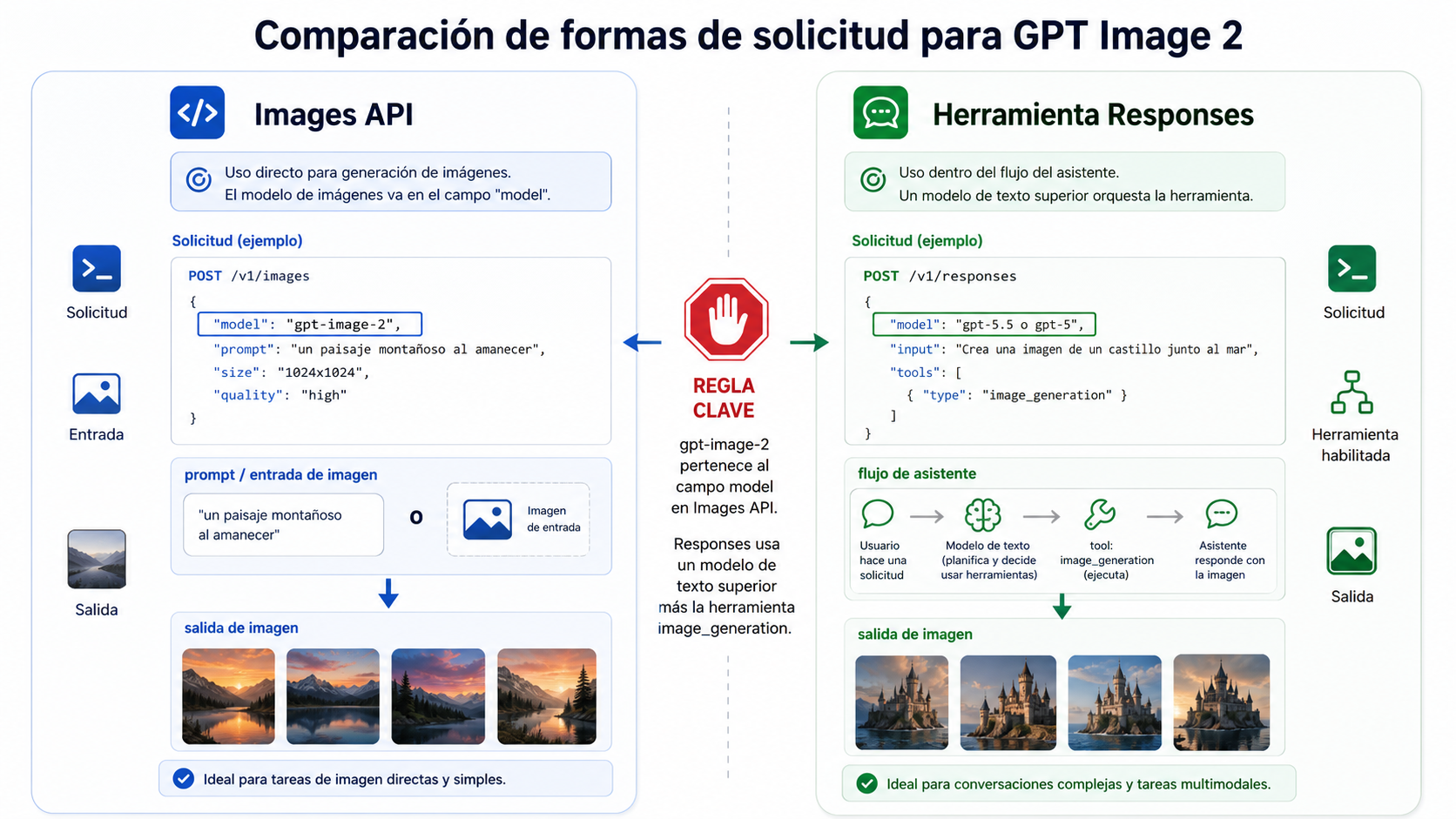

El model ID oficial para GPT Image 2 es gpt-image-2. Si el trabajo se puede resumir como “crear una imagen” o “editar esta imagen”, Images API es el punto de partida más limpio. Su superficie es estrecha: un endpoint de imágenes, un campo model, parámetros de tamaño y calidad, una salida que guardar y una lista manejable de errores.

La primera llamada debería ser deliberadamente simple. No mezcles transparent background, varias imágenes de entrada, streaming, Responses tools y fallback de gateway en la misma prueba. Comprueba primero si el project tiene acceso al modelo, si la organization requiere verificación, si el payload se acepta y si puedes guardar la salida con un identificador trazable.

tsimport OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY }); const image = await client.images.generate({ model: "gpt-image-2", prompt: "Create a clean route map for a developer documentation page.", size: "1024x1024", quality: "medium" });

La edición pertenece a la misma familia. Si tienes una o más imágenes de entrada y quieres producir una nueva versión, mira Images API edits primero. Responses no es “más correcto” por ser más nuevo; es más correcto cuando la imagen es una herramienta dentro de una experiencia conversacional o agentic.

También hay una realidad de acceso que conviene escribir sin prometer de más. Los modelos GPT Image pueden requerir organization verification. Que una demo pública funcione no significa que todos los projects estén listos. Una guía seria debe mencionar API key, project, billing, organization y acceso al modelo como parte de la primera verificación.

Responses sirve para assistant flows, no para reemplazar endpoints

Responses con image_generation es fuerte cuando la imagen forma parte de un flujo mayor. Imagina que el usuario pide una campaña, el modelo propone un concepto, genera una imagen, devuelve instrucciones de publicación y quizá ejecuta otras tools. Ahí el top-level model entiende el contexto y decide tools; el tool de imagen produce el asset.

La regla crítica es no poner gpt-image-2 como top-level model de Responses. El top-level model debe ser un modelo capaz de manejar texto y razonamiento, mientras que la generación se configura como tool. Si no separas esos roles, el fallo puede parecer un problema de permisos, de modelo, de SDK o de parsing al mismo tiempo.

tsconst response = await client.responses.create({ model: "gpt-5.4", input: "Plan a product launch card and generate one square image for it.", tools: [{ type: "image_generation", model: "gpt-image-2" }] });

Responses ofrece más contexto, pero también más superficie operativa. Debes extraer tool results, guardar archivos, manejar estados parciales, decidir retry policy y explicar el billing. Para un simple botón de “generar imagen”, ese coste de complejidad puede no compensar. Para un assistant real, sí.

Codex es workflow de repositorio, no nombre de endpoint público

En español ya aparecen vídeos y posts que mezclan GPT Image 2 con Codex o Claude Code. Eso tiene sentido: Codex es muy útil para producir assets dentro de un proyecto. Puedes generar una portada, un diagrama, un mockup o un tablero visual y dejar prompt, archivo generado, asset publicado y revisión en el mismo contexto de repo.

Pero eso no convierte Codex en la ruta de production backend. Si un usuario de tu app pide una imagen y tu servidor debe devolverla, almacenarla, cobrarla, auditarla y reintentarla, necesitas Images API o Responses. Codex puede ayudarte a crear documentación y recursos visuales para explicar el producto, pero no debe ser el nombre con el que describes todo el contrato de OpenAI API.

Esta distinción importa porque cambia quién responde por el resultado. En Codex, normalmente un humano revisa el asset antes de publicarlo. En production API, el sistema responde automáticamente a usuarios y debe manejar logs, storage, retries, deletion y costs. Ver el mismo nombre de modelo no significa tener la misma responsabilidad.

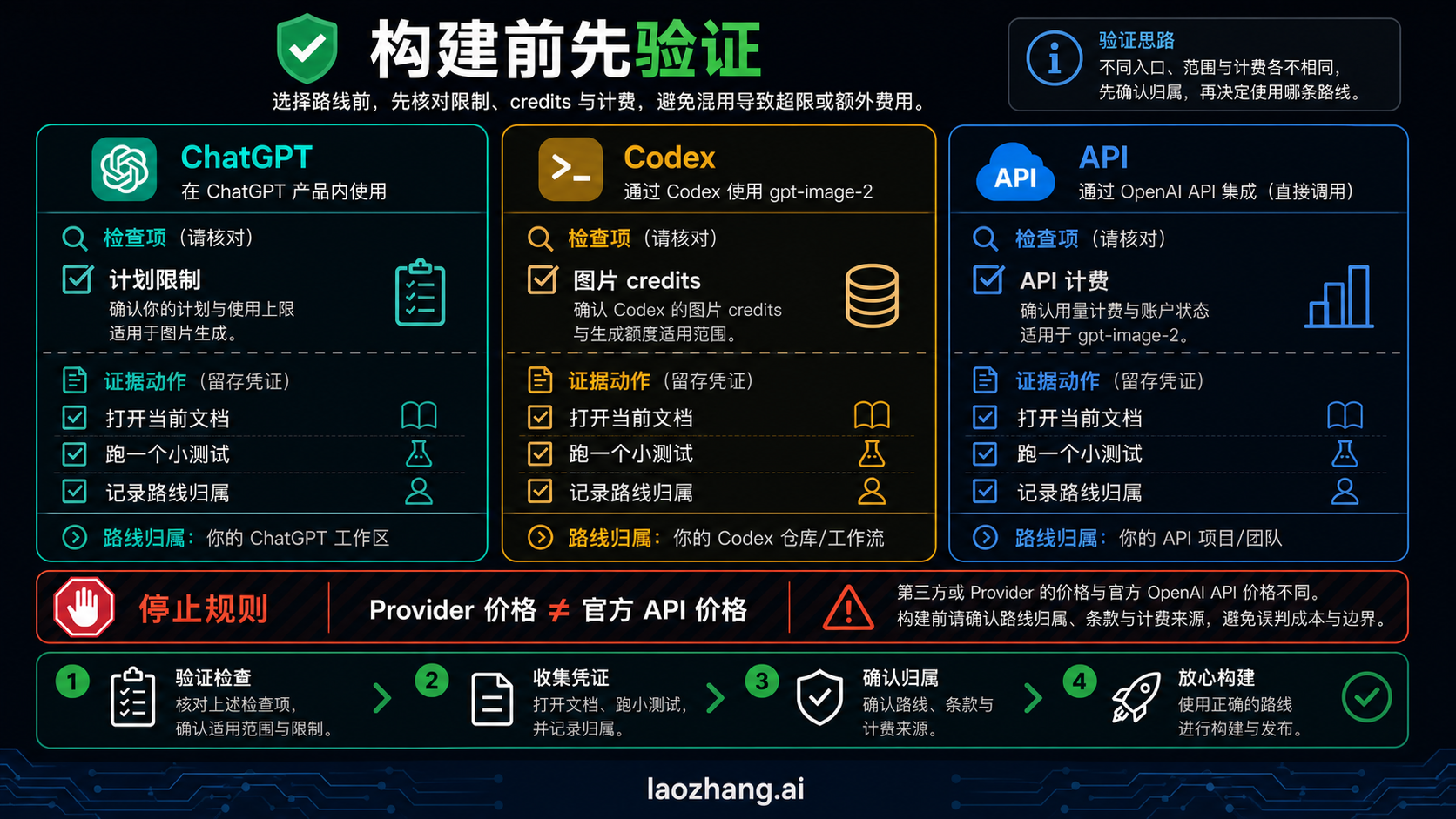

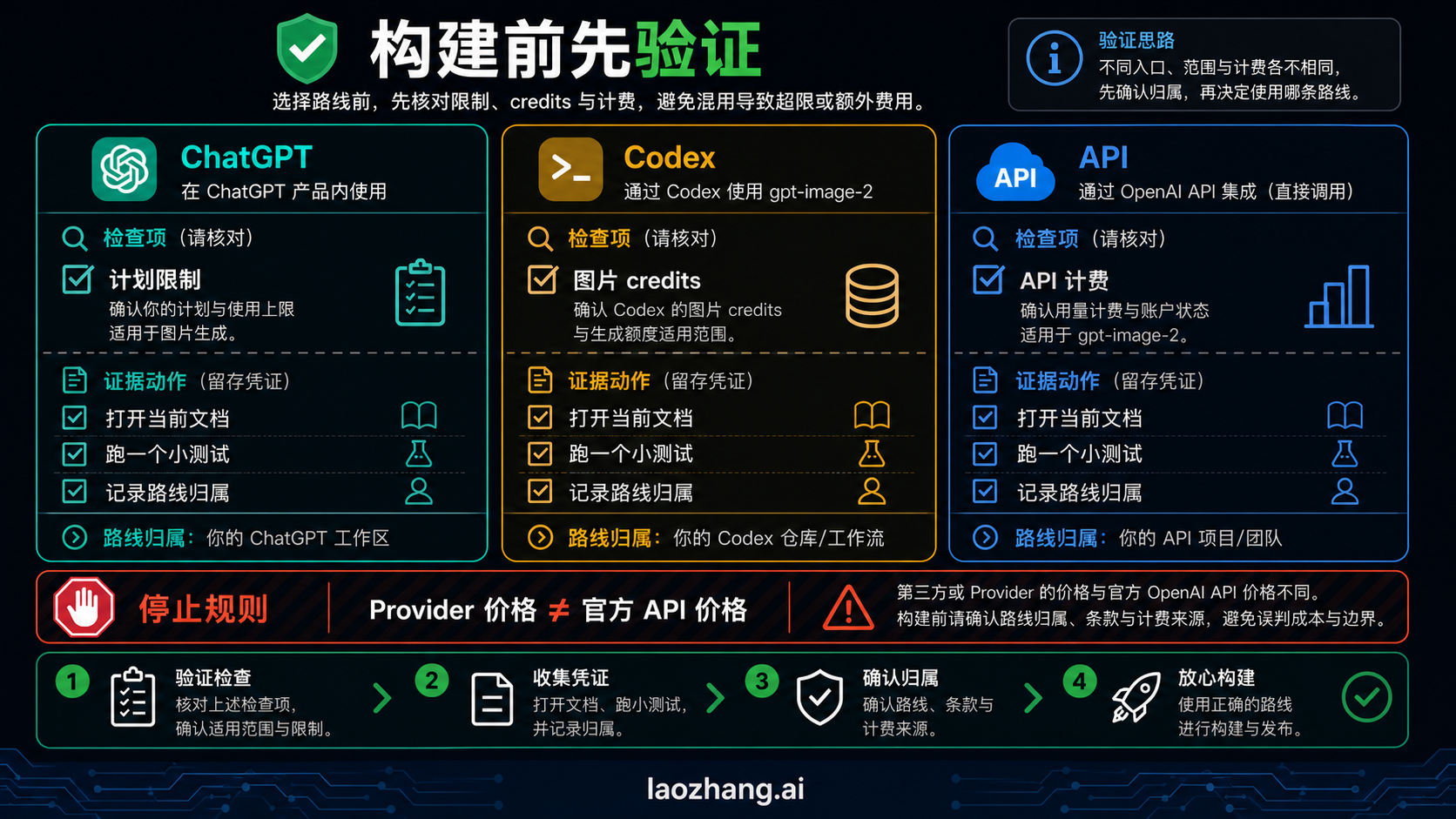

Costes: separa tres facturas

Para GPT Image 2, los costes deben explicarse en tres cajas. La primera es el precio oficial de OpenAI API cuando llamas Images API o Responses con API key. La segunda son credits o límites de plan en Codex/ChatGPT cuando generas assets dentro de un workspace. La tercera es el precio de un gateway externo, que pertenece al contrato de ese proveedor.

Mezclar esas cajas crea presupuestos falsos. Una tarifa de gateway no es precio oficial de OpenAI. Un credit de Codex no es cuota gratuita de backend API. Un ejemplo oficial por quality no se puede copiar automáticamente a un proveedor que añade routing, conversión de pago o soporte propio.

Un gateway externo puede tener sentido si necesitas una única key, pago local, ruta de respaldo, multi-model routing o consolidación de facturas de equipo. En ese contexto, laozhang.ai puede mencionarse como ruta separada de API gateway, con docs.laozhang.ai y api.laozhang.ai como puntos para revisar la integración. Lo que no conviene hacer es prometer claims no verificados como velocidad ilimitada, ausencia de bloqueos, uptime garantizado, reembolsos o “fallo sin coste”.

Qué registrar antes de production

Sea cual sea la ruta elegida, guarda suficientes datos para explicar cada salida. Como mínimo: route, model ID, quality, size, número de imágenes de entrada, formato de salida, request ID, output ID, storage path, coste, user/project, retry count, error code y account readiness. Una imagen es difícil de reproducir solo mirando el resultado final; necesitas saber con qué condiciones se generó.

También debes reflejar límites de capacidad en el producto. GPT Image 2 no soporta transparent backgrounds actualmente. Si tu UI ofrece esa opción como si fuera normal, empujará a los usuarios hacia errores previsibles. Sepárala, desactívala o envíala a una ruta donde la capacidad sí esté confirmada.

Si usas streaming o salidas parciales, define qué se muestra al usuario, si un resultado incompleto se guarda, quién paga el retry y cómo se relaciona la nueva salida con la anterior. Estas decisiones parecen detalles de backend, pero son exactamente lo que convierte una guía en algo utilizable para un equipo de producto.

Migrar desde GPT Image 1.5 no es solo cambiar el model string

Si ya tienes integración con GPT Image 1.5 o un modelo anterior, no cambies solo el valor de model. Primero identifica el route actual: direct Images API, Responses tool flow, Codex asset workflow o gateway externo. Después revisa campos de request, output format, storage, assumptions sobre transparent background, verification requirement y price attribution.

Las guías locales de OpenAI image generation API endpoint, OpenAI image editing API y OpenAI image generation API curl sirven para la mecánica general. GPT Image 2 exige una decisión más estrecha: cuando aparece en API, Responses, Codex y providers, hay que decidir qué ruta posee tu trabajo.

Antes del rollout, cierra con tres preguntas. ¿La experiencia del usuario es generar una imagen directa o pedir a un assistant que complete una tarea? ¿La salida entra en storage y billing de production? ¿Cada claim de precio, límite y capacidad está respaldado por una fuente actual? Si las tres respuestas están claras, el route choice está listo para documentarse.

Preguntas frecuentes

¿GPT Image 2 solo se usa con Codex?

No. Codex es útil para assets de repositorio, pero generación y edición directas pertenecen a Images API. Para un backend de producto, no uses Codex como sustituto del route de API pública.

¿Puedo poner gpt-image-2 como top-level model en Responses?

No es la forma correcta. En Responses, el top-level model entiende el contexto y decide tools. La imagen se genera mediante image_generation, donde debe vivir la configuración de imagen.

¿En qué se diferencian OpenAI API pricing y Codex credits?

OpenAI API pricing aplica a llamadas con API key. Codex credits o plan limits aplican al uso de Codex como workflow. El precio de un gateway externo es una tercera capa y debe explicarse como provider-owned pricing.

¿GPT Image 2 soporta fondo transparente?

Actualmente no. Si tu producto necesita transparent background, no lo expongas como opción normal dentro de la ruta GPT Image 2. Usa otra ruta confirmada o marca la opción como no disponible.

¿Cuándo tiene sentido usar un gateway externo?

Cuando necesitas acceso unificado, pago local, fallback, multi-model routing o facturación de equipo. Si la API oficial de OpenAI ya cubre acceso, coste y compliance, suele ser la ruta más simple.

¿Qué diferencia hay con una guía normal de endpoints?

Una guía de endpoints responde qué path llamar. La decisión de ruta para GPT Image 2 responde qué superficie debe poseer el trabajo cuando aparece al mismo tiempo en API, Responses, Codex y gateways. Un demo puede funcionar aunque el contrato esté mal explicado; production no suele perdonar esa mezcla.