A fecha de 28 de marzo de 2026, gpt-image-1-mini merece la pena cuando el coste por imagen es de verdad la restricción principal. Si lo que más te importa es arrancar con el default más seguro dentro de OpenAI para prompt adherence, edición exigente, trabajo con varias imágenes de referencia o text-plus-image output, lo razonable es empezar por GPT Image 1.5.

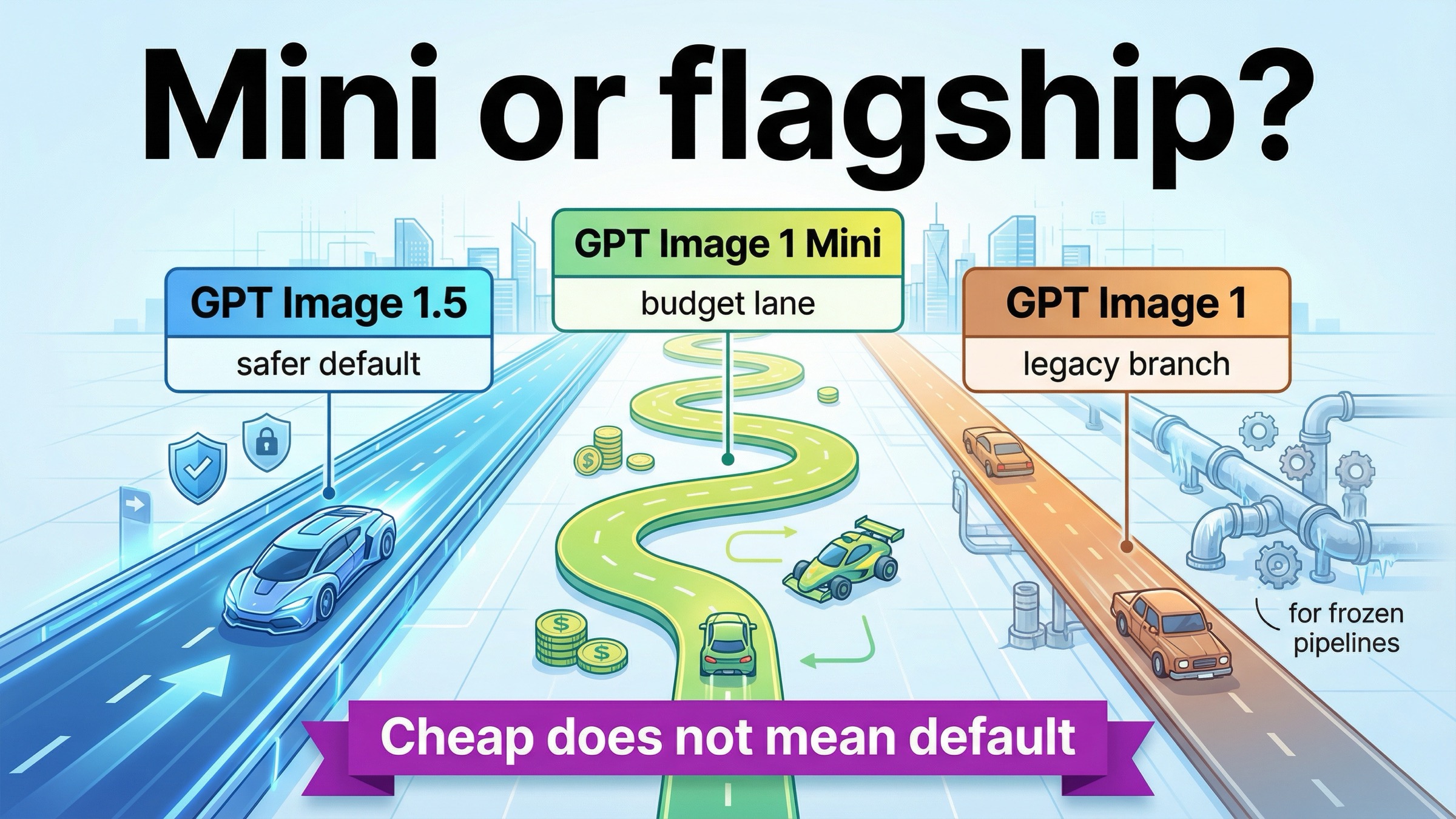

Ese reparto se ve mucho mejor en la documentación actual de OpenAI que en la SERP. El catálogo de modelos vigente a 28 de marzo de 2026 presenta GPT Image 1.5 como state-of-the-art image generation model, GPT Image 1 como previous image generation model, y la página de gpt-image-1-mini define mini como una cost-efficient version of GPT Image 1. Es decir: mini existe, está vivo y tiene sentido. Lo que no es, al menos hoy, es el flagship por defecto.

La suposición más engañosa en esta familia de búsquedas es pensar que mini también tiene que ser el más rápido porque es más pequeño y más barato. Las páginas actuales no sostienen esa idea. En la página de mini la velocidad aparece como Slowest, mientras que en la página de GPT Image 1.5 figura Medium. Así que la pregunta útil no es “¿mini es bueno?”. La pregunta útil es qué workflows merecen aprovechar su precio más bajo y cuáles deberían pagar por GPT Image 1.5 desde el primer día.

Resumen rápido

- Usa

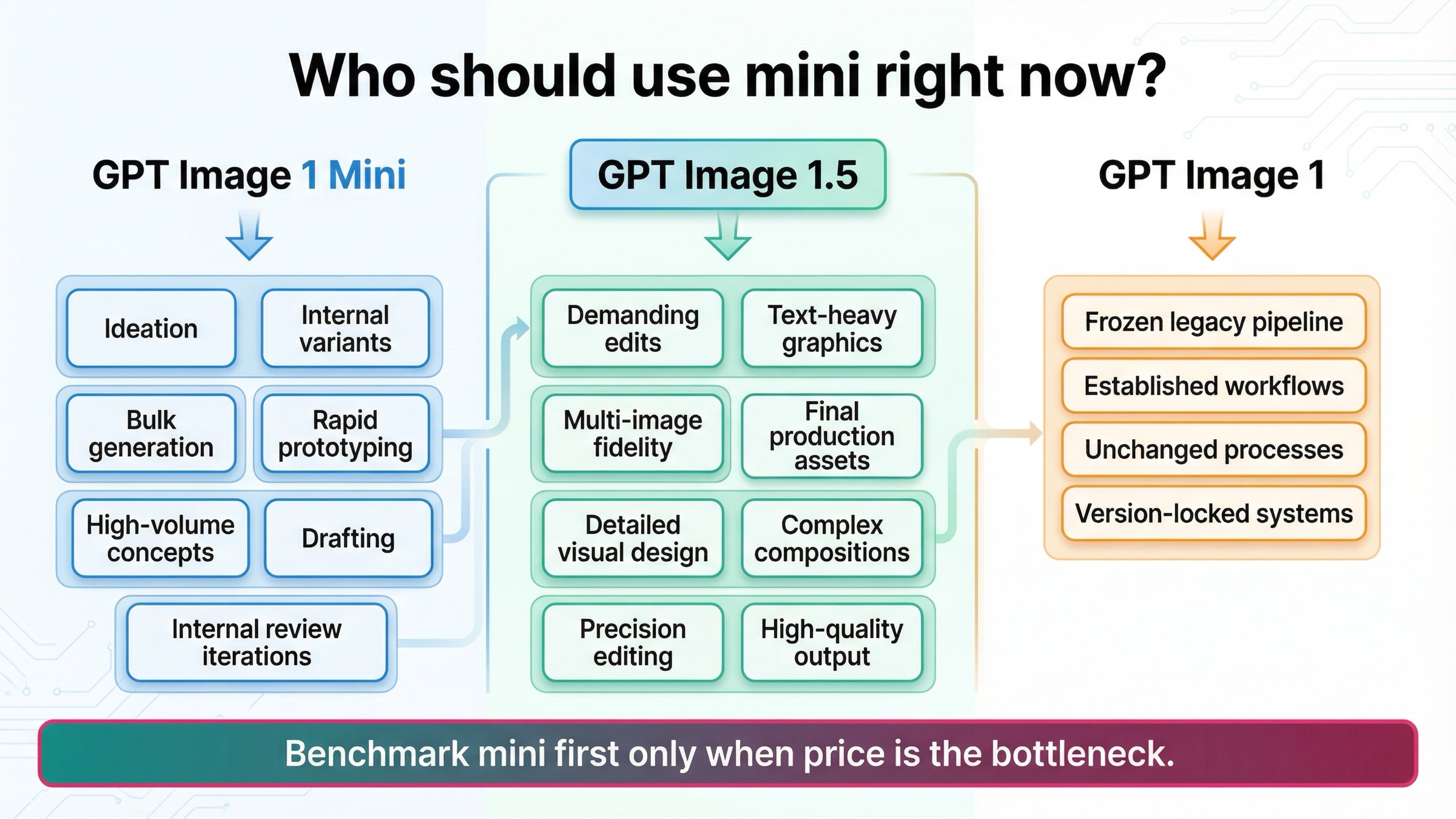

gpt-image-1-minicuando el coste por imagen mande y el trabajo sea sobre todo generación en volumen, variantes internas, borradores o creative batchable. - Empieza con GPT Image 1.5 cuando el valor esté en prompt adherence, layout control, multi-image fidelity o text-plus-image output.

- Mantén GPT Image 1 solo para compatibilidad legacy y pipelines congelados.

| Qué te importa más | Por dónde empezar | Por qué |

|---|---|---|

| El precio más bajo dentro del stack actual de OpenAI | gpt-image-1-mini | Es el carril oficial más barato para generación abundante y tareas de bajo riesgo |

| El default más seguro para un workflow exigente | GPT Image 1.5 | Permite arrancar con más margen en prompt adherence, edición y fidelidad con varias entradas |

| Mantener compatibilidad con un pipeline antiguo | GPT Image 1 | Es la generación anterior y su valor está sobre todo en lo legacy |

Dónde GPT Image 1 Mini sí destaca

La mejor baza de mini no es solo “ser barato”. Su valor real está en bajar el suelo de precio para un workflow de imagen actual dentro de OpenAI. En la página oficial vigente, la generación cuadrada 1024x1024 cuesta $0.005 / $0.011 / $0.036 en mini para low, medium y high, mientras que GPT Image 1.5 marca $0.009 / $0.034 / $0.133 para la misma escalera. No es una diferencia cosmética. A volumen cambia lo que te puedes permitir probar.

Además, mini tiene más anchura de surface API de la que muchas reseñas rápidas le conceden. En la página del modelo siguen apareciendo Responses, Chat Completions, Batch, v1/images/generations y v1/images/edits. Eso importa porque mini no es solo una vía barata para lanzar una imagen y salir. Puede formar parte de workflows reales, incluso con edición, siempre que aceptes sus tradeoffs.

Eso deja tres escenarios donde mini encaja bien.

El primero es volume-first generation. Si necesitas muchos conceptos, moodboards, variantes publicitarias de bajo riesgo, mockups internos o lotes amplios de candidatos para seleccionar después, el ahorro de mini se nota enseguida. En este tipo de trabajo la pregunta no es “¿sale la mejor imagen posible al primer intento?”, sino “¿puedo generar suficientes opciones viables por menos dinero?”.

El segundo es el cheap benchmark lane. Si todavía no sabes si el sobreprecio de GPT Image 1.5 te está resolviendo un problema real, mini es un control excelente dentro de la misma familia. Sirve para medir cuánto pierdes de verdad al ir por la línea barata antes de abrir el debate OpenAI vs otro proveedor.

El tercero es el workflow interno batchable, donde el mayor error económico sería mandar por defecto todas las imágenes al carril caro. La página actual de API Pricing recuerda además que Batch API ofrece 50% de ahorro en inputs y outputs. Para equipos sensibles al coste eso refuerza todavía más la idea de medir primero.

Por eso una reseña justa no debería resumir mini como “barato pero flojo”. Más bien habría que decir: barato, actual, suficientemente amplio en su API y muy útil cuando el trabajo consiste en generar mucho con un nivel de riesgo asumible.

Si lo que buscas es solo el cálculo fino de costes, el siguiente paso es GPT Image 1 Mini pricing. Esta página es otra cosa: una reseña sobre cuándo mini es la elección correcta.

Dónde GPT Image 1 Mini se queda corto primero

Las debilidades de mini también aparecen más claras en la documentación oficial que en muchas reviews superficiales.

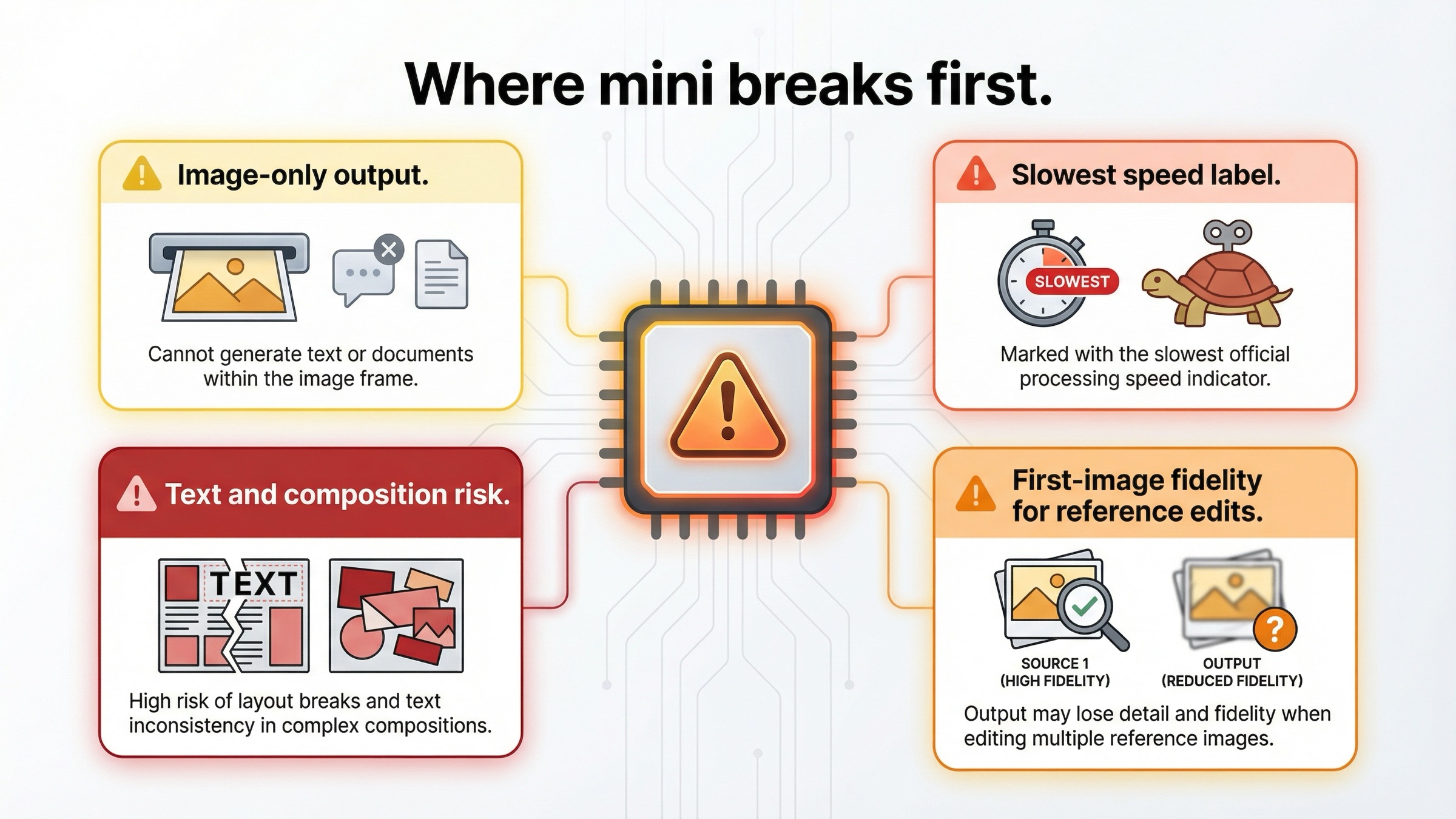

La primera es la forma de salida. La página de GPT Image 1.5 soporta image and text output, mientras que la página de mini lo sigue describiendo como image-output-only. Si tu flujo solo necesita una imagen final, puede parecer una diferencia menor. En cuanto el workflow se beneficia de devolver también explicación, resumen, clasificación o contexto en texto, la diferencia deja de ser pequeña.

La segunda es el workflow headroom. La image generation guide actual de OpenAI sigue advirtiendo sobre problemas con colocación precisa de texto, consistencia entre generaciones y control de composición, y también dice que prompts complejos pueden tardar hasta 2 minutos. Esto afecta a toda la familia GPT Image, pero golpea más a mini porque el carril barato solo sigue siendo barato si no dispara reintentos y correcciones manuales.

La tercera es la multi-image fidelity. Este es uno de los huecos más claros de la SERP actual. La misma guía explica que con high input fidelity gpt-image-1 y gpt-image-1-mini conservan mejor la primera imagen, mientras que GPT Image 1.5 mantiene con mayor fidelidad las primeras cinco imágenes de entrada. No es un detalle menor. Cambia la ruta para brand-preserving edits, trabajo con varias referencias, style transfer y cualquier proceso en el que varias entradas deban sobrevivir casi intactas.

La cuarta es la ausencia de una ventaja oficial de velocidad. Aquí conviene ser directo. mini no está presentado hoy como un carril de baja latencia. En la página de mini sigue apareciendo Slowest. Eso no obliga a descartarlo, pero sí a dejar de elegirlo por intuición.

El resumen real de esta review es muy simple:

- el mejor caso de mini es el volumen barato

- el mejor caso de GPT Image 1.5 es el menor riesgo de workflow

En creative con texto, outputs premium, edición con múltiples referencias o trabajos donde cada fallo cuesta caro, mini deja de ser “la opción barata” muy rápido.

GPT Image 1 Mini vs GPT Image 1.5 vs GPT Image 1

La forma más útil de leer la familia actual de OpenAI es verla como budget lane, flagship lane y legacy lane.

| Modelo | Papel oficial actual | Speed label | Patrón de salida | Postura de coste | Cuándo es el default más seguro |

|---|---|---|---|---|---|

gpt-image-1-mini | Cost-efficient version of GPT Image 1 | Slowest | Solo imagen | El carril actual más barato de OpenAI | Cuando manda el coste y el trabajo es generation-heavy |

| GPT Image 1.5 | State-of-the-art image generation model | Medium | Imagen + texto | Gama media-alta | Cuando priorizas prompt adherence, edición y fidelidad con varias imágenes |

| GPT Image 1 | Previous image generation model | Slowest | Solo imagen | Más legacy y más caro que mini | Cuando necesitas compatibilidad o reproducibilidad de pipelines antiguos |

La tabla solo sirve si cambia el comportamiento.

Si vas a abrir un workflow nuevo de imagen con OpenAI, GPT Image 1.5 debería ser el punto de partida, salvo que ya sepas que el coste domina por completo. El catálogo, las páginas de modelo y la guía actual van en esa dirección.

Si quieres controlar el gasto en trabajo interno o de bajo riesgo, mini es la challenge model correcta. Te obliga a responder si el premium de GPT Image 1.5 resuelve una necesidad real o solo una inquietud abstracta.

Si todavía estás en GPT Image 1, su historia ya es mucho más estrecha. Sigue importando cuando hay sistemas vivos, prompts heredados o requisitos de reproducibilidad, pero no como nuevo default. El verdadero dilema actual es mini frente a 1.5, con GPT Image 1 quedándose al fondo como branch legacy.

Si la pregunta se amplía a “¿debo salir de OpenAI?”, la siguiente lectura más útil es GPT Image 1 Mini alternative. Si ya sabes que te quedas dentro de OpenAI, el mapa de familia anterior es la respuesta honesta.

Para profundizar más en flagship versus legacy, GPT Image 1 vs GPT Image 1.5 entra mejor en la lógica de migración. Esta reseña va de dónde encaja mini hoy.

Cómo leer precio, rate limits y acceso sin hype

Que mini es barato es verdad. El problema empieza cuando una página se queda solo con ese dato.

La página actual de mini muestra estos precios de generación cuadrada:

- Low: $0.005

- Medium: $0.011

- High: $0.036

También lista $2.00 por 1M text input tokens, $2.50 por 1M image input tokens y $8.00 por 1M image output tokens. En cuanto el workflow depende más de edits, reference images o high-input-fidelity behavior, dejar de mirar estos números y pensar solo en “cuánto cuesta una imagen” se vuelve engañoso.

En rate limits tampoco hay una ventaja oculta. La página de mini muestra para mini, GPT Image 1.5 y GPT Image 1 el mismo escalado general: Free not supported y luego Tier 1 a Tier 5 con 5 / 20 / 50 / 150 / 250 IPM. Además, el artículo actual sobre usage tier y verification aclara que GPT-image-1 y GPT-image-1-mini están disponibles para tiers 1 through 5, con parte del acceso sujeta a organization verification.

La regla operativa honesta es esta:

mini es un carril más barato, no un carril mágicamente más fácil

Si el bloqueo real está en verification, estado de la cuenta o comportamiento de rate limits en producción, una fila más barata en la tabla no arregla nada por sí sola.

Otra trampa es ignorar Batch. La API Pricing page sigue diciendo que Batch API ahorra 50% en inputs y outputs. Eso no borra la ventaja de mini, pero sí reduce la diferencia en trabajos asíncronos. Si GPT Image 1.5 recorta suficientes reintentos y tu workflow acepta Batch, el carril que parece caro puede terminar mucho más cerca de lo que sugiere la tarjeta de precio.

Por eso esta reseña no debería degradarse a una calculadora. La pregunta de verdad no es solo qué modelo cuesta menos por imagen, sino qué modelo cuesta menos para todo el workflow una vez que metes reintentos, edición, acceso y constraints de despliegue.

Si ya ves que GPT Image 1.5 probablemente encaja mejor y solo te falta el breakdown de precio, sigue con GPT Image 1.5 API pricing.

Si el problema no es el modelo sino tier, verification o acceso, te conviene más OpenAI image generation API verification. Si el bloqueo está en la implementación y no en la ruta, OpenAI image API tutorial es mejor compañero.

Quién debería usar mini ahora mismo

La forma más limpia de evaluar mini es por workflow, no por eslóganes.

Usa mini cuando el trabajo sea sobre todo generación barata a escala. Concept boards internos, variantes de campaña de bajo riesgo, assets desechables, ideación rápida y cualquier sistema en el que el filtro final lo haga una persona o un proceso posterior encajan bien aquí. En ese tipo de trabajo el precio bajo de mini sí hace trabajo real.

Usa mini cuando quieras un budget-first benchmark lane. Si aún no sabes si el premium de GPT Image 1.5 se paga solo, mini es el baseline barato correcto dentro de la misma familia.

No conviertas mini en el default para gráficas con texto, piezas sensibles al layout, ediciones de preservación de marca o workflows con varias referencias. Las limitaciones oficiales ya apuntan presión en esas zonas, y la forma actual en que GPT Image 1.5 maneja varias imágenes lo convierte en la opción más segura.

Tampoco hagas de mini el default cuando el workflow gana valor si un mismo modelo puede devolver texto e imagen juntos. Ahí GPT Image 1.5 justifica su precio mucho antes.

Si la queja principal contra mini es solo “la calidad general se queda corta”, el siguiente paso más racional suele ser subir a GPT Image 1.5 antes de cambiar de proveedor. Es la ruta interna que apoyan los documentos actuales de OpenAI y, muchas veces, la más barata en tiempo de ingeniería.

Si tu organización sigue en GPT Image 1, el orden sensato es:

- benchmark mini si la prioridad es bajar coste

- benchmark GPT Image 1.5 si la prioridad es la calidad actual y el margen para edición

- mantener GPT Image 1 solo donde la reproducibilidad legacy siga siendo imprescindible

Esa es la recomendación práctica que esta keyword realmente necesita. mini no es el modelo equivocado. Lo equivocado es convertirlo en default para trabajos que no deberían arrancar ahí.

Conclusión

gpt-image-1-mini sí merece la pena en 2026, pero sobre todo como current budget lane de OpenAI, no como el mejor default general.

Si el primer condicionante es el coste por imagen y el workflow gira alrededor de generación masiva, variantes internas o creative batchable, mini es una elección razonable hoy. Si en cambio pesan más el prompt adherence, la edición rica, la fidelidad con varias imágenes, los trabajos sensibles al layout o el text-plus-image output, empezar por GPT Image 1.5 es más seguro.

El veredicto más honesto es este: usa mini cuando el carril barato resuelva de verdad el problema. Usa GPT Image 1.5 cuando el propio workflow sea lo bastante valioso como para que la imagen más barata ya no sea la decisión más barata.

FAQ

¿GPT Image 1 Mini es lo mismo que GPT Image 1.5 Mini?

No. OpenAI describe ahora gpt-image-1-mini como una cost-efficient version of GPT Image 1, no como una rama pequeña de GPT Image 1.5.

¿GPT Image 1 Mini es más rápido por ser más pequeño y más barato?

No conviene asumirlo. La página actual de mini lo marca como Slowest, mientras que GPT Image 1.5 aparece como Medium.

¿GPT Image 1 Mini soporta image edits?

Sí. La página oficial vigente sigue incluyendo v1/images/edits. La cuestión no es si soporta edits en abstracto, sino si es la lane adecuada para workflows con mucha edición y varias referencias.

¿Necesito un tier de pago para usar GPT Image 1 Mini?

Sí. La página del modelo dice Free not supported, y el artículo de usage tiers añade que GPT-image-1 y GPT-image-1-mini están disponibles para tiers 1 through 5, con parte del acceso sujeta a organization verification.

¿Qué debería elegir para un proyecto nuevo este mes: mini o GPT Image 1.5?

Por defecto, GPT Image 1.5. mini solo debería ser tu punto de partida cuando ya sabes que el workflow es budget-first, tolera mejor los compromisos y de verdad necesita el precio más bajo por imagen.