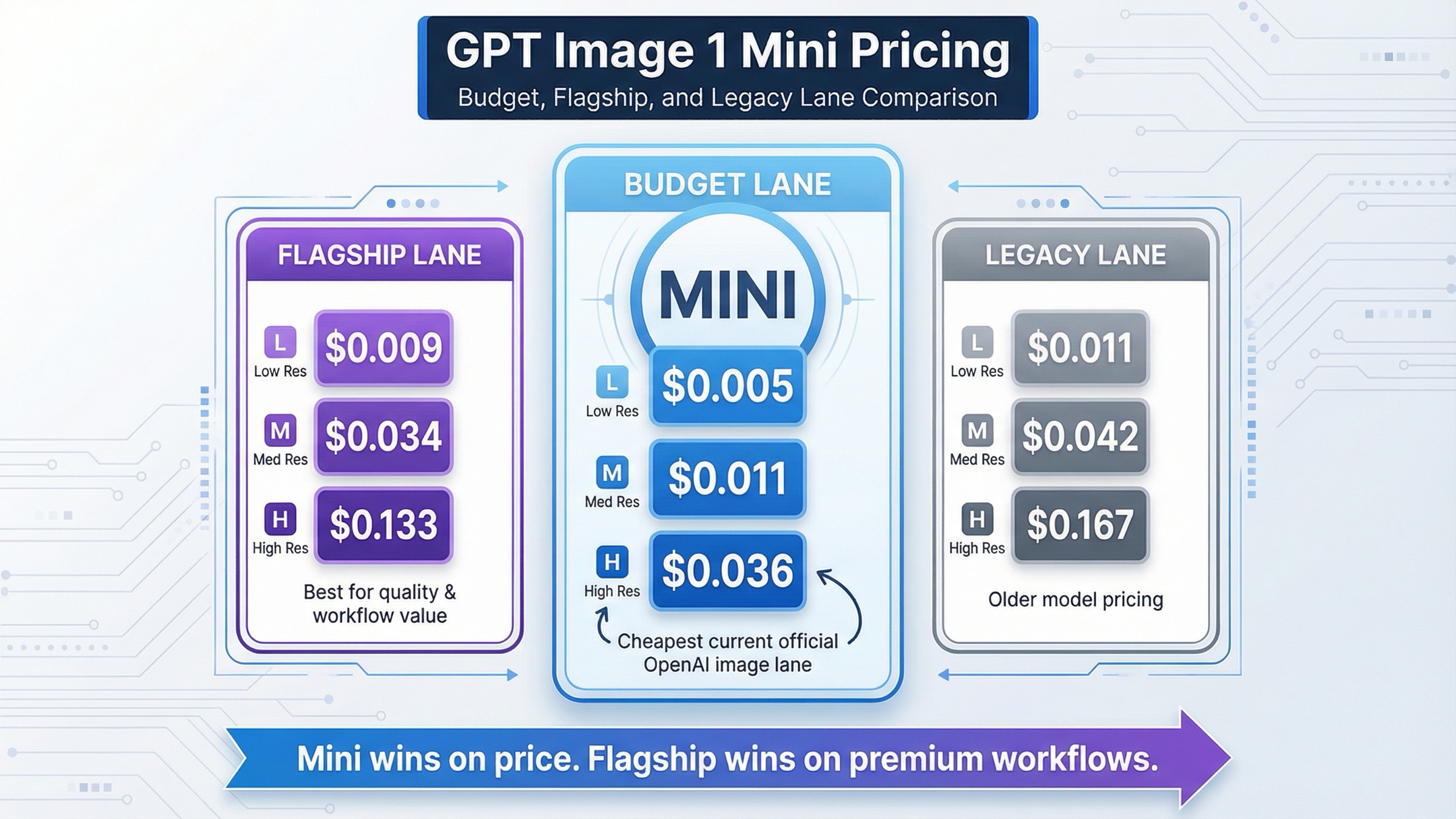

A fecha de 27 de marzo de 2026, gpt-image-1-mini cuesta $0.005, $0.011 y $0.036 para 1024x1024 low, medium y high, y $0.006, $0.015 y $0.052 para 1024x1536 y 1536x1024. Si tu pregunta es simplemente "cual es hoy la route oficial de OpenAI mas barata para generar imagenes", la respuesta corta es Mini.

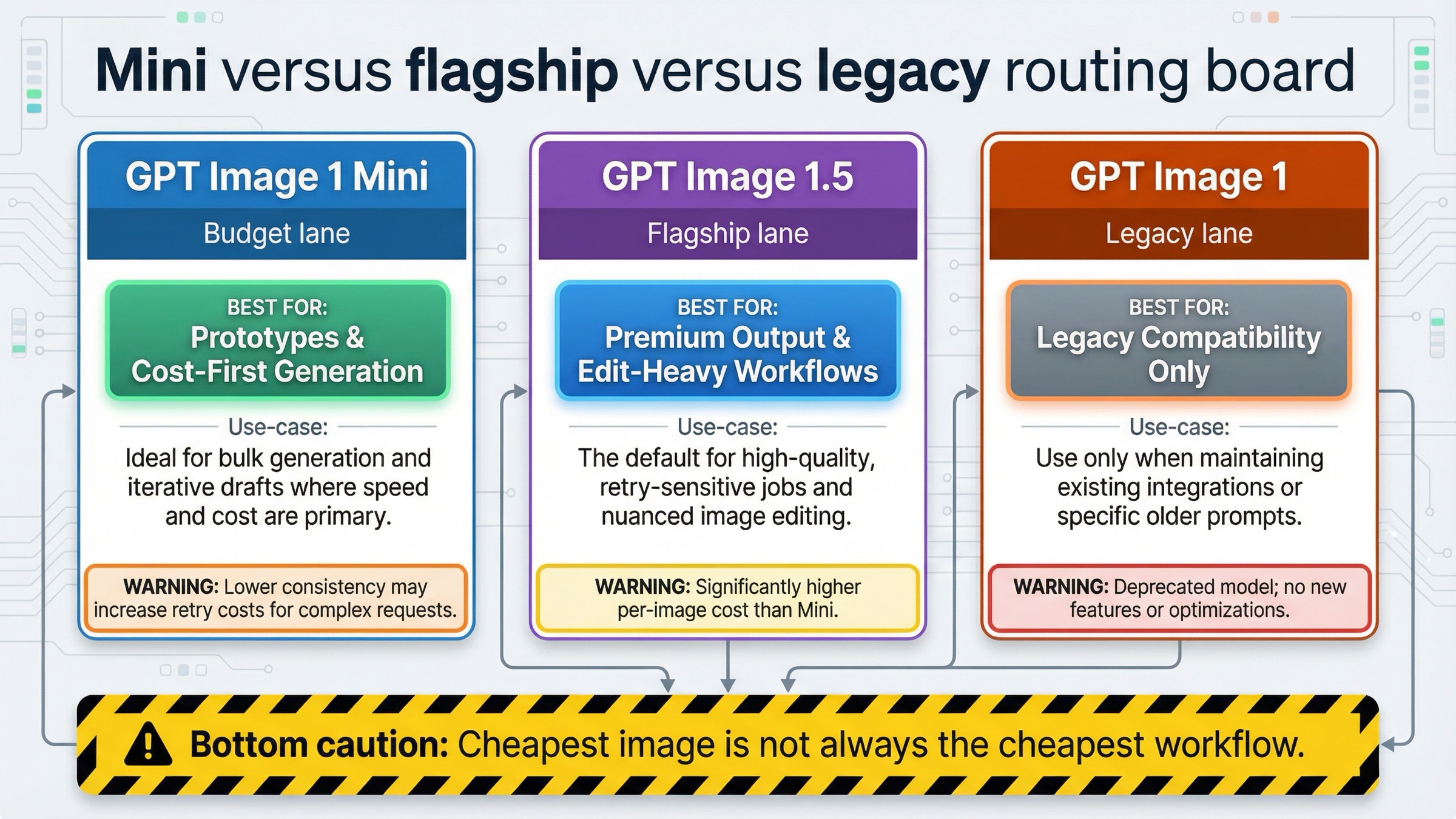

Pero ese dato no resuelve la decision real. El catalogo actual de OpenAI coloca GPT Image 1.5 como flagship image model, GPT Image 1 como previous model, y gpt-image-1-mini como version cost-efficient de GPT Image 1. Asi que el punto util no es solo "cuanto cuesta Mini", sino cuando Mini es el default correcto y cuando el sticker price te empuja a una decision peor.

La regla operativa mas util es esta: si tu prioridad es bajar el coste por output image y el workflow es sobre todo generation-heavy, empieza con Mini. Si en cambio dependes de edicion, de menos retries, de salida premium o de un mejor ajuste al prompt, entonces GPT Image 1.5 no deberia descartarse solo por ser mas caro por imagen.

Resumen rápido

- Square pricing: $0.005 / $0.011 / $0.036 para 1024x1024 low / medium / high

- Portrait y landscape pricing: $0.006 / $0.015 / $0.052

- Token rates de Mini: $2.00 text input, $0.20 cached text input, $2.50 image input, $0.25 cached image input y $8.00 image output por 1M tokens

- Acceso actual: Free no soportado; Tier 1 empieza en 100,000 TPM y 5 IPM

- Mejor encaje: prototipos, borradores masivos, tareas donde el coste manda

- Caveat principal: la imagen mas barata no siempre produce el workflow mas barato

Precio de GPT Image 1 Mini de un vistazo

La forma mas limpia de leer esta keyword es separar el precio visible por output image de la capa de token billing que hay debajo. La primera cifra es lo que casi todo el mundo busca primero, y la pagina oficial actual de gpt-image-1-mini lo deja bastante claro.

| Calidad | 1024x1024 | 1024x1536 | 1536x1024 |

|---|---|---|---|

| Low | $0.005 | $0.006 | $0.006 |

| Medium | $0.011 | $0.015 | $0.015 |

| High | $0.036 | $0.052 | $0.052 |

OpenAI tambien lista estos token rates:

- Text input: $2.00 por 1M tokens

- Cached text input: $0.20 por 1M

- Image input: $2.50 por 1M

- Cached image input: $0.25 por 1M

- Image output: $8.00 por 1M

Eso importa porque muchas paginas de page one se quedan solo con la tabla de output image. Para generation simple y prompts cortos, esa simplificacion suele bastar como rough estimate. Pero el simple hecho de que OpenAI publique input tokens de texto e imagen ya te dice que esta query es una decision de presupuesto, no solo una consulta de tabla.

Si lo que necesitas es el mapa amplio de precios de la familia OpenAI image, la lectura complementaria natural es OpenAI image generation API pricing. Esta pagina es mas estrecha a proposito: Mini, su decision real y nada mas.

Cuándo conviene Mini y cuándo no frente a GPT Image 1.5 y GPT Image 1

La tabla de precios solo sirve de verdad cuando la conviertes en una decision de modelo. Mini es hoy la lane oficial mas barata de OpenAI para imagen, pero la lane mas barata no siempre equivale al workflow mas barato.

| Modelo | Papel actual | 1024x1024 low | 1024x1024 medium | 1024x1024 high | Mejor default cuando |

|---|---|---|---|---|---|

gpt-image-1-mini | Budget lane actual | $0.005 | $0.011 | $0.036 | El coste es la primera restriccion |

| GPT Image 1.5 | Flagship actual | $0.009 | $0.034 | $0.133 | Importan mas la calidad, la edicion y la estabilidad |

| GPT Image 1 | Modelo anterior | $0.011 | $0.042 | $0.167 | Solo como referencia legacy |

Mini tiene mucho sentido en tres casos.

Primero, cuando quieres probar si de verdad necesitas el flagship. Si el trabajo es producir concepts, variaciones internas o lotes grandes de borradores, empezar por Mini suele ser lo correcto.

Segundo, cuando trabajas en volume-first workflows. La diferencia entre $0.011 y $0.034 parece pequeña a diez imagenes, pero cambia mucho cuando hablas de miles o decenas de miles.

Tercero, cuando buscas el suelo oficial de precio dentro de OpenAI sin quedarte atrapado en supuestos viejos de GPT Image 1. Esa parte importa porque muchas SERP pages viejas siguen mezclando Mini con referencias legacy.

GPT Image 1.5 gana en otra clase de trabajo. Si tu pipeline depende de output premium, tareas edit-heavy o situaciones donde un retry extra cuesta mas que la diferencia de precio, la decision correcta ya no es “el modelo mas barato por imagen”, sino el modelo mas barato por resultado util.

GPT Image 1 hoy sirve sobre todo para entender por que siguen apareciendo precios y capturas antiguas en la SERP. Si tu comparacion principal sigue siendo Mini contra GPT Image 1 en un despliegue nuevo, probablemente necesitas antes GPT Image 1 vs GPT Image 1.5.

Si tu duda ya se movio a stable model ID contra alias de ChatGPT, el siguiente paso correcto es chatgpt-image-latest vs gpt-image-1.5.

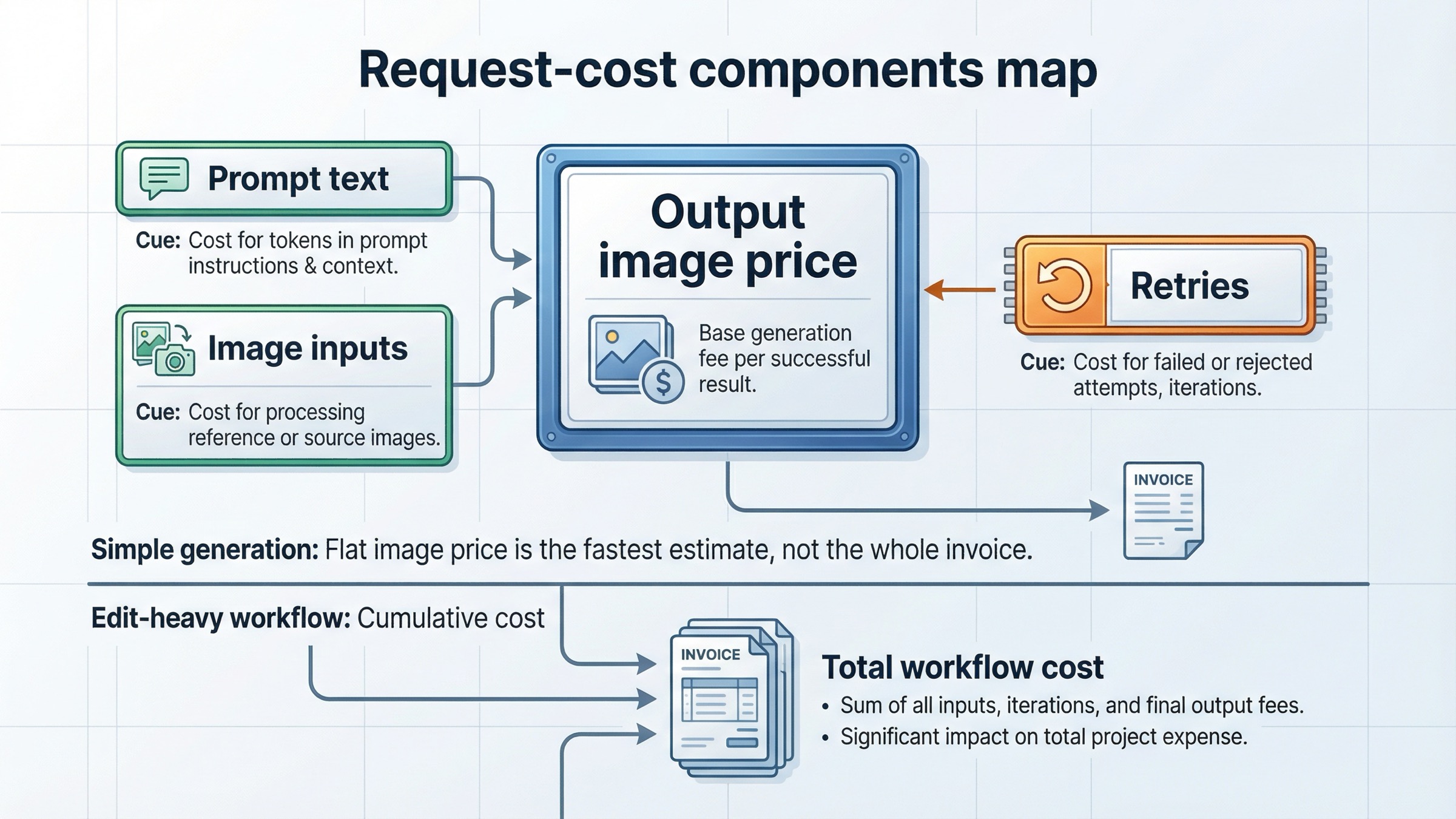

Qué pagas realmente además del “precio por imagen”

Aqui es donde fallan muchas paginas rapidas de pricing.

La ladder de arriba da la headline answer, y para esta keyword hace falta. Pero la model page de Mini tambien publica precios de text input e image input. Eso ya deja una conclusion clara: no todas las facturas de GPT Image se pueden explicar solo con la cifra por output image.

En la practica, el coste de una request depende de:

- prompt text

- image inputs, si editas o usas referencias

- output image

- retries, si la lane barata necesita mas intentos para llegar al resultado util

En generation simple con prompts cortos, el output image suele dominar. Por eso el pensamiento “precio por imagen” sigue funcionando como primer atajo. Pero en cuanto hay edicion, referencias o un coste alto por fallo, la comparacion pura de sticker price se queda corta.

La pregunta correcta pasa a ser: que modelo me da el workflow exitoso mas barato?

Ese es justo el hueco que page one deja abierto. Te ensena $0.011 frente a $0.034, pero no siempre te explica que una lane mas barata puede necesitar mas retries o puede rendir peor justo en el workflow que a ti te importa. La regla mas segura es:

- Usa la tabla por imagen para el primer presupuesto.

- Añade token logic si haces edit o reference-heavy work.

- En produccion, mide tambien retries y coste downstream.

De ahi sale una conclusion mas util para equipos pequenos y medianos. Si tu flujo es corto, con prompts simples y sin demasiada edicion posterior, Mini suele ganar tanto por precio como por claridad operativa. Pero si trabajas con referencias complejas, revisiones frecuentes o imagenes cuyo fallo obliga a repetir aprobaciones internas, el modelo aparentemente barato puede dejar de ser el camino barato en cuanto suben los retries.

Por eso conviene presupuestar en dos capas. Primero, usa la ladder oficial para calcular 1,000 o 10,000 outputs. Despues, añade una capa de realidad de workflow: cuantas repeticiones aceptas, cuanto cuesta la revision humana y que impacto tiene tu tier sobre el throughput. Esa segunda capa es la que normalmente decide si Mini sigue siendo el default correcto o si GPT Image 1.5 merece el sobreprecio.

Si aun estas eligiendo surface y no tienes claro si deberias ir por Images API o Responses API, el siguiente paso practico es OpenAI image API tutorial.

Hay otra capa operativa que muchas comparativas de pricing ignoran: el coste de coordinacion alrededor de un mal resultado. Si una generacion fallida no solo implica relanzar la request, sino volver a pasar por revision de contenido, diseno o aprobacion interna, el run barato deja de ser barato muy deprisa. En esos flujos, Mini puede seguir siendo el mejor default, pero solo si la tasa de reintentos y el tiempo humano no anulan su ventaja inicial.

Rate limits, acceso por tier y descuento Batch

Un precio bajo no garantiza una ruta util. Tier access y throughput pueden cambiar la respuesta tanto como la tabla de precios.

La actual model page de Mini lista:

- Free: no soportado

- Tier 1: 100,000 TPM y 5 IPM

- Tier 2: 250,000 TPM y 20 IPM

- Tier 3: 800,000 TPM y 50 IPM

- Tier 4: 3,000,000 TPM y 150 IPM

- Tier 5: 8,000,000 TPM y 250 IPM

Ademas, la help page de disponibilidad de modelos añade otra pieza clave: GPT-image-1 y GPT-image-1-mini estan disponibles para usuarios API en tiers 1 a 5, con parte del acceso sujeto a organization verification.

La lectura practica es simple: si sigues pensando en Mini como una ruta realmente free, ya estas partiendo de un marco mental incorrecto. Y si tu workload es sensible al throughput, la tabla de IPM puede importar tanto como el precio por imagen.

Batch es el otro caveat que puede cambiar la decision. La pricing page oficial dice hoy que Batch API ahorra 50% en inputs y outputs. Para trabajos offline, eso recorta bastante la diferencia entre Mini y GPT Image 1.5. Si descartabas el flagship solo por la tabla estandar, vale la pena recalcular.

La conclusion correcta no es “Batch vuelve irrelevante a Mini”, sino “cuando el workflow admite asincronia, la forma del trabajo importa mas que el sticker price”. Para user-facing generation inmediata, Batch no sirve. Para trabajos offline o nocturnos, si.

Si tu problema no es el precio sino la activacion del modelo o la verificacion, la lectura correcta es OpenAI image generation API verification.

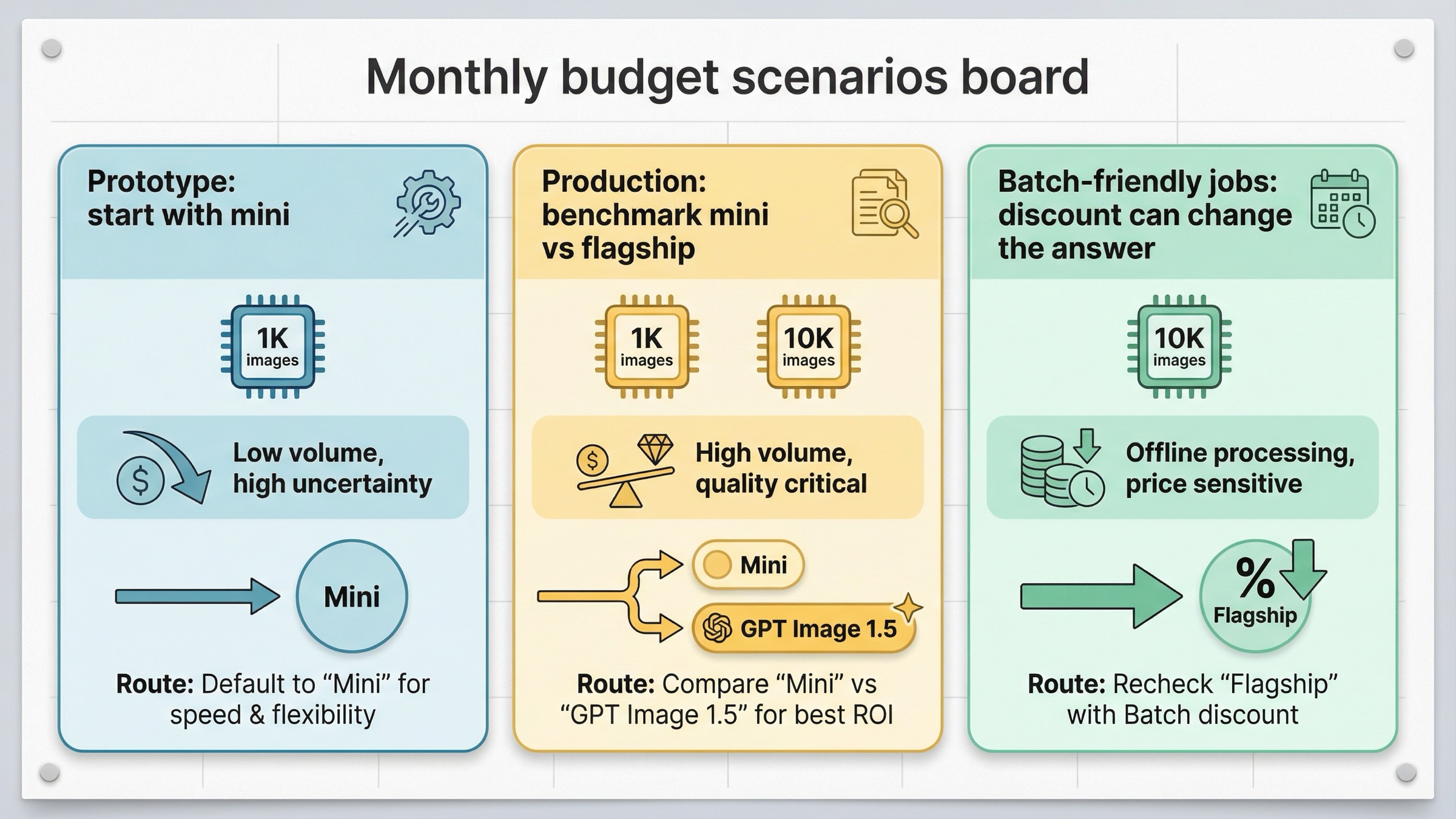

Ejemplos de presupuesto mensual por tipo de workload

Cuando conviertes la tabla en math de workload, la decision se vuelve mucho mas clara.

Para 1,000 square outputs, las cifras oficiales son aproximadamente:

- Mini low: $5

- Mini medium: $11

- Mini high: $36

- GPT Image 1.5 low: $9

- GPT Image 1.5 medium: $34

- GPT Image 1.5 high: $133

Para 10,000 square outputs, simplemente multiplicas por diez:

- Mini low: $50

- Mini medium: $110

- Mini high: $360

- GPT Image 1.5 low: $90

- GPT Image 1.5 medium: $340

- GPT Image 1.5 high: $1,330

De aqui salen tres reglas utiles.

Para prototipos y exploracion interna, Mini suele ser el mejor punto de partida porque la diferencia de precio crece rapido con el volumen y el coste de una salida imperfecta es bajo.

Para produccion estable, la pregunta real pasa a ser cuanto cuesta un fallo. Si un mal resultado implica revision manual, limpieza o una nueva llamada, GPT Image 1.5 puede ser mas barato a nivel de workflow aunque no lo sea a nivel de lista.

Para trabajos offline o batch-friendly, Mini sigue siendo fuerte, pero el descuento Batch obliga a volver a comparar el flagship con honestidad.

Aqui aparece la parte que muchas SERP pages no resuelven bien. La busqueda parece pedir solo una tabla, pero en realidad la decision final suele ser una policy de routing: que modelo usar por defecto en prototipos, cual en produccion y en que punto el descuento Batch hace que el flagship vuelva a entrar en juego. Sin esa capa de decision, el lector sale con numeros pero no con criterio.

Tambien ayuda convertir la tabla en una regla de compra simple: Mini suele ser la capa inicial para generacion masiva y pruebas rapidas, y solo se sube al flagship cuando la mejora de calidad compensa claramente la reduccion de retries o de limpieza manual. Ese enfoque es util para equipos que quieren un default estable sin pagar precio premium en todos los flujos por igual.

Dicho de otra forma, Mini responde bien a la pregunta "como lanzo volumen barato", mientras que GPT Image 1.5 suele responder mejor a "como reduzco coste total cuando cada fallo duele". Esa distincion parece pequena en la tabla, pero cambia mucho la decision cuando el workflow ya tiene revision humana, deadlines o aprobaciones internas.

Y precisamente por eso esta keyword funciona mejor como guia de decision que como simple calculadora.

FAQ

Cual es hoy el precio oficial mas bajo de OpenAI para imagen?

A 27 de marzo de 2026, el suelo oficial mas bajo es gpt-image-1-mini low a $0.005 para 1024x1024.

Mini siempre conviene mas que GPT Image 1.5?

No. Conviene mas por list price, pero no siempre por workflow cost total.

Mini es simplemente una version pequena de GPT Image 1.5?

No. El catalogo actual de OpenAI presenta Mini como cost-efficient version of GPT Image 1, mientras GPT Image 1.5 es el flagship actual.

El precio por imagen equivale a toda la factura?

No siempre. Es un buen first-pass estimate para generation simple, pero se queda corto en edit, references y retries.

Hace falta un tier de pago para usar Mini?

Si. Free no esta soportado y el acceso actual se mueve entre Tier 1 y Tier 5, con parte de la disponibilidad sujeta a verification.

Que pesa mas en el presupuesto real: el precio por imagen o el throughput?

Depende del caso. En uso ocasional suele mandar el precio por imagen. En pipelines grandes o sensibles al tiempo, el tier disponible, los IPM y el coste de repetir generaciones pueden alterar la decision tanto como la tabla base.

Conclusión

gpt-image-1-mini es la respuesta de presupuesto actual, no la respuesta universal. Si tu trabajo es generation-heavy y cost-first, Mini es el punto correcto para empezar. Si tu workflow es premium, edit-heavy o caro de reintentar, GPT Image 1.5 sigue mereciendo una comparacion seria antes de decidir.