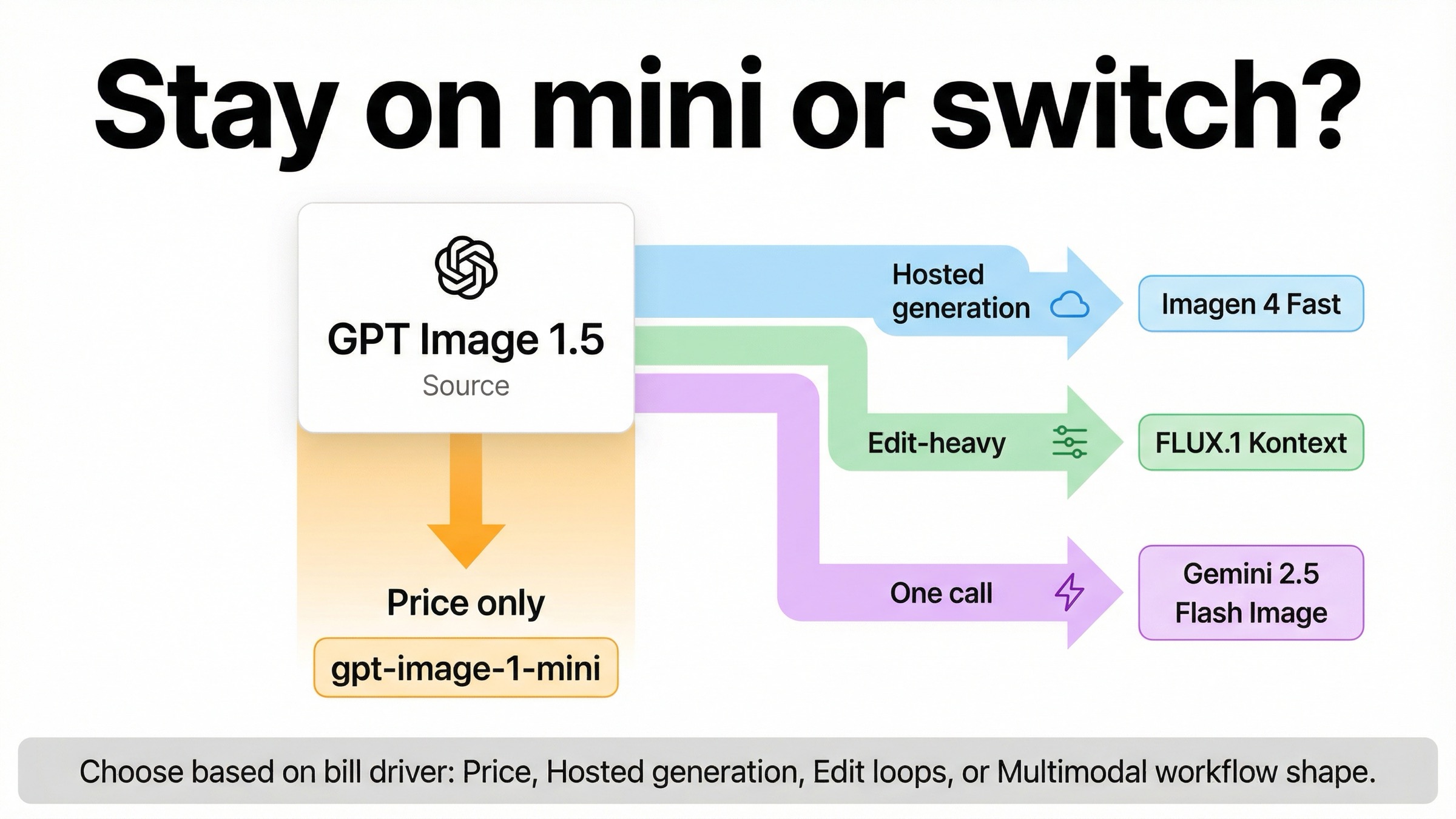

A 29 de marzo de 2026, el error más común en la búsqueda gpt-image-1.5 cheaper alternative es convertir “más barato” en “sal de OpenAI” sin hacer ninguna otra pregunta. Si el problema es solo bajar la factura, el primer movimiento razonable no suele ser otro proveedor, sino gpt-image-1-mini. OpenAI sigue mostrando para 1024x1024 cuadrado precios de low \$0.005, medium \$0.011 y high \$0.036. Las alternativas externas solo pasan a ser la respuesta correcta cuando cambia el driver real del coste: Imagen 4 Fast sirve cuando necesitas un hosted generation lane más barato que GPT Image 1.5 medium o high, FLUX.1 Kontext cuando el dinero se va en ediciones y retries, y Gemini 2.5 Flash Image solo cuando una sola llamada debe entender texto y devolver imagen.

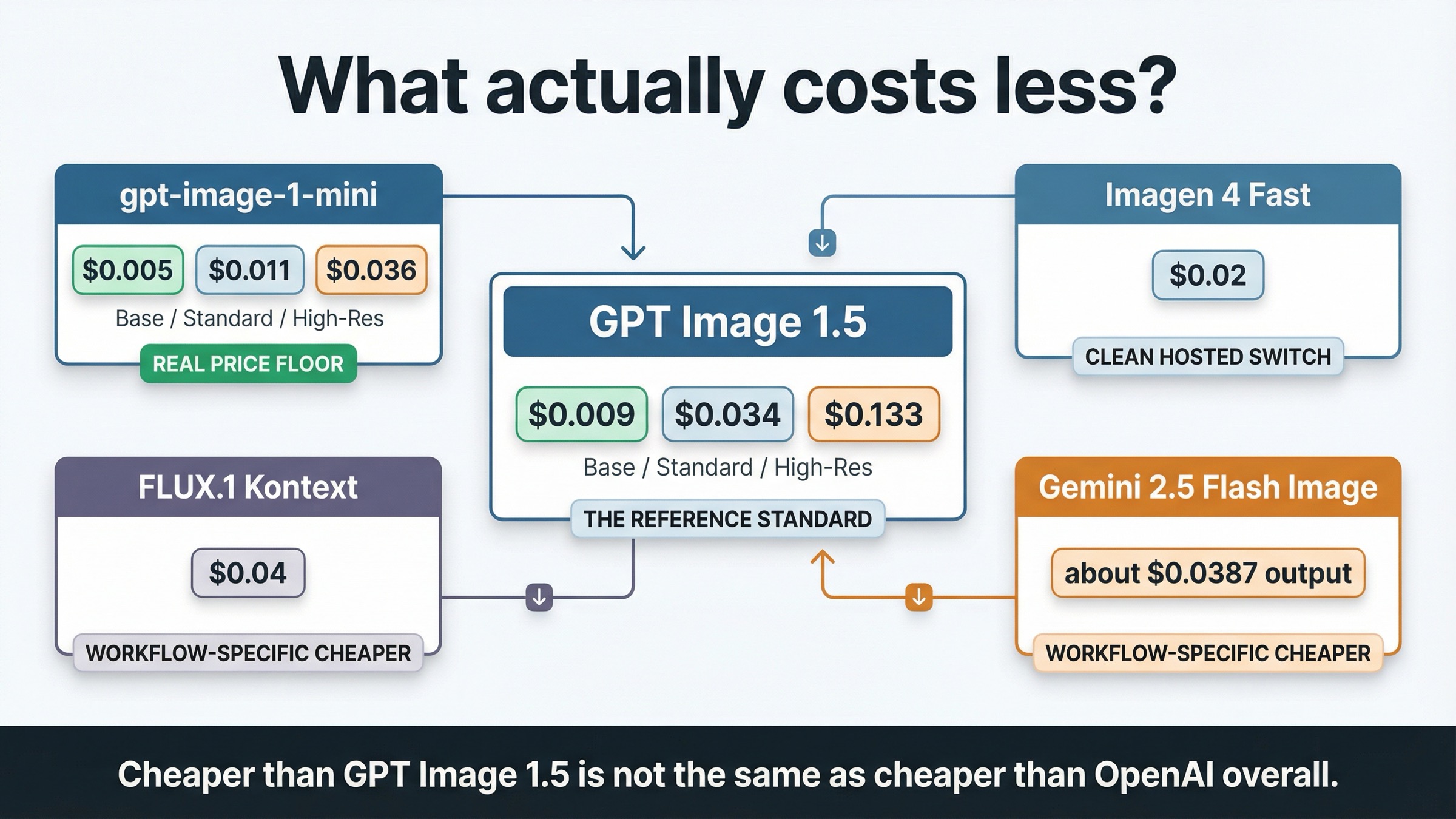

Ese es justo el matiz que muchos resultados del SERP siguen mezclando. Algunas páginas responden “qué es más barato que GPT Image 1.5”, mientras otras responden en realidad “qué es más barato que OpenAI en general”. No es lo mismo, porque OpenAI ya tiene una línea bastante más barata dentro de su propio catálogo y eso cambia la recomendación inicial para muchos equipos.

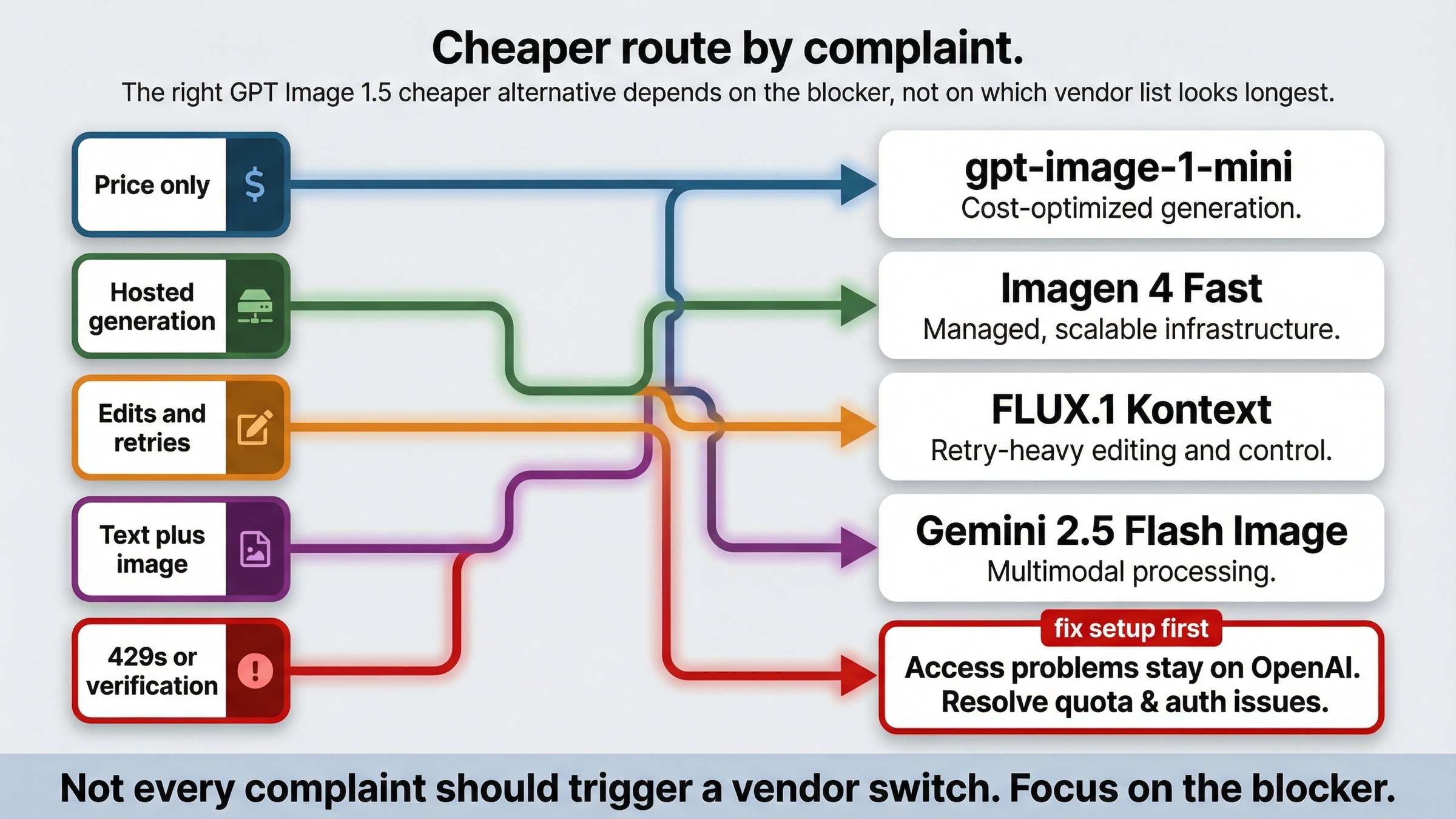

También conviene separar otro caso desde el principio: a veces el problema no es precio, sino fricción de acceso. Un 429, una verificación pendiente, un tier que no quedó claro o una ruta API mal planteada hacen que todo parezca caro antes de tener un benchmark limpio. En ese escenario, cambiar de proveedor no optimiza el coste; solo cambia el tipo de problema que estás depurando.

Resumen rápido

Si solo necesitas la respuesta operativa, empieza aquí.

| Si tu problema real es... | La opción más barata o más adecuada | Por qué este es el movimiento más sólido ahora | Coste o tradeoff principal |

|---|---|---|---|

| solo quieres bajar el precio oficial | gpt-image-1-mini | OpenAI sigue colocándolo por debajo de GPT Image 1.5 en todos los square tiers | Renuncias al techo del flagship |

| quieres un hosted generation lane más barato que GPT Image 1.5 medium / high | Imagen 4 Fast | Google publica hoy \$0.02 por imagen | Ya es otra provider stack |

| lo caro son las revisiones, el texto y los retries | FLUX.1 Kontext | Puede bajar el effective cost al reducir reinicios | Su headline price no es el más bajo |

| una sola llamada debe pensar y generar | Gemini 2.5 Flash Image | Un surface multimodal puede sustituir varios pasos separados | El coste por imagen no es el más simple de comparar |

| te atasca el tier, la verificación o el acceso | Quédate en OpenAI y arregla el setup | Un vendor switch no corrige problemas de account state | Antes hay que estabilizar la ruta |

La regla corta es clara: si el problema es solo precio, empieza por Mini. Las alternativas externas empiezan a ganar cuando lo caro ya no es el row por imagen, sino el hosted lane, el loop de edición o la orquestación multimodal.

¿Qué cuesta hoy menos que GPT Image 1.5?

Para responder bien a este keyword hay que separar primero las superficies de precio. La página actual del modelo GPT Image 1.5 muestra para 1024x1024 cuadrado \$0.009, \$0.034 y \$0.133 en low, medium y high. La página actual de gpt-image-1-mini muestra \$0.005, \$0.011 y \$0.036. Solo con esas dos líneas ya aparece un hecho que muchas páginas de alternativas esconden: si lo que buscas es una ruta más barata sin salir de OpenAI, la primera respuesta sigue estando dentro de OpenAI.

Las alternativas externas importan, pero responden a preguntas más estrechas. La Vertex AI pricing page de Google publica Imagen 4 Fast a \$0.02 por imagen, así que sí es una respuesta real de “más barato que GPT Image 1.5 medium y high”. La pricing page de Black Forest Labs publica FLUX.1 Kontext [pro] a \$0.04 por imagen; eso no mejora el \$0.034 de GPT Image 1.5 medium, pero en un workflow con muchas revisiones puede terminar siendo más barato. Y la documentación actual de Gemini 2.5 Flash Image explica que una imagen generada consume 1290 image output tokens. Combinado con el precio actual de Vertex de \$30 / 1M image output tokens, eso da aproximadamente \$0.0387 solo en output image cost. Es una inferencia a partir de datos oficiales, no una tarjeta plana “por imagen”.

Por eso este tema necesita una tabla de decisión, no una lista de marcas.

| Opción | Superficie de precio actual | Qué abarata | Dónde encaja mejor | Por qué no es la respuesta universal |

|---|---|---|---|---|

| GPT Image 1.5 | \$0.009 / \$0.034 / \$0.133 | solo sirve como baseline | trabajo de imagen flagship | Ya estás pagando la lane premium |

gpt-image-1-mini | \$0.005 / \$0.011 / \$0.036 | gana a GPT Image 1.5 en todos los square tiers | drafts, prototipos y visuales de bajo riesgo | No cubre todas las exigencias de calidad o edición |

| Imagen 4 Fast | \$0.02 por imagen | es más barato que GPT Image 1.5 medium y high | hosted generation fuera de OpenAI | No es más barato que Mini |

| FLUX.1 Kontext [pro] | \$0.04 por imagen | puede ganar por effective cost, no por titular | edits, cambios de texto, consistency workflows | No ofrece el row más barato |

| Gemini 2.5 Flash Image | alrededor de \$0.0387 solo en output image cost | gana solo si la compresión del workflow ahorra más | text+image reasoning y rendering en una sola llamada | Se compara mal como simple image generator |

Si quieres profundizar en el coste puro dentro de OpenAI, la continuación natural es GPT Image 1.5 API pricing y GPT Image 1.5 cost per image. Este artículo responde otra cosa: cuándo conviene cambiar de route.

Quédate en gpt-image-1-mini si el problema es solo el precio

Este es el apartado más importante del artículo, porque ahí se ve si la página quiere ayudar de verdad o solo vender un cambio de proveedor. En la image generation guide actual, OpenAI dice de forma explícita que gpt-image-1-mini es la opción más rentable cuando la calidad de imagen no es la prioridad principal. Para muchísimos equipos, esa frase ya resuelve la primera decisión.

Si tu carga real es de borradores, mockups internos, variantes rápidas, experimentación barata o generación de volumen con poco riesgo, mini debería ser el primer benchmark. Te permite seguir dentro de la misma API family, no tocar la relación de billing y bajar de forma visible el price floor. En 1024x1024 cuadrado, mini está en \$0.005, \$0.011 y \$0.036; GPT Image 1.5 está en \$0.009, \$0.034 y \$0.133. Eso no es un pequeño descuento; es otro carril de precio.

Aquí es donde el SERP actual más confunde. Muchas páginas toman “OpenAI me sale caro” y lo traducen directamente a “sal de OpenAI”. Pero un budget problem no siempre es un provider problem. A menudo es un lane-selection problem: el equipo empezó por el flagship cuando aún no había demostrado que su trabajo necesitaba esa lane.

Eso no convierte a mini en la solución para todo. Si la necesidad real es más fidelity, mejor text rendering, menos riesgo en outputs de cliente o más confianza en ediciones de alto valor, el premium de GPT Image 1.5 puede seguir siendo racional. Precisamente por eso una página fiable tiene que explicar cuándo no conviene salir.

Para ver la comparación más amplia dentro de la misma familia, puedes seguir con OpenAI image generation API cheaper alternative y gpt-image-1-mini pricing.

Usa Imagen 4 Fast si buscas un hosted generation lane más barato

Si ya sabes que el problema es GPT Image 1.5 en sí, y no OpenAI mini, entonces Imagen 4 Fast es la alternativa externa más limpia.

La Vertex AI pricing page actual de Google muestra Imagen 4 Fast a \$0.02 por imagen. Además, la documentación de Imagen 4 lo sitúa como una ruta claramente orientada a image generation. Eso importa porque aquí comparas generation-first product contra generation-first product, no un chat multimodal contra un endpoint puro de imágenes.

Esta ruta encaja cuando la decisión real suena así: “Quiero seguir con generación alojada, pero GPT Image 1.5 medium o high ya no cierran para mi volumen”. En ese marco, Imagen 4 Fast es fácil de explicar y fácil de presupuestar. No necesita justificar su valor por workflow compression ni por effective cost. Gana como hosted generation lane más barato que GPT Image 1.5.

Lo que no conviene es venderlo como la respuesta más barata de todo el árbol. No es más barato que mini y no es el mejor camino para workflows edit-heavy o multimodales. Su fuerza es mucho más concreta: un hosted generation lane mainstream con un precio visible que mejora a GPT Image 1.5 medium y high.

Usa FLUX.1 Kontext cuando lo caro son las revisiones

A veces el equipo no paga demasiado por la primera imagen. Paga demasiado por la segunda, la tercera y la cuarta corrección. En ese punto el coste deja de vivir en el per-image row y pasa a vivir en el número de intentos necesarios para obtener una imagen que realmente se pueda conservar.

Ese es el mejor argumento a favor de FLUX.1 Kontext. En el Kontext overview actual, Black Forest Labs se centra en image editing, character consistency, text editing y style transformation. Es decir, el producto no se vende como el generador más barato, sino como una forma de conservar lo que ya funciona mientras corriges el resto.

La tarjeta de precio es engañosa si la lees sola. La pricing page actual muestra FLUX.1 Kontext [pro] a \$0.04 por imagen. Esa cifra no parece un “cheap win” frente a GPT Image 1.5 medium y, desde luego, no compite con mini. Si miras solo el headline price, Kontext parece un mal candidato para este keyword.

Pero no es la pregunta correcta. La pregunta útil es: ¿cuánto me cuesta una usable image, no cuánto me cuesta el primer intento? Si tu trabajo consiste una y otra vez en mantener el personaje, retocar texto, conservar composición, cambiar un solo elemento o producir variantes sin reiniciar de cero, el effective cost depende mucho más de los retries que del primer row del pricing page.

Por eso Kontext no hay que leerlo como “la opción universal más barata”, sino como la opción que puede bajar el effective cost cuando el flujo se rompe en las revisiones. Solo en ese escenario se convierte de verdad en una alternativa más barata.

Usa Gemini 2.5 Flash Image solo si una llamada debe pensar y dibujar

Google aparece dos veces en este artículo porque vende dos respuestas distintas. Imagen 4 Fast es una lane de generación alojada. Gemini 2.5 Flash Image es una alternativa de workflow para casos en los que una sola llamada debe aceptar texto, usar imágenes como contexto, seguir la conversación y devolver imagen. Meter ambos productos en la misma historia de precio simplifica demasiado y lleva a malas decisiones.

La documentación actual de Gemini 2.5 Flash Image dice que el modelo acepta text y image inputs, devuelve text e image outputs y soporta multi-turn image editing. Eso significa que se compra no porque tenga la cifra más baja por imagen, sino porque puede reemplazar varios pasos separados de reasoning, rendering y glue code.

Por esa razón Gemini rara vez es la mejor respuesta cuando la pregunta es “qué image generator es más barato”. Viendo solo el coste de output image no gana a mini ni ofrece una victoria clara contra GPT Image 1.5 medium. Su sentido aparece cuando el propio workflow es caro. Si antes necesitabas un text model para entender la instrucción, otro model para generar la imagen y una capa extra para mantener el contexto, Gemini puede abaratar el total al comprimir la cadena.

Las páginas de roundup más flojas suelen fallar justo aquí. Ven un producto de imagen de Google y lo colocan al lado de otros generators como si todo fuera la misma compra. Gemini 2.5 Flash Image solo es una cheap alternative real cuando una llamada debe think and render al mismo tiempo.

Cuando el problema es setup y no precio

En esta familia de búsquedas hay muchas consultas que parecen de precio, pero en realidad son de acceso. El artículo actual de OpenAI sobre API model availability by usage tier and verification status deja claro que gpt-image-1 y gpt-image-1-mini pueden depender del usage tier y, en algunos casos, de la verificación de la organización. Eso significa que una mala primera experiencia no prueba por sí sola que GPT Image 1.5 sea demasiado caro o que otro proveedor vaya a ser mejor.

La fricción de setup distorsiona la percepción de coste. Un 429, una verificación incompleta o una route choice equivocada hacen que cada intento parezca caro incluso antes de tener un benchmark útil. En ese punto, moverse de proveedor puede convertirse en cambiar de dolor, no en ahorrar.

Por eso la regla aquí también debería ser simple. Si el bloqueo está en tier, verification, route o account state, arréglalo primero. Solo si el flujo ya corre limpio y aun así los economics no cierran, tiene sentido volver a plantear la migración.

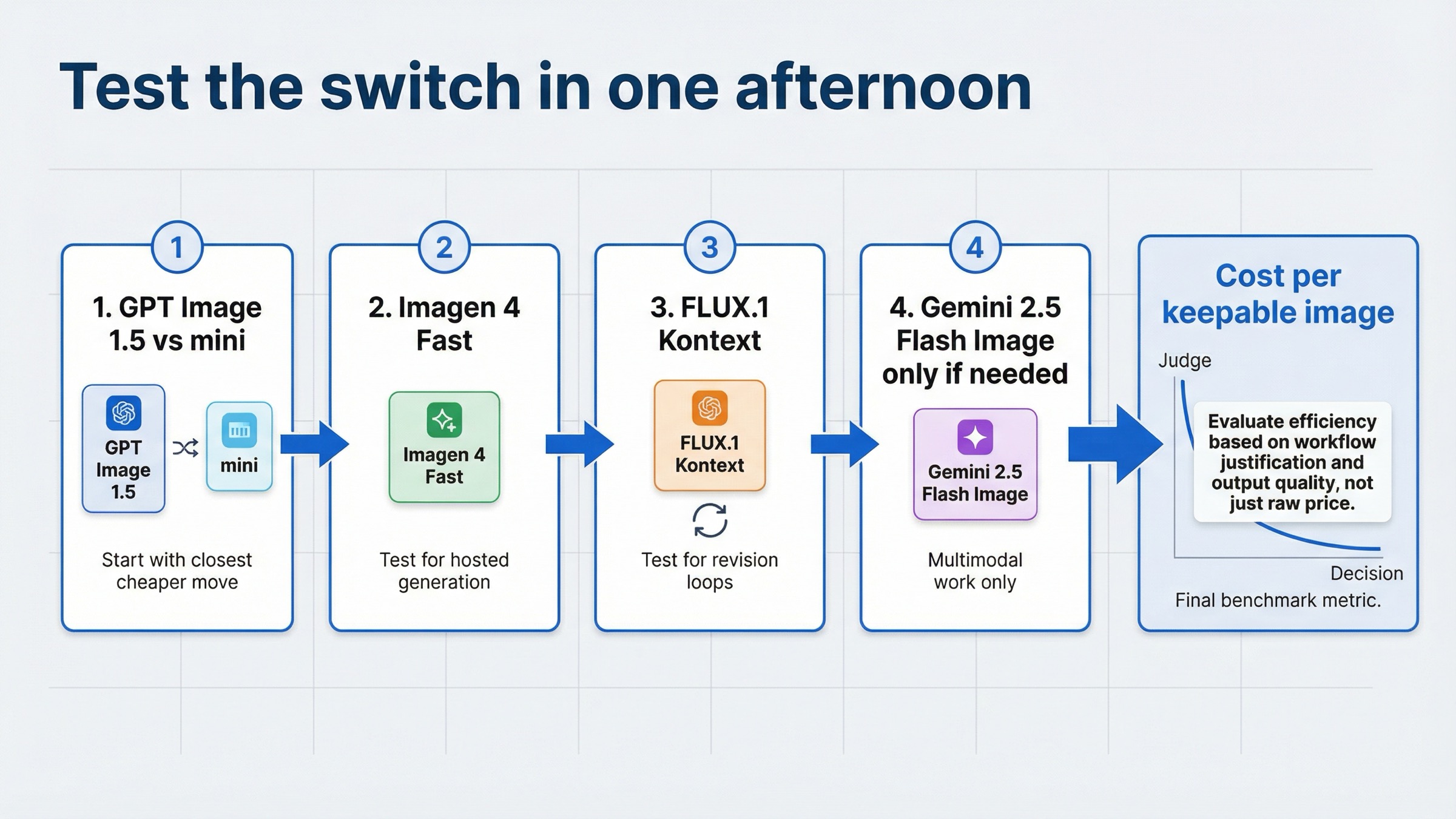

Cómo probaría el cambio en un día

La mejor forma de evitar una mala decisión de cambio no es mirar más marcas, sino probar de forma estrecha el failure mode real.

- Empieza ejecutando el mismo set de prompts en GPT Image 1.5 y

gpt-image-1-mini. Si mini ya es suficiente, párate ahí. - Después mete Imagen 4 Fast en un benchmark generation-first y comprueba si realmente baja los economics frente a GPT Image 1.5 medium o high.

- Luego mide FLUX.1 Kontext con tareas de edición parcial, cambio de texto y preservation loops.

- Añade Gemini 2.5 Flash Image solo si el producto necesita de verdad un workflow multimodal unificado.

- Al final compara no la primera línea del pricing, sino el coste total y el operator effort para llegar a una keepable image.

Este orden es deliberadamente estrecho. Las páginas débiles empiezan con un tour amplio del mercado. Un benchmark útil casi siempre empieza por la opción más cercana, más barata y con menos fricción de cambio.

Conclusión

La alternativa más barata a GPT Image 1.5 no es un ganador universal. Es el movimiento más barato que ataca la razón concreta por la que GPT Image 1.5 te sale caro.

Si el problema es solo precio, empieza por gpt-image-1-mini. Si necesitas un hosted generation lane más barato que GPT Image 1.5 medium o high, mira Imagen 4 Fast. Si el coste se dispara en edits y retries, mira FLUX.1 Kontext. Si una sola llamada debe pensar y generar, mira Gemini 2.5 Flash Image. Y si el dolor real está en el acceso, la verificación o la route choice, arregla primero el setup de OpenAI antes de decidir un vendor switch.