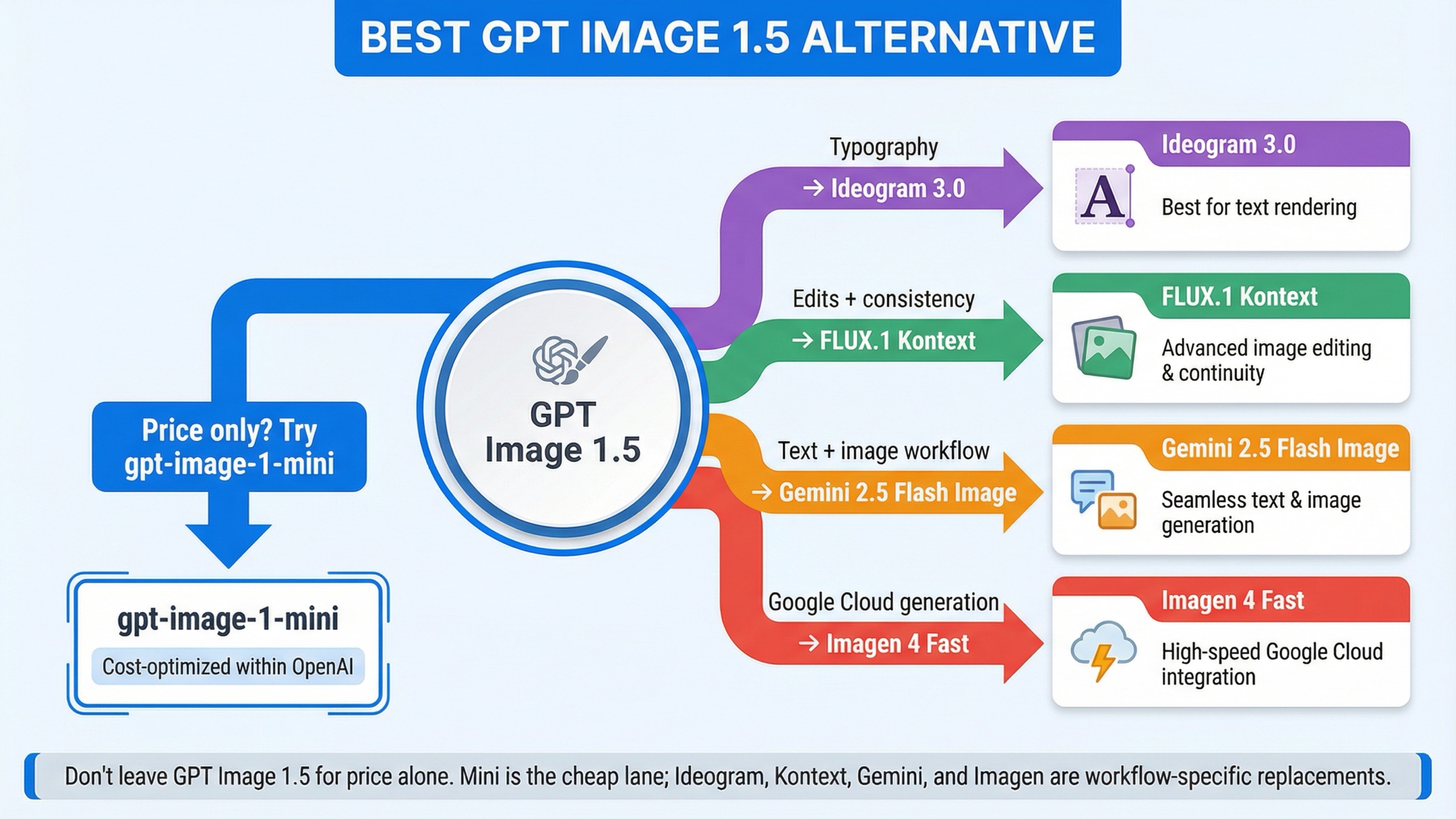

A 26 de marzo de 2026, la mejor alternativa a GPT Image 1.5 depende de qué está fallando de verdad. Si tu único problema es el precio, todavía no deberías cambiar de proveedor. Dentro de OpenAI ya existe gpt-image-1-mini, y para muchos equipos esa sola bajada de lane resuelve la presión de coste sin reabrir toda la decisión de vendor. Solo conviene salir fuera cuando cambia la forma del workflow: Ideogram 3.0 para diseño con mucho texto, FLUX.1 Kontext para revisiones iterativas y consistency, Gemini 2.5 Flash Image para una interacción que razona y devuelve imagen, e Imagen 4 Fast para un stack de generación alojado en Google Cloud.

Ese resumen importa porque el SERP actual sigue respondiendo a otra pregunta. Hay demasiadas broad alternatives pages, marketplaces y listados de modelos. Nombran herramientas, pero no aclaran si de verdad te conviene dejar GPT Image 1.5, bajar a mini dentro de OpenAI o elegir una ruta pensada para otro job.

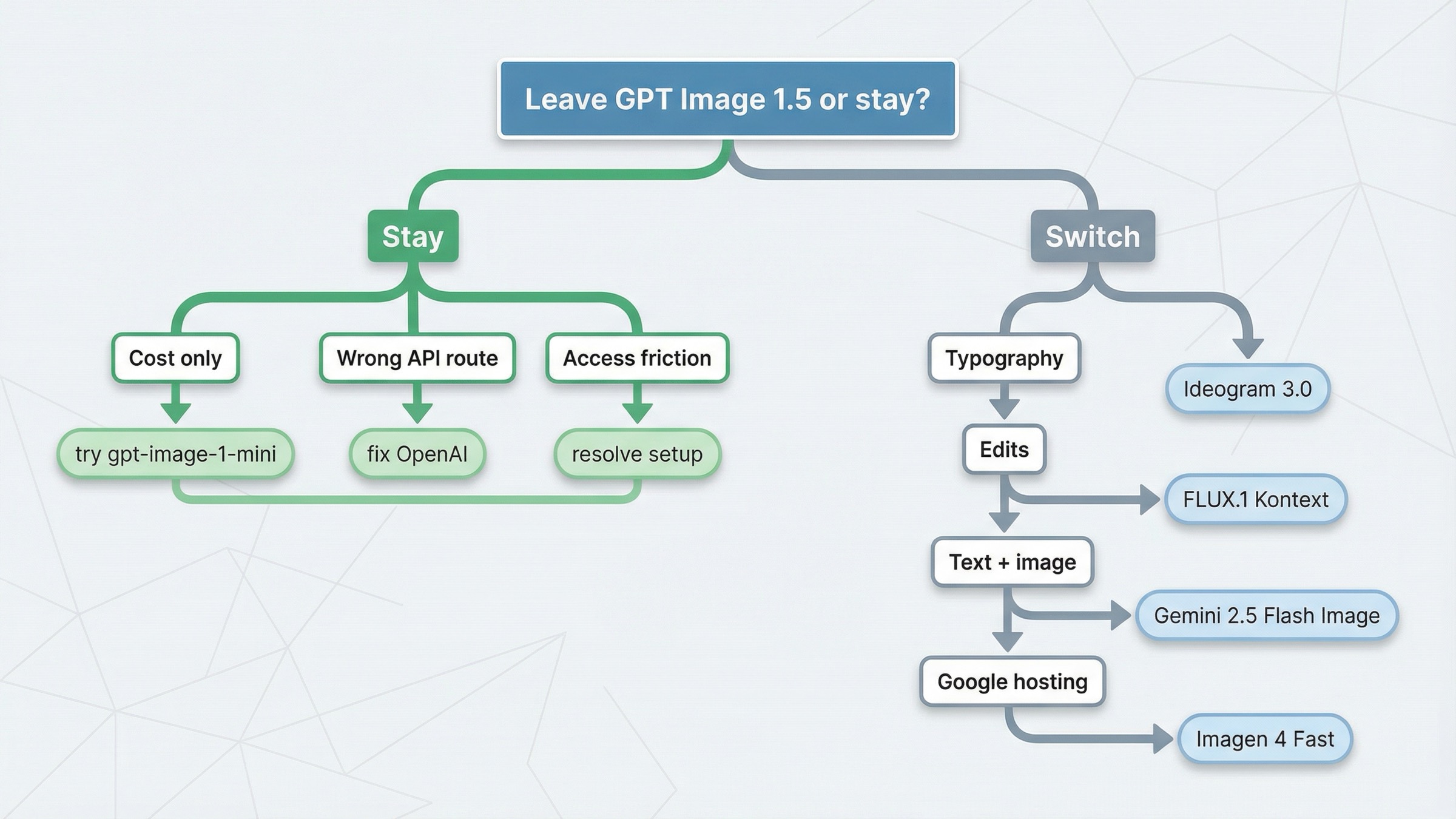

También hay un caveat que conviene dejar claro desde el principio. No toda búsqueda de GPT Image 1.5 alternative es un problema de alternativas. La guía actual de image generation de OpenAI sigue separando la generación/edición directa de imágenes y los workflows conversacionales editables. A veces el problema no es el techo del modelo, sino la superficie equivocada, la verificación o la fricción de cuenta.

Resumen rápido

Si solo quieres la regla de routing, empieza aquí.

| Si GPT Image 1.5 deja de encajar porque... | Mira esta opción | Por qué encaja mejor | Tradeoff principal |

|---|---|---|---|

| solo necesitas bajar el coste | gpt-image-1-mini | es la prueba más rápida para reducir coste sin salir de OpenAI | sigues dentro del mismo vendor |

| te importan sobre todo typography, posters y diseño con texto | Ideogram 3.0 | está más orientado a texto visible y design output | no es la respuesta a cualquier workflow multimodal |

| tu equipo corrige la misma imagen una y otra vez | FLUX.1 Kontext | destaca más en edits, consistency y cambios locales | no es una ruta hosted barata |

| tu app necesita text e image output en una misma interacción | Gemini 2.5 Flash Image | une text/image input y text/image output en un solo route | el pricing por tokens es menos intuitivo |

| quieres un lane de generación alojado en Google Cloud | Imagen 4 Fast | encaja como generation line dedicada dentro de Vertex AI | si necesitas multimodalidad, el problema es otro |

| en realidad tu problema es setup o API surface | Quédate con GPT Image 1.5 | puede bastar con corregir la cuenta o la ruta | mantienes la lógica de precio y verificación de OpenAI |

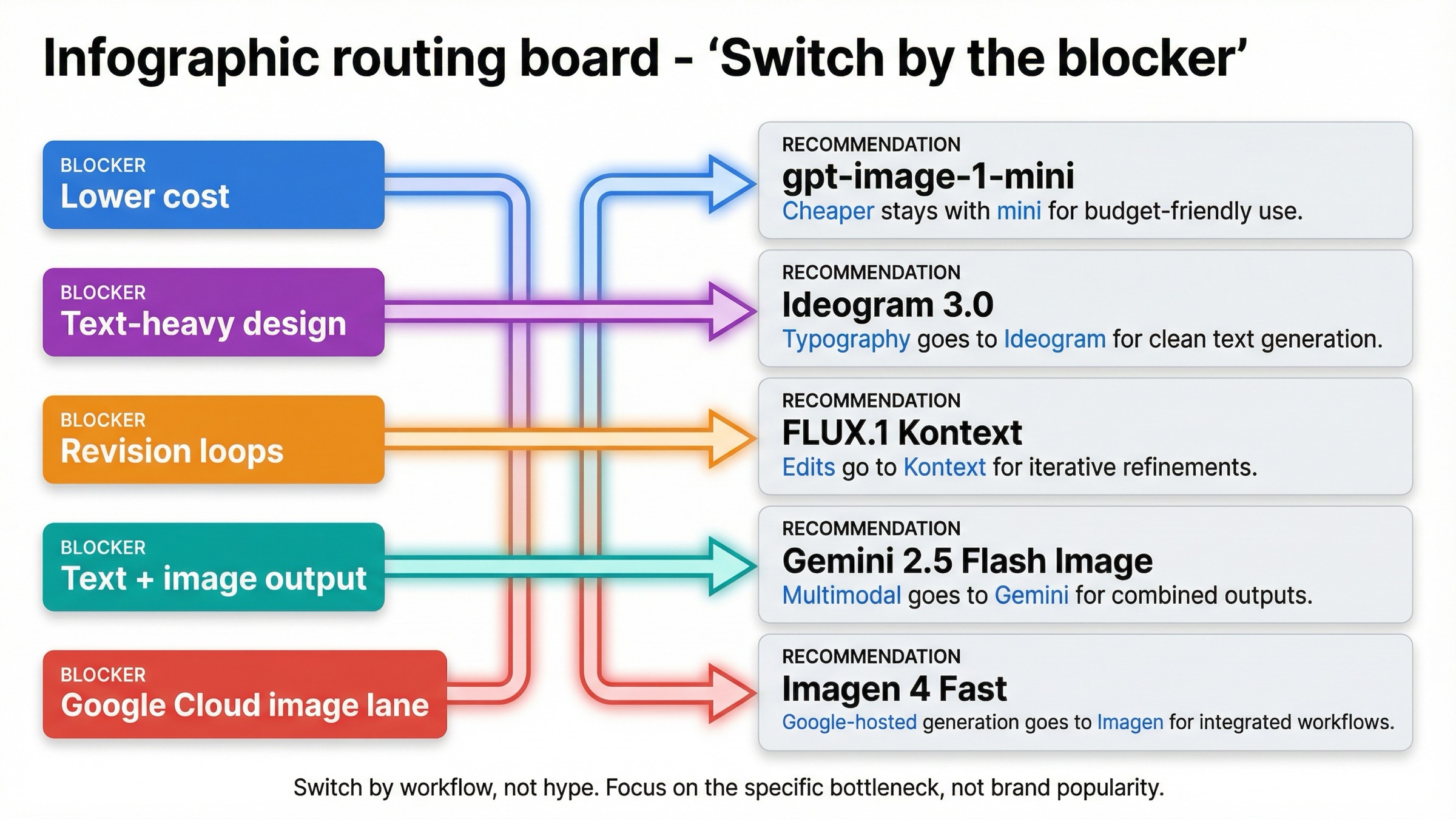

La ventaja de esta tabla no es cuántos modelos hay, sino que cada fila responde a un blocker distinto. Justo eso es lo que las páginas que rankean ahora tienden a aplastar en un único “best image models”.

Cuándo conviene probar gpt-image-1-mini antes de salir de OpenAI

Si la queja principal es el coste, la primera comparación honesta debería ser mini, no otro proveedor.

El motivo es simple. Muchas exact-match listicles actúan como si GPT Image 1.5 fuera el único lane vigente dentro de OpenAI. Ya no es así. El models directory sigue mostrando gpt-image-1-mini como una versión más cost-efficient de GPT Image 1, y la propia pricing page mantiene clara la separación entre flagship lane y cheaper lane.

El error práctico es muy común: el equipo ve la factura de medium o high, concluye que OpenAI “sale caro” y salta a buscar una alternativa externa. Pero si el workload es ideación de alto volumen, mockups, variaciones internas o prototipos baratos, la pregunta correcta no es “qué modelo externo es más barato”, sino “¿hacía falta usar GPT Image 1.5 para este trabajo?”.

Probar mini primero también ahorra fricción operativa. Auth, familia de endpoints, billing surface y observabilidad cambian muy poco. Eso convierte el experimento en una bajada de coste y no en un proyecto de migración.

Aquí es donde muchas páginas sobre alternativas pierden credibilidad. Asumen que todo lector quiere dejar OpenAI. Una guía útil no puede dar eso por hecho. Algunos lectores deben salir. Otros solo necesitan cambiar al lane más barato del mismo vendor.

Si después de este punto tu pregunta ya es pura cost math, el siguiente paso correcto es precio de GPT Image 1.5 API.

Ideogram 3.0 es la mejor alternativa para diseño con mucho texto

GPT Image 1.5 es fuerte en text rendering para ser un modelo de imagen generalista. Aun así, eso no lo convierte en la mejor opción por defecto cuando el deliverable es diseño con texto visible.

Ahí es donde Ideogram 3.0 merece ser la primera prueba externa.

La clave no es que Ideogram sea mejor en todo. La clave es su positioning: text-heavy graphics, posters, ads, thumbnails y composiciones más ligadas al diseño. Eso cambia por completo la comparación.

En trabajo real, la pregunta no debería ser “qué modelo hace la primera imagen más bonita”, sino “qué modelo obliga a menos cleanup manual en typography, spacing, layout y legibilidad”. Si tu equipo genera event cards, anuncios, imágenes de ecommerce, portadas o materiales de marketing con copy visible, esa diferencia pesa mucho.

Más que un límite absoluto de GPT Image 1.5, esto refleja una diferencia de job. Un modelo puede ser bueno para scene generation y aun así no ser la opción más económica para design assets cargados de texto.

Por eso la recomendación debe mantenerse estrecha. Ideogram 3.0 encaja cuando typography y layout son el trabajo. No conviene venderlo como la respuesta por defecto para edits, orchestration multimodal o generación genérica.

FLUX.1 Kontext encaja mejor en edición iterativa y consistencia

Muchos equipos no se cansan de GPT Image 1.5 porque la primera imagen salga mal. Se cansan porque la segunda, tercera y cuarta revisión se vuelven caras, inestables o lentas.

En ese punto, FLUX.1 Kontext se vuelve más interesante de lo que suelen admitir los roundups.

Black Forest Labs no presenta Kontext como otro simple generator, sino como un route centrado en image editing, character consistency, text editing y style transformation. Esa diferencia importa. Cuando el workflow dice “deja casi todo igual, pero cambia justo esto”, gana menos el modelo con la imagen inicial más vistosa y más el que resiste mejor la presión de revisión.

Por eso Kontext se parece menos a “otro mejor generator” y más a una herramienta de change management para imágenes. Si el equipo mantiene personaje, composición o branding mientras ajusta textos, props, fondo o pequeños detalles, edit reliability pesa más que un beauty score en la primera tirada.

Aquí también sirve la señal de la comunidad. Parte de la conversación sobre GPT Image 1.5 reconoce mejor prompt adherence y resultados más limpios, pero sigue señalando drift entre iteraciones. Eso no demuestra que GPT Image 1.5 sea flojo en general. Explica por qué las búsquedas de alternativas no desaparecen.

El tradeoff es evidente. En la BFL pricing, Kontext no aparece como una ruta hosted barata. Pero si tu coste real viene del cleanup interminable después de cada revisión, el número más bajo por imagen deja de ser la métrica principal.

Para profundizar en FLUX, aquí todavía hace falta un fallback explícito en inglés: FLUX.1 API guide.

Cómo separar Gemini 2.5 Flash Image de Imagen 4 Fast

Las dos rutas fuertes de Google importan por motivos distintos.

Elige Gemini 2.5 Flash Image cuando tu producto necesite comportamiento de texto e imagen en la misma interacción. Elige Imagen 4 Fast cuando lo que quieras sea un lane de generación alojado en Google Cloud con economics per-image fáciles de entender.

La diferencia no es menor.

La documentación actual de Gemini 2.5 Flash Image habla de text and image inputs y text and image outputs. Además indica que una imagen generada consume 1290 tokens. Eso no solo habla de pricing; habla del tipo de producto. Gemini no es únicamente un generador, sino una pieza de workflow multimodal.

Por eso encaja mejor cuando GPT Image 1.5 se siente demasiado aislado del resto de la interacción. Si tu app necesita entender la petición, responder en texto, refinar la intención y producir una imagen dentro del mismo flow, probar Gemini suele ser más natural que forzar una API de imagen dedicada.

Imagen 4 Fast resuelve otro job. La Vertex AI pricing page lo lista en $0.02 por imagen, y la documentación de Imagen 4 lo presenta como una generation line dedicada con hasta 4 imágenes por prompt. Es una respuesta más limpia al requisito “quiero generar imágenes dentro de Google Cloud”.

La separación real queda así:

- Gemini 2.5 Flash Image para workflows multimodales text-plus-image

- Imagen 4 Fast para generación alojada dentro de Google Cloud

Si después de elegir route quieres afinar el presupuesto de Google, lo siguiente es Gemini image generation API pricing.

Cuándo GPT Image 1.5 sigue siendo la opción correcta

Una página fiable sobre alternativas tiene que decir con claridad cuándo no conviene cambiar.

GPT Image 1.5 sigue siendo una buena opción por defecto cuando:

- necesitas generación y edición generalistas fuertes dentro del stack actual de OpenAI

- valoras prompt adherence y text rendering, pero no lo suficiente como para irte a una ruta typography-first

- tu workflow todavía no es tan revision-heavy como para justificar Kontext

- tu producto no necesita text-plus-image output en una sola llamada

- el problema real está en setup, verification o API surface choice

Ese último punto importa más de lo que suelen admitir los roundups. El artículo actual de OpenAI sobre model availability by usage tier and verification status sigue explicando la disponibilidad de gpt-image-1 y gpt-image-1-mini según tiers y verificación. Es decir, parte de la frustración que empuja a buscar alternativas puede ser account state y no una debilidad real del modelo.

Hay otra razón adicional para quedarse. Si la feature ya funciona y la única queja es el coste, mini sigue siendo el downgrade controlado más limpio. Salir de OpenAI tiene más sentido cuando lo que se rompió es la forma del workflow, no solo la factura del flagship.

Si eso se parece a tu caso, el siguiente paso lógico no es otro vendor list, sino el tutorial de OpenAI Image API.

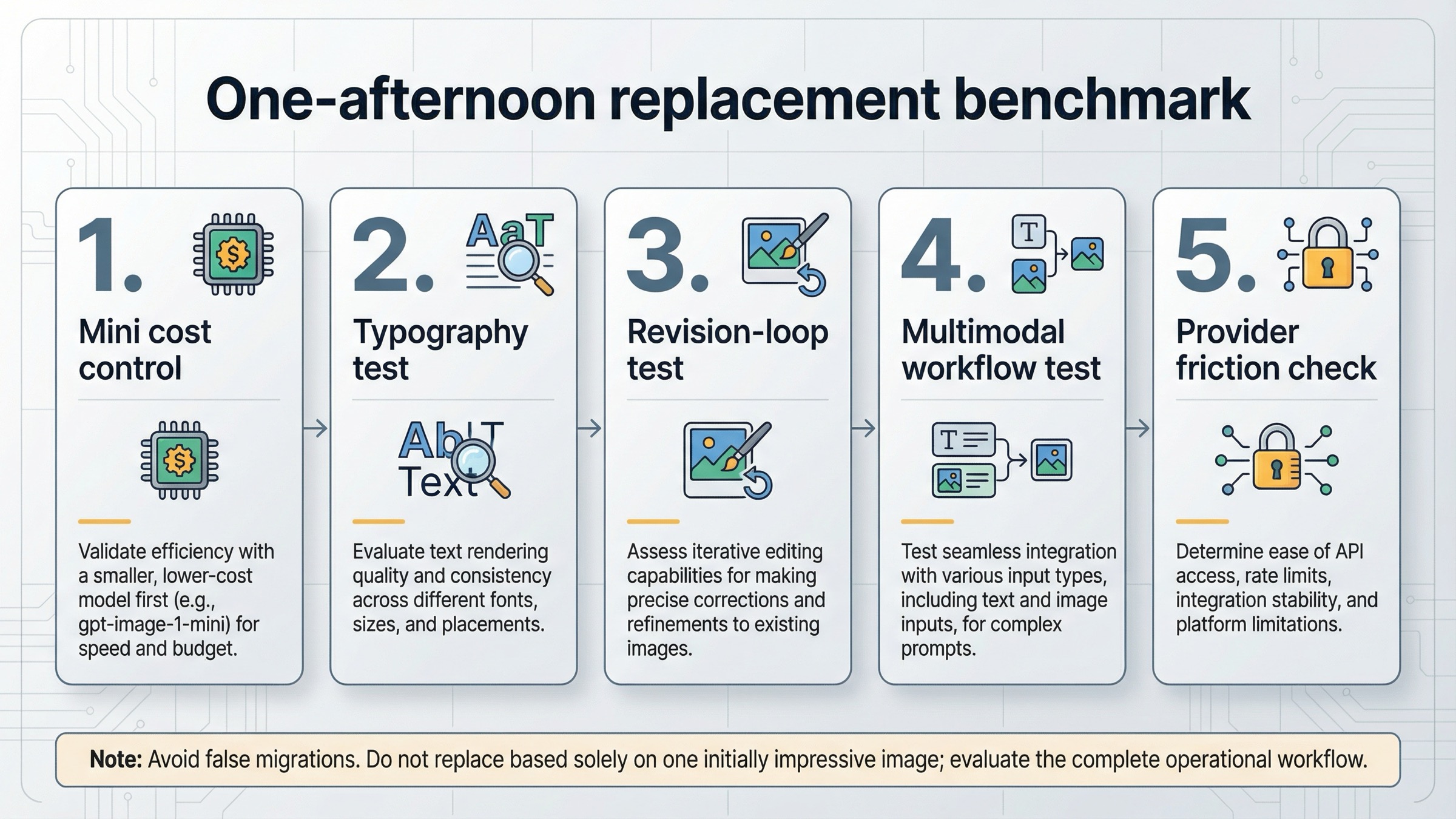

Cómo probar el reemplazo en una tarde

Si tu equipo va en serio con reemplazar GPT Image 1.5, no empieces con un concurso de belleza. Empieza con un benchmark corto que reproduzca el blocker real.

1. Corre primero el control más barato y honesto.

Si la queja es el coste, compara gpt-image-1-mini con tus prompts actuales antes de tocar otro proveedor.

2. Haz una prueba específica de typography.

Si el problema es el texto, pasa el mismo prompt de póster, anuncio o miniatura por GPT Image 1.5 e Ideogram 3.0. Mira cuánta corrección manual hace falta después.

3. Haz una prueba de revision loop.

Si el problema es la edición, no puntúes la primera imagen. Toma una sola imagen y aplícale tres change requests; luego compara GPT Image 1.5 y FLUX.1 Kontext en drift, preservación y esfuerzo operativo.

4. Haz una prueba de workflow multimodal.

Si tu app necesita texto e imagen juntos, compara tu flow actual de OpenAI con una interacción de Gemini 2.5 Flash Image que razone y renderice en el mismo turno.

5. Revisa la fricción del proveedor antes del veredicto final.

Rate limits, organization verification y disponibilidad regional pueden cambiar la respuesta práctica incluso si la comparación rápida de outputs parecía favorable.

Ese orden importa porque evita una migración falsa. Muchos equipos creen que están comparando modelos cuando en realidad están comparando trabajos distintos.

Qué elegiría en cinco situaciones reales

Si tuviera que decidir hoy, usaría estas reglas.

1. Solo quiero bajar el coste y el workflow no necesita flagship quality.

Me quedo con gpt-image-1-mini. Es el movimiento más limpio porque reduce coste sin cambiar vendor, auth ni familia de APIs.

2. Mis outputs son posters, ads, thumbnails y otros assets con mucho texto.

Probaría primero Ideogram 3.0. Aquí typography y layout son el trabajo real.

3. Mi equipo corrige la misma imagen una y otra vez y pelea con el drift.

Cambiaría a FLUX.1 Kontext. En ese flujo importa más el edit control y la consistency que la belleza de la primera salida.

4. Mi app necesita una interacción que razone en texto y también devuelva imagen.

Elegiría Gemini 2.5 Flash Image. Es una ruta multimodal más natural que forzar una API de imagen dedicada a resolver un problema más amplio.

5. Quiero un stack de generación alojado en Google Cloud con economía por imagen fácil de leer.

Elegiría Imagen 4 Fast. Es el mejor ajuste cuando el requisito es hosted generation dentro de Google, no multimodal reasoning.

Estas cinco situaciones cubren casi toda la demanda real detrás de este keyword. Y también explican por qué las páginas genéricas de “best alternatives” suenan flojas: responden al mercado, no al blocker.

Conclusión

La mejor alternativa a GPT Image 1.5 no es un único modelo. Es la forma de modelo que corrige la razón concreta por la que GPT Image 1.5 dejó de ser el default adecuado.

Si el problema es solo el coste, quédate en OpenAI y pasa a gpt-image-1-mini. Si el problema es typography, prueba Ideogram 3.0. Si el dolor está en revisiones y consistency, mira FLUX.1 Kontext. Si tu producto necesita una llamada que razone y renderice, usa Gemini 2.5 Flash Image. Si quieres un lane de generación alojado en Google Cloud, usa Imagen 4 Fast. Y si el problema real es setup o surface choice, la mejor decisión puede ser la menos glamorosa: no cambiar todavía.