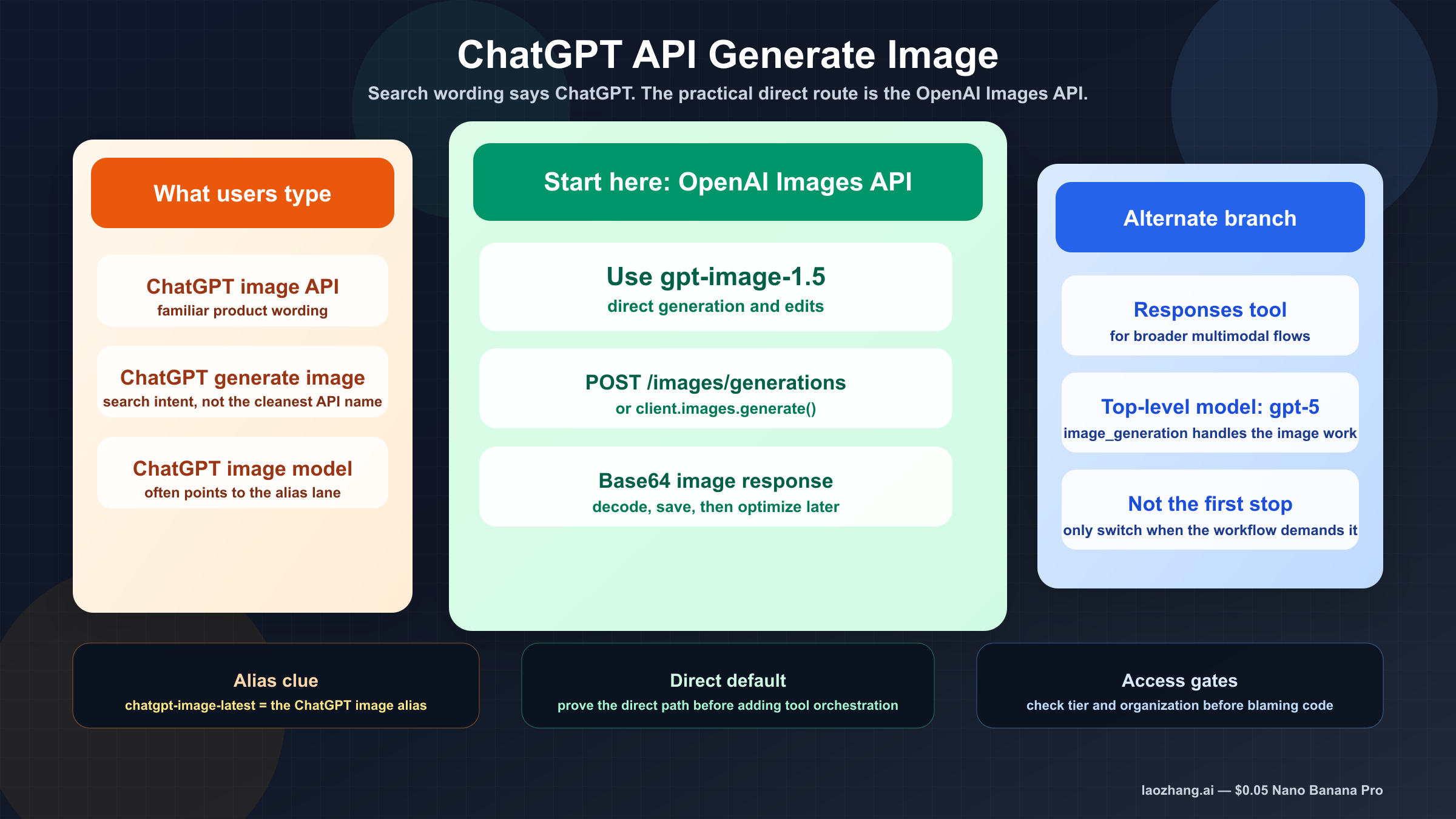

Si has buscado chatgpt api generate image, la respuesta práctica y actual a 23 de marzo de 2026 es esta: empieza con OpenAI Images API y gpt-image-1.5. Para una petición directa, eso significa client.images.generate() o POST /v1/images/generations, no un supuesto endpoint exclusivo de ChatGPT.

La consulta parece más confusa de lo que debería porque OpenAI reparte la respuesta entre varias superficies. El image generation guide explica la ruta directa con Images API y recomienda gpt-image-1.5 como mejor default actual. El tool guide de image_generation enseña la rama de Responses. La página de chatgpt-image-latest aclara que el alias apunta al snapshot de imagen usado en ChatGPT. Si solo lees una de esas páginas, es fácil quedarte con la mitad de la película.

La secuencia más segura es simple: primero haz funcionar una petición directa con Images API, guarda la imagen base64 en disco, confirma que tu cuenta realmente tiene acceso y solo después añade alias, edición o el tool de Responses si tu producto de verdad lo necesita. Esa secuencia evita la mayor parte del trabajo perdido que todavía genera la SERP.

Resumen rápido

- No existe una primera parada obligatoria llamada "ChatGPT image API" separada del resto.

- Para una petición directa de imagen, usa OpenAI Images API con

gpt-image-1.5. - Usa Responses

image_generationsolo cuando la imagen sea una herramienta dentro de un workflow multimodal más grande. - Trata

chatgpt-image-latestcomo el alias del snapshot usado en ChatGPT, no como prueba de una plataforma aparte. - Si el ejemplo falla, revisa antes usage tier, organization verification y qué organización usa tu API key.

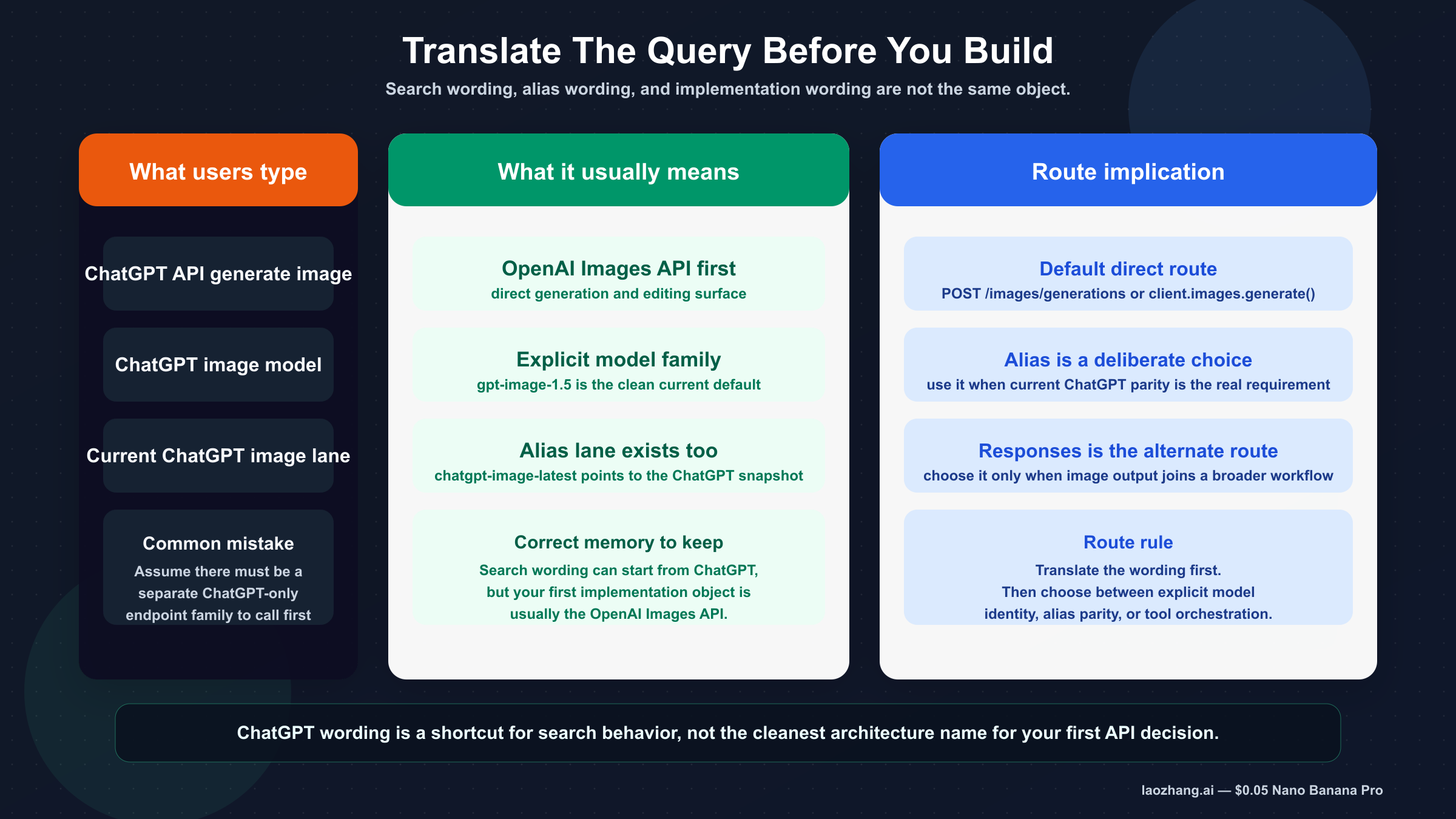

¿Buscas una API de imágenes de ChatGPT o en realidad OpenAI Images API?

En la práctica, casi siempre estás buscando la OpenAI Images API, aunque hayas llegado con wording de ChatGPT. Esa es la primera frase que demasiadas páginas todavía no dicen con suficiente claridad.

La página oficial de chatgpt-image-latest dice que el alias apunta al snapshot de imagen usado actualmente en ChatGPT. Eso explica por qué existe esta query. La gente conoce el producto ChatGPT y busca una API con el mismo nombre. Pero las superficies reales de implementación siguen siendo las superficies del API de OpenAI: v1/images/generations, v1/images/edits y la Responses API cuando la generación de imágenes es una herramienta más dentro de un flujo mayor.

La diferencia no es solo de branding. Cambia la forma de documentar, depurar y elegir la primera abstracción. Si te dices "necesito la API de imágenes de ChatGPT", puedes acabar en páginas débiles que todavía enseñan gpt-4o, proxies o supuestos atajos globales. Si te dices "necesito la ruta actual del API de OpenAI que encaja con la experiencia de imágenes de ChatGPT cuando haga falta", la documentación se ordena bastante mejor.

Eso también explica por qué esta keyword sigue siendo ganable. Las páginas oficiales tienen los hechos, pero no resuelven el mismo problema del lector. Una página da facts del modelo. Otra explica el tool. Otra confirma el endpoint. Otra habla de verification. El problema real del lector no es "qué es image generation", sino "qué debo llamar primero para no construir sobre la abstracción equivocada".

Para esa pregunta, la regla útil es corta:

- Empieza por Images API.

- Usa

gpt-image-1.5como modelo por defecto. - Trata

chatgpt-image-latestcomo una decisión de alias, no como la primera decisión arquitectónica.

Si todavía estás ordenando el mapa completo de superficies, la lectura siguiente en español es el tutorial de OpenAI Image API. Esta página es más estrecha a propósito: traduce la query con wording de ChatGPT a la decisión de implementación correcta.

La forma más rápida hoy de generar una imagen por API

Para una petición sencilla de "prompt entra, imagen sale", la ruta más limpia sigue siendo la Images API directa. La referencia oficial de Images confirma POST /images/generations como endpoint bruto, y el image generation guide recomienda gpt-image-1.5 como el mejor default actual.

La primera petición debería ser deliberadamente aburrida:

- un prompt

- una imagen cuadrada

- sin orquestación extra

- decodificar el base64

- guardar el archivo localmente

Eso prueba toda la ruta de integración, no solo la llamada HTTP.

JavaScript:

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const result = await client.images.generate({ model: "gpt-image-1.5", prompt: "Create a clean editorial illustration of a robot camera operator in a bright studio", size: "1024x1024", quality: "medium", }); const imageBase64 = result.data[0].b64_json; const imageBuffer = Buffer.from(imageBase64, "base64"); fs.writeFileSync("chatgpt-api-generate-image.png", imageBuffer);

Python:

pythonfrom openai import OpenAI import base64 client = OpenAI() result = client.images.generate( model="gpt-image-1.5", prompt="Create a clean editorial illustration of a robot camera operator in a bright studio", size="1024x1024", quality="medium", ) image_base64 = result.data[0].b64_json image_bytes = base64.b64decode(image_base64) with open("chatgpt-api-generate-image.png", "wb") as f: f.write(image_bytes)

cURL:

bashcurl https://api.openai.com/v1/images/generations \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "gpt-image-1.5", "prompt": "Create a clean editorial illustration of a robot camera operator in a bright studio", "size": "1024x1024", "quality": "medium" }' \ | jq -r '.data[0].b64_json' \ | base64 --decode > chatgpt-api-generate-image.png

Esta es la mejor primera ruta por tres motivos. Primero, usa la recomendación actual del modelo. Segundo, mantiene la ruta lo bastante directa como para que los fallos se diagnostiquen mejor. Tercero, enseña el contrato de salida que muchos tutorials siguen pasando por alto: el Image API devuelve imagen en base64 por defecto, con PNG como formato por defecto y JPEG/WebP más output_compression como ajustes opcionales.

Si tu siguiente necesidad es una página más amplia de ejemplos, la continuación natural es OpenAI image generation API example. Para esta keyword, lo crítico es acertar la primera ruta antes de ampliar el tutorial.

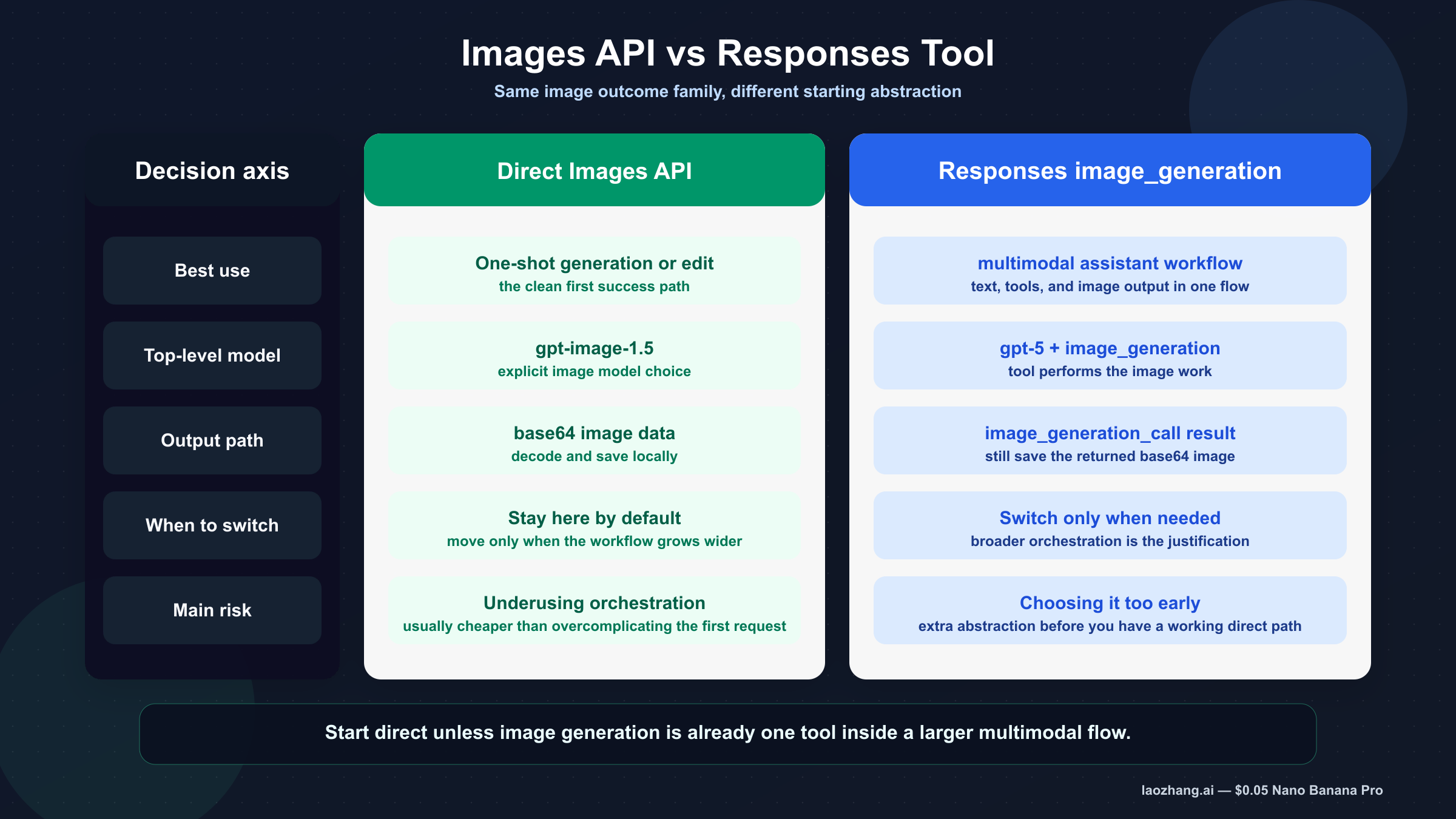

Cuándo usar Images API y cuándo Responses image_generation

La Images API directa es el mejor default cuando la generación de imágenes es la propia feature. El tool de Responses es el mejor default cuando la imagen es una salida dentro de un workflow de razonamiento o multimodalidad más grande.

| Situación | Mejor default | Por qué |

|---|---|---|

| Necesitas una petición directa de prompt a imagen | Images API | Menos capas y camino más corto al primer éxito |

| Quieres un endpoint backend para generar o editar | Images API | Contrato de petición más simple y depuración más clara |

| Necesitas edición directa sobre una o varias imágenes | Images API | La ruta de edición está documentada aquí y mantiene el flujo explícito |

| Estás construyendo un assistant que a veces también devuelve imágenes | Responses image_generation | La imagen encaja mejor como tool dentro del flujo mayor |

| Necesitas texto, tools e imagen en una sola interacción | Responses image_generation | La orquestación vive mejor dentro de la misma superficie |

El tool guide oficial deja el detalle clave bastante claro: el ejemplo actual de responses.create() usa model: "gpt-5" y añade tools: [{ type: "image_generation" }]. El tool de imagen aprovecha por detrás los modelos GPT Image. Por eso meter gpt-image-1.5 en el campo model de Responses suele ser una lectura equivocada de la documentación.

Si de verdad necesitas la ruta con tool, el patrón mínimo útil se ve así:

jsimport fs from "fs"; import OpenAI from "openai"; const client = new OpenAI({ apiKey: process.env.OPENAI_API_KEY, }); const response = await client.responses.create({ model: "gpt-5", input: "Generate a transparent sticker-style icon of a paper airplane", tools: [{ type: "image_generation", background: "transparent" }], }); const imageBase64 = response.output .filter((item) => item.type === "image_generation_call") .map((item) => item.result)[0]; fs.writeFileSync("paper-airplane.png", Buffer.from(imageBase64, "base64"));

Ese ejemplo sirve aquí por una única razón: te muestra la diferencia de abstracción en términos concretos. La ruta directa usa un modelo de imagen explícito. La ruta de Responses usa un modelo principal de razonamiento y delega la imagen en el tool. Una vez ves ambas formas una al lado de la otra, la bifurcación se entiende mucho mejor.

La regla operativa que merece sobrevivir dentro de tu equipo es simple: empieza directo salvo que tu producto ya necesite orquestación multimodal.

Los nombres de modelo que sí importan ahora

Los nombres importan porque la SERP sigue mezclando lanzamientos viejos y páginas que suenan actuales pero ya no deberían ser el punto de partida.

| Modelo o etiqueta | Qué significa ahora | Mejor uso |

|---|---|---|

gpt-image-1.5 | Último modelo GPT Image y default oficial actual | La mayoría del trabajo directo de generación y edición |

gpt-image-1.5-2025-12-16 | Snapshot fechado expuesto en la página del modelo | Evaluaciones reproducibles o rollout controlado |

chatgpt-image-latest | Alias que apunta al snapshot actual usado en ChatGPT | Solo cuando la prioridad real es seguir la ruta de ChatGPT |

gpt-image-1 | Rama GPT Image anterior todavía visible en docs e historial | Migración o compatibilidad |

| DALL-E 2 / DALL-E 3 | Modelos especializados deprecated | No deberían ser el default fresco para esta query |

El image generation guide actual dice que gpt-image-1.5 es el modelo más reciente y avanzado de la familia GPT Image, y lo recomienda como mejor experiencia. La misma guía añade que DALL-E 2 y DALL-E 3 están deprecated y dejarán de estar soportados el 05/12/2026. Eso basta para descartar como default la mayoría de páginas que todavía giran alrededor de GPT-4o o DALL-E.

La página de gpt-image-1.5 además da dos facts operativos útiles:

- Free not supported

- Tier 1 empieza en 100,000 TPM y 5 IPM

También expone el snapshot gpt-image-1.5-2025-12-16, que es útil si te importa la reproducibilidad o el rollout por fases. Si tu siguiente duda real es la diferencia entre alias y modelo explícito, la continuación natural es chatgpt-image-latest vs gpt-image-1.5.

La pricing no es el centro de esta keyword, pero conviene conocer la escalera visible actual. La página de chatgpt-image-latest muestra $0.009 para low en 1024x1024, $0.034 para medium y $0.133 para high. Eso refuerza otra idea: no merece la pena seguir confiando en páginas viejas que describen esta capa como si siguiera siendo simplemente "GPT-4o image generation". Si tu problema real ya es de presupuesto, vete a OpenAI image generation API pricing.

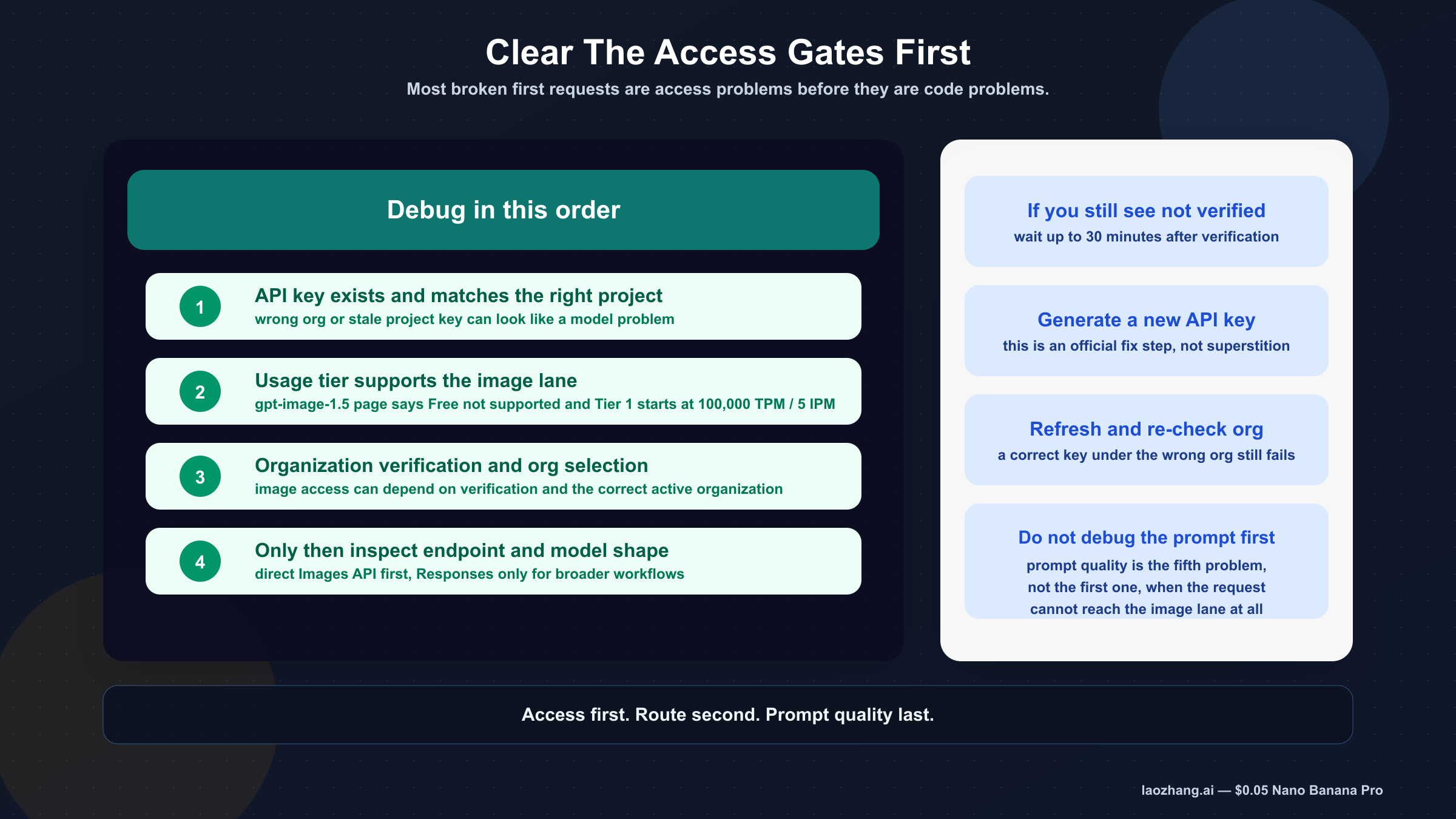

Troubleshooting: revisa el acceso antes de culpar al ejemplo

Muchos fallos del primer intento no vienen del snippet. Vienen del estado de la cuenta, de la organización activa o de una suposición vieja sobre qué superficie de OpenAI deberías estar usando.

La primera comprobación es el usage tier. La página API Model Availability by Usage Tier and Verification Status dice que GPT-image-1 y GPT-image-1-mini están disponibles para usuarios API en tiers 1 through 5, con parte del acceso sujeto a organization verification. La página de gpt-image-1.5 dice por separado Free not supported. Juntas, esas dos piezas dejan una regla práctica muy clara: si estás pensando en esto como una feature gratuita de ChatGPT, ya estás usando el marco mental equivocado para el acceso por API.

La segunda comprobación es organization verification. El artículo de API Organization Verification dice que la verificación puede desbloquear capacidades de image generation en el API. También da pasos concretos si sigues viendo el error de "not verified":

- esperar hasta 30 minutos

- generar una API key nueva

- refrescar o volver a entrar

- confirmar que estás mirando la organización correcta

Esos pasos merecen aparecer en el artículo porque muchos desarrolladores hacen lo contrario. Reinstalan el SDK, cambian el prompt o reescriben el ejemplo completo antes de verificar si la cuenta puede realmente llamar al modelo.

La tercera comprobación es la ruta elegida. Si copiaste un ejemplo de Responses cuando solo necesitabas una petición directa de imagen, te tocará depurar una capa de tool orchestration que quizá nunca necesitabas. Si copiaste un tutorial viejo que usa gpt-4o o asume URLs alojadas en vez de salida base64, vas a perder aún más tiempo culpando a OpenAI por un problema que empezó en la guía equivocada.

El orden limpio de depuración es:

- acceso y organización

- nombre actual del modelo

- endpoint y request shape

- decodificación del output

- calidad del prompt

Si tu bloqueo principal sigue siendo el acceso, el siguiente paso correcto es OpenAI image generation API verification, porque esa página profundiza mucho más en la rama de verification.

Qué tutoriales débiles conviene evitar

El primer patrón débil es el proxy-first tutorial. Si una página presenta todo el problema como "usa este proxy para desbloquear la API de imágenes de ChatGPT", ya te está alejando de la ruta oficial actual. Incluso cuando esas páginas parecen completas, muchas enseñan defaults viejos, model names incorrectos o una ruta que solo tiene sentido dentro del propio producto del intermediario.

El segundo patrón débil es el default viejo de gpt-4o. Sigue apareciendo porque suena reciente y pasa un vistazo superficial. Pero la guía actual de OpenAI recomienda gpt-image-1.5, y las páginas actuales del modelo ya exponen directamente la familia GPT Image. Un artículo nuevo en 2026 no debería centrar gpt-4o como respuesta por defecto para esta consulta.

El tercer patrón débil es el mal modelo mental sobre Responses. Algunas páginas explican correctamente que Responses puede generar imágenes, pero luego no aclaran que el modelo de nivel superior es un mainline model y que la imagen la produce el tool image_generation. El lector copia una forma que no termina de entender y acaba depurando el campo equivocado.

El cuarto patrón débil es mezclar comportamiento de planes de ChatGPT con comportamiento del API. No son la misma puerta. La experiencia en ChatGPT puede explicar la query, pero usage tier, organization verification y model availability son preguntas operativas distintas.

La mejor costumbre es hacerte cuatro preguntas cada vez que abras un tutorial:

- ¿Usa el naming actual de GPT Image?

- ¿Distingue Images API de Responses tool?

- ¿Explica la salida y el guardado, no solo el request?

- ¿Menciona tier y verification antes de culpar al SDK?

Si la respuesta es no a casi todo, esa página puede rankear, pero no es tu mejor guía de implementación.

Recomendación final

Si tu objetivo es simplemente generar una imagen por API, la respuesta más segura hoy es usar OpenAI Images API con gpt-image-1.5. Eso es lo que la mayoría de la gente quiere de verdad cuando busca chatgpt api generate image, aunque todavía no conozca los nombres correctos de las superficies de OpenAI.

Usa chatgpt-image-latest solo cuando seguir el alias actual de ChatGPT sea parte explícita del objetivo. Usa Responses image_generation solo cuando la imagen sea una herramienta dentro de un workflow multimodal más grande. Esas deben ser decisiones deliberadas, no la primera suposición.

La secuencia que menos tiempo desperdicia es esta:

- ejecutar un ejemplo directo con Images API

- confirmar que la cuenta tiene acceso

- guardar correctamente la imagen base64

- solo después añadir alias, edits o Responses

Esa secuencia es menos vistosa que un gran "complete guide", pero para esta keyword es exactamente lo que la SERP todavía no hace bien.