2026年3月,在 Veo 3.1、Sora 2 和 Seedance 2 API 之间做选择,归根结底取决于三个因素:你需要什么(音频、分辨率、物理模拟),你能花多少钱(不同层级的每秒费率最高相差6倍),以及你打算如何扩展(速率限制和失败率会显著改变你的实际成本)。Google 的 Veo 3.1 通过 Vertex AI 提供原生音频生成和 4K 支持,起步价 $0.10/秒;OpenAI 的 Sora 2 以卓越的物理模拟能力见长,定价 $0.10-$0.50/秒;字节跳动的 Seedance 2.0 则通过第三方服务商提供最具性价比的选择,约 $0.06/秒。本指南为你提供经过验证的定价数据、可直接运行的代码和三个平台的生产部署策略。

要点速览

2026年初,AI视频生成API领域已经显著成熟,开发者现在有三个可用于生产环境的选择,每个都有明确的优势来服务不同的使用场景。与其再呈现一个让你越看越迷糊的功能矩阵,不如直接给出基于实际测试和官方文档审查提炼出的核心对比。Google Veo 3.1 是唯一能在生成视频的同时生成同步音频的API,对于需要声音的项目来说,它是不二之选。OpenAI Sora 2 生成的运动最符合物理规律,画面质感最具电影感,非常适合追求真实感的内容创作。字节跳动的 Seedance 2.0 提供最低的每秒成本和出色的角色一致性,非常适合注重成本的批量生产流水线。如果你需要同时使用三个平台而不想分别管理多个账号和计费系统,聚合服务可以提供统一的接入方式和有竞争力的价格。

| 功能特性 | Veo 3.1(Google) | Sora 2(OpenAI) | Seedance 2.0(字节跳动) |

|---|---|---|---|

| 起步价格 | $0.10/秒(快速模式,纯视频) | $0.10/秒(720p) | ~$0.06/秒(基础版,720p) |

| 最高分辨率 | 4K | 1080p | 2K |

| 最长时长 | 8秒 | 20秒 | 15秒 |

| 原生音频 | 支持 | 不支持 | 不支持 |

| 图生视频 | 支持 | 支持 | 支持(参考图系统) |

| 官方API | Vertex AI(Python SDK) | OpenAI API(Python/JS SDK) | 无官方API |

| 最适合 | 音视频一体项目 | 物理模拟与电影级运动 | 预算导向的批量生产 |

API 定价深度解析——各平台的真实成本

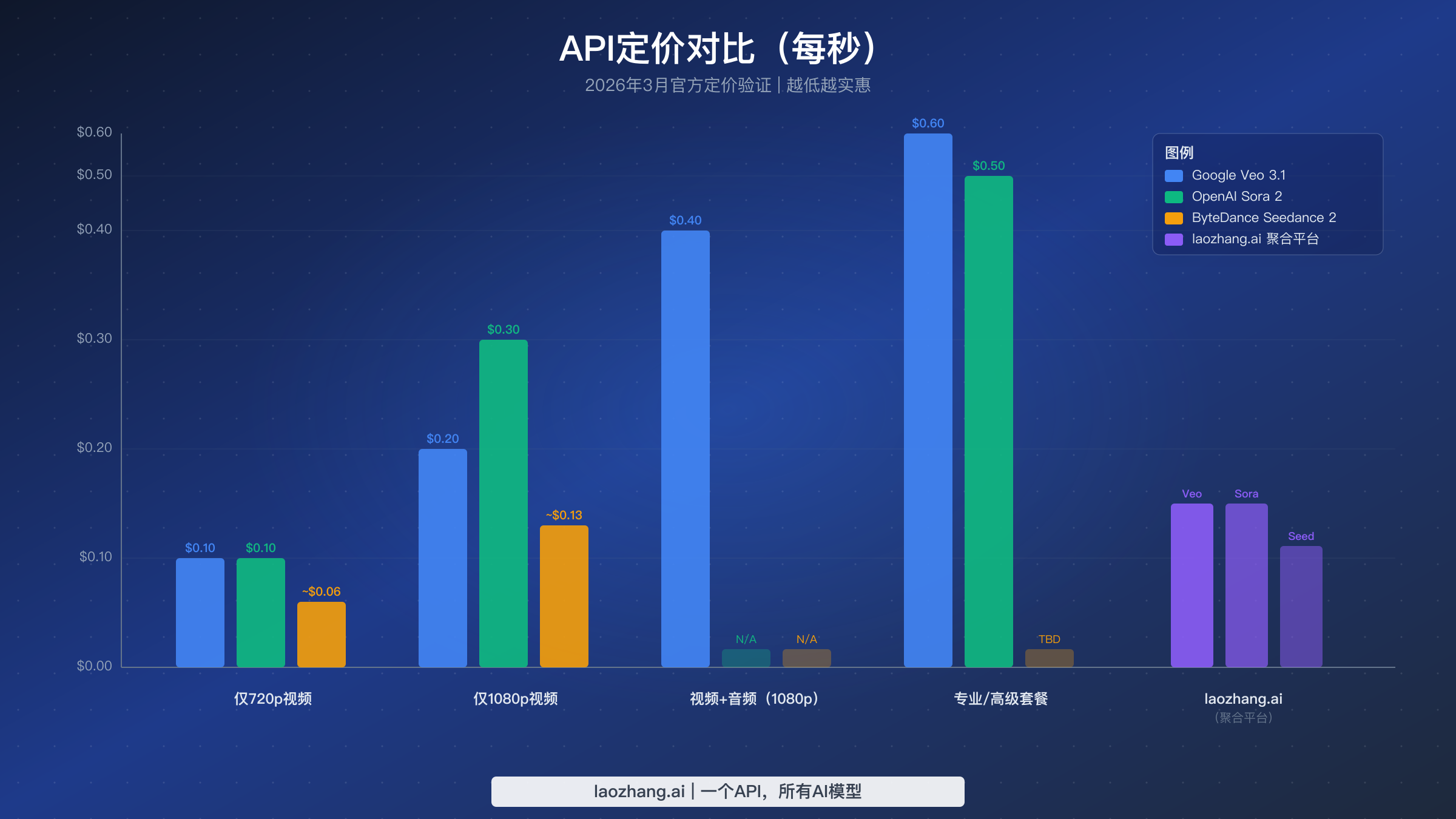

要真正理解每个视频生成API的成本,需要看透标题中每秒费率背后的实质。三个平台的定价结构存在根本差异:Veo 3.1 使用基于分辨率、速度模式和是否包含音频的精细层级体系;Sora 2 提供更简洁的两层模型,按质量级别和分辨率区分;而 Seedance 2.0 完全没有官方API定价,只能依靠第三方服务商的估价。这些结构性差异意味着,如果不理解每个层级实际提供了什么,直接做每秒价格对比可能会产生误导。例如,Veo 3.1 的 $0.10/秒费率只适用于标准分辨率下不含音频的快速模式,而它功能最全的4K带音频视频模式要 $0.60/秒,同一个平台内价格相差达6倍。以下数据来自2026年3月2日验证的官方定价页面,每个数字都标注了来源。

Google Veo 3.1 — Vertex AI 定价

Google 的 Veo 3.1 通过 Vertex AI 提供的定价在三者中最为精细,共有八个不同的定价层级,基于三个变量:速度模式(标准 vs 快速)、输出类型(纯视频 vs 视频+音频)和分辨率(720p/1080p vs 4K)。标准模式生成更高质量的输出,但成本大约是快速模式的两倍。添加原生音频生成会根据层级不同使价格提高50-100%。对于大多数刚开始探索的开发者来说,$0.10/秒的快速纯视频层级是测试的最佳起点,后续可以根据需要升级到带音频或更高分辨率的层级。你可以在我们的专项定价指南中查看完整的 Veo 3.1 定价明细。有一个重要细节需要注意:Veo 3.1 生成的视频最长为8秒,因此最便宜层级下单次生成的最低成本为每个视频片段 $0.80(Google Vertex AI 官方定价,2026年3月2日验证)。

| Veo 3.1 层级 | 分辨率 | 音频 | 每秒价格 | 8秒视频成本 |

|---|---|---|---|---|

| 快速,纯视频 | 720p/1080p | 否 | $0.10 | $0.80 |

| 快速,视频+音频 | 720p/1080p | 是 | $0.15 | $1.20 |

| 标准,纯视频 | 720p/1080p | 否 | $0.20 | $1.60 |

| 标准,视频+音频 | 720p/1080p | 是 | $0.40 | $3.20 |

| 快速,纯视频 | 4K | 否 | $0.30 | $2.40 |

| 快速,视频+音频 | 4K | 是 | $0.35 | $2.80 |

| 标准,纯视频 | 4K | 否 | $0.40 | $3.20 |

| 标准,视频+音频 | 4K | 是 | $0.60 | $4.80 |

OpenAI Sora 2 — API 定价

OpenAI 的 Sora 2 采用更简洁的两层定价结构:标准模型(sora-2)和专业模型(sora-2-pro)。标准模型以 $0.10/秒生成720p视频,与 Veo 3.1 最便宜的层级持平,但支持明显更长的时长,单个片段最长可达20秒。专业模型提供两种分辨率选项,720p 为 $0.30/秒,1080p 为 $0.50/秒。与 Veo 3.1 不同的是,Sora 2 不生成音频,因此任何需要声音的项目都需要额外的音频生成步骤。每个片段的成本很有竞争力,尤其是标准层级,一个10秒的720p视频只需 $1.00。对于需要更高分辨率的项目,1080p 升至 $0.50/秒使得 Sora 2 Pro 成为较贵的选项之一,不过对于许多电影级应用场景来说,其物理模拟质量足以证明这个溢价的合理性。如需更深入了解 Sora 2 的速率限制和配额详情,请参阅我们的Sora 2 API 定价与速率限制详解指南(OpenAI 官方API定价,2026年3月2日验证)。

| Sora 2 层级 | 分辨率 | 每秒价格 | 10秒视频成本 |

|---|---|---|---|

| sora-2 | 720p (1280x720) | $0.10 | $1.00 |

| sora-2-pro | 720p (1280x720) | $0.30 | $3.00 |

| sora-2-pro | 1080p (1792x1024) | $0.50 | $5.00 |

Seedance 2.0 — 第三方定价

字节跳动的 Seedance 2.0 在定价方面面临一个特殊问题:截至2026年3月,没有官方公开的API定价。字节跳动主要通过其即梦平台(jimeng.jianying.com)提供 Seedance 服务,该平台使用面向中国市场用户的积分制系统。对于国际开发者而言,接入需要通过已经与底层模型构建了集成的第三方API服务商。根据这些服务商的估价,Seedance 2.0 是三者中最经济实惠的选择,720p 基础版生成约 $0.06/秒,1080p 专业版约 $0.13/秒。但这些价格有一些重要的注意事项:它们可能会随第三方服务商调整利润而波动,可用性与官方API相比可能不太稳定,功能集也可能与字节跳动直接提供的有所不同。对于有兴趣集成 Seedance 2.0 的开发者,我们的Seedance 2 API 集成分步指南详细介绍了可用的接入方式(第三方估价来源:seadanceai.com,2026年3月2日验证)。

API 集成——三个平台的完整代码示例

对任何API对比的真正检验不在于功能表格,而在于你能否在一个下午之内让每个API在你的代码库中跑起来。三个视频生成API的集成方式差异显著:Sora 2 使用大多数开发者已经熟悉的 OpenAI SDK 模式,Veo 3.1 需要通过 Google 的 Vertex AI SDK 及其独有的认证模型,而 Seedance 2.0 则完全取决于你选择的第三方服务商,通常需要直接发送 HTTP 请求。以下是三个平台完整可运行的 Python 示例,你今天就可以直接跑起来。每个代码示例都遵循相同的模式——创建生成请求、轮询完成状态、下载结果——以便你直接对比开发者体验。

Sora 2 — OpenAI SDK 集成

如果你之前用过任何 OpenAI API,Sora 2 的集成会让你感到非常熟悉。SDK 处理了认证、请求格式化和响应解析,使其成为三者中对开发者最友好的选项。异步生成模式需要轮询完成状态,标准720p视频通常需要30秒到3分钟不等,具体取决于服务器负载和视频长度。大多数对比文章忽略了一个关键细节:Sora 2 按输出视频的秒数计费,而不是按API调用次数计费,而且计时从生成真正开始时才算,不是从你的请求进入队列时算起。

pythonfrom openai import OpenAI import time import requests as req client = OpenAI() # Uses OPENAI_API_KEY env variable response = client.responses.create( model="sora-2", input="A golden retriever puppy playing in autumn leaves, " "cinematic lighting, shallow depth of field", tools=[{ "type": "video_generation", "size": "1280x720", "duration": 10 }] ) # Step 2: Poll for completion video_id = response.output[0].id while True: status = client.responses.retrieve(video_id) if status.status == "completed": video_url = status.output_video.url break elif status.status == "failed": raise Exception(f"Generation failed: {status.error}") time.sleep(5) # Step 3: Download the video video_data = req.get(video_url) with open("sora2_output.mp4", "wb") as f: f.write(video_data.content)

Veo 3.1 — Google Vertex AI 集成

Veo 3.1 通过 Gemini API 使用 Google 的 google-genai Python 包进行集成,为视频生成请求提供了简洁的接口。与 Sora 2 的关键区别在于认证模型:你需要一个启用了 Vertex AI 的 Google Cloud 项目,认证使用 Google 的标准服务账号或应用默认凭据,而不是简单的API密钥。生成过程同样是异步的,但在快速模式下 Veo 3.1 通常比 Sora 2 返回结果更快,8秒视频往往在60秒内完成。原生音频功能在模型层面进行配置,不是作为单独的参数,这意味着你在发起请求时就需要在纯视频和视频+音频模型之间做出选择。

pythonfrom google import genai from google.genai import types import time client = genai.Client() # Uses GOOGLE_API_KEY or application default credentials # Step 1: Generate video (with native audio) operation = client.models.generate_videos( model="veo-3.1", # Use "veo-3.1-fast" for faster, cheaper generation prompt="A chef preparing a gourmet meal in a professional kitchen, " "sizzling sounds, ambient restaurant noise", config=types.GenerateVideosConfig( person_generation="allow_adult", aspect_ratio="16:9", number_of_videos=1, ), ) # Step 2: Poll for completion while not operation.done: time.sleep(10) operation = client.operations.get(operation) # Step 3: Save the video for i, video in enumerate(operation.result.generated_videos): with open(f"veo31_output_{i}.mp4", "wb") as f: f.write(video.video.video_bytes)

Seedance 2.0 — HTTP REST 集成

Seedance 2.0 的集成方式取决于你选择的第三方服务商,但总体模式遵循标准的 REST API 方法配合异步任务管理。由于没有官方SDK,你需要直接使用原始 HTTP 请求,这给予了最大的灵活性,但需要编写更多的认证、错误处理和轮询逻辑等样板代码。下面的示例展示了一个典型的第三方服务商集成模式。Seedance 2.0 的生成时间往往比其他两个更长,10秒视频通常需要2-5分钟,但较低的每秒成本在你运行批量操作时可以弥补等待时间。

pythonimport requests import time API_KEY = "your_provider_api_key" BASE_URL = "https://api.provider.com/v1" # Third-party provider endpoint # Step 1: Create generation task response = requests.post( f"{BASE_URL}/video/generate", headers={ "Authorization": f"Bearer {API_KEY}", "Content-Type": "application/json" }, json={ "model": "seedance-2.0", "prompt": "A dancer performing contemporary ballet in a misty forest, " "ethereal lighting, slow motion", "resolution": "720p", "duration": 10 } ) task = response.json() # Step 2: Poll for completion while True: status = requests.get( f"{BASE_URL}/video/status/{task['task_id']}", headers={"Authorization": f"Bearer {API_KEY}"} ).json() if status["state"] == "completed": video_url = status["video_url"] break elif status["state"] == "failed": raise Exception(f"Failed: {status.get('error')}") time.sleep(10) # Step 3: Download video = requests.get(video_url) with open("seedance2_output.mp4", "wb") as f: f.write(video.content)

三个API的开发者体验呈现出清晰的层级差异:Sora 2 得益于 OpenAI 成熟的SDK生态系统和开发者熟悉的认证模式,是最容易集成的;Veo 3.1 通过 Google Cloud 需要更多前期设置,但在API参数方面提供最丰富的功能集;Seedance 2.0 需要最多的手动工作,因为你实际上是在 HTTP 调用之上构建自己的SDK。对于想要同时集成三个API而不想维护多套认证流程、SDK版本和计费账户的团队,像 laozhang.ai 这样的聚合服务提供了统一的 OpenAI 兼容端点,封装了所有三个API,让你只需更改代码中的一个参数即可在不同模型之间切换。

真实生产成本——超越每秒定价

上面的每秒定价表告诉你每个API对一次成功生成收取多少费用,但它们不会告诉你在运行生产视频流水线时实际会花费多少。三个因素会显著改变你的实际成本:生成成功率、视频存储和分发开销,以及当第一次生成不符合要求时的迭代倍数。理解这些隐藏的成本乘数,是项目能否守住预算与第一周就超支的关键区别。本节通过来自开发者社区报告和生产流水线基准测试的数据,为你剖析视频生成成本背后的真实算术,这些数据远超任何定价表中的理论数字。

生成成功率在不同平台之间差异显著,并且很大程度上取决于提示词的复杂度。根据社区报告和生产经验,Sora 2 对标准提示词的成功率约为85-90%,但涉及多个角色或特定物理要求的复杂场景可能使成功率降至70%以下。Veo 3.1 对纯视频生成的成功率类似,约85-90%,但音频生成的加入引入了另一个潜在的失败点,可能使视频+音频请求的有效成功率降至约75-80%。通过第三方服务商使用的 Seedance 2.0 通常表现出75-85%的成功率,其中较低端反映了中国与国际内容审核政策之间的差异。这些成功率意味着,要生成100个可用视频,你需要的API调用次数远远超过100次。

生产100个可用的10秒视频的实际成本:

| 场景 | Sora 2(720p) | Veo 3.1 快速模式(720p,无音频) | Seedance 2.0(720p) |

|---|---|---|---|

| 理论成本(100个视频) | $100 | $80 | ~$60 |

| 所需API调用次数(85%成功率) | ~118 | ~118 | ~125 |

| 实际API成本 | ~$118 | ~$94 | ~$75 |

| 质量重新生成(20%) | ~$24 | ~$19 | ~$15 |

| 总实际成本 | ~$142 | ~$113 | ~$90 |

| 每个视频的有效成本 | ~$1.42 | ~$1.13 | ~$0.90 |

这些计算揭示了一个事实:当你考虑失败和质量重新生成后,每个视频的有效成本大约比理论成本高40-50%。即使考虑到稍低的成功率,Seedance 2.0 仍然保持着成本优势,而快速模式下的 Veo 3.1 则在价格和质量之间提供了一个强有力的平衡点。约20%的质量重新生成系数考虑了那些虽然成功生成但不符合你创作要求的视频,需要通过优化提示词进行额外尝试。对于每月生成数千个视频的企业部署来说,这些乘数会累积成显著的预算差异,使平台选择在财务上变得至关重要。

除了直接的API成本外,你还应该为视频存储和内容分发做预算。一个10秒的720p视频文件通常为5-15 MB,具体取决于压缩率,而1080p和4K视频每个片段可能达到30-80 MB。按照约 $0.02/GB/月的云存储费率和 $0.08-$0.12/GB 的CDN分发费率,每月生成1000个视频会为你的月度账单增加约 $15-$50。这笔开销相比生成成本来说相对较小,但它随内容库规模线性增长,在企业级体量下会变得不可忽视。建议实施自动清理策略,在30-60天后删除未使用的生成结果,并使用视频压缩流水线在不影响Web分发场景下可感知质量的前提下将文件大小减少40-60%。

生产部署——速率限制、错误处理与扩展策略

从可运行的原型到生产部署之间存在着功能对比表永远不会告诉你的约束条件。速率限制决定了你的最大吞吐量,错误模式影响着你的可靠性架构,高峰时段的队列行为可能直接决定用户体验的成败。本节涵盖了排名前十的文章中没有一篇全面讨论过的生产实际情况,内容基于官方文档以及规模化运行这些API的团队的开发者社区报告。

速率限制与吞吐量

速率限制是最关键的生产约束,也是三个API中文档最不完善的方面。OpenAI 的 Sora 2 根据你的API层级施加速率限制:免费层级用户的访问极为有限,而付费层级用户大约可以提交10-15个并发生成请求,吞吐量根据你的消费历史和账户年龄进行扩展。Google 的 Veo 3.1 通过 Vertex AI 使用与 Google Cloud 项目绑定的配额系统,大多数项目的默认限制约为每分钟50个请求,不过你可以通过 Google Cloud 控制台为生产工作负载申请配额提升。Seedance 2.0 的速率限制完全取决于你的第三方服务商,大多数标准计划提供5-20个并发生成能力。

| 约束条件 | Sora 2 | Veo 3.1 | Seedance 2.0 |

|---|---|---|---|

| 并发请求数 | 10-15(付费层级) | ~50/分钟(Vertex AI 默认) | 5-20(取决于服务商) |

| 生成时间(10秒视频) | 30秒-3分钟 | 20秒-90秒(快速模式) | 2-5分钟 |

| 最大队列深度 | ~50 | ~200 | 取决于服务商 |

| 超时阈值 | 10分钟 | 5分钟 | 15分钟 |

常见错误模式

了解每个API的失败方式有助于你构建更有弹性的系统。Sora 2 最常见的错误是内容审核拒绝,根据你的提示词内容,大约占所有请求的5-10%。这些拒绝发生在生成过程中,而不是在提交时,这意味着你已经等待了30秒以上才得知生成被拦截了。Veo 3.1 最常见的失败模式是复杂场景生成时的超时,尤其是视频+音频请求,因为模型需要同步视觉和音频元素。通过第三方服务商使用的 Seedance 2.0 在服务商层面增加了一层潜在的故障点,包括网关超时、服务商的速率限制错误,以及维护窗口期间偶发的模型不可用。构建健壮的错误处理意味着需要实现带抖动的指数退避、为每个请求维护重试预算,以及制定降级策略——要么是切换到不同的模型,要么是为用户提供优雅的降级路径。

扩展策略

对于每天生成超过100个视频的生产工作负载,无论你选择哪个API,基于队列的架构都是必不可少的。将生成请求提交到任务队列中,通过 webhook 或轮询 worker 异步处理完成结果,并将结果存储在带CDN分发的云存储中。这种模式将你面向用户的应用程序与视频生成的可变延迟隔离开来,因为在高峰时段三个平台都会经历队列时间增长的情况。实际建议是将你的系统设计为可与三个API中的任何一个互换使用,采用适配器模式来标准化各服务商之间的请求和响应格式,这样你就可以根据可用性、成本和质量要求实时路由流量。从一开始就实施多服务商策略还能在你的用量增长时给予你谈判筹码,因为你可以根据哪个平台为你的特定内容类型提供最佳的价格、可靠性和质量组合,有理有据地在不同平台之间转移流量。已经部署了多服务商架构的团队报告称,与单一服务商方案相比,有效成本降低了15-25%,可用性达到99.5%以上,因为特定服务商的故障不再阻塞他们的整个流水线。

成本优化——聚合服务与智能策略

除了选择最低的每秒费率之外,还有多种策略可以在生产环境中显著降低你的视频生成成本。对许多开发者来说,最具影响力的优化是使用API聚合服务——通过单一接口访问多个视频生成模型,结合智能路由根据你的具体需求为每个请求选择最具性价比的模型。其他策略包括优化提示词以提高首次成功率、缓存已生成的视频以供复用,以及分级质量选择——用较便宜的模型生成预览版本,将高端模型留给最终渲染。

API聚合服务已经成为需要访问多个视频生成平台的团队的实用解决方案。与其分别管理 Sora 2、Veo 3.1 和 Seedance 2.0 的API密钥、计费账户和SDK集成,聚合服务提供统一的端点,将你的请求路由到相应的底层API。对于需要批量生成或生产使用的开发者,laozhang.ai 通过统一的API提供 Sora 2 和 Veo 3.1 的访问。以 Sora 2 为例:720p(10-15秒视频)的单次请求定价从 $0.15/次起,1080p Pro 质量为 $0.80/次。Veo 3.1 方面,快速模式为 $0.15/次,标准模式为 $0.25/次。关键优势在于失败不收费策略——无论是内容审核拒绝了你的提示词还是生成超时,你都不会被收费。仅这一项策略就能比官方API节省总视频生成预算的10-15%,因为官方API中失败的生成仍然会消耗积分或产生费用。你也可以通过各种聚合服务对比来寻找最便宜的 Sora 2 API 访问方式。

python# Unified aggregator integration — access Sora 2, Veo 3.1, and more # through a single OpenAI-compatible endpoint from openai import OpenAI client = OpenAI( api_key="your_laozhang_api_key", base_url="https://api.laozhang.ai/v1" ) # Generate with Sora 2 sora_response = client.chat.completions.create( model="sora-2", # Switch to "veo-3.1-fast" for Veo 3.1 messages=[{ "role": "user", "content": "A time-lapse of a flower blooming in morning light" }], stream=True ) # Same endpoint, different model — no SDK changes needed veo_response = client.chat.completions.create( model="veo-3.1-fast", messages=[{ "role": "user", "content": "A chef preparing sushi with precise movements, ambient sounds" }], stream=True )

除了聚合服务之外,提示词工程是第二大最有效的成本优化策略。精心编写的提示词能够清楚描述场景、镜头角度、光线和运动风格,可以实现更高的首次成功率,减少昂贵的重新生成。根据生产经验,在提交生成请求之前花5-10分钟优化提示词,可以将成功率从70%提升至90%以上,这直接转化为三个平台上每个视频有效成本降低20-25%。聚合服务的详细集成文档可在 docs.laozhang.ai 查阅。

应该选择哪个API?——决策框架

在深入分析了定价、集成复杂度、生产约束和优化策略之后,最终的决策归结于你的具体项目需求。与其给出含糊的"视情况而定"式结论,不如直接提供一个基于五种常见开发者场景的明确推荐框架。如果想了解更广泛的视角,包括这三个之外的其他平台,我们的主流AI视频模型全面对比覆盖了完整的市场格局。

如果你需要音频,选择 Veo 3.1。 这是整个对比中最简单的决策点。截至2026年3月,Veo 3.1 是三个API中唯一能在生成视频的同时生成同步音频的。如果你的项目需要声音——带配音的产品演示、带音乐的社交媒体内容、带自然环境音的场景——Veo 3.1 省去了单独的音频生成和同步流水线。你为带音频生成支付的溢价(标准1080p视频+音频 $0.40/秒 vs Sora 2 720p纯视频 $0.10/秒)远低于在后期处理中添加音频所需的工程和计算成本。8秒的最长时长限制是主要短板,但对于短视频内容、社交媒体片段和产品展示来说,通常已经足够。

如果你需要逼真的运动效果,选择 Sora 2。 Sora 2 的物理模拟引擎在三者中产生最自然的运动效果,尤其是涉及水流、织物、头发和复杂物体交互的场景。20秒的最长时长也是三者中最长的,使其成为需要长镜头的叙事内容的最佳选择。OpenAI SDK 集成意味着已经在使用 GPT-4 或 DALL-E 的团队可以用最少的新基础设施将视频生成添加到技术栈中。标准层级 720p $0.10/秒提供了便于入手的起点,专业层级 1080p $0.50/秒则能提供广播级质量的输出。

如果预算是你的首要考量,选择 Seedance 2.0。 720p基础版约 $0.06/秒的价格,Seedance 2.0 比 Veo 3.1 或 Sora 2 最便宜的层级都低约40%。其角色一致性功能也相当出色,使其成为需要同一角色在多个视频中反复出现的动画内容系列的理想选择。但代价也是实实在在的:没有官方API意味着依赖第三方服务商,文档不够完善,可用性可能不稳定。对于成本效益重于官方支持和有保障的SLA的项目来说,Seedance 2.0 提供了强大的价值。

如果你需要灵活性,选择聚合服务。 对于将在不同质量要求下生成数千个视频的生产系统,锁定单一API是一种战略风险。使用聚合服务可以让你将简单的预览生成路由到最便宜的可用模型,将高端电影级内容路由到 Sora 2 Pro,将需要音频的内容路由到 Veo 3.1,所有这些都通过单一的API集成实现。这种方案还通过在各服务商之间提供自动故障转移,来防范平台故障、价格变动和速率限制约束。

如果你在做原型验证,从最便宜的选项开始。 对于你还在摸索AI视频生成是否适合你产品的早期项目,从 Sora 2 标准层级 $0.10/秒或 Veo 3.1 快速模式 $0.10/秒开始。两者都通过各自的平台(OpenAI 和 Google AI Studio)提供免费层级访问,让你在投入预算之前验证使用场景。一旦你验证了产品与市场的契合度并了解了你的生成量级,再迁移到最符合你生产需求的平台。

底线是:没有任何单一API在所有维度上都是赢家。2026年的视频生成API市场之所以健康,恰恰是因为每个平台都开辟了独特的细分领域。你的选择应该由产品需求驱动,而不是由哪个API的标题价格最低来决定,因为当你将集成工作量、失败率和应用程序所需的特定功能纳入考量后,最低的每秒费率往往不等于最低的总拥有成本。如果你在考虑完这些建议后仍然不确定,最安全的起点是使用一个能让你访问所有三个API的聚合服务,这样你可以用实际内容进行真实的A/B测试,然后再决定锁定哪个平台。

常见问题解答

Sora 2 API 是公开可用的,还是需要特殊权限?

是的,截至2026年初,Sora 2 API 已通过 OpenAI 的标准API平台公开可用。你需要一个绑定了有效支付方式的 OpenAI API 账户,视频生成功能不需要单独排队等待。API 通过与 GPT-4 和 DALL-E 相同的认证流程访问,按生成视频的秒数计费。速率限制根据你的账户层级扩展,因此新账户从较低的限制开始,随着使用历史的积累逐步提升。所有三个模型变体(sora-2、720p的 sora-2-pro 和 1080p 的 sora-2-pro)对所有付费API用户开放,无需额外审批。

用每个API生成一分钟的视频要花多少钱?

以最便宜的可用层级计算,一分钟视频的成本大约为:Sora 2 约 $6.00(720p $0.10/秒)、Veo 3.1 快速模式约 $6.00(720p纯视频 $0.10/秒)、Seedance 2.0 约 $3.60(720p基础版约 $0.06/秒)。但这些数字假设的是单个连续片段,而目前没有任何API支持这一点——Veo 3.1 最长8秒,Seedance 2.0 最长15秒,Sora 2 最长20秒。生成一分钟的视频需要将多个片段拼接在一起,这意味着根据片段长度需要3-8次单独的API调用,每次都有自己的成功率开销。考虑失败和重新生成后,一分钟可用视频内容的实际成本大约是:Sora 2 约 $8-$12,Veo 3.1 快速模式约 $8-$12,Seedance 2.0 约 $5-$7。

从中国境外能否访问 Seedance 2.0 API?

截至2026年3月,Seedance 2.0 没有官方的国际API。字节跳动的主要访问渠道是即梦平台(jimeng.jianying.com),该平台面向中国市场用户设计,注册需要中国手机号。国际开发者可以通过已构建代理集成的第三方API服务商访问 Seedance 2.0,包括 fal.ai 等平台以及各种聚合服务。这些服务商处理底层的访问问题,并暴露一个标准的 REST API,可从任何地理位置使用。代价是你需要依赖第三方服务商的可用性和定价,而不是直接与字节跳动打交道。

哪个API的图生视频能力最强?

三个API都支持图生视频功能,但实现方式各不相同。Veo 3.1 提供了最灵活的图生视频系统,其独特的"首尾帧"模式允许你同时提供起始图和结束图,模型会在两者之间生成平滑的过渡。这对于产品可视化和动画工作流特别有用。Sora 2 支持单张参考图输入来引导视频生成,生成的结果会紧密遵循输入图片的风格和构图。Seedance 2.0 具有多模态参考系统,可以接收角色参考图以在多次视频生成中保持一致性,是需要持久角色身份的项目的最佳选择。

视频生成失败时会被收费吗?

各平台对失败的收费政策差异显著。OpenAI 的 Sora 2 API 按输出视频时长计费,因此如果生成在产生输出之前就失败了,通常不会收费,但在生成过程中发生的内容审核拒绝仍可能消耗部分配额。Google 的 Veo 3.1 通过 Vertex AI 遵循类似的模式,你只为成功的输出付费。Seedance 2.0 的第三方服务商在失败策略上各不相同。像 laozhang.ai 这样的聚合服务明确提供异步API端点的失败不收费保证,这意味着无论失败原因是什么——包括内容审核拒绝和超时——你只为成功生成的视频付费。这一策略差异在失败率不可忽视的生产环境中可以节省总成本的10-15%。