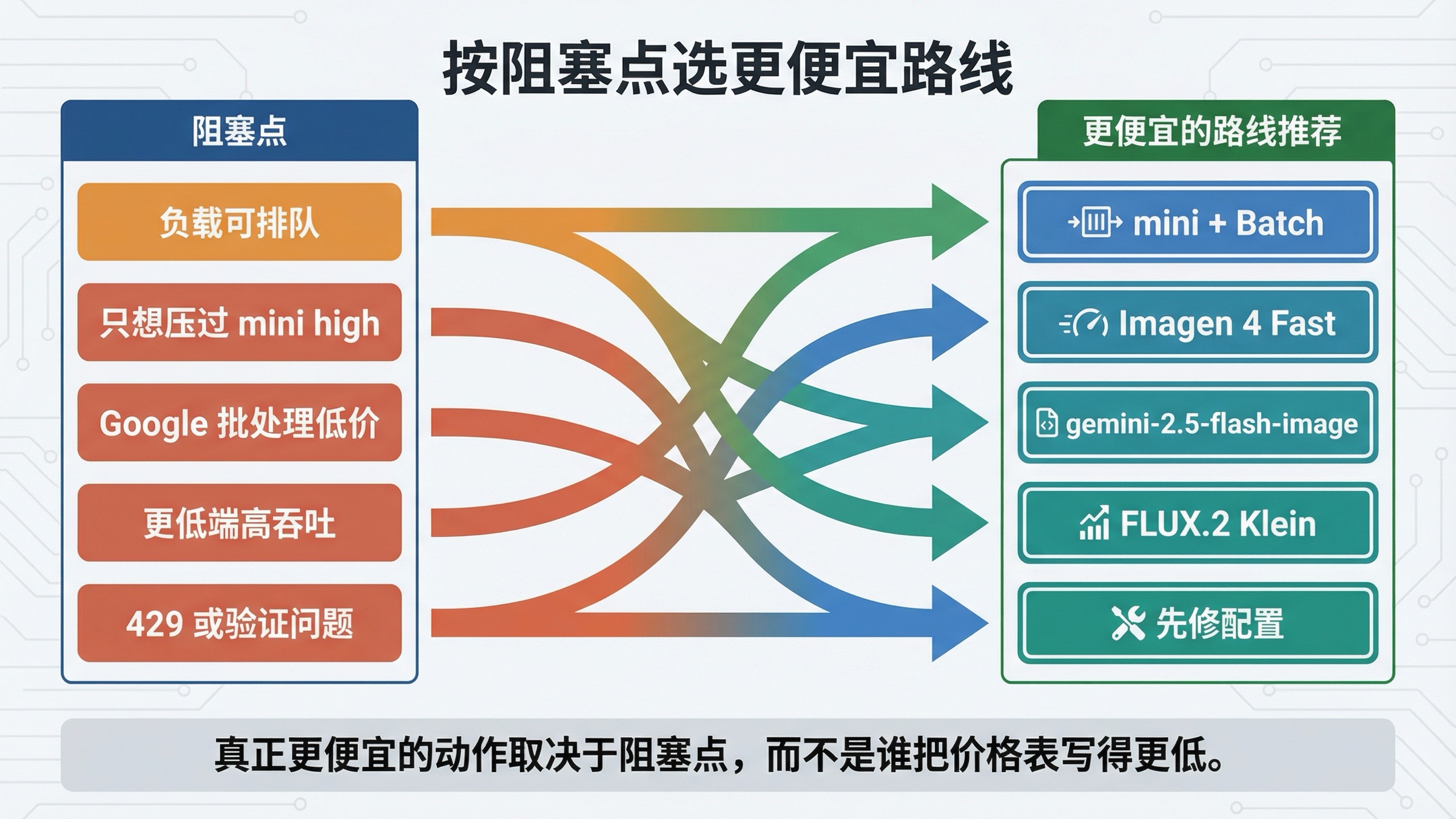

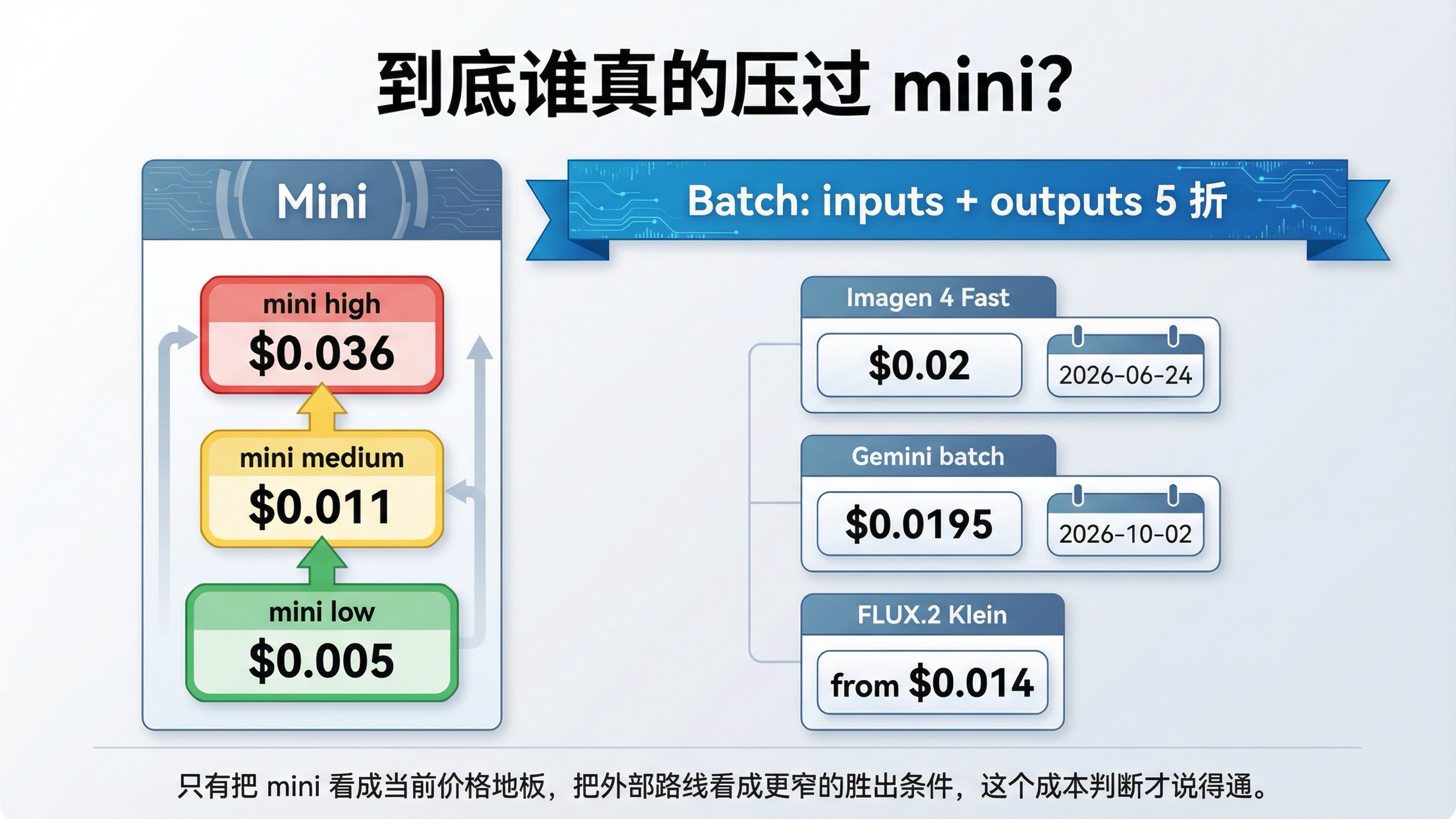

截至 2026 年 3 月 29 日,没有哪条主流托管 API 能稳定压过 gpt-image-1-mini 当前的 low 和 medium 两档价格。 OpenAI 当前的 gpt-image-1-mini 模型页 仍把 1024x1024 正方形输出列为 low \$0.005、medium \$0.011、high \$0.036。这意味着对大多数搜索“gpt-image-1-mini 更便宜替代方案”的人来说,第一步通常不是换供应商,而是继续留在 mini,并先测试 Batch。

这也是当前 SERP 最容易答偏的地方。很多价格表会告诉你 Imagen 4 Fast 是 0.02、gemini-2.5-flash-image batch 是 0.0195、FLUX.2 Klein 起步是 0.014 到 0.015。但它们通常不会顺手说明,这些数字到底是比 mini 整体更便宜,还是只是比 mini high 更便宜,或者只是因为工作本身变成了更低端、更高吞吐、寿命更短的路线,才看起来更低。

还有一类搜索,其实不是真的在找更便宜的模型,而是在找更便宜的工作方式。OpenAI 当前的 API Pricing 已经明确写了 Batch API 对 inputs 和 outputs 统一打 5 折。所以如果你的负载本来就能异步排队,真正该先比较的不是“换哪家”,而是“同样的 mini,live 和 Batch 之间差多少”。如果你的痛点其实是质量、字体、编辑能力,而不是价格,那更合适的下一篇应当是 GPT Image 1 Mini 替代方案,而不是这篇价格页。

要点速览

如果你只想先拿到结论,先看这张表。

| 你真正想要的是…… | 当前最可信的更便宜路线 | 价格锚点 | 为什么它成立 | 主要代价 |

|---|---|---|---|---|

| 保住 OpenAI 当前最低图像成本 | 继续用 gpt-image-1-mini | \$0.005 / \$0.011 / \$0.036 | mini 本身就是 OpenAI 现在的成本档 | 你继续承担 mini 的质量上限 |

| 不换模型继续降本,而且负载可以排队 | mini + Batch | OpenAI 写明 Batch 对 inputs 和 outputs 打 5 折 | 最先该省的是工作方式,不一定是模型 | OpenAI 没有单独公布 mini 的 Batch 每图卡价,而且 Batch 是异步 |

| 只是想压过 mini high 的价格 | Imagen 4 Fast | \$0.02/张 | 它确实低于 mini high 的 0.036 | 仍高于 mini low 和 medium,且 Google 列出 2026-06-24 关停日期 |

| 想拿到 Google 当前最低图像价 | gemini-2.5-flash-image batch | \$0.0195/张 | 它是 Google 当前公开的更低图像行 | 仍高于 mini low 和 medium,且 Google 列出 2026-10-02 关停日期 |

| 接受更低端、更高吞吐的外部路线 | FLUX.2 Klein | 从 \$0.014 到 \$0.015 起 | 在部分低端场景下可压过 mini high | 按 megapixel 计费,且不是一条等价的 GPT Image 替代路线 |

| 现在真正卡住的是 429、验证或 tier | 先留在 OpenAI 修配置 | 不需要换模型 | 这类问题不是“更便宜模型”能直接解决的 | 你仍要先把路由跑通 |

最短的判断规则就是一句话:比 mini high 更便宜,不等于比 mini 整体更便宜。

为什么 mini 已经是当前价格地板

这篇文章最重要的,不是再抄一遍别家价格,而是先搞清楚 mini 到底是什么。

OpenAI 当前的 models catalog 仍把图像家族讲得很清楚:GPT Image 1.5 是 state-of-the-art image generation model,GPT Image 1 是 previous image generation model,而 gpt-image-1-mini 是 cost-efficient branch。也就是说,mini 不是一个被遗忘的旧模型,而是 OpenAI 当前公开、明确、仍在维护的预算路线。

这会直接改变“更便宜替代方案”这个问题。因为只要你还在 mini low 或 medium 这一侧,大多数外部路线都不是真的更便宜。Google 的 0.02 和 0.0195 看起来很诱人,但它们打败的是 mini high 的 0.036,不是 mini low 的 0.005,也不是 mini medium 的 0.011。如果你原本就不该跑 high,这个所谓的外部低价就没有你想象中那么强。

更关键的是 Batch。OpenAI 的 API Pricing 页面已经写明,Batch 对 inputs 和 outputs 统一打 5 折,而 mini 模型页又明确暴露了 Batch 端点。OpenAI 并没有再单独给一张“mini Batch 每张图多少钱”的卡,所以这里最稳妥的说法是:Batch 是一条先做实验的降本路线,而不是一个单独固定的新价格标签。 但这已经足够改变读者的下一步动作了。只要你的工作负载能容忍异步,先测 mini + Batch,比先迁移到别家更合理。

同样也要避免被旧路线误导。OpenAI 当前的 image generation guide 已经说明 DALL-E 2 和 DALL-E 3 将在 2026-05-12 停止支持请求。也就是说,哪怕你在别处看到旧卡价更便宜,也不该把它当成今天这篇文章里的默认答案。

如果你想继续看 OpenAI 内部的更大成本图谱,可以接着读 OpenAI 图像生成 API 更便宜的替代方案;如果你只想看 mini 自己的官方价格拆分,则去看 GPT Image 1 Mini 定价 更快。

把这些路线放到一张表里,结论会更清楚:

| 路线 | 当前公开价格面 | 它真正打败了谁 | 主要 caveat |

|---|---|---|---|

| mini live | \$0.005 / \$0.011 / \$0.036 | OpenAI 内部当前地板 | 仍然是你现在的质量上限 |

| mini + Batch | inputs + outputs 5 折 | 可能是同一模型下最便宜的工作方式 | OpenAI 没有单独公布 mini 的 Batch 每图卡价 |

| Imagen 4 Fast | \$0.02/张 | mini high | 2026-06-24 关停日期 |

gemini-2.5-flash-image batch | \$0.0195/张 | mini high | 2026-10-02 关停日期 |

| FLUX.2 Klein | 从 \$0.014 / \$0.015 起 | 部分更低端的 mini-high 比较 | 按 megapixel 计费,且工作形态不同 |

这张表本身就是这篇文章的核心价值。

Google 什么时候才是真的更便宜

Google 在这篇文章里重要,但重要的前提是不能把它说大。

最清晰的 Google 托管出图路线是 Imagen 4 Fast。Google 当前的 Gemini Developer API pricing 页面把它列成 \$0.02/张。如果你的比较基准是 mini high,而且你就是想找一条更简单的 Google 托管出图路线,那么 Imagen 4 Fast 确实是合理答案。

但这个答案必须和 caveat 放在同一段里。Google 当前的 deprecations page 也明确写了 imagen-4.0-fast-generate-001 的关停日期是 2026-06-24。这不意味着它今天不能用,而是意味着它更像一条短周期便宜路线,而不是你可以安心构建长期默认值的答案。

gemini-2.5-flash-image batch 更需要谨慎。Google 当前把它写成 \$0.0195/张,standard 则是 \$0.039/张。看起来 batch 很吸引人,因为它也能压过 mini high。但 Google 同样把它列入了 2026-10-02 的关停清单。也就是说,这是一条真实但有时钟的低价路线。

因此,这一节最该留下的读法只有三句:

- 如果你只是要打败 mini high,并想走 Google 托管出图,Imagen 4 Fast 成立。

- 如果你明确接受更短的寿命窗口,

gemini-2.5-flash-imagebatch 也成立。 - 它们都不是“整体比 mini 更便宜”。

只要这三句不被抹平,这篇文章就不会把 Google 说过头。

BFL 更便宜,是因为工作本身变了

Black Forest Labs 出现在这里,不是因为它给出了一个“和 mini 完全一样、但更便宜”的替身,而是因为它提供了一条更低端、更高吞吐的外部路线。

当前的 BFL pricing page 把 FLUX.2 [klein] 4B 列成从 \$0.014 起,把 FLUX.2 [klein] 9B 列成从 \$0.015 起。这的确意味着它在部分低端场景里能压过 mini high。

但这里的前提不能被省掉。BFL 自己也把 Klein 描述成 real-time、high-volume、balanced quality-speed 的路线。它更像一条更低端、更高吞吐的外部生成路线,而不是完整对标 GPT Image 家族行为的替身。也正因为如此,它的“更便宜”来自于工作本身换了,不只是价格数字换了。

同一页价格也顺手告诉我们什么不该放进这篇文章。FLUX.1 Kontext [pro] 是 0.04。 这说明即便 BFL 也不是所有路线都更便宜。Kontext 可能适合 edit-heavy workflow,但它并不属于“比 mini 更便宜”的默认答案,应该交给更广的 GPT Image 1 Mini 替代方案 去承接。

所以这节真正该记住的不是“FLUX 更便宜”,而是:只有当你愿意接受一条更低端、更高吞吐、按 megapixel 计费的外部路线时,FLUX.2 Klein 才是有意义的 cheaper alternative。

真正的问题是配置,而不是价格时怎么办

这类关键词里有很多搜索,看起来像“我觉得 mini 还不够便宜”,其实真正问题是权限和接入。

OpenAI 当前的 API Organization Verification 帮助页明确写到,organization verification 会解锁图像生成能力,而且不需要消费门槛,状态同步可能要 30 分钟,并且在“still not verified”时经常需要重新生成 API key。这里没有一句是价格信息,但它们会直接影响你是不是把成本问题看错。

OpenAI 社区里当前关于 gpt-image-1 rate limit without even generating a single image 的讨论,也在讲同一件事。很多用户在真正开始跑图之前,就被 429、付款状态、tier、key 之类的问题拦住了。那种体验当然会让人觉得“这个路线太贵”,但本质上它还是 setup friction。

因此,这一节必须保留一句非常直白的话:如果你的问题是 tier、verification、route 或 account state,先修这个,再讨论迁移。 否则你比较的根本不是成本,而是不同平台的故障体验。

如果你的目标是把 OpenAI 的图像调用先跑顺,下一篇更合适的是 OpenAI 图像 API 教程。

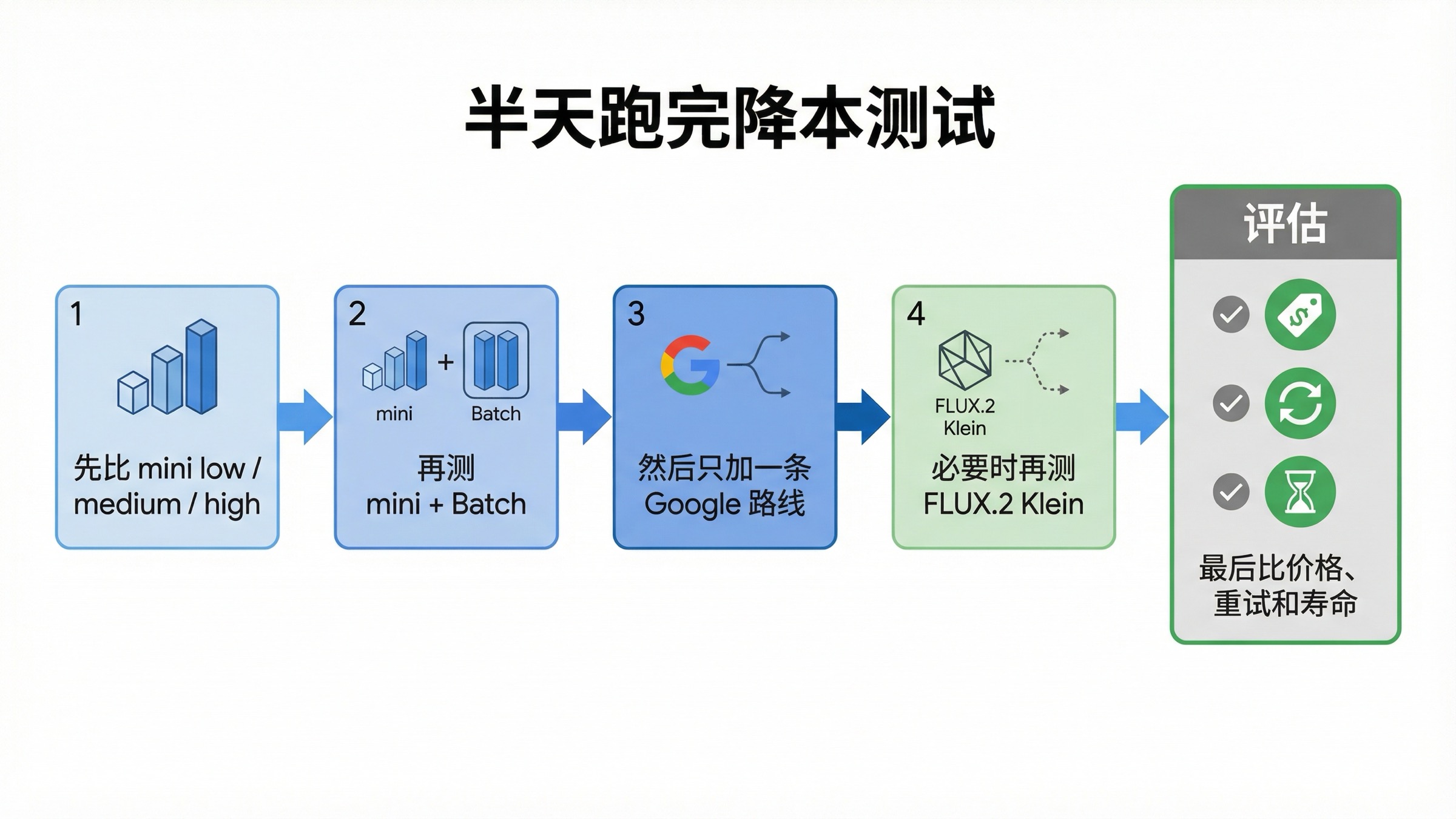

我会怎样用一个下午完成降本测试

不要从品牌开始测,要从你真正的成本问题开始测。

- 先跑 mini low、medium、high。如果你连自己当前该对标哪一档都没搞清楚,“更便宜替代方案”就会从第一步开始答错。

- 如果负载能异步,接着跑 mini + Batch。这通常是第一条真正有意义的降本路线,因为你还留在同一模型家族里。

- 再补一条 Google 路线,但只选一条。你如果关心的是 mini high 的价格压力,就比较 Imagen 4 Fast 或

gemini-2.5-flash-imagebatch,而不是两条都拉长对比。 - 只有当你真的接受更低端高吞吐路线时,才去测 FLUX.2 Klein。

- 最后比较的不该只是第一张图的价格,而是 一张真正能留下来的图,到底花了多少钱、重试了几次、这条路线还能用多久。

当前很多价格页只做到第一步,而真正能帮读者少走弯路的是第五步。

常见问题

现在真的有比 gpt-image-1-mini 整体更便宜的主流托管路线吗?

没有。当前能明显压过 mini 的路线,要么只赢 mini high,要么依赖 Batch,要么本身已经不是同一种工作形态。

如果我还是想继续用 mini,最先该怎么降本?

先确认 mini low 或 mini medium 能不能满足目标,然后测试 Batch。这通常比先迁移到外部供应商更像正确的第一步。

只看到 Google 价格更低,就应该立刻切过去吗?

不应该。Imagen 4 Fast 和 gemini-2.5-flash-image batch 现在都只是对 mini high 这一档看起来更便宜,而且两条路线在 Google 当前文档里都带着 2026 年的关停日期。

结论

gpt-image-1-mini 的更便宜替代方案,并不是一个新的统一赢家。

如果你只是想继续降本,先留在 mini,并测试 Batch。如果你比较的是 mini high,Google 的低价行才开始有意义;如果你愿意接受更低端、更高吞吐的外部路线,FLUX.2 Klein 才会变成真正的便宜选项;如果你现在主要被验证、tier 或 route 卡住,先修配置,而不是先迁移。

这才是当前 SERP 还没有讲透的地方:mini 本身已经是价格地板。真正要做的,不是急着“找一个更便宜模型”,而是先分清你到底是在降模型成本、降工作流成本,还是只是把配置问题误看成了价格问题。