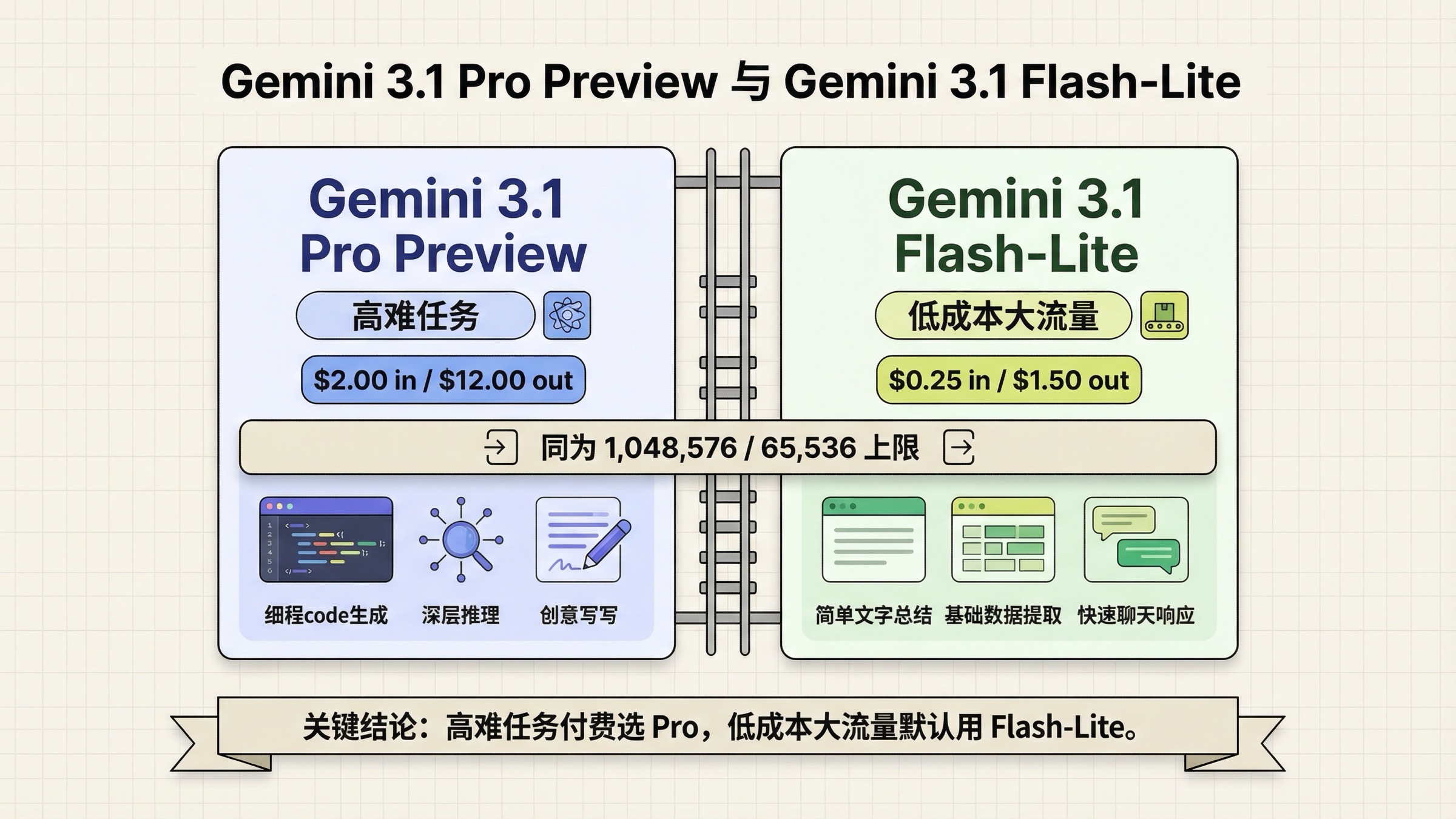

当工作负载真的困难、对工具敏感,而且工程强度高时,才为 Gemini 3.1 Pro Preview 付费;对于不需要 Pro 级推理的高吞吐、低延迟、强成本敏感任务,默认应选 Gemini 3.1 Flash-Lite。

这首先是一道路由题。Pro 不是一句“benchmark 更高”就能概括,Flash-Lite 也不是便宜版复制品。它们服务的是不同生产路线,答案取决于你实际需要哪一条。

要点速览

如果你只想看决策,可以直接用这条规则:

- 高难 Agent、软件工程、工具敏感型任务,用 Gemini 3.1 Pro Preview。

- 翻译、抽取、分类、轻量路由、高并发异步队列,用 Gemini 3.1 Flash-Lite。

- 如果流量是混合型,不要单选,应该分流。

截至 2026 年 3 月 20 日,官方对比如下:

| 维度 | Gemini 3.1 Pro Preview | Gemini 3.1 Flash-Lite | 含义 |

|---|---|---|---|

| 当前状态 | Preview | Preview | 两者都不是“绝对稳定的 GA 默认盘” |

| 免费层 | 无 | 有 | Flash-Lite 更适合测试、预发与低风险实验 |

| 标准输入价格 | $2.00 / 1M tokens | $0.25 / 1M tokens | Pro 输入价格是 Flash-Lite 的 8 倍 |

| 标准输出价格 | $12.00 / 1M tokens | $1.50 / 1M tokens | 输出价格同样相差 8 倍 |

| Batch 价格 | $1.00 in / $6.00 out | 免费层,之后 $0.125 in / $0.75 out | Flash-Lite 更适合高并发异步量 |

| 输入上限 | 1,048,576 tokens | 1,048,576 tokens | 上下文窗口不是决策重点 |

| 最大输出 | 65,536 tokens | 65,536 tokens | 输出上限也不是重点 |

| Tier 1 Batch 队列上限 | 5,000,000 tokens | 10,000,000 tokens | Flash-Lite 在大队列场景更友好 |

| 最适合 | 高难 Agent、软件工程、复杂工具调用 | 翻译、抽取、分类、轻量代理、高并发默认流量 | 这才是真正的分工 |

上面的结论主要来自 Google 官方 pricing、Gemini 3.1 Pro Preview 模型页、Gemini 3.1 Flash-Lite 模型页、公开 rate limits 页面,以及两张 DeepMind 模型卡:Gemini 3.1 Pro 与 Gemini 3.1 Flash-Lite。

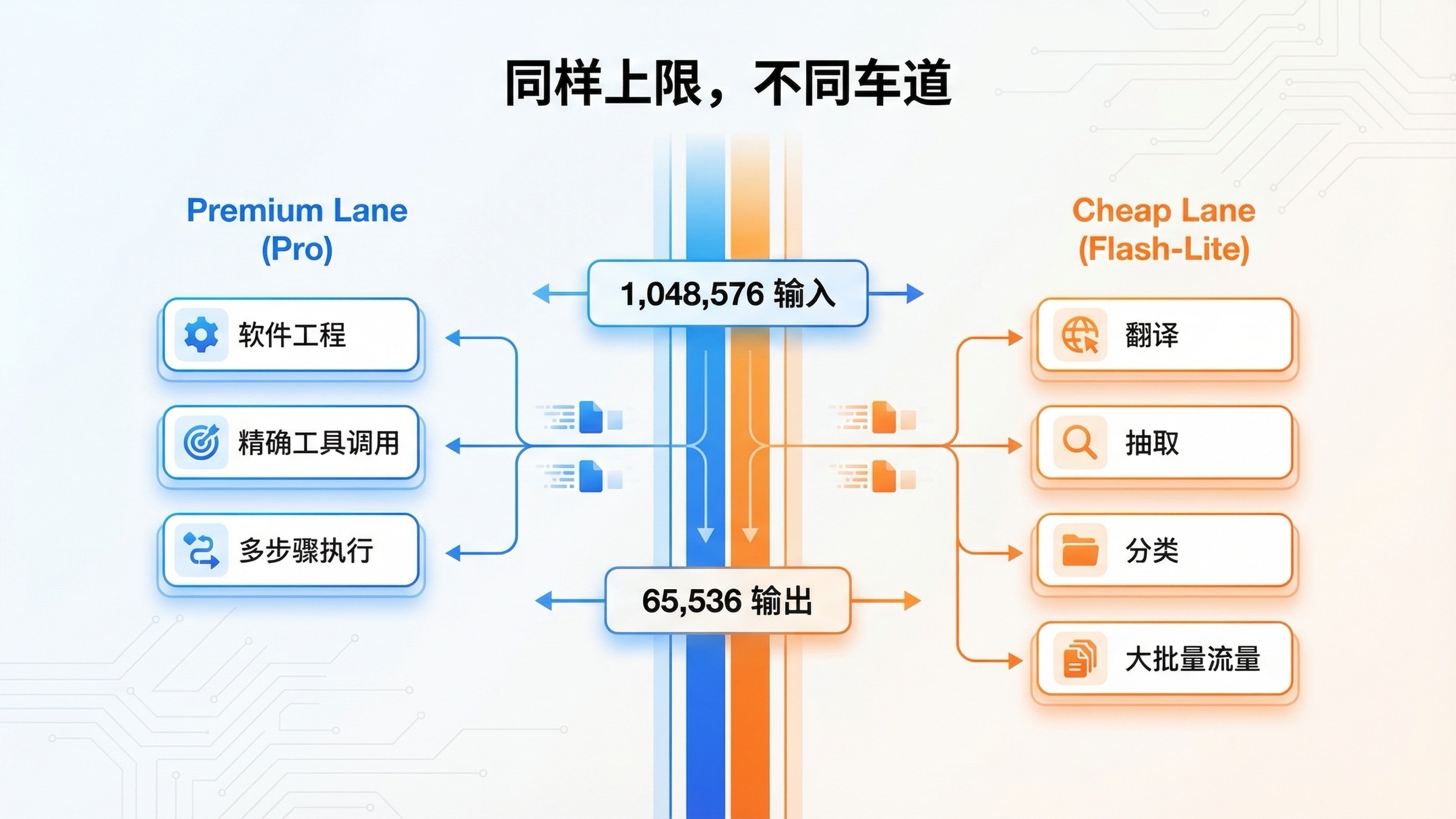

为什么这不是上下文窗口之争,而是路由之争

这组对比里最容易犯的错误,是把它理解成“既然 Pro 更强,就应该默认全量用 Pro”,或者反过来理解成“既然 Flash-Lite 只是 Lite,那肯定只是缩水版”。官方文档都不支持这种偷懒判断。

先看相同点。当前两张模型页都写得很清楚:两者都是 1,048,576 input tokens、65,536 output tokens。也就是说,你不是在做“谁上下文更大”的选择,也不是在做“谁输出更长”的选择。很多比较页面会让人误以为 Pro 的价值来自这些上限,但这一组并不是这样。

真正的区别在于:你为更贵的模型买到了什么,又为更便宜的模型放弃了什么。

Gemini 3.1 Pro Preview 模型页 强调的关键词是:更好的思考质量、更高 token 效率、更强事实一致性、更好的软件工程行为、可靠多步执行、精准工具使用。这是一条高端车道的表达方式。它面对的是“答错一次就可能连锁失败”的工作流。

Gemini 3.1 Flash-Lite 模型页 强调的则是:高频轻量任务、简单数据抽取、翻译、分类、低延迟应用和高并发代理工作。这不是弱化版 Pro,而是一条完全不同的优化目标。

所以你真正应该问的是:

- 哪些任务确实需要更强推理与更稳的工具行为?

- 哪些任务天然就是便宜车道工作,不值得为 Pro 付 8 倍 token 价格?

- 你的流量到底是纯一种,还是应该默认用 Flash-Lite,再把最难请求升级到 Pro?

只要把问题这样问,后面的价格、限额与工作负载建议就都通了。

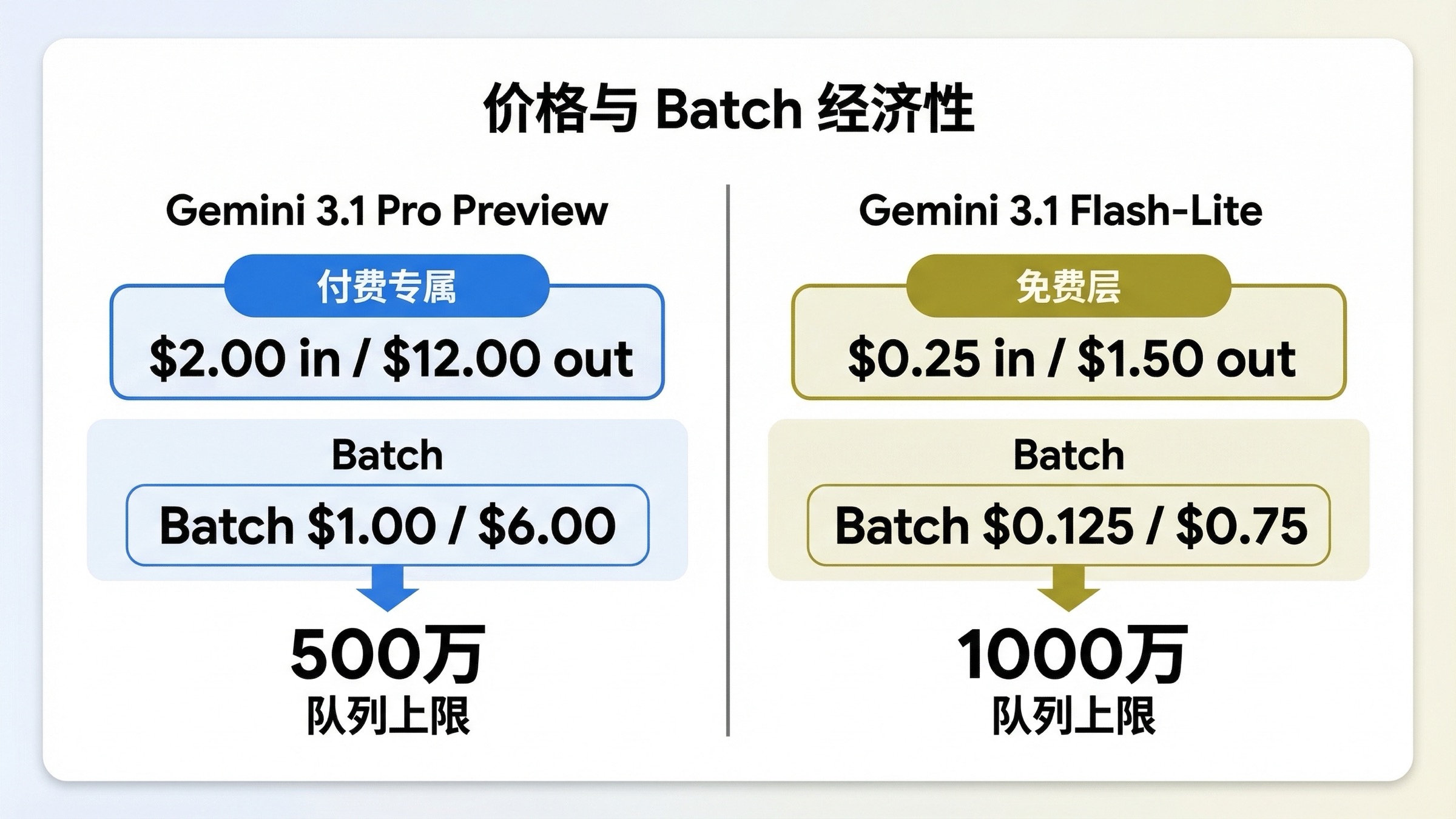

截至 2026 年 3 月 20 日的价格、Batch 经济性与公开限额现实

价格是这篇文章里最不该被“语气词”盖过去的部分,因为它直接决定默认盘应该放哪边。

在当前官方 pricing 页面 上,Gemini 3.1 Pro Preview 没有免费层。200k prompt tokens 以内,输入价格是 $2.00 / 1M tokens,输出价格是 $12.00 / 1M tokens。超过 200k prompt 之后,价格提高到 $4.00 input 和 $18.00 output。Batch 价格打五折,但即便如此,也仍然是 $1.00 input、$6.00 output 的级别。

Flash-Lite 的世界完全不同。它保留免费层,标准价格只有 $0.25 input 和 $1.50 output。Batch 进一步便宜到 $0.125 input 和 $0.75 output。这不是“小幅优惠”,而是非常明确的成本分层。

换句话说,Pro 相比 Flash-Lite 的标准输入和输出价格,都是 8 倍。这会直接改变你的默认盘选择逻辑。只有当 Pro 明显减少返工、减少错误工具调用、减少人工复核时,这种价格差才站得住。如果只是普通翻译、普通抽取、普通模板生成,那么 Pro 往往付出了远高于收益的代价。

公开限额页给出的信号也一致。当前 rate limits 页面 已经不再为所有模型提供一张静态 RPM/TPM 总表,而是引导用户去 AI Studio 查看实际可用值。因此,写文档时不应该伪造一个“固定公开 RPM 结论”。但这个页面仍然给出非常有用的一项:Tier 1 Batch enqueued token 上限。

这里 Google 当前公开列出:

- Gemini 3.1 Pro Preview:5,000,000

- Gemini 3.1 Flash-Lite:10,000,000

这个差距对很多真实系统非常重要,因为很多生产流量不是交互式聊天,而是后台任务:

- 批量翻译

- 文档抽取

- 分类与标注

- 大规模总结

- 异步路由

对于这种工作,Flash-Lite 不仅更便宜,公开队列上限也更友好。

grounding 方面也不要误判。当前价格页给两者都列出了 每月 5,000 个免费 grounding prompts,之后 Search 或 Maps 都按 $14 / 1,000 queries 计费。所以不要把 Pro 想象成“工具侧更划算”的那个,它在当前公开页面上也不是这样。

因此,价格与公开限额一起指向同一个结论:只要你的任务属于便宜车道工作,就不该默认走 Pro。

Gemini 3.1 Pro Preview 什么时候真的值这个价

如果把这篇文章写成“便宜模型永远更划算”,那也是误导。因为确实存在一批工作,Pro 的溢价是能自我回本的。

Gemini 3.1 Pro Preview 模型页 把重点写得很清楚:软件工程、可靠多步执行、精准工具调用。官方 Gemini 3.1 Pro 模型卡 发布于 2026 年 2 月 19 日,并把 Pro 描述为当时 Google 面向复杂任务的最先进模型之一,同时给出了更强的高难 benchmark 信号,包括 Humanity's Last Exam、GPQA Diamond、Terminal-Bench 2.0、SWE-Bench Verified、APEX-Agents 等。

这些 benchmark 当然不能被偷换成“你的业务一定同比例提升”,但方向性已经足够明确:如果任务本身足够难,Pro 真的更有可能值回票价。典型场景包括:

- 多步 Agent 规划

- 工具调用链复杂、失败成本高的流程

- 软件工程任务

- 一次错误会带来长链返工的场景

- 人工审核昂贵、首答质量决定总成本的场景

还有一个实际工作流信号值得提一下:官方 Pro 文档里单独暴露了 gemini-3.1-pro-preview-customtools 这一类面向 bash 与自定义工具混合工作流的端点。这不是说所有代理都必须上 Pro,但它说明 Google 自己也把 Pro 放在了更重的工具工作流里。

社区信号也和这个方向一致。像 Reddit 上那条 "I had to switch to 3.1 Pro Preview Custom Tools for my Agent" 这样的讨论,不能当作平台规范引用,但它很好地说明了一件事:搜索这个关键词的人,很多时候不是在看热闹,而是在解决真正的工具行为问题。

所以 Pro 的正确定位不是“更新就默认切过去”,而是:

当错误答案的成本显著高于 token 成本时,才让 Pro 上场。

这句话比“Pro 更强”更可执行,也更接近生产系统的真实决策方式。

Gemini 3.1 Flash-Lite 为什么应该继续做默认便宜车道

Flash-Lite 最容易被低估的原因,是很多模型对比内容默认把“高 benchmark = 更值得默认”。但 Google 当前的官方表述不是这个逻辑。它并没有把 Flash-Lite 当作“可有可无的缩水版”,而是非常明确地把它定位成成本效率最优的工作模型。

Gemini 3.1 Flash-Lite 模型页 和 Gemini 3.1 Flash-Lite 模型卡 共同强调的任务类型包括:

- 翻译

- 分类

- 简单抽取

- 低延迟场景

- 高频调用

- 大型异步队列

- 轻量代理

这其实已经覆盖了大量真实生产流量。

如果你的系统大多数请求是结构明确、输出受限、错误代价有限的工作,那么 Flash-Lite 不只是“便宜一点”,而是“在这个工作类型里更合理”。因为你根本不需要为 Pro 的高端能力付费。对抽取、分类、轻量翻译、模版化总结这类任务而言,很多时候 Pro 不是更优,而是更奢侈。

免费层也是重要现实。对很多团队,免费层不是“省试玩钱”,而是保留一个低摩擦验证车道:

- prompt 模板试验

- 预发 smoke test

- 路由逻辑验证

- 小流量监控

这在工程流程上非常实用。一个保留免费层的便宜模型,能让你更低成本地维护系统健康;一个付费独占高端车道,则更适合承担那些已经被证明值得花钱的请求。

所以我不会把 Flash-Lite 描述成“预算不足时才用的方案”。更准确的说法是:只要任务本来就属于便宜车道工作,Flash-Lite 就是正确模型。

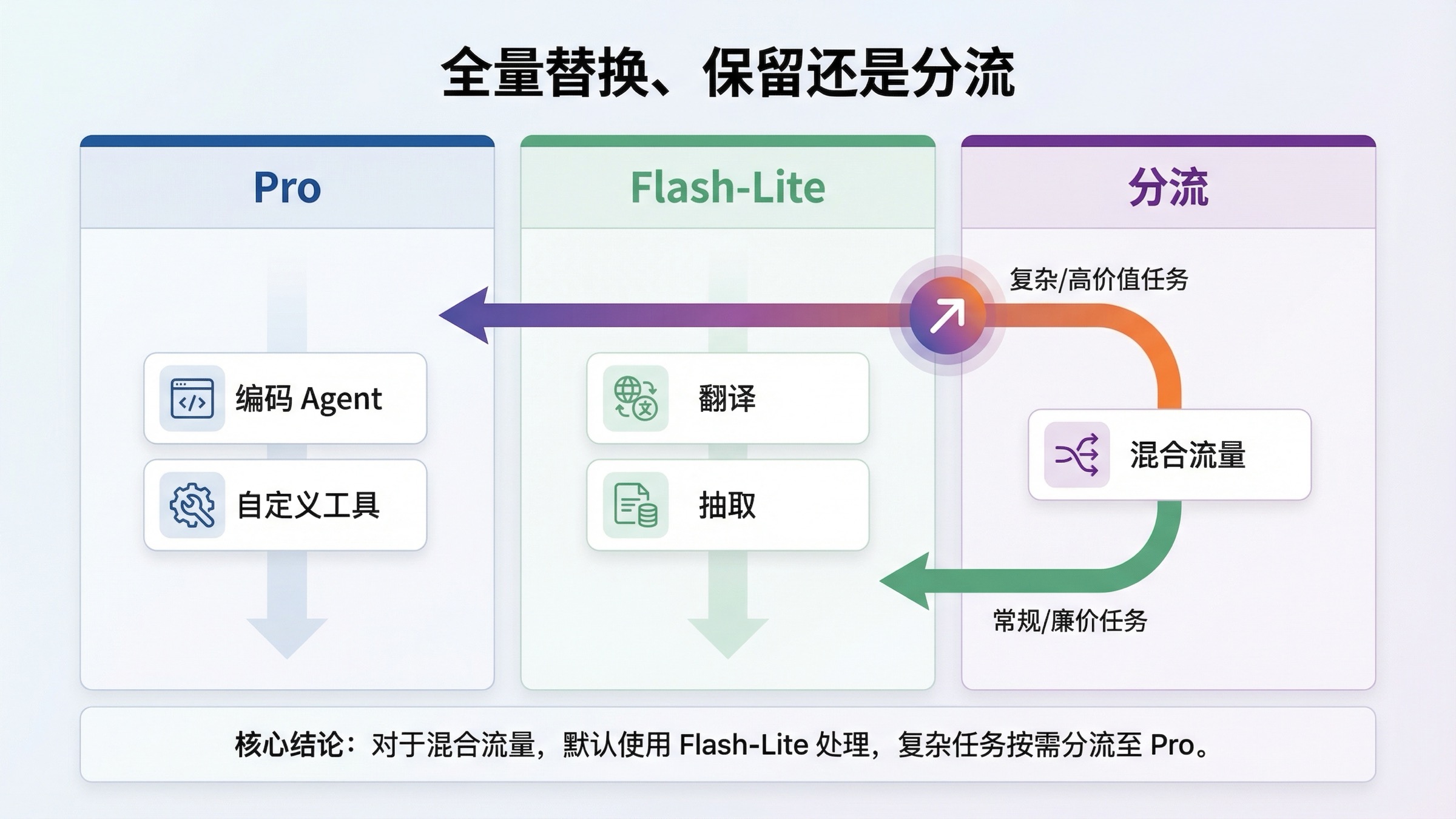

该全量替换、继续保留,还是双模型分流?

对多数认真跑生产流量的团队来说,答案都不应该是极端单选。

如果你把所有流量都切到 Pro,通常会为大量普通工作多付钱;如果你把所有流量都压到 Flash-Lite,又容易在最难任务上吃亏。真正更稳的答案,是分流。

可以直接按这张思路执行:

| 工作负载 | 更适合的默认模型 | 原因 |

|---|---|---|

| 工具链复杂的编码 Agent | Gemini 3.1 Pro Preview | 多步执行与软件工程行为更关键 |

| 自定义工具编排 | Gemini 3.1 Pro Preview | Pro 的工具工作流定位更明确 |

| 大规模翻译 | Gemini 3.1 Flash-Lite | 成本与并发更优 |

| 结构化抽取与标注 | Gemini 3.1 Flash-Lite | 典型便宜车道工作,不值得为 Pro 付 8 倍价格 |

| 大型异步队列 | Gemini 3.1 Flash-Lite | Batch 价格和公开队列上限更友好 |

| 混合型生产流量 | 分流 | Flash-Lite 走默认,困难请求升级到 Pro |

实操上建议分三步:

- 新的高并发默认流量先落到 Flash-Lite。

- 只在最难、最贵的工作上测试 Pro,例如高难编码、复杂工具调用、多步任务。

- 如果 Pro 的质量提升确实能抵消成本,再为这些流量单独开高端车道。

这比“Pro 负责质量,Lite 负责便宜”那种空话更能落地。真正可执行的规则是:

便宜车道工作默认给 Flash-Lite;只有当更强答案带来的收益大于 token 溢价时,才把请求升级到 Pro。

如果你还想看 Flash-Lite 和另一条快速高能力车道的关系,可以继续读我们的 Gemini 3.1 Flash-Lite vs Gemini 3 Flash 对比。如果你想看 Pro 与更稳定老牌高端车道之间怎么选,可以读 Gemini 3.1 Pro vs Gemini 2.5 Pro 对比。

FAQ

Gemini 3.1 Pro Preview 一定比 Gemini 3.1 Flash-Lite 更好吗?

如果任务很难、需要软件工程能力、需要更稳的工具行为,那是的;但这不等于它适合做所有请求的默认盘。对于大量便宜车道工作,Flash-Lite 反而是更合理的默认模型。

谁更便宜?

Flash-Lite 明显更便宜。按 2026 年 3 月 20 日官方价格页,Pro 是 $2.00 input / $12.00 output,Flash-Lite 是 $0.25 input / $1.50 output,标准价格差是 8 倍。

两者 token 上限一样吗?

一样。当前模型页都写的是 1,048,576 input tokens 和 65,536 output tokens。这也是为什么本文一直强调这不是上下文窗口之争。

做编码 Agent 应该选谁?

如果 Agent 工具调用复杂、一步错会连锁失败,优先从 Pro 开始。如果只是轻量自动化或简单代码辅助,先用 Flash-Lite 做基线更合理。

做翻译或抽取应该选谁?

绝大多数高并发翻译、分类、抽取场景,Flash-Lite 都更适合。官方定位、价格结构和 Batch 队列上限都在支持这个判断。