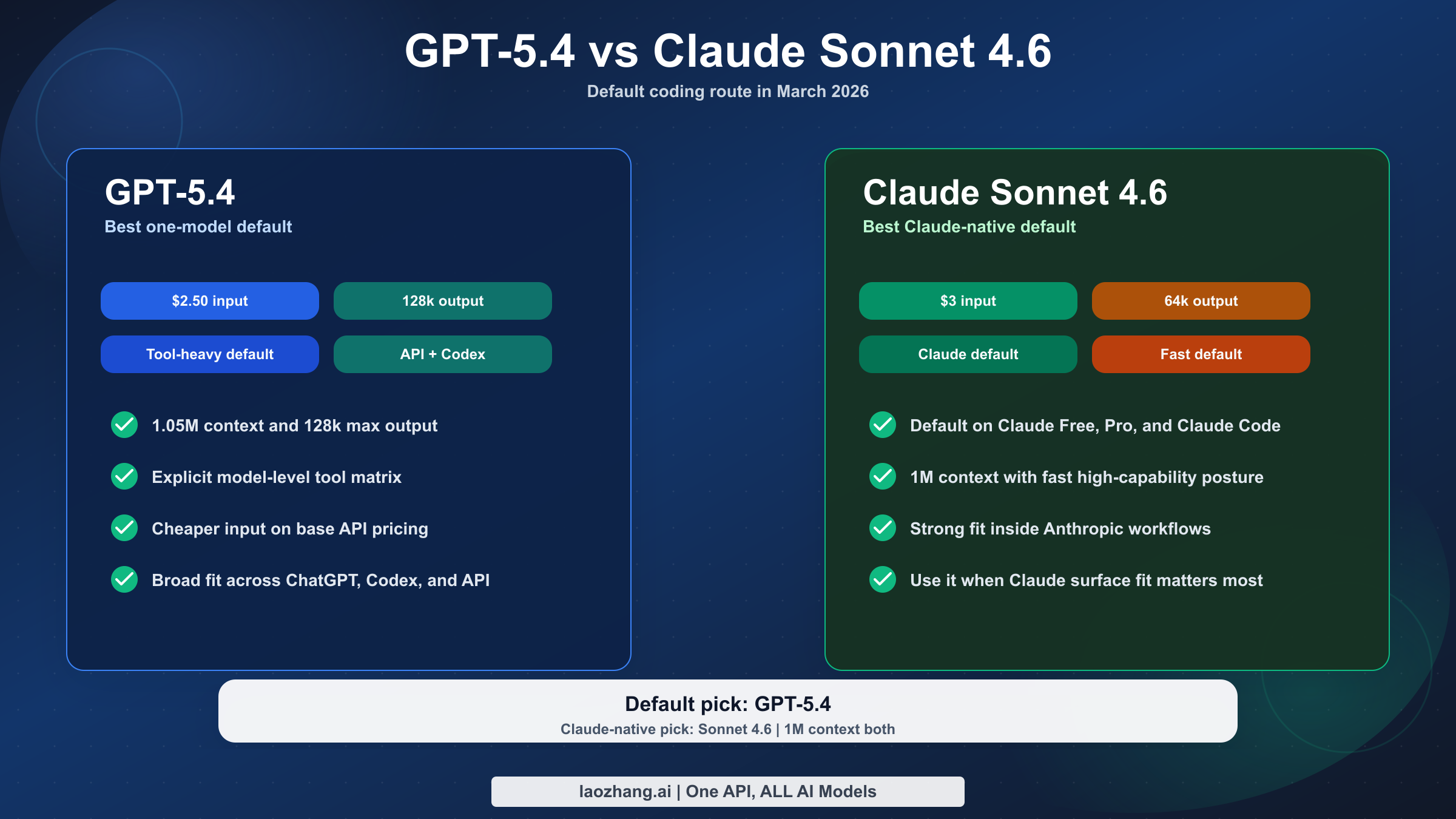

Короткий ответ: если вам нужна одна модель по умолчанию для большинства инженерных задач, то в марте 2026 года GPT-5.4 выглядит сильнее. По текущим официальным страницам OpenAI GPT-5.4 уже явно подается как главная frontier-модель для профессиональной работы, кодинга и agentic workflow. По ключевым спецификациям она находится в том же классе длинного контекста, что и Claude Sonnet 4.6. Но документы Anthropic лучше читать точнее: исходная launch page от 17 февраля 2026 года до сих пор сохраняет beta-формулировку для 1M контекста, тогда как в текущем models overview для Sonnet 4.6 указаны 1M контекста и 64k max output, а текущий guide по context windows вместе с заметками Anthropic от 13 марта 2026 года про "What's new in Claude 4.6" показывают, что полное окно 1M токенов для Sonnet 4.6 теперь доступно по стандартной цене. При этом GPT-5.4 все равно выигрывает по максимальному выводу (128k против 64k), публикует более ясную матрицу встроенных инструментов и оказывается дешевле по базовой цене входных токенов API (\$2.50 против \$3).

Это не делает Claude Sonnet 4.6 слабой моделью. Anthropic выпустила Sonnet 4.6 17 февраля 2026 года и сделала ее основной моделью по умолчанию в Claude Free / Pro и Claude Cowork, а также вывела в Claude Code, API и на крупных облачных платформах. Если ваш реальный рабочий процесс уже завязан на Claude.ai, Claude Code или в целом на Anthropic-стек, Sonnet 4.6 остается очень логичным выбором. Но чистое сравнение цены, спецификаций и инструментального слоя для API выглядит менее выгодным для Sonnet, чем это часто подают страницы из поиска.

Этот материал опирается на официальные страницы OpenAI и Anthropic, перепроверенные 19 марта 2026 года. Главная разница между ним и средним SERP-материалом в том, что здесь отдельно разобраны факты, которые можно сравнивать напрямую, и метрики, где нельзя притворяться абсолютной точностью.

Краткое содержание

Если нужен один совет без длинных оговорок: GPT-5.4 лучше ставить моделью по умолчанию. Claude Sonnet 4.6 стоит выбирать тогда, когда ваш реальный центр тяжести уже находится в Claude и вы цените нативность Anthropic-экосистемы выше, чем абсолютное преимущество по опубликованному spec sheet.

| Категория | GPT-5.4 | Claude Sonnet 4.6 | Практический вывод |

|---|---|---|---|

| Дата релиза | 5 марта 2026 | 17 февраля 2026 | Обе модели свежие, но GPT-5.4 новее |

| Роль продукта | Основная frontier-модель OpenAI для профессиональной работы, кодинга и агентных сценариев | Быстрая high-capability модель по умолчанию в Anthropic | GPT-5.4 шире как default route, Sonnet 4.6 сильнее как Claude-native default |

| Цена входа | $2.50 / 1M | $3 / 1M | GPT-5.4 дешевле по базовой цене input |

| Цена выхода | $15 / 1M | $15 / 1M | По output базовая цена одинакова |

| Контекст | 1,050,000 | 1M | Один класс по headline-лимиту; текущие models overview Anthropic плюс guide по context windows и заметки от 13 марта поддерживают трактовку Sonnet 4.6 как полной 1M-модели по стандартной цене |

| Макс. вывод | 128,000 | 64,000 | GPT-5.4 лучше для длинного single-pass вывода |

| Доступность в продуктах | ChatGPT (как GPT-5.4 Thinking), а также API и Codex | По умолчанию в Claude Free, Pro и Claude Cowork; также Claude Code, API и крупные облака | Sonnet 4.6 глубже встроена в продукты Anthropic |

| Позиция по инструментам | Явно опубликованы web search, file search, image generation, hosted shell, apply patch, MCP и другие | Сильный платформенный стек Anthropic вокруг Sonnet 4.6: adaptive thinking, compaction, search, fetch, code execution, memory | GPT-5.4 легче оправдать как одну универсальную tool-heavy модель |

| Лучший сценарий | Один дефолтный маршрут для API, Codex и агентных задач | Claude-first команда, Claude Code, быстрая основная модель внутри Anthropic | Выбирать надо по surface и workflow, а не по логотипу |

Самый важный неожиданный момент здесь связан с ценой. Многие статьи по привычке предполагают, что Sonnet обязательно дешевле. На официальных базовых API-ценах, проверенных 19 марта 2026 года, это не так: GPT-5.4 дешевле по input и равна по output.

Что реально изменилось в марте 2026 года

Главное различие здесь связано не столько с одной метрикой, сколько с позиционированием продукта.

На странице запуска GPT-5.4 OpenAI прямо называет GPT-5.4 своей самой сильной и эффективной frontier-моделью для профессиональной работы. Более того, OpenAI отдельно говорит, что GPT-5.4 объединяет прогресс в reasoning, coding и agentic workflow, а также включает в себя кодинговые возможности GPT-5.3-Codex. Для разработчика это очень понятный сигнал: GPT-5.4 должна быть не просто еще одной моделью в каталоге, а основным дефолтом.

Anthropic на странице запуска Claude Sonnet 4.6 делает другой акцент. Sonnet 4.6 подается как лучший баланс скорости и интеллекта внутри семейства Claude. Anthropic подчеркивает улучшения в кодинге, computer use, long-context reasoning, agent planning и knowledge work. На странице запуска 17 февраля 2026 года окно в 1M токенов было отмечено как beta, и эта историческая формулировка до сих пор остается на launch page. При этом текущие живые документы Anthropic уже говорят более широко: в текущем models overview для Sonnet 4.6 указаны 1M контекста и 64k max output; текущий guide по context windows говорит, что Claude Sonnet 4.6 и Claude Opus 4.6 теперь имеют generally available 1M-token context windows; а заметки Anthropic от 13 марта 2026 года "What's new in Claude 4.6" уточняют, что полное окно 1M токенов для Sonnet 4.6 доступно по стандартной цене. Самая аккуратная трактовка здесь не в том, что beta-язык полностью исчез, а в том, что launch page сохраняет историю rollout, тогда как актуальные models overview, guide по context windows и release notes уже поддерживают чтение Sonnet 4.6 как модели с 1M context и 64k max output. При этом GPT-5.4 все равно сохраняет более выгодный базовый input price и более высокий потолок output. Одновременно модель сделана дефолтной для Free / Pro и Claude Cowork при доступности в Claude Code. То есть Sonnet 4.6 - это не попытка выиграть каждую строчку spec sheet, а стремление стать основной рабочей моделью внутри Anthropic-среды.

Отсюда и реальный вопрос под этим ключом:

Что мне поставить моделью по умолчанию прямо сейчас: более широкую и сильнее упакованную GPT-5.4 или нативную для Claude Sonnet 4.6?

Именно поэтому так много результатов поиска уводят в сторону. Поисковая выдача охотно ранжирует страницы вроде "GPT-5 vs Claude" или даже "GPT-5.4 vs Claude Opus 4.6", потому что они покрывают широкое сравнение брендов. Но реальная задача читателя намного конкретнее: какую модель выбрать дефолтом для реальной инженерной работы?

Если вам нужен дополнительный контекст про то, как GPT-5.4 заняла место над старой более узкой кодинговой линией, посмотрите наш материал GPT-5.4 vs GPT-5.3-Codex.

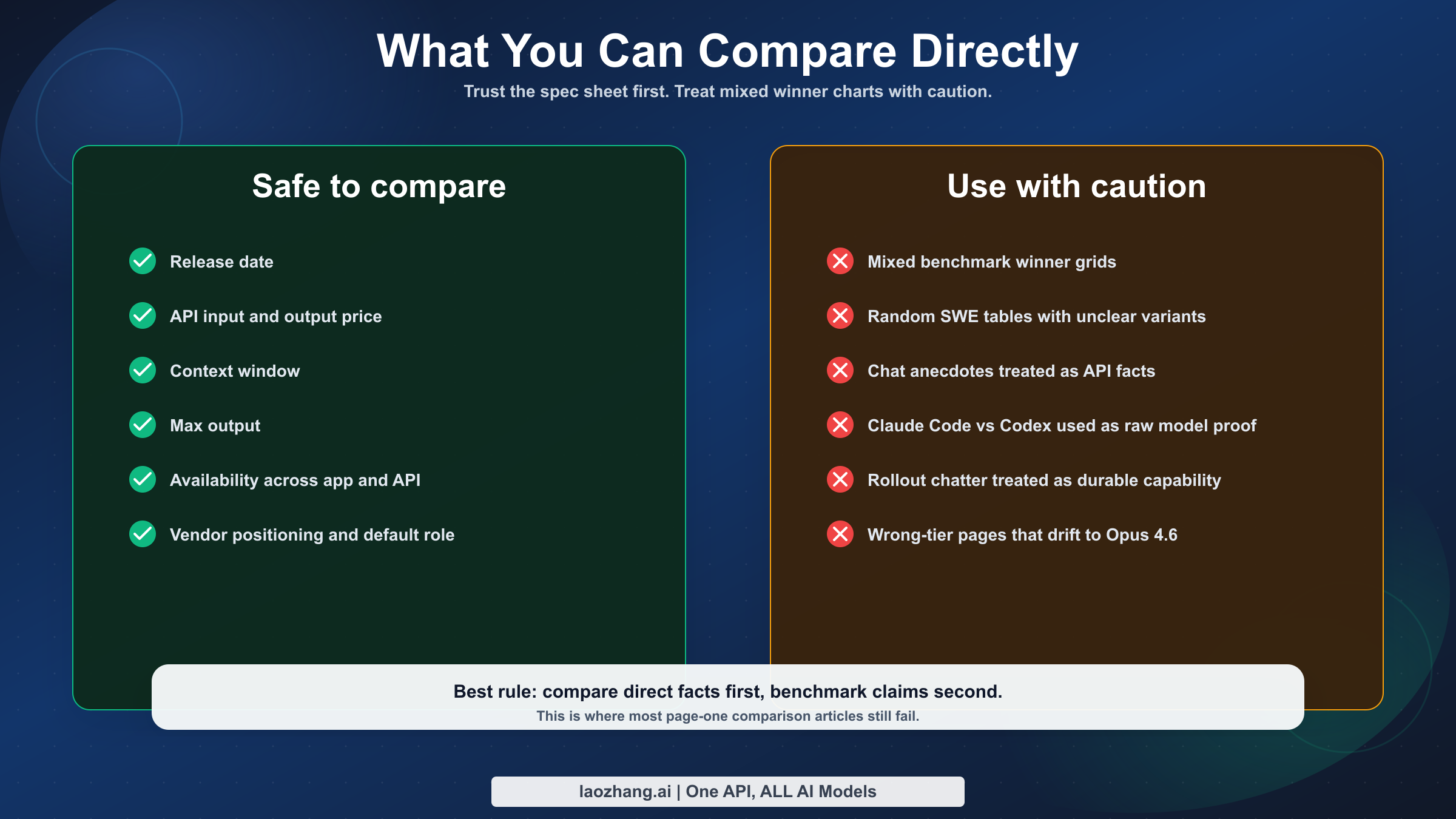

Что можно сравнивать напрямую, а что нельзя

Это тот участок, где большинство сравнительных материалов начинает "подкручивать" уверенность.

Вот что можно сравнивать напрямую, потому что обе компании публикуют это однозначно:

| Можно сравнивать напрямую | Почему |

|---|---|

| Даты релиза | Даты указаны на официальных launch pages |

| Базовую цену API input / output | Обе компании публикуют актуальные цены |

| Размер контекста | У обеих есть явные текущие лимиты |

| Максимальный вывод | Обе компании публикуют cap по output |

| Доступность в приложениях и API | Обе компании указывают rollout surfaces |

| Позиционирование модели | Launch pages прямо объясняют роль моделей |

А вот что нельзя честно сводить в одну "таблицу побед":

| Нельзя сравнивать без оговорок | Почему |

|---|---|

| Случайные benchmark winner charts | Нет одной общей официальной таблицы GPT-5.4 vs Sonnet 4.6 в одинаковой конфигурации |

| SWE-bench числа из разных блогов | Часто отличаются harness, prompts, variants и число прогонов |

| Ощущения от Claude Code vs Codex | Это product-surface сравнение, а не только model-ID comparison |

| Жалобы на rollout или лимиты | Это полезный friction-сигнал, но слабое доказательство возможностей модели |

| Статьи, которые переключаются на Opus 4.6 | Это уже другой Claude-tier и другой вопрос |

Launch page OpenAI в основном показывает GPT-5.4 рядом с GPT-5.3-Codex и GPT-5.2, а Anthropic объясняет Sonnet 4.6 через сравнительный рост внутри собственной линейки и через свою методологию system card. Именно поэтому значительная часть сторонних "рейтингов победителя" - это не чистый apples-to-apples head-to-head, а интерпретация.

При этом официальные benchmark-сигналы все равно полезны по направлению. OpenAI публикует для GPT-5.4 сильный профиль на coding и tool-use: 57.7% на SWE-Bench Pro (Public), 75.1% на Terminal-Bench 2.0, 82.7% на BrowseComp и 54.6% на Toolathlon. Anthropic делает упор не на прямой cross-vendor grid, а на рабочую оценку: ранние пользователи Claude Code предпочитали Sonnet 4.6 Sonnet 4.5 примерно в 70% случаев, а Opus 4.5 - в 59% случаев. Это хорошее доказательство того, что Sonnet 4.6 действительно сильна, но не повод притворяться, будто у нас есть одна идеальная сводная таблица между нею и GPT-5.4.

Еще важнее то, что Anthropic сама говорит: Opus 4.6 остается самым сильным вариантом для задач, где нужен предельный reasoning - например, тяжелый codebase refactoring и координация нескольких агентов. Это показывает место Sonnet 4.6 в линейке Anthropic: очень сильный default, но не абсолютный потолок семейства.

Цены, контекст, лимиты вывода и инструменты

Для разработчика именно этот раздел обычно важнее любых громких заголовков про "лидера".

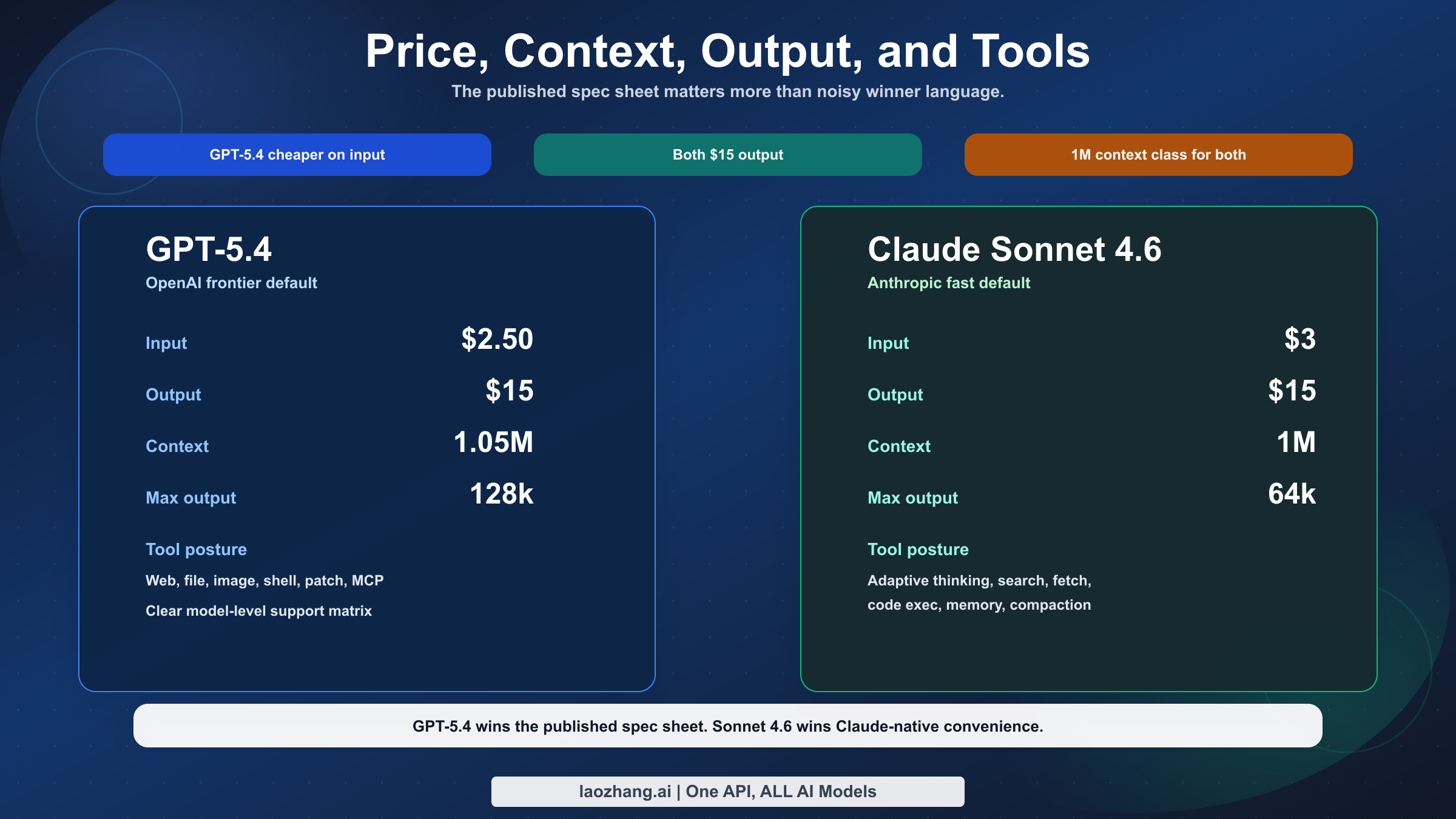

Сначала цена. По текущей странице модели GPT-5.4 у OpenAI цена составляет $2.50 за input, $0.25 за cached input и $15 за output на миллион токенов. По текущей модели overview Anthropic у Claude Sonnet 4.6 цена $3 за input и $15 за output. То есть на уровне базовой опубликованной API-цены GPT-5.4 дешевле на входе и не дороже на выходе.

Но это не вся экономика. OpenAI отдельно указывает важную деталь: если сессия GPT-5.4 превышает 272K input tokens, она начинает считаться по коэффициенту 2x input и 1.5x output для всей сессии. Иными словами, огромное контекстное окно у GPT-5.4 реально, но на дальнем конце оно становится заметно дороже. Поэтому если ваш workload почти всегда уходит в экстремально длинный контекст, нельзя смотреть только на headline price.

По контексту обе модели находятся примерно в одной лиге. GPT-5.4 публикуется с 1,050,000 токенов контекста, Sonnet 4.6 - с 1M в текущем Anthropic models overview. Историю rollout знать полезно, потому что launch page вводила 1M как beta, и эта формулировка там до сих пор видна. Но текущие живые документы уже шире: guide по context windows говорит, что Sonnet 4.6 теперь имеет generally available 1M-token window, а заметки Anthropic от 13 марта 2026 года "What's new in Claude 4.6" уточняют, что полное окно 1M токенов доступно по стандартной цене. Поэтому самая осторожная текущая трактовка выглядит так: launch page хранит beta-историю, а актуальные models overview, context-windows guide и release notes поддерживают чтение Sonnet 4.6 как модели с 1M context и 64k max output. Существеннее разница в max output: 128k у GPT-5.4 против 64k у Sonnet 4.6. Если вам нужны длинные отчеты, крупные переписывания текста или более объемный одноразовый результат, GPT-5.4 дает заметно больше пространства.

Еще один важный пласт - инструменты. Сила GPT-5.4 в том, что OpenAI очень ясно показывает model-level support: web search, file search, image generation, code interpreter, hosted shell, apply patch, skills, computer use, MCP, tool search. У Sonnet 4.6 инструментальный слой тоже силен, но подан иначе: release page и текущие docs описывают вокруг модели платформенный стек Anthropic - adaptive thinking, extended thinking, context compaction, web search, fetch, code execution, memory, tool search, programmatic tool calling. Это реальные возможности, но они описаны скорее как платформенный workflow, а не как одна идеальная model matrix.

Практический вывод отсюда очень приземленный:

- если вы хотите одну модель по умолчанию для tool-heavy задач, GPT-5.4 проще защитить как default route;

- если вы уже живете внутри Claude.ai и Claude Code, Sonnet 4.6 выглядит естественнее как главная рабочая модель;

- если для вас критичны длинные single-pass outputs, GPT-5.4 дает заметно больше запаса;

- если вы хотите самый сильный не-Opus default внутри Anthropic, Sonnet 4.6 - очевидный ответ.

Anthropic также помечает Sonnet 4.6 как Fast по comparative latency, тогда как OpenAI помечает GPT-5.4 как Medium. Это не доказывает автоматически, что Sonnet 4.6 всегда быстрее во всех реальных задачах, но поддерживает простую интерпретацию: Sonnet 4.6 - это быстрый сильный default, GPT-5.4 - более тяжелый и широкий default.

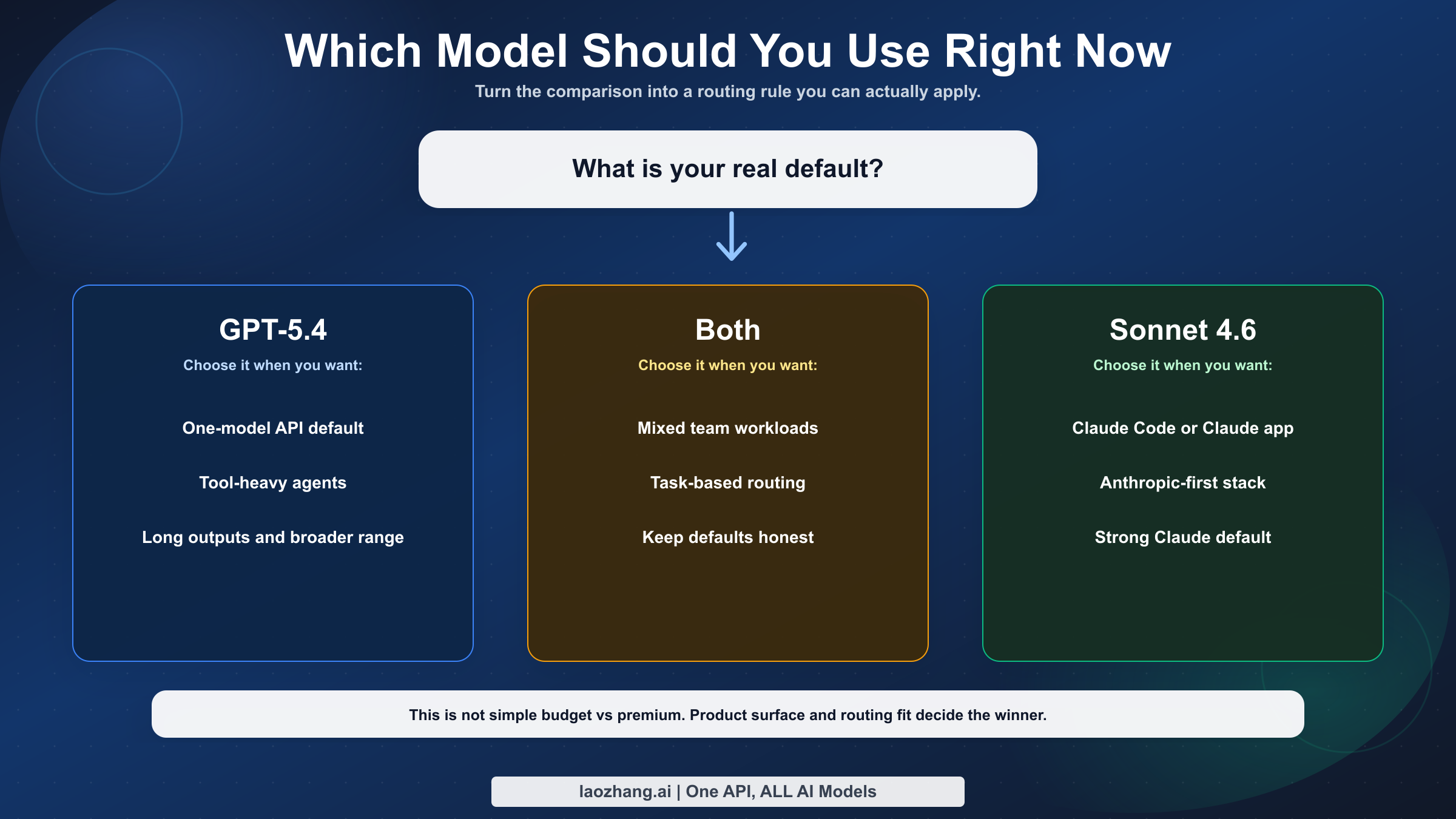

Какую модель выбирать под разные workflow

Переводить спецификации в действие - вот где сравнение реально приносит пользу.

| Workflow | Что лучше выбрать | Почему |

|---|---|---|

| Нужен один API default для кодинга и инструментов | GPT-5.4 | Шире инструментальный слой, дешевле input, такой же output, выше max output |

| Большой репозиторий и длинные анализы | GPT-5.4 | Тот же класс контекста, но больше output headroom |

| Tool-heavy agent tasks с search, shell, patch и MCP | GPT-5.4 | У OpenAI яснее опубликована model-level tool matrix |

| Основная поверхность - Claude.ai или Claude Code | Claude Sonnet 4.6 | Это нативный default Anthropic-экосистемы |

| Claude Free / Pro как основной режим работы | Claude Sonnet 4.6 | Sonnet 4.6 уже является там default |

| Anthropic-first команда | Claude Sonnet 4.6 | Лучше совпадает с существующим стеком и процессами |

| Команда умеет routing по задаче | Обе модели | GPT-5.4 как основной default, Sonnet 4.6 как Claude-native secondary lane |

Для индивидуального разработчика или маленькой команды, которым нужен один API default, GPT-5.4 сейчас обычно выглядит рациональнее. Она новее, дешевле на входе, не дороже на выходе, сильнее по max output и проще объясняется, когда задача расширяется от "напиши код" к "поиск, инструменты, многошаговый агент, большая сессия".

Для Claude-first команды решение другое. Если реальный вопрос у вас не "кто сильнее на бумаге?", а "какую модель мы хотим использовать внутри Claude Code и Claude.ai без лишнего расслоения стека?", тогда Sonnet 4.6 становится гораздо более естественным выбором. Anthropic явно строит ее как модель, к которой вы тянетесь первой, а Opus 4.6 сохраняет роль более дорогого reasoning ceiling.

Для команд с task-based routing лучшая стратегия часто в том, чтобы оставить обе модели:

- GPT-5.4 для repo-wide planning, tool-using agents, browser-backed research и длинного вывода;

- Sonnet 4.6 для Claude Code sessions, Anthropic-native review loops и Claude-first инженерной среды;

- Opus 4.6 или GPT-5.4 Pro только для более узкого круга задач, где реально нужен дополнительный reasoning ceiling.

Это не компромисс ради компромисса. Это просто более честный рабочий ответ.

Если ваш выбор на самом деле больше связан с продуктами, чем с самими model IDs, посмотрите наш материал Claude Code vs Codex: он хорошо показывает, насколько сильно user experience зависит от surface, даже если разговор начинается с сравнения моделей.

Где каждая модель действительно выигрывает

Неправильный вывод из этого текста был бы таким: "раз GPT-5.4 лучше как default, значит Sonnet 4.6 уже не нужна". Это не так.

Claude Sonnet 4.6 выигрывает тогда, когда ваш workflow уже глубоко сидит внутри Claude. Если команда работает через Claude Code, использует Claude.ai как основной интерфейс, уже стандартизировала процессы вокруг Anthropic и не хочет усложнять stack ради каждого marginal gain, Sonnet 4.6 по-прежнему очень сильна. Ее ценность здесь не в том, что она "дешевле", а в том, что это правильный дефолт внутри Claude-экосистемы.

GPT-5.4 выигрывает тогда, когда вам нужен единый основной маршрут для API, Codex, длинного вывода и tool-heavy задач. В этом сравнении особенно важно то, что GPT-5.4 не только выглядит сильнее как универсальный default, но и не проигрывает по базовой цене API. Это редкая комбинация: более широкая модель по опубликованным фактам не оказывается автоматически более дорогой на входе.

Если свести все к одной практической формуле, то она будет такой:

- нужен один универсальный default - берите GPT-5.4

- нужен лучший Claude-native default - берите Claude Sonnet 4.6

- умеете маршрутизировать по задачам - держите обе

Это менее громкий заголовок, чем "X уничтожает Y", но намного полезнее в реальной работе.

FAQ: Часто задаваемые вопросы

GPT-5.4 действительно лучше Claude Sonnet 4.6 именно для кодинга?

В большинстве случаев - да, если вам нужна одна модель по умолчанию не только для кодинга, но и для длинного контекста, инструментов и agentic workflow. По текущим опубликованным фактам GPT-5.4 выглядит сильнее как общий default: дешевле input, такая же цена output, тот же класс контекста, больше max output и более ясная tool matrix. Sonnet 4.6 при этом остается очень хорошей Claude-first моделью.

Claude Sonnet 4.6 дешевле GPT-5.4?

Нет, если смотреть на официальные базовые цены API, проверенные 19 марта 2026 года. GPT-5.4 стоит $2.50 / 1M input и $15 / 1M output, а Claude Sonnet 4.6 стоит $3 / 1M input и $15 / 1M output. Поэтому многие поисковые страницы, где Sonnet подается как "более бюджетный путь", сейчас устарели или как минимум упрощают картину.

Может ли Claude Sonnet 4.6 заменить GPT-5.4?

Да, в некоторых workflow может - особенно если вы уже глубоко внутри Claude Code или Claude.ai и не нуждаетесь в более широком model-level tool layer OpenAI. Но если вам нужна одна модель, которую удобно поставить дефолтом для API routing, Codex, длинного вывода и tool-heavy agent tasks, GPT-5.4 выглядит надежнее.

Стоит ли командам держать обе модели?

Очень часто да. Самая практичная схема - GPT-5.4 как основной default и Sonnet 4.6 как Claude-native lane. Если инфраструктура позволяет task-based routing, такой подход обычно дает лучший баланс качества, удобства и стоимости, чем попытка загнать все задачи в одного вендора.