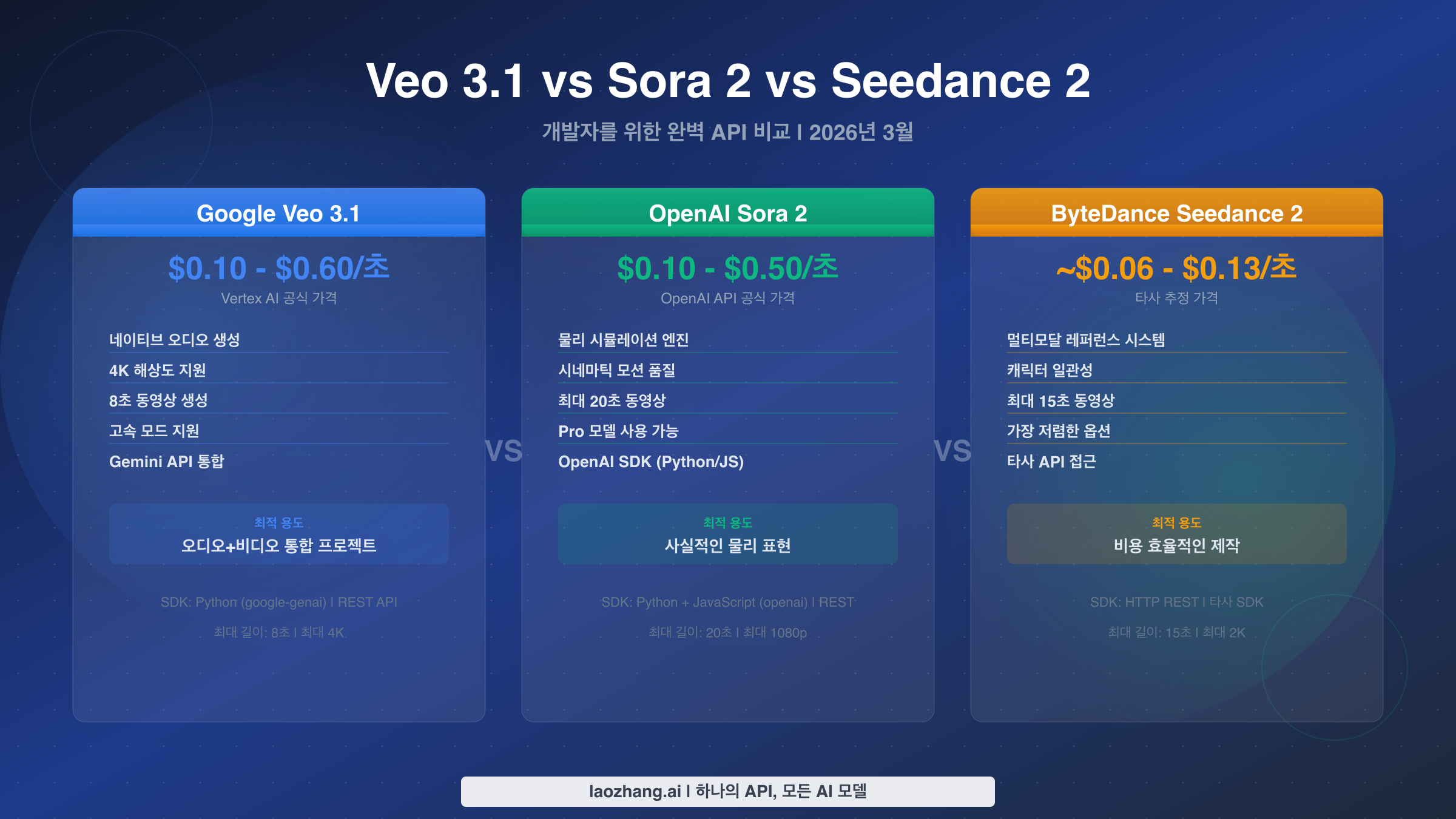

2026년 3월 현재 Veo 3.1, Sora 2, Seedance 2 API 중 하나를 선택하는 것은 세 가지 요소로 귀결됩니다. 무엇이 필요한지(오디오, 해상도, 물리 시뮬레이션), 얼마를 지출할 수 있는지(초당 요금이 티어별로 최대 6배 차이), 그리고 어떻게 확장할 것인지(요청 제한과 실패율이 실제 비용을 크게 변화시킵니다). Google의 Veo 3.1은 Vertex AI를 통해 초당 $0.10부터 시작하는 네이티브 오디오 생성과 4K 지원을 제공하고, OpenAI의 Sora 2는 초당 $0.10-$0.50에 우수한 물리 시뮬레이션을 제공하며, ByteDance의 Seedance 2.0은 서드파티 제공자를 통해 초당 약 $0.06으로 가장 경제적인 옵션을 제공합니다. 본 가이드에서는 세 가지 모두에 대한 검증된 가격, 실행 가능한 코드, 프로덕션 전략을 다룹니다.

핵심 요약

AI 동영상 생성 API 시장은 2026년 초에 크게 성숙했으며, 개발자들은 이제 각각 고유한 강점을 가진 세 가지 프로덕션 레벨의 옵션을 선택할 수 있습니다. 읽고 나서 더 혼란스러워지는 기능 매트릭스를 제시하는 대신, 실제 테스트와 공식 문서 검토에서 도출한 핵심 비교를 정리했습니다. Google Veo 3.1은 동영상과 함께 동기화된 오디오를 생성하는 유일한 API로, 소리가 중요한 프로젝트에 최적의 선택입니다. OpenAI Sora 2는 가장 물리적으로 정확한 움직임과 시네마틱 품질을 생성하여, 사실적인 콘텐츠에 이상적입니다. ByteDance Seedance 2.0은 가장 낮은 초당 비용과 강력한 캐릭터 일관성을 제공하여, 예산에 민감한 프로덕션 파이프라인에 적합합니다. 세 가지 모두를 별도의 계정과 결제 없이 사용하고 싶다면, 통합 서비스를 통해 경쟁력 있는 가격으로 통합 접근이 가능합니다.

| 기능 | Veo 3.1 (Google) | Sora 2 (OpenAI) | Seedance 2.0 (ByteDance) |

|---|---|---|---|

| 시작 가격 | $0.10/초 (Fast, 동영상만) | $0.10/초 (720p) | ~$0.06/초 (Basic, 720p) |

| 최대 해상도 | 4K | 1080p | 2K |

| 최대 길이 | 8초 | 20초 | 15초 |

| 네이티브 오디오 | 지원 | 미지원 | 미지원 |

| 이미지-투-비디오 | 지원 | 지원 | 지원 (참조 시스템) |

| 공식 API | Vertex AI (Python SDK) | OpenAI API (Python/JS SDK) | 공식 API 없음 |

| 적합 용도 | 오디오+동영상 프로젝트 | 물리 시뮬레이션 & 시네마틱 | 예산 중심 프로덕션 |

API 가격 심층 분석 — 각 플랫폼의 실제 비용

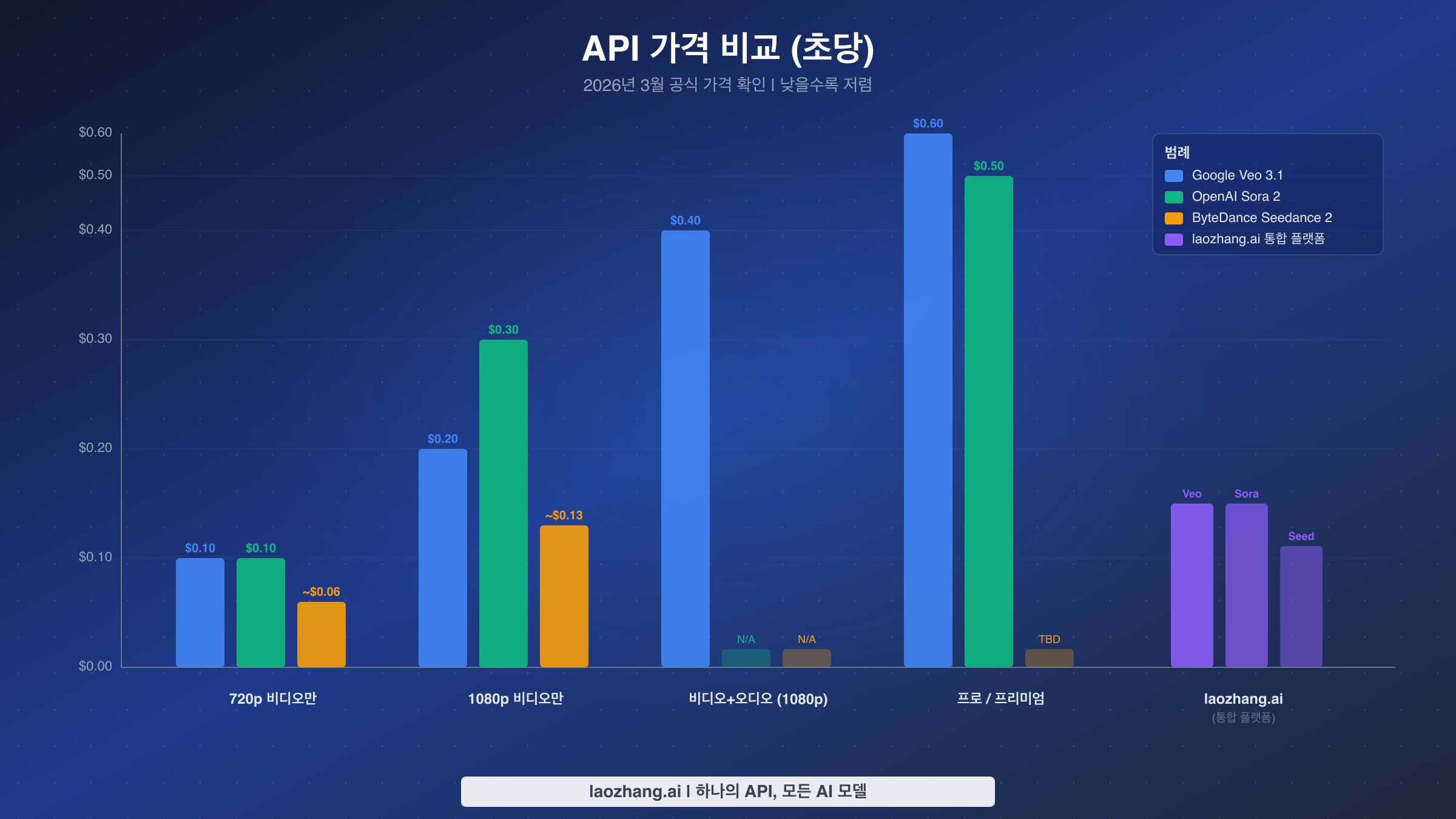

각 동영상 생성 API의 실제 비용을 이해하려면 헤드라인 초당 요금 이상을 살펴봐야 합니다. 세 플랫폼의 가격 구조는 근본적으로 다릅니다. Veo 3.1은 해상도, 속도, 오디오 포함 여부에 기반한 세분화된 티어 시스템을 사용하고, Sora 2는 품질 수준과 해상도로 구분되는 더 단순한 2티어 모델을 제공하며, Seedance 2.0은 공식 API 가격이 전혀 없어 서드파티 제공자 추정치에 의존합니다. 이러한 구조적 차이로 인해 각 티어가 실제로 무엇을 제공하는지 이해하지 못하면 단순한 초당 비교는 오해를 불러일으킬 수 있습니다. 예를 들어, Veo 3.1의 $0.10/초 요금은 표준 해상도의 오디오 없는 고속 모드에만 적용되며, 오디오가 포함된 4K 동영상 모드는 $0.60/초로 동일 플랫폼 내에서 6배의 가격 차이가 발생합니다. 아래 데이터는 2026년 3월 2일에 검증된 공식 가격 페이지에서 가져온 것이며, 각 수치에 대한 출처가 명시되어 있습니다.

Google Veo 3.1 — Vertex AI 가격

Google의 Vertex AI를 통한 Veo 3.1 가격은 세 가지 중 가장 세분화되어 있으며, 속도 모드(standard vs fast), 출력 유형(동영상만 vs 동영상+오디오), 해상도(720p/1080p vs 4K)의 세 가지 변수에 기반한 8가지 가격 티어를 제공합니다. 표준 모드는 더 높은 품질의 출력을 생성하지만 고속 모드에 비해 약 2배의 비용이 듭니다. 네이티브 오디오 생성을 추가하면 티어에 따라 50-100%의 가격 인상이 발생합니다. 대부분의 개발자에게는 테스트용으로 초당 $0.10의 고속 동영상 전용 티어가 가장 좋은 시작점이며, 필요에 따라 오디오 지원 또는 고해상도 티어로 업그레이드할 수 있습니다. Veo 3.1 가격 상세 분석 전용 가격 가이드에서 전체 내용을 확인하실 수 있습니다. 한 가지 중요한 세부 사항이 있습니다. Veo 3.1은 최대 8초 길이의 동영상을 생성하므로, 가장 저렴한 티어에서도 단일 생성 비용은 최소 동영상 클립당 $0.80입니다(Google Vertex AI 공식 가격, 2026년 3월 2일 검증).

| Veo 3.1 티어 | 해상도 | 오디오 | 초당 가격 | 8초 동영상 비용 |

|---|---|---|---|---|

| Fast, 동영상만 | 720p/1080p | 미포함 | $0.10 | $0.80 |

| Fast, 동영상+오디오 | 720p/1080p | 포함 | $0.15 | $1.20 |

| Standard, 동영상만 | 720p/1080p | 미포함 | $0.20 | $1.60 |

| Standard, 동영상+오디오 | 720p/1080p | 포함 | $0.40 | $3.20 |

| Fast, 동영상만 | 4K | 미포함 | $0.30 | $2.40 |

| Fast, 동영상+오디오 | 4K | 포함 | $0.35 | $2.80 |

| Standard, 동영상만 | 4K | 미포함 | $0.40 | $3.20 |

| Standard, 동영상+오디오 | 4K | 포함 | $0.60 | $4.80 |

OpenAI Sora 2 — API 가격

OpenAI의 Sora 2 가격은 더 깔끔한 2티어 구조를 따릅니다. 표준 모델(sora-2)과 프로페셔널 모델(sora-2-pro)로 구성됩니다. 표준 모델은 $0.10/초에 720p 동영상을 생성하며, 이는 Veo 3.1의 가장 저렴한 티어와 동일하지만 클립당 최대 20초까지의 상당히 긴 길이를 지원합니다. 프로 모델은 두 가지 해상도 옵션을 제공하며, 720p가 $0.30/초, 1080p가 $0.50/초입니다. Veo 3.1과 달리 Sora 2는 오디오를 생성하지 않으므로, 소리가 필요한 프로젝트에는 별도의 오디오 생성 단계가 필요합니다. 클립당 비용은 경쟁력 있으며, 특히 표준 티어에서 10초 720p 동영상은 단 $1.00입니다. 고해상도가 필요한 프로젝트의 경우, 1080p로의 $0.50/초 업그레이드는 Sora 2 Pro를 더 비싼 옵션 중 하나로 만들지만, 많은 시네마틱 사용 사례에서 물리 시뮬레이션 품질이 프리미엄을 정당화합니다. Sora 2의 요청 제한과 할당량 세부 정보에 대한 자세한 내용은 Sora 2 API 가격 및 요청 제한 상세 가이드를 참조하십시오(OpenAI 공식 API 가격, 2026년 3월 2일 검증).

| Sora 2 티어 | 해상도 | 초당 가격 | 10초 동영상 비용 |

|---|---|---|---|

| sora-2 | 720p (1280x720) | $0.10 | $1.00 |

| sora-2-pro | 720p (1280x720) | $0.30 | $3.00 |

| sora-2-pro | 1080p (1792x1024) | $0.50 | $5.00 |

Seedance 2.0 — 서드파티 가격

ByteDance의 Seedance 2.0은 독특한 가격 문제를 제시합니다. 2026년 3월 기준으로 공식 공개 API 가격이 없습니다. ByteDance는 주로 중국 시장 사용자를 대상으로 한 크레딧 기반 시스템을 사용하는 JiMeng 플랫폼(jimeng.jianying.com)을 통해 Seedance를 제공합니다. 해외 개발자의 경우, 기본 모델과의 통합을 구축한 서드파티 API 제공자를 통해 접근할 수 있습니다. 이러한 제공자들의 추정 가격에 따르면 Seedance 2.0은 상당한 차이로 가장 경제적인 옵션이며, 기본 720p 생성이 초당 약 $0.06, 프로 1080p 생성이 초당 약 $0.13입니다. 그러나 이 가격에는 중요한 주의 사항이 있습니다. 서드파티 제공자가 마진을 조정함에 따라 가격이 변동할 수 있고, 공식 API에 비해 가용성이 일관되지 않을 수 있으며, 기능 세트가 ByteDance가 직접 제공하는 것과 다를 수 있습니다. Seedance 2.0 통합에 관심 있는 개발자를 위해 Seedance 2 API 통합 단계별 가이드에서 사용 가능한 접근 방법을 상세히 다루고 있습니다(seadanceai.com의 서드파티 추정치, 2026년 3월 2일 검증).

API 통합 — 세 플랫폼 모두를 위한 작동 코드

API 비교의 진정한 테스트는 기능 표가 아니라, 각 API를 반나절 안에 코드베이스에서 작동시킬 수 있는지 여부입니다. 세 가지 동영상 생성 API는 통합 방식에서 크게 다릅니다. Sora 2는 대부분의 개발자가 이미 알고 있는 OpenAI의 익숙한 SDK 패턴을 사용하고, Veo 3.1은 자체 인증 모델을 가진 Google의 Vertex AI SDK를 필요로 하며, Seedance 2.0은 선택한 서드파티 제공자에 전적으로 의존하여 일반적으로 직접 HTTP 요청을 수반합니다. 아래는 세 플랫폼 각각에 대한 완전한 Python 코드 예제로, 오늘 바로 실행할 수 있습니다. 모든 코드 예제는 동일한 패턴을 따르도록 구성되었습니다. 생성 요청을 만들고, 완료를 폴링하고, 결과를 다운로드하는 방식으로, 개발자 경험을 직접 비교할 수 있습니다.

Sora 2 — OpenAI SDK 통합

Sora 2 통합은 OpenAI API를 사용해 본 적이 있다면 즉시 익숙하게 느껴질 것입니다. SDK가 인증, 요청 형식 지정, 응답 파싱을 처리하므로 세 가지 중 가장 개발자 친화적인 옵션입니다. 비동기 생성 패턴은 완료 폴링이 필요하며, 일반적으로 서버 부하와 동영상 길이에 따라 표준 720p 동영상의 경우 30초에서 3분이 소요됩니다. 대부분의 비교 글에서 놓치는 중요한 세부 사항이 하나 있습니다. Sora 2는 API 호출당이 아닌 출력 동영상 초당 과금하며, 타이머는 요청이 대기열에 들어갈 때가 아니라 실제로 생성이 시작될 때부터 작동합니다.

pythonfrom openai import OpenAI import time import requests as req client = OpenAI() # Uses OPENAI_API_KEY env variable response = client.responses.create( model="sora-2", input="A golden retriever puppy playing in autumn leaves, " "cinematic lighting, shallow depth of field", tools=[{ "type": "video_generation", "size": "1280x720", "duration": 10 }] ) # Step 2: Poll for completion video_id = response.output[0].id while True: status = client.responses.retrieve(video_id) if status.status == "completed": video_url = status.output_video.url break elif status.status == "failed": raise Exception(f"Generation failed: {status.error}") time.sleep(5) # Step 3: Download the video video_data = req.get(video_url) with open("sora2_output.mp4", "wb") as f: f.write(video_data.content)

Veo 3.1 — Google Vertex AI 통합

Gemini API를 통한 Veo 3.1 통합은 Google의 google-genai Python 패키지를 사용하며, 동영상 생성 요청을 위한 깔끔한 인터페이스를 제공합니다. Sora 2와의 핵심 차이점은 인증 모델입니다. Vertex AI가 활성화된 Google Cloud 프로젝트가 필요하며, 인증은 단순한 API 키가 아닌 Google의 표준 서비스 계정 또는 애플리케이션 기본 자격 증명을 사용합니다. 생성 프로세스도 비동기적이지만, Veo 3.1은 고속 모드에서 Sora 2보다 일반적으로 더 빠르게 결과를 반환하며, 8초 동영상을 60초 이내에 완료하는 경우가 많습니다. 네이티브 오디오 기능은 별도의 파라미터가 아닌 모델 수준에서 구성됩니다. 즉, 요청 시 동영상 전용 모델과 동영상+오디오 모델 중 하나를 선택합니다.

pythonfrom google import genai from google.genai import types import time client = genai.Client() # Uses GOOGLE_API_KEY or application default credentials # Step 1: Generate video (with native audio) operation = client.models.generate_videos( model="veo-3.1", # Use "veo-3.1-fast" for faster, cheaper generation prompt="A chef preparing a gourmet meal in a professional kitchen, " "sizzling sounds, ambient restaurant noise", config=types.GenerateVideosConfig( person_generation="allow_adult", aspect_ratio="16:9", number_of_videos=1, ), ) # Step 2: Poll for completion while not operation.done: time.sleep(10) operation = client.operations.get(operation) # Step 3: Save the video for i, video in enumerate(operation.result.generated_videos): with open(f"veo31_output_{i}.mp4", "wb") as f: f.write(video.video.video_bytes)

Seedance 2.0 — HTTP REST 통합

Seedance 2.0 통합은 선택한 서드파티 제공자에 따라 다르지만, 일반적인 패턴은 비동기 작업 관리를 포함하는 표준 REST API 접근 방식을 따릅니다. 공식 SDK가 없기 때문에 원시 HTTP 요청으로 작업하게 되며, 이는 최대한의 유연성을 제공하지만 인증, 에러 처리, 폴링 로직에 더 많은 보일러플레이트 코드가 필요합니다. 아래 예제는 일반적인 서드파티 제공자 통합 패턴을 보여줍니다. Seedance 2.0의 생성 시간은 다른 두 가지보다 긴 경향이 있으며, 10초 동영상에 2-5분이 소요되는 경우가 많지만, 배치 작업을 실행할 때는 낮은 초당 비용이 대기 시간을 보상합니다.

pythonimport requests import time API_KEY = "your_provider_api_key" BASE_URL = "https://api.provider.com/v1" # Third-party provider endpoint # Step 1: Create generation task response = requests.post( f"{BASE_URL}/video/generate", headers={ "Authorization": f"Bearer {API_KEY}", "Content-Type": "application/json" }, json={ "model": "seedance-2.0", "prompt": "A dancer performing contemporary ballet in a misty forest, " "ethereal lighting, slow motion", "resolution": "720p", "duration": 10 } ) task = response.json() # Step 2: Poll for completion while True: status = requests.get( f"{BASE_URL}/video/status/{task['task_id']}", headers={"Authorization": f"Bearer {API_KEY}"} ).json() if status["state"] == "completed": video_url = status["video_url"] break elif status["state"] == "failed": raise Exception(f"Failed: {status.get('error')}") time.sleep(10) # Step 3: Download video = requests.get(video_url) with open("seedance2_output.mp4", "wb") as f: f.write(video.content)

세 가지 API의 개발자 경험을 비교하면 명확한 계층 구조가 드러납니다. Sora 2는 OpenAI의 성숙한 SDK 생태계와 익숙한 인증 패턴 덕분에 통합이 가장 쉽고, Veo 3.1은 Google Cloud를 통한 약간의 추가 설정이 필요하지만 API 파라미터에서 가장 풍부한 기능 세트를 제공하며, Seedance 2.0은 사실상 HTTP 호출 위에 자체 SDK를 구축해야 하므로 가장 많은 수동 작업이 필요합니다. 별도의 인증 플로우, SDK 버전, 결제 계정을 유지하지 않고 세 가지 모두를 통합하려는 팀의 경우, laozhang.ai와 같은 통합 서비스가 세 가지 API를 모두 래핑하는 통합 OpenAI 호환 엔드포인트를 제공하여, 기존 코드에서 단일 파라미터만 변경하면 모델 간 전환이 가능합니다.

실제 프로덕션 비용 — 초당 가격을 넘어서

위의 초당 가격 표는 성공적인 생성에 대해 각 API가 부과하는 비용을 알려주지만, 프로덕션 동영상 파이프라인을 운영할 때 실제로 지출하게 될 금액은 알려주지 않습니다. 세 가지 요소가 실제 비용을 극적으로 변화시킵니다. 생성 성공률, 동영상 저장 및 전송 오버헤드, 그리고 첫 번째 생성이 원하는 결과와 일치하지 않을 때의 반복 비용 승수입니다. 이러한 숨겨진 비용 승수를 이해하는 것이 예산 내에서 유지되는 프로젝트와 첫 주에 할당량을 초과하는 프로젝트의 차이를 만듭니다. 이 섹션에서는 개발자 커뮤니티 보고서와 프로덕션 파이프라인 벤치마크의 데이터를 사용하여, 어떤 가격 표의 이론적 수치를 넘어서는 동영상 생성 비용의 실제 계산을 분석합니다.

생성 성공률은 플랫폼마다 크게 다르며 프롬프트의 복잡성에 크게 좌우됩니다. 커뮤니티 보고서와 프로덕션 경험에 기반하면, Sora 2는 표준 프롬프트에 대해 약 85-90%의 성공률을 달성하지만, 여러 캐릭터나 특정 물리 요구 사항이 있는 복잡한 장면은 성공률이 70% 미만으로 떨어질 수 있습니다. Veo 3.1은 동영상 전용 생성에서 약 85-90%의 유사한 성공률을 보이지만, 오디오 생성이 추가되면 또 다른 잠재적 실패 지점이 발생하여 동영상+오디오 요청의 유효 성공률이 약 75-80%로 감소할 수 있습니다. 서드파티 제공자를 통한 Seedance 2.0은 일반적으로 75-85%의 성공률을 보이며, 하한선은 중국과 해외의 콘텐츠 모더레이션 정책 차이를 반영합니다. 이러한 성공률은 100개의 사용 가능한 동영상을 생성하는 데 100개 이상의 API 호출이 필요하다는 것을 의미합니다.

사용 가능한 10초 동영상 100개의 실제 비용:

| 시나리오 | Sora 2 (720p) | Veo 3.1 Fast (720p, 오디오 없음) | Seedance 2.0 (720p) |

|---|---|---|---|

| 이론적 비용 (100개) | $100 | $80 | ~$60 |

| 필요 API 호출 수 (85% 성공률) | ~118 | ~118 | ~125 |

| 실제 API 비용 | ~$118 | ~$94 | ~$75 |

| 품질 재생성 (20%) | ~$24 | ~$19 | ~$15 |

| 총 실제 비용 | ~$142 | ~$113 | ~$90 |

| 유효 동영상당 비용 | ~$1.42 | ~$1.13 | ~$0.90 |

이 계산에서 알 수 있듯이, 실패와 품질 재생성을 고려하면 유효 동영상당 비용은 이론적 비용보다 약 40-50% 높습니다. Seedance 2.0은 약간 낮은 성공률을 감안하더라도 비용 우위를 유지하며, 고속 모드의 Veo 3.1은 가격과 품질 사이의 강력한 중간 지점을 제공합니다. 약 20%의 품질 재생성 비율은 성공적으로 생성되었지만 창의적 요구 사항과 일치하지 않아 개선된 프롬프트로 추가 시도가 필요한 동영상을 설명합니다. 월간 수천 개의 동영상을 생성하는 엔터프라이즈 배포의 경우, 이러한 승수가 복합적으로 작용하여 플랫폼 선택이 재정적으로 중요한 의미를 가지게 됩니다.

직접적인 API 비용 외에도 동영상 저장 및 콘텐츠 전송 비용도 예산에 포함해야 합니다. 10초 720p 동영상 파일은 압축에 따라 일반적으로 5-15 MB 범위이며, 1080p 및 4K 동영상은 클립당 30-80 MB에 달할 수 있습니다. 클라우드 스토리지 비용 약 $0.02/GB/월, CDN 전송 비용 $0.08-$0.12/GB를 기준으로, 월 1,000개 동영상의 저장 및 대역폭 비용은 월별 청구서에 약 $15-$50을 추가합니다. 이 오버헤드는 생성 비용에 비해 상대적으로 작지만, 콘텐츠 라이브러리 크기에 따라 선형적으로 증가하며 엔터프라이즈 규모에서는 상당해집니다. 30-60일 후 미사용 생성물을 삭제하는 자동 정리 정책을 구현하고, 웹 전송 시나리오에서 인지 가능한 품질 손실 없이 파일 크기를 40-60% 줄이는 동영상 압축 파이프라인을 사용하는 것을 권장합니다.

프로덕션 배포 — 요청 제한, 에러, 스케일링

작동하는 프로토타입에서 프로덕션 배포로 이동하면 어떤 기능 비교 표에서도 보여주지 않는 제약 조건이 도입됩니다. 요청 제한은 최대 처리량을 결정하고, 에러 패턴은 안정성 아키텍처에 영향을 미치며, 피크 시간대의 대기열 동작은 사용자 경험을 좌우할 수 있습니다. 이 섹션에서는 공식 문서와 이러한 API를 대규모로 운영하는 팀의 개발자 커뮤니티 보고서를 기반으로, 상위 10개 기사 중 어디에서도 종합적으로 다루지 않는 프로덕션 현실을 다룹니다.

요청 제한 및 처리량

요청 제한은 가장 중요한 프로덕션 제약 조건이면서 세 가지 API 모두에서 가장 문서화가 부족한 부분입니다. OpenAI의 Sora 2는 API 티어에 기반한 요청 제한을 부과합니다. 무료 티어 사용자는 매우 제한된 접근 권한을 받으며, 유료 티어 사용자는 약 10-15개의 동시 생성 요청을 제출할 수 있고, 처리량은 사용 내역과 계정 연령에 따라 확장됩니다. Google의 Vertex AI를 통한 Veo 3.1은 Google Cloud 프로젝트에 연결된 할당량 시스템을 사용하며, 대부분의 프로젝트에 대해 분당 약 50개 요청의 기본 제한이 있지만, 프로덕션 워크로드를 위해 Google Cloud 콘솔을 통해 할당량 증가를 요청할 수 있습니다. Seedance 2.0의 요청 제한은 전적으로 서드파티 제공자에 따라 다르며, 대부분 표준 플랜에 대해 5-20개의 동시 생성을 제공합니다.

| 제약 조건 | Sora 2 | Veo 3.1 | Seedance 2.0 |

|---|---|---|---|

| 동시 요청 | 10-15 (유료 티어) | ~50/분 (Vertex AI 기본) | 5-20 (제공자 의존) |

| 생성 시간 (10초 동영상) | 30초-3분 | 20초-90초 (fast 모드) | 2-5분 |

| 최대 대기열 깊이 | ~50 | ~200 | 제공자 의존 |

| 타임아웃 임계값 | 10분 | 5분 | 15분 |

일반적인 에러 패턴

각 API가 어떻게 실패하는지 이해하면 탄력적인 시스템을 구축하는 데 도움이 됩니다. Sora 2의 가장 빈번한 에러는 콘텐츠 모더레이션 거부로, 프롬프트 내용에 따라 전체 요청의 약 5-10%를 차지합니다. 이러한 거부는 제출 시점이 아닌 생성 중에 발생합니다. 즉, 생성이 차단되었다는 것을 알기까지 이미 30초 이상을 기다린 것입니다. Veo 3.1의 가장 일반적인 실패 모드는 복잡한 장면 생성 중 타임아웃이며, 특히 모델이 시각적 요소와 오디오 요소를 동기화해야 하는 동영상+오디오 요청에서 두드러집니다. 서드파티 제공자를 통한 Seedance 2.0은 게이트웨이 타임아웃, 제공자 측 요청 제한 에러, 유지보수 기간 중 간헐적인 모델 비가용성을 포함하여 제공자 수준에서 추가적인 실패 가능성이 있습니다. 견고한 에러 처리를 구축하려면 지터가 포함된 지수 백오프를 구현하고, 요청당 재시도 예산을 유지하며, 대체 전략(다른 모델 또는 사용자를 위한 우아한 성능 저하 경로)을 마련해야 합니다.

스케일링 전략

하루 100개 이상의 동영상을 생성하는 프로덕션 워크로드의 경우, 어떤 API를 선택하든 대기열 기반 아키텍처가 필수적입니다. 생성 요청을 작업 대기열에 제출하고, 웹훅 또는 폴링 워커를 통해 비동기적으로 완료를 처리하며, 결과를 CDN 전송이 가능한 클라우드 스토리지에 저장합니다. 이 패턴은 사용자 대면 애플리케이션을 동영상 생성의 가변 지연 시간으로부터 격리하며, 이 지연 시간은 세 플랫폼 모두 대기열 시간이 증가하는 피크 시간대에 급증할 수 있습니다. 실용적인 권장 사항은 어댑터 패턴을 사용하여 제공자 간 요청 및 응답 형식을 정규화함으로써 세 가지 API 모두와 교환 가능하게 작동하도록 시스템을 설계하는 것입니다. 이를 통해 가용성, 비용, 품질 요구 사항에 따라 실시간으로 트래픽을 라우팅할 수 있습니다. 처음부터 다중 제공자 전략을 구현하면 볼륨이 증가함에 따라 협상력도 갖게 됩니다. 특정 콘텐츠 유형에 대해 가격, 안정성, 품질의 최적 조합을 제공하는 플랫폼으로 트래픽을 신뢰성 있게 전환할 수 있기 때문입니다. 다중 제공자 아키텍처를 배포한 팀은 단일 제공자 설정에 비해 15-25% 낮은 유효 비용과 99.5% 이상의 가용성을 보고하는데, 이는 제공자별 장애가 더 이상 전체 파이프라인을 차단하지 않기 때문입니다.

비용 최적화 — 통합 서비스와 스마트 전략

가장 저렴한 초당 요금을 선택하는 것 외에도, 프로덕션에서 동영상 생성 비용을 크게 절감할 수 있는 여러 전략이 있습니다. 많은 개발자에게 가장 영향력 있는 최적화는 단일 인터페이스를 통해 여러 동영상 생성 모델에 접근할 수 있는 API 통합 서비스를 사용하는 것이며, 특정 요구 사항에 따라 각 요청에 가장 비용 효율적인 모델을 선택하는 지능형 라우팅을 결합하는 것입니다. 다른 전략으로는 첫 시도 성공률을 높이기 위한 프롬프트 최적화, 재사용을 위한 생성 동영상 캐싱, 그리고 미리보기에는 저렴한 모델을 사용하고 최종 렌더링에만 프리미엄 모델을 예약하는 계층화된 품질 선택이 있습니다.

API 통합 서비스는 여러 동영상 생성 플랫폼에 접근해야 하는 팀을 위한 실용적인 솔루션으로 부상했습니다. Sora 2, Veo 3.1, Seedance 2.0에 대한 별도의 API 키, 결제 계정, SDK 통합을 관리하는 대신, 통합 서비스는 요청을 적절한 기본 API로 라우팅하는 통합 엔드포인트를 제공합니다. 배치 생성이나 프로덕션 사용이 필요한 개발자를 위해 laozhang.ai는 통합 API를 통해 Sora 2와 Veo 3.1 모두에 대한 접근을 제공합니다. Sora 2를 예로 들면, 요청당 가격은 720p(10-15초 동영상)의 경우 $0.15/요청, 1080p Pro 품질의 경우 $0.80/요청부터 시작합니다. Veo 3.1의 경우, fast 모드는 $0.15/요청, standard 모드는 $0.25/요청으로 이용 가능합니다. 핵심 장점은 실패 시 무과금 정책입니다. 콘텐츠 모더레이션이 프롬프트를 거부하든 생성이 타임아웃되든, 비용이 청구되지 않습니다. 이 정책만으로도 공식 API에서 실패한 생성에도 크레딧이 소비되거나 비용이 발생하는 것과 비교하여 총 동영상 생성 예산의 10-15%를 절약할 수 있습니다. 다양한 통합 서비스 비교를 통해 가장 저렴한 Sora 2 API 접근을 찾아볼 수도 있습니다.

python# Unified aggregator integration — access Sora 2, Veo 3.1, and more # through a single OpenAI-compatible endpoint from openai import OpenAI client = OpenAI( api_key="your_laozhang_api_key", base_url="https://api.laozhang.ai/v1" ) # Generate with Sora 2 sora_response = client.chat.completions.create( model="sora-2", # Switch to "veo-3.1-fast" for Veo 3.1 messages=[{ "role": "user", "content": "A time-lapse of a flower blooming in morning light" }], stream=True ) # Same endpoint, different model — no SDK changes needed veo_response = client.chat.completions.create( model="veo-3.1-fast", messages=[{ "role": "user", "content": "A chef preparing sushi with precise movements, ambient sounds" }], stream=True )

통합 서비스 외에, 프롬프트 엔지니어링은 두 번째로 효과적인 비용 최적화 전략입니다. 장면, 카메라 앵글, 조명, 움직임 스타일을 명확하게 설명하는 잘 작성된 프롬프트는 더 높은 첫 시도 성공률을 달성하여, 비용이 많이 드는 재생성의 필요성을 줄입니다. 프로덕션 경험에 기반하면, 생성 요청을 제출하기 전에 프롬프트 개선에 5-10분을 투자하면 성공률을 70%에서 90% 이상으로 향상시킬 수 있으며, 이는 세 플랫폼 모두에서 유효 동영상당 비용의 20-25% 절감으로 직접 연결됩니다. 통합 서비스 통합에 대한 자세한 문서는 docs.laozhang.ai에서 확인하실 수 있습니다.

어떤 API를 선택해야 할까? — 의사결정 프레임워크

가격, 통합 복잡성, 프로덕션 제약 조건, 최적화 전략을 검토한 후, 의사결정은 궁극적으로 특정 프로젝트 요구 사항에 따라 결정됩니다. 모호한 "상황에 따라 다릅니다" 결론 대신, 다섯 가지 일반적인 개발자 시나리오를 기반으로 한 명확한 추천 프레임워크를 제시합니다. 이 세 가지 외에 추가 플랫폼을 포함하는 더 넓은 관점은 주요 AI 동영상 모델 종합 비교 가이드에서 확인하실 수 있습니다.

오디오가 필요하다면 Veo 3.1을 선택하십시오. 이것은 전체 비교에서 가장 단순한 결정 포인트입니다. 2026년 3월 기준으로, Veo 3.1은 세 가지 API 중 동영상과 함께 동기화된 오디오를 생성하는 유일한 API입니다. 프로젝트에 소리가 필요하다면(보이스오버가 포함된 제품 데모, 음악이 포함된 소셜 미디어 콘텐츠, 자연 오디오가 포함된 앰비언트 장면) Veo 3.1은 별도의 오디오 생성 및 동기화 파이프라인이 불필요합니다. 오디오 지원 생성에 지불하는 프리미엄(표준 1080p 동영상+오디오 $0.40/초 vs Sora 2 720p 동영상만 $0.10/초)은 후처리에서 오디오를 추가하는 엔지니어링 및 컴퓨팅 비용보다 상당히 적습니다. 8초 최대 길이가 주요 제한이지만, 숏폼 콘텐츠, 소셜 미디어 클립, 제품 쇼케이스에는 일반적으로 충분합니다.

사실적인 움직임이 필요하다면 Sora 2를 선택하십시오. Sora 2의 물리 시뮬레이션 엔진은 세 가지 중 가장 자연스러운 움직임을 생성하며, 특히 물, 천, 머리카락, 복잡한 객체 상호작용이 포함된 장면에서 뛰어납니다. 20초 최대 길이는 세 가지 중 가장 길어, 확장된 샷이 필요한 내러티브 콘텐츠에 최적의 선택입니다. OpenAI SDK 통합은 이미 GPT-4 또는 DALL-E를 사용하는 팀이 최소한의 새로운 인프라로 동영상 생성을 스택에 추가할 수 있음을 의미합니다. 720p $0.10/초의 표준 티어는 접근 가능한 시작점을 제공하며, 1080p $0.50/초의 프로 티어는 방송 품질의 출력을 제공합니다.

예산이 최우선이라면 Seedance 2.0을 선택하십시오. 기본 720p 생성에 초당 약 $0.06으로, Seedance 2.0은 Veo 3.1이나 Sora 2의 가장 저렴한 티어보다 약 40% 저렴합니다. 캐릭터 일관성 기능도 특히 강력하여, 동일한 캐릭터가 여러 동영상에 등장하는 애니메이션 콘텐츠 시리즈에 탄탄한 선택입니다. 트레이드오프는 현실적입니다. 공식 API가 없다는 것은 서드파티 제공자에 의존해야 함을 의미하고, 문서가 덜 포괄적이며, 가용성이 일관되지 않을 수 있습니다. 비용 효율성이 공식 지원과 보장된 SLA의 필요성보다 중요한 프로젝트에서 Seedance 2.0은 강력한 가치를 제공합니다.

유연성이 필요하다면 통합 서비스를 선택하십시오. 다양한 품질 요구 사항에 따라 수천 개의 동영상을 생성할 프로덕션 시스템의 경우, 단일 API에 고정하는 것은 전략적 위험입니다. 통합 서비스를 사용하면 단순한 미리보기 생성은 가장 저렴한 모델로, 프리미엄 시네마틱 콘텐츠는 Sora 2 Pro로, 오디오가 필요한 콘텐츠는 Veo 3.1로 라우팅할 수 있으며, 이 모든 것이 단일 API 통합을 통해 이루어집니다. 이 접근 방식은 또한 제공자 간 자동 장애 조치를 제공하여 플랫폼 장애, 가격 변경, 요청 제한 제약에 대한 보호 기능도 합니다.

프로토타입 단계라면 가장 저렴한 옵션부터 시작하십시오. AI 동영상 생성이 제품에 적합한지 아직 파악 중인 초기 단계 프로젝트의 경우, Sora 2의 표준 티어 $0.10/초 또는 Veo 3.1 Fast $0.10/초로 시작하십시오. 둘 다 각각의 플랫폼(OpenAI 및 Google AI Studio)을 통해 무료 티어 접근을 제공하여, 예산을 투입하기 전에 사용 사례를 검증할 수 있습니다. 제품-시장 적합성을 검증하고 생성 볼륨을 파악한 후, 프로덕션 요구 사항에 가장 적합한 플랫폼으로 마이그레이션하십시오.

결론적으로 모든 차원에서 이기는 단일 API는 없습니다. 2026년 동영상 생성 API 시장이 건강한 이유는 각 플랫폼이 뚜렷한 니치를 개척했기 때문입니다. 선택은 가장 낮은 헤드라인 가격을 가진 API가 아니라 제품 요구 사항에 의해 결정되어야 합니다. 통합 노력, 실패율, 애플리케이션에 필요한 특정 기능을 고려하면 가장 저렴한 초당 요금이 반드시 가장 낮은 총소유비용으로 이어지지는 않기 때문입니다. 이러한 권장 사항을 고려한 후에도 여전히 불확실하다면, 세 가지 모두에 접근할 수 있는 통합 서비스로 시작하여 단일 플랫폼에 전념하기 전에 실제 콘텐츠로 A/B 테스트를 실행하는 것이 가장 안전한 시작점입니다.

FAQ — 자주 묻는 질문

Sora 2 API는 공개적으로 사용 가능합니까, 아니면 특별한 접근이 필요합니까?

네, Sora 2 API는 2026년 초부터 OpenAI의 표준 API 플랫폼을 통해 공개적으로 사용 가능합니다. 유효한 결제 수단이 있는 OpenAI API 계정이 필요하며, 동영상 생성 접근을 위한 별도의 대기 목록은 없습니다. API는 GPT-4 및 DALL-E에 사용되는 동일한 인증 플로우를 통해 접근 가능하며, 생성된 동영상 초당 가격이 적용됩니다. 요청 제한은 계정 티어에 따라 확장되므로 새 계정은 사용 이력이 쌓이면서 증가하는 낮은 제한으로 시작합니다. 세 가지 모델 변형(sora-2, 720p의 sora-2-pro, 1080p의 sora-2-pro) 모두 추가 승인 없이 모든 유료 API 사용자에게 제공됩니다.

각 API로 1분 분량의 동영상을 생성하는 데 비용이 얼마나 드나요?

가장 저렴한 티어 기준으로, 1분 동영상의 비용은 Sora 2의 경우 약 $6.00(720p, $0.10/초), Veo 3.1 Fast의 경우 약 $6.00(720p 동영상 전용, $0.10/초), Seedance 2.0의 경우 약 $3.60(720p 기본, ~$0.06/초)입니다. 그러나 이 수치는 단일 연속 클립을 가정한 것이며, 현재 어떤 API도 이를 지원하지 않습니다. Veo 3.1은 최대 8초, Seedance 2.0은 최대 15초, Sora 2는 최대 20초입니다. 1분 분량의 동영상을 생성하려면 클립 길이에 따라 3-8번의 별도 API 호출이 필요하며, 각각 자체 성공률 오버헤드가 있습니다. 실패와 재생성을 고려한 1분 분량의 사용 가능한 동영상 콘텐츠의 현실적 비용은 Sora 2의 경우 약 $8-$12, Veo 3.1 Fast의 경우 약 $8-$12, Seedance 2.0의 경우 약 $5-$7입니다.

중국 외부에서 Seedance 2.0 API에 접근할 수 있나요?

Seedance 2.0은 2026년 3월 기준으로 공식 해외 API가 없습니다. ByteDance의 주요 접근 채널은 JiMeng 플랫폼(jimeng.jianying.com)이며, 이는 중국 시장 사용자를 위해 설계되었고 등록에 중국 전화번호가 필요합니다. 해외 개발자는 프록시 통합을 구축한 서드파티 API 제공자(fal.ai와 같은 플랫폼 및 다양한 통합 서비스 포함)를 통해 Seedance 2.0에 접근할 수 있습니다. 이러한 제공자는 기본 접근을 처리하고 어떤 지리적 위치에서도 작동하는 표준 REST API를 노출합니다. 트레이드오프는 ByteDance와 직접 거래하는 대신 가용성과 가격에 대해 서드파티 제공자에 의존한다는 것입니다.

어떤 API가 가장 좋은 이미지-투-비디오 기능을 제공하나요?

세 가지 API 모두 이미지-투-비디오 생성을 지원하지만, 접근 방식이 다릅니다. Veo 3.1은 고유한 "첫 번째와 마지막 프레임" 모드를 갖춘 가장 다재다능한 이미지-투-비디오 시스템을 제공합니다. 시작 이미지와 종료 이미지를 모두 제공하면 모델이 그 사이의 부드러운 전환을 생성합니다. 이는 제품 시각화 및 애니메이션 워크플로우에 특히 강력합니다. Sora 2는 단일 참조 이미지 입력을 지원하여 동영상 생성을 안내하며, 입력 이미지의 스타일과 구도를 밀접하게 따르는 결과를 생성합니다. Seedance 2.0은 캐릭터 참조 이미지를 받아 여러 동영상 생성에서 일관성을 유지할 수 있는 다중 모달 참조 시스템을 특징으로 하여, 지속적인 캐릭터 정체성이 필요한 프로젝트에 가장 강력한 옵션입니다.

동영상 생성에 실패하면 어떻게 되나요 — 여전히 과금되나요?

실패에 대한 과금 정책은 상당히 다릅니다. OpenAI의 Sora 2 API 과금은 출력 동영상 길이에 기반하므로, 출력을 생성하기 전에 생성이 실패하면 일반적으로 과금되지 않습니다. 다만 생성 중 발생하는 콘텐츠 모더레이션 거부는 일부 할당량을 소비할 수 있습니다. Google의 Vertex AI를 통한 Veo 3.1도 성공적인 출력에 대해서만 지불하는 유사한 패턴을 따릅니다. Seedance 2.0의 서드파티 제공자는 실패 정책이 다양합니다. laozhang.ai와 같은 통합 서비스는 비동기 API 엔드포인트에 대해 명시적으로 실패 시 무과금 보장을 제공합니다. 이는 콘텐츠 모더레이션 거부와 타임아웃을 포함하여 실패 사유에 관계없이 성공적으로 생성된 동영상에 대해서만 비용을 지불한다는 의미입니다. 이 정책 차이는 실패율이 무시할 수 없는 프로덕션 환경에서 총 비용의 10-15%를 절약할 수 있습니다.