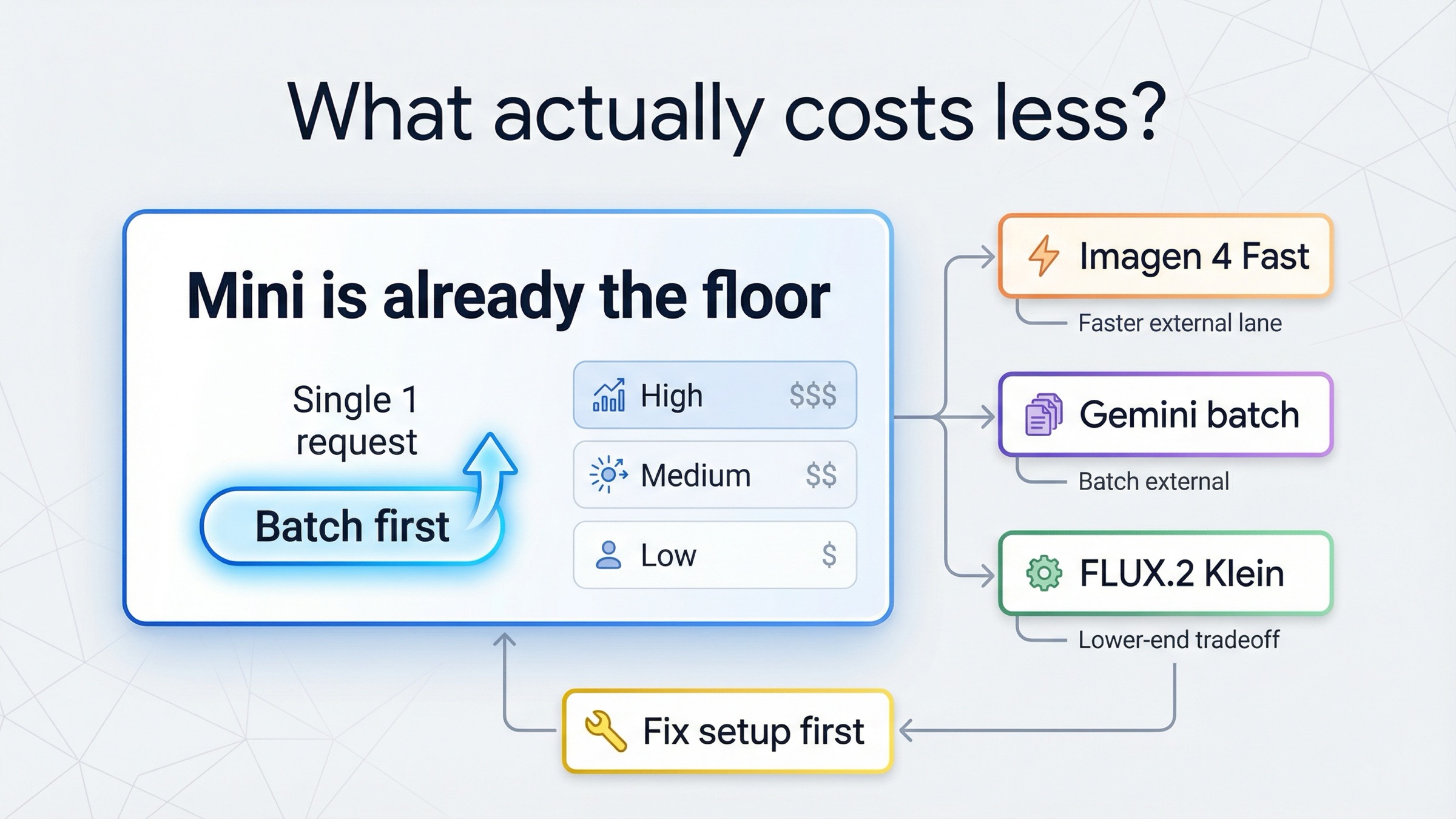

2026년 3월 29일 기준으로 gpt-image-1-mini 의 현재 low와 medium price row를 안정적으로 밑도는 clean한 mainstream hosted API는 없습니다. OpenAI의 현재 gpt-image-1-mini 모델 페이지는 square 1024x1024 기준 low, medium, high를 각각 \$0.005, \$0.011, \$0.036 으로 보여 줍니다. 이 한 가지 사실만으로도 검색 결과에 많은 generic alternatives page와 출발점이 달라집니다. 가격만이 문제라면, 첫 cheaper move는 모델을 바꾸는 것이 아니라 mini에 남아 Batch 를 시험하는 것입니다.

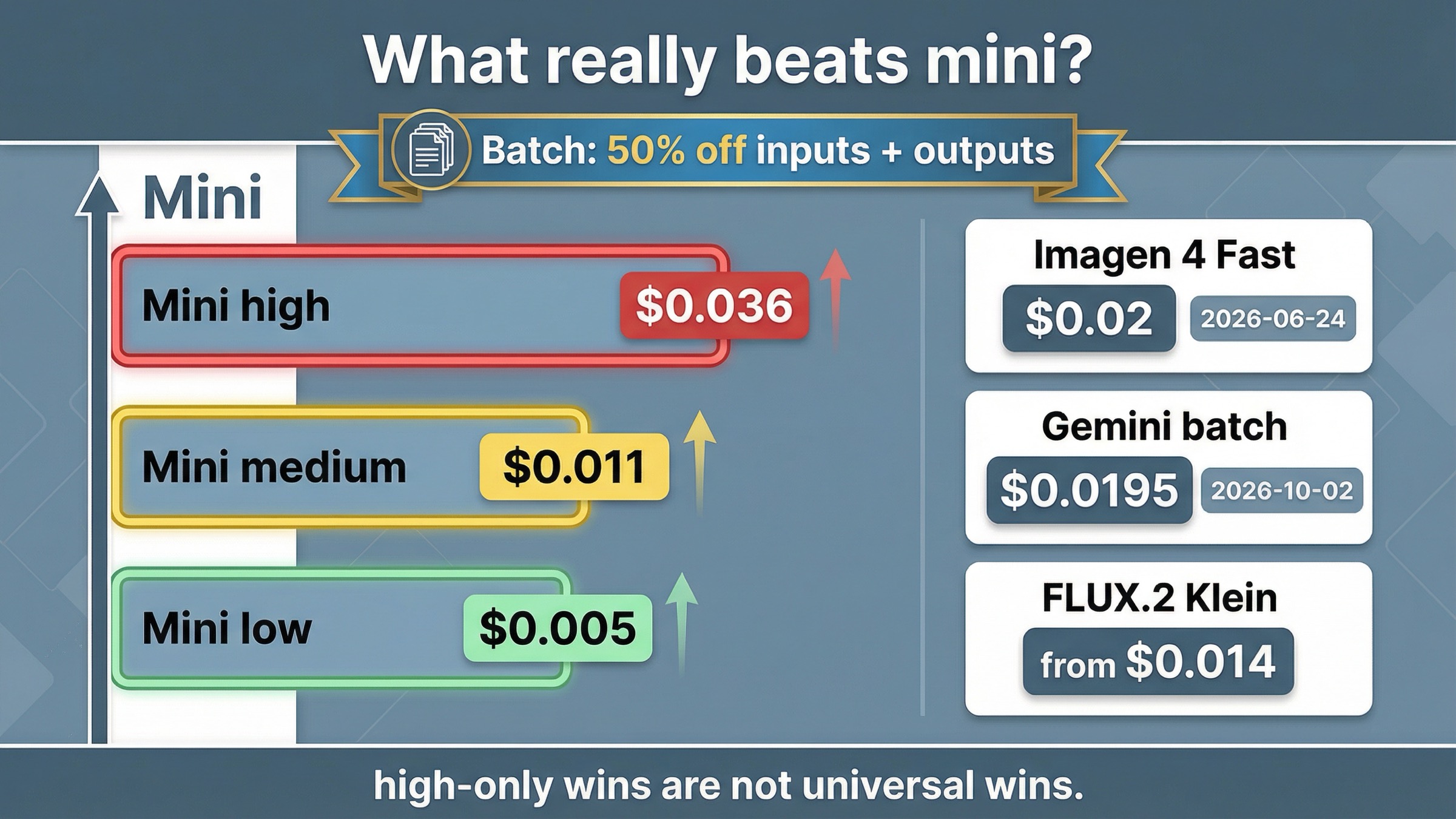

현재 SERP가 가장 자주 흐리는 지점도 여기입니다. 넓은 pricing grid는 Imagen 4 Fast가 0.02, gemini-2.5-flash-image batch가 0.0195, FLUX.2 Klein이 0.014 또는 0.015부터 시작한다고 말해 줍니다. 하지만 그 row가 mini 전체보다 싼지, mini high만 이기는지, 아니면 job 자체와 quality target, route의 shelf life가 달라져서 싸 보이는지까지는 잘 분리하지 않습니다.

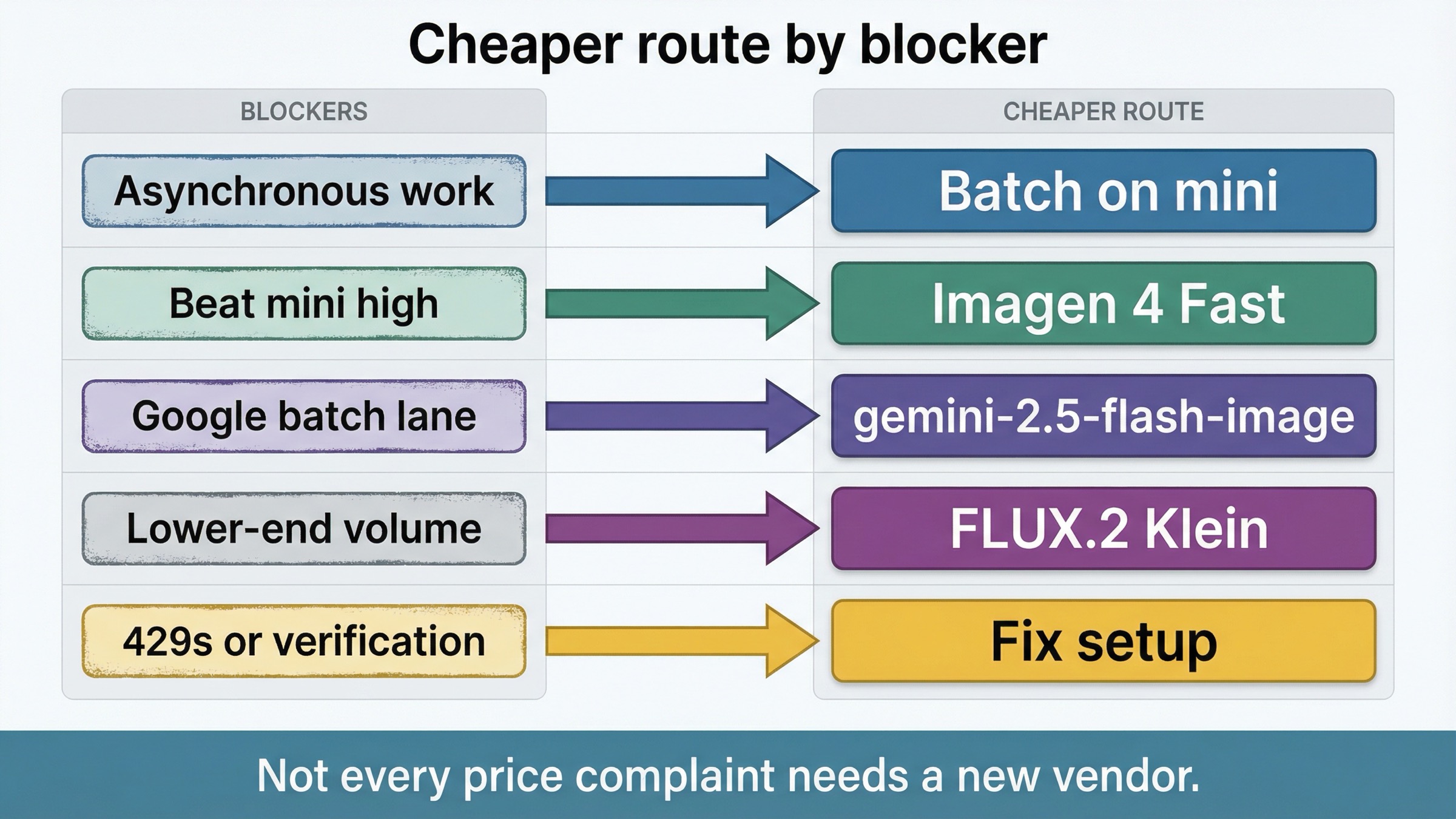

이 keyword에는 두 번째 함정도 있습니다. gpt-image-1-mini cheaper alternative 검색 가운데 일부는 애초에 model-selection problem이 아닙니다. live와 Batch routing의 차이이거나, verification, tier state, access pain 때문에 workflow가 비싸게 느껴질 뿐입니다. 만약 진짜 문제의 중심이 quality, typography, editing이라면 다음 글은 GPT Image 1 Mini alternative가 더 맞습니다. 이 페이지는 price-first decision만 다룹니다.

핵심 요약

빠른 routing answer만 필요하다면 먼저 이 표를 보세요.

| 실제 goal이... | 지금 가장 설득력 있는 저비용 선택 | 현재 price anchor | 왜 성립하나 | 핵심 caveat |

|---|---|---|---|---|

| OpenAI 안에서 가장 싼 공식 image lane을 유지하고 싶다 | gpt-image-1-mini 에 남는다 | \$0.005 / \$0.011 / \$0.036 | mini 자체가 현재 OpenAI의 cost-efficient branch이기 때문 | mini의 quality ceiling은 그대로다 |

| 모델을 바꾸지 않고 비동기 작업 비용을 낮추고 싶다 | mini 그대로 Batch를 시험한다 | OpenAI는 inputs와 outputs가 50% off 라고 안내 | 먼저 줄여야 하는 것은 vendor가 아니라 workflow일 수 있다 | OpenAI는 mini 전용 batch per-image card를 공개하지 않았고 Batch는 비동기다 |

| mini high 만 이기면 되는 단순한 Google-hosted lane이 필요하다 | Imagen 4 Fast | \$0.02 / image | mini high보다 낮고 설명도 쉽다 | mini low나 medium보다 여전히 비싸고 Google docs에는 2026년 6월 24일 shutdown date가 있다 |

| Google의 현재 image row 중 mini high 를 넘고 싶다 | gemini-2.5-flash-image batch | \$0.0195 / image | Google이 공개한 현재 저가 image row이기 때문 | mini low나 medium보다 여전히 비싸고 Google docs에는 2026년 10월 2일 shutdown date가 있다 |

| lower-end external high-volume lane을 사고 싶다 | FLUX.2 Klein | \$0.014 에서 \$0.015 시작 | 일부 lower-end workload에서는 mini high보다 낮아질 수 있다 | megapixel pricing이며 GPT Image의 like-for-like replacement가 아니다 |

| access, verification, route pain을 먼저 해결해야 한다 | OpenAI에 남아 setup을 고친다 | 모델 변경이 필요 없다 | vendor switch는 tier나 verification state를 해결하지 못한다 | economics를 보기 전에 route 디버깅이 필요하다 |

실무 규칙은 간단합니다. mini high보다 싸다는 것과 mini 전체보다 싸다는 것은 다릅니다. 이 둘을 섞으면 현재 floor에서 이유 없이 벗어나게 됩니다.

왜 mini가 이미 현재 floor인가

이 글에서 가장 중요한 것은 comparison row를 더 늘리는 것이 아니라 mini를 어떤 위치로 읽어야 하는지 분명히 하는 일입니다.

OpenAI의 현재 models catalog는 family 역할을 꽤 선명하게 나눕니다. GPT Image 1.5 는 state-of-the-art image generation model, GPT Image 1 은 previous generation model, gpt-image-1-mini 는 cost-efficient branch입니다. 즉 mini는 우연히 남아 있는 싸구려 줄이 아니라, OpenAI가 현재의 저비용 쪽으로 공식 배치해 둔 route입니다.

같은 mini model page는 price split도 그대로 보여 줍니다. square 1024x1024 출력 기준 low 0.005, medium 0.011, high 0.036. 이 세 줄이 있기 때문에 cheaper-alternative keyword가 더 까다로워집니다. 많은 pricing page는 mini에 하나의 가격만 있는 것처럼 경쟁사 숫자 하나와 OpenAI 숫자 하나를 나란히 둡니다. 하지만 실제로는 어떤 row를 사고 있는지가 중요합니다.

그래서 겉보기에는 싼 외부 route 상당수가 mini 전체를 이기는 것은 아닙니다. Imagen 4 Fast의 0.02 와 gemini-2.5-flash-image batch의 0.0195 는 mini high 보다 저렴하지만, mini low 와 mini medium 보다 싸지는 않습니다. 현재 작업이 이미 low나 medium에 맞는다면, Google의 저가 row는 생각만큼 강한 price win이 아닙니다.

같은 이유로 Batch 가 상단에 와야 합니다. OpenAI의 현재 API pricing page 는 Batch API가 inputs와 outputs를 50% 절감 한다고 말합니다. mini model page 역시 Batch를 supported endpoint family로 보여 줍니다. OpenAI는 mini 전용 batch per-image card를 따로 공개하지 않았기 때문에, 이것은 고정 새 가격표라기보다 workflow optimization으로 읽는 편이 안전합니다. 그래도 routing 의미는 큽니다. workload를 queue에 태울 수 있다면 첫 cheaper experiment는 새 vendor가 아니라 mini plus Batch 인 경우가 많기 때문입니다.

이 지점은 legacy answer를 피하는 데도 중요합니다. 현재 image generation guide는 DALL-E 2 와 DALL-E 3 가 2026년 5월 12일 에 requests 지원을 끝낸다고 안내합니다. 겉으로는 싸 보이는 오래된 row가 남아 있더라도, 오늘의 default answer는 아닙니다.

mini 자체의 가격 사다리만 보고 싶다면 다음은 GPT Image 1 Mini pricing이 자연스럽습니다. mini를 넘어서 OpenAI image stack 전체보다 저렴한 route를 묻는다면 OpenAI image generation API cheaper alternative가 더 맞습니다.

현재 가격 그림은 universal win과 narrow win을 나누면 훨씬 선명해집니다.

| Route | 현재 공개된 price surface | 실제로 이기는 대상 | 핵심 caveat |

|---|---|---|---|

| Mini live | \$0.005 / \$0.011 / \$0.036 | OpenAI 내부 baseline floor | 익숙한 mini quality ceiling 그대로 |

| Mini + Batch | inputs와 outputs 50% off | 비동기라면 같은 workflow의 최저 후보 | mini 전용 batch image card는 공개되지 않았다 |

| Imagen 4 Fast | \$0.02 / image | mini high | shutdown date는 2026년 6월 24일 |

gemini-2.5-flash-image batch | \$0.0195 / image | mini high | shutdown date는 2026년 10월 2일 |

| FLUX.2 Klein 4B / 9B | \$0.014 / \$0.015 부터 | 일부 lower-end mini-high 비교 | megapixel pricing이며 quality target도 다르다 |

이 표가 글의 본문입니다. 나머지 문단은 각 row가 어떤 조건에서만 정직한 답이 되는지를 설명할 뿐입니다.

Google의 싼 row가 실제로 의미가 있을 때

Google이 중요한 것은, 그것이 해결하는 문제를 좁게 잡았을 때뿐입니다.

가장 설명하기 쉬운 Google-hosted generation lane은 Imagen 4 Fast 의 \$0.02 / image 입니다. 이 숫자는 Google의 현재 Gemini Developer API pricing page에 나옵니다. 비교 대상이 mini high 이고, OpenAI 내부의 queue나 workflow tweak가 아니라 단순한 hosted generation product를 원한다면, 이것은 타당한 answer입니다.

하지만 그 price row는 caveat와 붙어 있어야만 안전합니다. Google의 현재 deprecations page는 imagen-4.0-fast-generate-001 에 2026년 6월 24일 shutdown date를 붙여 두고 있습니다. 즉 Imagen 4 Fast는 오늘 당장 못 쓰는 route는 아니지만, short-horizon cheaper lane 이지, 장기 default로 생각을 멈춰도 되는 route는 아닙니다.

gemini-2.5-flash-image batch는 더더욱 문맥 의존적입니다. 현재 pricing page는 batch 0.0195 / image, standard 0.039 / image 를 보여 줍니다. 그래서 mini high를 넘는 깔끔한 cheap-looking row처럼 보입니다. 하지만 같은 현재 deprecations page는 gemini-2.5-flash-image 에 2026년 10월 2일 shutdown date를 적고 있습니다. 싸다는 사실도, clock이 있다는 사실도 둘 다 맞습니다.

그래서 Google에 대해 남겨야 할 결론은 사실 꽤 좁습니다.

- Imagen 4 Fast 는 mini high보다 싸면서 단순한 Google-hosted generation lane이 필요할 때 쓴다

gemini-2.5-flash-imagebatch 는 더 짧은 lifecycle과 batch path를 받아들일 때만 쓴다- 둘 다 mini 전체보다 싸다고 쓰지 않는다

마지막 한 줄이 trust의 기준입니다. 현재 일이 mini low나 medium으로 충분하다면, Google은 더 깨끗한 price win을 가져오는 것이 아닙니다. 다른 platform, 다른 lifecycle, 그리고 mini의 한 줄에 대해서만 싸 보이는 숫자를 가져오는 것입니다.

BFL이 싸 보이는 이유는 job이 바뀌기 때문이다

Black Forest Labs는 Google과는 다른 이유로 이 글에 들어옵니다.

현재 BFL pricing page 에는 분명 더 낮은 starting lane이 있습니다. FLUX.2 [klein] 4B가 0.014부터, FLUX.2 [klein] 9B가 0.015부터 이고 둘 다 megapixel-based pricing입니다. 이 지점만 보면 mini high 아래로 들어갈 수 있는 line으로 진지하게 볼 만합니다.

하지만 BFL의 의미는 "mini의 싸고 똑같은 복제본이 있다"가 아닙니다. 의미는 Klein이 lower-end high-volume lane으로서 다른 product posture를 가진다 는 데 있습니다. BFL 자신도 real-time, high-volume, balanced quality-speed라는 전제 위에 Klein을 둡니다. 즉 GPT Image family와 같은 promise를 싸게 파는 것이 아니라, 다른 job shape를 싸게 만드는 route입니다.

SERP가 자주 놓치는 것도 이 차이입니다. cheap는 항상 같은 일을 더 낮은 숫자로 사는 뜻이 아닙니다. 경우에 따라서는

- quality expectation이 낮아지고

- output-size economics가 달라지고

- operating assumption이 바뀌고

- OpenAI-style behavior 대신 volume-first lane을 사게 되는 것

을 뜻합니다.

그래서 BFL recommendation도 좁게 유지해야 합니다. FLUX.2 Klein은 lower-end external volume lane을 의도적으로 고를 때만 의미 있는 cheaper alternative입니다. mini의 one-to-one replacement로 놓으면 안 됩니다.

같은 pricing page는 이 페이지에서 빼야 할 것도 보여 줍니다. FLUX.1 Kontext [pro] 는 0.04 / image 입니다. 이는 mini high보다 저렴하지 않습니다. edit-heavy workflow에서는 여전히 강한 선택일 수 있지만, 그것은 cheap answer가 아니라 better-fit answer이므로 GPT Image 1 Mini alternative 쪽으로 보내는 편이 맞습니다.

진짜 문제가 price가 아니라 setup일 때

cheaper-alternative query가 실제보다 강해 보이는 이유 중 하나는 access pain이 곧바로 price pain처럼 느껴진다는 점입니다.

OpenAI의 현재 organization verification help page는 verification이 image-generation capabilities를 unlock하고, spending thresholds는 필요 없으며, 반영에 최대 30분 이 걸릴 수 있고, "still not verified"가 남으면 새 API key를 생성 하면 풀리는 경우가 있다고 말합니다. 이것은 pricing advice는 아니지만 routing advice로는 중요합니다. 문제가 verification이나 route state라면 vendor switch는 다른 문제를 풀고 있는 셈입니다.

현재의 OpenAI community thread on gpt-image-1 rate-limit errors 를 봐도 같습니다. credits나 verification 이후에도 실제 이미지 생성 전에 429나 free-tier-like failure를 겪는 사람이 있습니다. 그 뒤 대화는 payment state, tier, support, key regeneration 쪽으로 흘러갑니다. 이것은 cheap model의 대화가 아니라 아직 아무것도 정상적으로 shipping하지 못하는 setup의 대화입니다.

이 절에서 구분하고 싶은 상태는 세 가지입니다.

- model이 일에 비해 너무 비싸다

- Batch하지 않아 workflow가 비싸다

- account나 verification state가 access를 막고 있다

첫 번째만이 진짜 cheaper model을 요구합니다. 두 번째는 cheaper workflow일 수 있습니다. 세 번째는 troubleshooting입니다.

불만이 "keepable image에 너무 많은 돈이 든다"라면 이 페이지에서 비교를 이어가면 됩니다. 불만이 "route 자체를 아직 깨끗하게 못 돌린다"라면 다음 글은 OpenAI image API tutorial 이지 provider migration이 아닙니다.

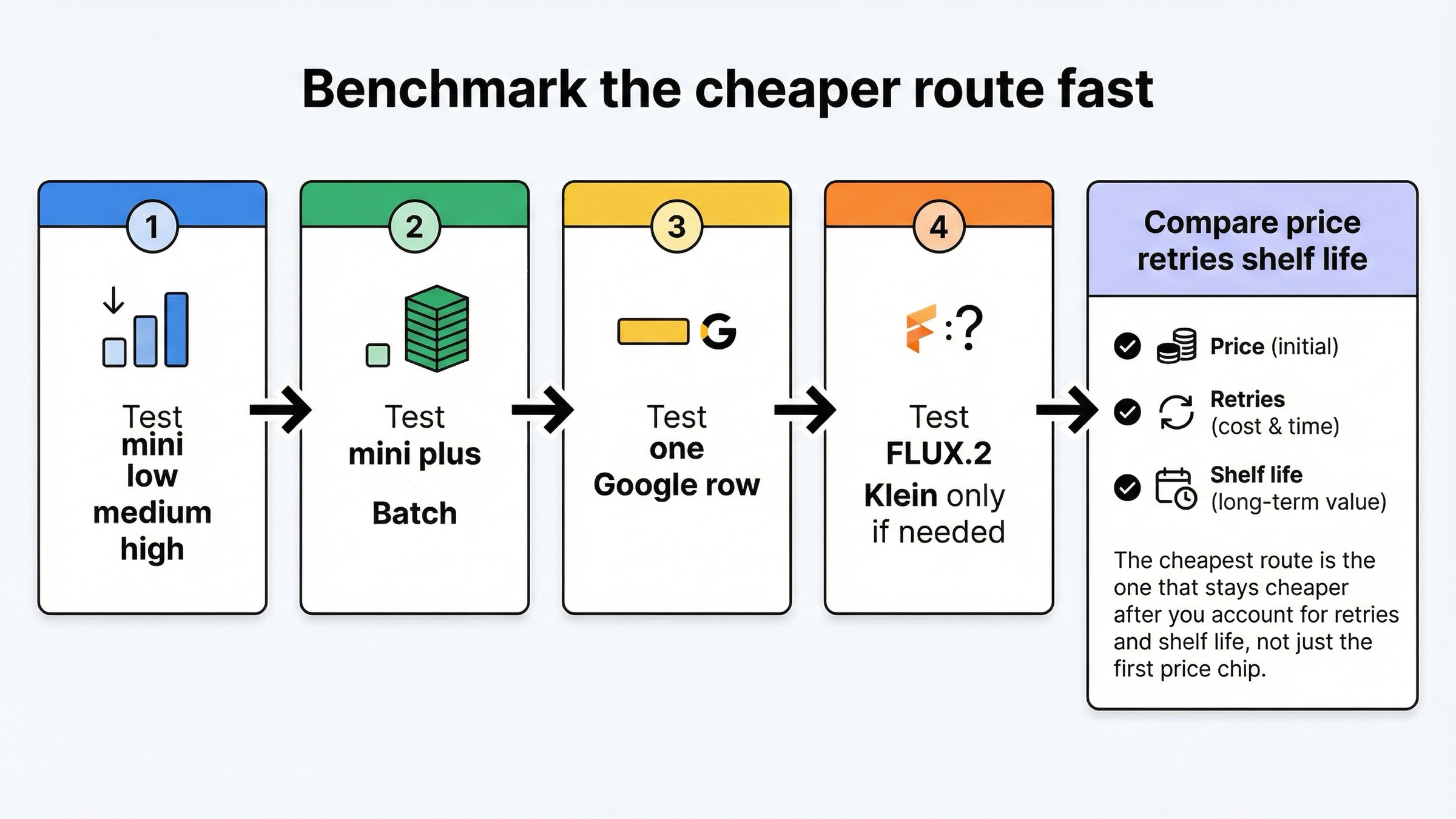

반나절 안에 어떻게 비교할까

한 줄의 price row로 결정하지 마세요. 통제된 반나절 테스트로 결정합니다.

- 같은 prompt set을 mini low, medium, high 에 흘립니다. 지금 내가 어떤 mini row와 비교하는지도 모른 채로는 이 keyword에 정직하게 답할 수 없습니다.

- workload를 기다리게 할 수 있다면 mini를 Batch로 돌립니다. 같은 model family에 남은 채 platform layer에서 inputs와 outputs를 반으로 줄일 수 있으니, 이것이 첫 cheap workflow route입니다.

- Imagen 4 Fast 는 비교 대상이 정말 mini high이고, 단순한 Google-hosted generation lane이 필요할 때만 넣습니다.

gemini-2.5-flash-imagebatch 는 2026년 10월 2일 shutdown date가 계획을 깨지 않을 때만 넣습니다.- FLUX.2 Klein 은 like-for-like한 mini replacement가 아니라 lower-end external volume lane을 실제로 살 의향이 있을 때만 넣습니다.

마지막에 봐야 할 것은 하나가 아니라 세 가지입니다.

- usable image 1장당 가격

- keep할 결과에 도달하기까지의 retry 횟수

- shutdown date와 workflow shape를 포함했을 때 그 route의 shelf life가 충분한지

pricing guide가 빠뜨리기 쉬운 것은 늘 이 마지막 줄입니다. 가장 싼 row가 답의 전부가 아닙니다. 싼 route는 queue shape, quality expectation, shelf life를 넣고도 여전히 싼 route입니다.

FAQ

gpt-image-1-mini 전체보다 정말 싼 것이 있나요?

clean한 현재 mainstream hosted swap으로는 없습니다. 오늘 mini를 분명히 밑도는 row가 있더라도, 그것은 mini high만 이기거나, Batch 에 의존하거나, 혹은 route shape가 달라질 만큼 job 자체가 달라지는 경우입니다.

mini를 계속 쓰는 전제에서 가장 싼 움직임은 무엇인가요?

먼저 mini low 나 mini medium 으로 충분한지 확인하고, 비동기로 돌릴 수 있다면 Batch 를 시험합니다. 이것이 보통 첫 honest cheaper move입니다. 같은 model family에 남은 채 migration이 정말 필요한지부터 확인할 수 있기 때문입니다.

sticker price가 Google 쪽이 낮아 보이기만 해도 옮겨야 하나요?

그것은 mini high 와 비교하고 있고 lifecycle caveat를 받아들일 수 있을 때만 그렇습니다. Imagen 4 Fast 와 gemini-2.5-flash-image batch 는 그 좁은 비교에서는 싸 보일 수 있지만, mini low나 medium보다 싼 것은 아니고 둘 다 Google docs에 2026년 shutdown date가 있습니다.

결론

gpt-image-1-mini 의 더 저렴한 대안은 대개 또 다른 mainstream hosted image model 그 자체가 아닙니다.

가격만이 문제라면 mini에 남아 먼저 Batch를 시험하는 것 이 우선입니다. mini high만 이기고 싶다면 Imagen 4 Fast 와 gemini-2.5-flash-image batch 가 실제 row이지만, 둘 다 2026년 shutdown caveat를 갖고 있고 mini low나 medium보다 싸지는 않습니다. lower-end external volume lane이 필요하다면 FLUX.2 Klein 이 BFL 쪽의 가장 깔끔한 후보이지만, 그것은 job change이지 universal mini replacement가 아닙니다. 그리고 pain의 본질이 verification이나 access state라면, pricing problem이라고 부르기 전에 setup부터 고쳐야 합니다.

지금 SERP가 아직 숨기고 있는 정직한 답은 이것입니다. mini는 이미 floor입니다. 필요한 일은 새로운 최저가 모델을 찾는 것이 아니라, 그 floor를 최적화해야 하는지, 거기서 벗어나야 하는지, 아니면 setup issue를 model pricing issue로 잘못 읽고 있지 않은지를 구분하는 것입니다.