2026年3月31日現在、Seedance 2.0 APIは正式に公開されていません。さまざまなブログやサードパーティプラットフォームで目にする情報とは異なり、ByteDanceはハリウッドスタジオとの著作権コンプライアンス問題により、グローバルAPIの提供を延期しています。現時点で正規のAPIアクセスは一切利用できません。Seedance 2.0 APIへのアクセスを提供すると主張するウェブサイトの多くは、信頼性の保証がない非公式のリバースエンジニアリングエンドポイントを運用しているか、まだ存在しない製品のプレースホルダー料金ページを掲載しているだけです。本ガイドでは、こうした混乱を整理し、実際のリリース状況、予想される料金体系、現在利用可能な代替モデルとの比較、そして公式パートナーのlaozhang.aiを通じてAPI公開初日にアクセスを確保する方法をお伝えします。

要点まとめ

- Seedance 2.0はByteDanceのフラッグシップ動画生成モデルです — 映画品質、ネイティブ音声、マルチモーダル入力、最大2K解像度・24fps対応

- 2026年3月時点でAPIは未公開です — BytePlusによるグローバル展開は著作権問題により延期されました

- サードパーティのAPI提供を謳うサイトの大半は信頼性に欠けます — 課金には十分ご注意ください

- 予想価格:API公開後、公式パートナーlaozhang.ai経由で1動画約$0.05(laozhang.aiは公式ディストリビューションパートナーであり、最初にサービスを開始する予定です)

- コンシューマー向けプラットフォーム(CapCut Dreamina)は現在利用可能で、API公開前にモデルの性能をテストできます

- 待機中の代替手段として、Sora 2($0.15/動画)とVeo 3.1($0.15/動画)がlaozhang.aiで今すぐ利用可能です

Seedance 2.0とは何か — 開発者にとってなぜ重要なのか

ByteDanceは2026年2月にSeedance 2.0を統合型マルチモーダル音声・動画生成モデルとしてリリースし、AI動画制作の経済性を一変させました。従来の動画生成モデルがテキスト・画像・音声入力を別々のパイプラインとして処理していたのに対し、Seedance 2.0はDual-Branch Diffusion Transformerと呼ばれる単一アーキテクチャで4つのモダリティすべてを処理します。このアーキテクチャ上の決定は単なる技術的な脚注ではありません。単一の統合パスは本質的に、複数の専門モデルを連鎖させるよりも効率的であるため、出力品質と生成コストの両方に直接影響を与えます。

開発者にとっての実質的なメリットは大きなものです。Sora 2が物理的に正確なモーションシミュレーションに優れ、Veo 3.1が4Kまでの解像度の限界を押し上げる中、Seedance 2.0は最大12個のリファレンスファイル(キャラクター画像、環境写真、モーションテンプレート、音声トラック)を1回のリクエストで同時に受け付けることで、独自のポジションを確立しています。このマルチモーダルリファレンスシステムにより、他のモデルが必要とする複雑なプロンプトエンジニアリングの回避策なしに、一連の生成動画間で視覚的な一貫性を維持できます。マーケティングコンテンツやSNSクリップ、ショート動画を大量に制作するプロダクションチームにとって、この一貫性は単なる解像度の数値以上の価値があります。

モデルは1リクエストあたり4〜15秒の動画を、最大2K(2048x1080)解像度・ネイティブ24fps再生で生成します。すべての競合と一線を画すのはネイティブ音声生成機能です。Seedance 2.0は同期された効果音、環境音、さらに8言語以上の対話を同じ生成パスの一部として出力します。他のモデルは無音の動画を生成するか、別途音声合成のステップが必要で、パイプラインにコストと複雑さの両方を追加します。ByteDance独自のSeedVideoBench-2.0評価によると、指示遵守、モーション品質、ビジュアル美学、音声レンダリングの各次元でリードしており、Artificial Analysisなどの独立ベンチマークでも、Veo 3、Sora 2、Runway Gen-4、Kling 2.0との比較でコミュニティ投票による1位を確認しています(Artificial Analysis、2026年3月検証)。

生成プロセスは非同期ジョブベースのパターンに従います。リクエストを送信し、ジョブIDを受け取り、完了をポーリングし(通常30〜120秒)、生成された動画をダウンロードします。このアーキテクチャは計算集約型のAIワークロードでは標準的ですが、本番デプロイメントではアプリケーション側で適切な非同期処理、リトライロジック、Webhookサポートが必要になります。その見返りとして、最も高性能な動画生成モデルの1つに、最も近い競合の数分の1のコストでアクセスできるようになります。

Seedance 2.0 APIのリリース状況 — 実際に利用可能なもの(2026年3月)

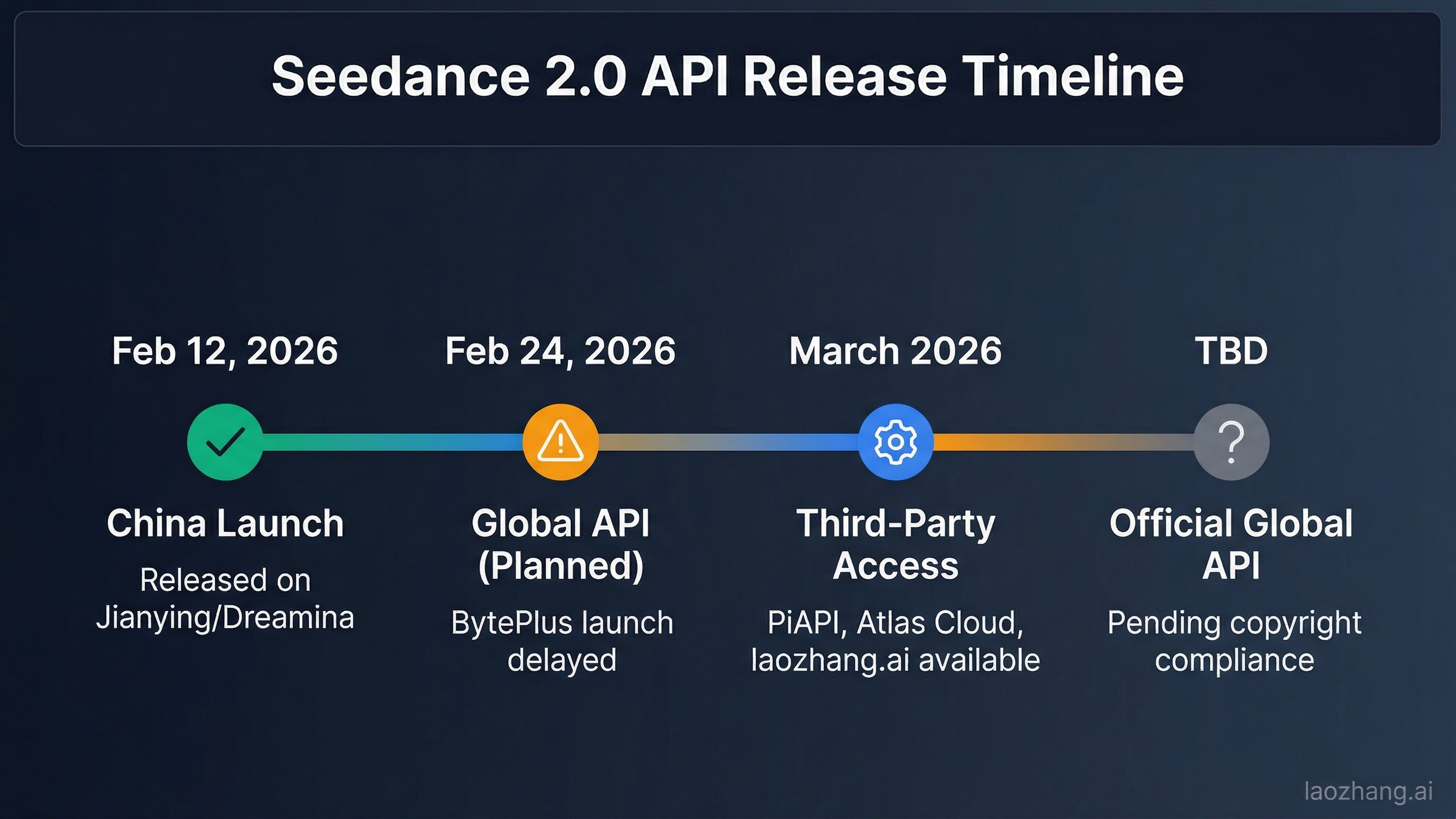

Seedance 2.0の現在の利用可能状況を理解するには、何が本物で何がマーケティングの誇大広告なのかを正直に見極める必要があります。状況は本当に混乱しており、多くの記事が読者を誤解させているからです。ByteDanceは当初、2026年2月下旬にコンシューマープラットフォームと開発者APIの協調的なグローバルローンチを計画していましたが、法的な複雑さがAPIの展開を完全に頓挫させました。以下が2026年3月31日現在の事実です。

コンシューマープラットフォームは予定通り公開されました — これが現時点で唯一の正規アクセスです。 Seedance 2.0は2026年2月12日に剪映(ByteDanceの中国向け動画エディタ、jimeng.jianying.com)およびCapCut Dreamina(国際版、dreamina.capcut.com)を通じて利用可能になりました。これらのプラットフォーム内では、モデルは「Seedance 40 Pro」として表示され、月額約69元(約$9.60 USD)からのサブスクリプションでアクセスできます。このコンシューマーアクセスはグローバルに機能し、中国の電話番号は不要なため、現在モデルを使用できる唯一の信頼できる方法です。API公開前にSeedance 2.0の性能を評価する必要がある場合は、ここから始めるべきです。

公式開発者APIは日程未定のまま延期されています。 ByteDanceの国際クラウドプラットフォームであるBytePlusは、2026年2月24日にSeedance 2.0 APIを公開する予定でした。しかし著作権コンプライアンスの問題、具体的にはモデルのトレーニングデータに関するハリウッドスタジオからの反発により、無期限に延期されました。2026年3月31日現在、BytePlusは修正された公開日を発表していません。Volcengine(火山引擎)を通じた国内版も同様に個人開発者には利用できません。つまり、サードパーティのウェブサイトが何を主張しようと、誰も使用できる公式APIエンドポイントは存在しないのです。

サードパーティの「APIアクセス」の大半は信頼できません — 十分にご注意ください。 公式APIの延期以降、Seedance 2.0 APIアクセスを提供すると主張する多数のウェブサイトが出現しています。実態として、これらのサービスの大半はリバースエンジニアリングされたコンシューマープラットフォームのエンドポイントを実行しており、公式サポートもSLA保証もなく、ByteDanceがコンシューマープラットフォームを更新すればいつでも壊れる可能性があります。単に提供不能な製品のプレースホルダー料金ページを掲載しているだけのサイトもあります。Seedance 2.0 APIアクセスにサードパーティへの支払いを検討する前に、自問してください:ByteDanceがAPIをリリースしていないのに、このプロバイダーは一体どこからアクセスを得ているのか? 大半の場合、答えは不安定なリバースエンジニアリングか、単なる虚偽表示のいずれかです。

公式ディストリビューションパートナーはAPI公開と同時にアクセスを提供します。 laozhang.aiはByteDanceの動画生成APIの公式ディストリビューションパートナーであり、BytePlusが延期を解除した時点で、正規のSeedance 2.0 APIアクセスを最初に提供するプラットフォームの1つとなります。予想価格は1動画あたり約$0.05で、同等のモデルと比較して大幅に安価です。その間、laozhang.aiはすでにSora 2($0.15/動画)やVeo 3.1($0.15/動画)など他の主要な動画生成モデルへの実績あるAPIアクセスを提供しています。今すぐ動画生成パイプラインを構築し、Seedance 2.0が利用可能になった際に最小限のコード変更で切り替えることができます。Seedance 2.0 APIの公開通知を受け取るには、laozhang.aiで登録してください。

Seedance 2.0 APIの予想価格:現時点で判明していること

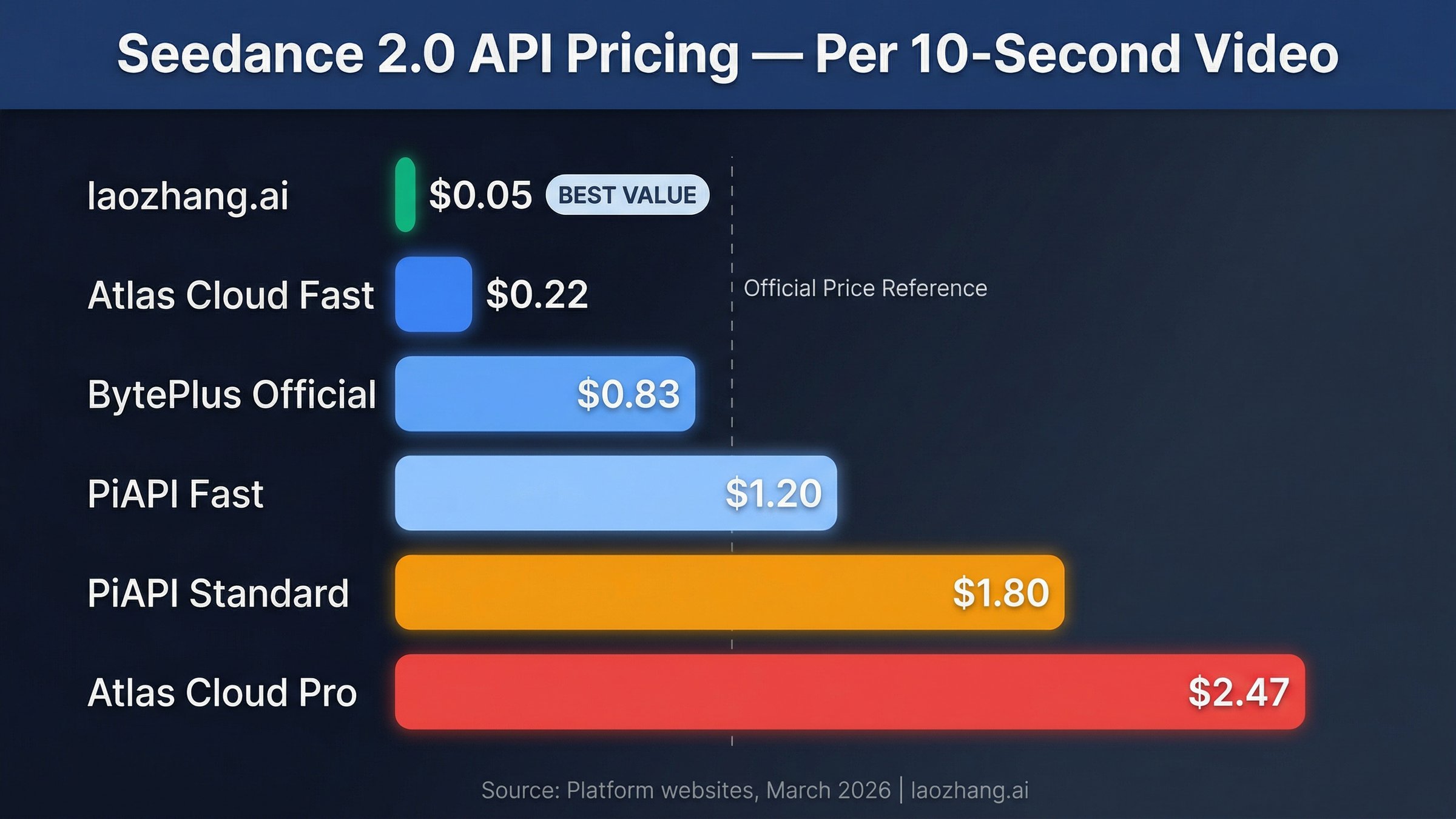

公式のSeedance 2.0 APIがまだ公開されていないため、すべての料金情報は確定レートではなく暫定的な見積もりとして扱うべきです。とはいえ、いくつかのデータポイントから合理的な全体像を把握できます。ByteDance自身のドキュメントやパートナーへの通知は解像度と時間に基づく料金ティアを示唆しており、コンシューマープラットフォームDreaminaはByteDanceが適正市場価格と考えるベースラインを提供しています。

| ソース | 予想価格 | 根拠 | 信頼性 |

|---|---|---|---|

| laozhang.ai(公式パートナー) | 約$0.05/動画 | パートナー契約 | 高 — 公式ディストリビューションパートナー |

| BytePlusドキュメント(リーク) | $0.10〜$0.80/分 | ローンチ前ドキュメント | 中 — ローンチ前に変更の可能性あり |

| Dreaminaコンシューマープラットフォーム | 月額約$9.60のサブスクリプション | 現行価格 | 高 — 現在利用可能 |

| 各種サードパーティの主張 | $0.02〜$0.25/秒 | 未検証のリスティング | 低 — 大半は実際にサービスを提供していない |

予想価格がここまで競争力のある理由。 ByteDanceは一貫してSeedance 2.0を市場で最もコストパフォーマンスの高いプレミアム動画生成モデルとして位置づけることを示唆してきました。Dual-Branch Diffusion Transformerアーキテクチャは動画と音声を単一の統合パスで処理するため、別々の生成ステップを必要とするモデルよりも本質的に計算効率が高くなります。このアーキテクチャ上の優位性は、1動画あたりのコスト削減に直接つながります。公式パートナーlaozhang.ai経由で予想される1動画$0.05という価格は、同等の品質レベルでSora 2やVeo 3.1の約3分の1です。

本番環境のコスト計画のため、予想価格がスケール時に意味するものを示します。 laozhang.ai経由で1動画$0.05という予想価格に基づくと、SNSコンテンツ向けに月100本の動画を生成する小規模チームの月額コストはわずか$5です。エンタープライズ規模(月1,000本)では約$50となり、Dreaminaの個人サブスクリプション1つ分より安価です。すでにSora 2を$0.15/動画で使用しているチームがSeedance 2.0公開時に切り替えた場合、動画生成コストを約67%削減できます。Seedance APIの料金トレンドの詳細な分析については、最安値のSeedance APIプロバイダーガイドをご覧ください。

未検証のサードパーティプロバイダーからの「ライブ」料金には極めて慎重になるべきです。 現在(2026年3月)、Seedance 2.0 APIアクセスの具体的な秒単価を広告しているウェブサイトがあれば、そのモデルをどこから入手しているのか問い質してください。ByteDanceは公式ディストリビューションパートナー以外のサードパーティプロバイダーにAPIをリリースしていません。現在Seedance 2.0 APIを提供しているサービスは、いつでも壊れる可能性のあるリバースエンジニアリングされたコンシューマープラットフォームのエンドポイントを実行しているか、一貫性のない結果を生成するか、あるいは全く動作しない可能性が高いです。公式チャネルを通じた正規アクセスを待つことで、プロジェクト予算を守りましょう。

中国アカウントなしでSeedance 2.0 APIにアクセスする方法

海外の開発者からよく寄せられる質問の1つが、Seedance 2.0を利用するために中国の電話番号、TGアカウント、またはVolcengineの登録が必要かどうかです。簡潔に答えると、不要です。標準的なUSD決済方法で国際プラットフォームを通じてモデルにアクセスするための複数の経路が存在します。

オプション1(今すぐ利用可能):CapCut Dreaminaコンシューマープラットフォーム。 今すぐモデルの性能を評価する必要がある場合、dreamina.capcut.comのDreaminaプラットフォームがグローバルに動作するブラウザベースのインターフェースを提供しています。Googleまたはメールアカウントでサインアップでき、月額約$9.60からのサブスクリプションを通じてSeedance 2.0(モデルセレクターで「Seedance 40 Pro」として表示)にアクセスできます。このオプションはプログラマティックなAPIアクセスを提供しませんが、現時点でSeedance 2.0を使用できる唯一の正規の方法です。API公開前にプロンプトのプロトタイプ作成、マルチモーダルリファレンスシステムのテスト、モデルの出力能力の理解にご活用ください。

オプション2(近日公開):laozhang.aiなどの公式ディストリビューションパートナー。 laozhang.aiはByteDanceのローンチ延期が解除され次第、OpenAI互換のRESTエンドポイントを通じてSeedance 2.0 APIアクセスを提供する公式ディストリビューションパートナーです。登録は今すぐ可能で、アカウントを作成してAPIキーを取得し、他の動画生成モデル(Sora 2 $0.15/動画、Veo 3.1 $0.15/動画)の利用をすぐに開始できます。Seedance 2.0が公開された際には、コード1行の変更でモデルを切り替えることができます。docs.laozhang.aiのドキュメントでは、Seedance 2.0にも適用される詳細なエンドポイント仕様と認証ガイドを提供しています。

オプション3(将来):BytePlus公式エンタープライズアクセス。 ByteDanceの国際クラウドサービスであるBytePlusは、最終的にUSD課金、国際データコンプライアンス、エンタープライズSLA保証を備えた直接APIアクセスを提供する予定です。公開された際には、契約上の保証と専用サポートが必要な大企業顧客にとって最も信頼性の高い選択肢になる可能性があります。しかし現在の延期状況を踏まえると、個人開発者や小規模チームは公式ディストリビューションパートナーを主要なアクセスチャネルとして計画すべきです。

初日から対応できるよう、今すぐコードベースを準備しましょう。 Seedance 2.0 APIを待つ間の最も賢明な行動は、将来Seedance 2.0を提供する同じプロバイダーで、利用可能なモデルを使って動画生成パイプラインを構築することです。今すぐlaozhang.aiでSora 2またはVeo 3.1を使用してインテグレーションをセットアップすれば、今日から稼働する本番パイプラインが手に入り、Seedance 2.0が公開された際にはAPIコール内のモデル名をsora-2からseedance-2に変更するだけで、他のコード変更なしにより安価で高性能なモデルに即座にアップグレードできます。待機中に遊休状態でいるのではなく、即座に価値を得て、最速の移行を実現するアプローチです。

クイックスタート:今すぐSora 2でパイプラインを構築し、後でSeedance 2.0にアップグレード

Seedance 2.0 APIはまだ利用できないため、最も賢いアプローチは同じプロバイダーで利用可能なモデルを使って今すぐ動画生成パイプラインを構築することです。以下のコードはlaozhang.aiを通じてSora 2を使用しています。Seedance 2.0が公開された際には、モデル名をsora-2からseedance-2に変更するだけで、それ以外はすべて同じです。エラーハンドリング、Webhookインテグレーション、バッチ処理を含むより包括的なセットアップについては、完全インテグレーションガイドをご覧ください。

pythonimport requests import time API_KEY = "your_api_key_here" BASE_URL = "https://api.laozhang.ai/v1" response = requests.post( f"{BASE_URL}/videos", headers={ "Authorization": f"Bearer {API_KEY}", "Content-Type": "application/json" }, json={ "model": "sora-2", # 公開後は "seedance-2" に変更 "prompt": "A drone shot flying over a misty mountain valley at sunrise, golden light filtering through clouds, cinematic depth of field", "duration": 10, "resolution": "1080p", "audio": True } ) job = response.json() job_id = job["id"] print(f"ジョブ送信完了: {job_id}") # ステップ2: 完了までポーリング(通常30〜120秒) while True: status = requests.get( f"{BASE_URL}/videos/{job_id}", headers={"Authorization": f"Bearer {API_KEY}"} ).json() if status["status"] == "completed": video_url = status["output"]["video_url"] print(f"動画完成: {video_url}") break elif status["status"] == "failed": print(f"生成失敗: {status.get('error', 'Unknown error')}") break time.sleep(5) # 5秒ごとにポーリング

画像から動画への生成では、リクエストにリファレンス画像を追加することで、複数の動画間でキャラクターやシーンの一貫性を維持できます。これはSeedance 2.0の最大の差別化要因であり、マルチモーダルリファレンスをここまでクリーンに処理できるモデルは他にありません。JSONボディにreferences配列を追加し、各エントリにrole(「subject」「environment」「motion」「audio」など)とURLまたはbase64エンコードされたファイルを指定することで、1回のリクエストに最大12個のリファレンスファイル(画像9枚、動画3本、音声3ファイル)を含めることができます。

上記コードの本番運用に関するヒント。 ここに示したポーリングループはテスト用には問題ありませんが、本番環境ではWebhookコールバックに置き換えるべきです。ほとんどのプロバイダーは初期リクエストでcallback_urlパラメータをサポートしており、生成完了時にPOST通知を受け取ることで、ポーリングの必要性を完全に排除できます。また、ステータスチェックに指数バックオフを実装し、生成が予想より長くかかるケースにも対応すべきです。ピーク時には「高速」ティアでも複雑なプロンプトで3〜4分かかることがあります。

Seedance 2.0 vs Sora 2 vs Veo 3.1 vs Kling 3.0 — 価格と性能の比較

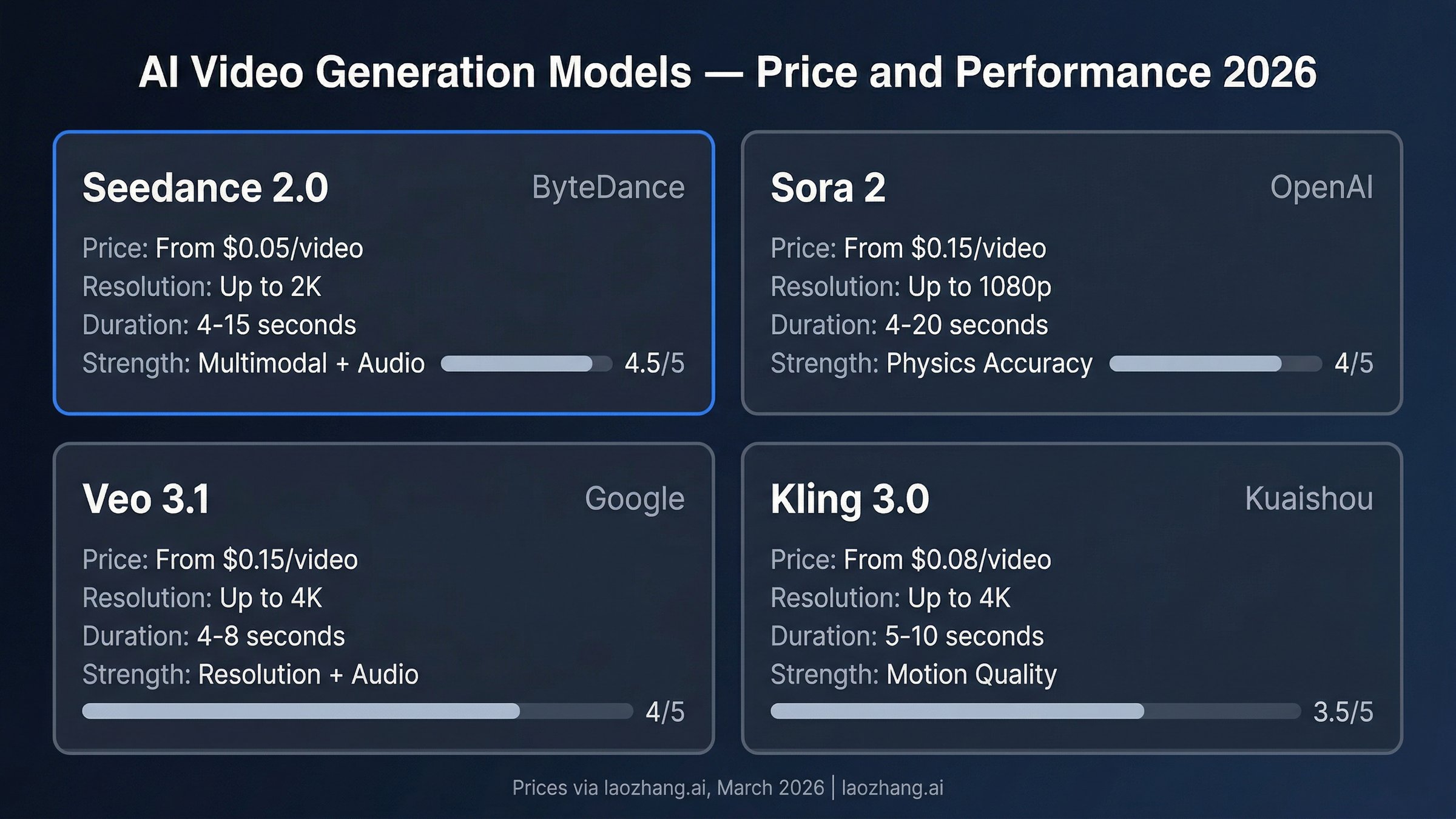

2026年の主要AI動画生成モデルの選択は、具体的なユースケース、タイムライン、予算によって決まります。以下の比較はlaozhang.ai経由の2026年3月時点の料金を使用しています。laozhang.aiは現在Sora 2とVeo 3.1を提供しており、公式API公開後にSeedance 2.0を追加する予定です。Seedance 2.0のスペックはByteDanceが公開した仕様とコンシューマープラットフォームでのテストに基づいています。さらに詳細な内訳については、動画モデルの総合比較ガイドをご覧ください。

| 機能 | Seedance 2.0 | Sora 2 | Veo 3.1 | Kling 3.0 |

|---|---|---|---|---|

| 価格(laozhang.ai経由) | 約$0.05/動画(予想) | $0.15/動画(利用可能) | $0.15/動画(利用可能) | $0.08/動画(利用可能) |

| 最大解像度 | 2K(2048x1080) | 1080p | 4K | 4K |

| 最大尺 | 15秒 | 20秒 | 8秒 | 10秒 |

| ネイティブ音声 | あり(8言語以上) | なし | あり | なし |

| マルチモーダル入力 | テキスト+画像+音声+動画 | テキスト+画像 | テキスト+画像 | テキスト+画像 |

| リファレンスファイル | 最大12 | 最大2 | 最大2 | 最大3 |

| 物理精度 | 良好 | 優秀 | 良好 | 非常に良好 |

| 生成速度 | 30〜120秒 | 60〜180秒 | 30〜90秒 | 45〜120秒 |

マルチモーダルリファレンスワークフローにはSeedance 2.0(利用可能になり次第)を選択しましょう。 API公開後、複数のマーケティング動画で一貫したキャラクターを維持する必要がある場合や、プロダクト写真と背景シーンと特定の音声トラックを1回のリクエストで組み合わせたい場合、Seedance 2.0が明確な選択肢になります。12個の同時入力を受け付けるマルチモーダルリファレンスシステムは市場でユニークです。予想される1動画$0.05という価格は大幅に安価な選択肢でもあります。公開されるまでは、laozhang.ai経由でSora 2を使ってワークフローのプロトタイプを作成し、Seedance 2.0が利用可能になった際にシームレスに切り替えることができます。

物理的な正確性が最も重要な場合はSora 2を選択しましょう。 OpenAIのモデルは、リアルな物理現象のシミュレーションで依然としてリードしています。物体は説得力のある重量感で落下し、流体は自然に振る舞い、衝突は本物らしく見えます。プロダクトデモ動画、建築ビジュアライゼーション、視聴者がモーションの「リアルさ」を精査するコンテンツには、Sora 2の3倍の価格プレミアムは正当化されます。また、20秒という最長の単一生成をサポートしており、動画スティッチングの必要性が減少します。laozhang.ai経由でSora 2は1動画$0.15で利用可能で、非同期API対応・生成失敗時は課金されないビリングモデルを採用しています。

解像度と音声品質が最も重要な場合はVeo 3.1を選択しましょう。 Googleのモデルはネイティブ4K出力を実現し、音声生成品質はSeedance 2.0に匹敵します。トレードオフは最大8秒という最短の生成時間と、秒単価の高さです。映画的なエスタブリッシングショット、自然ドキュメンタリー、大画面向けのコンテンツには、Veo 3.1の解像度の優位性は意味があります。興味深い中間策として、ヒーローショットにはVeo 3.1を使い、大量生産にはSeedance 2.0を使うことで、平均コストを低く抑えることができます。laozhang.ai経由で1動画$0.15で利用可能です。詳細な品質分析についてはVeo 3.1 vs Sora 2の比較をご覧ください。

予算重視でモーション重視のコンテンツにはKling 3.0を選択しましょう。 Kuaishouのモデルは1動画$0.08という印象的なモーション品質を提供し、Seedance 2.0の低価格帯とプレミアムなSora 2/Veo 3.1ティアの間に位置しています。4K解像度のサポートと優れたモーションレンダリングにより、スポーツハイライトやダイナミックなプロダクトショーケースなどアクション重視のコンテンツに適した選択肢です。主な制限はネイティブ音声生成がないことで、音声が必要な動画には別途音声合成ステップが必要です。Kling 3.0はSeedance 2.0よりリファレンス入力が少なく(3対12)、一連の生成クリップ間で厳密な視覚的一貫性が必要なワークフローには不向きです。

スケール時の実際のコスト比較はより精緻になります。 月500本の動画を生成するプロダクションチームの場合、月間APIコストは以下の通りです。laozhang.ai経由のSeedance 2.0は$25、Kling 3.0は$40、Sora 2とVeo 3.1はそれぞれ$75です。しかしAPI単体のコストは方程式の一部に過ぎません。再生成率(モデルが使用不能な出力を生成しリトライが必要になる頻度)と後処理コスト(音声追加、アップスケーリング、ネイティブサポートのないモデルのスティッチング)も考慮する必要があります。Seedance 2.0のマルチモーダルリファレンスによる低い再生成率と、別途音声パイプラインの必要性を排除するネイティブ音声生成を考慮すると、総所有コストの差はさらに広がります。Sora 2のAPI呼び出しに$75を費やすチームは、音声合成と高いリトライ率を加味すると実際には$90〜$100を費やす可能性がありますが、Seedance 2.0に$25を費やすチームには追加の隠れたコストがありません。

Seedance 2.0のコストと品質を最適化するための本番運用ヒント

出力品質を維持しながらSeedance 2.0 APIコストを削減するには、モデルがプロンプトをどのように処理するか、そして異なるパラメータが生成時間と品質の両方にどう影響するかを理解する必要があります。

プロンプトエンジニアリングは最もROIの高い最適化です。 「道路を走る車」のような曖昧なプロンプトは、モデルに数十の創造的決定を強制し、再生成が必要な汎用的な出力になることが多いです。一方、「ゴールデンアワーに海岸沿いのワインディングロードを走る赤いスポーツカー、サイドからのカメラトラッキング、背景に海の波が見える、シネマティックな被写界深度」のような具体的なプロンプトは、少なくとも80%の確率で初回の試行で使用可能な出力を生成します。再生成のたびにプラットフォームに応じて$0.05〜$2.47のコストがかかるため、プロンプト作成に2分余分に投資することで、大量生成時に大幅なコスト削減につながります。常に照明条件、カメラの動き、雰囲気、環境についての具体的な詳細を含めてください。

プロトタイプには720pで開始し、本番で解像度を上げましょう。 Atlas Cloud Fastティアは秒あたり$0.022で720p出力を生成し、プロンプトのテストやクリエイティブな方向性の反復には十分な品質です。望む結果を一貫して生成するプロンプトが見つかったら、最終出力用にフル解像度ティアに切り替えます。この2段階ワークフローにより、すべてを最高品質で生成する場合と比較してプロトタイピングコストを90%削減できます。実際には、ほとんどのチームが最終版を決定する前に3〜5回のプロンプト反復を行うため、節約は急速に積み上がります。720pでの5回のテスト実行がそれぞれ$0.22、2Kの最終版1回が$1.80で合計$2.90であるのに対し、2Kで6回実行すると$10.80です。

マルチモーダルリファレンスシステムを活用して試行錯誤を減らしましょう。 キャラクターの外見をテキストで説明する(そしてモデルが正しく解釈することを期待する)代わりに、リファレンス画像を提供します。特定のカメラの動きを説明する代わりに、望む動きを示すリファレンス動画を提供します。追加するリファレンスファイルごとにリクエストの曖昧さが減り、初回の成功率が向上します。ブランドコンテンツを生成するチームの場合、キャラクター、ロゴ、環境用の承認済みリファレンス画像ライブラリを維持することで、再生成率を半分に削減できます。

スマートキャッシングと重複排除を実装しましょう。 類似のプロンプトで動画を生成するアプリケーション(例えば、異なるカラーバリアントのプロダクト動画)の場合、ベース生成をキャッシュし、プロンプトが実質的に異なる場合にのみ再生成します。プロンプトとパラメータの組み合わせをハッシュ化し、新しいジョブを送信する前に以前の結果と照合します。大規模運用では、この単純な最適化でAPIコストを20〜40%削減できます。生成した動画をオブジェクトストレージ(S3または同等サービス)に保存し、プロンプトハッシュ、解像度、モデルバージョンに一致するメタデータタグを付与することを検討してください。新しいリクエストが入った際、$0.05〜$2.47の新しいAPI呼び出しに費やす前に、同一またはほぼ同一の生成がすでに存在するかチェックします。数百のSKUでわずかなバリエーションのプロダクト動画を生成するECチームの場合、このキャッシング戦略だけで月間APIコストを数千ドル削減できます。

よくある質問

BytePlusからの公式Seedance 2.0 APIはもう利用できますか?

いいえ。2026年3月31日現在、公式のBytePlus APIローンチは日程未定のまま延期されています。延期の原因はモデルのトレーニングデータに関する著作権コンプライアンスの問題、具体的にはトレーニング中に著作権のある映画映像が使用されたかどうかに関するハリウッドスタジオからの疑義です。ByteDanceはこれらの懸念に公式に対応しておらず、修正されたタイムラインも提供していません。モデルはコンシューマープラットフォームCapCut Dreaminaを通じて利用可能ですが、正規のAPIアクセスはまだ存在しません。laozhang.aiなどの公式ディストリビューションパートナーがAPI公開後最初にアクセスを提供する予定です。今すぐ登録して通知を受け取りましょう。

Seedance 2.0 APIの1動画あたりのコストはいくらですか?

APIがまだ公開されていないため、すべての価格は暫定的なものです。公式パートナー契約とByteDanceのドキュメントに基づくと、laozhang.aiなどの公式ディストリビューションパートナー経由の予想価格は、動画の長さに関係なく1動画あたり約$0.05の定額です。BytePlusの公式価格は、利用可能になった際には$0.10〜$0.80/分の範囲に収まると予想されています。具体的な秒単価を広告しているサードパーティサイトには注意が必要です。大半は実際には広告しているサービスを提供できていません。

中国国外からSeedance 2.0 APIを利用できますか?

はい。API公開後、laozhang.aiなどの公式ディストリビューションパートナーが標準的なクレジットカード決済でグローバルアクセスを提供します。中国の電話番号、TGアカウント、Volcengineの登録は不要です。その間、コンシューマープラットフォームCapCut Dreaminaは既にGoogleまたはメールアカウントで国際的に動作しますが、APIインテグレーションではなくブラウザベースのアクセスとなります。今すぐlaozhang.aiで登録してAPIキーを取得し、Seedance 2.0を待つ間に他の動画モデル(Sora 2、Veo 3.1)を使い始めることができます。

Seedance 2.0が生成できる最大動画長はどのくらいですか?

1回のAPI呼び出しで4〜15秒の動画を生成します。より長いコンテンツの場合は、複数のクリップを生成して結合する必要があります。マルチモーダルリファレンスシステムがクリップ間の一貫性維持に役立ちます。

Seedance 2.0はSora 2より優れていますか?

優先事項とユースケースによって異なります。Seedance 2.0は大幅に安価で($0.05 vs $0.15/動画)、より多くの入力モダリティをサポートし(4 vs 2)、最大12個のリファレンスファイルを同時に受け付け、ネイティブの同期音声を生成します。Sora 2は物理シミュレーションで優れており、物体の落下、流体の流れ、衝突がよりリアルに見え、Seedance 2.0の15秒制限に対して最大20秒のより長い単一生成をサポートしています。コスト効率と視覚的一貫性が物理精度より重要な大半の商業動画制作ワークフローでは、Seedance 2.0は約3分の1の価格で大幅に優れた価値を提供します。

Seedance 2.0は自動的に音声を生成しますか?

はい。Seedance 2.0は、効果音、環境音、8言語以上の対話を含む同期音声を同じ生成パスの一部として出力する数少ない動画生成モデルの1つです。不要な場合は音声生成を無効にすることもできます。

Seedance 2.0はどの解像度をサポートしていますか?

モデルは480pから2K(2048x1080)までの解像度をサポートし、16:9、9:16、4:3、3:4、21:9、1:1のアスペクト比に対応しています。正確な解像度オプションはプロバイダーと料金ティアによって異なります。

動画生成にはどのくらい時間がかかりますか?

一般的な生成時間は、解像度、動画の長さ、サーバー負荷に応じて30〜120秒です。ピーク時には3〜4分かかることもあります。APIは非同期ジョブパターンを使用します。リクエストを送信し、ジョブIDを受け取り、完了をポーリングするか、Webhookコールバックを設定します。本番アプリケーションでは、不要なAPI呼び出しを減らしレスポンスタイムを改善するために、ポーリングよりもWebhookコールバックが強く推奨されます。ほとんどのサードパーティプロバイダーは、初期生成リクエストでcallback_urlパラメータをサポートしています。

生成に失敗した場合でも課金されますか?

プロバイダーによって異なります。laozhang.aiのようなプラットフォームは、成功した動画生成に対してのみ課金される「失敗時無課金」のビリングモデルを採用しています。コンテンツポリシー違反、サーバーエラー、タイムアウトの問題で生成が失敗した場合、アカウントへの課金は発生しません。これは、稀な障害が不可避な本番ワークロードにとって大きな利点であり、使用可能な動画1本あたりの実質コストが広告価格と一貫して維持されることを意味します。大量利用をコミットする前に、必ず選択したプロバイダーのビリングポリシーを確認してください。