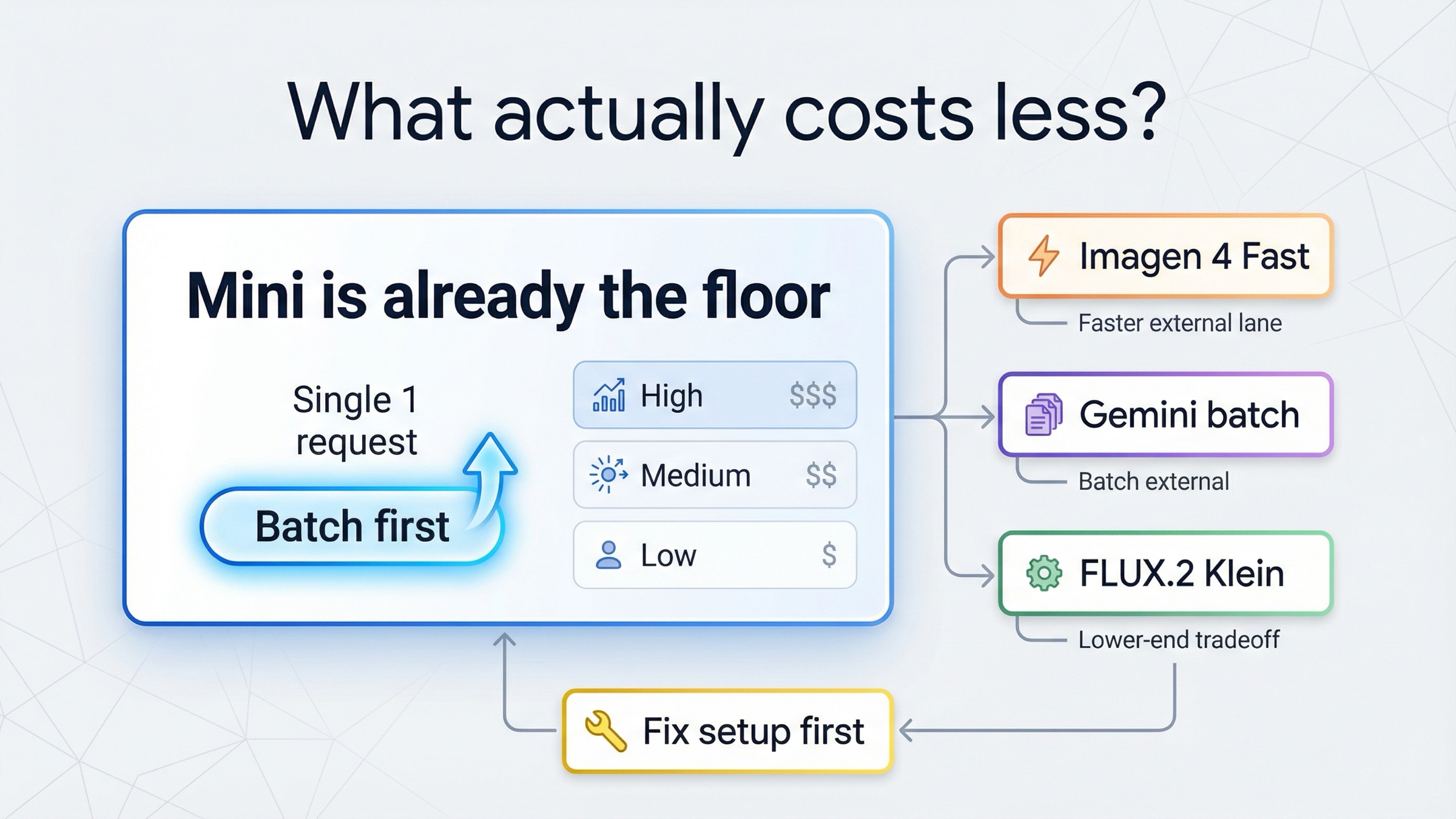

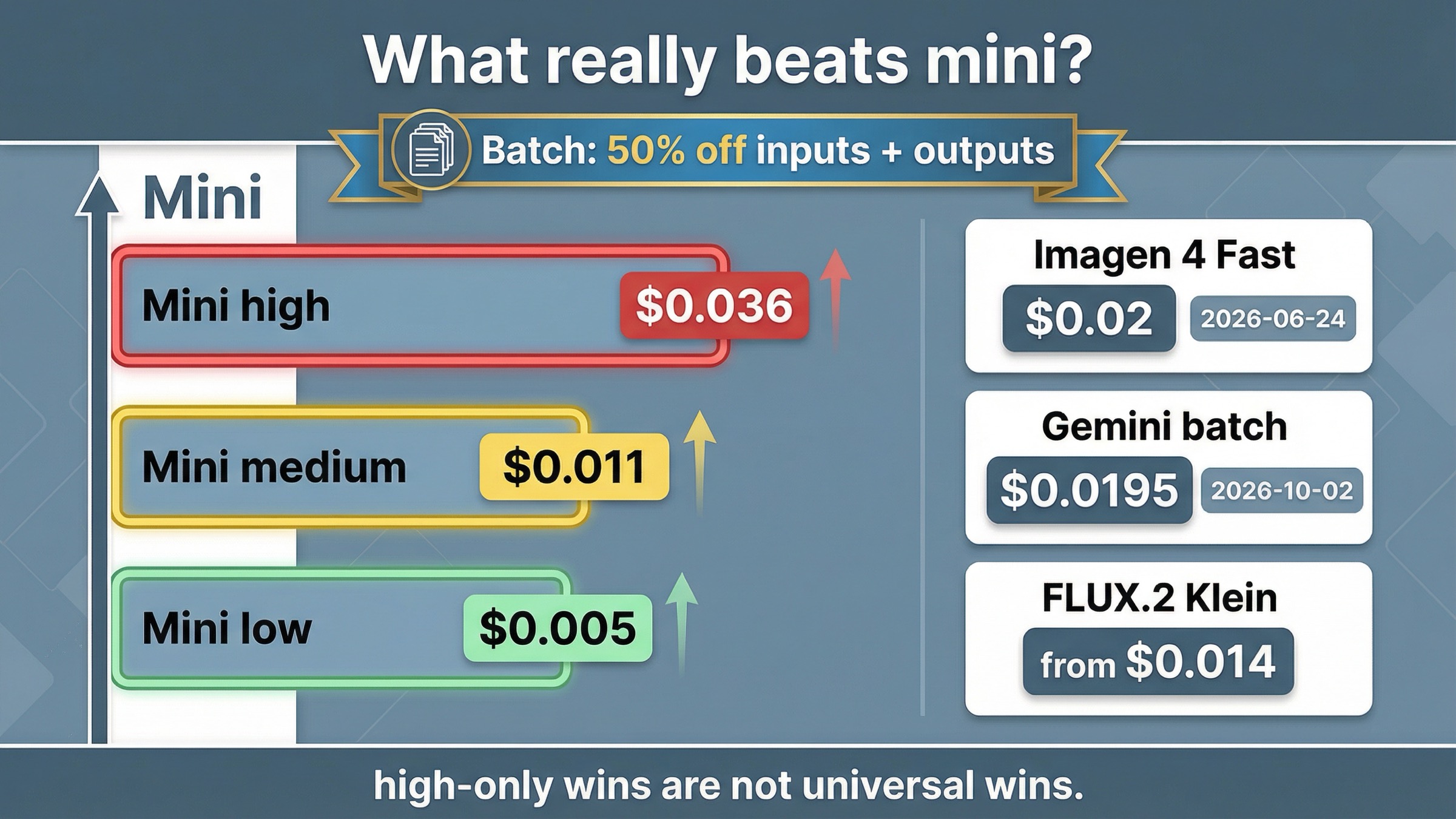

2026年3月29日時点では、gpt-image-1-mini の現在のlowとmedium price rowを安定して下回るcleanなmainstream hosted APIはありません。 OpenAIの現在の gpt-image-1-mini モデルページ には、square 1024x1024 の low、medium、high がそれぞれ \$0.005、\$0.011、\$0.036 と出ています。この一点だけで、検索結果に多い generic alternatives page とは出発点が変わります。価格だけが問題なら、最初のcheaper moveはモデルを替えることではなく、miniのまま Batch を試すことです。

ここが、今のSERPがまだ弱いところです。広いpricing gridは Imagen 4 Fastが 0.02、gemini-2.5-flash-image batchが 0.0195、FLUX.2 Kleinが 0.014 から 0.015 だと教えてくれます。ただ、そのrowがmini全体より安いのか、mini highだけより安いのか、あるいはjob自体、quality target、routeの寿命が変わるから安く見えるのかまでは、きちんと分けてくれません。

このkeywordにはもう一つ罠があります。gpt-image-1-mini cheaper alternative という検索の一部は、そもそもmodel-selection problemではありません。liveとBatchのroutingの違いだったり、verificationやtier state、access painのせいでworkflow全体が高く感じていたりするだけです。もし本当の悩みがquality、typography、editingなら、次に読むべきなのは GPT Image 1 Mini alternative のほうです。このページはprice-first decisionに絞ります。

要点まとめ

すぐにrouting answerが欲しいなら、まずこの表を見てください。

| 本当のgoalが... | いま最も安いと説明しやすい選択 | 現在のprice anchor | 成り立つ理由 | 主なcaveat |

|---|---|---|---|---|

| OpenAI内の最安公式image laneを維持したい | gpt-image-1-mini に残る | \$0.005 / \$0.011 / \$0.036 | mini自体が現在のOpenAIのcost-efficient branchだから | miniのquality ceilingはそのまま残る |

| モデルを変えずに非同期処理のコストを下げたい | miniのままBatchを試す | OpenAIは inputsとoutputsが50% off と案内 | 先に下げるべきなのはvendorではなくworkflowかもしれない | OpenAIはmini専用のbatch per-image cardを公開しておらず、Batchは非同期 |

| mini high だけを下回るシンプルなGoogle-hosted laneが欲しい | Imagen 4 Fast | \$0.02 / image | mini highよりは安く、説明もしやすい | mini lowやmediumよりは高く、Google docsには 2026年6月24日 のshutdown dateがある |

| Googleの現行image rowで mini high を下回りたい | gemini-2.5-flash-image batch | \$0.0195 / image | Googleが公開している現行の低いimage rowだから | mini lowやmediumよりは高く、Google docsには 2026年10月2日 のshutdown dateがある |

| lower-endなexternal high-volume laneを買いたい | FLUX.2 Klein | \$0.014 から \$0.015 | 一部のlower-end workloadではmini highを下回れる | megapixel pricingで、GPT Imageのlike-for-like replacementではない |

| access、verification、route painをまず解消したい | OpenAIに残ってsetupを直す | モデル変更は不要 | vendor switchではtierやverification stateは直らない | economicsを判断する前にrouteのデバッグが必要 |

実務上のルールは単純です。mini highより安いことと、mini全体より安いことは同じではありません。 ここをぼかすと、価格floorから理由なく離れることになります。

なぜminiがすでに現在のfloorなのか

このページで一番大事なのは、comparison rowを増やすことではなく、miniを何として読むべきかをはっきりさせることです。

OpenAIの現在の models catalog は、familyの役割をかなり明確に整理しています。GPT Image 1.5 は state-of-the-art image generation model、GPT Image 1 は previous generation model、そして gpt-image-1-mini は cost-efficient branchです。つまりminiは偶然安い残り物ではなく、OpenAI自身が現在の低コスト側として置いている公式ルートです。

同じ mini model page には、price splitもそのまま出ています。square 1024x1024の出力で low 0.005、medium 0.011、high 0.036。この三段があるからこそ、cheaper-alternative keywordは一段とややこしくなります。多くのpricing pageは、miniに単一価格しかないかのように、競合の一つの数字とOpenAIの一つの数字を並べます。でも実際には、どのrowを買っているかで話が変わります。

だから、一見安く見える外部routeの多くは、miniそのものに勝っているわけではありません。Imagen 4 Fastの 0.02 と gemini-2.5-flash-image batchの 0.0195 は mini high よりは安いですが、mini low や mini medium より安いわけではありません。今の仕事がlowやmediumで足りているなら、Googleの安いrowは思っているほどのprice winではありません。

同じロジックで、Batch が上位に来ます。OpenAIの現在の API pricing page には、Batch APIでinputsとoutputsが50% off と書かれています。mini model pageでもBatchはsupported endpoint familyとして見えています。OpenAIは mini専用のbatch per-image cardを公開していない ので、これは固定の新価格というよりworkflow optimizationとして読むほうが安全です。ただしrouting上の意味は大きいです。workloadをqueueに載せられるなら、最初のcheaper experimentは別vendorではなく mini plus Batch であることが多いからです。

古いOpenAI routeに逃げないための材料もあります。現在の image generation guide では DALL-E 2 と DALL-E 3 が 2026年5月12日 にrequestsを受け付けなくなると案内されています。表面上まだ安く見える古いrowがあっても、今日のdefault answerにはなりません。

miniそのものの価格階段だけを見たいなら、次は GPT Image 1 Mini pricing が自然です。miniを超えてOpenAI image stack全体より安いrouteを知りたいなら、OpenAI image generation API cheaper alternative のほうが合います。

いまの価格図は、universal winとnarrow winを分けるとかなり見やすくなります。

| Route | 現在公開されているprice surface | 本当に下回っている相手 | 主なcaveat |

|---|---|---|---|

| Mini live | \$0.005 / \$0.011 / \$0.036 | OpenAI内のbaseline floor | 既知のmini quality ceilingのまま |

| Mini + Batch | inputsとoutputsが50% off | 非同期なら同じworkflowの最安候補 | mini専用のbatch image cardは公開されていない |

| Imagen 4 Fast | \$0.02 / image | mini high | shutdown dateは2026年6月24日 |

gemini-2.5-flash-image batch | \$0.0195 / image | mini high | shutdown dateは2026年10月2日 |

| FLUX.2 Klein 4B / 9B | \$0.014 / \$0.015 から | 一部のlower-end mini-high比較 | megapixel pricingでquality targetも異なる |

この表が記事の本体です。残りの文章は、それぞれのrowがどの条件でだけ正直な答えになるかを説明しています。

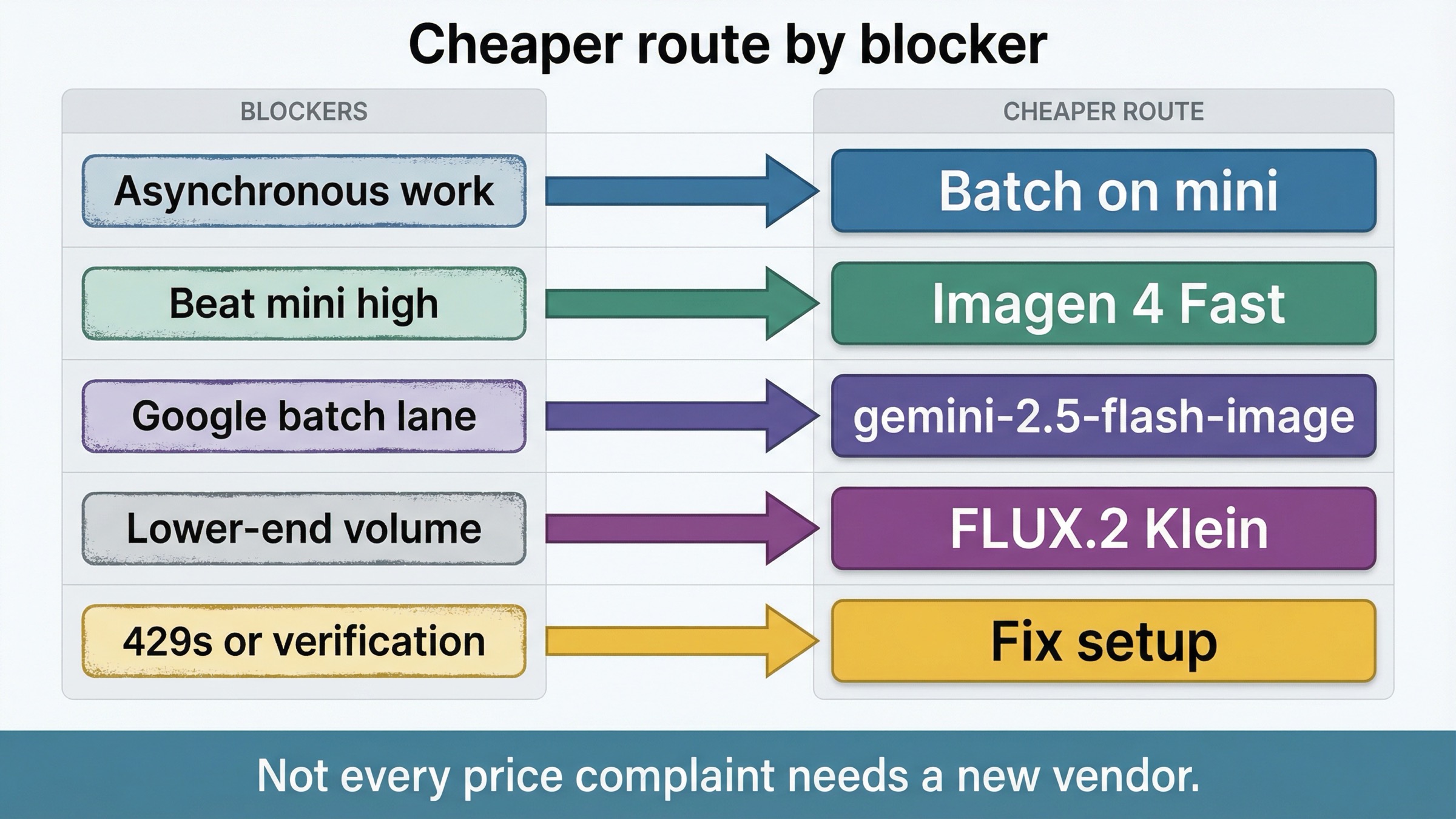

Googleの安いrowが本当に効く場面

Googleが重要なのは、何を解決するrouteなのかをきちんと限定した場合だけです。

最も分かりやすいGoogle-hosted generation laneは Imagen 4 Fast の \$0.02 / image です。これはGoogleの現在の Gemini Developer API pricing page に出ています。比較対象が mini high であり、OpenAI内のqueueやworkflow tweakではなく、分かりやすいhosted generation productを求めているなら、これは妥当な答えです。

ただし、そのprice rowはcaveatとセットでないと危険です。Googleの現在の deprecations page では imagen-4.0-fast-generate-001 に 2026年6月24日 のshutdown dateが付いています。つまりImagen 4 Fastは、今すぐ使えないrouteではありませんが、short-horizon cheaper lane であって、長期のdefaultとして思考停止で置いてよいrouteではありません。

gemini-2.5-flash-image batchはさらに文脈依存です。現在の pricing page では batchが 0.0195 / image、standardが 0.039 / image と出ています。だからmini highを下回るきれいなcheap-looking rowに見えます。ただし、同じく現在の deprecations page では gemini-2.5-flash-image に 2026年10月2日 のshutdown dateがあります。安いrowであることも、clockがあることも、両方とも事実です。

だからGoogleについて残すべき結論は、実はかなり狭いです。

- Imagen 4 Fast は、mini highより安いシンプルなGoogle-hosted generation laneが欲しいときに使う

gemini-2.5-flash-imagebatch は、より短いlifecycleでも構わずbatch pathを使いたいときだけ使う- どちらもmini全体より安いと書かない

この最後の一行がtrustの境目です。今の仕事がmini lowかmediumで足りるなら、Googleはよりきれいなprice winを持ってきているわけではありません。別platform、別lifecycle、そして一つのmini rowに対してだけの安さを持ってきているだけです。

BFLが安く見えるのは、job自体が変わるから

Black Forest Labsは、Googleとは別の理由でこの記事に入ります。

現在の BFL pricing page には、明確に低いstarting laneがあります。FLUX.2 [klein] 4Bが 0.014 から、FLUX.2 [klein] 9Bが 0.015 から で、どちらもmegapixel-based pricingです。ここだけ見ると、mini highの下に入り得るlineとして真剣に比較する理由があります。

ただし、BFLの意味は「miniの安いクローンがある」ということではありません。意味は Kleinがlower-end high-volume laneとして別のproduct postureを持っている ということです。BFL自身も、real-time、high-volume、balanced quality-speedといった前提でKleinを置いています。つまり、GPT Image familyと同じpromiseを安く売っているのではなく、別のjob shapeを安くしているのです。

SERPがよく落とすのはこの違いです。cheapとは、いつも同じ仕事をもっと低い数字で買うことではありません。場合によっては、

- quality expectationが下がる

- output-size economicsが変わる

- operating assumptionが変わる

- OpenAI-style behaviorではなくvolume-first laneを買う

という意味になります。

だからBFL recommendationも狭く保つべきです。FLUX.2 Kleinは、lower-end external volume laneをあえて買うときだけ有効なcheaper alternativeです。 miniのone-to-one replacementとして置くべきではありません。

同じpricing pageは、何をこのページから外すべきかも教えてくれます。FLUX.1 Kontext [pro] は 0.04 / image です。これはmini highより安くありません。edit-heavy workflowではなお有力でも、それはcheap answerではなくbetter-fit answerなので、GPT Image 1 Mini alternative に寄せるほうが筋です。

本当の問題がpriceではなくsetupのとき

cheaper-alternative queryが実態以上に強く見える理由の一つは、access painがそのままprice painのように感じられることです。

OpenAIの現在の organization verification help page には、verificationがimage-generation capabilitiesをunlockし、spending thresholdsは不要 で、反映に 最大30分 かかり、"still not verified" が残る場合は 新しいAPI keyの作成 が効くことがあると書かれています。これはpricing adviceではありませんが、routing adviceとしては非常に重要です。問題がverificationやroute stateなら、vendor switchは違う問題を解いています。

現在の OpenAI community thread on gpt-image-1 rate-limit errors を見ても同じです。creditsやverificationの後ですら、実際の画像生成の前に429やfree-tier-like failureに当たる人がいます。その後の話題はpayment state、tier、support、key regenerationに流れます。これはcheaper modelの話ではなく、まだ何も正常にshippingできていない setupの話です。

この節で分けたい状態は三つです。

- modelが仕事に対して高すぎる

- Batchしていないのでworkflowが高い

- accountやverification stateがaccessを塞いでいる

一つ目だけが、本当にcheaper modelを要求します。二つ目はcheaper workflowかもしれません。三つ目はtroubleshootingです。

不満が「keepable imageに対して払いすぎている」なら、このページのまま判断を進めてよいです。不満が「route自体をまだ正常に動かせていない」なら、次に読むべきは OpenAI image API tutorial であって、provider migrationではありません。

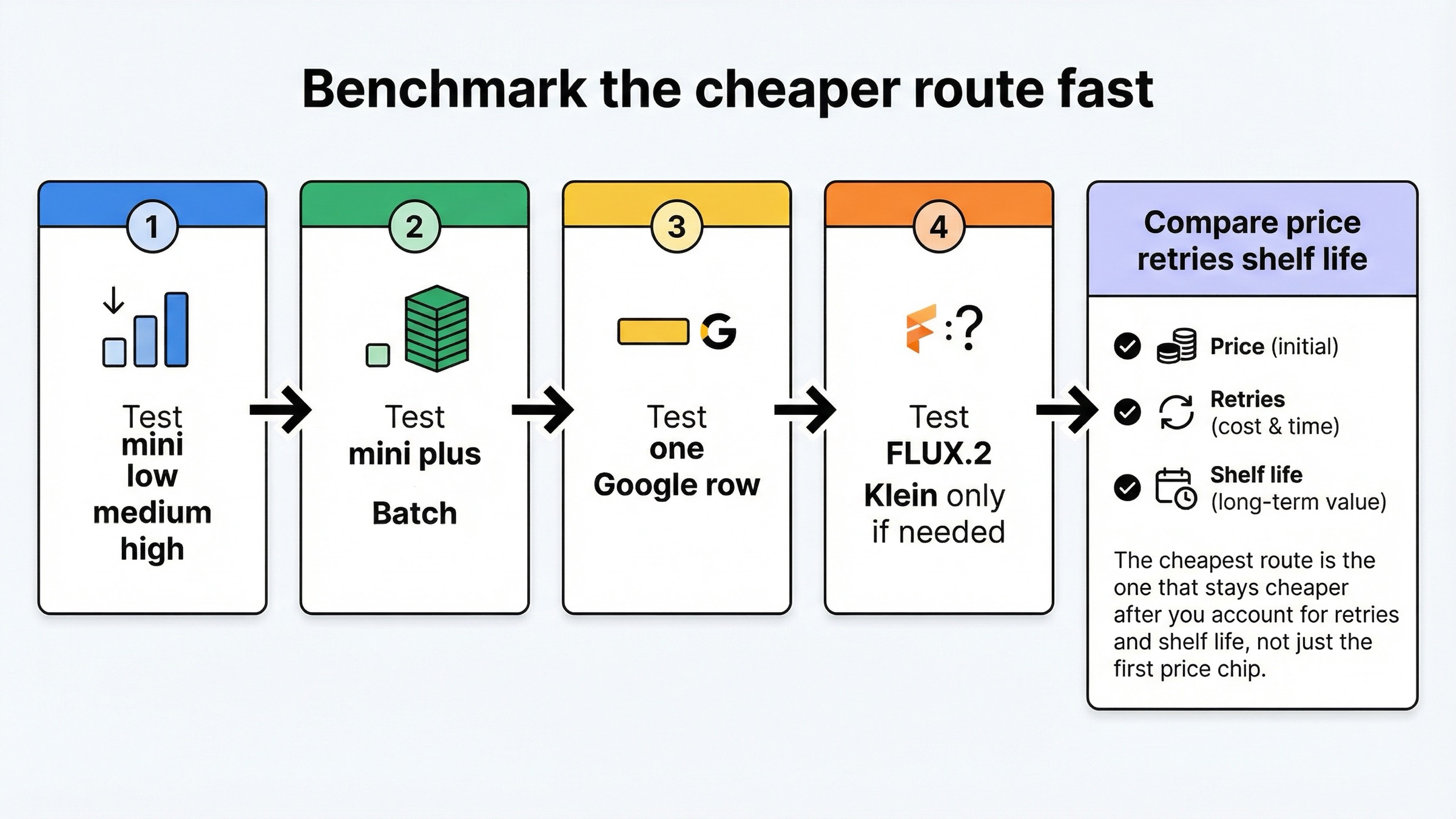

1回の午後でどう比較するか

1つのprice rowで決めないでください。1回の制御された午後で決めます。

- 同じprompt setを mini low、medium、high に流します。そもそも自分がどのmini rowと比較しているか分からないままでは、このkeywordに正直に答えられません。

- workloadを待たせられるなら miniをBatchで回します。同じmodel familyのままplatform layerでinputsとoutputsを半分にできるので、これが最初のcheap workflow routeです。

- Imagen 4 Fast は、本当に比較相手がmini highで、しかもシンプルなGoogle-hosted generation laneが欲しいときだけ入れます。

gemini-2.5-flash-imagebatch は、2026年10月2日 のshutdown dateが計画を壊さない場合だけ入れます。- FLUX.2 Klein は、like-for-likeなmini replacementではなく、lower-end external volume laneを本当に買う気があるときだけ入れます。

最後に見るべきは一つではなく三つです。

- usable image 1枚あたりの価格

- keepしたい結果に届くまでのretry回数

- shutdown dateとworkflow shapeを含めたとき、そのrouteのshelf lifeが十分か

pricing guideが落としがちなのは、いつもこの最後の行です。最安rowが答えのすべてではありません。安いrouteとは、queue shape、quality expectation、shelf lifeまで入れてもなお安いrouteです。

FAQ

gpt-image-1-mini 全体より本当に安いものはありますか。

cleanな現行mainstream hosted swapとしてはありません。明確にminiを下回るrowがある場合でも、それは mini highだけ を下回っているか、Batch に依存しているか、あるいはjob自体が変わるほどroute shapeが違います。

miniを使い続ける前提で一番安い動きは何ですか。

まず mini low か mini medium で足りるか確認し、そのうえで非同期にできるなら Batch を試します。これが普通は最初の正直なcheaper moveです。同じmodel familyに残ったまま、migrationが本当に必要かどうかを先に確かめられるからです。

sticker priceがGoogleのほうが低く見えるだけで移るべきですか。

それは mini high と比較していて、しかもlifecycle caveatを受け入れられる場合だけです。Imagen 4 Fast も gemini-2.5-flash-image batch も、その狭い比較では安く見えますが、mini lowやmediumより安いわけではなく、どちらもGoogle docsに2026年のshutdown dateがあります。

結論

gpt-image-1-mini のもっと安い代替案は、たいてい 別のmainstream hosted image modelそのものではありません。

価格だけが問題なら、miniのままでまずBatchを試す のが先です。mini highだけ を下回りたいなら Imagen 4 Fast や gemini-2.5-flash-image batch は現実のrowですが、どちらも2026年のshutdown caveatを持ち、mini lowやmediumより安いわけではありません。lower-endなexternal volume laneが欲しいなら FLUX.2 Klein がBFL側の最も素直な候補ですが、それはjob changeであってuniversal mini replacementではありません。そして痛みの正体がverificationやaccess stateなら、pricing problemと呼ぶ前にsetupを直す べきです。

いまのSERPがまだ隠している正直な答えはこれです。miniはすでにfloorです。必要なのは、新しい最安モデル探しよりも、そのfloorを最適化するのか、そこから外れるべきなのか、あるいはsetup issueをpricing issueと取り違えていないかを見分けることです。