まず、本当に Gemini を離れる必要があるかを確認するべきです。 すでに Gemini 2.5 Flash-Lite の価格帯と Gemini の multimodal surface に収まる workload なら、vendor を切り替えても SERP が示すほど節約できないことがあります。

より有用な問いは、あなたの実 workload に対してどの alternative が本当に安く、移ったときに何を失うかです。純粋な text generation では Gemini より安い route もありますが、multimodal coverage、vendor consolidation、Google の現行 API surface に残る価値まで含めると、Gemini がまだ better default であることは多いです。

要点まとめ

いちばん短い結論はこうです。安くて安定したマルチモーダルの既定路線が欲しいなら、まずGeminiに残るべきです。乗り換えを考えるのは、トラフィックがほぼテキスト中心、クォータ問題の方が価格より痛い、あるいは別のベンダー生態系が重要なときだけで十分です。

| 選択肢 | 現在の価格 | どんな時に最適か | 主なトレードオフ |

|---|---|---|---|

| Gemini 2.5 Flash-Lite | 入力$0.10 / 出力$0.40 | 現在もっとも安い安定Geminiルート。テキスト、画像、動画、Google系ツールも残せる | Googleのプロジェクト単位クォータの影響は受ける |

| Gemini 3.1 Flash-Lite Preview | 入力$0.25 / 出力$1.50 | Gemini 3系の新しい能力が必要なときだけ | 新しいが安くはない |

| DeepSeek-V3.2 | 入力$0.28 / 出力$0.42 | 低価格のテキスト/推論用途 | 標準出力はGemini 2.5 Flash-Liteより安くない |

| Mistral Small 3.2 | 入力$0.10 / 出力$0.30 | 低価格ホスト型APIを使いたいテキスト中心ワークロード | 128Kコンテキストで、製品面はより狭い |

| Groqの低価格テキストモデル | Llama 3.1 8Bは$0.05 / $0.08、GPT OSS 20Bは$0.075 / $0.30 | 高スループットの安価なテキスト処理 | Geminiのマルチモーダル代替ではない |

| OpenAI GPT-5.4 nano | 入力$0.20 / 出力$1.25 | OpenAIエコシステム優先のとき | 標準料金ではGeminiよりかなり高い |

| Claude Haiku 4.5 | 入力$1 / 出力$5 | Anthropicを明確に選びたいとき | 安いAPIではない |

もし知りたいことが「今いちばん安いGeminiは何か」だけなら、まず Gemini API free quota 2026 を見た方が早いです。より広い比較軸が欲しいなら Gemini vs OpenAI vs Claudeのコスト比較 も役に立ちます。

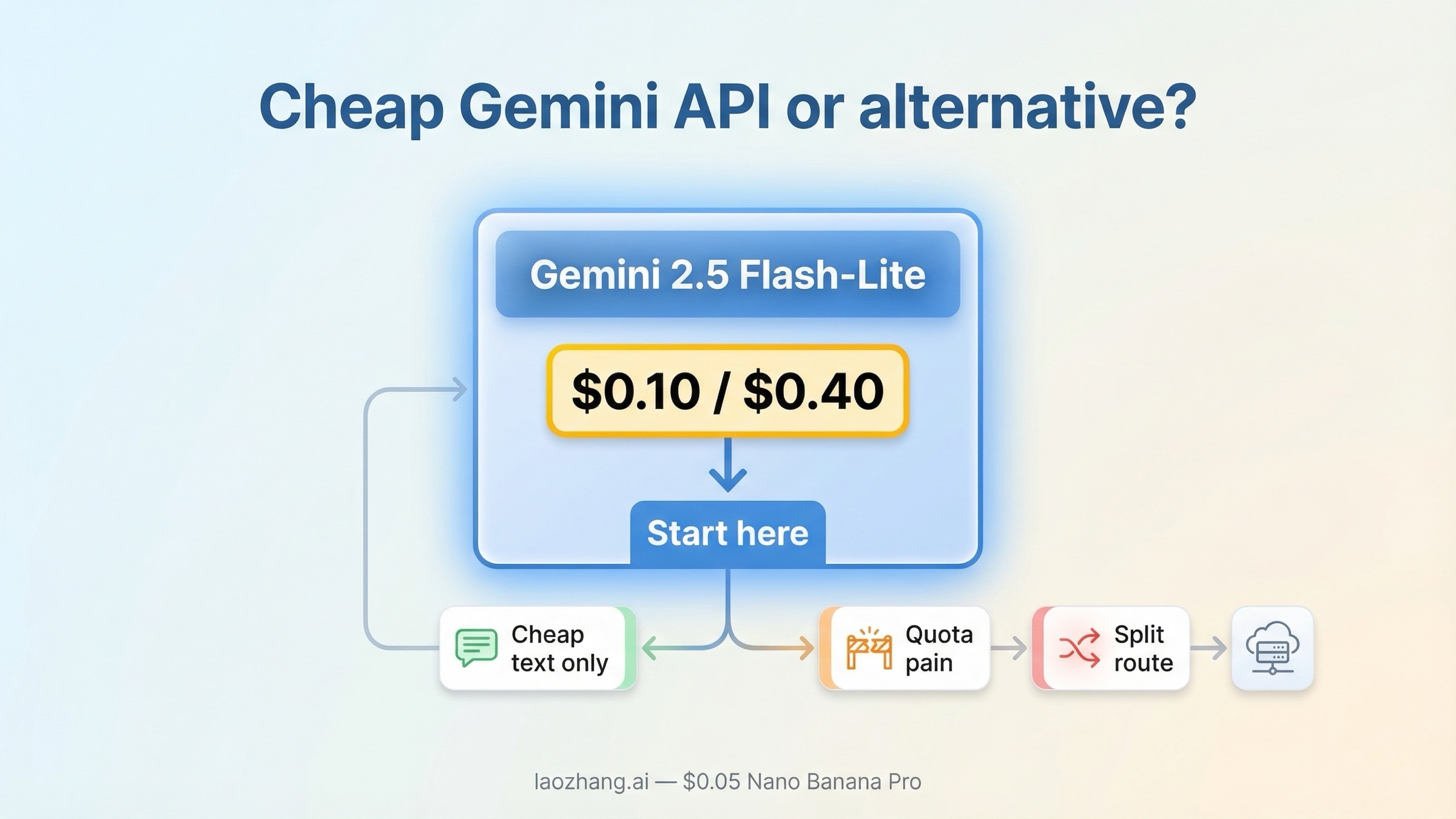

「安いGemini API」と「Gemini APIの代替」は同じ検索ではない

SERPではこの2つが混ざっていますが、開発者にとっては別問題です。“cheap Gemini API” と検索する人は、たいてい次のどれかを知りたいはずです。

- いま一番安いGeminiモデルはどれか

- 自分の用途ではGeminiより安いAPIがあるのか

- 問題は価格ではなく、クォータや運用の不安定さなのではないか

この3つは答え方が違います。最初はGoogleの料金表で済みます。2つ目はベンダー横断の価格比較が必要です。3つ目はそもそもtoken単価ではなく、運用設計の話です。

今の上位ページが物足りなく見えるのはここです。消費者向けの“Gemini alternatives”記事はチャットツール比較に寄りすぎますし、API系の比較記事は会社名を並べるだけで「そもそもGeminiを残した方が安いのでは?」という問いに正面から答えないことが多い。公式ドキュメントは数字は正確でも、意思決定まではしてくれません。

だからこのキーワードで本当に強い記事は、単に候補を増やすことではなく、価格、クォータ、移行コスト、ワークロード特性を同時に判断できること が必要です。基本ルールはひとつです。Geminiを残すのがデフォルトで、別プロバイダに切り替えるのは、その用途で本当に安く、しかも失う機能を受け入れられる時だけ。多くの比較記事はこの基準を先に言い切っていません。

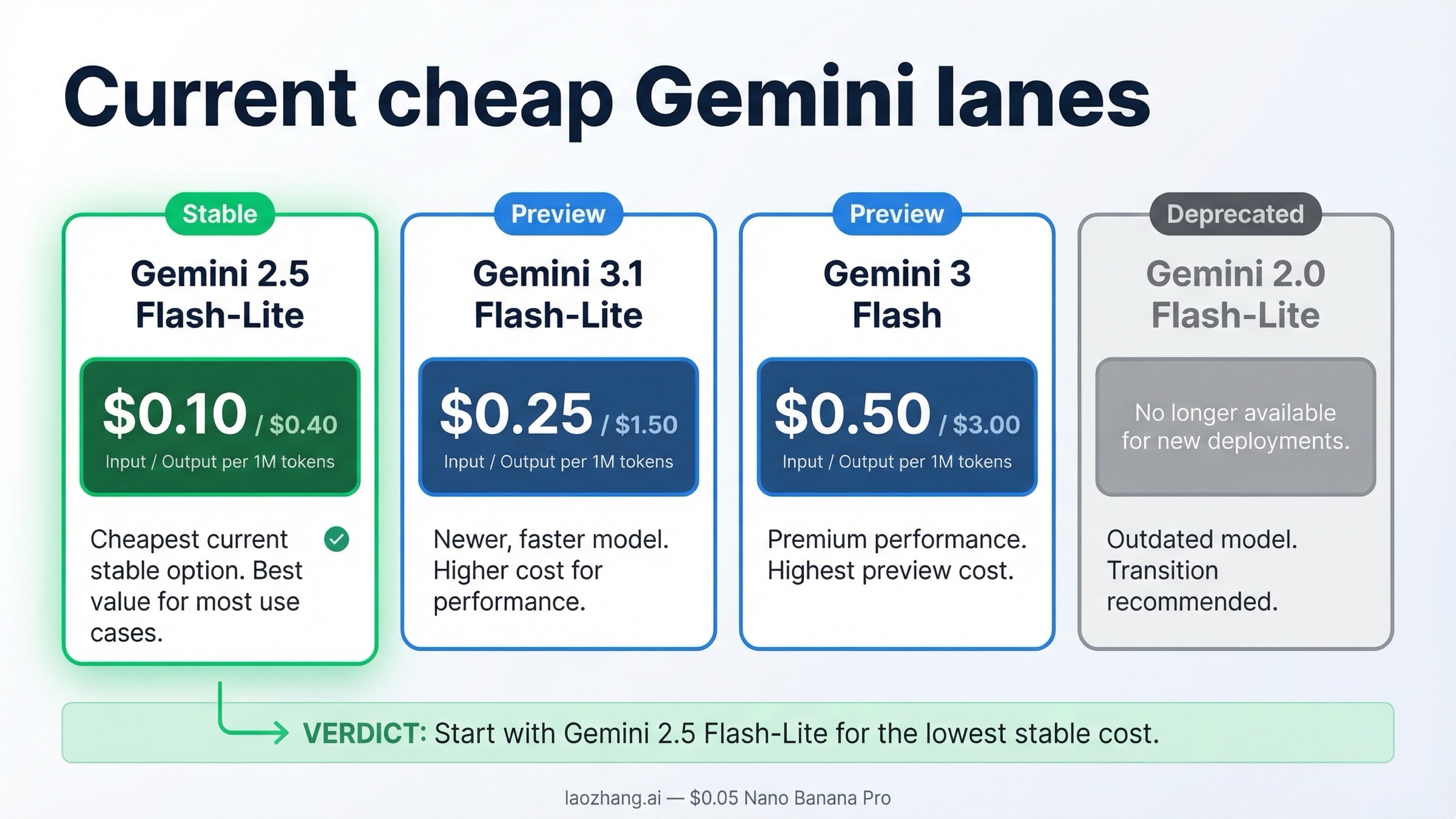

2026年3月時点で安いGeminiルートはどれか

いま最も安い安定版Geminiルートは Gemini 2.5 Flash-Lite です。Google公式料金ページでは標準料金が 入力$0.10 / 出力$0.40、Batchなら $0.05 / $0.20 と書かれています。ここが重要なのは、“cheap Gemini API” を探す人の多くが、実際には「新しいGemini 3 previewを使うべきか、それとももっと軽い安定モデルで十分か」を迷っているからです。

一方で、新しいpreviewラインは安い答えではありません。Googleは現在、Gemini 3.1 Flash-Lite Preview を $0.25 / $1.50、Gemini 3 Flash Preview を $0.50 / $3.00 と載せています。Gemini 3系が必要なら合理的な選択ですが、コスト最優先で見ると 2.5 Flash-Lite の代わりにはなりません。

さらに Gemini 2.0 Flash-Lite は $0.075 / $0.30 なので紙の上ではもっと安いです。ただし同じページに deprecated と明記されており、2026年6月1日 に終了予定です。2026年3月後半に新規導入するチームにとって、数セント安い代わりにすぐ移行が必要になるルートを主推奨にするのは筋が良くありません。

加えて、Googleのコストは単純な表の比較だけで決まりません。Googleは paid tier の利点として context caching と Batch APIによる50%コスト削減 を明示しています。繰り返しプロンプト、大きな共有コンテキスト、非同期バッチ処理が多いワークロードなら、Geminiの実効コストはかなり下がります。

もうひとつ見落とされがちなのが OpenAI互換エンドポイント です。Googleは公式に「OpenAIライブラリを使いながら設定変更だけでGeminiを呼べる」ことを案内しています。つまり、OpenAI風SDKを使いたいからといって、Geminiから出る必要は必ずしもありません。

Geminiが必要以上に高く見えるときの典型的な勘違い

一つ目は、比較対象のGeminiラインを間違えることです。Gemini 3 Flash Preview を Groq Llama 3.1 8B や Mistral Small 3.2 と並べれば、Geminiは確かに高く見えます。でもそれは“安いルート同士”の比較ではありません。Gemini 3 Flash Previewは、より高機能なpreview tierです。予算比較で見るべきは Gemini 2.5 Flash-Lite です。

二つ目は、マルチモーダル価格 と テキスト価格 を同じものとして扱うことです。Groqの低価格モデルは、テキスト生成、分類、抽出には非常に向いています。しかし、それがGeminiの画像・動画・grounding・単一API面を置き換えるわけではありません。安いテキストモデルが本当に“より安い解”になるのは、あとから他ベンダーを足さなくて済む場合だけです。

三つ目は、Batchやcacheの経済性 を無視することです。共有コンテキストや繰り返しsystem promptが多いなら、Googleの公式割引経路込みで見ないと比較を誤ります。

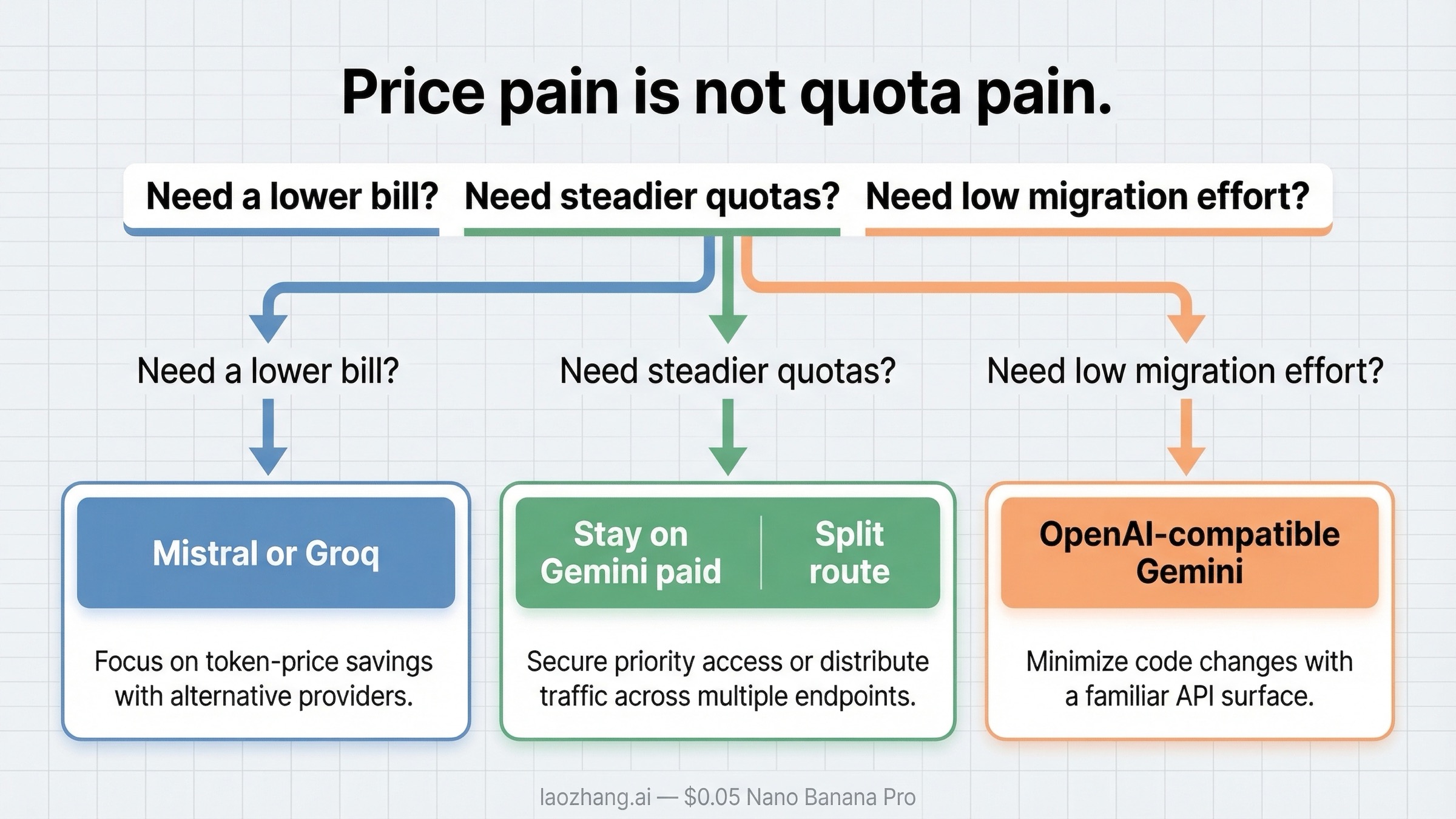

四つ目は、クォータの痛みを価格の痛みと混同すること。429エラーの直後に “Gemini alternatives” を探し始めると、価格だけが問題に見えてしまいます。でもその痛みは実際には、billing有効化、project分離、tier、または分流設計の問題かもしれません。

五つ目は、移行税 を軽視することです。SDK、監視、prompt、マルチモーダル設計まで変わるなら、トークン単価の差だけでは回収できないことがあります。

Geminiより実際に安い代替APIは何か

ワークロードがほぼテキストで、Geminiのマルチモーダル面をあまり使わないなら、Gemini 2.5 Flash-Lite より安い候補はあります。ただし“本当に安い代替”として成立する範囲は、よくあるlisticleよりずっと狭いです。

| モデル/プロバイダ | 現在の価格 | Gemini 2.5 Flash-Liteより安いか | 向いている場面 |

|---|---|---|---|

DeepSeek-V3.2 (deepseek-chat) | 入力$0.28 / 出力$0.42 | 入出力ともに安くない | DeepSeek寄りのtext/reasoning評価 |

| Mistral Small 3.2 | 入力$0.10 / 出力$0.30 | 出力は安い、入力は同じ | 低価格ホスト型テキストAPI |

| OpenAI GPT-5.4 nano | 入力$0.20 / 出力$1.25 | 安くない | OpenAIエコシステム優先 |

| Claude Haiku 4.5 | 入力$1 / 出力$5 | 安くない | Anthropicを選びたい場合 |

| Groq Llama 3.1 8B | 入力$0.05 / 出力$0.08 | 安い | 超低コストのテキスト処理 |

| Groq GPT OSS 20B | 入力$0.075 / 出力$0.30 | 安い | より強めの低価格テキスト路線 |

DeepSeek-V3.2 は直感的には“Geminiより安そう”に見えますが、現時点の公式価格は deepseek-chat で 入力$0.28 / 出力$0.42。Gemini 3 Flash Previewよりはずっと安いですが、Gemini 2.5 Flash-Liteよりは標準出力でも勝っていません。DeepSeekは有力候補ですが、“Geminiの完全上位互換の安い版”ではありません。

Mistral Small 3.2 はこのキーワードでかなり本命です。公式ページでは 入力$0.10 / 出力$0.30、128K context。入力はGeminiと同じ、出力は安い。要約、分類、構造化出力、軽い生成などでは、かなりバランスのよい低価格候補です。

OpenAI GPT-5.4 nano は価格勝負ではなく、ワークフロー継続性の選択肢です。OpenAIのdeveloper pricing pageは現在、標準料金として 入力$0.20 / cached input $0.02 / 出力$1.25 を示しています。これは“安い代替”というより、“OpenAIの道具立てを優先するために追加コストを払うか”という話です。

Claude Haiku 4.5 はここでは反例として重要です。Anthropic公式価格は $1 / $5。cheap APIの記事でClaudeを強く推すなら、まずその価格差を明確にしないと不誠実です。

Groq は本当に“安いテキスト路線”として見る価値があります。公式モデル一覧では Llama 3.1 8Bが$0.05 / $0.08、GPT OSS 20Bが$0.075 / $0.30、developer planで 1K RPM。高ボリュームのテキスト処理ならかなり魅力的です。ただし、ここでも前提は同じで、GroqはGeminiのフルスタックを置き換えるためではなく、安いテキストを担当させるための候補 と読むべきです。

Geminiを離れる理由は価格だけではない

この検索意図では、価格は半分で、残り半分はクォータや運用ストレスです。

Googleの公式 rate limitsページ は、制限が API key単位ではなくproject単位 であること、RPDがPacific Timeの深夜にリセット されること、実際の上限は AI Studio で見ること、preview/experimentalモデルはより厳しい制限になり得ることを明示しています。これだけでも、なぜ“安いのに運用が読みにくい”と感じる人が多いのか説明がつきます。

コミュニティ側ではその痛みがさらに具体的です。新規無料アカウントで即429が返るスレッド や、Tier 1 paidでも無料枠扱いの指標に縛られるスレッド を見ると、検索者が“単価比較”より“もっと安定した運用先が欲しい”と思っていることがよく分かります。

したがって、判断はこう分けるべきです。

- 問題が 請求額 なら、まず標準token価格を比べる。

- 問題が クォータの不安定さ なら、まずルーティングとバックアップ先を考える。

- 問題が 移行コスト なら、GeminiのOpenAI互換で足りるかを先に確認する。

この違いを無視すると、“best alternative” の答えがいつもズレます。テキスト中心のパイプラインと、たまに429が出るマルチモーダルアプリでは、最適解が同じはずがありません。

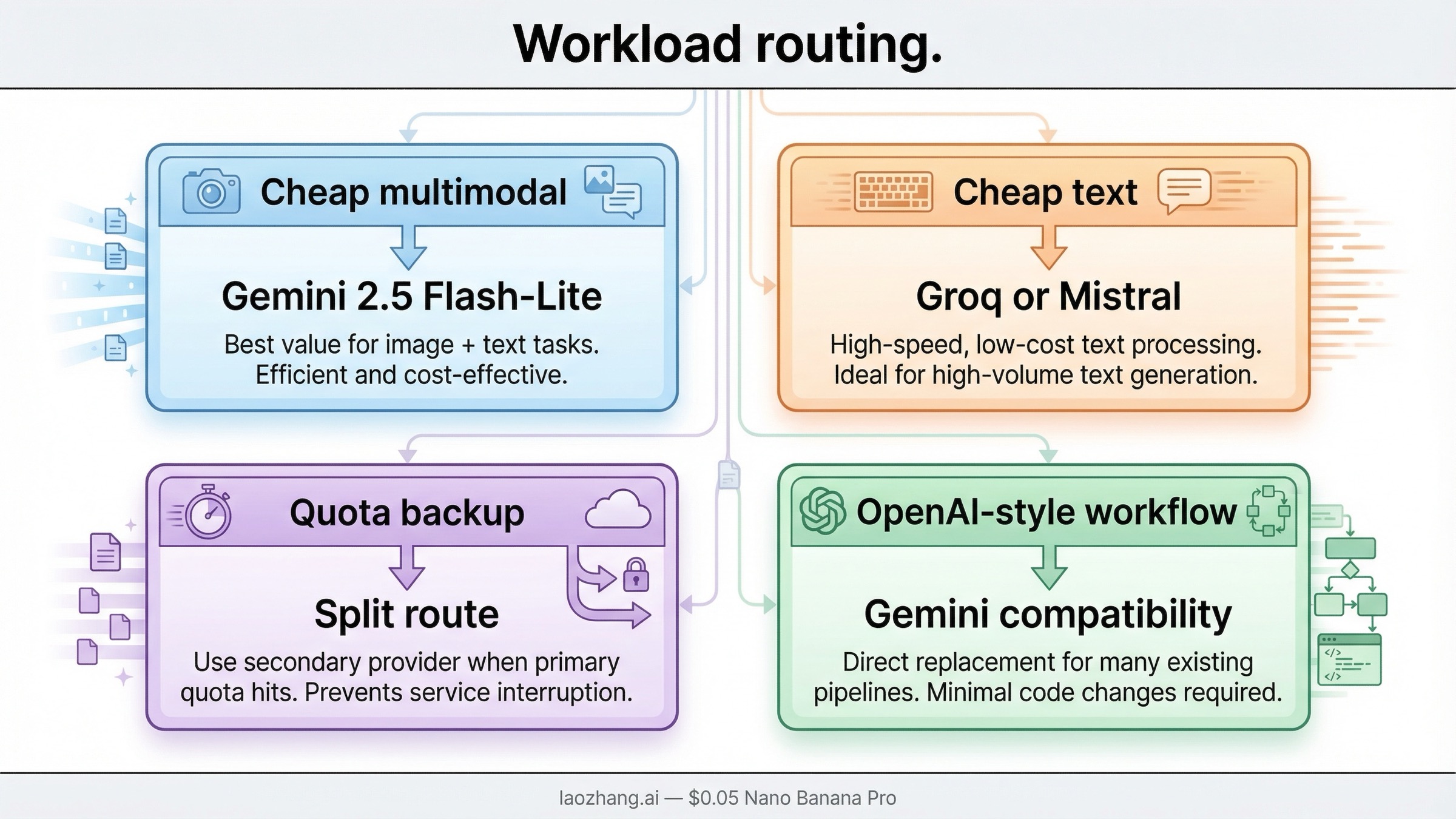

実務ではどう使い分けるべきか

実際に役に立つ答えは、「5社並べること」ではなく「何をどこに流すべきか」をはっきりさせることです。

安くて安定したマルチモーダルのデフォルト が欲しいなら、まず Gemini 2.5 Flash-Lite。テキスト、画像、音声、動画が混ざるアプリでは、1社にまとめられる価値が大きいです。

最安の純テキスト路線 が欲しいなら、Groq か Mistral Small 3.2。単価重視ならGroq、より一般的なhosted API体験ならMistralです。

低価格のtext-plus-reasoning候補 として見ておくべきなのが DeepSeek-V3.2。ただし、Gemini 2.5 Flash-Liteより全方面で安いわけではありません。

OpenAI風SDKワークフローを残したい なら、OpenAIに移る前にGeminiの OpenAI互換レイヤー を確認する価値があります。GPT-5.4 nanoはワークフロー都合の選択肢であって、価格の主役ではありません。

クォータ摩擦が主問題 なら、最も現実的なのは split route です。マルチモーダルやGoogle依存の処理はGeminiに残し、安いテキスト処理だけをGroq、Mistral、DeepSeekへ逃がす。これなら全面移行せずに痛い部分だけ切り離せます。

FAQ

今いちばん安いGemini APIは何ですか?

2026年3月21日時点で、現在もっとも安い安定版Gemini APIは Gemini 2.5 Flash-Lite です。標準料金は 入力$0.10 / 出力$0.40。Gemini 2.0 Flash-Liteは紙の上では安いですが、deprecatedで2026年6月1日に終了予定です。

テキスト専用なら、いちばん安いGemini代替は何ですか?

この比較で確認できた範囲では、最安クラスなのは Groqの低価格テキストモデル です。よりバランスのよいhosted APIを求めるなら Mistral Small 3.2 が有力です。

Gemini 3.1 Flash-LiteはGemini 2.5 Flash-Liteより安いですか?

いいえ。Googleの公式価格は Gemini 3.1 Flash-Lite Previewが$0.25 / $1.50、Gemini 2.5 Flash-Liteが$0.10 / $0.40 です。新しいpreviewラインは安いラインではありません。

OpenAIライブラリを使いたいならGeminiを離れる必要がありますか?

必ずしもありません。Googleは公式にOpenAI互換エンドポイントを提供しており、多くの既存コードは設定変更だけでGeminiを利用できます。

価格が悪くなくてもGeminiを離れた方がいいのはどんな時ですか?

トラフィックの大半がテキストで、クォータ問題が安定性を壊している、あるいは別プロバイダの方が運用面で明確に合っている時です。単に“代替候補が多いから”ではなく、自分の仕事で本当に安く、しかも十分に使える時だけ 切り替えるべきです。