La API de Seedance 2.0 no se ha lanzado oficialmente a fecha de 31 de marzo de 2026. A pesar de lo que puedas haber leído en diversos blogs y plataformas de terceros, ByteDance retrasó el lanzamiento global de la API debido a problemas continuos de cumplimiento de derechos de autor con estudios de Hollywood, y actualmente no existe ningún acceso legítimo a la API. Muchos sitios web que afirman ofrecer acceso a la API de Seedance 2.0 están ejecutando puntos de conexión de ingeniería inversa no oficiales de la plataforma de consumo sin garantías de fiabilidad, o simplemente muestran páginas de precios para un producto que aún no existe. Esta guía elimina el ruido para darte el estado real del lanzamiento, lo que sabemos sobre el precio esperado, cómo se compara el modelo con alternativas que sí puedes usar hoy, y cómo posicionarte para acceder desde el primer día cuando la API se lance a través de socios oficiales como laozhang.ai.

Resumen rápido

- Seedance 2.0 es el modelo insignia de generación de vídeo de ByteDance — calidad cinematográfica, audio nativo, entrada multimodal, resolución de hasta 2K a 24fps

- La API NO se ha lanzado aún a fecha de marzo de 2026 — el despliegue global a través de BytePlus se retrasó por problemas de derechos de autor

- La mayoría de los sitios de terceros que afirman tener acceso a la API no son fiables — ten cuidado con tu dinero

- Precio esperado: ~$0.05/vídeo a través de socios oficiales como laozhang.ai cuando se lance la API (laozhang.ai es socio oficial de distribución y estará entre los primeros en ofrecer acceso)

- La plataforma de consumo (CapCut Dreamina) está disponible ahora para probar las capacidades del modelo antes del lanzamiento de la API

- Mientras tanto, Sora 2 ($0.15/vídeo) y Veo 3.1 ($0.15/vídeo) están disponibles hoy a través de laozhang.ai

¿Qué es Seedance 2.0 y por qué importa para los desarrolladores?

ByteDance lanzó Seedance 2.0 en febrero de 2026 como un modelo unificado de generación multimodal de audio y vídeo, y de inmediato transformó la economía de la creación de vídeo con IA. A diferencia de los modelos anteriores de generación de vídeo que trataban las entradas de texto, imagen y audio como pipelines separados, Seedance 2.0 procesa las cuatro modalidades a través de una única arquitectura denominada Dual-Branch Diffusion Transformer. Esta decisión arquitectónica no es solo una nota técnica al margen — afecta directamente tanto a la calidad del resultado como al costo de generación, porque un único paso unificado es inherentemente más eficiente que encadenar múltiples modelos especializados.

El impacto práctico para los desarrolladores es significativo. Mientras que Sora 2 destaca en la simulación de movimiento físicamente preciso y Veo 3.1 empuja los límites de resolución hasta 4K, Seedance 2.0 se posiciona en su propio nicho al aceptar hasta 12 archivos de referencia simultáneamente — imágenes de personajes, fotos de entornos, plantillas de movimiento y pistas de audio, todo en una sola petición. Este sistema de referencias multimodal significa que puedes mantener la consistencia visual a lo largo de una serie de vídeos generados sin las complicadas soluciones de ingeniería de prompts que otros modelos requieren. Para equipos de producción que crean contenido de marketing, clips para redes sociales o vídeo de formato corto a escala, esta consistencia vale más que los números de resolución bruta.

El modelo genera vídeos de entre 4 y 15 segundos por petición a resoluciones de hasta 2K (2048x1080) con reproducción nativa a 24fps. Lo que lo diferencia de todos los competidores es la generación de audio nativo — Seedance 2.0 produce efectos de sonido sincronizados, audio ambiental e incluso diálogos en más de 8 idiomas como parte del mismo paso de generación. Otros modelos generan vídeo sin sonido o requieren un paso separado de síntesis de audio, añadiendo tanto costo como complejidad al pipeline. Según la evaluación interna SeedVideoBench-2.0 de ByteDance, el modelo lidera en adherencia a instrucciones, calidad de movimiento, estética visual y dimensiones de renderizado de audio, aunque evaluaciones independientes de fuentes como Artificial Analysis han confirmado su posición número uno en votación de preferencia comunitaria frente a Veo 3, Sora 2, Runway Gen-4 y Kling 2.0 (Artificial Analysis, marzo 2026 verificado).

El proceso de generación sigue un patrón asíncrono basado en trabajos: envías una petición, recibes un ID de trabajo, consultas el estado periódicamente (normalmente 30-120 segundos) y luego descargas el vídeo resultante. Esta arquitectura es estándar para cargas de trabajo de IA intensivas en cómputo, pero significa que tu aplicación necesita un manejo adecuado de operaciones asíncronas, lógica de reintentos y soporte de webhooks para despliegues en producción. La recompensa es el acceso a uno de los modelos de generación de vídeo más capaces disponibles a una fracción del costo de sus competidores más cercanos.

Estado del lanzamiento de la API de Seedance 2.0 — ¿Qué está realmente disponible? (Marzo 2026)

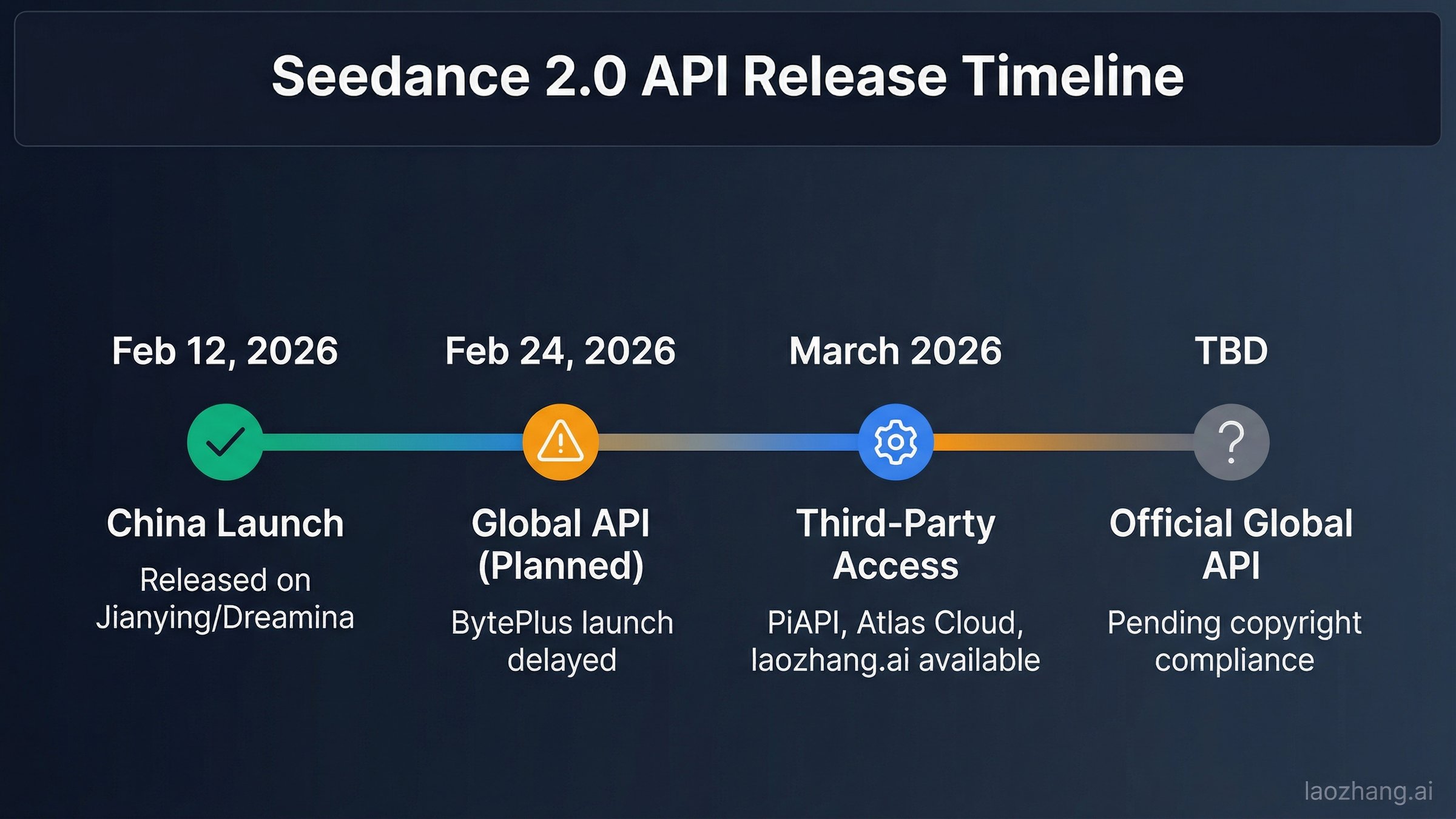

Comprender la disponibilidad actual de Seedance 2.0 requiere ser honesto sobre qué es real y qué es puro marketing, porque la situación es genuinamente confusa y muchos artículos están engañando a los lectores. ByteDance planeó originalmente un lanzamiento global coordinado entre plataformas de consumo y APIs para desarrolladores a finales de febrero de 2026, pero las complicaciones legales han descarrilado por completo el despliegue de la API. Esto es lo que realmente es cierto a fecha de 31 de marzo de 2026.

La plataforma de consumo se lanzó según lo previsto — este es el único acceso legítimo hoy. Seedance 2.0 estuvo disponible a través de Jianying (el editor de vídeo chino de ByteDance, en jimeng.jianying.com) y CapCut Dreamina (el equivalente internacional, en dreamina.capcut.com) el 12 de febrero de 2026. Dentro de estas plataformas, el modelo aparece como "Seedance 40 Pro" y es accesible mediante una suscripción que comienza en aproximadamente 69 RMB al mes (unos $9.60 USD). Este acceso de consumo funciona globalmente y no requiere un número de teléfono chino, lo que lo convierte en la única forma fiable de usar el modelo en este momento. Si necesitas evaluar las capacidades de Seedance 2.0 antes del lanzamiento de la API, este es el lugar donde deberías empezar.

La API oficial para desarrolladores está retrasada sin fecha confirmada. BytePlus, la plataforma de nube internacional de ByteDance, tenía previsto lanzar la API de Seedance 2.0 el 24 de febrero de 2026. Ese lanzamiento fue pospuesto indefinidamente debido a problemas de cumplimiento de derechos de autor — específicamente, la presión de estudios de Hollywood respecto a los datos de entrenamiento utilizados para el modelo. A fecha de 31 de marzo de 2026, BytePlus no ha anunciado una fecha de lanzamiento revisada. El equivalente doméstico a través de Volcengine (Volcano Ark) tampoco está disponible para desarrolladores individuales. Esto significa que no existe ningún punto de conexión API oficial que alguien pueda usar, independientemente de lo que los sitios web de terceros afirmen.

La mayoría de las afirmaciones de "acceso a la API" de terceros no son fiables — ten precaución. Desde el retraso de la API oficial, numerosos sitios web han aparecido afirmando ofrecer acceso a la API de Seedance 2.0. La realidad es que la mayoría de estos servicios están ejecutando puntos de conexión de ingeniería inversa de la plataforma de consumo, lo que significa que no tienen soporte oficial, no ofrecen garantías de SLA y pueden dejar de funcionar en cualquier momento cuando ByteDance actualice su plataforma de consumo. Algunos simplemente están listando páginas de precios para un producto que realmente no pueden entregar. Antes de pagar a cualquier proveedor externo por acceso a la API de Seedance 2.0, pregúntate: si ByteDance no ha lanzado la API, ¿de dónde exactamente obtiene este proveedor su acceso? La respuesta en la mayoría de los casos es ingeniería inversa inestable o directamente una tergiversación.

Los socios oficiales de distribución tendrán acceso desde el primer día cuando la API se lance. laozhang.ai es un socio oficial de distribución de las APIs de generación de vídeo de ByteDance y estará entre las primeras plataformas en ofrecer acceso legítimo a la API de Seedance 2.0 cuando BytePlus levante el retraso. El precio esperado es de aproximadamente $0.05 por vídeo — significativamente más barato que modelos comparables. Mientras tanto, laozhang.ai ya ofrece acceso comprobado a la API de otros modelos líderes de generación de vídeo, incluyendo Sora 2 ($0.15/vídeo) y Veo 3.1 ($0.15/vídeo), para que puedas construir tu pipeline de generación de vídeo hoy y cambiar a Seedance 2.0 con cambios mínimos de código una vez que esté disponible. Regístrate en laozhang.ai para recibir una notificación cuando la API de Seedance 2.0 esté activa.

Precio esperado de la API de Seedance 2.0: lo que sabemos hasta ahora

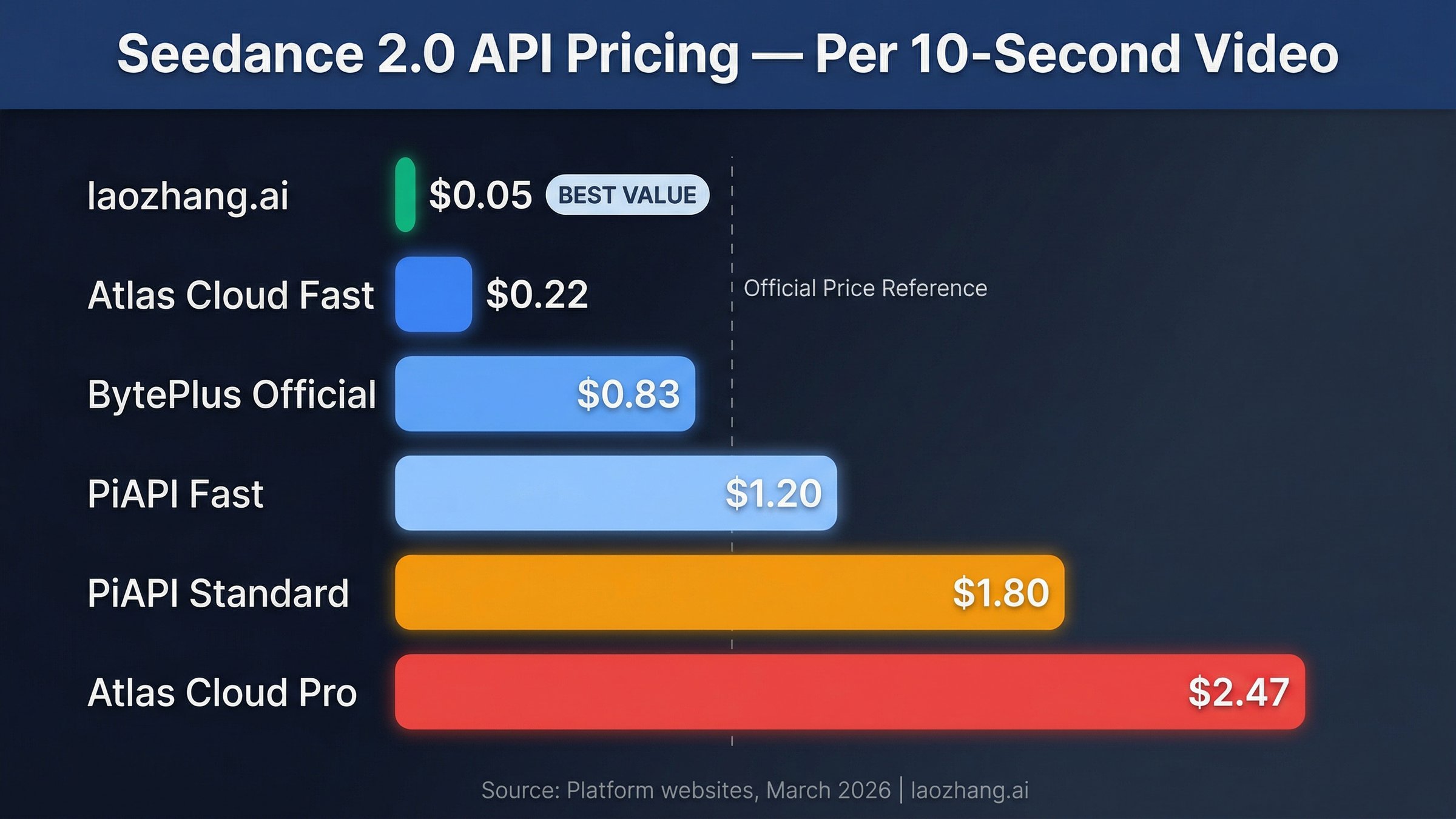

Dado que la API oficial de Seedance 2.0 aún no se ha lanzado, toda la información de precios debe tratarse como estimaciones preliminares en lugar de tarifas confirmadas. Dicho esto, varios puntos de datos nos dan una imagen razonable de qué esperar. La propia documentación de ByteDance y las comunicaciones con socios sugieren niveles de precios basados en resolución y duración, mientras que la plataforma de consumo Dreamina proporciona una referencia de lo que ByteDance considera un precio justo de mercado.

| Fuente | Precio esperado | Base | Fiabilidad |

|---|---|---|---|

| laozhang.ai (socio oficial) | ~$0.05/vídeo | Acuerdo de socio | Alta — socio oficial de distribución |

| Documentación de BytePlus (filtrada) | $0.10-$0.80/min | Documentación previa al lanzamiento | Media — puede cambiar antes del lanzamiento |

| Plataforma de consumo Dreamina | ~$9.60/mes suscripción | Precio en vivo | Alta — disponible actualmente |

| Diversas afirmaciones de terceros | $0.02-$0.25/s | Listados no verificados | Baja — la mayoría no están entregando realmente el servicio |

¿Por qué el precio esperado es tan competitivo? ByteDance ha señalado consistentemente que Seedance 2.0 se posicionará como el modelo premium de generación de vídeo más rentable del mercado. Su arquitectura Dual-Branch Diffusion Transformer procesa vídeo y audio en un único paso unificado, lo cual es inherentemente más eficiente en cómputo que los modelos que requieren pasos de generación separados. Esta ventaja arquitectónica se traduce directamente en costos más bajos por vídeo. A un precio esperado de $0.05 por vídeo a través de socios oficiales como laozhang.ai, Seedance 2.0 sería aproximadamente 3 veces más barato que Sora 2 y Veo 3.1 a niveles de calidad equivalentes.

Para la planificación de costos de producción, esto es lo que significa el precio esperado a escala. Basándose en el precio proyectado de $0.05 por vídeo a través de laozhang.ai, un equipo pequeño que genere 100 vídeos al mes para contenido de redes sociales gastaría solo $5 al mes. A escala empresarial (1,000 vídeos al mes), el costo sería de aproximadamente $50 — menos que una sola suscripción de consumo de Dreamina. Para equipos que ya usan Sora 2 a $0.15/vídeo, cambiar a Seedance 2.0 cuando se lance reduciría los costos de generación de vídeo en aproximadamente un 67%. Para un análisis más profundo de las tendencias de precios de la API de Seedance, consulta nuestra guía sobre los proveedores más económicos de API Seedance.

Sé extremadamente escéptico con los precios "en vivo" de proveedores de terceros no verificados. Si un sitio web está anunciando tarifas específicas por segundo para acceso a la API de Seedance 2.0 ahora mismo (marzo de 2026), pregúntate de dónde están obteniendo el modelo. ByteDance no ha lanzado la API a ningún proveedor externo excepto a socios oficiales de distribución. Cualquier servicio que ofrezca la API de Seedance 2.0 hoy probablemente está ejecutando puntos de conexión de ingeniería inversa de la plataforma de consumo que podrían dejar de funcionar en cualquier momento, producir resultados inconsistentes o simplemente no funcionar en absoluto. Protege el presupuesto de tu proyecto esperando al acceso legítimo a través de canales oficiales.

Cómo acceder a la API de Seedance 2.0 sin una cuenta china

Una de las preguntas más frecuentes de los desarrolladores internacionales es si necesitan un número de teléfono chino, una cuenta de TG o un registro en Volcengine para usar Seedance 2.0. La respuesta corta es no — existen múltiples vías para acceder al modelo completamente a través de plataformas internacionales con métodos de pago estándar en USD.

Opción 1 (disponible ahora): plataforma de consumo CapCut Dreamina. Si necesitas evaluar las capacidades del modelo ahora mismo, la plataforma Dreamina en dreamina.capcut.com proporciona una interfaz basada en navegador que funciona globalmente. Puedes registrarte con una cuenta de Google o un correo electrónico y acceder a Seedance 2.0 (listado como "Seedance 40 Pro" en el selector de modelos) a través de una suscripción que comienza en aproximadamente $9.60 al mes. Esta opción no proporciona acceso programático a la API, pero es la única forma legítima de usar Seedance 2.0 hoy. Úsala para crear prototipos de prompts, probar el sistema de referencias multimodal del modelo y entender lo que puede producir antes del lanzamiento de la API.

Opción 2 (próximamente): socios oficiales de distribución como laozhang.ai. laozhang.ai es un socio oficial de distribución que proporcionará acceso a la API de Seedance 2.0 a través de endpoints REST compatibles con OpenAI tan pronto como ByteDance levante el retraso del lanzamiento. El registro está disponible ahora — puedes crear una cuenta, obtener una clave de API y empezar a usar otros modelos de generación de vídeo (Sora 2 a $0.15/vídeo, Veo 3.1 a $0.15/vídeo) inmediatamente. Cuando Seedance 2.0 se lance, podrás cambiar de modelo con una sola línea de código. La documentación en docs.laozhang.ai proporciona especificaciones detalladas de endpoints y guías de autenticación que también se aplicarán a Seedance 2.0.

Opción 3 (futuro): acceso empresarial oficial de BytePlus. BytePlus, el servicio de nube internacional de ByteDance, eventualmente proporcionará acceso directo a la API con facturación en USD, cumplimiento internacional de datos y garantías de SLA empresariales. Cuando se lance, probablemente será la opción más fiable para grandes clientes empresariales que necesiten garantías contractuales y soporte dedicado. Sin embargo, basándose en el retraso actual, los desarrolladores individuales y los equipos pequeños deberían planificar utilizando socios oficiales de distribución como su canal principal de acceso.

Prepara tu código ahora para estar listo desde el primer día. La decisión más inteligente mientras esperas la API de Seedance 2.0 es construir tu pipeline de generación de vídeo usando un modelo disponible a través del mismo proveedor que ofrecerá Seedance 2.0. Configurando tu integración con laozhang.ai ahora usando Sora 2 o Veo 3.1, obtienes un pipeline de producción funcional hoy y una ruta de actualización casi instantánea a Seedance 2.0 cuando se lance — simplemente cambia el nombre del modelo en tu llamada a la API de sora-2 a seedance-2, y tu pipeline cambiará al modelo más económico y más capaz sin ningún otro cambio de código. Este enfoque te da valor inmediato en lugar de esperar sin hacer nada, y te posiciona para la transición más rápida posible.

Inicio rápido: construye tu pipeline ahora con Sora 2, actualiza a Seedance 2.0 después

Dado que la API de Seedance 2.0 aún no está disponible, el enfoque más inteligente es construir tu pipeline de generación de vídeo ahora usando un modelo disponible a través del mismo proveedor. El código a continuación usa Sora 2 a través de laozhang.ai — cuando Seedance 2.0 se lance, simplemente cambia el nombre del modelo de sora-2 a seedance-2 y todo lo demás permanece igual. Para una configuración más completa que cubra manejo de errores, integración de webhooks y procesamiento por lotes, consulta nuestra guía completa de integración.

pythonimport requests import time API_KEY = "your_api_key_here" BASE_URL = "https://api.laozhang.ai/v1" response = requests.post( f"{BASE_URL}/videos", headers={ "Authorization": f"Bearer {API_KEY}", "Content-Type": "application/json" }, json={ "model": "sora-2", # Cambiar a "seedance-2" cuando se lance "prompt": "A drone shot flying over a misty mountain valley at sunrise, golden light filtering through clouds, cinematic depth of field", "duration": 10, "resolution": "1080p", "audio": True } ) job = response.json() job_id = job["id"] print(f"Trabajo enviado: {job_id}") # Paso 2: Consultar el estado periódicamente (normalmente 30-120 segundos) while True: status = requests.get( f"{BASE_URL}/videos/{job_id}", headers={"Authorization": f"Bearer {API_KEY}"} ).json() if status["status"] == "completed": video_url = status["output"]["video_url"] print(f"Vídeo listo: {video_url}") break elif status["status"] == "failed": print(f"Generación fallida: {status.get('error', 'Error desconocido')}") break time.sleep(5) # Consultar cada 5 segundos

Para generación de imagen a vídeo, añade una imagen de referencia a tu petición para mantener la consistencia de personajes o escenas a través de múltiples vídeos. Este es el diferenciador más fuerte de Seedance 2.0 — ningún otro modelo maneja las referencias multimodales con tanta limpieza. Puedes incluir hasta 12 archivos de referencia (9 imágenes, 3 vídeos, 3 archivos de audio) en una sola petición añadiendo un array references al cuerpo JSON, con cada entrada especificando un role (como "subject", "environment", "motion" o "audio") y una URL o archivo codificado en base64.

Consejos de producción para el código anterior. El bucle de consulta mostrado aquí es adecuado para pruebas pero debería reemplazarse con callbacks de webhook en producción. La mayoría de los proveedores soportan un parámetro callback_url en la petición inicial que recibe una notificación POST cuando la generación se completa, eliminando la necesidad de consultas periódicas por completo. También deberías implementar retroceso exponencial en la verificación de estado y manejar el caso donde la generación tarda más de lo esperado — durante las horas pico, incluso el nivel "rápido" puede tardar ocasionalmente 3-4 minutos para prompts complejos.

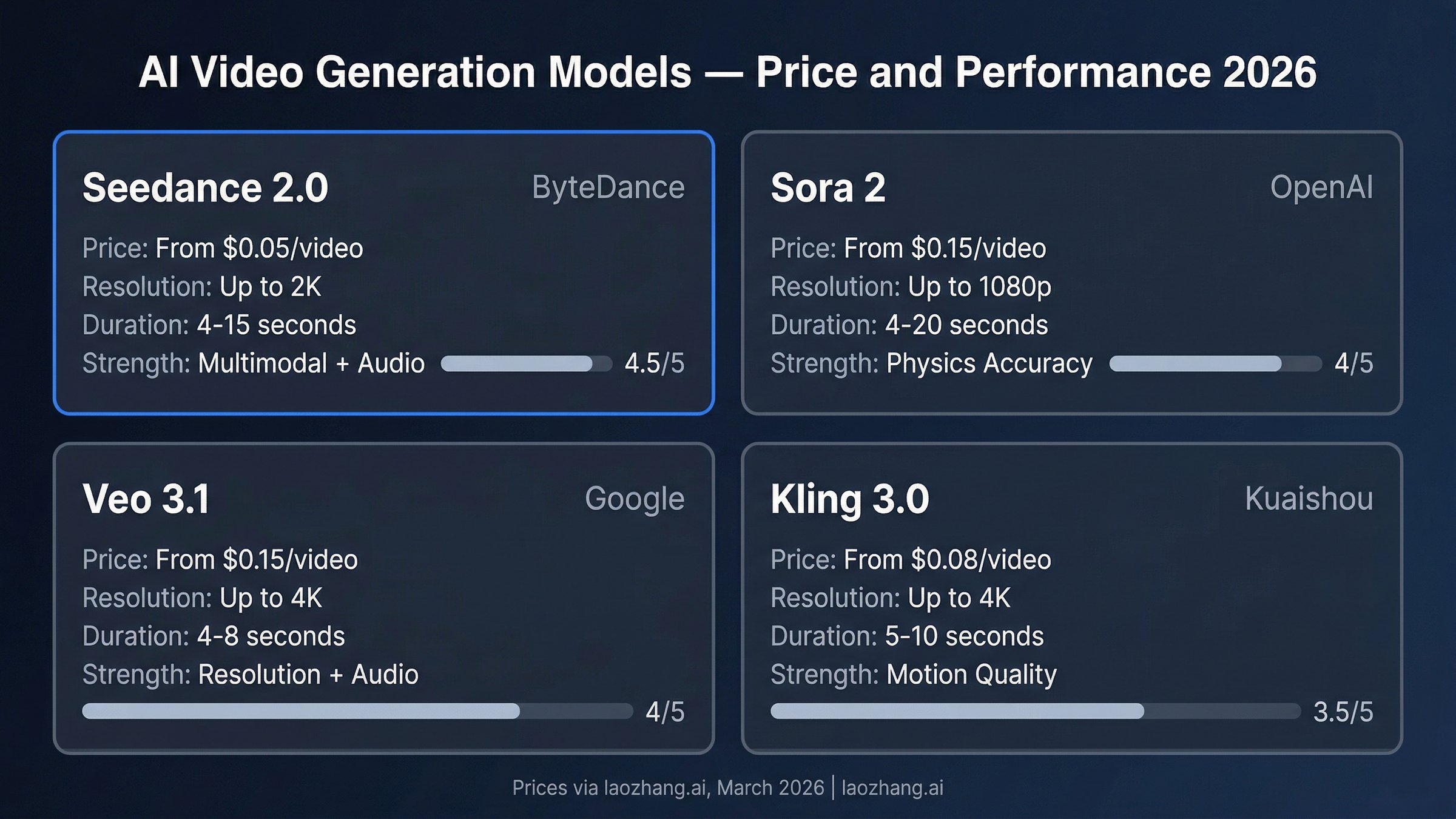

Seedance 2.0 vs Sora 2 vs Veo 3.1 vs Kling 3.0 — Precio y rendimiento

Elegir entre los modelos líderes de generación de vídeo con IA en 2026 depende de tu caso de uso específico, plazo y presupuesto. La comparación a continuación usa los precios de marzo de 2026 a través de laozhang.ai, que actualmente ofrece Sora 2 y Veo 3.1 y añadirá Seedance 2.0 tan pronto como se lance la API oficial. Las especificaciones de Seedance 2.0 se basan en las especificaciones publicadas por ByteDance y pruebas en la plataforma de consumo. Para un desglose aún más detallado, consulta nuestra comparación completa de modelos de vídeo.

| Característica | Seedance 2.0 | Sora 2 | Veo 3.1 | Kling 3.0 |

|---|---|---|---|---|

| Precio (vía laozhang.ai) | ~$0.05/vídeo (esperado) | $0.15/vídeo (activo) | $0.15/vídeo (activo) | $0.08/vídeo (activo) |

| Resolución máxima | 2K (2048x1080) | 1080p | 4K | 4K |

| Duración máxima | 15 segundos | 20 segundos | 8 segundos | 10 segundos |

| Audio nativo | Sí (8+ idiomas) | No | Sí | No |

| Entrada multimodal | Texto+Imagen+Audio+Vídeo | Texto+Imagen | Texto+Imagen | Texto+Imagen |

| Archivos de referencia | Hasta 12 | Hasta 2 | Hasta 2 | Hasta 3 |

| Precisión física | Buena | Excelente | Buena | Muy buena |

| Velocidad de generación | 30-120s | 60-180s | 30-90s | 45-120s |

Elige Seedance 2.0 (cuando esté disponible) para flujos de trabajo con referencias multimodales. Cuando la API se lance, Seedance 2.0 será la opción clara si necesitas mantener un personaje consistente a través de múltiples vídeos de marketing, o quieres combinar una foto de producto con una escena de fondo y una pista de audio específica en una sola petición. El sistema de referencias multimodal que acepta 12 entradas simultáneas es único en el mercado. A un precio esperado de $0.05 por vídeo, también sería la opción más económica por un margen significativo. Hasta que se lance, puedes prototipar tu flujo de trabajo usando Sora 2 a través de laozhang.ai y cambiar sin problemas cuando Seedance 2.0 esté disponible.

Elige Sora 2 cuando la precisión física sea lo más importante. El modelo de OpenAI todavía lidera en la simulación de física realista — los objetos caen con un peso convincente, los fluidos se comportan de forma natural y las colisiones se ven auténticas. Para vídeos de demostración de productos, visualizaciones arquitectónicas o cualquier contenido donde la audiencia vaya a examinar si el movimiento "se ve correcto", Sora 2 justifica su precio tres veces superior. También soporta la generación individual más larga con 20 segundos, reduciendo la necesidad de unir vídeos. A través de laozhang.ai, Sora 2 está disponible a $0.15 por vídeo con API asíncrona y facturación libre de fallos — solo pagas por los vídeos generados exitosamente.

Elige Veo 3.1 cuando la resolución y la calidad del audio sean primordiales. El modelo de Google alcanza una salida nativa de 4K y su generación de audio rivaliza con la de Seedance 2.0 en calidad. La contrapartida es la duración máxima más corta con 8 segundos y un mayor costo por segundo. Para tomas cinematográficas de establecimiento, documentales de naturaleza o cualquier contenido destinado a pantallas grandes, la ventaja en resolución de Veo 3.1 es significativa. Un punto intermedio interesante es usar Veo 3.1 para tomas principales y Seedance 2.0 para producción en volumen, manteniendo tu costo promedio bajo. También disponible a través de laozhang.ai a $0.15 por vídeo — consulta nuestra comparación de Veo 3.1 vs Sora 2 para un análisis detallado de calidad.

Elige Kling 3.0 para contenido con mucho movimiento con presupuesto ajustado. El modelo de Kuaishou ofrece una calidad de movimiento impresionante a $0.08 por vídeo, situándose entre el precio económico de Seedance 2.0 y el nivel premium de Sora 2/Veo 3.1. Su soporte de resolución 4K y su fuerte renderizado de movimiento lo convierten en una opción sólida para contenido orientado a la acción como resúmenes deportivos o exhibiciones dinámicas de productos. La principal limitación es la falta de generación de audio nativo, que requiere un paso separado de síntesis de audio para vídeos que necesiten sonido. Kling 3.0 también soporta menos entradas de referencia que Seedance 2.0 (3 vs 12), haciéndolo menos adecuado para flujos de trabajo que requieren consistencia visual estricta a través de una serie de clips generados.

La comparación de costos reales se vuelve más matizada a escala. Para un equipo de producción que genera 500 vídeos al mes, los costos mensuales de API se desglosan de la siguiente manera: Seedance 2.0 vía laozhang.ai costaría $25, Kling 3.0 costaría $40, y tanto Sora 2 como Veo 3.1 costarían $75 cada uno. Pero el costo bruto de la API es solo parte de la ecuación — también necesitas tener en cuenta las tasas de regeneración (con qué frecuencia el modelo produce resultados inutilizables que requieren un reintento) y los costos de postprocesamiento (añadir audio, escalar resolución o unir clips para modelos que carecen de soporte nativo para estas características). Cuando se tiene en cuenta la menor tasa de regeneración de Seedance 2.0 gracias a las referencias multimodales y su generación de audio nativo que elimina la necesidad de un pipeline de audio separado, la brecha en el costo total de propiedad se amplía aún más. Un equipo que gastaría $75 en llamadas a la API de Sora 2 podría realmente gastar $90-$100 en total después de contabilizar la síntesis de audio y las tasas más altas de reintentos, mientras que un equipo que gaste $25 en Seedance 2.0 no tendría costos ocultos adicionales.

Consejos de producción para optimizar el costo y la calidad de Seedance 2.0

Reducir los costos de la API de Seedance 2.0 mientras mantienes la calidad del resultado requiere entender cómo el modelo procesa los prompts y cómo los diferentes parámetros afectan tanto al tiempo de generación como a la calidad.

La ingeniería de prompts tiene el mayor retorno de inversión de cualquier optimización. Un prompt vago como "un coche conduciendo por una carretera" obliga al modelo a tomar docenas de decisiones creativas, lo que frecuentemente resulta en un resultado genérico que requiere regeneración. Un prompt específico como "Un coche deportivo rojo conduciendo por una carretera costera sinuosa al atardecer, cámara siguiéndolo desde el lateral, olas del océano visibles en el fondo, profundidad de campo cinematográfica" produce un resultado utilizable en el primer intento al menos el 80% de las veces. Cada regeneración cuesta otros $0.05-$2.47 dependiendo de tu plataforma, así que invertir 2 minutos extra en la elaboración del prompt puede ahorrar dinero significativo a escala. Siempre incluye detalles específicos sobre las condiciones de iluminación, el movimiento de la cámara, el estado de ánimo y el entorno.

Comienza con 720p para prototipos, actualiza para producción. El nivel Atlas Cloud Fast a $0.022 por segundo genera salida a 720p que es perfectamente adecuada para probar prompts e iterar sobre la dirección creativa. Una vez que tengas un prompt que produzca consistentemente el resultado que deseas, cambia a un nivel de resolución completa para el resultado final. Este flujo de trabajo en dos etapas puede reducir tus costos de prototipado en un 90% comparado con generar todo a la máxima calidad. En la práctica, la mayoría de los equipos pasan por 3-5 iteraciones de prompt antes de encontrar una versión que quieren producir a resolución completa, así que los ahorros se acumulan rápidamente — cinco pruebas a 720p a $0.22 cada una más una final a 2K a $1.80 suman $2.90, frente a seis generaciones a 2K a $1.80 cada una que cuestan $10.80.

Usa el sistema de referencias multimodal para reducir el ensayo y error. En lugar de intentar describir la apariencia de un personaje en texto (esperando que el modelo lo interprete correctamente), proporciona una imagen de referencia. En lugar de describir un movimiento específico de cámara, proporciona un vídeo de referencia que muestre el movimiento que deseas. Cada archivo de referencia que añades reduce la ambigüedad en tu petición y aumenta las tasas de éxito en el primer intento. Para equipos que generan contenido de marca, mantener una biblioteca de imágenes de referencia aprobadas para personajes, logotipos y entornos puede reducir las tasas de regeneración a la mitad.

Implementa caché inteligente y deduplicación. Si tu aplicación genera vídeos para prompts similares (por ejemplo, vídeos de productos con diferentes variantes de color), almacena en caché la generación base y solo regenera cuando el prompt difiera significativamente. Calcula un hash de tu combinación de prompt + parámetros y compruébalo contra resultados anteriores antes de enviar un nuevo trabajo. A escala, esta simple optimización puede reducir los costos de API entre un 20% y un 40%. Considera almacenar los vídeos generados en almacenamiento de objetos (S3 o equivalente) con etiquetas de metadatos que coincidan con el hash del prompt, la resolución y la versión del modelo. Cuando llega una nueva petición, verifica si una generación idéntica o suficientemente similar ya existe antes de gastar otros $0.05-$2.47 en una nueva llamada a la API. Para equipos de comercio electrónico que generan vídeos de productos a través de cientos de SKU con variaciones menores, esta estrategia de caché por sí sola puede reducir el gasto mensual en API en miles de dólares.

Preguntas frecuentes

¿Está disponible ya la API oficial de Seedance 2.0 de BytePlus?

No. A fecha de 31 de marzo de 2026, el lanzamiento oficial de la API de BytePlus sigue retrasado sin fecha confirmada. El retraso se debe a problemas de cumplimiento de derechos de autor relacionados con los datos de entrenamiento del modelo — específicamente, la presión de estudios de Hollywood que cuestionan si se utilizó material cinematográfico protegido por derechos de autor durante el entrenamiento. ByteDance no ha abordado públicamente estas preocupaciones ni ha proporcionado un calendario revisado. El modelo está disponible a través de la plataforma de consumo CapCut Dreamina, pero no existe acceso legítimo a la API todavía. Socios oficiales de distribución como laozhang.ai estarán entre los primeros en ofrecer acceso a la API cuando se lance — regístrate ahora para recibir la notificación.

¿Cuánto cuesta la API de Seedance 2.0 por vídeo?

Dado que la API aún no se ha lanzado, todos los precios son preliminares. Basándose en acuerdos con socios oficiales y documentación de ByteDance, el precio esperado a través de socios oficiales de distribución como laozhang.ai es de aproximadamente $0.05 por vídeo como tarifa plana independientemente de la duración. El precio oficial de BytePlus, cuando esté disponible, se espera que esté en el rango de $0.10-$0.80 por minuto. Ten precaución con los sitios de terceros que anuncian tarifas específicas por segundo — la mayoría no pueden realmente entregar el servicio que están anunciando.

¿Puedo usar la API de Seedance 2.0 fuera de China?

Sí. Cuando la API se lance, socios oficiales de distribución como laozhang.ai proporcionarán acceso global con pagos estándar con tarjeta de crédito — no se necesita un número de teléfono chino, cuenta de TG ni registro en Volcengine. Mientras tanto, la plataforma de consumo CapCut Dreamina ya funciona internacionalmente con una cuenta de Google o correo electrónico, aunque proporciona acceso basado en navegador en lugar de integración API. Puedes registrarte en laozhang.ai ahora para obtener una clave de API y empezar a usar otros modelos de vídeo (Sora 2, Veo 3.1) mientras esperas Seedance 2.0.

¿Cuál es la duración máxima de vídeo que Seedance 2.0 puede generar?

Una sola llamada a la API genera vídeos de entre 4 y 15 segundos. Para contenido más largo, necesitas generar múltiples clips y unirlos. El sistema de referencias multimodal ayuda a mantener la consistencia entre clips.

¿Es Seedance 2.0 mejor que Sora 2?

Depende de tus prioridades y caso de uso. Seedance 2.0 es significativamente más económico ($0.05 vs $0.15 por vídeo), soporta más modalidades de entrada (4 vs 2), acepta hasta 12 archivos de referencia simultáneamente y genera audio nativo sincronizado. Sora 2 tiene una simulación física superior — los objetos cayendo, los fluidos fluyendo y las colisiones se ven más realistas — y soporta generaciones individuales más largas de hasta 20 segundos comparado con el límite de 15 segundos de Seedance 2.0. Para la mayoría de los flujos de trabajo de producción comercial de vídeo donde la eficiencia en costos y la consistencia visual importan más que la precisión física, Seedance 2.0 ofrece un valor sustancialmente mejor a aproximadamente un tercio del precio.

¿Seedance 2.0 genera audio automáticamente?

Sí. Seedance 2.0 es uno de los pocos modelos de generación de vídeo que produce audio sincronizado — incluyendo efectos de sonido, sonido ambiental y diálogos en más de 8 idiomas — como parte del mismo paso de generación. Puedes desactivar la generación de audio si no la necesitas.

¿Qué resoluciones soporta Seedance 2.0?

El modelo soporta resoluciones desde 480p hasta 2K (2048x1080) con relaciones de aspecto que incluyen 16:9, 9:16, 4:3, 3:4, 21:9 y 1:1. Las opciones exactas de resolución varían según el proveedor y el nivel de precios.

¿Cuánto tarda la generación de vídeo?

Los tiempos típicos de generación van de 30 a 120 segundos dependiendo de la resolución, duración y carga actual del servidor. Durante las horas pico, la generación puede tardar ocasionalmente 3-4 minutos. La API utiliza un patrón asíncrono basado en trabajos — envías una petición, recibes un ID de trabajo, luego consultas el estado periódicamente o configuras un callback de webhook. Para aplicaciones en producción, los callbacks de webhook son fuertemente recomendados sobre las consultas periódicas para reducir llamadas innecesarias a la API y mejorar el tiempo de respuesta. La mayoría de los proveedores de terceros soportan un parámetro callback_url en la petición inicial de generación.

¿Qué ocurre si una generación falla — me cobran igualmente?

Esto depende del proveedor. Plataformas como laozhang.ai siguen un modelo de facturación libre de fallos donde solo pagas por los vídeos generados exitosamente — si la generación falla debido a violaciones de la política de contenido, errores del servidor o problemas de tiempo de espera, no se aplica ningún cargo a tu cuenta. Esta es una ventaja significativa para cargas de trabajo en producción donde los fallos ocasionales son inevitables, ya que significa que tu costo real por vídeo utilizable se mantiene consistente con el precio anunciado por vídeo. Siempre verifica la política de facturación con tu proveedor elegido antes de comprometerte con un uso de alto volumen.