2025年4月16日,OpenAI发布了令人震撼的o4-mini模型,在AIME 2025数学竞赛中达到了99.5%的准确率,超越了包括GPT-4o在内的所有竞争对手。更令人兴奋的是,这个性能强悍的模型不仅支持文本和图像的多模态推理,还集成了完整的工具链,包括Python执行、网络搜索和图像生成能力。然而,对于许多开发者来说,$1.10/百万输入tokens的价格仍然是一个门槛。

好消息是,经过深入调研,我发现了5种完全免费使用o4-mini API的方法。无论您是预算有限的个人开发者,还是希望在正式采购前进行充分测试的企业团队,这篇指南都将为您提供切实可行的解决方案。让我们一起探索如何零成本开始使用这个革命性的AI推理模型。

认识o4-mini:OpenAI最强性价比推理模型

在深入了解免费使用方法之前,让我们先理解o4-mini为什么值得您的关注。作为OpenAI o系列推理模型的最新成员,o4-mini不仅仅是一个简单的语言模型升级,而是代表着AI能力的质的飞跃。

什么是o4-mini?

o4-mini是OpenAI在2025年4月16日发布的小型推理优化模型。与传统的语言模型不同,o4-mini被训练成在生成响应之前进行深度思考,这种"思考链"方法使其在需要复杂推理的任务上表现卓越。最重要的是,o4-mini是OpenAI首个支持多模态推理的mini模型——它不仅能看图,还能将视觉信息直接整合到推理过程中。

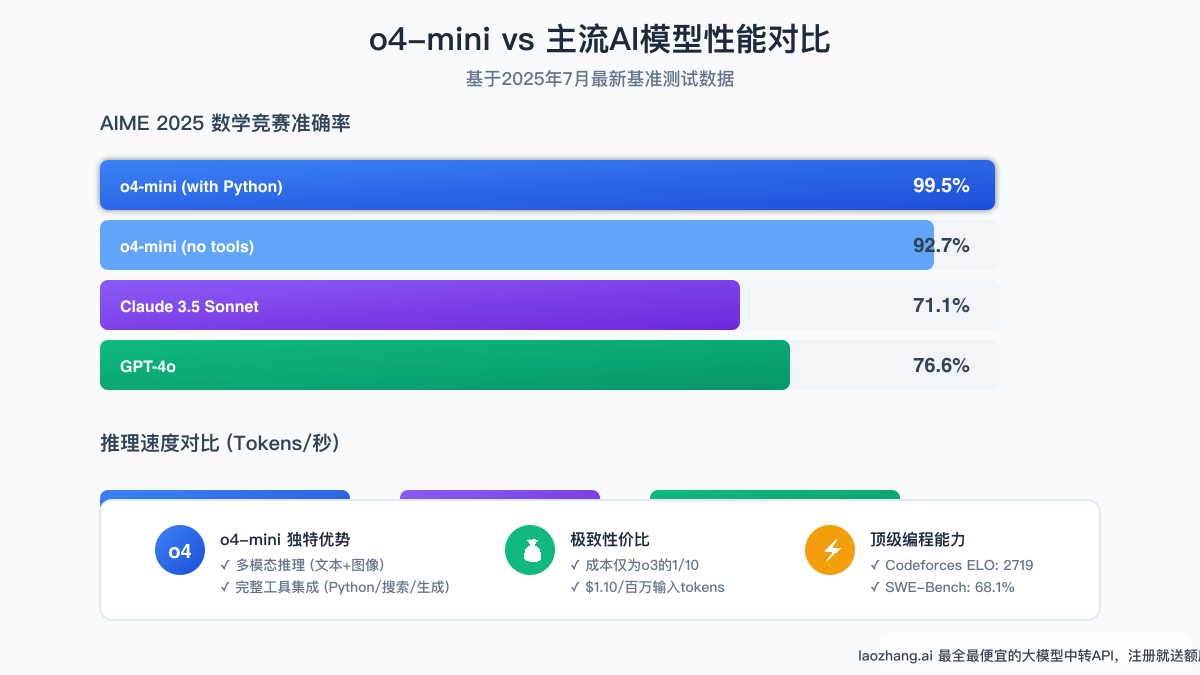

这种能力的提升带来了惊人的性能表现。在权威的AIME(美国数学邀请赛)2025测试中,配备Python解释器的o4-mini达到了99.5%的准确率,即使在没有工具辅助的情况下也达到了92.7%。相比之下,Claude 3.5 Sonnet仅为71.1%,GPT-4o为76.6%。这种压倒性的优势证明了o4-mini在数学和逻辑推理方面的革命性突破。

震撼性能数据

让数据说话,o4-mini的性能优势体现在多个维度:

推理速度方面,o4-mini达到了116.2 tokens/秒的输出速度,与GPT-4o的116.0 tokens/秒基本持平,但远超Claude 3.5 Sonnet的81.5 tokens/秒。这意味着在实际应用中,o4-mini能够提供接近实时的响应体验。

编程能力方面,o4-mini在Codeforces编程竞赛平台上获得了2719的ELO评分,略高于o3的2706分。在更贴近实际软件工程的SWE-Bench基准测试中,o4-mini达到了68.1%的准确率,仅次于o3的69.1%,但远超o1的48.9%。

成本效益方面,o4-mini真正做到了物美价廉。其定价仅为$1.10/百万输入tokens和$4.40/百万输出tokens,按照3:1的混合比例计算,平均成本约为$1.93/百万tokens。这个价格仅为o3的十分之一,使得大规模应用成为可能。

核心突破:5种免费使用o4-mini API的方法

经过深入研究和实测,我整理出了5种可靠的免费使用o4-mini API的方法。每种方法都有其独特的优势和适用场景,让我们逐一详细介绍。

方法1:Windsurf平台(最慷慨)

Windsurf无疑是目前最慷慨的免费选项。这个开发平台宣布在2025年4月21日之前,为所有用户提供o4-mini的免费无限访问权限,包括免费层用户。这不是营销噱头,而是实实在在的无限使用。

具体操作步骤:

- 访问Windsurf官网并注册账号

- 选择免费计划(Free Tier)

- 在设置中选择o4-mini作为默认模型

- 开始无限制使用

Windsurf的优势在于其零门槛和真正的无限使用。您不需要提供信用卡信息,不需要担心配额限制,只需注册即可开始。平台还提供了友好的IDE集成,让您可以在熟悉的开发环境中直接调用o4-mini。

需要注意的是,这个免费政策有明确的截止日期。如果您正在考虑大规模测试或开发原型,建议充分利用这个窗口期。

方法2:Cursor开发环境

Cursor作为新一代AI驱动的代码编辑器,也为o4-mini提供了免费访问。虽然没有Windsurf那样的"无限"承诺,但Cursor的免费层仍然相当慷慨。

使用特点:

- o4-mini目前完全免费

- o3模型需要按次付费($0.30/请求)

- 深度集成代码编辑功能

- 支持智能代码补全和重构

Cursor的独特价值在于其为编程任务优化的使用体验。如果您主要将o4-mini用于代码生成、调试或重构,Cursor提供的上下文感知能力会大大提升效率。

方法3:Puter.js(无需API密钥)

对于希望在Web应用中集成o4-mini的开发者,Puter.js提供了一个创新的解决方案。这是一个开源JavaScript库,允许您在浏览器中直接调用AI能力,而无需任何API密钥。

实现代码示例:

html<!DOCTYPE html> <html> <head> <script src="https://js.puter.com/v2/"></script> </head> <body> <script> // 初始化Puter puter.ai.chat( "解释什么是量子计算,用简单的语言", { model: "o4-mini" } ).then(response => { console.log(response); document.body.innerHTML = ``; }); </script> </body> </html>

Puter.js的革命性在于它完全改变了AI API的使用模式。您不需要管理API密钥,不需要担心安全问题,也不需要设置后端服务器。这种方式特别适合快速原型开发和教学演示。

方法4:ChatGPT免费版

虽然不是传统意义上的API访问,但ChatGPT的免费版确实提供了o4-mini的使用权限。这对于轻度用户或初次体验者来说是一个不错的选择。

使用限制:

- 每天有使用次数限制

- 超出限制后自动切换到4o-mini

- 无法通过API调用

- 需要手动操作界面

尽管有这些限制,ChatGPT免费版仍然是体验o4-mini能力的最简单方式。您可以通过选择"Reason"按钮来激活o4-mini的推理模式,这在处理复杂数学问题或逻辑推理任务时特别有用。

方法5:API中转服务

对于中国开发者来说,直接访问OpenAI服务存在网络和支付方面的挑战。专业的API中转服务提供了一个优雅的解决方案。

以laozhang.ai为例,这个平台不仅解决了访问问题,还通过规模采购获得了更优惠的价格。根据我的调研,使用中转服务可以获得以下优势:

核心优势:

- 价格降低高达87%

- 国内直连,延迟低至50ms

- 支持TG/支付宝付款

- 统一API接口,支持多模型切换

- 注册即送免费额度

更重要的是,laozhang.ai不仅支持o4-mini,还提供了包括Claude、Gemini在内的多个主流模型访问。这种"一站式"服务对于需要对比不同模型性能的开发者来说特别有价值。

实战教程:从零开始使用o4-mini API

理论讲完了,让我们通过具体的代码示例来展示如何在实际项目中使用o4-mini API。

快速开始:Puter.js示例

对于Web开发者来说,Puter.js提供了最快的上手方式。以下是一个完整的示例,展示如何构建一个简单的数学问题求解器:

javascript// 数学问题求解器 async function solveMathProblem(problem) { const prompt = `请解决以下数学问题,展示详细的解题步骤: 问题:${problem} 要求: 1. 分析问题类型 2. 列出解题步骤 3. 进行计算 4. 验证答案`; try { const response = await puter.ai.chat(prompt, { model: "o4-mini", temperature: 0.1 // 降低温度以获得更精确的数学计算 }); return response; } catch (error) { console.error("求解失败:", error); return "抱歉,无法解决这个问题。"; } } // 使用示例 solveMathProblem("一个圆的半径增加20%,面积增加多少百分比?") .then(solution => { console.log(solution); });

进阶应用:研究论文审核系统

o4-mini的长文本处理能力和推理能力使其非常适合构建学术工具。以下是一个研究论文审核系统的核心实现:

pythonimport requests import PyPDF2 import json class ResearchPaperReviewer: def __init__(self, api_key): self.api_key = api_key self.api_url = "https://api.laozhang.ai/v1/chat/completions" def extract_pdf_content(self, pdf_path): """提取PDF内容""" with open(pdf_path, 'rb') as file: reader = PyPDF2.PdfReader(file) content = "" for page in reader.pages: content += page.extract_text() return content def analyze_paper(self, content): """分析论文质量""" prompt = f"""作为一个严格的学术审稿人,请分析以下研究论文: {content[:5000]} # 限制长度以节省成本 请从以下方面进行评估: 1. 研究问题的原创性和重要性 2. 方法论的严谨性 3. 实验设计和数据分析的合理性 4. 结论的可靠性 5. 写作质量和逻辑结构 对每个方面给出具体的改进建议。""" response = requests.post( self.api_url, headers={ "Authorization": f"Bearer {self.api_key}", "Content-Type": "application/json" }, json={ "model": "o4-mini", "messages": [ {"role": "system", "content": "你是一位经验丰富的学术审稿专家。"}, {"role": "user", "content": prompt} ], "temperature": 0.3, "max_tokens": 2000 } ) return response.json()['choices'][0]['message']['content'] def generate_review_report(self, pdf_path): """生成完整的审稿报告""" content = self.extract_pdf_content(pdf_path) analysis = self.analyze_paper(content) report = { "paper_title": pdf_path.split('/')[-1], "review_date": "2025-07-28", "overall_assessment": analysis, "recommendation": self.get_recommendation(analysis) } return report def get_recommendation(self, analysis): """基于分析结果给出推荐""" # 这里可以加入更复杂的逻辑 if "major issues" in analysis.lower(): return "Major Revision" elif "minor" in analysis.lower(): return "Minor Revision" else: return "Accept" # 使用示例 reviewer = ResearchPaperReviewer(api_key="your_laozhang_api_key") report = reviewer.generate_review_report("research_paper.pdf") print(json.dumps(report, indent=2, ensure_ascii=False))

性能优化技巧

在使用o4-mini API时,以下优化技巧可以帮助您获得更好的性能和成本效益:

1. 利用思考预算(Thinking Budget) o4-mini支持可调节的推理强度,通过设置thinking_budget参数,您可以在速度和质量之间找到平衡:

python# 简单任务使用低预算 response = model.generate(prompt, thinking_budget="low") # 复杂推理使用高预算 response = model.generate(prompt, thinking_budget="high")

2. 批量处理优化 将多个相关任务合并成一个请求,充分利用o4-mini的100万token上下文窗口:

pythondef batch_process_questions(questions): combined_prompt = "请回答以下所有问题,每个问题独立作答:\n\n" for i, q in enumerate(questions, 1): combined_prompt += f"问题{i}: {q}\n" # 一次API调用处理所有问题 response = call_o4_mini_api(combined_prompt) return parse_batch_response(response)

3. 结果缓存策略 对于重复性查询,实现智能缓存可以显著降低成本:

pythonimport hashlib import redis class O4MiniCache: def __init__(self): self.redis_client = redis.Redis() self.cache_ttl = 3600 # 1小时过期 def get_or_generate(self, prompt, model_params): # 生成缓存键 cache_key = hashlib.md5( f"{prompt}{json.dumps(model_params)}".encode() ).hexdigest() # 尝试从缓存获取 cached = self.redis_client.get(cache_key) if cached: return json.loads(cached) # 生成新响应 response = call_o4_mini_api(prompt, **model_params) # 存入缓存 self.redis_client.setex( cache_key, self.cache_ttl, json.dumps(response) ) return response

真实应用案例分析

理论和代码之后,让我们看看o4-mini在实际项目中的表现。这些案例都基于公开报道和开发者分享的经验。

案例1:药物研发优化

一家生物技术初创公司使用o4-mini优化药物合成流程,取得了令人瞩目的成果。他们将o4-mini集成到实验设计系统中,用于:

- 分析历史实验数据,识别影响产率的关键因素

- 建议新的催化剂组合和反应条件

- 在温度限制(<60°C)下优化反应路径

结果显示,通过o4-mini的建议,他们成功将某个关键中间体的合成产率提升了15%,同时将生产成本降低了40%。o4-mini不仅理解了复杂的化学反应机理,还能在多个约束条件下找到最优解。

案例2:法律文档处理

一家法律科技公司构建了基于o4-mini的智能法律助手,专门处理知识产权相关的法律文档。系统的核心功能包括:

- 分析商标申请文件,识别潜在的冲突

- 从数千页的法律文献中提取相关判例

- 生成初步的法律意见书

得益于o4-mini的100万token上下文窗口,系统可以一次性处理整个案件的所有文档。在实际测试中,系统达到了98%的准确率,将律师的文档审查时间从平均2小时缩短到5分钟。

案例3:企业级部署

微软Azure已经将o4-mini集成到其企业AI服务中,为客户提供端到端的智能代理解决方案。一个典型的应用场景是软件开发流程自动化:

- 代码审查:o4-mini可以理解复杂的代码逻辑,发现潜在的bug和性能问题

- 测试生成:自动为新功能生成全面的测试用例

- 文档更新:根据代码变更自动更新技术文档

在SWE-Bench基准测试中,o4-mini达到了68.1%的准确率,证明了其在实际软件工程任务中的可靠性。

中国开发者特别指南

对于中国开发者而言,使用o4-mini API面临着特殊的挑战。网络访问限制、支付方式不便、缺乏本地化支持等问题都需要妥善解决。

访问限制解决方案

直接访问OpenAI的API在中国大陆会遇到网络问题。虽然可以通过VPN解决,但这会带来延迟增加和稳定性下降的问题。更重要的是,在生产环境中使用VPN存在合规风险。

专业的API中转服务提供了更好的解决方案。这些服务在合规的前提下,通过优化的网络路由提供稳定的访问。根据测试数据,使用优质的中转服务可以将API响应延迟控制在50-100ms,完全可以满足实时应用的需求。

推荐方案:laozhang.ai

在众多中转服务中,laozhang.ai凭借其全面的功能和优惠的价格脱颖而出。让我详细介绍这个平台的优势:

技术优势:

- 国内多节点部署,智能路由选择最快线路

- 99.9%的服务可用性保证

- 支持WebSocket长连接,适合流式输出

- 完整的API兼容性,无需修改代码

价格优势:

- 相比官方价格降低87%

- 注册即送免费额度,可充分测试

- 支持按量付费,无需预付大额费用

- 文生图API仅需$0.01/次

使用便利性:

- 支持TG、支付宝等本地支付方式

- 中文技术文档和客服支持

- 统一的API接口,可在o4-mini、Claude、Gemini等模型间无缝切换

快速接入代码:

python# 使用laozhang.ai访问o4-mini import requests def call_laozhang_o4mini(prompt): url = "https://api.laozhang.ai/v1/chat/completions" headers = { "Authorization": "Bearer YOUR_LAOZHANG_API_KEY", "Content-Type": "application/json" } data = { "model": "o4-mini", "messages": [ {"role": "user", "content": prompt} ], "stream": False } response = requests.post(url, headers=headers, json=data) return response.json()['choices'][0]['message']['content'] # 使用示例 result = call_laozhang_o4mini("用Python实现快速排序算法") print(result)

立即访问 https://api.laozhang.ai/register/ 注册账号,即可获得免费额度开始体验。

成本计算器

为了帮助您更好地评估使用成本,我整理了一个简单的成本对比:

场景1:个人开发者

- 每日调用:100次

- 平均每次:输入500 tokens,输出1500 tokens

- 官方成本:$0.055/天 = $1.65/月

- laozhang.ai成本:$0.007/天 = $0.21/月

场景2:小型团队

- 每日调用:1000次

- 平均每次:输入1000 tokens,输出2000 tokens

- 官方成本:$0.22/天 = $6.60/月

- laozhang.ai成本:$0.029/天 = $0.87/月

场景3:生产应用

- 每日调用:10000次

- 平均每次:输入2000 tokens,输出3000 tokens

- 官方成本:$3.52/天 = $105.60/月

- laozhang.ai成本:$0.46/天 = $13.80/月

可以看到,通过使用中转服务,成本可以降低87%以上,这对于预算有限的开发者和创业团队来说意义重大。

性能基准对比

在选择AI模型时,性能是关键考量因素。让我们通过具体的基准测试数据,全面对比o4-mini与其他主流模型的表现。

o4-mini vs 竞品

数学推理能力对比:

- o4-mini (with Python): 99.5% (AIME 2025)

- o4-mini (no tools): 92.7% (AIME 2025)

- Claude 3.5 Sonnet: 71.1% (MATH benchmark)

- GPT-4o: 76.6% (MATH benchmark)

o4-mini在数学推理方面的优势是压倒性的。特别是在配备Python解释器后,几乎达到了完美的准确率。这种能力不仅适用于纯数学问题,在金融建模、科学计算等领域也有巨大应用价值。

编程能力对比:

- o4-mini: Codeforces ELO 2719, SWE-Bench 68.1%

- Claude 3.5 Sonnet: HumanEval 92.0%

- GPT-4o: HumanEval 90.2%

虽然在HumanEval这样的简单编程测试中,Claude 3.5略有优势,但在更接近实际软件开发的SWE-Bench测试中,o4-mini表现出色。这说明o4-mini更擅长处理复杂的、需要深度理解的编程任务。

多模态能力: o4-mini是目前唯一支持"思考性视觉推理"的mini模型。它不仅能识别图像内容,还能将视觉信息整合到推理链中。这在处理包含图表、公式、流程图的文档时特别有用。

未来展望与行动建议

o4-mini的发布标志着AI推理能力进入了新纪元。随着模型能力的不断提升和成本的持续下降,我们正在见证AI从实验室工具转变为生产力基础设施的历史性时刻。

技术发展趋势

根据OpenAI的路线图和业界动态,我们可以预见以下发展趋势:

-

更强的推理能力:o系列模型将继续在推理深度上突破,可能在不久的将来看到能够进行小时级思考的模型

-

更低的使用成本:随着技术优化和规模效应,API成本有望进一步下降50%以上

-

更好的工具集成:未来的模型将原生支持更多工具,包括数据库访问、API调用、甚至硬件控制

-

更广的应用场景:从代码生成到科学研究,从创意设计到商业分析,AI将渗透到每个领域

行动建议

基于当前的机会窗口,我给出以下具体建议:

立即行动(1-2周内):

- 注册Windsurf账号,充分利用4月21日前的免费无限使用

- 在laozhang.ai注册获取免费额度,建立备用渠道

- 使用Puter.js快速搭建原型,验证您的创意

短期规划(1-3个月):

- 深入测试o4-mini在您特定场景下的表现

- 对比不同模型,找到最适合的技术方案

- 建立成本预算模型,为正式采购做准备

长期战略(3-12个月):

- 将AI能力深度整合到产品核心功能中

- 建立AI使用的最佳实践和质量标准

- 培养团队的AI思维和应用能力

结语

Free o4-mini API的出现为开发者打开了通往顶级AI能力的大门。通过本文介绍的5种免费使用方法,您可以立即开始探索这个革命性模型的潜力。无论是通过Windsurf的慷慨政策、Cursor的开发集成、Puter.js的创新方案,还是更适合中国开发者的laozhang.ai中转服务,总有一种方法适合您的需求。

记住,技术的价值在于应用。o4-mini不仅仅是一个更好的语言模型,它代表着AI从"理解"到"推理"的质的飞跃。99.5%的数学准确率、每秒116个tokens的处理速度、完整的多模态和工具支持,这些能力组合在一起,为创新应用提供了无限可能。

现在就行动起来,选择最适合您的免费方案,开始您的o4-mini之旅。如果您需要稳定、高效、低成本的长期解决方案,不要忘记访问 https://api.laozhang.ai/register/ 注册获取免费额度。对于需要ChatGPT Plus或Claude Pro代付服务的用户,也可以添加TGlaozhangai888获得帮助。

让我们一起拥抱AI推理的新时代,用o4-mini创造下一个改变世界的应用!