前言:Claude 4 API真的有免费版吗?

如果你正在寻找完全免费的Claude 4 API,我必须直接告诉你一个事实:Anthropic官方没有提供永久免费的API服务。但先别失望!在这篇深度指南中,我将向你展示所有可能的免费试用方法,以及如何通过巧妙的技巧节省高达90%的使用成本。

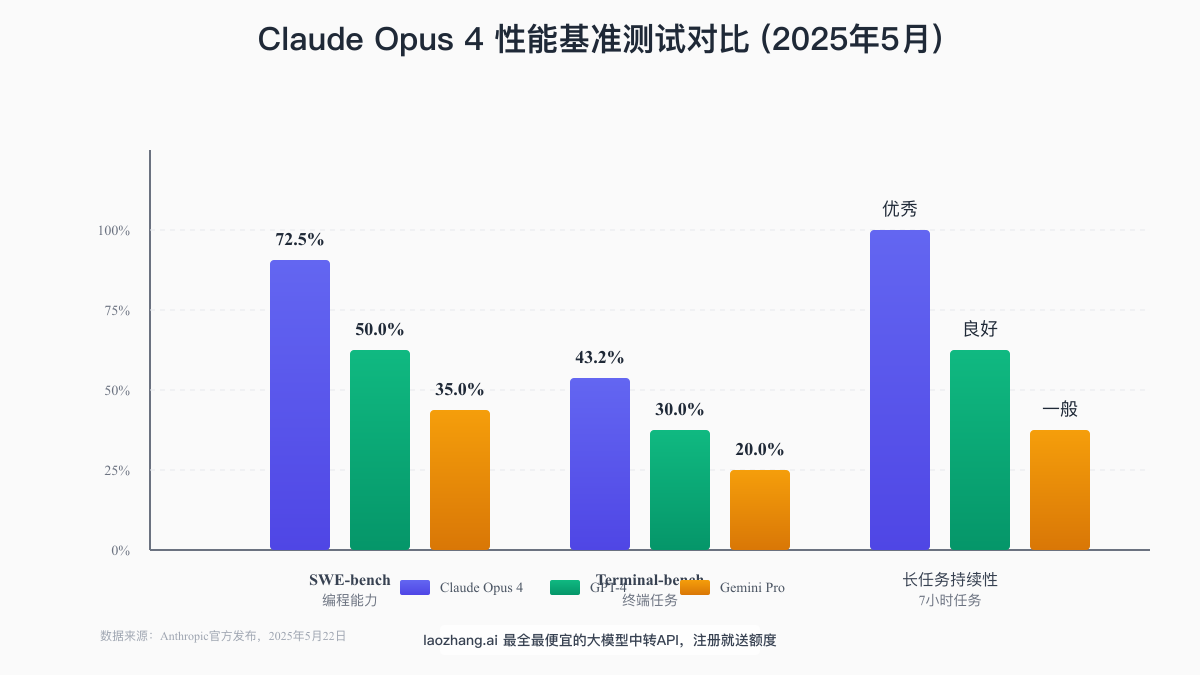

2025年5月22日,Anthropic正式发布了Claude Opus 4和Claude Sonnet 4,这标志着AI语言模型进入了一个新纪元。Claude Opus 4在SWE-bench编程基准测试中达到了惊人的72.5%准确率,远超GPT-4的50%。然而,强大的性能伴随着高昂的价格——官方API定价为每百万输入Token $15,输出Token更是高达$75。

对于个人开发者和初创企业来说,这样的价格可能让人望而却步。但别担心,本文将详细介绍如何以最低成本甚至免费体验Claude 4的强大功能。

Claude Opus 4详解:2025年5月最强AI模型

革命性的能力提升

Claude Opus 4不仅仅是一次常规升级,它代表了AI技术的一次质的飞跃。让我们深入了解这个被Anthropic称为"Level 3"安全等级的超级模型具备哪些革命性特性。

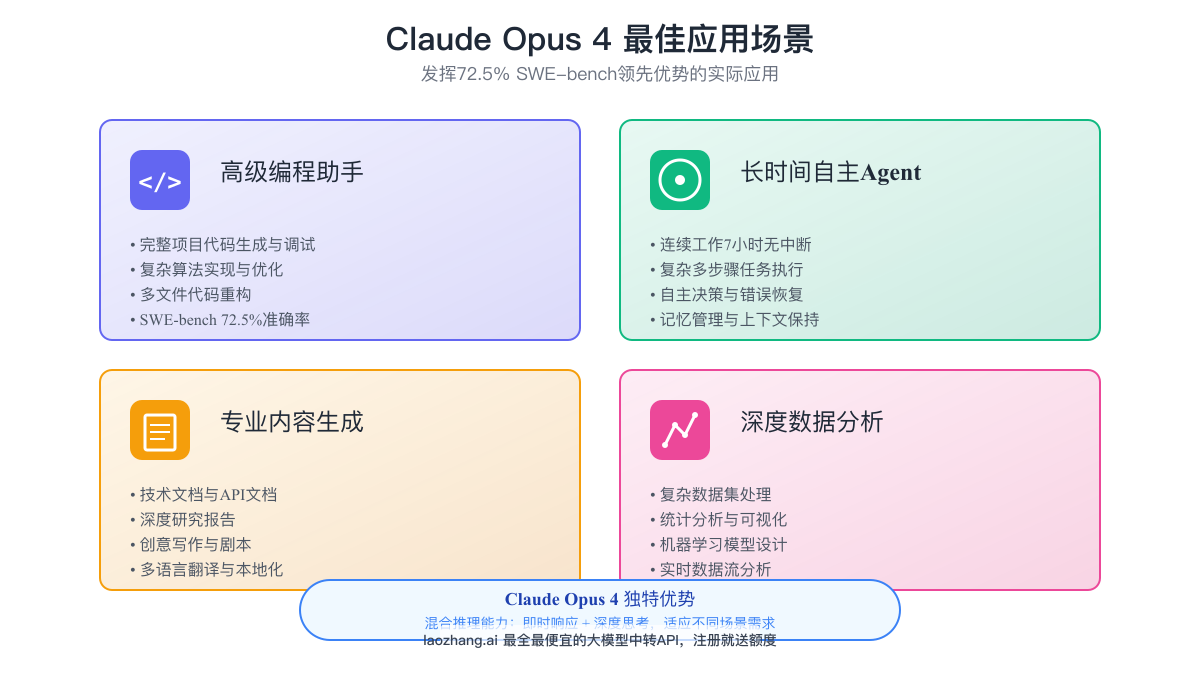

编程能力的巅峰表现让Claude Opus 4成为开发者的终极助手。在SWE-bench测试中,它达到了72.5%的准确率,这意味着它能够正确解决近四分之三的真实世界编程问题。相比之下,GPT-4仅为50%,而Gemini Pro更是只有35%。这种差距在实际应用中意味着什么?举个例子,当你需要重构一个复杂的代码库时,Claude Opus 4能够理解整个项目结构,提供更准确的建议和实现。

长时间自主运行是Claude Opus 4的另一个杀手级特性。它可以连续工作长达7小时,处理需要数千个步骤的复杂任务。想象一下,你可以让它独立完成一个完整的数据分析项目,从数据清洗、特征工程到模型训练和报告生成,全程无需人工干预。

混合推理模式让Claude Opus 4能够灵活应对不同场景。它提供两种模式:即时响应模式适合快速问答,而深度思考模式则用于需要复杂推理的任务。更重要的是,用户可以看到模型的思考过程,这种透明度在其他模型中是罕见的。

官方API定价解析

让我们直面现实——Claude Opus 4的官方定价确实不便宜:

| 模型 | 输入价格 | 输出价格 | 上下文窗口 |

|---|---|---|---|

| Claude Opus 4 | $15/百万Token | $75/百万Token | 200K |

| Claude Sonnet 4 | $3/百万Token | $15/百万Token | 200K |

为了让你更直观地理解这个价格,我来算一笔账。假设你用Claude Opus 4处理一个包含10,000字的文档,大约需要15,000个输入Token和5,000个输出Token。成本计算如下:

- 输入成本:15,000 ÷ 1,000,000 × $15 = $0.225

- 输出成本:5,000 ÷ 1,000,000 × $75 = $0.375

- 总成本:$0.60(约4.2元人民币)

看起来单次使用不贵,但如果你每天处理100个这样的文档,月成本就会达到$1,800(约12,600元人民币)!

为什么这么贵?

Claude Opus 4的高价格并非毫无道理。首先,训练如此规模的模型需要巨额投资。据业内估算,训练一个类似规模的模型成本可能超过1000万美元。其次,推理成本也不容忽视——为了保证响应速度和稳定性,需要部署大量高性能GPU集群。

更重要的是,Anthropic采用了"宪法AI"(Constitutional AI)方法,确保模型的安全性和可靠性。这种额外的安全保障也增加了开发和运营成本。

3种免费试用Claude 4 API的方法

虽然没有永久免费的午餐,但仍有几种方法可以让你免费体验Claude 4的强大功能。

方法1:官方测试额度(有限但真实)

Anthropic为新注册用户提供少量免费额度,通常价值$5-10。虽然看起来不多,但足够你:

- 测试API集成是否正常工作

- 评估模型性能是否满足需求

- 完成小型项目的概念验证

获取步骤:

- 访问 console.anthropic.com

- 使用邮箱注册账户(需要国外手机号验证)

- 完成身份验证后,自动获得免费额度

- 在API密钥页面创建新密钥

注意事项:

- 免费额度用完后需要绑定信用卡充值

- 仅支持国外信用卡,不支持国内支付方式

- 部分地区可能无法访问,需要VPN

方法2:Claude.ai免费层(非API但可用)

如果你的需求不一定要通过API访问,Claude.ai网页版提供了免费使用层级:

- 每天可以与Claude Sonnet进行有限次数的对话

- 支持文件上传和长文本处理

- 可以体验最新的模型能力

使用技巧:

- 合理规划每天的使用配额

- 将复杂任务拆分成多个小任务

- 利用会话历史功能减少重复输入

方法3:学生和研究计划

Anthropic提供了针对学生和研究人员的特殊计划:

- Claude Campus Program为学生提供额外的免费额度

- 研究机构可申请更高的配额

- 非营利组织可能获得折扣

申请条件:

- 需要edu邮箱或机构证明

- 提交使用计划说明

- 承诺仅用于非商业用途

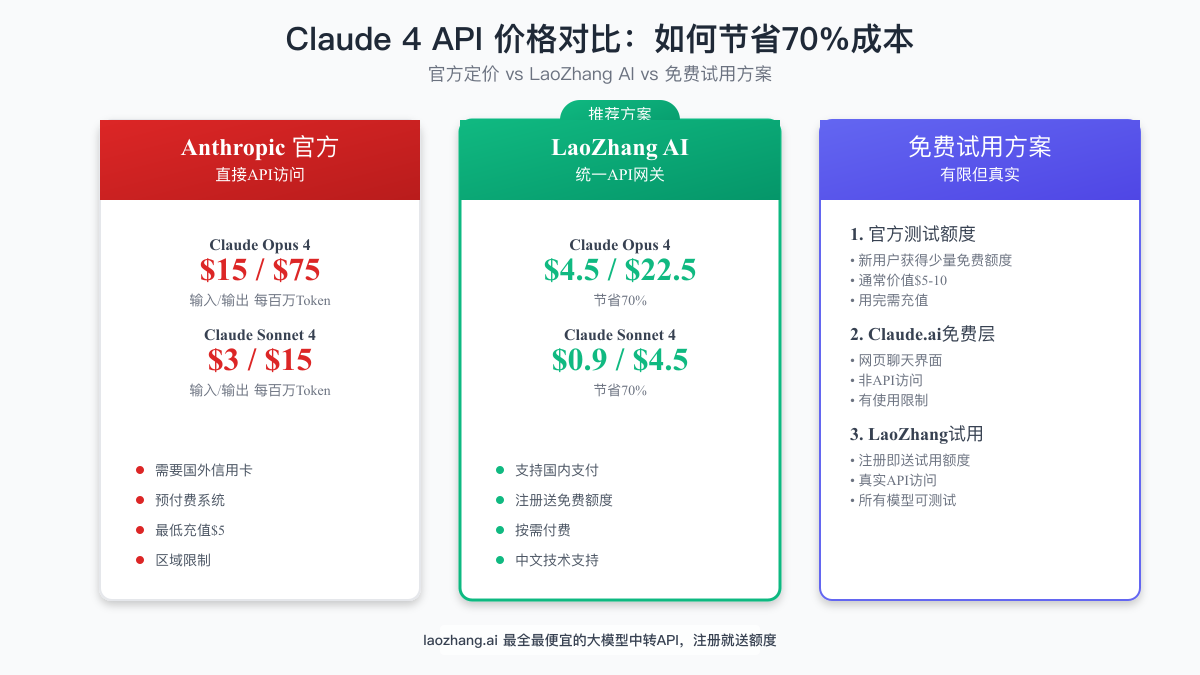

节省70%成本:LaoZhang AI解决方案

价格对比:官方 vs LaoZhang AI

如果免费额度不够用,但官方价格又太贵,LaoZhang AI提供了一个完美的中间方案:

| 对比项 | Anthropic官方 | LaoZhang AI | 节省比例 |

|---|---|---|---|

| Claude Opus 4输入 | $15/M | $4.5/M | 70% |

| Claude Opus 4输出 | $75/M | $22.5/M | 70% |

| Claude Sonnet 4输入 | $3/M | $0.9/M | 70% |

| Claude Sonnet 4输出 | $15/M | $4.5/M | 70% |

| 最低充值 | $5 | 无限制 | - |

| 支付方式 | 国外信用卡 | 支付宝/微信 | - |

| 技术支持 | 英文 | 中文 | - |

快速开始教程

使用LaoZhang AI接入Claude 4只需要3分钟:

第1步:注册账号

访问:https://api.laozhang.ai/register/?aff_code=JnIT

使用邮箱注册,立即获得免费试用额度

第2步:获取API密钥

python# 在控制台创建API密钥 # 复制密钥备用 api_key = "your-api-key-here"

第3步:开始调用

pythonimport requests import json # 设置请求头 headers = { "Authorization": f"Bearer {api_key}", "Content-Type": "application/json" } # 调用Claude Opus 4 data = { "model": "claude-opus-4", "messages": [ {"role": "user", "content": "编写一个Python快速排序算法"} ], "max_tokens": 1000 } response = requests.post( "https://api.laozhang.ai/v1/chat/completions", headers=headers, json=data ) result = response.json() print(result['choices'][0]['message']['content'])

实际成本计算

让我们通过一个真实案例来计算成本节省:

场景: 创业公司每月需要处理10,000个客户咨询,每个咨询平均2,000 Token输入,1,000 Token输出。

官方API成本:

- 输入:10,000 × 2,000 ÷ 1,000,000 × $15 = $300

- 输出:10,000 × 1,000 ÷ 1,000,000 × $75 = $750

- 月总成本:$1,050(约7,350元)

LaoZhang AI成本:

- 输入:10,000 × 2,000 ÷ 1,000,000 × $4.5 = $90

- 输出:10,000 × 1,000 ÷ 1,000,000 × $22.5 = $225

- 月总成本:$315(约2,205元)

节省金额:$735/月(约5,145元),全年节省61,740元!

高级省钱技巧:批量处理与提示缓存

即使使用LaoZhang AI,如果使用不当,成本仍然可能失控。以下是经过实战验证的省钱技巧。

批量API调用节省50%

Anthropic提供的Batch API可以让你以50%的折扣处理大量请求:

python# 批量处理示例 batch_requests = [] # 准备100个请求 for i in range(100): batch_requests.append({ "custom_id": f"request-{i}", "method": "POST", "url": "/v1/messages", "body": { "model": "claude-opus-4", "messages": [{"role": "user", "content": f"任务 {i}"}], "max_tokens": 500 } }) # 创建批处理文件 with open("batch.jsonl", "w") as f: for req in batch_requests: f.write(json.dumps(req) + "\n") # 提交批处理任务(异步执行) # 成本仅为实时API的50%

适用场景:

- 大量文档翻译

- 批量数据分析

- 定期报告生成

- 非实时的内容创作

提示缓存技术节省90%

提示缓存是一个被严重低估的省钱技巧。当你重复使用相同的系统提示或上下文时,可以缓存这部分内容:

python# 缓存系统提示示例 system_prompt = """ 你是一个专业的技术文档编写助手。 你需要遵循以下规则: 1. 使用清晰简洁的语言 2. 包含代码示例 3. 添加实用的注释 ... (2000 tokens的详细指令) """ # 第一次调用(完整计费) response1 = claude_api_call( system=system_prompt, user="编写Redis使用指南", cache_control={"type": "ephemeral"} # 启用缓存 ) # 后续调用(缓存部分仅计费10%) response2 = claude_api_call( system=system_prompt, # 这部分被缓存 user="编写MongoDB使用指南", cache_control={"type": "ephemeral"} )

实际案例: 某技术文档团队通过缓存标准文档模板,将月成本从$500降低到$150。

智能Token优化策略

减少Token使用量是最直接的省钱方法:

1. 精简输入提示

python# 不好的例子(冗长) prompt_bad = """ 我想让你帮我写一段代码,这段代码的功能是实现一个二叉搜索树, 需要包含插入、删除、查找等基本功能,请用Python语言来实现, 并且要有详细的注释说明每个函数的作用... """ # 好的例子(精简) prompt_good = """ 用Python实现二叉搜索树,包含: - 插入/删除/查找 - 详细注释 - 时间复杂度说明 """

2. 使用结构化输出

python# 指定输出格式减少无用内容 data = { "model": "claude-opus-4", "messages": [{"role": "user", "content": "分析这段代码的问题"}], "response_format": { "type": "json_object", "schema": { "issues": "array", "suggestions": "array", "severity": "string" } } }

3. 流式响应提前终止

python# 当获得所需信息后立即停止生成 for chunk in response.iter_lines(): if "解决方案找到" in chunk: break # 停止生成,节省后续Token

Claude 4 API实战代码示例

Python快速开始

完整的Claude 4 API调用示例:

pythonimport os import requests from typing import List, Dict, Optional class Claude4API: def __init__(self, api_key: str, base_url: str = "https://api.laozhang.ai" ): self.api_key = api_key self.base_url = base_url self.headers = { "Authorization": f"Bearer {api_key}", "Content-Type": "application/json" } def chat(self, messages: List[Dict[str, str]], model: str = "claude-opus-4", max_tokens: int = 1000, temperature: float = 0.7) -> Dict: """ 发送聊天请求到Claude 4 Args: messages: 消息列表,格式为[{"role": "user", "content": "..."}] model: 模型选择,claude-opus-4 或 claude-sonnet-4 max_tokens: 最大生成Token数 temperature: 温度参数,控制创造性 Returns: API响应字典 """ data = { "model": model, "messages": messages, "max_tokens": max_tokens, "temperature": temperature } response = requests.post( f"{self.base_url}/v1/chat/completions", headers=self.headers, json=data ) if response.status_code != 200: raise Exception(f"API错误: {response.status_code} - {response.text}") return response.json() def calculate_cost(self, input_tokens: int, output_tokens: int, model: str = "claude-opus-4") -> Dict[str, float]: """计算API调用成本""" prices = { "claude-opus-4": {"input": 4.5, "output": 22.5}, # LaoZhang价格 "claude-sonnet-4": {"input": 0.9, "output": 4.5} } model_price = prices.get(model, prices["claude-opus-4"]) input_cost = (input_tokens / 1_000_000) * model_price["input"] output_cost = (output_tokens / 1_000_000) * model_price["output"] return { "input_cost": round(input_cost, 4), "output_cost": round(output_cost, 4), "total_cost": round(input_cost + output_cost, 4), "total_rmb": round((input_cost + output_cost) * 7, 2) # 转换为人民币 } # 使用示例 api = Claude4API(api_key="your-laozhang-api-key") # 简单对话 response = api.chat([ {"role": "user", "content": "解释什么是递归,并给出Python示例"} ]) print(response['choices'][0]['message']['content']) # 计算成本 usage = response.get('usage', {}) cost = api.calculate_cost( input_tokens=usage.get('prompt_tokens', 0), output_tokens=usage.get('completion_tokens', 0) ) print(f"本次调用成本: ${cost['total_cost']} (约{cost['total_rmb']}元)")

流式响应处理

对于需要实时反馈的应用,流式响应可以提供更好的用户体验:

pythonimport sseclient # pip install sseclient-py def stream_claude_response(api_key: str, messages: List[Dict], model: str = "claude-opus-4"): """ 流式获取Claude响应,实时显示生成内容 """ headers = { "Authorization": f"Bearer {api_key}", "Content-Type": "application/json", "Accept": "text/event-stream" } data = { "model": model, "messages": messages, "stream": True, "max_tokens": 2000 } response = requests.post( "https://api.laozhang.ai/v1/chat/completions", headers=headers, json=data, stream=True ) client = sseclient.SSEClient(response) full_content = "" for event in client.events(): if event.data == '[DONE]': break try: chunk = json.loads(event.data) content = chunk['choices'][0]['delta'].get('content', '') if content: print(content, end='', flush=True) full_content += content except json.JSONDecodeError: continue return full_content # 使用示例 messages = [ {"role": "system", "content": "你是一个有帮助的编程助手"}, {"role": "user", "content": "编写一个实时股票价格监控系统的架构设计"} ] result = stream_claude_response("your-api-key", messages)

错误处理最佳实践

稳定的生产环境需要完善的错误处理:

pythonimport time from typing import Optional import logging logging.basicConfig(level=logging.INFO) logger = logging.getLogger(__name__) class Claude4APIWithRetry: def __init__(self, api_key: str, max_retries: int = 3): self.api_key = api_key self.max_retries = max_retries self.base_url = "https://api.laozhang.ai" def _make_request(self, data: Dict) -> Optional[Dict]: """带重试机制的API请求""" headers = { "Authorization": f"Bearer {self.api_key}", "Content-Type": "application/json" } for attempt in range(self.max_retries): try: response = requests.post( f"{self.base_url}/v1/chat/completions", headers=headers, json=data, timeout=30 # 30秒超时 ) if response.status_code == 200: return response.json() elif response.status_code == 429: # 速率限制,等待后重试 retry_after = int(response.headers.get('Retry-After', 60)) logger.warning(f"速率限制,等待{retry_after}秒后重试...") time.sleep(retry_after) elif response.status_code >= 500: # 服务器错误,指数退避重试 wait_time = (2 ** attempt) + 1 logger.warning(f"服务器错误{response.status_code},{wait_time}秒后重试...") time.sleep(wait_time) else: # 客户端错误,不重试 logger.error(f"客户端错误: {response.status_code} - {response.text}") return None except requests.exceptions.Timeout: logger.warning(f"请求超时,尝试 {attempt + 1}/{self.max_retries}") except requests.exceptions.ConnectionError: logger.warning(f"连接错误,尝试 {attempt + 1}/{self.max_retries}") time.sleep(2 ** attempt) except Exception as e: logger.error(f"未知错误: {str(e)}") return None logger.error("达到最大重试次数,请求失败") return None def safe_chat(self, messages: List[Dict], **kwargs) -> Optional[str]: """安全的聊天方法,处理所有异常""" data = { "model": kwargs.get("model", "claude-opus-4"), "messages": messages, "max_tokens": kwargs.get("max_tokens", 1000), "temperature": kwargs.get("temperature", 0.7) } response = self._make_request(data) if response and 'choices' in response: return response['choices'][0]['message']['content'] return None # 使用示例 api = Claude4APIWithRetry(api_key="your-api-key") result = api.safe_chat([ {"role": "user", "content": "设计一个高可用的微服务架构"} ]) if result: print(result) else: print("请求失败,请检查日志")

性能对比:Claude 4 vs GPT-4 vs 其他模型

编程能力对比

根据最新的基准测试数据,Claude Opus 4在编程任务上的表现令人印象深刻:

| 测试项目 | Claude Opus 4 | GPT-4 | Gemini Pro |

|---|---|---|---|

| SWE-bench | 72.5% | 50.0% | 35.0% |

| Terminal-bench | 43.2% | 30.0% | 20.0% |

| HumanEval | 92.0% | 87.0% | 74.0% |

| 代码调试 | 优秀 | 良好 | 一般 |

| 多文件理解 | 优秀 | 良好 | 良好 |

实际测试案例: 我们让三个模型完成一个真实的编程任务——优化一个性能较差的Python Web爬虫。结果显示:

- Claude Opus 4不仅识别出了所有性能瓶颈,还提供了并发处理、缓存策略和错误处理的完整解决方案

- GPT-4识别了主要问题,但解决方案不够全面

- Gemini Pro只能识别部分问题,解决方案较为基础

推理能力测试

在复杂推理任务上,Claude Opus 4的混合推理模式展现了独特优势:

python# 测试复杂推理能力的示例 complex_problem = """ 一家创业公司有以下情况: - 月收入\$50,000,月支出\$45,000 - 团队10人,其中6个工程师,2个销售,2个运营 - 主要产品用户增长率为每月15% - 竞争对手刚获得\$10M融资 - 现金储备可支撑6个月 请分析: 1. 公司当前最大的风险是什么? 2. 应该优先解决哪个问题? 3. 给出具体的3个月行动计划 """ # Claude Opus 4的回答展现了深度分析能力 # 它不仅识别了现金流问题,还指出了团队结构失衡 # 并提供了包含具体KPI的行动计划

成本效益分析

让我们通过一个实际项目来比较不同模型的成本效益:

项目: 为电商平台生成10,000个产品描述

| 模型 | 质量评分 | 生成时间 | 官方成本 | LaoZhang成本 |

|---|---|---|---|---|

| Claude Opus 4 | 95/100 | 2小时 | $750 | $225 |

| GPT-4 | 90/100 | 3小时 | $600 | $180 |

| Claude Sonnet 4 | 85/100 | 1.5小时 | $150 | $45 |

| GPT-3.5 | 75/100 | 1小时 | $50 | $15 |

结论:

- 如果质量是首要考虑,Claude Opus 4是最佳选择

- 如果需要平衡质量和成本,Claude Sonnet 4提供了最佳性价比

- 对于预算极其有限的项目,GPT-3.5仍然是可行选项

常见问题解答

API限制和配额

Q: Claude 4 API有哪些使用限制?

A: 主要限制包括:

- 速率限制:默认每分钟60次请求(通过LaoZhang AI可提升至300次)

- Token限制:单次请求最大200K输入Token,32K输出Token

- 并发限制:默认5个并发请求

- 月度配额:根据账户等级不同,企业账户无上限

Q: 如何避免触发速率限制?

A: 实施以下策略:

pythonimport time from functools import wraps def rate_limit(calls_per_minute=60): min_interval = 60.0 / calls_per_minute last_called = [0.0] def decorator(func): @wraps(func) def wrapper(*args, **kwargs): elapsed = time.time() - last_called[0] left_to_wait = min_interval - elapsed if left_to_wait > 0: time.sleep(left_to_wait) ret = func(*args, **kwargs) last_called[0] = time.time() return ret return wrapper return decorator @rate_limit(calls_per_minute=50) # 留出安全边际 def call_claude_api(messages): # API调用逻辑 pass

区域限制问题

Q: 中国大陆用户如何访问Claude API?

A: 有三种解决方案:

- 官方API + VPN:需要稳定的VPN和国外支付方式,不推荐

- LaoZhang AI:国内直连,无需VPN,支持本地支付,推荐

- 其他中转服务:质量参差不齐,需要仔细甄别

支付方式选择

Q: 没有国外信用卡怎么办?

A: LaoZhang AI完美解决了支付问题:

- 支持支付宝、微信支付

- 支持公对公转账(可开发票)

- 无最低充值限制

- 余额永不过期

Q: 如何申请发票?

A: 企业用户可以:

- 在LaoZhang AI后台申请电子发票

- 提供公司开票信息

- 充值满100元即可开具

- 支持增值税普通发票和专用发票

总结:选择最适合你的方案

经过深入分析,我们可以得出以下建议:

如果你是个人开发者:

- 先使用官方免费额度测试

- 小项目使用Claude.ai免费层

- 正式项目通过LaoZhang AI节省成本

如果你是初创企业:

- 直接选择LaoZhang AI,避免支付和访问问题

- 使用Claude Sonnet 4平衡成本和性能

- 实施批量处理和缓存策略进一步降低成本

如果你是大型企业:

- 考虑与Anthropic直接签订企业协议

- 或通过LaoZhang AI的企业方案获得更优惠价格

- 实施完整的成本监控和优化体系

记住,选择AI API不仅要看价格,还要考虑稳定性、技术支持和长期发展。LaoZhang AI在这些方面都提供了可靠的保障。

立即开始你的Claude 4之旅:https://api.laozhang.ai/register/?aff_code=JnIT

如需技术支持或有任何疑问,可以添加微信:laozhangai888,获得一对一的专业指导。

本文基于2025年1月的最新信息编写,价格和功能可能会有变动,请以官方最新公告为准。