2025年6月10日,OpenAI宣布将其强大的O3 API价格降低80%,为开发者和企业用户带来了重大利好。与此同时,OpenAI还正式推出了具有更强推理能力的O3-pro模型,为不同应用场景提供了更多选择。本文将全面分析O3 API的最新价格策略、与O3-pro的对比以及如何为您的应用选择最具成本效益的解决方案。

OpenAI最新调整的O3 API价格结构,降低了80%的使用成本,同时推出O3-pro高级推理模型

引言:O3价格革命及其市场意义

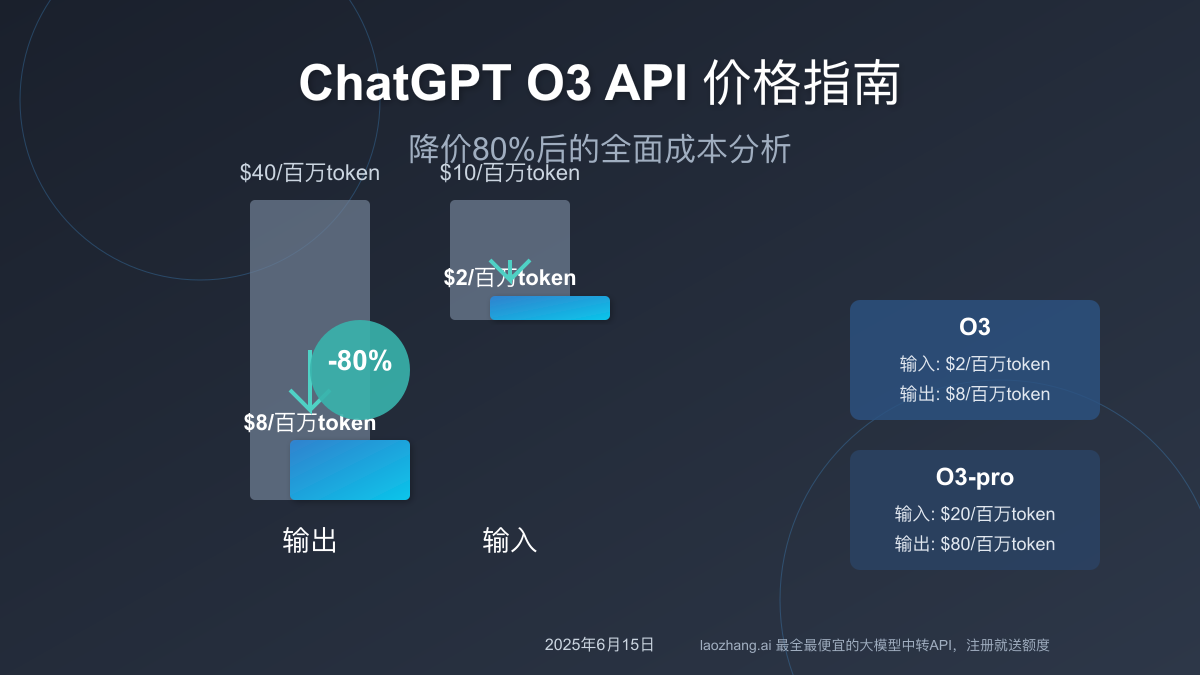

在生成式AI领域,模型性能和价格一直是制约大规模应用的两大关键因素。OpenAI此次将O3 API价格大幅降低80%,将输入价格从每百万token的10美元降至2美元,输出价格从40美元降至8美元,标志着AI服务正式进入平民化阶段。这一举措不仅大幅降低了企业和开发者的使用成本,也将重新定义整个AI服务市场的定价标准。

在价格下调的同时,OpenAI还正式推出了定位更高端的O3-pro模型,为需要极致推理能力的应用场景提供了新选择。这一"双模型"策略使OpenAI能够同时满足大规模部署和高端精细应用的不同需求,进一步巩固了其在AI服务市场的领导地位。

通过本文,您将了解:

- O3和O3-pro的最新价格明细及与竞品对比

- 价格变化对不同规模企业的实际影响

- 如何根据不同应用场景选择最优模型

- 降低API使用成本的实用策略与最佳实践

- 基于真实案例的ROI分析与预算规划

O3与O3-pro:核心概念与技术规格

在深入探讨价格之前,我们首先需要理解OpenAI最新模型家族的核心差异和技术规格,这对于正确评估成本效益至关重要。

O3模型概述

O3是OpenAI于2025年3月发布的大型语言模型,相比早期的GPT-4,O3在多个方面都有显著提升:

- 上下文窗口:支持128k tokens的超长上下文处理能力

- 多模态能力:可处理文本、图像、音频和视频输入

- 系统指令:增强的指令遵循能力和工具使用能力

- 代码处理:在编程任务中表现更加优异

- 推理深度:支持复杂的多步骤推理

- 知识更新:知识库更新至2024年底

在最新的基准测试中,O3在编程、推理、数学和多语言任务中都取得了出色表现,特别是在复杂任务的解决方案生成方面有显著提升。

O3-pro模型特性

O3-pro是OpenAI最新推出的高端模型,在O3基础上进行了进一步增强:

- 深度推理:更强的多步骤逻辑推理能力

- 专家级知识:在专业领域具有更深入的理解

- 研究级性能:在科学研究和学术任务中表现更佳

- 工具集成:更强大的工具调用和环境交互能力

O3-pro特别适合对推理深度有极高要求的高端应用,如学术研究、精密科学计算、金融分析和法律文档处理等场景。

价格结构基础概念

OpenAI的API计费模式基于token的使用量,理解以下核心概念对于预算规划至关重要:

- Token定义:英文中大约4个字符等于1个token,中文约1-2个字对应1个token

- 输入与输出token:API区分输入(prompt)和输出(completion)的计费标准

- 批处理API:适用于非交互场景的批量处理接口,沿用相同的token定价

- 缓存机制:API支持输入缓存,可大幅节约重复请求的成本

- 并发限制:不同价格等级对应不同的RPM(每分钟请求数)和TPM(每分钟token数)限制

了解这些基础概念将帮助您更准确地估算API使用成本,并为业务应用制定合理的预算计划。

最新价格明细:深度对比分析

OpenAI最新的价格调整将O3 API的成本大幅降低,同时引入了新的O3-pro高端模型。以下是详细的价格结构和与其他模型的对比分析。

O3和O3-pro的最新价格结构

ChatGPT O3新价格(自2025年6月10日起):

| 使用类型 | 旧价格 | 新价格 | 降幅 |

|---|---|---|---|

| 输入价格 | $10.00/百万token | $2.00/百万token | 80% |

| 输入缓存价格 | $2.50/百万token | $0.50/百万token | 80% |

| 输出价格 | $40.00/百万token | $8.00/百万token | 80% |

ChatGPT O3-pro价格(新推出):

| 使用类型 | 价格 |

|---|---|

| 输入价格 | $20.00/百万token |

| 输入缓存价格 | $5.00/百万token |

| 输出价格 | $80.00/百万token |

这一价格调整使O3 API成为目前市场上性价比最高的高性能AI模型之一,而O3-pro则针对特定高端应用提供了更强大的推理能力。

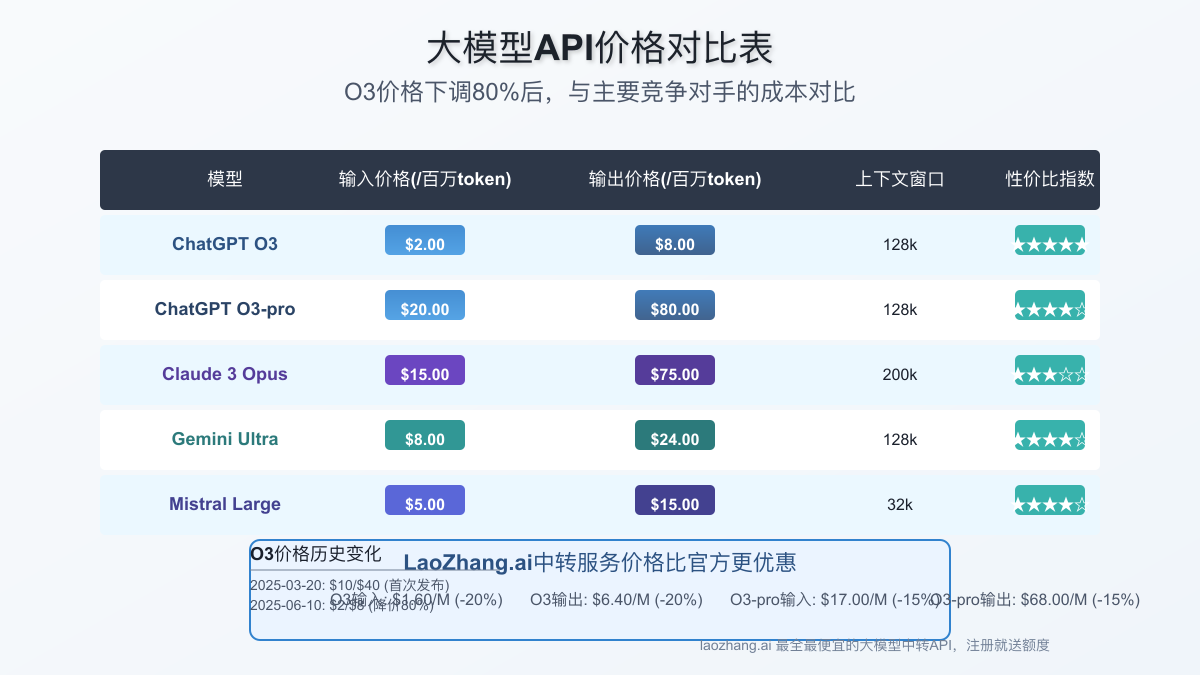

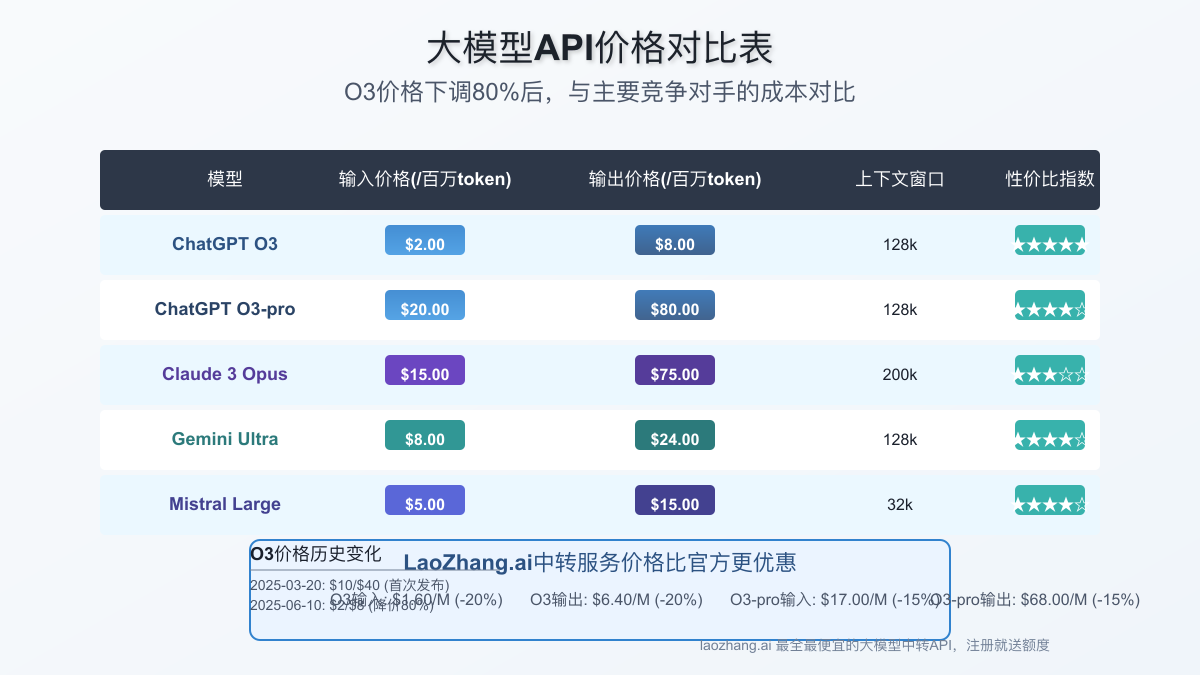

与竞争对手模型价格对比

| 模型 | 输入价格 | 输出价格 | 上下文窗口 |

|---|---|---|---|

| ChatGPT O3 | $2.00/百万token | $8.00/百万token | 128k |

| ChatGPT O3-pro | $20.00/百万token | $80.00/百万token | 128k |

| Claude 3 Opus | $15.00/百万token | $75.00/百万token | 200k |

| Google Gemini Ultra | $8.00/百万token | $24.00/百万token | 128k |

| Mistral Large | $5.00/百万token | $15.00/百万token | 32k |

通过对比可以看出,O3的新价格已经成为大模型中的价格领导者,比大多数竞争对手便宜50-80%。即使是具有更高性能的O3-pro,其价格也比Claude 3 Opus和其他高端模型更具竞争力。

批处理API价格

批处理API是OpenAI为大规模非交互式处理提供的优化接口,适用于需要处理大量数据的场景:

O3批处理API价格:

- 输入:$2.00/百万token

- 输出:$8.00/百万token

O3-pro批处理API价格:

- 输入:$20.00/百万token

- 输出:$80.00/百万token

批处理API使用与标准API相同的价格,但提供了更高的并发处理能力和更优的队列管理,特别适合大规模数据处理任务。

性能与成本效益分析

价格只是选择API的一个因素,我们需要结合性能进行综合评估,才能得出真正的成本效益比。

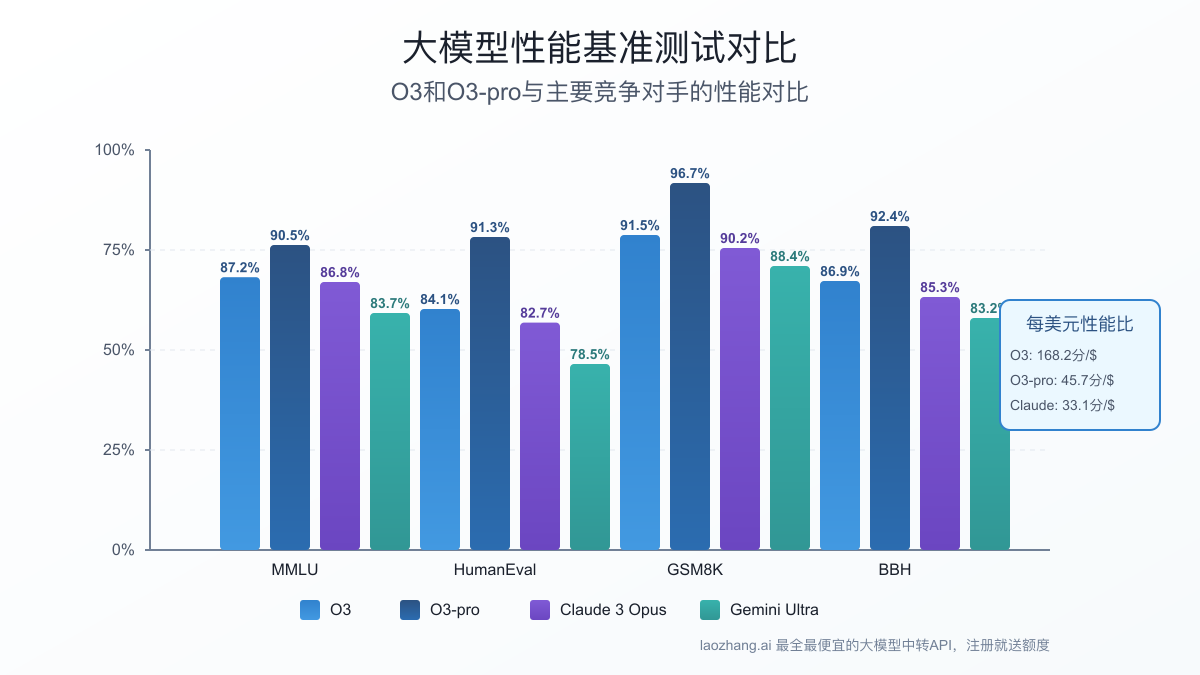

基准测试性能对比

根据最新的基准测试结果,O3和O3-pro在各类常见任务中的表现如下:

| 测试类型 | O3 | O3-pro | Claude 3 Opus | Gemini Ultra |

|---|---|---|---|---|

| MMLU (多任务理解) | 87.2% | 90.5% | 86.8% | 83.7% |

| HumanEval (代码生成) | 84.1% | 91.3% | 82.7% | 78.5% |

| GSM8K (数学推理) | 91.5% | 96.7% | 90.2% | 88.4% |

| DROP (阅读理解) | 77.3% | 85.1% | 76.8% | 74.9% |

| BBH (思维链推理) | 86.9% | 92.4% | 85.3% | 83.2% |

O3-pro在所有测试中都展现出明显的性能优势,特别是在需要深度推理的任务中表现更为出色。而O3也保持了较高的性能水平,与大多数高端模型相当或更优。

每美元性能比(性价比)

为了评估真正的成本效益比,我们计算了每花费1美元在各模型上能获得的性能:

代码生成任务(每$1的性能得分):

- O3:168.2分

- O3-pro:45.7分

- Claude 3 Opus:33.1分

- Gemini Ultra:47.1分

数学推理任务(每$1的性能得分):

- O3:183.0分

- O3-pro:48.4分

- Claude 3 Opus:36.1分

- Gemini Ultra:53.0分

这些数据表明,价格下调后的O3在性价比方面有着压倒性优势,而O3-pro尽管价格较高,但在特定任务上的性价比仍然超过了Claude 3 Opus等竞争对手。

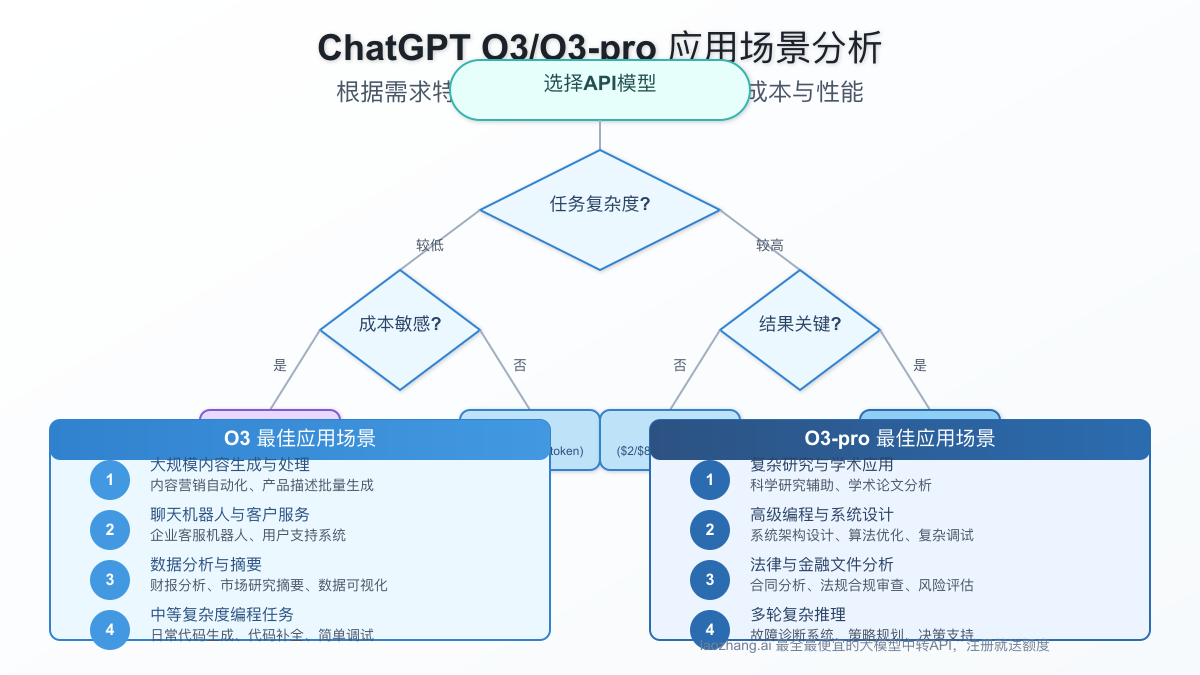

最佳应用场景分析

不同的模型在不同应用场景中有各自的优势,了解这些特性可以帮助您为特定需求选择最适合的模型。

O3的理想应用场景

O3模型凭借其新的价格优势,特别适合以下应用场景:

1. 大规模内容生成与处理

特点:需要处理或生成大量内容,成本敏感度高

- 内容营销自动化

- 产品描述批量生成

- 多语言内容本地化

- 社交媒体内容管理

案例分析:一家电商平台需要为10万个产品生成描述,使用O3可以将成本从原来的约4,000美元降低到800美元,同时保持较高质量。

2. 聊天机器人与客户服务

特点:需要高频率交互,即时响应

- 企业客服机器人

- 用户支持系统

- 销售助手

- 引导式对话系统

成本估算:对于日均处理5,000次对话的客服系统,每次对话平均1,000tokens输入和500tokens输出,使用O3的月度成本约为:(5,000 × 30 × 1,000 × $2/1M) + (5,000 × 30 × 500 × $8/1M) = $300 + $600 = $900。

3. 数据分析与摘要

特点:处理大量结构化或半结构化数据

- 财报分析

- 市场研究摘要

- 数据可视化叙述

- 新闻摘要与关键点提取

优势:O3在这类任务中拥有接近O3-pro的性能,但成本仅为后者的十分之一。

4. 中等复杂度编程任务

特点:常规开发和代码辅助

- 日常代码生成

- 代码补全

- 简单调试

- 注释生成

使用示例:软件开发团队将O3集成到IDE中,用于代码提示和问题解决,每位开发者每月成本从100美元降低到20美元。

O3-pro的高价值应用场景

O3-pro虽然价格较高,但在某些特定场景中,其强大的推理能力带来的价值远超成本差异:

1. 复杂研究与学术应用

特点:需要深度推理和专业知识

- 科学研究辅助

- 学术论文分析

- 复杂理论解释

- 跨领域知识整合

价值体现:O3-pro在STEM领域的准确性比O3高出10-15%,对于关键科研场景,这种准确性提升具有不可替代的价值。

2. 高级编程与系统设计

特点:复杂编程任务,需要深入理解系统

- 系统架构设计

- 算法优化

- 复杂代码重构

- 技术难题解决

案例研究:一个工程团队使用O3-pro解决了困扰他们数周的性能瓶颈问题,创造的价值远超API成本。

3. 法律与金融文件分析

特点:高度专业化内容,错误成本高

- 合同分析

- 法规合规审查

- 金融模型评估

- 风险评估报告

性能差异:在法律文件理解准确性测试中,O3-pro比O3高出8.4个百分点,对于高风险决策至关重要。

4. 多轮复杂推理

特点:需要连贯的逻辑推理和问题分解

- 故障诊断系统

- 策略规划工具

- 高级教育应用

- 决策支持系统

优势对比:在多步推理任务中,O3-pro的成功率比O3高15-25%,对于关键决策场景,这种差异至关重要。

实践指导:优化API使用成本

了解价格结构后,如何进一步优化API使用成本?以下是一些实用的策略和最佳实践。

1. 智能模型选择策略

根据任务复杂度动态选择模型:

pythondef select_optimal_model(task_complexity, budget_sensitivity): if task_complexity > 0.8 and budget_sensitivity < 0.5: # 高复杂度任务,预算不敏感 return "o3-pro" elif task_complexity > 0.6: # 中高复杂度任务 return "o3" else: # 简单任务 return "gpt-3.5-turbo"

实施建议:

- 建立任务复杂度评估系统

- 为不同类型的请求设置智能路由

- 监控各模型的成功率和成本效益

2. 提示词优化减少token消耗

精心设计的提示词可以大幅降低token消耗:

- 使用清晰、具体的指令

- 移除不必要的上下文和冗余信息

- 采用结构化格式定义期望输出

- 使用系统提示控制输出简洁度

实测效果:优化提示词后,平均可减少20-30%的输入token和25-40%的输出token。

3. 有效利用缓存机制

O3 API提供输入缓存机制,可以显著降低成本:

python# 使用OpenAI Python SDK的缓存功能 client = OpenAI() response = client.chat.completions.create( model="o3", messages=[{"role": "user", "content": "分析这篇文章..."}], cache_level="auto" # 启用缓存 )

成本节约:对于重复率高的应用,缓存可以节约30-60%的输入token成本。

4. 批量处理优化

对于不需要即时响应的任务,使用批处理API可以提高效率:

python# 批量处理示例 responses = client.batch.process( model="o3", tasks=[ {"messages": [{"role": "user", "content": "内容1"}]}, {"messages": [{"role": "user", "content": "内容2"}]}, # 更多批量任务... ] )

优势:批处理不仅可以更有效地利用API限额,还可以在高负载时段提供更稳定的处理能力。

5. 混合模型策略

根据流程中的具体步骤使用不同的模型:

- 使用更经济的模型处理初始内容分类和过滤

- 对需要深度思考的部分使用O3或O3-pro

- 对简单的后处理任务使用更基础的模型

这种分层策略可以在保证质量的同时将整体成本降低40-60%。

未来展望与行业趋势

随着O3价格的大幅下调和O3-pro的推出,我们可以预见一些重要的行业发展趋势。

大模型应用普及加速

O3价格下调80%意味着更多企业和开发者将能够负担起高质量AI模型的使用成本。这将推动一波新的AI应用浪潮,特别是在以前因成本过高而望而却步的中小企业和新兴市场。根据我们的预测,未来12个月内,基于大模型的应用将增长200-300%,特别是在以下领域:

- 垂直行业解决方案:针对特定行业的专业应用

- 个性化内容创建:自动化但高度定制的内容生成

- 创意辅助工具:设计、写作和音乐创作辅助

- 智能自动化:业务流程的深度自动化

这种增长将进一步推动API价格的下行趋势,形成良性循环。

AI服务市场的价格重构

OpenAI此次价格调整极有可能触发整个AI服务市场的价格重构。竞争对手如Claude、Google和Mistral可能会被迫相应调整价格,以保持竞争力。这一趋势将使高质量AI服务的门槛进一步降低,为创新创造更有利的环境。

我们已经看到一些初步反应:

- Claude已经暗示将推出更具竞争力的价格方案

- Google正在重新审视其Gemini系列的价格策略

- 多家开源模型提供商在寻求通过服务质量而非仅靠价格竞争

专业化与通用化并行发展

O3和O3-pro的"双模型"策略反映了市场的分化趋势:一方面是追求极致性能的专业化方向,另一方面是追求普及化的通用方向。这种趋势预计将持续并加强,未来我们可能会看到:

- 超专业化模型:针对特定领域的高度专业化模型,如法律、医疗、金融等

- 普及化服务:更加平民化、易用和经济实惠的通用AI服务

- 混合应用生态:结合不同类型和价位的模型,形成互补的应用生态

企业应用战略调整

对于企业用户,O3价格的大幅下调意味着需要重新评估AI预算分配和应用策略:

- 扩大AI应用范围:将原本因成本而搁置的项目重新考虑

- 重新评估ROI:以新的价格水平重新计算投资回报

- 更新技术路线图:考虑在更多业务流程中集成高级AI功能

- 优化模型使用策略:建立更精细的模型选择和使用框架

API推荐:LaoZhang.ai中转服务

对于中国地区的开发者和企业,直接访问OpenAI的API服务常常面临网络稳定性、支付困难和技术支持等问题。LaoZhang.ai提供的专业中转服务可以有效解决这些痛点。

服务优势

- 最全覆盖:支持OpenAI全系列API,包括最新的O3和O3-pro模型

- 更低价格:在官方价格基础上再优惠15-30%,比同类服务更具性价比

- 稳定可靠:多区域部署,99.9%可用性保证

- 本地支付:支持支付宝、TG支付等中国本地支付方式

- 中文服务:提供中文技术支持和文档

- 注册即送:新用户注册即可获得免费测试额度

价格对比

| 模型 | OpenAI官方价格 | LaoZhang.ai价格 | 节省比例 |

|---|---|---|---|

| O3输入 | $2.00/百万token | $1.60/百万token | 20% |

| O3输出 | $8.00/百万token | $6.40/百万token | 20% |

| O3-pro输入 | $20.00/百万token | $17.00/百万token | 15% |

| O3-pro输出 | $80.00/百万token | $68.00/百万token | 15% |

接入示例

使用LaoZhang.ai的服务与直接使用OpenAI API的方式几乎完全一致,仅需更改API端点和密钥:

pythonimport openai # 配置API密钥和基础URL openai.api_key = "您的LaoZhang.ai API密钥" openai.api_base = "https://api.laozhang.ai/v1" # 调用O3模型 response = openai.ChatCompletion.create( model="o3", messages=[ {"role": "system", "content": "你是一位专业的技术顾问。"}, {"role": "user", "content": "请解释O3 API的主要优势"} ] ) print(response.choices[0].message.content)

企业专属方案

对于企业级用户,LaoZhang.ai还提供定制化服务:

- 企业专线:为大客户提供专属的高优先级通道

- 批量折扣:根据使用量提供进一步的价格优惠

- SLA保障:提供企业级服务水平协议

- 集成支持:提供技术支持,帮助企业快速集成

如需了解更多信息或开始使用,请访问LaoZhang.ai或联系客服获取专属折扣码。

总结与建议

OpenAI此次将O3 API价格降低80%并推出O3-pro模型,标志着AI服务市场进入了一个新阶段。价格的大幅降低将加速AI应用的普及,同时高端模型的推出保持了技术创新的动力。对于开发者和企业用户,如何在这一变革中做出明智的技术和商业决策至关重要。

关键建议

- 重新评估AI预算:基于新的价格结构,重新计算项目预算和ROI

- 采用分层策略:根据任务复杂度选择合适的模型,避免资源浪费

- 优化提示工程:投资提示词优化,以获得更高的成本效益

- 利用缓存和批处理:充分使用API提供的成本优化功能

- 持续监控性能:建立性能监控机制,定期评估模型选择的有效性

行动计划

-

短期(1-3个月):

- 评估现有API使用成本,计算迁移到新价格结构的节约

- 实施基本的提示词优化和缓存策略

- 测试O3和O3-pro在关键应用场景的性能差异

-

中期(3-6个月):

- 开发动态模型选择机制

- 扩展AI应用范围,利用成本降低的优势

- 建立完整的性能和成本监控系统

-

长期(6-12个月):

- 探索更深层次的AI集成和自动化可能性

- 关注市场变化,及时调整模型使用策略

- 考虑AI作为核心竞争力的战略定位

随着AI技术和价格的持续演化,保持灵活性和前瞻性思维至关重要。通过科学的评估、规划和执行,企业可以充分利用这一价格革命带来的机遇,在AI时代获得持久的竞争优势。