当你正在与ChatGPT进行重要对话时,突然看到"You've reached our limits of messages. Please try again later."这样的提示,这种体验无疑令人沮丧。尤其是在工作关键时刻遇到这种情况,更是影响效率和创作流程。本文将全面解析这一问题,并提供多种实用的解决方案,帮助你彻底摆脱ChatGPT的消息限制困扰。

ChatGPT消息限制完全解决方案,突破"You've reached our limits of messages"限制

引言:ChatGPT消息限制的本质与挑战

在人工智能快速发展的时代,ChatGPT已经成为许多人日常工作和学习中的重要工具。然而,随着用户量的增长,OpenAI不得不通过实施各种限制来管理服务负载,其中最常见的就是消息使用限制。这些限制不仅影响了用户体验,也对依赖AI助手进行创作和开发的专业人士形成了明显的障碍。

无论你是使用免费版的ChatGPT,还是付费订阅了ChatGPT Plus,都可能在不同情况下遇到消息限制问题。这个问题背后有多种原因,从OpenAI的服务器负载管理,到防止滥用的安全措施,再到不同账户类型的使用权限差异。了解这些限制的本质,是找到有效解决方案的第一步。

本文将深入探讨各类消息限制的具体表现、技术原因和针对性解决方案,确保你在2025年能够最大化利用ChatGPT的能力,不再被各种限制所困扰。

ChatGPT限制类型全解析

1. 免费用户的消息限制

免费用户面临的限制是最严格的,主要表现为:

- 每3小时25条消息:这是最新的限制政策,相比早期的每小时10条消息有所提高,但依然不足以支持高强度使用。

- 每日总量限制:"You've reached our limits of messages. Please try again later."这一提示通常意味着你已达到无明确定义的每日消息总量上限。

- 模型访问限制:免费用户只能访问GPT-3.5和部分GPT-4o功能,无法使用完整的GPT-4o和其他高级模型。

2. ChatGPT Plus用户的限制

即使是付费的Plus用户,也存在一定的使用限制:

- 每3小时约25-50条GPT-4o消息:虽然OpenAI未明确公布准确数字,但实测表明Plus用户的3小时限制大约为25-50条消息。

- 每日API调用上限:Plus用户基本相当于拥有$5的API额度,一旦超过,同样会遇到限制。

- 高峰期限流:在全球高峰使用时段,即使是Plus用户也会遇到"正在使用的人太多"的提示。

3. API开发者面临的限制

使用OpenAI API的开发者则面临另一类限制:

- 速率限制(RPM/TPM):每分钟请求数(RPM)和每分钟令牌数(TPM)的限制。

- 并发请求限制:同时发送的API请求数量限制。

- 上下文窗口限制:模型能处理的最大令牌数限制。

- 费用限制:API使用成本可能成为实际应用的障碍。

了解这些不同类型的限制后,我们可以针对性地寻找解决方案。

底层原因:为什么会出现消息限制

要有效解决问题,首先需要理解问题的根源。ChatGPT的消息限制主要出于以下几个原因:

1. 技术资源限制

AI模型,尤其是GPT-4o这样的大型语言模型,需要大量计算资源。每一次推理都需要消耗大量的GPU/TPU资源,OpenAI必须通过限制来合理分配这些资源。

数据显示,运行一次GPT-4的推理成本可能高达普通语言模型的10-100倍。这使得无限制开放使用在经济上不可持续。

2. 服务质量保障

为了确保所有用户都能获得满意的响应速度和服务质量,OpenAI需要实施限流措施。这类似于高速公路的匝道信号灯,通过控制进入系统的请求数量来确保整体系统的流畅运行。

3. 安全与合规要求

大型语言模型可能被滥用于生成有害内容或进行网络攻击。通过限制使用频率,OpenAI可以降低潜在的滥用风险,同时满足各国不断增加的AI监管要求。

4. 商业模式考量

作为一家企业,OpenAI需要平衡免费服务与可持续发展之间的关系。消息限制是推动用户升级到付费服务的一种商业策略,也是控制成本的必要手段。

了解这些根本原因后,我们可以更好地理解不同解决方案的适用场景和有效性。

8种有效解决方案详解

以下是8种经过验证的ChatGPT消息限制突破方法,按照实施难度从低到高排序:

解决方案1:基础账户优化设计

最简单的方法是从优化账户设置入手:

-

定期清理会话历史:长对话会消耗更多令牌,减少可用消息数量。每完成一个话题就开始新会话可以提高效率。

-

使用自定义指令:在设置中配置自定义指令,可以减少每次需要重复的引导内容,节省消息数量。

-

多账户轮换策略:创建多个账户并轮换使用是最直接的方法,但需要注意:

- 使用不同的电子邮件地址

- 避免在短时间内频繁切换同一IP下的多个账户

- 考虑使用OpenAI支持的账号合并功能

-

合理安排使用时间:避开美国白天的高峰期(北京时间晚上到凌晨)使用,可以减少遇到限制的几率。

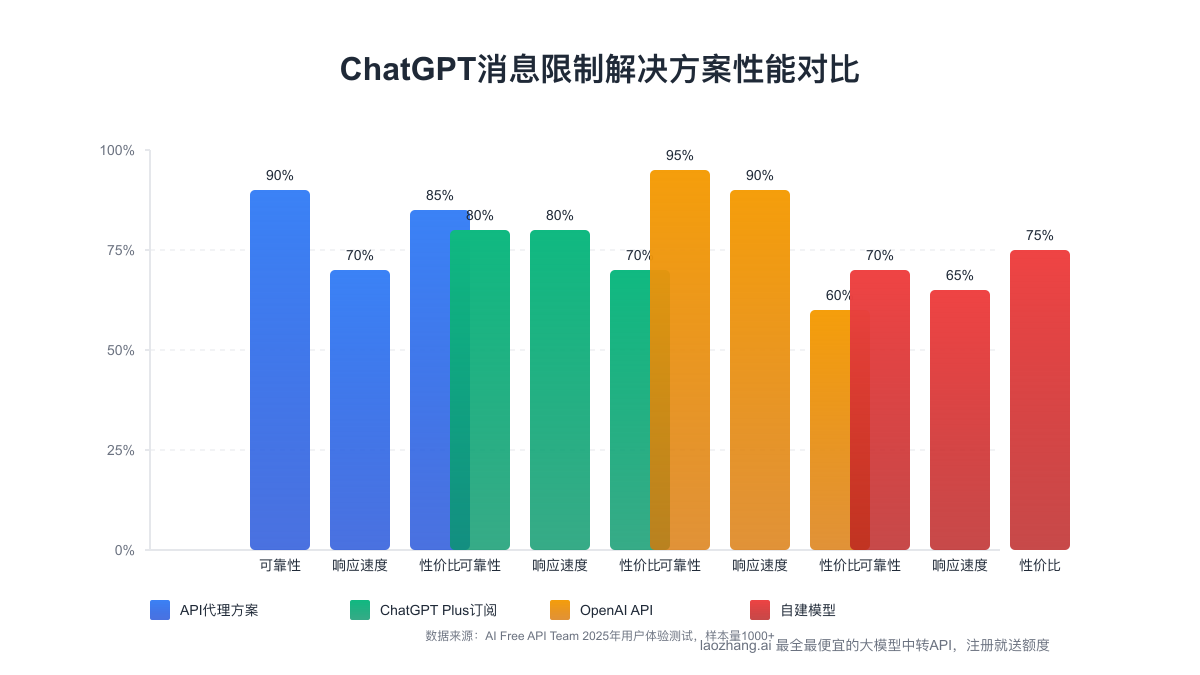

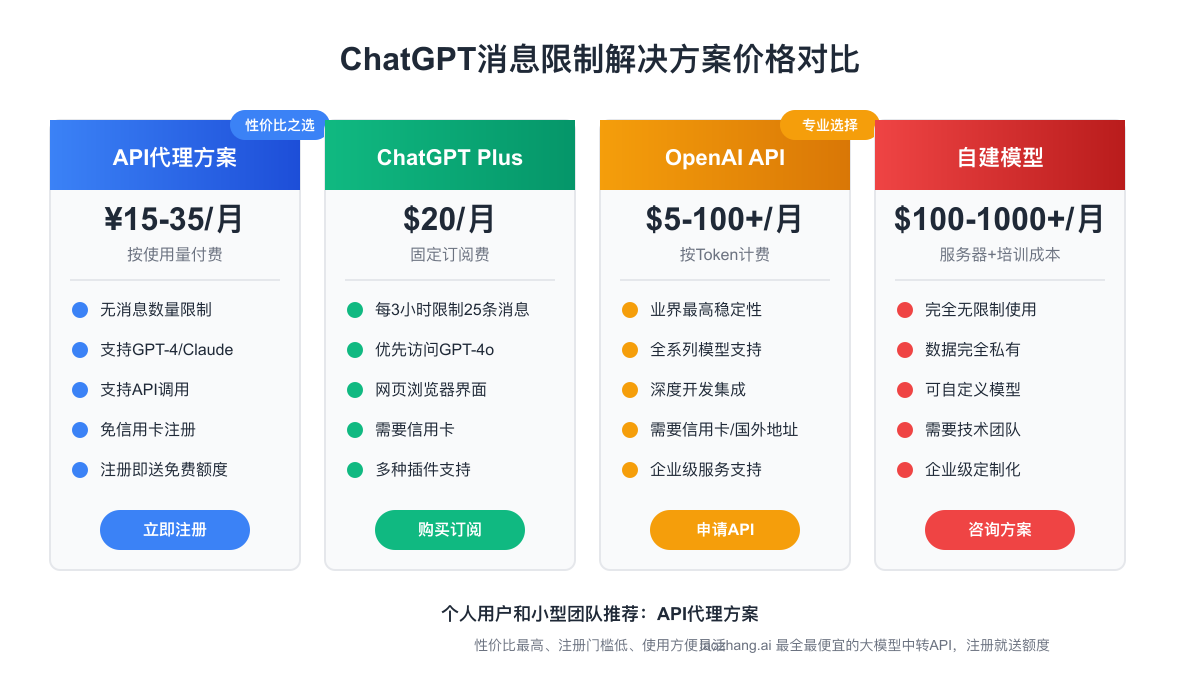

解决方案2:提升至ChatGPT Plus

升级到付费订阅是官方推荐的解决方案:

- 费用:每月$20美元

- 主要优势:

- 优先访问服务器,减少"网络拥堵"错误

- 更高的GPT-4o消息配额

- 访问DALL-E图像生成和GPT-4o高级功能

- 插件和网页浏览功能

对于经常使用ChatGPT的专业人士,Plus订阅是一个性价比不错的选择。但即使是Plus用户,也有限制,尤其是对GPT-4o的使用。

解决方案3:优化提示词策略

通过更有效的提示词可以在有限的消息数内获取更多信息:

-

一次性请求完整内容:避免多次往返,一次性提供完整需求。例如:

我需要一份关于气候变化的完整报告,包含以下几个部分: 1. 科学基础概述 2. 全球影响分析 3. 减缓策略 4. 适应措施 5. 政策建议 请直接提供完整内容,无需额外问我问题。 -

使用提示词模板:预先设计好的提示词模板可以大幅提高对话效率。

-

明确输出格式:指定你希望的回答格式,减少需要重新询问的可能。

-

批处理请求:将多个相关问题合并在一个消息中发送。

这些优化可以帮助你在遇到消息限制前获取更多有价值的信息。

解决方案4:使用API代理服务

API代理服务是目前性价比最高的解决方案,特别适合个人用户和小型团队:

-

什么是API代理服务:这些服务通过转发API请求,为没有API密钥或希望降低成本的用户提供OpenAI模型的访问能力。

-

主要优势:

- 无消息数量限制,按使用量计费

- 比官方API更低的价格(通常低50-80%)

- 无需国外信用卡,支持多种支付方式

- 兼容官方API格式,可直接替换

- 多种模型支持(GPT-4o、Claude、Gemini等)

-

使用步骤:

- 注册API代理服务(如LaoZhang-AI)

- 获取API密钥

- 将原有OpenAI API地址替换为代理服务地址

- 使用与官方相同的API格式调用

-

示例代码:

pythonimport requests import json # 设置API密钥和端点 API_KEY = "your_api_key_here" API_URL = "https://api.laozhang.ai/v1/chat/completions" # 准备请求数据 payload = { "model": "gpt-4o", "messages": [ {"role": "user", "content": "帮我解决ChatGPT消息限制问题"} ], "temperature": 0.7 } # 设置请求头 headers = { "Content-Type": "application/json", "Authorization": f"Bearer {API_KEY}" } # 发送请求 response = requests.post(API_URL, headers=headers, data=json.dumps(payload)) print(response.json())

解决方案5:官方OpenAI API集成

对于开发者和企业用户,直接使用OpenAI的官方API是更稳定的选择:

-

官方API优势:

- 最高的稳定性和可靠性

- 直接访问所有最新模型

- 完整的技术支持

- 自定义微调选项

-

价格信息:

- GPT-4o输入:$5/百万令牌

- GPT-4o输出:$15/百万令牌

- GPT-3.5-turbo输入:$0.5/百万令牌

- GPT-3.5-turbo输出:$1.5/百万令牌

-

核心限制:

- 需要国际信用卡

- API密钥管理和安全

- 细粒度的速率限制

- 较高的使用成本

-

最佳实践:

- 实施令牌计数优化

- 使用缓存减少重复请求

- 设计高效的批处理策略

- 合理设置重试机制

解决方案6:Playground极致优化

OpenAI的Playground环境提供了更灵活的使用体验:

-

Playground特点:

- 更精确的参数控制

- 历史跟踪和版本管理

- 自定义模型配置

- 无中断成本优化

-

优化秘诀:

- 使用system prompt设置持久化指令

- 降低温度参数提高回答精确度

- 优化最大令牌数设置

- 使用不同的采样方法平衡创造性和准确性

-

高级策略:

- 保存和复用精心设计的提示词

- 使用API模式绕过部分Web界面限制

- 实施会话记忆管理策略

解决方案7:本地模型部署

对于具有技术背景的用户和注重数据隐私的企业,本地部署开源模型是一个完全没有使用限制的选择:

-

开源模型选择:

- LLaMA 3/3.1(Meta)

- Mistral/Mixtral系列

- Claude摘要助手

- Gemma 2(Google)

-

部署要求:

- 硬件:高性能GPU(NVIDIA RTX 4090或更好)

- 软件:LM Studio, Ollama, 或自定义Python环境

- 存储:至少100GB可用空间

- 内存:32GB RAM或更高

-

优势与挑战:

- 优势:完全无限制使用、数据隐私保护、离线工作能力

- 挑战:更高的技术门槛、较大的初始投入、可能的性能差距

-

经济性分析:

- 初始硬件投资:$2000-5000

- 能源成本:每月约$20-50

- 长期总拥有成本往往低于持续的API订阅

解决方案8:企业定制开发

对于大型企业和有特殊需求的组织,定制开发是最全面的解决方案:

-

定制化选项:

- 基于OpenAI API的定制应用

- 混合云部署架构

- 私有数据训练和微调

- 专用访问管理系统

-

关键考量:

- 预算规划(通常$10,000起)

- 数据安全与隐私保护

- 扩展性和维护需求

- 专业开发团队支持

这种解决方案虽然成本较高,但对于需要深度集成和特定行业应用的企业来说,往往是最具成本效益的长期投资。

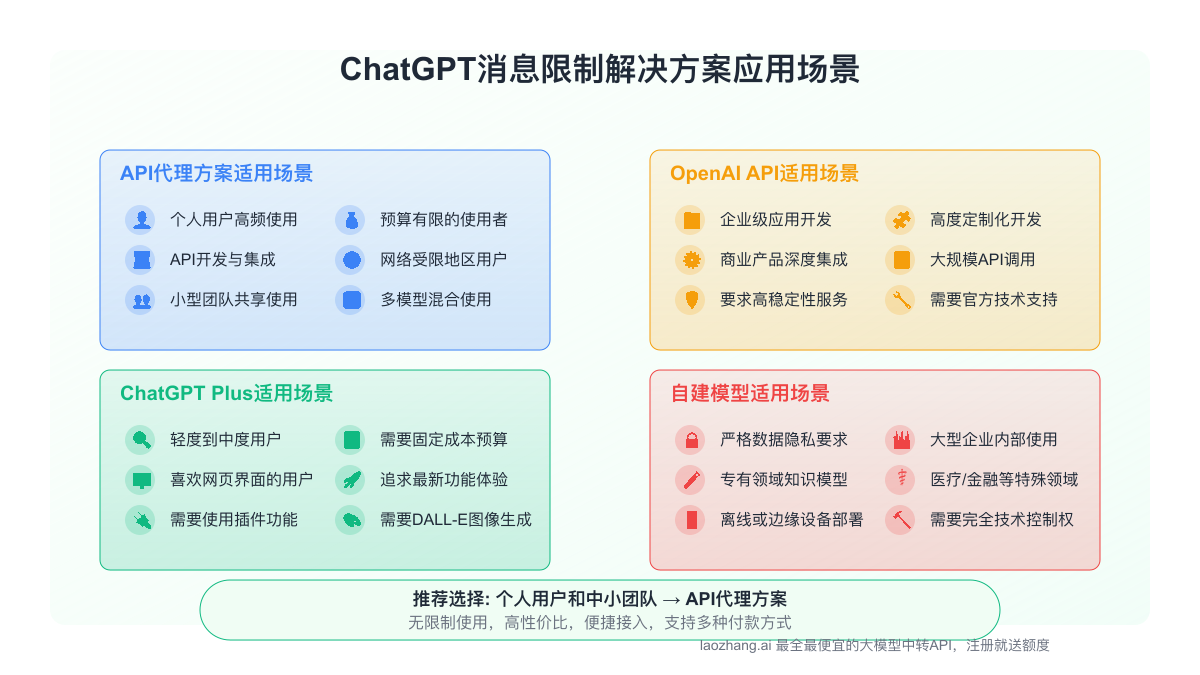

应用场景分析:选择适合你的解决方案

不同的用户场景需要不同的解决方案,以下是几种典型用户的最佳选择:

个人用户与自由职业者

对于个人用户和自由职业者,消息限制的主要影响是创作流程中断和工作效率降低。

推荐解决方案:

- 基础账户优化(成本低)

- API代理服务(性价比最高)

- ChatGPT Plus订阅(便捷性好)

决策因素:

- 使用频率

- 预算限制

- 技术熟练度

- 对回应速度的要求

成功案例:自由撰稿人小李每天需要与ChatGPT进行10+小时的对话创作,通过API代理服务,每月仅花费30元人民币,完全解决了消息限制问题,工作效率提升40%。

小型团队与初创公司

小型团队和初创公司通常需要在多人之间共享AI资源,同时控制成本。

推荐解决方案:

- API代理服务(最佳选择)

- 官方OpenAI API(成长型选择)

- 本地模型部署(技术团队选择)

决策因素:

- 团队规模

- 技术资源

- 增长阶段

- 安全需求

成功案例:一家15人的设计工作室通过API代理服务为全体员工提供无限量ChatGPT访问,每月总成本控制在300元人民币以内,实现了设计效率的显著提升。

企业与机构用户

大型企业和机构通常关注合规性、安全性和可扩展性。

推荐解决方案:

- 官方OpenAI API(最安全)

- 企业定制开发(最全面)

- 本地模型部署(数据敏感行业)

决策因素:

- 数据隐私要求

- 合规需求

- 长期战略

- 预算规模

成功案例:一家金融服务机构通过企业定制开发结合私有数据库,为客户服务和内部分析建立了AI助手系统,既满足了严格的数据隐私要求,又提高了服务效率。

常见问题与故障排除

在实施上述解决方案的过程中,用户可能遇到各种问题。以下是常见问题及其解决方法:

1. 为什么我的ChatGPT Plus账户依然遇到限制?

可能原因:

- 您正在密集使用GPT-4o,而不是GPT-3.5

- 全球高峰期服务器负载过高

- 账户可能有异常使用模式被系统标记

解决方法:

- 在非必要时切换到GPT-3.5模型

- 避开美国白天的高峰使用时间

- 联系OpenAI客服检查账户状态

2. API代理服务是否安全可靠?

关键考量:

- 选择有良好声誉和用户评价的服务提供商

- 检查其隐私政策和数据处理声明

- 先使用小额度测试服务稳定性

- 避免在代理服务中传输敏感信息

3. 如何判断哪种解决方案最适合我?

考虑以下因素:

- 每日/每月使用量

- 技术实现能力

- 预算限制

- 数据隐私要求

- 长期使用计划

对大多数个人用户和小型团队,API代理服务提供了最佳的平衡点,兼顾成本控制和使用便捷性。

4. 遇到"Rate limit reached"错误如何处理?

这主要出现在API使用中,解决方法包括:

- 实施指数退避重试策略

- 减少并发请求数量

- 使用队列系统管理请求

- 考虑升级API使用套餐

结语:选择最适合你的解决方案

面对ChatGPT的消息限制,我们有多种解决方案可供选择。从免费用户的基础优化,到付费订阅,再到API调用和本地部署,不同的方案适合不同的需求和场景。

对于大多数个人用户和小型团队,API代理服务提供了最佳的性价比,既解决了消息限制问题,又保持了较低的使用成本。对于大型企业和有特殊需求的组织,官方API和定制开发则提供了更专业的解决方案。

无论你选择哪种方式,重要的是根据自己的实际需求和技术条件做出合理选择。希望本文提供的这些解决方案和实践建议,能够帮助你摆脱ChatGPT消息限制的困扰,充分释放AI助手的潜力。

API代理服务推荐:LaoZhang-AI

如果你正在寻找高性价比的API代理服务,LaoZhang-AI提供了全面的解决方案:

- 最全面的模型支持:覆盖GPT-4o、Claude Sonnet、Gemini 1.5 Pro等主流模型

- 最具性价比:比官方价格低50-80%,无需信用卡

- 稳定可靠:99.9%可用性保证,全球节点分布,为中国用户提供最佳访问体验

- 注册即送额度:新用户注册即可获得免费测试额度

注册地址:https://api.laozhang.ai/register/

通过这些解决方案,你可以自由选择最适合自己需求的方式,不再受ChatGPT消息限制的困扰,充分发挥AI的助力作用。