ByteDance LatentSync는 사용할 수 있는 모델이지만, 하나의 공식 서비스처럼 다루면 위험하다. 먼저 확인할 것은 코드와 가중치를 어디서 신뢰할지, 추론을 어디서 실행할지, 비디오와 오디오 파일이 누구에게 전달되는지, 실패와 과금과 삭제를 누가 책임지는지다.

실제 인물의 얼굴, 목소리, 고객 영상, 공개 전 콘텐츠를 다룬다면 ByteDance GitHub 저장소와 Hugging Face 가중치부터 확인해야 한다. GPU와 운영 권한이 있으면 로컬 실행이 더 통제하기 쉽다. GPU가 없고 짧은 테스트만 필요하면 호스팅 API가 빠르지만, 제공자의 가격, 입력 제한, 파일 보관, 삭제, 지원 조건을 먼저 확인해야 한다.

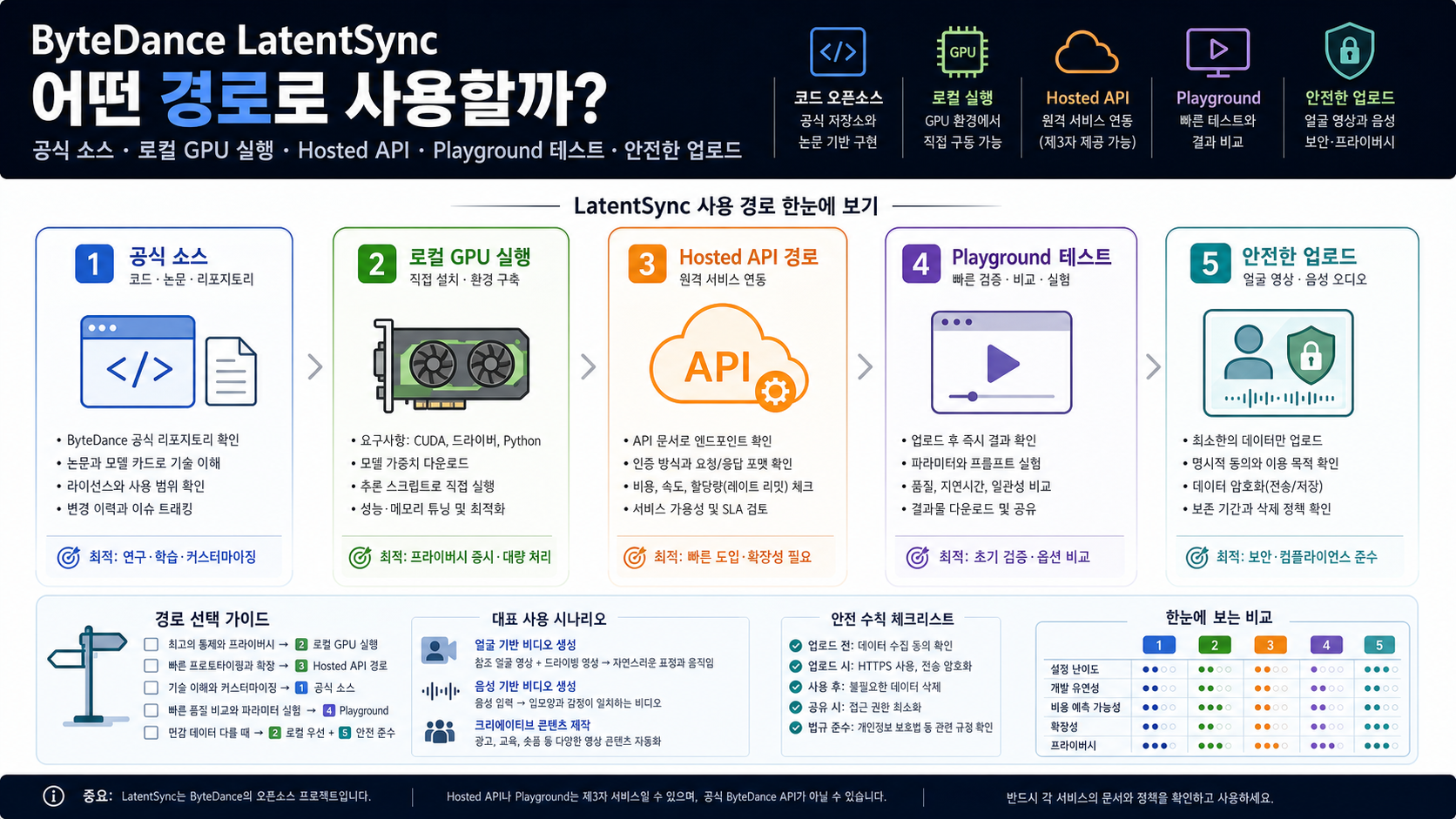

실행 경로부터 고른다

LatentSync의 일은 명확하다. 원본 비디오와 목표 오디오를 받아 화면 속 입 모양을 오디오에 맞추는 립싱크 작업이다. 겉으로는 비디오와 오디오를 넣고 결과를 받는 단순한 흐름처럼 보이지만, 실행 경로마다 책임 주체가 다르다.

| 경로 | 어울리는 상황 | 먼저 확인할 것 | 가정하면 안 되는 것 |

|---|---|---|---|

| 공식 소스 | 코드, 가중치, 논문, 버전 사실을 확인해야 할 때 | GitHub bytedance/LatentSync, Hugging Face ByteDance/LatentSync-1.6, arXiv 2412.09262 | 상위에 보이는 래퍼 사이트가 공식이라는 가정 |

| 로컬 실행 | GPU가 있고 파일을 내부에서 관리해야 할 때 | VRAM, 가중치 버전, setup script, Gradio 또는 CLI | 최신 버전이 모든 장비에 맞는다는 가정 |

| 호스팅 API | GPU 없이 API로 실행하고 싶을 때 | 입력 필드, 과금 주체, 길이 제한, 보관, 실패 처리 | fal이나 Replicate가 ByteDance 공식 API라는 가정 |

| Playground | 더미 소재로 흐름만 보고 싶을 때 | 운영자, 모델 출처, 업로드 규칙 | 무료 업로드 박스가 실제 얼굴과 음성에 안전하다는 가정 |

이 순서로 보면 문제 해결도 쉬워진다. 로컬 실행 실패는 Python 환경, CUDA, checkpoint, VRAM, 비디오 포맷, 오디오 포맷을 봐야 한다. 호스팅 API 실패는 제공자의 queue, URL 접근성, 파라미터 이름, billing, output URI를 봐야 한다. Playground는 운영자가 모델 출처와 파일 보관을 설명하지 않으면 실패 원인을 충분히 알기 어렵다.

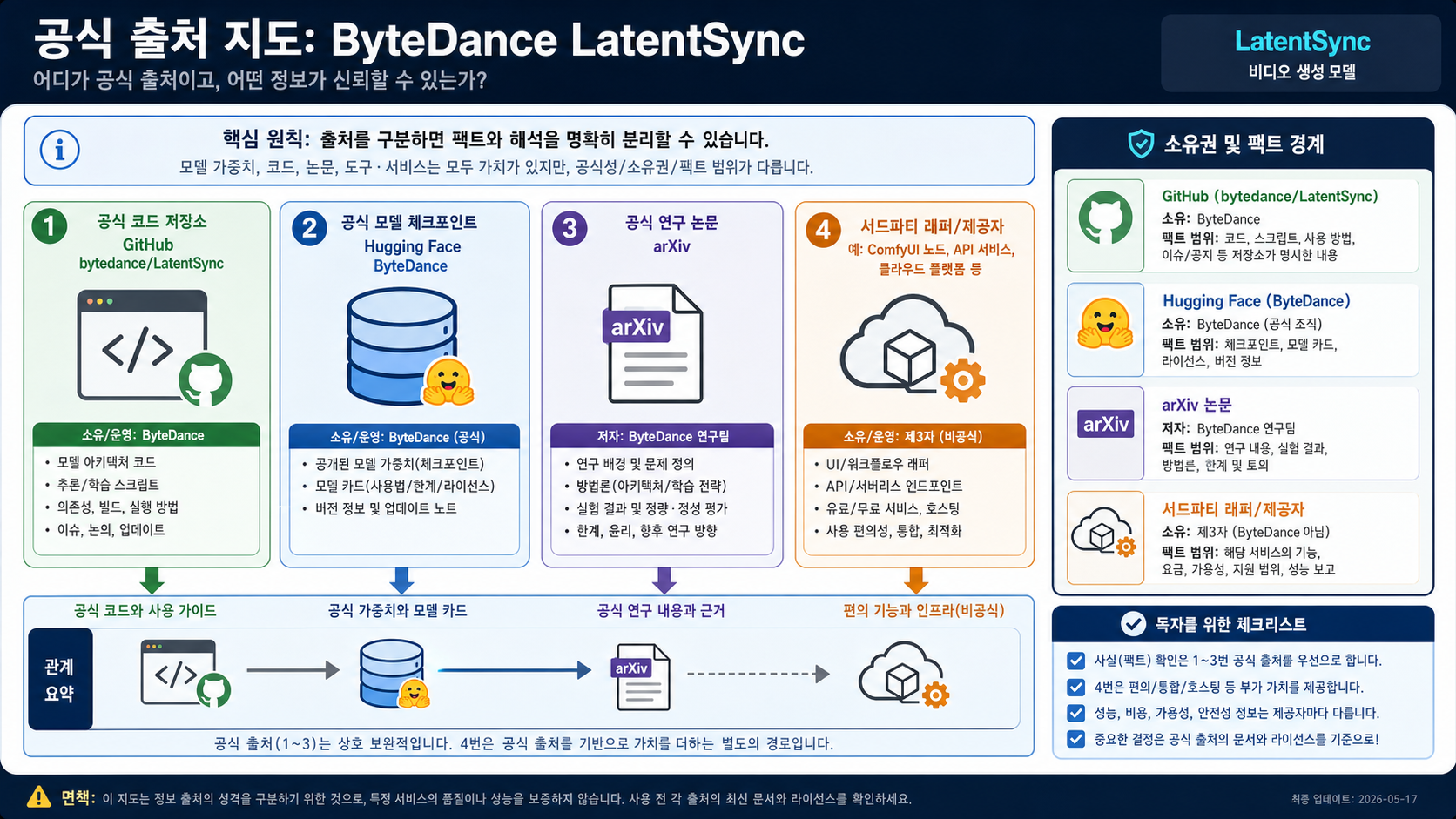

ByteDance라는 이름과 API라는 단어가 함께 보인다고 해서 공개된 ByteDance 운영 API가 있다고 단정하면 안 된다. 확인 가능한 공식 축은 오픈소스 코드, 가중치, 논문이고, 공개 API 실행은 대체로 제3자 제공자가 LatentSync를 실행해 주는 서비스로 봐야 한다.

LatentSync는 범용 비디오 생성 모델이 아니다

LatentSync는 text-to-video 모델이 아니고, 디지털 휴먼 제작 전체를 대신하는 제품도 아니다. 이미 존재하는 비디오에 목표 오디오를 맞춰 입 모양을 동기화하는 모델이다. 얼굴 크기, 입 주변 가림, 조명, 흔들림, 오디오 품질, 클립 길이가 결과에 직접 영향을 준다.

공식 논문은 Taming Stable Diffusion for Lip Sync이며 arXiv 2412.09262와 연결된다. 방법은 audio-conditioned latent diffusion을 기반으로 하고, Whisper 기반 오디오 특성, U-Net cross-attention, SyncNet 계열 supervision, StableSyncNet과 TREPA를 이용한 temporal consistency를 포함한다. 실무에서는 이 용어들이 모델의 경계를 알려 준다. LatentSync는 기존 영상의 입 모양을 오디오에 맞추는 모델이지, 텍스트로 전체 장면을 만드는 모델이 아니다.

이 경계는 안전 검토와도 연결된다. 립싱크는 얼굴과 목소리를 동시에 다루므로, 결과물이 특정 사람이 실제로 말한 것처럼 보일 수 있다. 기술적으로 잘 작동하더라도 동의, 초상권, 음성 사용 권리, 공개 범위, 고객 승인 없이 실제 인물 소재를 외부 서비스에 올리는 것은 안전하지 않다.

공식 소스는 GitHub, Hugging Face, arXiv로 나눈다

LatentSync라고 적힌 페이지 하나만 보고 출처 확인을 끝내면 안 된다. GitHub, Hugging Face, arXiv는 서로 다른 질문에 답한다.

GitHub bytedance/LatentSync는 코드 기준점이다. 프로젝트 구조, README, setup path, inference scripts, update notes, license metadata를 확인할 수 있다. 2026년 5월 17일 확인 기준으로 저장소 owner는 ByteDance, 주 언어는 Python, 코드 쪽 license metadata는 Apache-2.0이며 GitHub Releases가 버전의 중심은 아니었다. 그래서 버전을 확인할 때는 Releases만 보지 말고 README의 업데이트 기록과 checkpoint 참조를 봐야 한다.

Hugging Face는 가중치 기준점이다. ByteDance/LatentSync-1.6에는 latentsync_unet.pt, stable_syncnet.pt, whisper/tiny.pt 같은 파일이 있고, 이전 ByteDance/LatentSync도 과거 가중치와 관련 Spaces의 진입점으로 남아 있다. Hugging Face model card metadata는 openrail++를 표시하므로, 코드가 Apache-2.0이라고 해서 가중치까지 같은 조건이라고 묶어 말하면 안 된다. 코드, 가중치, 입력 미디어, 출력 사용 권리는 따로 확인해야 한다.

arXiv는 방법 기준점이다. 논문은 모델 구조와 적용 경계를 이해하는 데 도움이 되지만 실행 경로는 아니다. 설치와 버전 사실은 GitHub, 가중치 사실은 Hugging Face, 제공자별 API 동작은 각 호스팅 서비스 페이지에서 확인해야 한다.

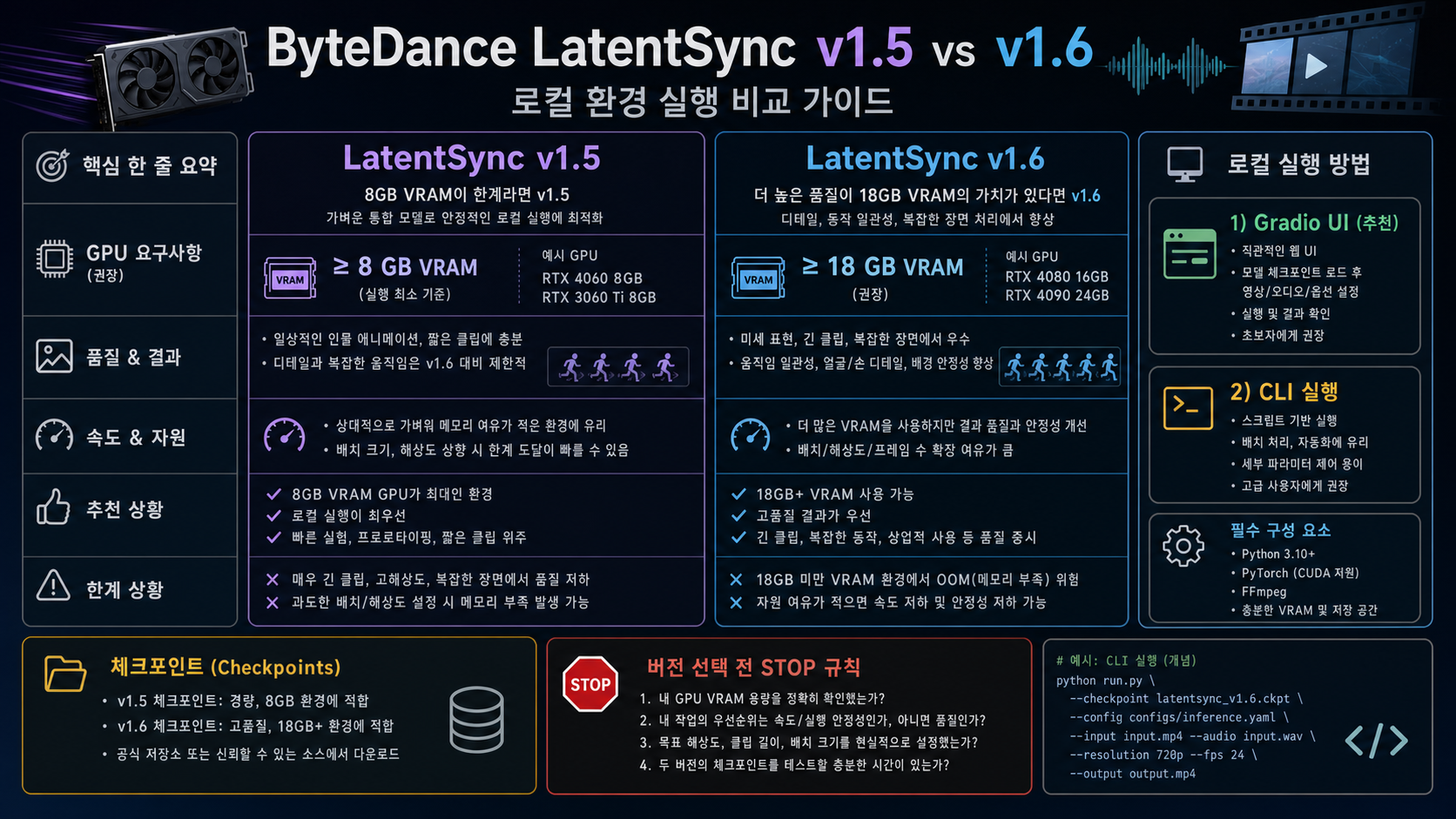

v1.5와 v1.6은 VRAM으로 먼저 나눈다

로컬 실행에서 최신 버전이라는 이유만으로 v1.6을 고르면 안 된다. README의 추론 조건은 분명하다. LatentSync 1.5는 최소 8 GB VRAM, LatentSync 1.6은 최소 18 GB VRAM이 필요하다. 많은 개인용 GPU에서는 이 차이가 가장 먼저 걸리는 조건이다.

v1.6은 품질 쪽 이유가 있다. 2025년 6월 11일 업데이트는 v1.6이 512x512 videos로 학습되어 blur를 줄이려 했다고 설명한다. 2025년 3월 14일 v1.5 업데이트는 temporal consistency, Chinese videos 성능, stage-two training VRAM 개선을 강조한다. 따라서 v1.5와 v1.6은 단순한 구버전과 신버전의 문제가 아니라, 장비 여유, 입력 품질, 처리 시간, 출력 품질 목표의 선택이다.

첫 로컬 검증은 짧게 해야 한다. 짧은 source video, 짧은 target audio, 선택한 checkpoint, 충분한 VRAM, 명확한 output path만으로도 충분하다. 첫 목표는 긴 production clip이 아니라 환경이 뜨는지, 가중치가 로드되는지, 입력 포맷이 맞는지, 결과가 저장되는지를 확인하는 것이다.

장비가 두 버전 모두에 맞지 않는다면 CUDA 재설치를 반복하기 전에 멈추는 편이 낫다. 권리상 안전한 테스트 파일로 호스팅 API를 확인하면, 모델 결과와 운영 조건을 더 빨리 판단할 수 있다.

파일 통제가 중요하면 로컬 실행이 맞다

로컬 실행의 장점은 더 공식처럼 보인다는 데 있지 않다. 입력 파일, 출력 파일, 로그, 코드 버전, 가중치 버전, 임시 파일 삭제를 직접 통제할 수 있다는 점이 핵심이다. 내부 영상, 고객 파일, 공개 전 콘텐츠, 동의 확인이 필요한 음성을 다룰 때 이 통제권은 중요하다.

공식 README의 로컬 시작 형태는 다음과 같다.

bashgit clone https://github.com/bytedance/LatentSync.git cd LatentSync source setup_env.sh python gradio_app.py

스크립트 추론에는 ./inference.sh 경로도 있다. 처음부터 긴 영상이나 대량 배치를 실행하지 말고, 짧은 영상과 짧은 오디오로 codec, audio format, checkpoint path, VRAM, output directory를 확인한다. 그 뒤에야 batch, queue, cloud GPU, 긴 영상 분할을 붙이는 것이 안전하다.

로컬 실행은 관리 비용도 있다. dependency drift, CUDA 충돌, checkpoint 다운로드 실패, 디스크 공간, 긴 영상 전처리, 실패 파일 정리까지 직접 책임져야 한다. 개인정보와 재현성이 중요하면 받아들일 수 있는 비용이지만, 일회성 데모라면 너무 무거울 수 있다.

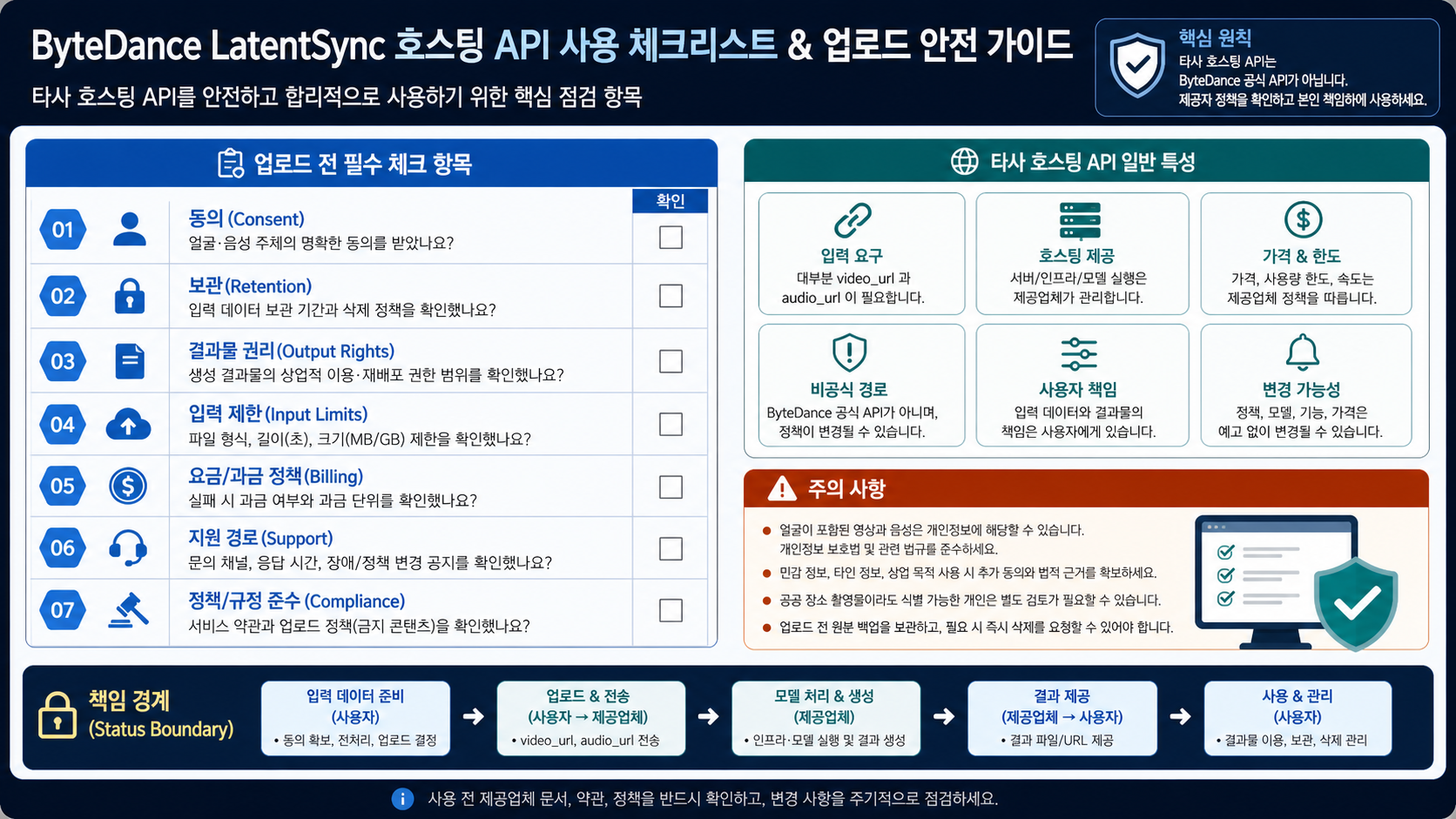

호스팅 API는 제공자 계약이다

호스팅 API는 GPU와 환경 구축을 줄여 주는 편리한 경로다. 하지만 LatentSync라는 이름을 쓴다고 해서 ByteDance 공식 API가 되는 것은 아니다. 제공자가 endpoint, queue, billing, storage, limits, response schema, support를 관리한다.

2026년 5월 17일 확인 기준으로 fal은 fal-ai/latentsync 경로와 endpoint https://fal.run/fal-ai/latentsync를 제공했다. 필수 입력은 video_url과 audio_url이고, 선택 입력에는 guidance_scale, seed, loop_mode가 있었다. 같은 근거에서 가격은 40초 이하 \$0.20, 이후 output second당 \$0.005로 표시되었다. 이는 fal이 소유한 가격이며 ByteDance 가격이 아니다.

Replicate는 bytedance/latentsync 경로를 제공하고, 입력은 video와 audio, 추가로 guidance_scale, seed를 사용한다. 출력은 URI로 돌아온다. 설명에는 mp4 video와 mp3, aac, wav, m4a audio formats가 언급되었다. 같은 확인에서 안정적인 현재 가격은 검증하지 않았으므로 production estimate에는 Replicate 가격 페이지 재확인이 필요하다.

| 호스팅 경로 | 확인한 입력 형태 | 적합한 용도 | 운영 전 확인 |

|---|---|---|---|

fal fal-ai/latentsync | video_url, audio_url | URL 기반 빠른 API 테스트 | 가격 날짜, URL privacy, 최대 길이, 실패 과금, retention |

Replicate bytedance/latentsync | video, audio | Replicate 생태계의 hosted inference | 현재 가격, queue, file limits, output retention, support |

| Wrapper playground | 사이트마다 다름 | 더미 소재 수동 테스트 | 운영자, 모델 출처, 삭제 정책, 계정 조건 |

호스팅 API를 쓰는 이유는 공식성이 아니라 운영 편의다. 낮은 위험의 파일이고, 제공자 조건이 맞고, 실패 처리와 과금이 분명할 때 유용하다. 실제 얼굴과 목소리를 다룰 때는 편의성보다 파일 보관과 삭제 조건이 먼저다.

실제 얼굴과 음성 업로드 전에는 중지 조건이 필요하다

LatentSync 입력은 얼굴 비디오와 음성 오디오의 조합이다. 성공적인 결과일수록 보는 사람이 특정 인물이 실제로 말한 것처럼 받아들일 수 있다. 따라서 업로드 전에 멈출 조건을 정해야 한다.

| 확인 항목 | 필요한 이유 | 멈출 조건 |

|---|---|---|

| 동의 | 결과물이 실제 발화처럼 보일 수 있음 | 얼굴, 음성, 사용 목적에 대한 허가가 없음 |

| 파일 보관 | input, output, logs, URL이 저장될 수 있음 | 저장, 삭제, 접근 범위가 불명확함 |

| 권리 | 코드, 가중치, 소재, 출력의 조건이 다를 수 있음 | 상업 사용이나 공개 범위를 설명할 수 없음 |

| 입력 제한 | 긴 영상과 비지원 포맷은 다른 실패를 만듦 | 길이, 크기, 형식 경계가 없음 |

| 실패 과금 | retry나 partial failure에도 비용이 날 수 있음 | 과금, 환불, 재실행 규칙이 불명확함 |

| 지원 경로 | production failure에는 추적 가능한 창구가 필요함 | docs, issue, ticket, contact가 없음 |

내부 실험은 합성 소재나 명시적으로 허가된 짧은 파일로 시작한다. 고객 작업에서는 route owner, model version, source media, consent basis, upload destination, output path, deletion plan, reviewer를 기록한다. 이 기록이 있어야 품질, 청구, 권리 문제를 나중에 설명할 수 있다.

실무 선택 순서

공식성을 확인해야 하면 GitHub와 Hugging Face에서 시작한다. 파일을 외부로 보낼 수 없으면 로컬 실행을 선택한다. GPU가 없고 짧은 검증이 필요하면 호스팅 API를 검토한다. 흐름만 보고 싶다면 더미 소재로 Playground를 사용한다.

| 우선순위 | 시작점 | 이유 |

|---|---|---|

| 공식 확인 | GitHub와 Hugging Face | ByteDance 소스 사실과 제3자 표시를 분리할 수 있음 |

| 비공개 파일 | 로컬 v1.5 또는 v1.6 | 입력을 내부 환경에 둘 수 있음 |

| GPU 없음 | 호스팅 API | 추론 운영을 제공자에게 맡김 |

| 빠른 흐름 확인 | 더미 소재 Playground | 입출력 형태만 보기 충분함 |

| production 준비 | 로컬 또는 조건이 명확한 제공자 | logs, limits, retry, retention, support가 필요함 |

정답은 하나가 아니다. 민감한 파일이면 로컬이 유리하고, GPU가 없으면 조건이 명확한 호스팅 API가 낫고, 초기 탐색이면 더미 소재 Playground로 충분할 수 있다. 중요한 것은 링크가 아니라 파일 위험, 하드웨어, 실행 책임이 맞는지다.

자주 묻는 질문

LatentSync는 ByteDance 공식 프로젝트인가요?

예. 공식 open-source 기준점은 GitHub bytedance/LatentSync이며, ByteDance는 Hugging Face 가중치 경로도 유지한다. 래퍼 사이트와 제공자 페이지는 유용할 수 있지만, 별도 증거가 없다면 독립 실행 경로로 다뤄야 한다.

ByteDance 공식 LatentSync API가 있나요?

확인된 범위에서는 ByteDance가 직접 운영하는 공개 LatentSync API를 찾지 못했다. fal, Replicate 같은 경로는 LatentSync를 둘러싼 제3자 호스팅 API로 설명해야 하며, ByteDance 공식 API와 분리해야 한다.

로컬에서는 v1.5와 v1.6 중 무엇을 써야 하나요?

먼저 VRAM을 본다. 8 GB VRAM 근처라면 v1.5로 짧은 검증을 시작하는 편이 현실적이다. 18 GB VRAM 정도가 있고 blur 감소가 중요하면 v1.6을 테스트한다. 장비가 부족하면 안전한 소재로 호스팅 경로를 먼저 확인한다.

GitHub 코드와 Hugging Face 가중치는 같은 라이선스인가요?

그렇게 가정하면 안 된다. GitHub 저장소의 코드 license metadata는 Apache-2.0이고, Hugging Face model card metadata는 openrail++를 표시한다. 상업 배포, 재배포, 고객 납품 전에는 둘 다 확인해야 한다.

무료 Playground에 실제 인물 영상을 올려도 되나요?

운영자, 모델 출처, 보관, 삭제, 계정 처리, 출력 권리, 지원 경로가 명확하지 않다면 피해야 한다. 무료 입력창은 더미 소재로 흐름을 보는 데 적합하며 실제 얼굴이나 목소리에는 충분하지 않다.

production에서는 무엇을 기록해야 하나요?

route owner, model version 또는 provider model name, source media, consent basis, upload destination, output URI 또는 file path, failure/retry reason, billing owner, retention/deletion policy를 기록한다. 나중에 품질, 청구, 권리 검토를 할 때 필요한 최소 기록이다.