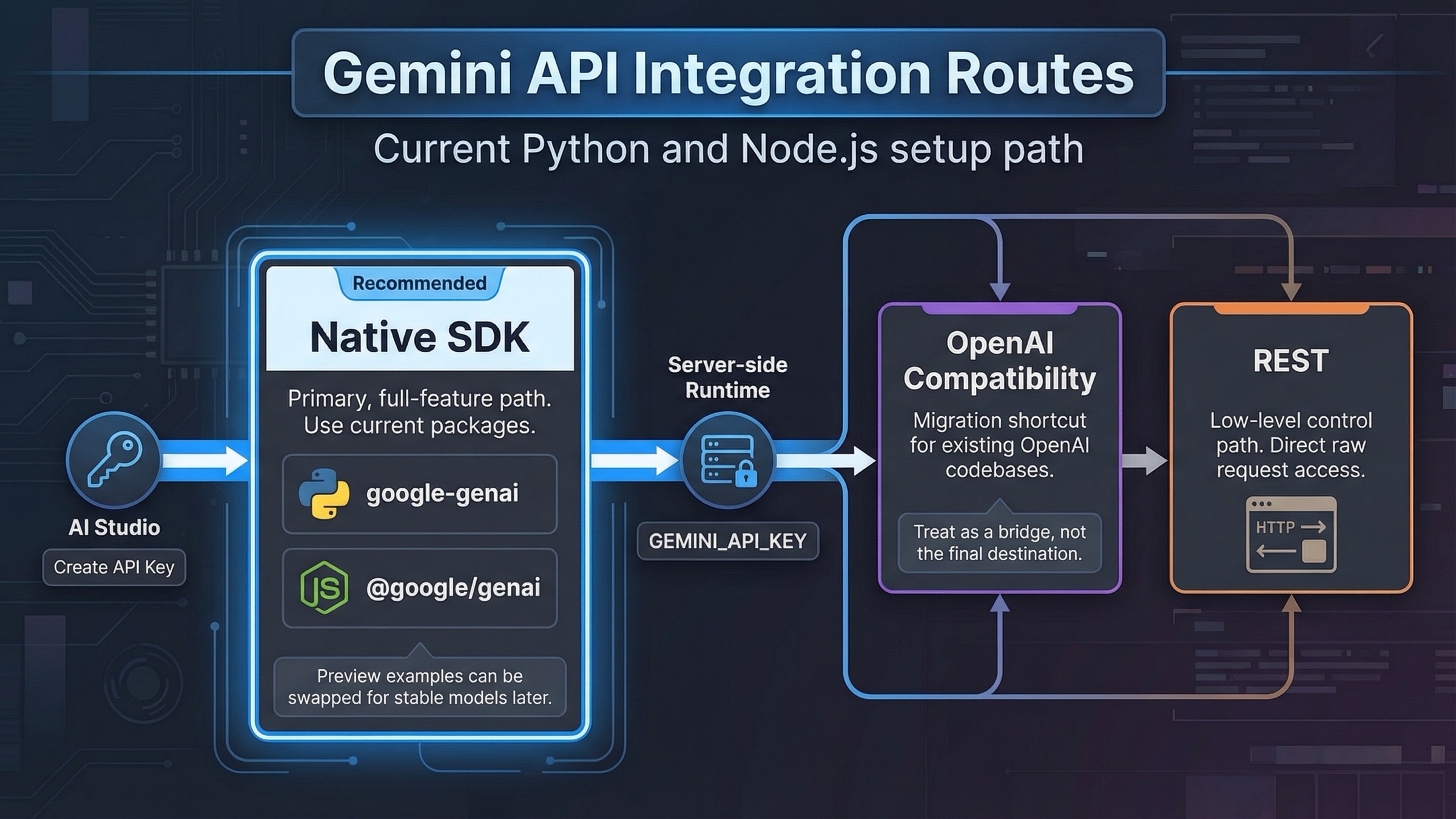

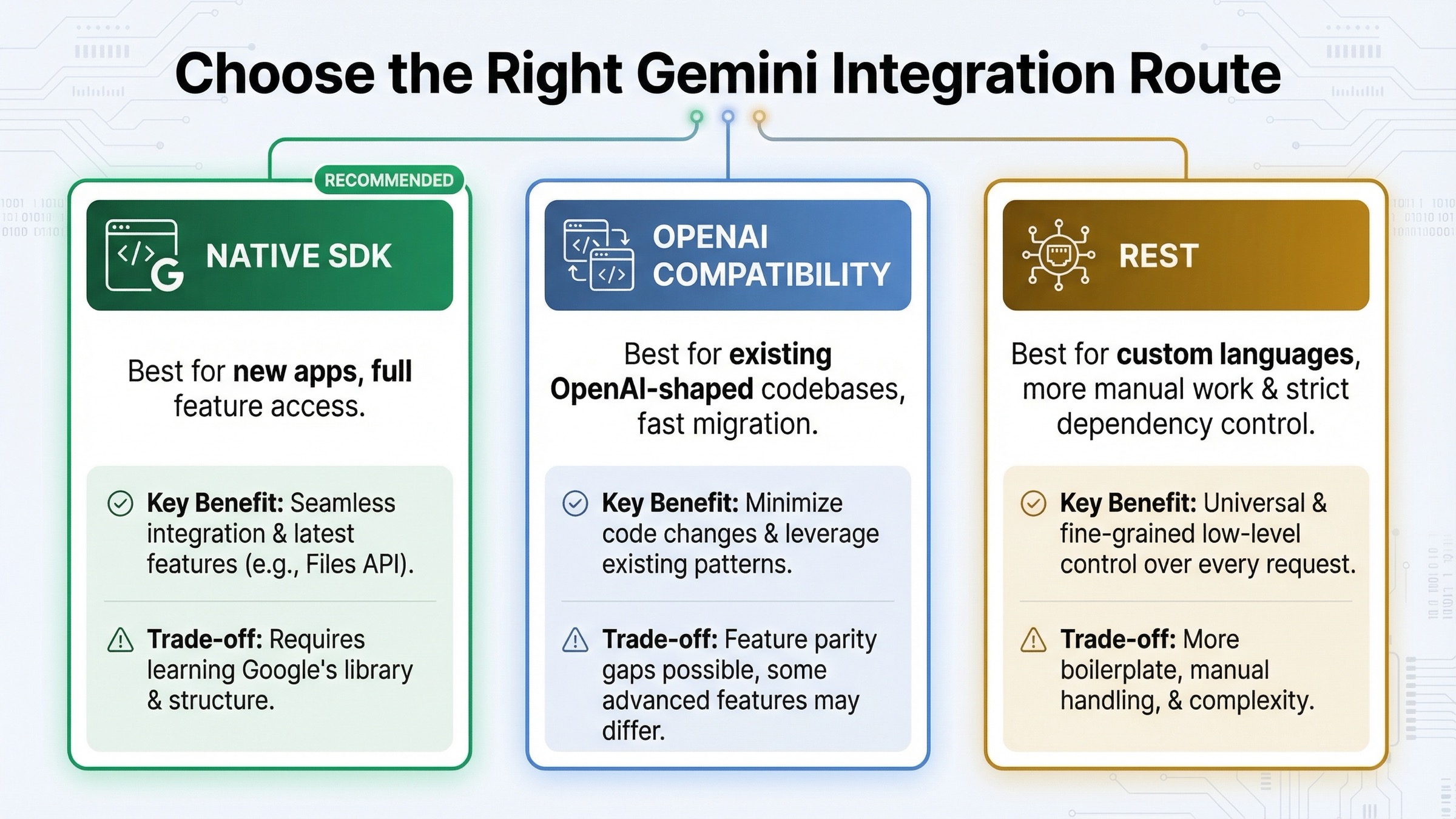

지금 새 Gemini API 통합을 시작한다면 기본값은 네이티브 Google GenAI SDK입니다. GEMINI_API_KEY 는 서버에 두고, 먼저 최소한의 한 번 성공하는 요청을 만든 뒤 streaming, tools, files 를 붙이는 순서가 가장 안전합니다. OpenAI 호환 레이어를 먼저 써야 하는 경우는 이미 OpenAI 스타일 코드베이스가 있어서 빠르게 옮겨야 할 때뿐입니다. 현재 Google의 quickstart, migration guide, example repo는 이미 google-genai(Python)와 @google/genai(JavaScript)를 중심으로 정리되어 있습니다.

이 가이드의 핵심 역할은 첫날의 구현 경로를 올바르게 고정하는 것입니다. 올바른 SDK와 비밀정보 경계, 첫 성공 요청을 확보한 뒤에 streaming, structured output, function calling, Files API, billing, rate limits 를 순서대로 붙이면 됩니다. 그렇게 해야 오래된 패키지명, 잘못된 모델 ID, 어색한 운영 경계 때문에 처음부터 다시 손보는 일을 줄일 수 있습니다.

현재 Google 공식 예제는 여전히 gemini-3-flash-preview 같은 preview 모델 ID를 자주 사용하므로, 아래 코드 예제도 그 흐름을 그대로 따릅니다. 하지만 운영 원칙은 별개입니다. models guide는 적절한 stable 모델이 있으면 대부분의 production 앱은 stable model ID를 우선하는 편이 낫다고 설명합니다. 실무적으로는 먼저 예제를 그대로 실행해 본 뒤, 필요하면 gemini-2.5-flash 같은 안정적인 모델 문자열로 바꾸는 편이 더 안전합니다.

핵심 요약

- 새 프로젝트라면 Python에서는

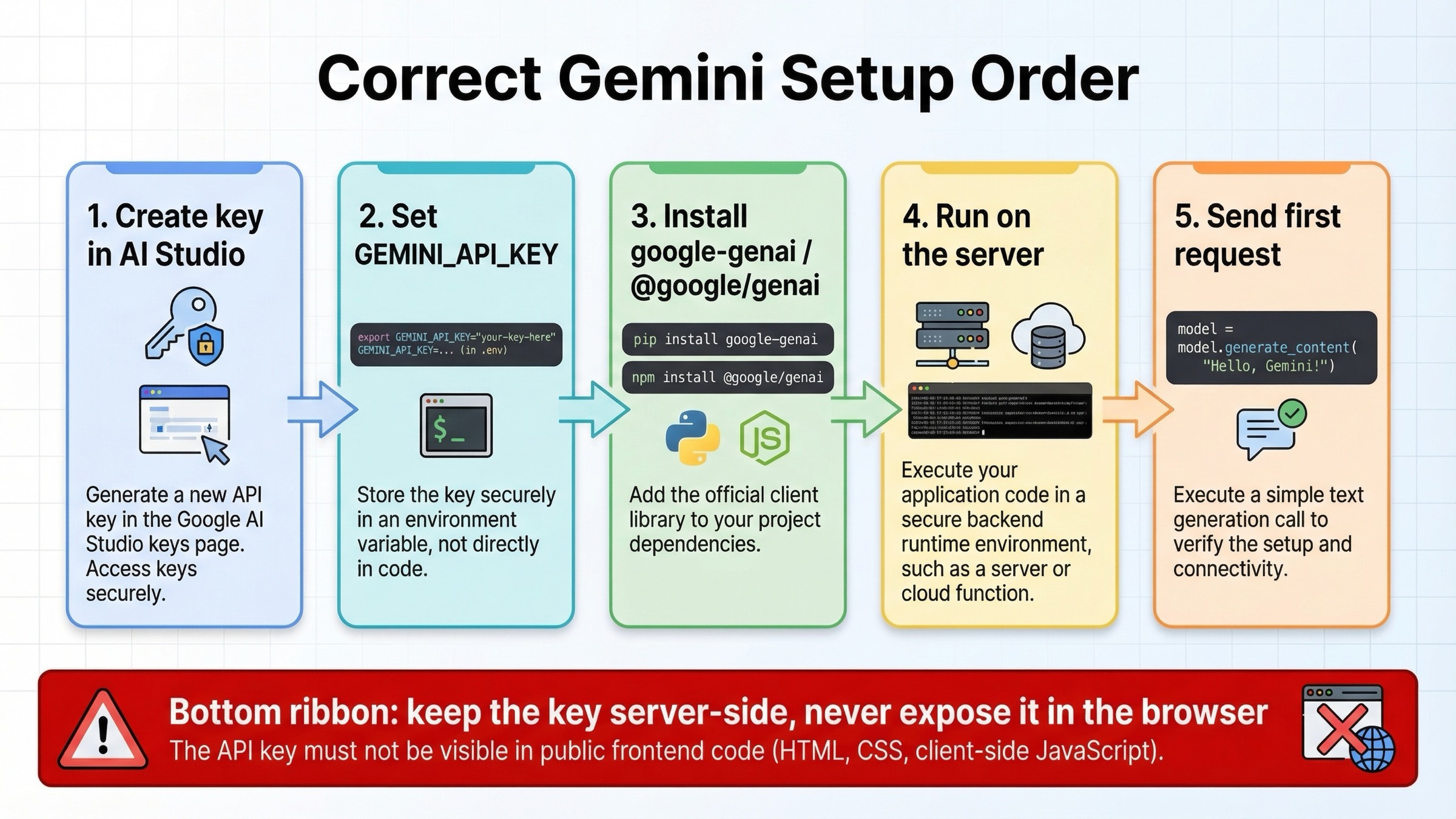

google-genai, JavaScript에서는@google/genai를 쓰는 것이 현재 공식 경로입니다. Google migration guide도 이전 Gemini 라이브러리에서 이 경로로 옮길 것을 권장합니다. - 키는 Google AI Studio 에서 만들고

GEMINI_API_KEY에 저장한 뒤, 브라우저가 아니라 서버, worker, API route, server action 같은 백엔드 실행면에서 호출해야 합니다. - 첫 단계는 네이티브 SDK 요청 하나를 성공시키는 것입니다. 두 번째는 streaming, 세 번째는 structured output이나 function calling처럼 실제 제품에 필요한 기능을 붙이는 것입니다.

- 기존 OpenAI 형태의 코드를 빠르게 옮겨야 한다면 OpenAI compatibility 가 유용합니다. 하지만 Files API 같은 Gemini 고유 기능이 필요해지면 장기적으로는 네이티브 SDK가 더 자연스럽습니다.

- 전체 요청 크기가 100 MB를 넘거나 PDF가 50 MB를 넘으면 Files API로 전환해야 합니다. 공식 문서에는 파일 보관 48시간, 프로젝트당 20 GB, 파일당 2 GB 제한이 적혀 있습니다.

- billing 페이지는 400/500 오류가 과금되지는 않지만 quota는 소비한다고 명시합니다. rate limits 페이지도 실제 제한은 tier에 따라 다르니 AI Studio에서 확인하라고 안내합니다.

| 경로 | 적합한 대상 | 장점 | 주요 비용/제약 |

|---|---|---|---|

| 네이티브 Google GenAI SDK | 새 Python / Node.js 앱 | 현재 패키지, 현재 문서, streaming·structured output·files·tools에 직접 접근 가능 | OpenAI 추상 대신 Gemini 고유 클라이언트 구조를 받아들여야 함 |

| OpenAI 호환 | 기존 OpenAI 스타일 코드베이스 | base URL, API key, model name만 바꿔 빠르게 검증 가능 | Gemini 고유 기능으로 갈수록 추상 손실이 커짐 |

| 순수 REST | 커스텀 언어, 엄격한 의존성 제어, 저수준 디버깅 | 요청 구조를 완전히 통제 가능 | boilerplate와 수동 처리 부담이 큼 |

비용 관점이 더 급하다면 Gemini API 토큰 가격 가이드가 다음 읽을거리로 좋습니다. 이미 400, 429, 500 계열 문제를 보고 있다면 Gemini API 오류 트러블슈팅 가이드로 바로 가는 편이 빠릅니다.

Gemini API 첫 요청을 올바르게 만드는 방법

올바른 시작점은 IDE가 아니라 AI Studio입니다. 현재 Gemini API 키는 Google AI Studio에서 만들고 관리하며, 키는 독립적인 문자열이라기보다 Google Cloud project에 속한 자격 증명으로 다뤄집니다. 신규 사용자는 AI Studio가 기본 project와 key를 자동으로 준비해 주는 경우가 많아서 첫 테스트는 금방 통과합니다. 하지만 그 편의성 때문에 project 소유권, billing, 팀 권한 문제를 너무 늦게 생각하게 되기도 합니다.

실제 코드보다 먼저 고정해야 할 규칙이 하나 있습니다. GEMINI_API_KEY 는 서버에 둬야 한다는 점입니다. 백엔드 서비스라면 환경 변수로 넣고, 웹앱이라면 API route, server route, edge backend, worker 같은 서버 측 경로에서 Gemini를 호출해야 합니다. 브라우저에 영구 키를 넣는 방식은 피해야 합니다. 많은 초반 통합 실패는 모델이 아니라 이 보안 경계에서 시작됩니다.

현재 공식 설치 방법은 다음과 같습니다.

bashpip install -U google-genai npm install @google/genai

그 다음 키를 설정합니다.

bashexport GEMINI_API_KEY="your_real_key_here"

이후 첫 요청은 일부러 단순해야 합니다. function calling, grounding, multimodal files부터 시작할 필요가 없습니다. 첫 요청의 목적은 키, 환경, runtime, 네트워크 경로가 제대로 연결되었는지 확인하는 것입니다.

pythonfrom google import genai client = genai.Client() response = client.models.generate_content( model="gemini-3-flash-preview", contents="Explain the purpose of an API integration tutorial in one sentence." ) print(response.text)

javascriptimport { GoogleGenAI } from "@google/genai"; const ai = new GoogleGenAI({}); const response = await ai.models.generateContent({ model: "gemini-3-flash-preview", contents: "Explain the purpose of an API integration tutorial in one sentence.", }); console.log(response.text);

여기서 중요한 것은 prompt 자체보다 client shape입니다. 새 Google GenAI SDK는 models, chats, files 같은 기능을 하나의 클라이언트 아래에 모읍니다. 오래된 튜토리얼이 지금 읽으면 헷갈리는 이유도 여기 있습니다. 단순히 패키지명이 오래된 것이 아니라, Google이 더 이상 중심 경로로 보지 않는 구조를 가르치고 있기 때문입니다.

2026년에도 유효한 Python 통합 예제

Python은 여전히 Gemini를 가장 편하게 붙일 수 있는 경로 중 하나입니다. 기본 요청도 짧지만, 그 다음으로 빨리 익혀야 할 기능은 streaming입니다. Google text-generation guide에도 generate_content_stream 가 현재 패턴으로 제시되어 있고, 이는 CLI, 내부 도구, 웹 UI, 대화형 워크플로의 체감 속도를 실제로 바꿉니다.

pythonfrom google import genai client = genai.Client() stream = client.models.generate_content_stream( model="gemini-3-flash-preview", contents="Write three short tips for migrating from a legacy LLM SDK." ) for chunk in stream: print(chunk.text, end="")

streaming이 중요한 이유는 Gemini 사용 사례가 꼭 챗봇만은 아니기 때문입니다. 결과를 조금씩 먼저 보여 주기만 해도 사용자 경험이 확 달라집니다. “첫 요청 다음에 뭘 배워야 하나”라는 질문에는 대부분 streaming이 가장 실용적인 첫 답입니다.

두 번째로 빨리 익혀야 할 패턴은 structured output입니다. 공식 structured output 가이드는 Gemini가 JSON Schema를 따를 수 있다고 설명하고, Python SDK는 Pydantic과도 자연스럽게 연결됩니다. 실제 통합에서는 “문단을 써 달라”보다 “다음 시스템이 처리할 수 있는 구조를 반환해 달라”가 훨씬 더 자주 필요합니다.

pythonfrom google import genai from google.genai import types from pydantic import BaseModel class IntegrationTicket(BaseModel): language: str task: str priority: str client = genai.Client() response = client.models.generate_content( model="gemini-3-flash-preview", contents="Python app, needs JSON output, shipping next week.", config=types.GenerateContentConfig( response_mime_type="application/json", response_schema=IntegrationTicket, ), ) print(response.text)

schema를 요청에 직접 넣으면 prompt는 “JSON 형식을 지켜라”를 설득하는 역할에서 벗어나, 실제 의미를 정확하게 뽑아내는 역할로 바뀝니다. 이것이 데모와 프로덕션 통합을 가르는 핵심 차이 중 하나입니다.

Python은 function calling에서도 이점이 있습니다. Google 공식 문서는 type hints와 docstring이 달린 실제 Python 함수를 tool로 넘기면 SDK가 선언, 실행, 응답 순환을 도와준다고 설명합니다. 내부 운영 도구나 가벼운 agent 흐름에서는 이 편의성이 꽤 큽니다.

pythonfrom google import genai from google.genai import types def get_current_temperature(location: str) -> dict: """Gets the current temperature for a given location.""" return {"temperature": 25, "unit": "Celsius"} client = genai.Client() response = client.models.generate_content( model="gemini-3-flash-preview", contents="What's the temperature in Boston?", config=types.GenerateContentConfig(tools=[get_current_temperature]), ) print(response.text)

다만 이 편의성은 Python이 실행 환경의 중심일 때 가장 잘 맞습니다. 여러 언어가 섞이거나 엄격한 감사 경계가 필요하면, 더 명시적인 도구 오케스트레이션이 장기적으로는 낫기도 합니다.

JavaScript와 Node.js 통합 예제

Node.js 쪽도 기본 클라이언트 구조는 비슷하지만, 가장 자주 틀리는 부분은 실행 경계입니다. JavaScript 팀은 프런트엔드와 백엔드를 동시에 다루기 때문에 키, SDK, 페이지 로직을 너무 일찍 한곳에 섞는 경우가 많습니다. 현재 @google/genai 패키지 자체가 문제인 것은 아닙니다. 핵심은 그것을 어디서 실행하느냐입니다. Node 프로세스, API route, server action, edge backend 같은 서버 측 표면에 있어야 합니다.

첫 JavaScript 요청은 다음 형태면 충분합니다.

javascriptimport { GoogleGenAI } from "@google/genai"; const ai = new GoogleGenAI({}); const response = await ai.models.generateContent({ model: "gemini-3-flash-preview", contents: "Give me a one-line summary of why current SDK names matter.", }); console.log(response.text);

그 다음 단계도 역시 streaming입니다.

javascriptimport { GoogleGenAI } from "@google/genai"; const ai = new GoogleGenAI({}); const stream = await ai.models.generateContentStream({ model: "gemini-3-flash-preview", contents: "List three practical steps for hardening an API integration.", }); for await (const chunk of stream) { process.stdout.write(chunk.text ?? ""); }

이 패턴은 Next.js, Express, Nest 같은 JS 백엔드에서 특히 가치가 큽니다. 키는 서버에 남겨 둔 채 스트리밍 응답을 클라이언트에 전달할 수 있기 때문입니다. 사용자 경험은 좋아지고, 비밀키 경계는 유지됩니다. 실제 제품에서 체감되는 차이는 이 단계에서 많이 생깁니다.

JavaScript도 structured output과 function calling을 지원하지만, Python보다 조금 더 명시적인 구성이 많습니다. Google 문서에서는 Zod, functionCallingConfig 같은 형태가 자주 나오고, 이는 TypeScript 팀에게는 오히려 장점일 수 있습니다. 기존 타입 시스템, schema, 서비스 경계와 더 잘 맞기 때문입니다.

또 하나 초기에 붙여 두면 좋은 습관은 토큰 계측입니다. Google token guide는 count-tokens 메서드와 usage metadata를 쓰라고 안내합니다. JS 제품은 system prompt, 대화 이력, RAG 컨텍스트, tool logs가 쉽게 불어나므로, 비용과 한도를 초기에 계량화하는 편이 훨씬 안전합니다.

언제 OpenAI 호환 레이어를 써야 하는가

OpenAI 호환 레이어는 실제로 유용하지만, 만능 해답은 아닙니다. Google 공식 호환 문서를 보면 핵심은 세 가지입니다. base URL을 Gemini 쪽으로 바꾸고, Gemini API key를 쓰고, model name을 바꾸는 것입니다. 이미 OpenAI messages 구조에 맞춰진 내부 서비스나 제품 백엔드가 있다면, Gemini 적합성을 가장 빠르게 검증하는 방법입니다.

pythonfrom openai import OpenAI client = OpenAI( api_key="YOUR_GEMINI_API_KEY", base_url="https://generativelanguage.googleapis.com/v1beta/openai/", ) response = client.chat.completions.create( model="gemini-3-flash-preview", messages=[{"role": "user", "content": "Explain why compatibility layers are useful."}], ) print(response.choices[0].message.content)

이 경로가 매력적인 이유는 팀 전체를 새 client shape로 즉시 재교육하지 않아도 되고, provider 비교나 BYOK 흐름도 기존 OpenAI 추상 위에서 유지하기 쉽기 때문입니다. 빠른 검증이나 급한 마이그레이션이 목표라면 호환 레이어는 꽤 합리적인 선택입니다.

하지만 장기 기본값으로 삼아야 하느냐는 다른 질문입니다. Google 자료를 종합하면 OpenAI compatibility는 migration bridge로는 강하지만, Files API 같은 Gemini 고유 기능을 깊게 쓸수록 번역 계층으로서의 비용이 커집니다. Gemini 특화 surface에 더 의존할수록 네이티브 SDK가 더 자연스럽습니다.

실무 규칙은 단순합니다. 새 앱이면 네이티브, 기존 OpenAI 스타일 코드를 빨리 옮겨야 하면 compatibility. 이 정도면 대부분의 초기 판단은 충분히 정리됩니다.

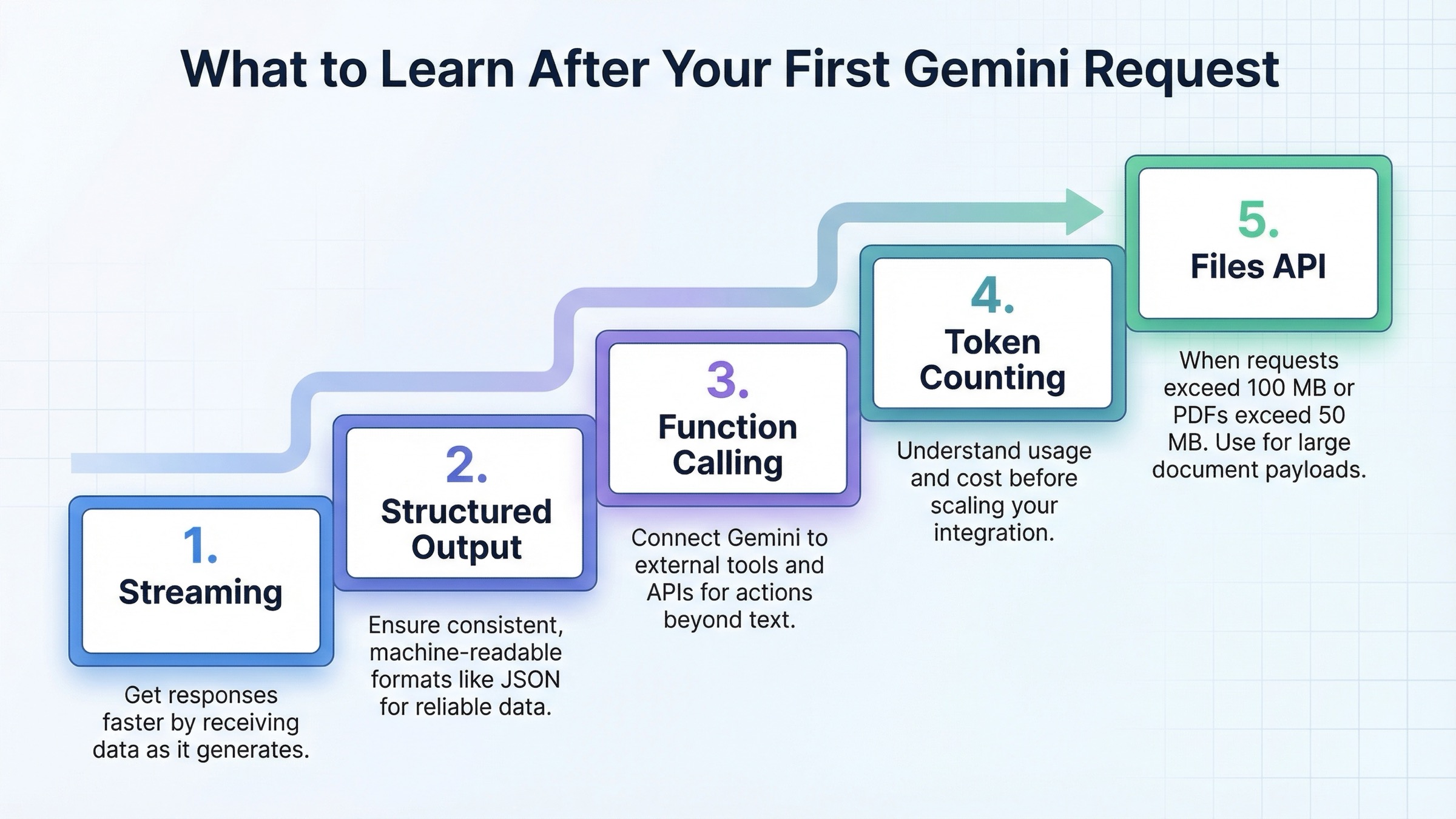

Hello World 다음에 바로 배워야 할 운영 기능

첫 요청이 성공한 뒤 해야 할 일은 Gemini의 모든 기능을 한꺼번에 공부하는 것이 아닙니다. 실제 앱 동작을 바꾸는 소수의 기능을 순서대로 익히는 것입니다. 대부분의 경우 그 순서는 streaming, structured output, function calling, token counting, 그리고 Files API입니다.

streaming은 응답성을 높여 줍니다. structured output은 downstream 자동화를 안전하게 만듭니다. function calling은 Gemini를 여러분의 코드와 외부 시스템에 연결합니다. token counting은 비용과 프롬프트 성장 추이를 미리 보게 해 줍니다. Files API는 입력이 정말 크거나 멀티모달이 될 때 필요합니다. Google Files guide는 총 요청 크기가 100 MB를 넘거나 PDF가 50 MB를 넘으면 Files API를 써야 한다고 설명합니다. 48시간 보관, 프로젝트당 20 GB, 파일당 2 GB라는 조건도 운영 설계에 직접 영향을 줍니다.

javascriptimport { GoogleGenAI, createPartFromUri, createUserContent, } from "@google/genai"; const ai = new GoogleGenAI({}); const myfile = await ai.files.upload({ file: "path/to/sample.mp3", config: { mimeType: "audio/mpeg" }, }); const response = await ai.models.generateContent({ model: "gemini-3-flash-preview", contents: createUserContent([ createPartFromUri(myfile.uri, myfile.mimeType), "Describe this audio clip", ]), }); console.log(response.text);

Files API는 필요할 때만 쓰면 됩니다. 작은 텍스트 요청이라면 가장 단순한 호출이 여전히 가장 좋은 호출입니다. 다만 대용량 첨부나 멀티모달 입력이 필요해지는 순간, 파일 수명 주기와 크기 제한은 선택 지식이 아니라 필수 지식이 됩니다.

| 기능 | 언제 배울까 | 중요한 이유 | 공식 기준 |

|---|---|---|---|

| Streaming | 첫 성공 직후 | 체감 지연을 줄이고 대화형 UX를 개선함 | Text generation |

| Structured output | 다른 서비스가 Gemini 출력에 의존하기 시작할 때 | 깨지기 쉬운 JSON 파싱을 줄이고 자동화를 안정화함 | Structured outputs |

| Function calling | Gemini가 앱 로직이나 도구를 호출해야 할 때 | agent형 흐름을 현실적으로 만듦 | Function calling |

| Token counting | 본격 트래픽 전에 | 프롬프트 성장과 비용을 조기 측정 가능 | Token counting |

| Files API | 요청이 100 MB 초과, PDF가 50 MB 초과일 때 | 대형 멀티모달 입력을 깨끗하게 처리 가능 | Files API |

이 순서가 중요한 이유는, 약한 튜토리얼이 두 극단으로 가기 쉽기 때문입니다. 간단한 텍스트 요청에서 멈추거나, 반대로 모든 기능을 한꺼번에 보여 주거나. 실제 팀에 도움이 되는 것은 그 중간입니다. 하나의 안정적인 요청을 만들고, 운영 결과를 바꾸는 기능만 순서대로 추가하는 방식입니다.

자주 겪는 통합 실수와 트러블슈팅

가장 흔한 실수는 잘못된 튜토리얼에서 출발하는 것입니다. google-generativeai 나 @google/generative-ai 가 현재 기본 경로처럼 보인다면, 바로 Google migration guide와 교차 확인하는 편이 좋습니다. 예전 예제가 완전히 쓸모없다는 뜻은 아니지만, 2026년 기준 새 통합의 가장 깔끔한 출발점은 아닙니다.

두 번째 실수는 preview 모델 ID를 안정 계약처럼 보는 것입니다. Google models guide도 preview 모델은 production에서 쓸 수 있지만 제한이 더 엄격하거나 deprecation 위험이 크다고 설명합니다. preview를 무조건 피하라는 뜻이 아니라, 왜 그 모델을 쓰는지 알고 나중에 model ID를 교체할 계획을 가져야 한다는 뜻입니다. 최신 preview 전용 기능이 꼭 필요하지 않다면 stable 모델이 더 안전한 경우가 많습니다.

세 번째 실수는 quota와 billing을 오해하는 것입니다. Google billing page는 input tokens, output tokens, cached token count, cached token storage duration이 과금 대상이라고 설명합니다. 동시에 400/500 오류는 과금되지 않더라도 quota는 소비한다고 적어 둡니다. 즉 “청구되지 않았다”는 말은 “완전히 공짜였다”와 같은 뜻이 아닙니다. 실패 요청도 프로젝트 capacity는 태웁니다.

이 점은 429에서 특히 중요합니다. rate-limit docs와 커뮤니티 사례를 보면, 눈에 보이는 RPM보다 한참 낮은데도 enqueued token, project mismatch, free-tier exhaustion, preview 모델 수용 한계 같은 문제에 걸릴 수 있습니다. 따라서 429를 만나면 exponential backoff만 강화하기 전에 어떤 제한에 걸린 것인지 먼저 확인해야 합니다. 더 넓은 오류 지도가 필요하다면 Gemini API 오류 트러블슈팅 가이드를 참고하면 됩니다.

마지막 흔한 실수는 통합 첫 주에 너무 많은 것을 한꺼번에 넣는 것입니다. streaming, tools, files, structured output, cache, chat history를 모두 첫날부터 넣을 필요는 없습니다. 필요한 것은 서버 측에서 성공한 요청 하나, 비밀키 경계 하나, 그리고 제품에 정말 필요한 다음 기능 하나입니다. 이 순서를 지키는 팀이 대개 더 빨리 안정적인 엔드포인트에 도달합니다.

결국 운영 규칙은 한 줄로 요약됩니다. 네이티브로 시작하고, 키는 서버에 두고, 토큰은 초기에 측정하고, 기능 추가는 실제 제품 요구가 나왔을 때만 하라. 이 원칙이 대개 거대한 샘플 모음보다 더 많은 문제를 막아 줍니다.