ByteDance LatentSyncは使えるモデルだが、ひとつの公式サービスとして扱うと判断を誤る。最初に決めるべきことは、コードと重みをどこで確認し、推論をどこで動かし、動画と音声を誰に渡し、失敗時の料金や削除を誰が扱うのかという実行場所の責任である。

実写の顔、声、顧客素材、未公開の社内動画を扱うなら、まずByteDanceのGitHubリポジトリとHugging Faceの重みで出所を確認する。GPUと運用体制があるならローカル実行が安全寄りになる。GPUがなく短い検証をしたい場合はHosted APIが速いが、その場合も提供者の料金、入力制限、保存、削除、サポートを確認してから素材を渡す必要がある。

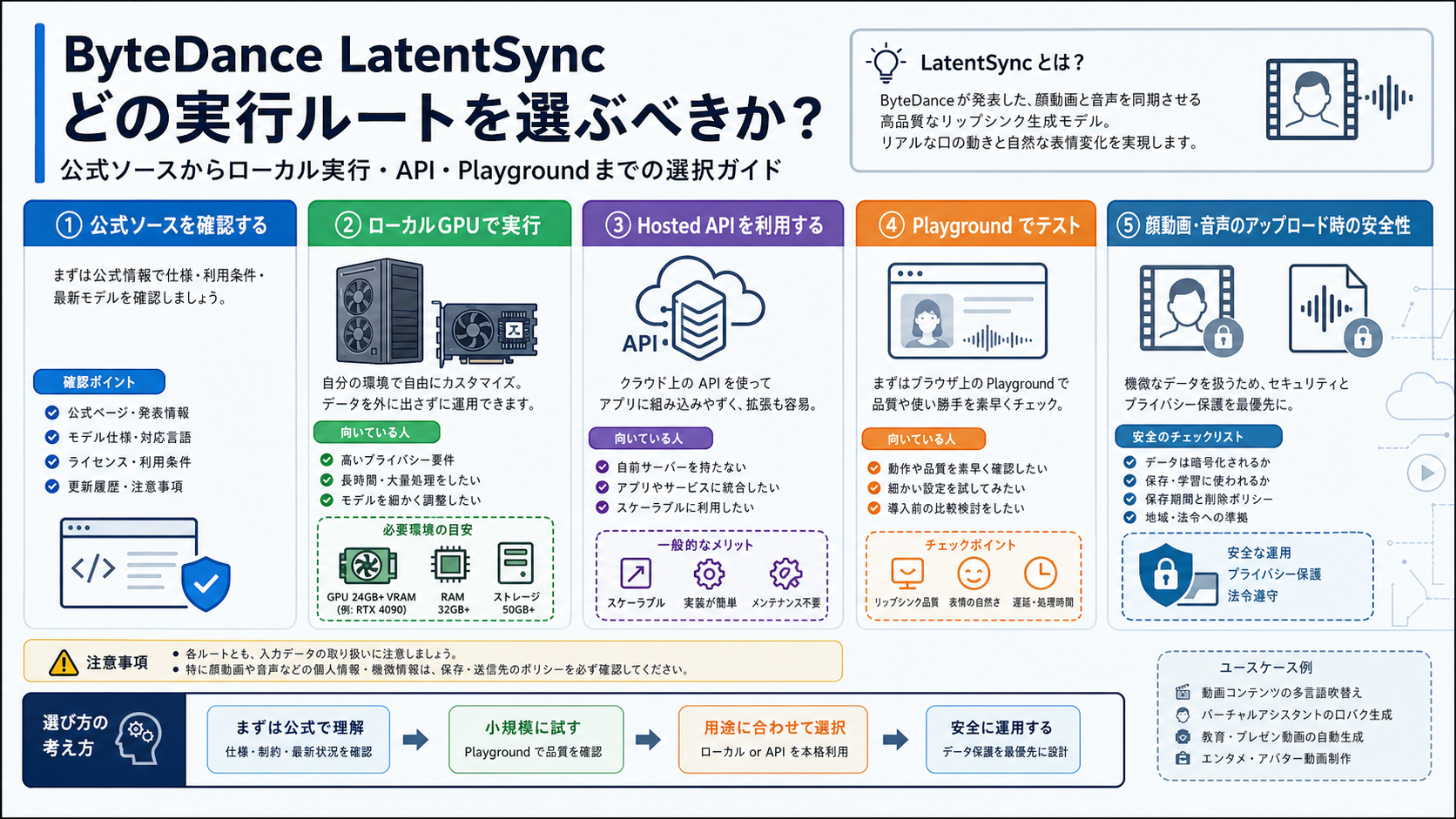

実行ルートを先に決める

LatentSyncの仕事は、元動画と目標音声を受け取り、映像内の口の動きを音声に合わせることだ。操作としては動画と音声を入れるだけに見えても、入口ごとに責任範囲はまったく違う。

| ルート | 向いている用途 | 先に確認すること | 思い込まないこと |

|---|---|---|---|

| 公式ソース | コード、重み、論文、バージョンを確認したい | GitHub bytedance/LatentSync、Hugging Face ByteDance/LatentSync-1.6、arXiv 2412.09262 | 上位に出るラッパーサイトが公式とは限らない |

| ローカル実行 | GPUがあり、ファイルを自分の環境で管理したい | VRAM、重みの版、setup script、GradioまたはCLI | 新しい版がすべてのPCに最適とは限らない |

| Hosted API | GPUなしでAPI実行したい | 入力フィールド、課金主体、長さ制限、保存、失敗時の扱い | falやReplicateがByteDance公式APIとは限らない |

| Playground | ダミー素材で流れだけ見たい | 運営者、モデル出所、アップロード規約 | 無料フォームが実写の顔や声に安全とは限らない |

この分け方を先に置くと、障害の切り分けが楽になる。ローカルの失敗はPython環境、CUDA、checkpoint、VRAM、動画形式、音声形式に寄る。Hosted APIの失敗は提供者のqueue、URLの到達性、パラメータ名、billing、output URIに寄る。Playgroundは、運営者がモデル出所や保存規則を示していなければ、失敗理由を十分に追えない。

ByteDanceという名前とAPIという語が並ぶと、公式の公開APIがあるように見えることがある。しかし、確認できる範囲では公式の主軸はオープンソースのコード、重み、論文であり、公開のAPI実行は主に第三者提供者のサービスとして扱うべきである。

LatentSyncは汎用動画生成ではない

LatentSyncはtext-to-videoモデルではなく、デジタルヒューマン制作全体を置き換えるものでもない。既存の動画に対して、別の音声に合わせて口元を同期させるlip-syncモデルである。顔の大きさ、口元の見え方、照明、ブレ、音声の明瞭さ、動画の長さによって結果は変わる。

公式論文はTaming Stable Diffusion for Lip Syncで、arXiv 2412.09262と結びついている。手法としてはaudio-conditioned latent diffusionを使い、Whisper由来の音声特徴、U-Net cross-attention、SyncNet系の監督、StableSyncNetとTREPAによる時間一貫性の工夫が入る。実務では、この詳細は境界を理解するために重要だ。LatentSyncは既存動画の口の動きを音声に合わせるモデルであり、テキストから場面全体を作るモデルではない。

この境界は安全判断にも直結する。リップシンクは顔と声を同時に扱うため、視聴者には「本人がその言葉を話した」ように見える可能性がある。技術的に動いたとしても、本人同意、素材権利、公開範囲、クライアントの承認がなければ、本番素材を外部サービスへ送るべきではない。

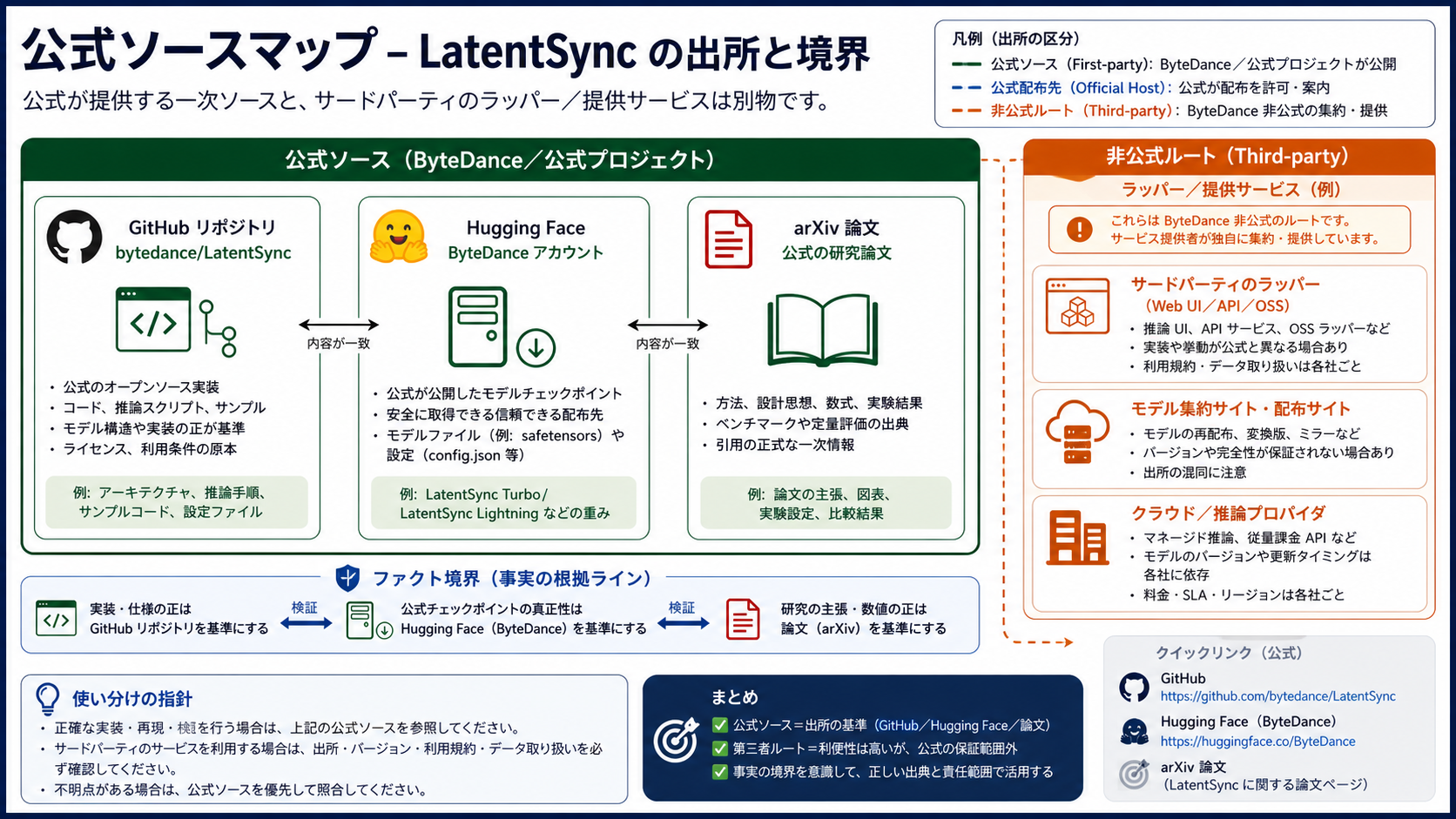

公式ソースはGitHub、Hugging Face、arXivに分ける

出所確認では、LatentSyncと書かれたページをひとつ見て終わらせない。GitHub、Hugging Face、arXivはそれぞれ別の役割を持つ。

GitHub bytedance/LatentSyncはコードの基準点だ。プロジェクト構成、README、セットアップ方法、推論スクリプト、更新履歴、license metadataを確認できる。2026年5月17日の確認では、ownerはByteDance、主な言語はPython、コード側のlicense metadataはApache-2.0、GitHub Releasesは版管理の中心ではなかった。したがって、版の確認はReleasesだけではなくREADMEの更新記録とcheckpoint参照を見る必要がある。

Hugging Faceは重みの基準点だ。ByteDance/LatentSync-1.6にはlatentsync_unet.pt、stable_syncnet.pt、whisper/tiny.ptなどのファイルがあり、古いByteDance/LatentSyncも以前の重みや関連Spacesの入口として残る。Hugging Faceのmodel card metadataはopenrail++を示すため、コードがApache-2.0だから重みも同じ条件だとまとめてはいけない。コード、重み、入力素材、出力利用は別々に確認する。

arXivは方法の基準点だ。論文はモデルの仕組みや適用境界を理解する助けになるが、実行ルートではない。インストールと版の事実はGitHub、重みの事実はHugging Face、提供者ごとの挙動は各Hosted APIのページで確認する。

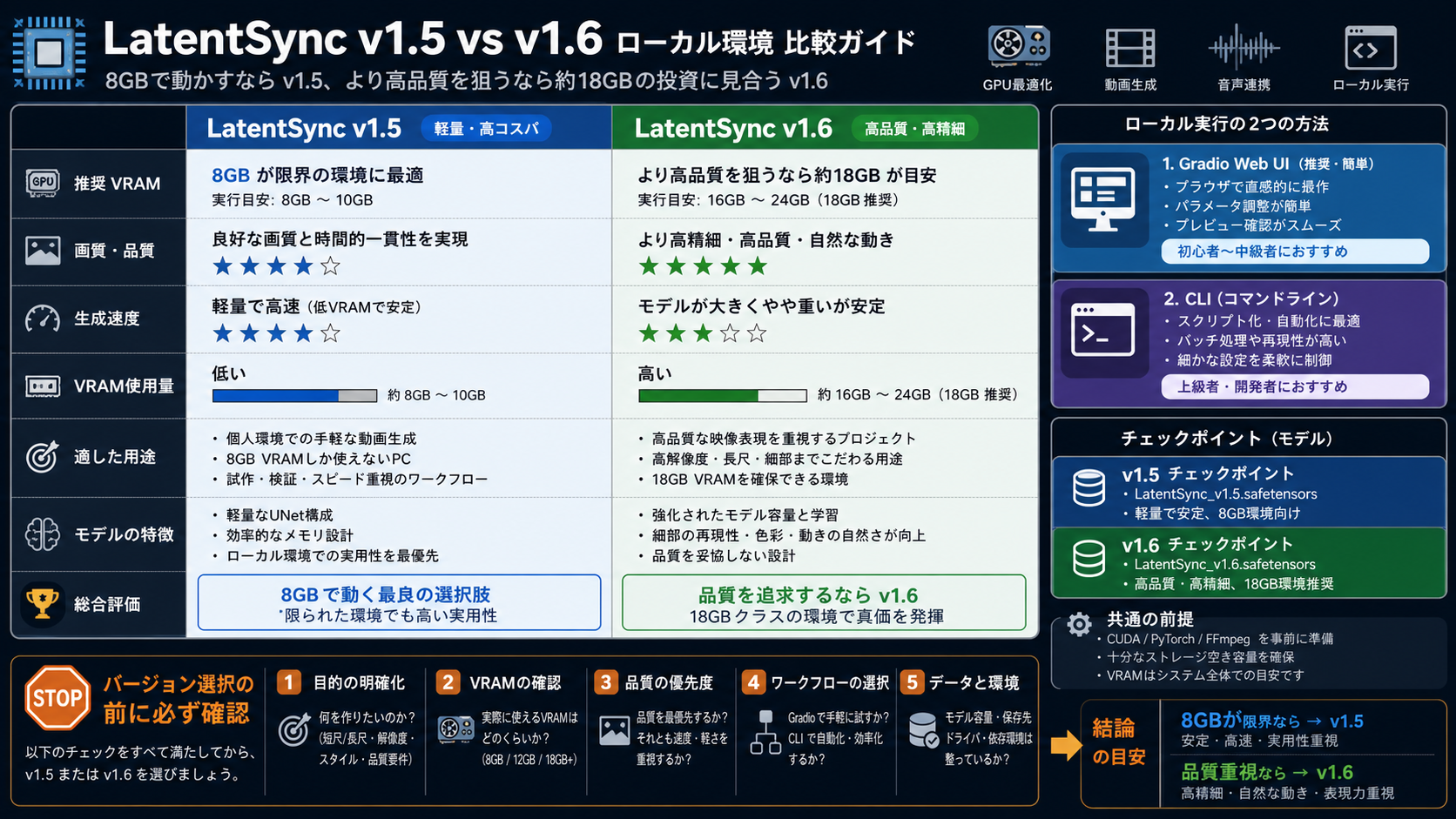

v1.5とv1.6はVRAMから選ぶ

ローカル実行では、最新版という理由だけでv1.6を選ばない。READMEの推論要件では、LatentSync 1.5は少なくとも8 GB VRAM、LatentSync 1.6は少なくとも18 GB VRAMが必要とされる。多くの手元GPUでは、この差が最初の分岐になる。

v1.6の目的は品質側にある。2025年6月11日の更新では、512x512 videosで学習し、blurを軽減する意図が示されている。v1.5の2025年3月14日の更新では、temporal consistency、中国語動画での性能、stage-two training VRAMの改善が説明されている。つまり、v1.5は低めのVRAMで現実的に試しやすく、v1.6は十分なGPUがあり、ブレ低減の価値がある時に試す候補となる。

最初のローカル検証は短くする。短いsource video、短いtarget audio、選んだcheckpoint、十分なVRAM、明確なoutput pathだけでよい。最初の目的は本番品質の長尺クリップではなく、環境が起動し、重みが読み込まれ、入力形式が受け付けられ、結果が書き出されることを確認することだ。

どちらの版も手元環境に合わないなら、CUDAの再構築に時間を使い続ける前に止まる。権利上安全な短い素材でHosted APIを試し、結果と運用条件が合うかを確認してから、ローカルGPUやクラウドGPUへの投資を考える。

ファイル管理が重要ならローカル実行を選ぶ

ローカル実行の利点は、より公式らしく見えることではなく、ファイル、ログ、版、依存関係を自分で管理できることにある。社内素材、クライアント素材、公開前の動画、同意確認が必要な音声を扱う場合、この管理権は大きい。

公式READMEのローカル実行は次の形から始まる。

bashgit clone https://github.com/bytedance/LatentSync.git cd LatentSync source setup_env.sh python gradio_app.py

スクリプト実行では./inference.shも使える。最初から長尺動画や大量のバッチを流さず、短い動画と短い音声で、codec、audio format、checkpoint path、VRAM、output directoryを確認する。動作が安定した後に、分割処理、バッチ処理、キュー、クラウドGPUを検討する。

ローカル実行にも負担はある。依存関係のずれ、CUDAの相性、重みダウンロード、ディスク容量、長尺動画の前処理、失敗時の一時ファイル削除は自分で見る必要がある。プライバシーや再現性が重要なら妥当な負担だが、一度だけの低リスクデモなら重すぎる場合がある。

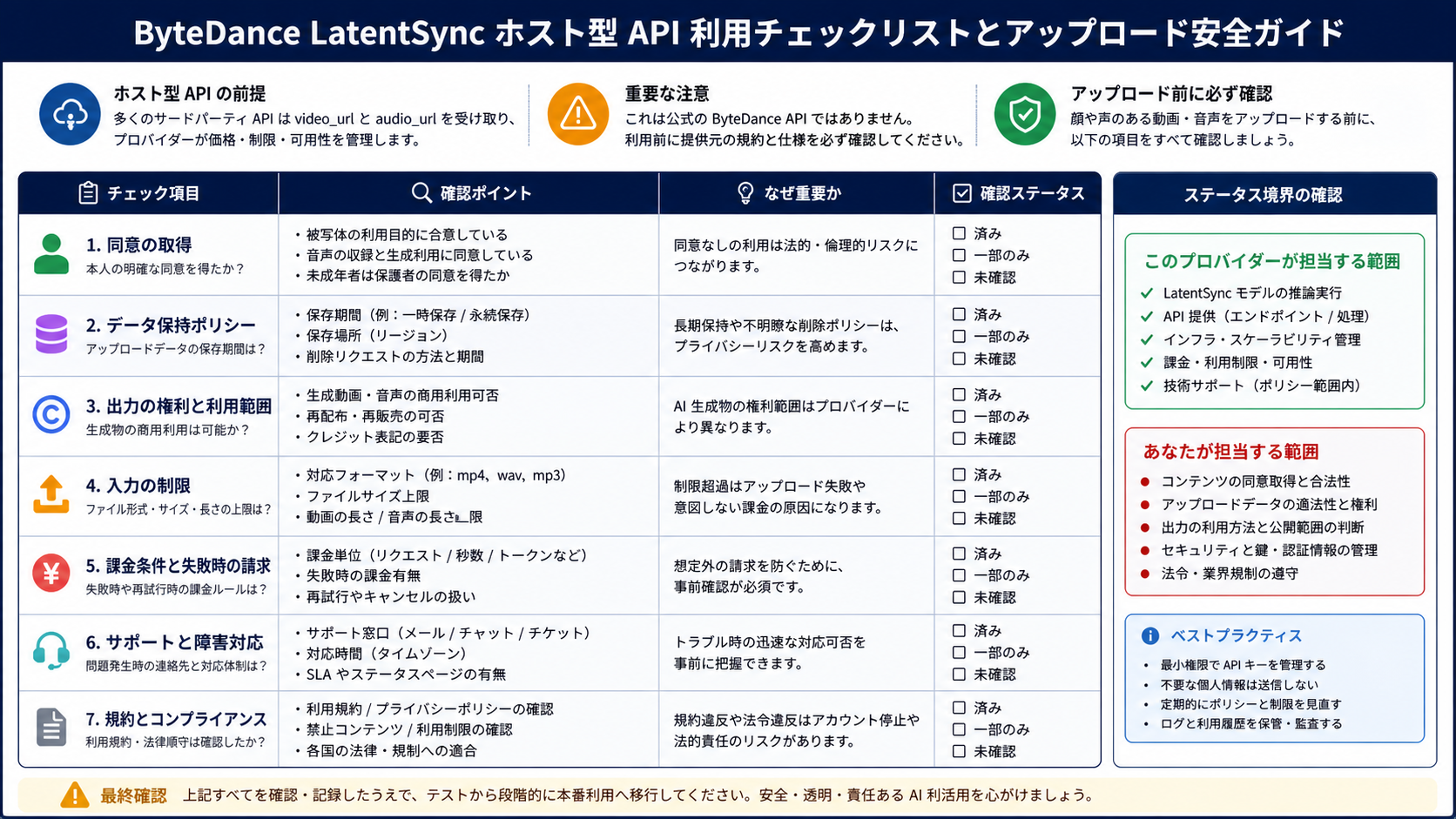

Hosted APIは提供者の契約として扱う

Hosted APIはGPUと環境構築を省ける便利な入口だが、それ自体がByteDance公式APIであることを意味しない。提供者がendpoint、queue、billing、storage、limits、response schema、supportを管理する。

2026年5月17日の確認では、falはfal-ai/latentsyncルートを示し、endpointはhttps://fal.run/fal-ai/latentsyncだった。必須入力はvideo_urlとaudio_urlで、任意入力にはguidance_scale、seed、loop_modeが含まれていた。同じ証拠では、40秒以内は\$0.20、それ以降は\$0.005/secという価格も示されていた。これはfalが所有する価格であり、ByteDanceの価 格ではない。

Replicateはbytedance/latentsyncルートを示し、入力はvideoとaudio、追加でguidance_scaleとseedを使う。出力はURIとして返る。説明ではmp4動画、mp3、aac、wav、m4aなどの音声形式が扱われていた。ただし同じ証拠で現在価格を安定確認していないため、見積もりにはReplicate側の最新価格確認が必要になる。

| Hosted route | 確認した入力 | 向いている用途 | 本番前の確認 |

|---|---|---|---|

fal fal-ai/latentsync | video_url、audio_url | URLで渡せる短いAPI検証 | 価格日付、URL privacy、最大長、失敗時課金、retention |

Replicate bytedance/latentsync | video、audio | Replicate上でのhosted inference | 現在価格、queue、file limits、output retention、support |

| Wrapper playground | サイトごとに異なる | ダミー素材の手動テスト | 運営者、モデル出所、削除規則、アカウント条件 |

Hosted APIを使う理由は、公式度が上がるからではなく、GPU運用を提供者へ移せるからだ。低リスク素材で、提供者の条件が明確で、失敗時の扱いも納得できるなら有効である。実写の顔や声を扱う場合は、便利さより先に保存と削除を確認する。

実写素材をアップロードする前の停止条件

LatentSyncの入力は、顔の動画と声の音声という強い個人性を持つ組み合わせだ。成功した出力ほど、本人が発話したように見える。だから、アップロード前に止める条件を決めておく必要がある。

| 確認項目 | なぜ必要か | 止める条件 |

|---|---|---|

| 同意 | 本人が話したように見える出力を作れる | 顔、声、用途の許可がない |

| ファイル保存 | 入力、出力、ログ、URLが保存される可能性がある | 保存、削除、アクセス範囲が不明 |

| 権利 | コード、重み、素材、出力は別の条件を持つ | 商用利用や公開範囲が説明できない |

| 入力制限 | 長尺や非対応形式は別の失敗を起こす | 長さ、サイズ、形式の境界がない |

| 失敗時課金 | retryやpartial failureでも料金が発生し得る | 課金、返金、再実行の扱いが不明 |

| サポート | 本番障害には追跡可能な連絡先が必要 | docs、issue、ticket、contactがない |

社内テストでは合成素材や明示許可済みの短い素材を使う。クライアント作業では、route owner、model version、source media、consent basis、upload destination、output path、deletion plan、reviewerを記録する。これがないと、品質、請求、権利確認のどれも後から追いにくくなる。

実務での選び方

公式性を確認したいならGitHubとHugging Faceから始める。ファイルを外に出せないならローカル実行を選ぶ。GPUを持たず短い検証をしたいならHosted APIを選ぶ。単に流れを見たいだけならPlaygroundにダミー素材を使う。

| 優先すること | 最初の入口 | 理由 |

|---|---|---|

| 公式の確認 | GitHubとHugging Face | ByteDance側の事実と第三者の表示を分けられる |

| 非公開ファイル | ローカルv1.5またはv1.6 | 入力を自分の環境に置ける |

| GPUなし実行 | Hosted API | 推論運用を提供者に任せられる |

| 低リスクな試用 | ダミー素材のPlayground | 入出力の形だけ確認できる |

| 本番運用 | ローカルまたは条件が明確な提供者 | logs、limits、retry、retention、supportが必要 |

ひとつの万能な答えはない。素材が敏感ならローカル、GPUがなければ条件の明確なHosted API、まだ価値検証段階ならダミー素材のPlaygroundで十分な場合もある。大事なのは、リンクの見た目ではなく、素材、ハードウェア、リスク、実行責任が合っていることだ。

よくある質問

LatentSyncはByteDance公式のプロジェクトですか?

はい。公式のopen-source基準点はGitHub bytedance/LatentSyncで、ByteDanceはHugging Faceの重みルートも維持している。ラッパーサイトや提供者ページは役に立つことがあるが、別途証拠がない限り独立した実行入口として扱う。

ByteDanceの公式LatentSync APIはありますか?

確認済みの範囲では、ByteDanceが直接運営する公開LatentSync APIは見つかっていない。falやReplicateは第三者のHosted APIとして説明し、ByteDance公式APIとは分ける。

ローカルではv1.5とv1.6のどちらを使うべきですか?

まずVRAMを見る。8 GB VRAM付近ならv1.5で短い検証を始める。18 GB VRAM程度を確保でき、blur低減が重要ならv1.6を試す。どちらも厳しい場合は、権利上安全な素材でHosted APIを確認する。

GitHubのコードとHugging Faceの重みは同じライセンスですか?

同じとは限らない。GitHub側のコードlicense metadataはApache-2.0だが、Hugging Faceのmodel card metadataはopenrail++を示す。商用利用、再配布、顧客納品では両方を確認する。

無料Playgroundに実写動画を入れてよいですか?

運営者、モデル出所、保存、削除、アカウント、出力権利、サポートが明確でないなら避ける。無料フォームはダミー素材で流れを見る用途に止める。

本番では何を記録すべきですか?

route owner、model versionまたはprovider model name、source media、consent basis、upload destination、output URIまたはfile path、failure/retry reason、billing owner、retention/deletion policyを残す。後で品質、料金、権利を確認するための最低限の記録になる。