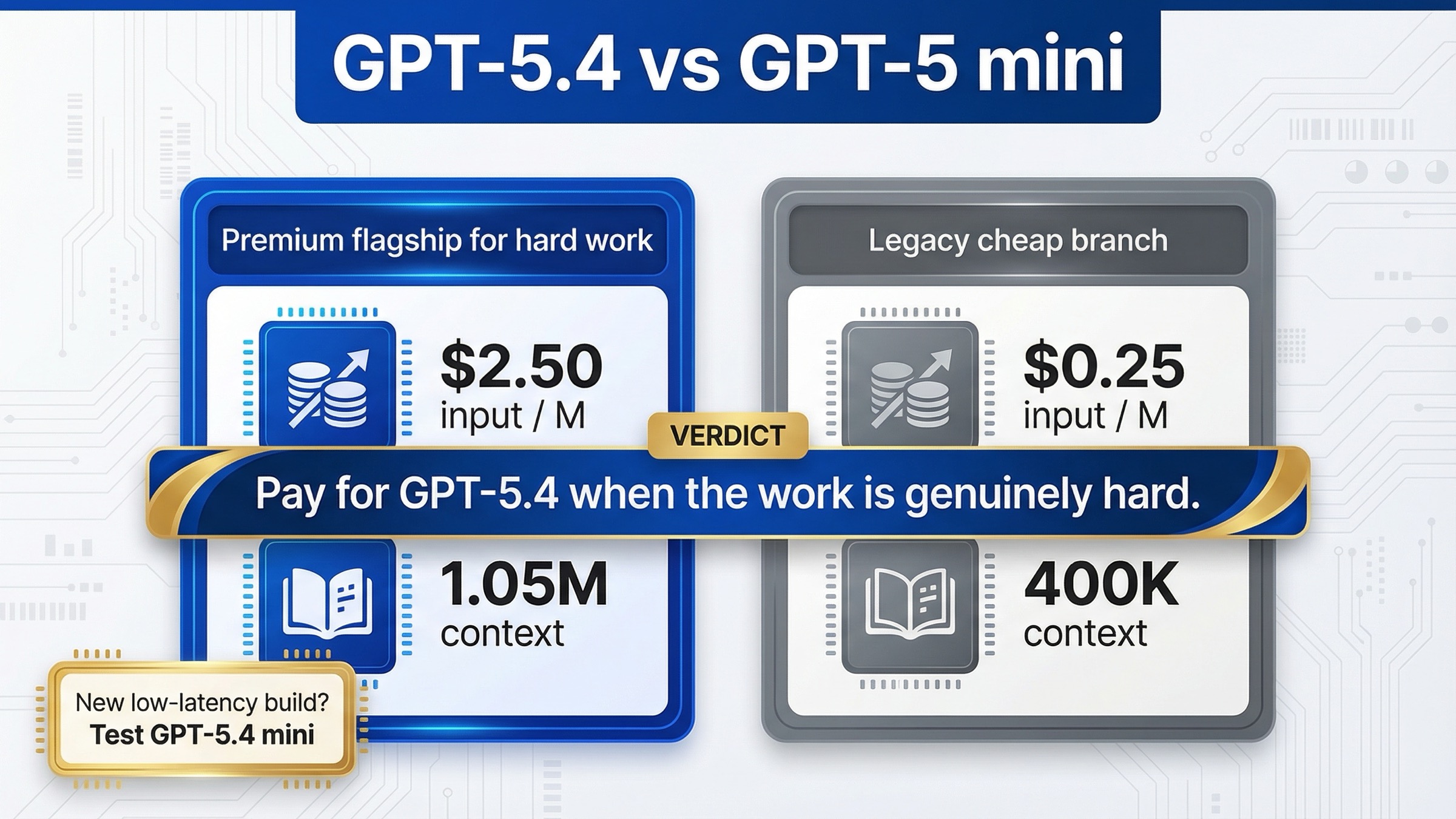

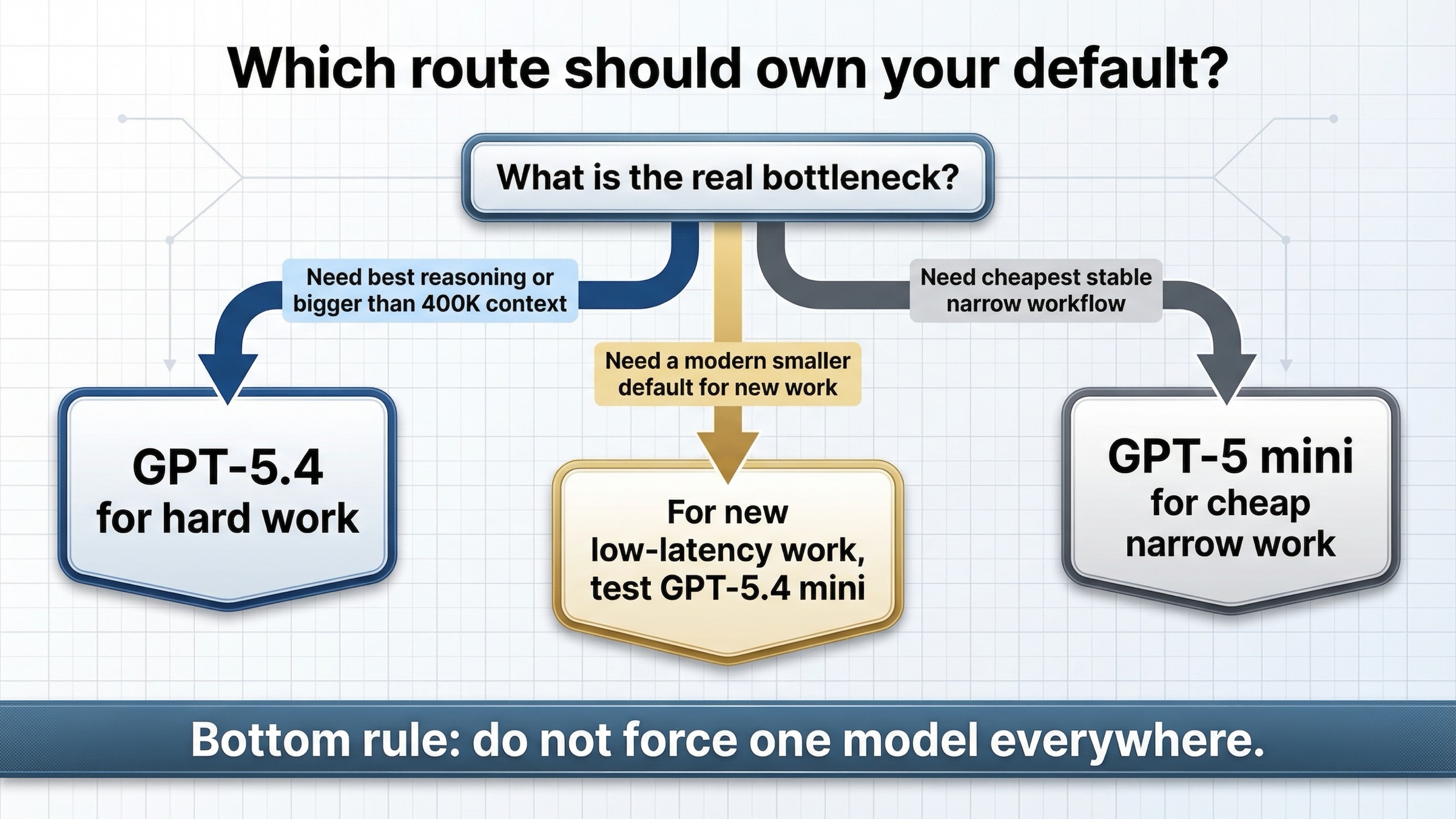

仕事が十分に難しく、強い reasoning、少ない retries、より信頼できる agent behavior のほうが価格より重要なら GPT-5.4 を選ぶべきです。GPT-5 mini を選ぶ理由があるのは、workload が安定していて tool 依存が浅く、cost gap が本当に予算に効く場合だけです。

大事な前提は、GPT-5 mini がもう新規 build の modern small-model default ではないことです。今の位置付けは cheaper older lane であり、OpenAI が professional API と coding work の serious default として置いているのは GPT-5.4 です。

要点まとめ

| モデル | 向いている用途 | 選ぶ理由 | 主な代償 |

|---|---|---|---|

| GPT-5.4 | 難しい coding、長い repo 文脈、ツールを伴う agent、失敗コストの高い出力 | 1,050,000 context、2025-08-31 cutoff、広い tool surface、強い公式 benchmark | 高価: $2.50 input / $15 output |

| GPT-5 mini | 低コストの安定したテキスト処理、単純な構造化生成、レガシーな budget route | $0.25 input / $2.00 output と非常に安い | 400,000 context、2024-05-31 cutoff、ツール面がかなり狭い |

一行で覚えるならこうです。失敗が高くつく、やり直しが痛い、長文脈が本質、またはツール面が製品価値を左右するなら GPT-5.4。作業が十分に狭く、余剰能力にお金を払うだけになるなら GPT-5 mini。

もう一つ大事なのは、新しい low-latency 系システムの小さい default を探しているなら、この比較だけで止めないことです。今の OpenAI の製品ツリーでは、安い現代ルートとしてまず見るべきなのは GPT-5 mini ではなく GPT-5.4 vs GPT-5.4 mini です。

なぜこの比較は見た目より複雑なのか

検索結果の多くは、このキーワードを「フラッグシップ対 mini」という普通の対決に見せかけます。価格と context window を並べて、あとは“高い方が強い、安い方が軽い”で終わらせてしまうページが多いです。しかし、2026年の実際の製品構造はもう少し複雑です。

公式の GPT-5.4 ページ では、GPT-5.4 は coding、agentic workflow、professional work の主力として位置付けられています。一方の GPT-5 mini ページ は、依然として速くて安い小型モデルとして紹介されるものの、同じページの中で「新規の低遅延・高ボリューム案件は GPT-5.4 mini から始めるべき」と明示しています。

つまり、今この比較をする人は、たいてい次のどれかを考えています。

- プレミアム flagship に払う価値があるのか。

- 既存の GPT-5 mini deployment を維持してよいのか。

- 新規構築で古い cheap branch を飛ばして新 mini 系列へ移るべきか。

今の SERP が薄く見える理由もここにあります。公式ページは数字をくれますが、チームが本当に必要としている判断、つまり GPT-5.4 を default にするのか、GPT-5 mini を残すのか、それとも cheap lane を GPT-5.4 mini に移すのか までは、まだ十分に説明していません。

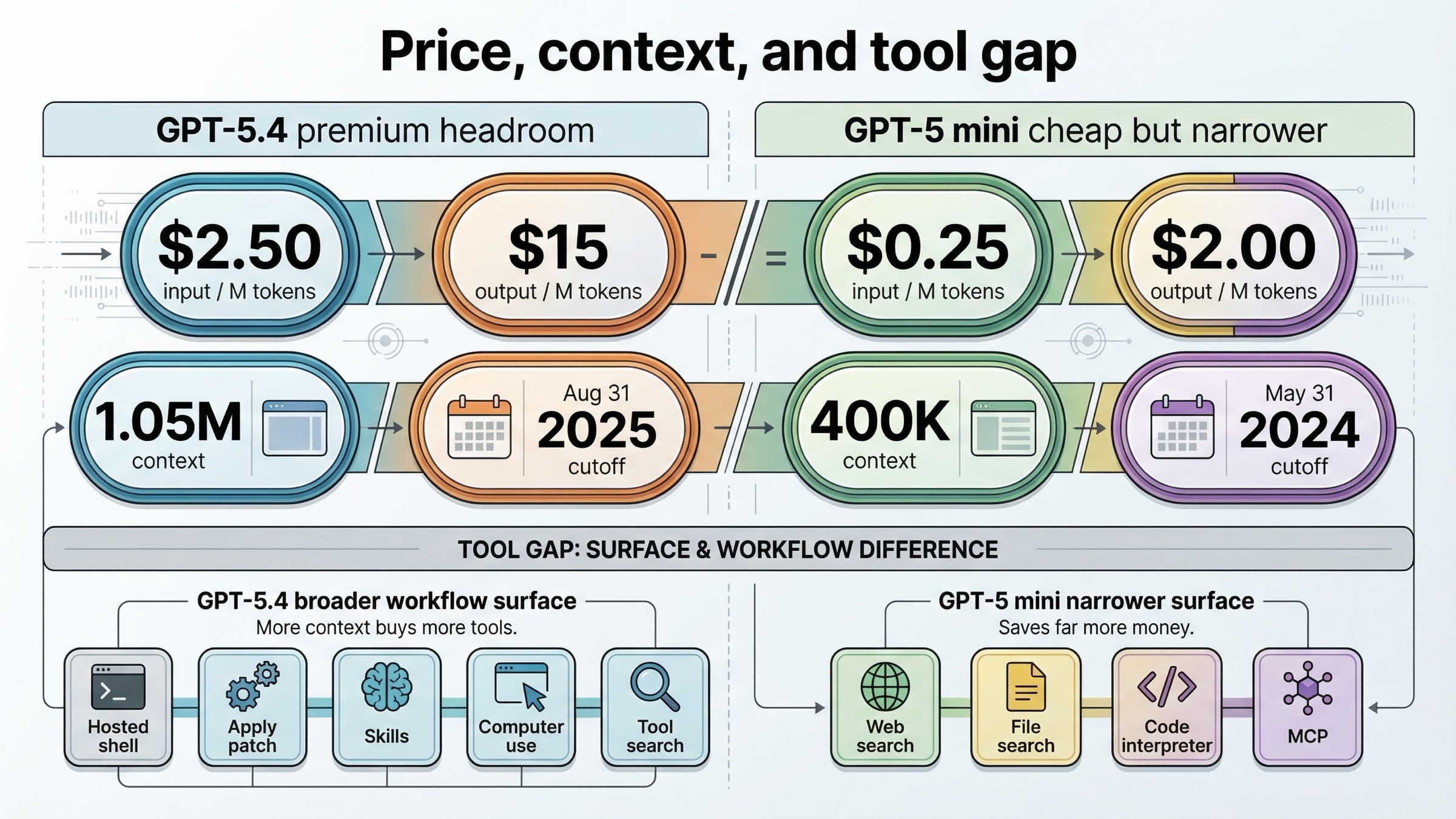

価格・コンテキストウィンドウ・ツール対応を横並びで見る

まず価格差です。現在の GPT-5.4 ページ によると、GPT-5.4 は $2.50 / 1M input tokens、$0.25 / 1M cached input tokens、$15.00 / 1M output tokens。現在の GPT-5 mini ページ では、GPT-5 mini は $0.25 / 1M input、$0.025 / 1M cached input、$2.00 / 1M output です。

つまり GPT-5.4 は、現時点で input で10倍、cached input でも10倍、output で7.5倍 高いことになります。もし workload の中心が大量の単純 prompt で、品質上限をほとんど使わないなら、この価格差は本当に効いてきます。これが GPT-5 mini を production に残す最大の理由です。

ただし能力差も大きいです。GPT-5.4 は 1,050,000 context、128,000 max output、2025年8月31日 cutoff。GPT-5 mini は 400,000 context、同じ 128,000 max output、2024年5月31日 cutoff。2025年以降のライブラリや API 変更、大規模な repo や長文書束を扱うなら、この差はかなり実務に効きます。

さらに大きいのはツール面です。GPT-5.4 には web search、file search、image generation、code interpreter、hosted shell、apply patch、skills、computer use、MCP、tool search、distillation が列挙されています。GPT-5 mini は web search、file search、code interpreter、MCP は維持していますが、hosted shell や apply patch、computer use などの広い agent surface は出てきません。

つまりこの比較は、単なる「強いモデル対安いモデル」ではなく、豊かな workflow surface を持つモデル対、狭い workflow surface に留まるモデルの比較でもあります。shell、patch、tool routing、UI 操作のいずれかが絡むなら、価格だけでは決められません。

公式ポジショニングとベンチマークが実際に示していること

公式のメッセージは、現在の docs と launch page を合わせるとかなり明確です。

2026年3月5日 の GPT-5.4 launch page では、GPT-5.4 は professional work 向けの最も capable で efficient な frontier model として説明されています。reasoning、coding、agentic workflows を一つのモデルにまとめ、native computer use を備え、1M tokens の context をサポートすると書かれています。これはニッチな upgrade の語り方ではなく、「今後の主線 default」の語り方です。

続く 2026年3月17日 の GPT-5.4 mini and nano launch page は、小型分岐の意味をさらにはっきりさせます。GPT-5.4 mini は GPT-5 mini より coding、reasoning、multimodal understanding、tool use で優れており、しかも 2倍以上高速と説明されています。さらに、GPT-5.4 は planning と final judgment、GPT-5.4 mini は narrower parallel tasks という routing パターンまで書かれています。

これは GPT-5 mini が不要だと言っているわけではありません。そうではなく、OpenAI が未来の small-model architecture を説明するときに使っている主役は、もはや GPT-5 mini ではなく GPT-5.4 mini だ、ということです。

現在の latest-model guide も同じ方向を示しています。GPT-5.4 は GPT-4.1 replacement として、GPT-5.4 mini は o4-mini や gpt-4.1-mini replacement として勧められています。cheap lane を探しているときでさえ、推奨される移行先は GPT-5 系全体ではなく GPT-5.4 系列です。

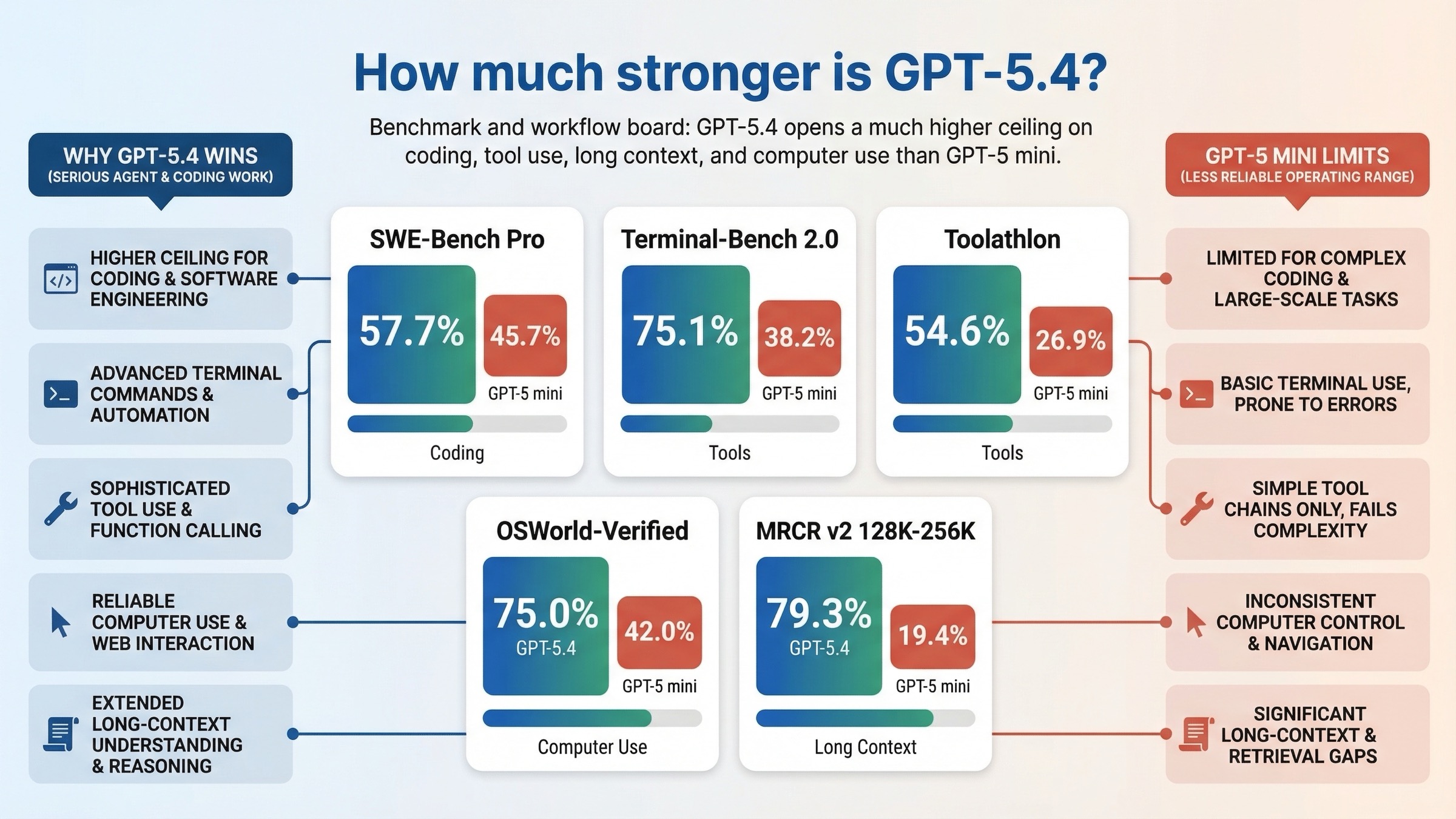

このキーワードで一番有用な数字は、GPT-5.4 mini launch page の benchmark table にあります。そこでは GPT-5.4 と GPT-5 mini が直接比較されていて、主な差はこうです。

- SWE-Bench Pro: 57.7 vs 45.7

- Terminal-Bench 2.0: 75.1 vs 38.2

- Toolathlon: 54.6 vs 26.9

- GPQA Diamond: 93.0 vs 81.6

- OSWorld-Verified: 75.0 vs 42.0

- MRCR v2 128K-256K: 79.3 vs 19.4

この差は見栄えだけのものではありません。長文脈、ツール使用、terminal-style work、UI を伴う computer-use workload で、GPT-5.4 の operating range がずっと広いことを示しています。repo assistant、coding agent、browser operator、document-heavy copilot に近いシステムほど、この差はそのまま UX に現れます。

もちろん注意点もあります。同じ表では GPT-5 mini は high まで、GPT-5.4 は xhigh で評価されています。つまり純粋なラボ比較ではなく、今実際に使える製品設定の比較です。ただ、買い手が知りたいのはまさにその「今使える製品差」なので、この情報は十分に実用的です。

どんなときに GPT-5.4 の追加コストを払う価値があるか

GPT-5.4 が高くても合理的なのは、安いモデルを使うことで単に答えが少し弱くなるだけではなく、再試行、補助ロジック、人間の修正、ワークフローの継ぎ足しが増えるときです。

第一のケースは 長いコンテキスト です。大きな repo、多数の文書、複数ファイルにまたがる作業では、400K から 1.05M への差は、そのまま「何を一度に持ち込めるか」の差になります。chunking や manual orchestration を減らしたいなら、この余裕はかなり効きます。

第二のケースは agent と tool use です。GPT-5.4 は hosted shell、apply patch、skills、computer use、tool search を持ちます。GPT-5 mini にはそれがありません。もし product plan に delegation、environment manipulation、patching、wide tool inventory が入るなら、GPT-5.4 で初めて成立するシステムになります。

第三のケースは 失敗コストの高い professional output です。OpenAI は GPT-5.4 launch page で spreadsheet、document、presentation などの professional task を強く押しています。悪い答えが analyst time や engineering time、あるいは trust loss に直結するなら、モデルの追加コストは見た目より早く回収されます。

第四のケースは computer use と UI reasoning です。スクリーンショットや UI 操作を伴う workflow では、GPT-5.4 の product positioning も benchmark も、はっきりこちらを支持しています。

要するに、安いモデルの不足を補うためのエンジニアリング時間が増えるなら、GPT-5.4 は高くても合理的ということです。

どんなときに GPT-5 mini がまだ合理的か

GPT-5 mini が意味を持つのは、仕事が十分に狭く、GPT-5.4 の headroom の大半がそのまま“使わない余力への課金”になるときです。

最も強いケースは 高ボリュームで成熟したテキスト pipeline です。prompt が十分安定し、出力も厳密で、tool use が浅く、すでに business が満足しているなら、10倍の input 差は benchmark より重くなります。

次のケースは 単純な structured generation です。分類、ラベリング、ルーティング、軽い抽出、制御された text production が中心なら、GPT-5 mini は今でも合理的な cheap branch です。特に production behavior をすでに理解しているなら、その価値は残ります。

三つ目は dual-route architecture です。難しい作業は別の強いモデルに任せていて、簡単な仕事のための最安 OpenAI lane だけ欲しいなら、GPT-5 mini を残す理由は十分あります。

加えて、移行は常に即断ではありません。新しい推薦が出たからといって production route を全部置き換える必要はありません。GPT-5 mini がすでに計測済みで許容範囲なら、まず見るべきは「実際にどこで損しているか」です。

どんなときに GPT-5.4 mini を先に試すべきか

ここは多くの比較記事が本当は一番先に書くべき部分です。

もしあなたの本当の目的が「GPT-5.4 より安い現代的な default を探すこと」なら、現在の docs は GPT-5 mini ではなく GPT-5.4 mini を先に見ろと言っています。

重要なのは次の四つです。第一に 新しい low-latency product。GPT-5 mini ページ自身が、新しい低遅延・高ボリューム workload は GPT-5.4 mini から始めるべきだと書いています。第二に subagent architecture。3月17日の launch page は GPT-5.4 を planning/final judgment、GPT-5.4 mini を narrower task parallelism として描いています。第三に 旧 cheap route からの移行。latest-model guide は GPT-5.4 mini を o4-mini や GPT-4.1 mini の置き換えとして勧めています。第四に Codex-style 利用。同じ launch page は、GPT-5.4 mini が Codex app、CLI、IDE extension、web に入り、Codex では GPT-5.4 quota の 30% で済むと説明しています。

つまり、「より安い現代的な小型ルート」を探しているなら、今の本命は GPT-5 mini ではなく GPT-5.4 mini です。

チーム向けの実践ルーティングルール

チーム向けにそのまま使える表が必要なら、次のように整理できます。

| ワークロード | デフォルト選択 | 理由 | 上書き前に試すこと |

|---|---|---|---|

| 長い repo / 長文書処理 | GPT-5.4 | 1.05M context と long-context benchmark の強さ | 実際に 400K 超を使っているか |

| Tool-heavy coding / agent workflow | GPT-5.4 | tool surface が広く、tool/terminal benchmark 差も大きい | 細いタスクを GPT-5.4 mini に出せるか |

| 安定した安価テキスト生成 | GPT-5 mini | input 10倍差、output 7.5倍差が効く | GPT-5.4 mini で十分な改善が出るか |

| 新規の low-latency 高スループット案件 | まず GPT-5.4 mini | 公式推奨の small default がこちらだから | 本当に flagship context が必要か |

| premium lane と cheap lane の混合構成 | GPT-5.4 + GPT-5.4 mini | 現在の OpenAI product tree と整合的 | legacy GPT-5 mini lane がまだ採算に合うか |

もっと短く言うなら、難しい仕事が製品を規定するなら GPT-5.4、安い狭い仕事が製品を規定するなら GPT-5 mini、どちらでもないなら GPT-5.4 mini を試す です。

FAQ

GPT-5 mini は deprecated ですか。

いいえ。2026年3月20日 時点で GPT-5 mini には現行モデルページも価格もあります。問題は消えたことではなく、OpenAI が新規構築向けの前向きな cheap default として最初に勧める位置ではなくなったことです。

GPT-5.4 は常に高いだけの価値がありますか。

いいえ。仕事が狭く、安定していて、cheap text first なら過剰です。払う理由はステータスではなく、retry 減少、長文脈、広い tool surface にあります。

一番大きな実務差は何ですか。

単一の benchmark ではありません。大きな context、より新しい cutoff、広い tool surface、そして professional/agentic work 向けに設計された product role の組み合わせです。

いつ GPT-5 mini ではなく GPT-5.4 mini を比較対象にすべきですか。

新規構築で premium lane と modern smaller lane を選びたいときです。2026年にゼロから始めるなら、GPT-5.4 mini の方が現実の routing に近い比較になります。

すでに GPT-5 mini を production で使っている場合はどうすべきですか。

盲目的に移行しないことです。品質、tool use、context、reliability のどこで本当に損しているかを測り、利益が小さくコスト増が大きいなら残してもよいです。逆に workflow が agent や広い tool use、大きな context に寄っているなら、移行の根拠はかなり強くなります。