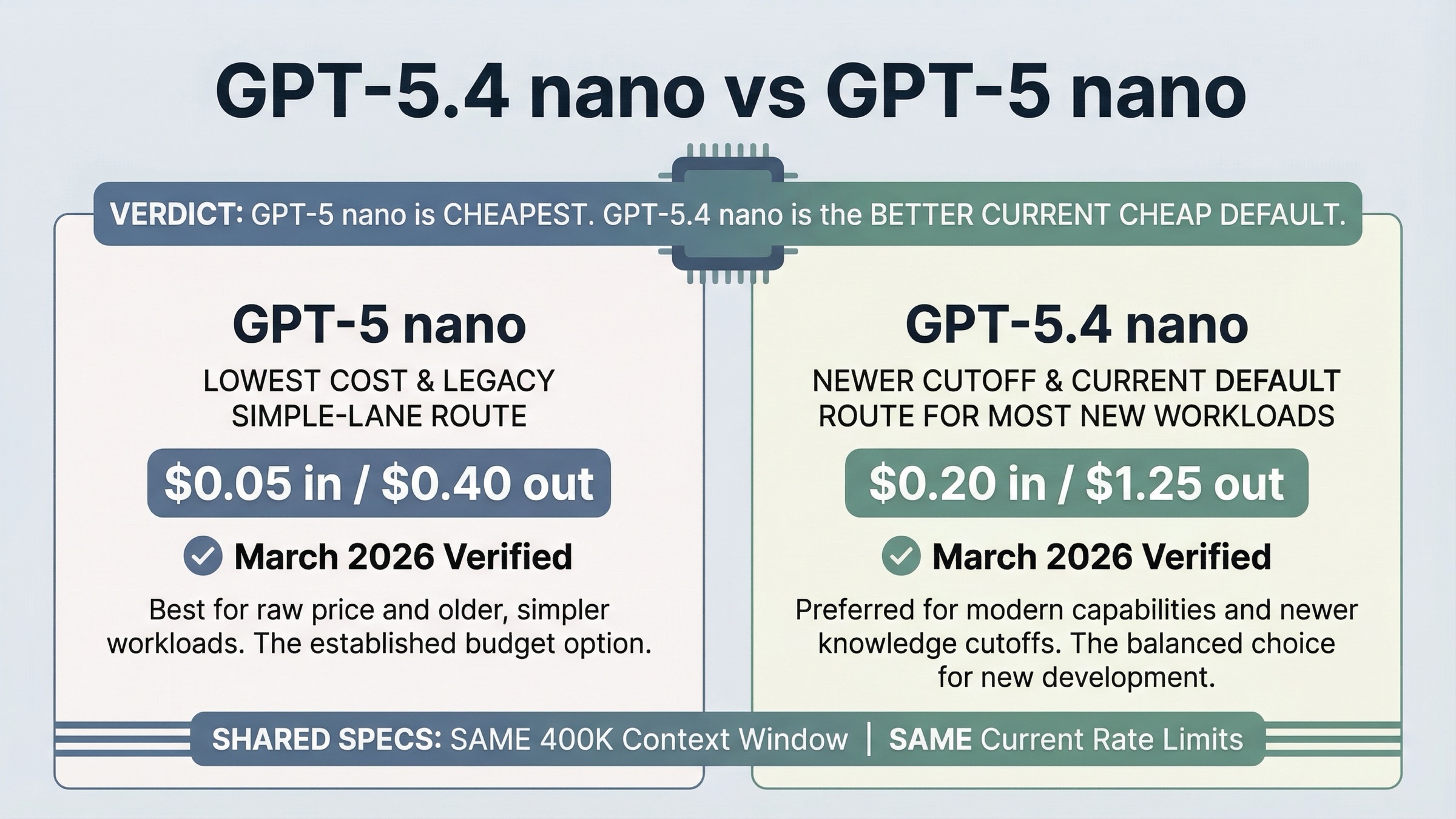

GPT-5.4 nano suele ser el default barato correcto para trabajo nuevo en OpenAI API. Si vas a abrir un carril barato nuevo para classification, extraction, ranking o helper agents sencillos, normalmente es la opción más equilibrada porque conserva el mismo contexto y los mismos rate limits publicados mientras gana en cutoff, reasoning y tool surface. Deja GPT-5 nano solo para casos donde el coste mínimo por token pese más que todo eso y la carga sea tan simple y estable que el ahorro bruto sea el criterio principal.

La separación útil es simple: ambos comparten 400.000 tokens de contexto y 128.000 de salida máxima, así que esto no va realmente de contexto ni de throughput. Va de coste contra capacidad: la lane legacy más barata para flujos ultracomprimidos frente a la lane barata moderna que hoy encaja mejor cuando quieres seguir en bajo coste sin quedarte en la rama vieja.

Resumen rápido

| Modelo | Mejor para | Por qué elegirlo | Principal desventaja |

|---|---|---|---|

| GPT-5 nano | Summarization barata, classification ligera y flujos donde el coste mínimo manda | Es claramente más barata en input, cached input y output | Cutoff más viejo y una superficie de herramientas más limitada |

| GPT-5.4 nano | Nuevos flujos de extraction, ranking, helper agents y carriles baratos modernos | OpenAI ya la coloca como punto de partida para la mayoría de los nuevos workloads baratos | Cuesta unas 4 veces más que GPT-5 nano |

Si quieres una sola regla práctica: quédate en GPT-5 nano cuando el producto se defina por la factura más baja posible; empieza con GPT-5.4 nano cuando quieras un carril barato que siga siendo actual.

Aquí no comparas dos nano casi iguales, sino “lo más barato” frente a “el default actual”

Los nombres engañan. Las dos son nano, las dos están abajo en la jerarquía de precios y por eso parece que la diferencia debería ser pequeña.

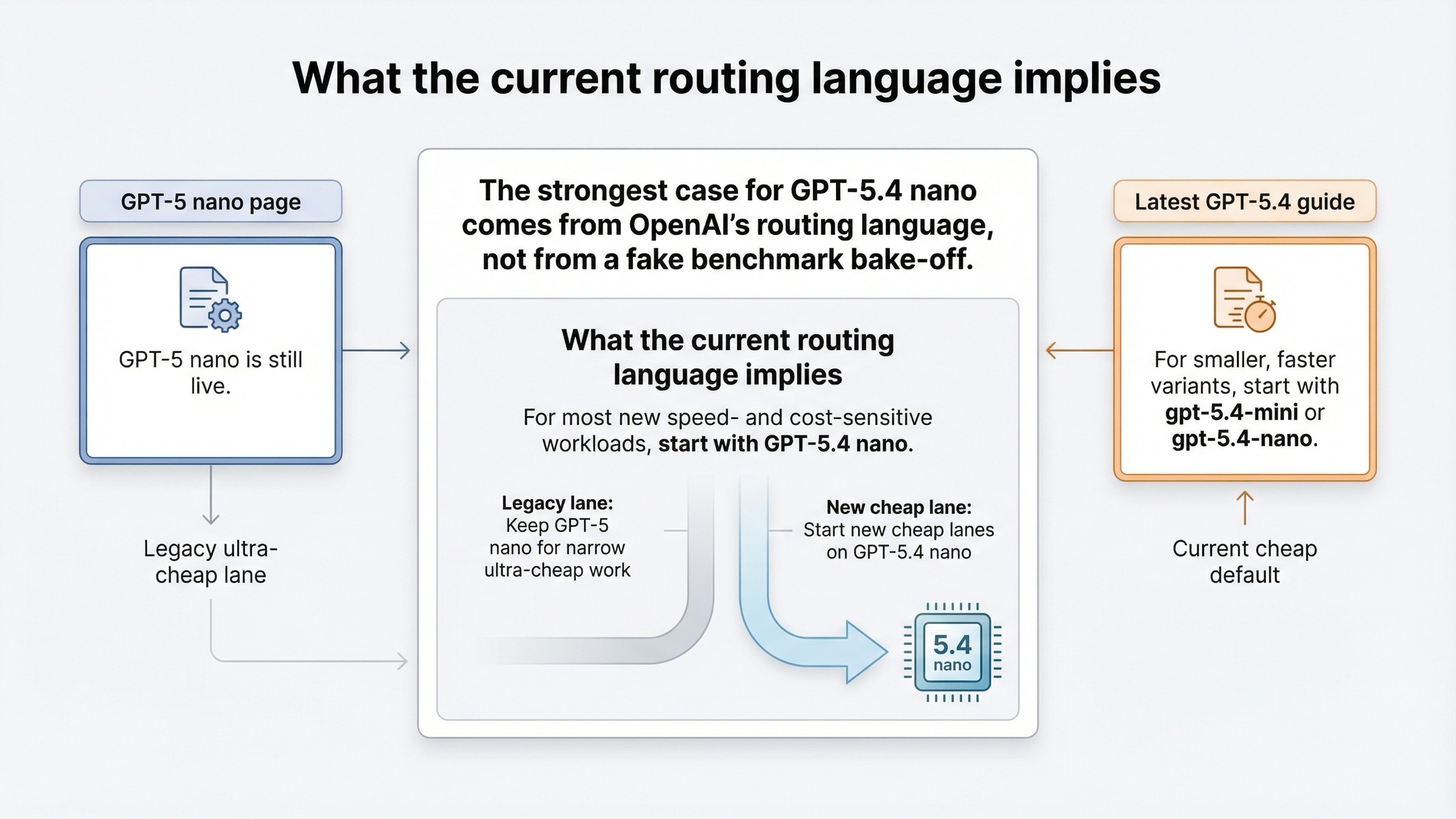

Pero la documentación actual de OpenAI apunta a otra lectura. GPT-5 nano sigue viva, sigue teniendo página, precio y casos de uso reales. No es un producto retirado. El cambio importante es que ya no parece ser la rama barata que OpenAI quiere para nuevos proyectos por defecto.

La frase decisiva está en la propia página de GPT-5 nano: para la mayoría de los nuevos speed- and cost-sensitive workloads, OpenAI recomienda empezar con GPT-5.4 nano. Eso cambia la interpretación completa del keyword. GPT-5 nano ya no es el inicio natural de un carril barato nuevo; es una rama ultrabarata que todavía tiene sentido cuando el coste manda de verdad.

La guía más reciente de GPT-5.4 empuja en la misma dirección: para smaller, faster variants, el punto de partida debe ser gpt-5.4-mini o gpt-5.4-nano. En otras palabras, la línea GPT-5.4 es ahora la rama “actual” para modelos pequeños, mientras que GPT-5 nano pasa a ser una opción más estrecha y más legacy.

Eso importa a nivel operativo. Si tu cheap lane toca documentación reciente, reglas que cambian, o pequeños pasos con herramientas, la decisión deja de ser solo financiera. La pregunta útil pasa a ser si quieres exprimir el precio mínimo absoluto o si prefieres una rama barata que siga alineada con la dirección actual de OpenAI para trabajo nuevo.

También conviene verlo así: como el contexto y los límites publicados siguen siendo iguales, migrar a GPT-5.4 nano no es comprar más techo, sino comprar una base barata más actual para trabajo nuevo.

Precio, frescura, herramientas y límites uno al lado del otro

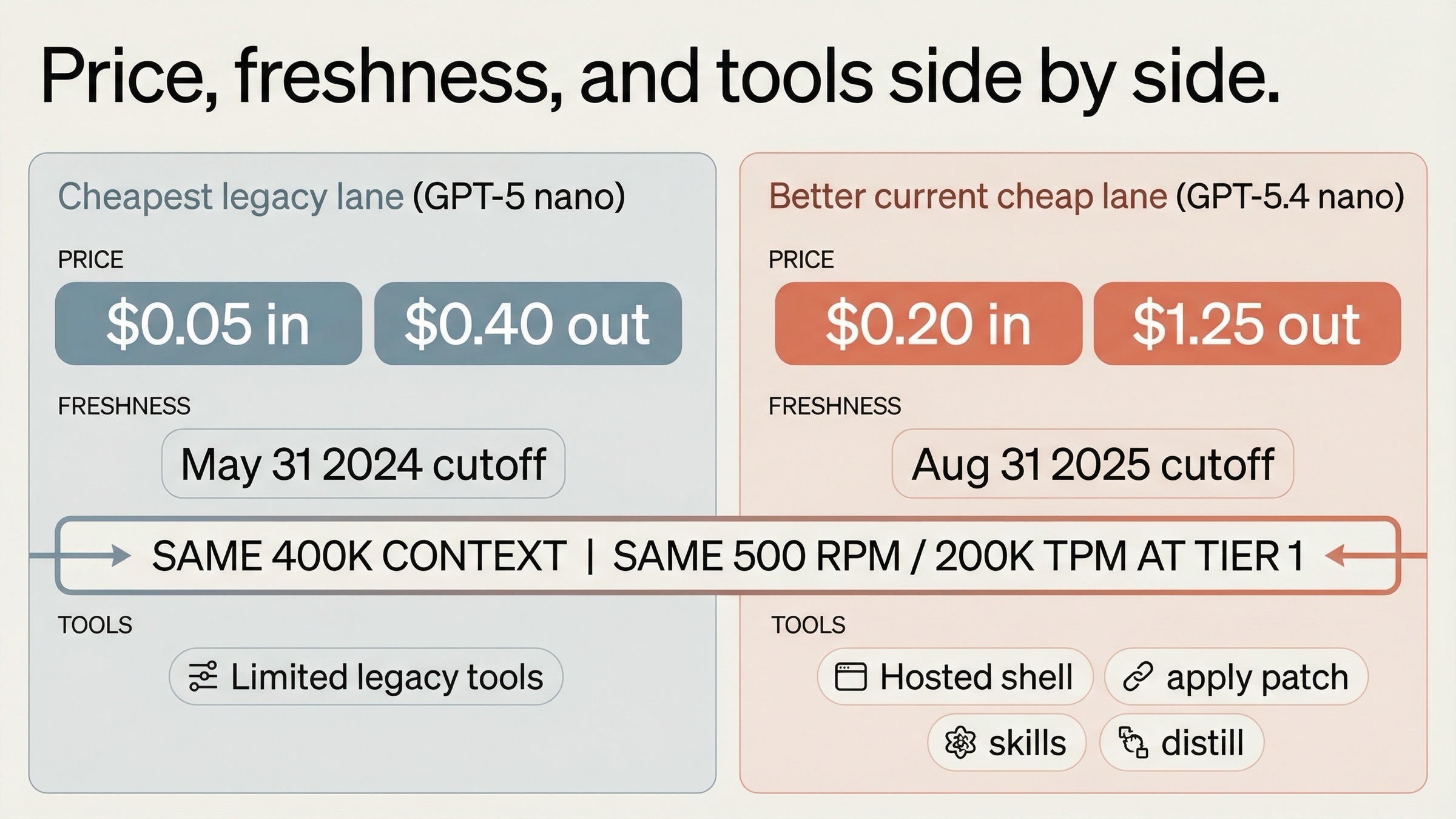

Según las páginas oficiales verificadas el 21 de marzo de 2026, GPT-5 nano cuesta $0.05 por 1M input tokens, $0.005 de cached input y $0.40 por 1M output tokens. GPT-5.4 nano cuesta $0.20 input, $0.02 cached input y $1.25 output. Para un sistema con muchísimo tráfico corto, esa diferencia es decisiva.

Pero el ahorro de GPT-5 nano no viene acompañado por la misma frescura ni por la misma profundidad de herramientas. Su cutoff es 31 de mayo de 2024, mientras que GPT-5.4 nano sube a 31 de agosto de 2025. Para un carril barato que aún toca APIs, librerías y documentación reciente, la diferencia es grande.

También cambia el tool surface. GPT-5.4 nano hoy incluye hosted shell, apply patch, skills y distillation, mientras que GPT-5 nano no. Si tu carril barato solo resume texto, tal vez no importe. Si ya participa en extraction, ranking o helper-agent work, importa bastante.

| Especificación | GPT-5.4 nano | GPT-5 nano |

|---|---|---|

| Precio input | $0.20 / 1M | $0.05 / 1M |

| Cached input | $0.02 / 1M | $0.005 / 1M |

| Precio output | $1.25 / 1M | $0.40 / 1M |

| Context window | 400.000 | 400.000 |

| Max output | 128.000 | 128.000 |

| Knowledge cutoff | 2025-08-31 | 2024-05-31 |

| Nivel de reasoning en la ficha | High | Average |

| Snapshot | gpt-5.4-nano-2026-03-17 | gpt-5-nano-2025-08-07 |

| Hosted shell | Sí | No |

| Apply patch | Sí | No |

| Skills | Sí | No |

| Distillation | Sí | No |

| MCP | Sí | Sí |

| Image generation | Sí | Sí |

| Tier 1 | 500 RPM / 200.000 TPM | 500 RPM / 200.000 TPM |

| Tier 5 | 30.000 RPM / 180.000.000 TPM | 30.000 RPM / 180.000.000 TPM |

La fila más importante aquí no es la del precio, sino la de límites. Como ambos modelos mantienen el mismo contexto y los mismos límites publicados, la comparación queda mucho más limpia: más barato pero más viejo frente a más caro pero más actual y más capaz dentro de un carril barato.

Lo que realmente implica el routing language actual de OpenAI

OpenAI no publica una benchmark table perfecta que enfrente directamente GPT-5.4 nano y GPT-5 nano en todas las filas que interesan. Por eso sería incorrecto fingir que existe un “knockout” definitivo por benchmarks. El argumento más fuerte a favor de GPT-5.4 nano hoy viene de otro sitio: del lenguaje de routing de OpenAI y de las diferencias objetivas de sus páginas de modelo.

La frase clave, otra vez, está en la propia página de GPT-5 nano: para la mayoría de los nuevos speed- and cost-sensitive workloads, hay que empezar con GPT-5.4 nano. Esa frase no se escribe sobre la rama que sigue siendo el default barato para proyectos nuevos.

La guía de GPT-5.4 remata el mismo mensaje desde arriba: si buscas variantes pequeñas y rápidas, empieza por gpt-5.4-mini o gpt-5.4-nano. Eso no significa que GPT-5 nano haya dejado de servir; significa que ha dejado de ser la primera recomendación para diseñar un cheap lane nuevo.

El post Introducing GPT-5.4 mini and nano refuerza esa idea porque posiciona GPT-5.4 nano para classification, data extraction, ranking y simpler subagents. El post Introducing GPT-5 for developers explica por qué GPT-5 nano sigue importando: nació como la rama más barata. En 2026 sigue teniendo ese papel, pero ahora parece más una opción ultrabarata y estrecha que el camino recomendado para empezar.

Cuándo GPT-5 nano sigue siendo mejor

GPT-5 nano sigue siendo la mejor elección cuando el carril barato se define por el coste mínimo absoluto.

El caso más claro es el tráfico masivo de summarization y classification ligera donde la calidad ya es suficiente y lo que más importa es el coste por token. Si el prompt es estable y el error no sale demasiado caro, pagar una cuarta parte del input puede valer más que ganar un cutoff más nuevo o mejores herramientas.

También puede seguir teniendo sentido en arquitecturas donde el carril barato solo hace el primer filtrado antes de escalar a un modelo mejor. Si esa capa inicial no necesita hosted shell, apply patch, skills ni conocimiento reciente, GPT-5 nano sigue siendo racional.

Y, por supuesto, existe el argumento de la confianza operativa. Si ya la tienes en producción, conoces su comportamiento y la economía del sistema ya está afinada alrededor de esa rama, mantenerla puede ser sensato. Pero eso debe ser una decisión medida, no una costumbre basada en el nombre.

Tiene sentido quedarse con GPT-5 nano si la mayoría de estos puntos se cumple:

- la carga es simple, textual y muy estable;

- el coste mínimo importa más que el cutoff nuevo y el tool surface;

- no necesitas hosted shell, apply patch, skills ni distillation;

- todavía no ves una ganancia suficientemente grande al migrar.

Cuándo compensa pagar más por GPT-5.4 nano

GPT-5.4 nano compensa cuando el cheap lane debe seguir siendo barato, pero ya no puede ser “solo barato”.

El primer caso fuerte es extraction, ranking y helper-agent work. OpenAI la coloca precisamente ahí, lo que indica que no es un simple reemplazo económico, sino una rama barata que todavía puede sostener tareas modernas.

El segundo caso es cualquier flujo barato que gane valor con una superficie de herramientas mejor. Hosted shell, apply patch, skills y distillation pueden cambiar completamente lo que ese carril puede hacer dentro de un stack agentic.

El tercer caso es la frescura. Si tu carril barato toca APIs o librerías recientes, el salto entre mayo de 2024 y agosto de 2025 importa de verdad.

El cuarto caso es arquitectura nueva. Si diseñas el sistema hoy y no estás defendiendo un legacy setup, la forma más razonable de empezar suele ser seguir la dirección actual de OpenAI y tomar GPT-5.4 nano como default, dejando que GPT-5 nano tenga que demostrar que su ahorro justifica el retroceso en frescura y herramientas.

GPT-5.4 nano suele ser la primera candidata si:

- estás montando un cheap lane nuevo;

- la tarea incluye extraction, ranking, helper agents o trabajo estructurado;

- un cutoff más reciente reduce riesgo real;

- esa rama gana con hosted shell, apply patch, skills o distillation;

- quieres alinearte con la línea de producto actual de OpenAI.

Si incluso así GPT-5.4 nano se queda corta, la comparación útil ya no es esta, sino GPT-5.4 mini vs GPT-5.4 nano.

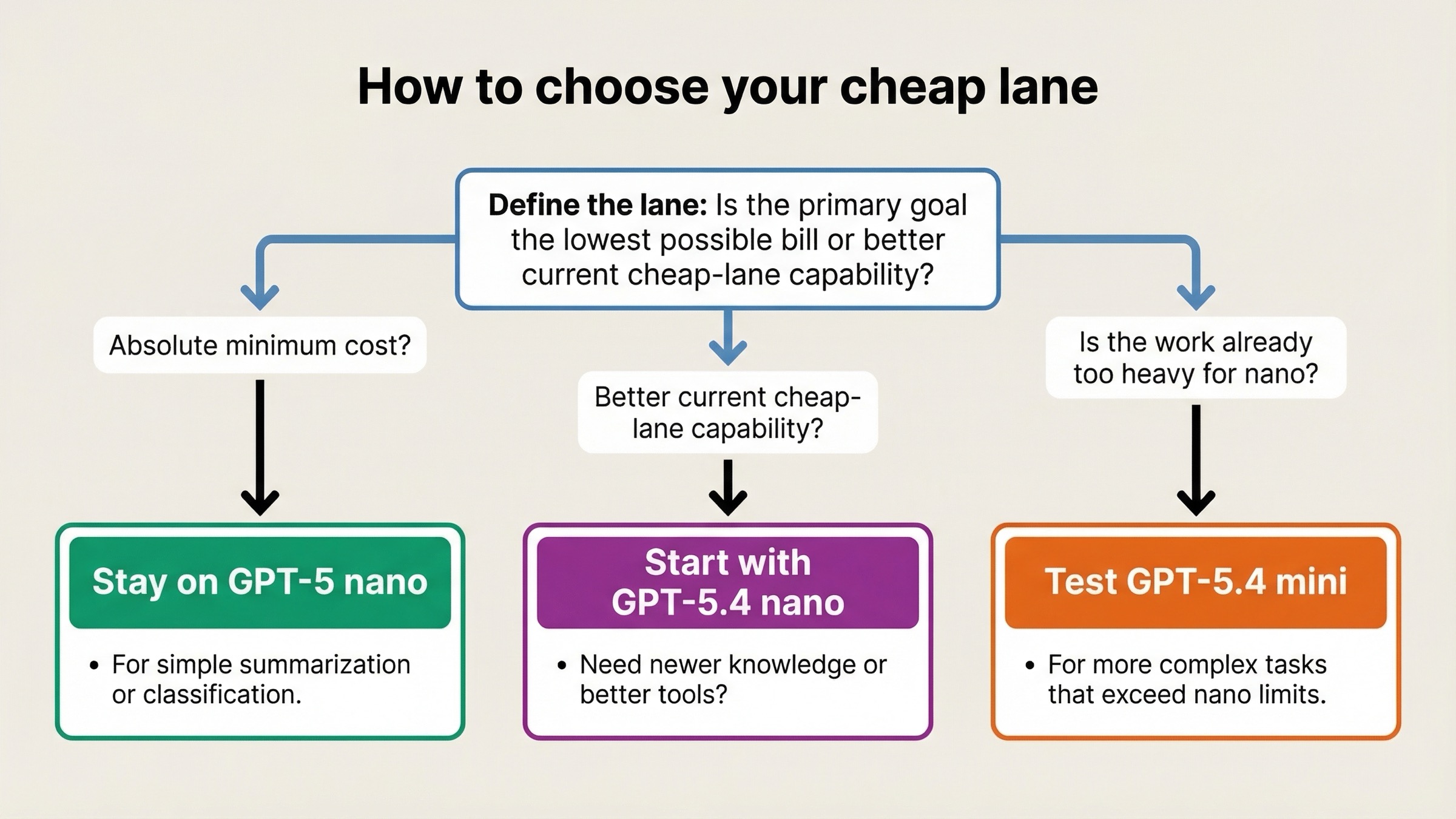

Cómo decidirlo en tu stack

La pregunta más útil es muy simple: ¿esta rama existe para minimizar la factura o para ofrecer mejor capacidad barata actual?

Si existe para minimizar la factura, empieza con GPT-5 nano y solo sube si los errores empiezan a costar demasiado. Si existe para ofrecer mejor capacidad barata actual, empieza con GPT-5.4 nano y solo retrocede si la diferencia de precio pesa más que la mejora.

Mi regla práctica sería esta:

- Quédate en GPT-5 nano si la rama es simple, textual y extremadamente sensible al coste.

- Empieza con GPT-5.4 nano si sigue siendo una rama barata, pero ya necesita conocimiento más fresco y mejor tool surface.

- Si GPT-5.4 nano ya se te queda corta, deja de compararla con GPT-5 nano y pasa a GPT-5.4 mini vs GPT-5.4 nano.

También conviene probarlo de una forma más operativa y menos teórica. Escoge un cheap lane real que ya exista o que vayas a lanzar pronto, como summarization de tickets, classification de leads, extraction de campos o ranking ligero, y pásalo por las dos ramas con el mismo lote de entradas. Después compara no solo el coste por tokens, sino cuántos reintentos necesitas, cuánta lógica defensiva te obliga a añadir cada modelo y cuánto trabajo humano queda para dejar la salida en un nivel aceptable.

Ese ejercicio suele aclarar el punto más importante de toda la comparación. GPT-5 nano gana de forma limpia cuando el sistema de verdad está optimizado para la factura mínima y la calidad actual ya basta. GPT-5.4 nano empieza a justificar el salto cuando la rama barata necesita tocar información más reciente, soportar flujos más estructurados o encajar mejor dentro de un stack con herramientas. En otras palabras: a veces la diferencia de precio no se recupera en el propio token, pero sí en menos fricción operativa alrededor del token.

Ese matiz importa mucho en equipos que no están eligiendo un modelo aislado, sino el primer escalón de una arquitectura completa. Si el cheap lane va a clasificar, extraer, enrutar y preparar trabajo para otras capas, el coste total ya no depende solo del precio por millón de tokens. También depende de cuántas reglas extras necesitas para corregir salidas viejas, cuánto fallback debes mantener para datos recientes y cuántas veces acabas escalando a un modelo superior porque la rama barata se queda corta demasiado pronto.

Si aún te falta la parte de acceso a la API, aquí no hay versión localizada de esa guía y toca dejar el enlace en inglés: OpenAI API key guide. Si tu duda real es “nano nueva” contra “mini vieja”, la siguiente lectura útil es GPT-5.4 nano vs GPT-5 mini.

FAQ

¿GPT-5 nano está deprecada?

No. A fecha de 21 de marzo de 2026 sigue teniendo página, precio y límites activos. El punto no es que haya desaparecido, sino que ya no parece ser la primera recomendación para nuevos workloads baratos.

¿GPT-5.4 nano vale 4 veces más porque es 4 veces mejor?

No se puede afirmar así. OpenAI no publica una tabla directa que lo pruebe. Lo que sí puedes decir es que GPT-5.4 nano compra frescura, mejor postura de reasoning y una superficie de herramientas más completa sin pedirte menos contexto ni peores límites actuales.

¿Cuál es la mejor razón para seguir con GPT-5 nano?

El precio. Si el workload es simple, estable y enorme en volumen, la ventaja económica de GPT-5 nano sigue siendo real.

¿Cuál es la mejor razón para pasar a GPT-5.4 nano?

Que quieres un cheap lane que siga siendo actual. OpenAI dirige allí los nuevos workloads baratos y la rama ofrece mejor cutoff y mejor tool surface.

La conclusión más corta y honesta es esta: GPT-5 nano sigue ganando cuando el producto exige la factura más baja posible; GPT-5.4 nano suele ganar cuando necesitas el mejor cheap lane actual para trabajo nuevo.